基于重合度损失优化模型的文本识别方法及装置与流程

1.本发明涉及深度学习技术领域,尤其涉及一种基于重合度损失优化模型的文本识别方法及装置。

背景技术:

2.随着生产力的发展和科技的进步,消费者对信息筛选的准确性及高效性要求越来越高,特别是在对广告信息的筛选方面,常见的通过关键词匹配等技术来提取文本中的品牌或品类信息的方式,由于其适用范围不够广泛且准确率低,已经不能很好地满足用户需求。

3.现有的语义分析方式,一般通过构建深度学习模型对文本信息进行语义分析,提高了泛化性和识别准确率。但是,目前对深度学习模型的训练优化大多是基于交叉熵损失函数,该损失函数仅在微观意义上考虑损失而不是全局考虑,对所有标签的重视程度一致,但是针对一些特殊的文本,由于具有特定意义的标签词在文本中所占比例往往较小,导致此方式对语义识别准确率的提升有限。因此,提出一种如何提升对文本中具有特定意义的标签的识别准确率的技术方案显得尤为重要。

技术实现要素:

4.本发明所要解决的技术问题在于,提供一种基于重合度损失优化模型的文本识别方法及装置,能够实现在语义分析过程中对不同实体给予不同的重视程度,提升对文本中具有特定意义的标签的识别准确率。

5.为了解决上述技术问题,本发明第一方面公开了一种基于重合度损失优化模型的文本识别方法,所述方法包括:

6.确定待预测文本;

7.将所述待预测文本输入至训练好的文本识别模型,得到所述待预测文本对应的文本特征标签;其中,所述训练好的文本识别模型基于重合度损失函数被训练得到;所述重合度损失函数与所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度相关。

8.作为一种可选的实施方式,在本发明第一方面中,所述重合度损失函数的值,与所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度成反比。

9.作为一种可选的实施方式,在本发明第一方面中,所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为所述预测标签分布的全部可能结果中和所述真实标签分布的全部可能结果中表示结果相同的数量与2的乘积,与所述预测标签分布和所述真实标签分布的全部可能结果的数量之和的比值。

10.作为一种可选的实施方式,在本发明第一方面中,所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为文本识别模

型在训练时的所有训练数据单元的预测真实二倍积之和与所有训练数据单元的预测真实平方求和值之和的比值;所述预测真实二倍积为每一训练数据单元的预测标签值与真实标签值与2的乘积;所述预测真实平方求和值为每一训练数据单元的预测标签值的平方值与真实标签值的平方值之和。

11.作为一种可选的实施方式,在本发明第一方面中,所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和的第一修正值与所有训练数据单元的预测真实平方求和值之和的第二修正值的比值;所述第一修正值为所述预测真实二倍积之和与第一修正因子之和,所述第二修正值为所述预测真实平方求和值之和与第二修正因子之和,所述第一修正因子和所述第二修正因子均为非负数;所述预测真实二倍积为每一训练数据单元的预测标签值与真实标签值与2的乘积;所述预测真实平方求和值为每一训练数据单元的预测标签值的平方值与真实标签值的平方值之和;

12.所述真实标签值在所述训练数据单元不属于所述文本特征标签时为零。

13.作为一种可选的实施方式,在本发明第一方面中,所述训练好的文本识别模型通过以下步骤被训练得到:

14.从符合第一预设条件的多个训练文本中获得训练数据,对所述文本识别模型进行训练;

15.当所述文本识别模型在训练中满足第二预设条件时,将所述文本识别模型作为所述训练好的文本识别模型。

16.作为一种可选的实施方式,在本发明第一方面中,所述从符合第一预设条件的多个训练文本中获得训练数据,包括:

17.对于每一符合第一预设条件的训练文本,根据该训练文本中的每一训练文本单元的是否属于所述文本特征标签以及位置,逐一生成该训练文本中每一训练文本单元对应的标签,得到该训练文本对应的标签序列;

18.对所有所述训练文本对应的所述标签序列进行独热编码,得到训练数据。

19.作为一种可选的实施方式,在本发明第一方面中,所述第一预设条件包括:

20.所述训练文本的类型与所述待预测文本的类型相同;和/或,

21.所述第二预设条件包括:

22.与所述训练数据中的当前训练数据对应的重合度损失函数的值小于或等于设定阈值。

23.本发明第二方面公开了一种基于重合度损失优化模型的文本识别装置,所述装置包括:

24.确定模块,用于确定待预测文本;

25.输入模块,用于将所述待预测文本输入至训练好的文本识别模型,得到所述待预测文本对应的文本特征标签;其中,所述训练好的文本识别模型基于重合度损失函数被训练得到;所述重合度损失函数与文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度相关。

26.作为一种可选的实施方式,在本发明第二方面中,所述重合度损失函数的值,与所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的

重合度成反比。

27.作为一种可选的实施方式,在本发明第二方面中,所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为所述预测标签分布的全部可能结果中和所述真实标签分布的全部可能结果中表示结果相同的数量与2的乘积,与所述预测标签分布和所述真实标签分布的全部可能结果的数量之和的比值。

28.作为一种可选的实施方式,在本发明第二方面中,所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和与所有训练数据单元的预测真实平方求和值之和的比值;所述预测真实二倍积为每一训练数据单元的预测标签值与真实标签值与2的乘积;所述预测真实平方求和值为每一训练数据单元的预测标签值的平方值与真实标签值的平方值之和。

29.作为一种可选的实施方式,在本发明第二方面中,所述文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和的第一修正值与所有训练数据单元的预测真实平方求和值之和的第二修正值的比值;所述第一修正值为所述预测真实二倍积之和与第一修正因子之和,所述第二修正值为所述预测真实平方求和值之和与第二修正因子之和,所述第一修正因子和所述第二修正因子均为非负数;所述预测真实二倍积为每一训练数据单元的预测标签值与真实标签值与2的乘积;所述预测真实平方求和值为每一训练数据单元的预测标签值的平方值与真实标签值的平方值之和;

30.所述真实标签值在所述训练数据单元不属于所述文本特征标签时为零。

31.作为一种可选的实施方式,在本发明第二方面中,所述装置还包括训练模块,用于执行以下步骤训练得到所述训练好的文本识别模型:

32.从符合第一预设条件的多个训练文本中获得训练数据,对所述文本识别模型进行训练;

33.当所述文本识别模型在训练中满足第二预设条件时,将所述文本识别模型作为所述训练好的文本识别模型。

34.作为一种可选的实施方式,在本发明第二方面中,所述训练模块从符合第一预设条件的多个训练文本中获得训练数据的具体方式,包括:

35.对于每一符合第一预设条件的训练文本,根据该训练文本中的每一训练文本单元的是否属于所述文本特征标签以及位置,逐一生成该训练文本中每一训练文本单元对应的标签,得到该训练文本对应的标签序列;

36.对所有所述训练文本对应的所述标签序列进行独热编码,得到训练数据。

37.作为一种可选的实施方式,在本发明第二方面中,所述第一预设条件包括:

38.所述训练文本的类型与所述待预测文本的类型相同;和/或,

39.所述第二预设条件包括:

40.与所述训练数据中的当前训练数据对应的重合度损失函数的值小于或等于设定阈值。

41.本发明第三方面公开了另一种基于重合度损失优化模型的文本识别装置,所述装置包括:

42.存储有可执行程序代码的存储器;

43.与所述存储器耦合的处理器;

44.所述处理器调用所述存储器中存储的所述可执行程序代码,执行本发明第一方面公开的基于重合度损失优化模型的文本识别方法。

45.与现有技术相比,本发明实施例具有以下有益效果:

46.本发明实施例中,通过确定待预测文本,将待预测文本输入至训练好的文本识别模型,从而得到待预测文本对应的文本特征标签;其中,训练好的文本识别模型基于重合度损失函数被训练得到;重合度损失函数与文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度相关。可见,实施本发明能够利用基于重合度损失函数进行训练优化的文本识别模型对待预测文本对应的文本特征标签进行识别,实现在语义分析过程中对不同实体给予不同的重视程度,提升对文本中具有特定意义的标签的识别准确率。

附图说明

47.为了更清楚地说明本发明实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

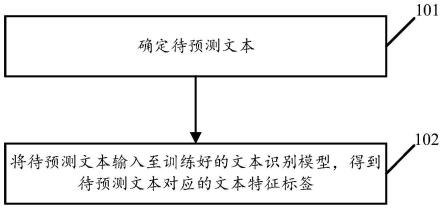

48.图1是本发明实施例公开的一种基于重合度损失优化模型的文本识别方法的流程示意图;

49.图2是本发明实施例公开的另一种基于重合度损失优化模型的文本识别方法的流程示意图;

50.图3是本发明实施例公开的一种基于重合度损失优化模型的文本识别装置的结构示意图;

51.图4是本发明实施例公开的另一种基于重合度损失优化模型的文本识别装置的结构示意图;

52.图5是本发明实施例公开的另一种基于重合度损失优化模型的文本识别装置的结构示意图;

53.图6是本发明实施例公开的一种标签矩阵示意图;

54.图7是本发明实施例公开的一种概率分布示意图;

55.图8是本发明实施例公开的另一种标签矩阵示意图;

56.图9是本发明实施例公开的另一种概率分布示意图。

具体实施方式

57.为了使本技术领域的人员更好地理解本发明方案,下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部的实施例。基于本发明中的实施例,本领域普通技术人员在没有作出创造性劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。

58.本发明的说明书和权利要求书及上述附图中的术语“第一”、“第二”等是用于区别

不同对象,而不是用于描述特定顺序。此外,术语“包括”和“具有”以及它们任何变形,意图在于覆盖不排他的包含。例如包含了一系列步骤或单元的过程、方法、装置、产品或端没有限定于已列出的步骤或单元,而是可选地还包括没有列出的步骤或单元,或可选地还包括对于这些过程、方法、产品或端固有的其他步骤或单元。

59.在本文中提及“实施例”意味着,结合实施例描述的特定特征、结构或特性可以包含在本发明的至少一个实施例中。在说明书中的各个位置出现该短语并不一定均是指相同的实施例,也不是与其它实施例互斥的独立的或备选的实施例。本领域技术人员显式地和隐式地理解的是,本文所描述的实施例可以与其它实施例相结合。

60.随着新的深度学习模型的出现,传统的语义分析方式正逐渐被基于深度学习方法的语义分析方式所替代,目前的深度学习方法大多是基于交叉熵损失函数来优化模型,该损失对所有标签的重视程度一致。然而在实际识别任务中,目标标签在所有文本标签中所占的比例往往较小,因此没有使深度学习模型的优势得到充分发挥。

61.在此背景下,本发明公开了一种基于重合度损失优化模型的文本识别方法及装置,能够实现在语义分析过程中对不同实体给予不同的重视程度,提升对文本中具有特定意义的实体的识别准确率。以下分别进行详细说明。

62.实施例一

63.请参阅图1,图1是本发明实施例公开的一种基于重合度损失优化模型的文本识别方法的流程示意图。其中,图1所描述的方法可以应用于文本处理装置中,该处理装置可以是相应的处理终端、处理设备或处理服务器,且该服务器可以是本地服务器,也可以是云服务器,本发明实施例不做限定。如图1所示,该基于重合度损失优化模型的文本识别方法可以包括以下操作:

64.101、确定待预测文本。

65.可选的,待预测文本的确定方式,可以为人工筛选确定,也可以通过对特定网络地址的文本进行爬虫抓取。

66.可选的,待预测文本的类型,可以是广告类文本,也可以是网络小说、剧本类文本。优选的,待预测文本的类型为广告类文本。本发明中的方案应用在广告类文本的品牌词或品类词的识别中有优异的效果,这是因为品牌词和品类词在广告类文本中所占比例往往较小。

67.可选的,待预测文本的语言种类并不限定为中文,也可以为英文、法文等其他语法明确的语言。

68.本发明对待预测文本的确定方式、待预测文本的类型和待预测文本的语言种类均不做具体限定。

69.102、将待预测文本输入至训练好的文本识别模型,得到待预测文本对应的文本特征标签。

70.其中,训练好的文本识别模型基于重合度损失函数被训练得到。可选的,重合度损失函数与文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度相关。

71.可选的,通过最小化重合度损失函数直至收敛,得到训练好的文本识别模型。待预测文本对应的文本特征标签,指的是待预测文本的标签中符合识别目标类型的标签。例如,

想对待预测广告类文本中的品牌和品类词进行识别,则文本特征标签为品牌和品类。

72.可见,实施本发明实施例能够利用基于重合度损失函数进行训练优化的文本识别模型对待预测文本对应的文本特征标签进行识别,实现在语义分析过程中对不同实体给予不同的重视程度,提升对文本中具有特定意义的标签的识别准确率。

73.在一个可选的实施例中,重合度损失函数的值,与文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度成反比。

74.可选的,文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度可以通过预测标签分布和真实标签分布之间的相似度来表示。

75.通过这样设置,经过对文本识别模型的训练,重合度的数值变大,则与重合度成反比的重合度损失函数的值变小,若重合度的数值无限趋近于1,则重合度损失函数收敛,文本识别模型训练完成。

76.可选的,重合度损失函数与重合度的反比关系,可以有多种表示方式。例如是:

77.iou_loss=1-iou

78.其中,iou_loss表示重合度损失函数,iou表示预测标签分布与对应的训练数据的真实标签分布之间的重合度。

79.可选的,也可以用其他表示方式表示重合度损失函数与重合度的反比关系,例如:

[0080][0081]

其中,iou_loss1表示重合度损失函数,iou1表示预测标签分布与对应的训练数据的真实标签分布之间的重合度,m为非负数。

[0082]

又例如:iou_loss2=-lg(iou2),iou2≠0;其中,iou_loss2表示重合度损失函数,iou2表示预测标签分布与对应的训练数据的真实标签分布之间的重合度。

[0083]

重合度损失函数与重合度的反比关系的表示方式在此不做具体限定。

[0084]

可见,通过实施该可选的实施方式,基于重合度损失函数来优化文本识别模型,通过设定重合度与重合度损失函数的关系为反比关系,使重合度损失函数直接优化两个分布的重叠程度,能够有效避免标签分布不平衡的情况。

[0085]

在一个可选的实施例中,文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为预测标签分布的全部可能结果中和真实标签分布的全部可能结果中表示结果相同的数量与2的乘积,与预测标签分布和真实标签分布的全部可能结果的数量之和的比值。

[0086]

通过这样设置,该重合度的数值可以用于表征预测标签分布和真实标签分布之间的重合度,在两者重合度为完全重合时,显然,预测标签分布的全部可能结果中和真实标签分布的全部可能结果中表示结果相同的数量等于预测标签分布和真实标签分布的全部可能结果的数量之和的二分之一,此时该重合度的数值为1,而在两者重合度为完全不重合时,显然,预测标签分布的全部可能结果中和真实标签分布的全部可能结果中表示结果相同的数量等于零,则此时该重合度的数值为零。显然,由上可见,该重合度的数值与预测标签分布和真实标签分布之间的重合度成正比。

[0087]

可见,本可选的实施例通过给出重合度具体的计算方式,使重合度损失函数直接用于表征预测标签分布和真实标签分布之间的重合度,能够使得模型训练优化中通过优化

该损失函数即可优化模型的预测能力,有效避免现有的基于交叉熵损失进行优化的方法中标签分布不平衡所带来的不良训练效果的情况。

[0088]

在一个可选的实施例中,文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和与所有训练数据单元的预测真实平方求和值之和的比值。

[0089]

具体的,预测真实二倍积为每一训练数据单元的预测标签值与真实标签值与2的乘积,预测真实平方求和值为每一训练数据单元的预测标签值的平方值与真实标签值的平方值之和。

[0090]

可见,本可选的实施例通过给出重合度具体的计算方式,使重合度损失函数直接用于表征预测标签分布和真实标签分布之间的重合度,能够使得模型训练优化中通过优化该损失函数即可优化模型的预测能力,有效避免现有的基于交叉熵损失进行优化的方法中标签分布不平衡所带来的不良训练效果的情况。

[0091]

在一个可选的实施例中,文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和的第一修正值与所有训练数据单元的预测真实平方求和值之和的第二修正值的比值。

[0092]

具体的,第一修正值为预测真实二倍积之和与第一修正因子之和,第二修正值为预测真实平方求和值之和与第二修正因子之和。具体的,第一修正因子和第二修正因子均为非负数,真实标签值在训练数据单元不属于文本特征标签时为零。

[0093]

这里,相比于前序实施例对重合度的计算方式,增加了第一修正因子和第二修正因子,优化了文本识别模型的训练过程。

[0094]

具体的,在实际对训练文本中的训练数据单元(如文本单字)进行编码时,对于真实标签值在训练数据单元不属于文本特征标签时为零的这种情况,若不存在第一修正因子和第二修正因子,则真实标签值为0,此时损失函数值为1,则该训练文本不能对最小化损失函数起到作用,因此该训练文本对文本识别模型的训练过程没有贡献。考虑到这种特殊情况,将第一修正因子和第二修正因子引入算法,使得在通过上述类型的训练文本进行模型训练优化时,可以计算得到准确的损失函数值以帮助模型进行优化收敛。

[0095]

可选的,第一修正因子和第二修正因子皆为非负数,第一修正因子和第二修正因子的值可以相同,也可以不相同,此处不做具体限定。

[0096]

可见,本可选的实施例通过给出重合度具体的计算方式,使重合度损失函数直接用于表征预测标签分布和真实标签分布之间的重合度,能够使得模型训练优化中通过优化该损失函数即可优化模型的预测能力,有效避免现有的基于交叉熵损失进行优化的方法中标签分布不平衡所带来的不良训练效果的情况。并且,通过在计算过程中引入第一修正因子和第二修正因子,避免了负样本对文本识别模型的训练起不到作用从而降低效率的情况发生,优化了文本识别模型的训练过程。

[0097]

实施例二

[0098]

请参阅图2,图2是本发明实施例公开的一种基于重合度损失优化模型的文本识别方法的流程示意图。其中,图2所描述的方法可以应用于文本处理装置中,该处理装置可以是相应的处理终端、处理设备或处理服务器,且该服务器可以是本地服务器,也可以是云服

务器,本发明实施例不做限定。如图2所示,该基于重合度损失优化模型的文本识别方法可以包括以下操作:

[0099]

201、确定待预测文本。

[0100]

202、从符合第一预设条件的多个训练文本中获得训练数据,对文本识别模型进行训练。

[0101]

203、当文本识别模型在训练中满足第二预设条件时,将文本识别模型作为训练好的文本识别模型。

[0102]

204、将待预测文本输入至训练好的文本识别模型,得到待预测文本对应的文本特征标签。

[0103]

上述步骤201、204的具体的技术细节和技术名词解释,可以参照实施例一中对步骤101-102的表述,在此不再赘述。

[0104]

可见,本发明实施例能够提高训练文本中存在目标标签类型的概率,并且使训练完成的文本识别模型具有较好的预测效果。

[0105]

在一个可选的实施例中,上述步骤202中的从符合第一预设条件的多个训练文本中获得训练数据,包括:

[0106]

对于每一符合第一预设条件的训练文本,根据该训练文本中的每一训练文本单元的是否属于文本特征标签以及位置,逐一生成该训练文本中每一训练文本单元对应的标签,得到该训练文本对应的标签序列;

[0107]

对所有训练文本对应的标签序列进行独热编码,得到训练数据。

[0108]

本可选的实施例的目的之一在于,防止数值表示的类别变量因数值之间并无实际意义的关系对深度学习模型带来无任何价值的额外信息干扰。在进行深度学习模型的建立前,首先需要对类别变量进行独热编码(one-hot encoding)处理。其中,独热编码作为一种编码方式,也称为一位有效编码,是分类变量作为二进制向量的表示。具体的,独热编码过程可以为:先将分类值映射到整数值,然后将每个整数值表示为二进制向量,其中,整数的索引标记为1,除了整数的索引之外,其他都是零值。

[0109]

可见,通过实施该可选的实施例,能够将训练文本对应的标签序列转换为独热编码,使得数据的分类更准确,从而预测结果更准确。

[0110]

在一个可选的实施例中,第一预设条件包括:训练文本的类型与待预测文本的类型相同。

[0111]

可选的,上述步骤202之前,该方法还可以包括:

[0112]

确定待预测文本的类型;

[0113]

根据待预测文本的类型,从多个候选文本中确定出符合第一预设条件的多个训练文本。

[0114]

通过设置上述步骤,给出了从候选文本中筛选出训练文本的具体操作,即在训练前先对待预测文本的类型进行探知,从而根据该类型从候选文本中确定出符合该类型的训练文本。

[0115]

可见,通过实施该可选的实施例,可以提高训练文本中存在目标标签类型的概率,使模型训练效果更好。

[0116]

在一个可选的实施例中,第二预设条件包括:与训练数据中的当前训练数据对应

的重合度损失函数的值小于或等于设定阈值。

[0117]

这里,重合度损失函数的值小于或等于设定阈值表示重合度损失函数收敛,文本识别模型训练完成。此处不对设定阈值的数值做具体限定。

[0118]

可见,通过实施该可选的实施例,可以使训练完成的文本识别模型具有较好的预测效果。

[0119]

在本发明所描述的文本识别方法的一种具体的实施方案中,用于训练文本识别模型的训练文本为“李宁泳镜,高清防雾,助力畅游水下”,这一训练文本中的品牌文本特征标签为“李宁”,品类文本特征标签为“泳镜”,若目标标签类型是品牌和品类,则该训练文本对应的标签序列可以表示为[b-brand,i-brand,b-cate,i-cate,o,o,o,o,o,o,o,o,o,o,o,o],可以看到,这里一共有5类标签,分别为b-brand,i-brand,b-cate,i-cate和o。其中o标签占大多数,但我们实际更关注的应当是前面4种标签。设标签名称和标签id的对应关系为{b-brand:0,i-brand:1,b-cate:2,i-cate:3,o:4},那么上述标签用标签id的形式表示为:[0,1,2,3,4,4,4,4,4,4,4,4,4,4,4,4],通过独热编码转化成独热编码标签后,得到训练数据label如图6所示(为了方便展示,只显示前5个字)。

[0120]

进而对文本识别模型进行训练,假设训练数据输入到文本识别模型后,输出的预测标签分布pred如图7所示(同上,只显示前5个字)。

[0121]

那么,文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和为9.2,文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和的第一修正值为预测真实二倍积之和与第一修正因子之和,即9.2+α(α为修正因子);

[0122]

所有训练数据单元的预测真实平方求和值之和为9.32,所有训练数据单元的预测真实平方求和值之和的第二修正值为预测真实平方求和值之和与第二修正因子之和,即9.32+α(α为修正因子);

[0123]

从而得到文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和的第一修正值与所有训练数据单元的预测真实平方求和值之和的第二修正值的比值,即文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度(coin)的数值,为(9.2+α)/(9.32+α)。

[0124]

根据重合度损失函数的值与该重合度成反比的其中一种表示形式,得到重合度损失函数(dice_loss)的值dice_loss=1-coin=1-(9.2+1)/(9.32+1)=0.0116,此时α=1。

[0125]

上述过程为通过一个训练文本对文本识别模型的一次训练过程,通过不同的训练文本重复上述训练过程直至损失函数收敛,得到训练好的文本识别模型。

[0126]

在本发明所描述的文本识别方法的另一种具体的实施方案中,用于训练文本识别模型的训练文本为“宝格丽淡香水”,可以看出这一训练文本中的品牌文本特征标签为“宝格丽”,品类文本特征标签为“香水”,若目标标签类型是品牌和品类,则该训练文本对应的标签序列可以表示为[b-brand,i-brand,i-brand,o,b-cate,i-cate],上述标签用标签id的形式表现为:[0,1,1,4,2,3],通过独热编码转化成独热编码标签后,得到训练数据label如图8所示。

[0127]

进而对文本识别模型进行训练,假设训练数据输入到文本识别模型后,输出的预测标签分布pred如图9所示。

[0128]

那么,文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和为9.4,

文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和的第一修正值为预测真实二倍积之和与第一修正因子之和,即9.4+α(α为修正因子);

[0129]

所有训练数据单元的预测真实平方求和值之和为10.22,所有训练数据单元的预测真实平方求和值之和的第二修正值为预测真实平方求和值之和与第二修正因子之和,即10.22+α(α为修正因子);

[0130]

从而得到文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和的第一修正值与所有训练数据单元的预测真实平方求和值之和的第二修正值的比值,即文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度(coin)的数值,为(9.4+α)/(10.22+α)。

[0131]

根据重合度损失函数的值与该重合度成反比的其中一种表示形式,得到重合度损失函数(dice_loss)的值dice_loss=1-coin=1-(9.4+2)/(10.22+2)=0.0671,此时α=2。

[0132]

上述过程为又一个通过训练文本对文本识别模型的一次训练过程,将不同的训练文本重复上述训练过程直至损失函数收敛,得到训练好的文本识别模型。

[0133]

实施例三

[0134]

请参阅图3,图3是本发明实施例公开的一种基于重合度损失优化模型的文本识别装置的结构示意图。该处理装置可以是相应的处理终端、处理设备或处理服务器,且该服务器可以是本地服务器,也可以是云服务器,本发明实施例不做限定。如图3所示,该基于重合度损失优化模型的文本识别装置可以包括:

[0135]

确定模块301,用于确定待预测文本;

[0136]

输入模块302,用于将待预测文本输入至训练好的文本识别模型,得到待预测文本对应的文本特征标签。

[0137]

其中,训练好的文本识别模型基于重合度损失函数被训练得到;重合度损失函数与文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度相关。

[0138]

可见,实施图3所示实施例,通过确定模块301和输入模块302二者的配合,能够利用基于重合度损失函数进行训练优化的文本识别模型对待预测文本对应的文本特征标签进行识别,实现在语义分析过程中对不同实体给予不同的重视程度,提升对文本中具有特定意义的标签的识别准确率。

[0139]

在一个可选的实施例中,重合度损失函数的值,与文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度成反比。

[0140]

可见,实施本可选实施例所描述的装置,基于重合度损失函数来优化文本识别模型,通过设定重合度与重合度损失函数的关系为反比关系,使重合度损失函数直接优化两个分布的重叠程度,能够有效避免标签分布不平衡的情况。

[0141]

在一个可选的实施例中,文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为预测标签分布的全部可能结果中和真实标签分布的全部可能结果中表示结果相同的数量与2的乘积,与预测标签分布和真实标签分布的全部可能结果的数量之和的比值。

[0142]

可见,实施本可选实施例所描述的装置,通过给出重合度具体的计算方式,使重合度损失函数直接用于表征预测标签分布和真实标签分布之间的重合度,能够使得模型训练

优化中通过优化该损失函数即可优化模型的预测能力,有效避免现有的基于交叉熵损失进行优化的方法中标签分布不平衡所带来的不良训练效果的情况。

[0143]

在一个可选的实施例中,文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和与所有训练数据单元的预测真实平方求和值之和的比值;预测真实二倍积为每一训练数据单元的预测标签值与真实标签值与2的乘积;预测真实平方求和值为每一训练数据单元的预测标签值的平方值与真实标签值的平方值之和。

[0144]

可见,实施本可选实施例所描述的装置,通过给出重合度具体的计算方式,使重合度损失函数直接用于表征预测标签分布和真实标签分布之间的重合度,能够使得模型训练优化中通过优化该损失函数即可优化模型的预测能力,有效避免现有的基于交叉熵损失进行优化的方法中标签分布不平衡所带来的不良训练效果的情况。

[0145]

在一个可选的实施例中,文本识别模型在训练时输出的预测标签分布与对应的训练数据的真实标签分布之间的重合度的数值,为文本识别模型在训练时的所有训练数据单元的预测真实二倍积之和的第一修正值与所有训练数据单元的预测真实平方求和值之和的第二修正值的比值;第一修正值为预测真实二倍积之和与第一修正因子之和,第二修正值为预测真实平方求和值之和与第二修正因子之和,第一修正因子和第二修正因子均为非负数;预测真实二倍积为每一训练数据单元的预测标签值与真实标签值与2的乘积;预测真实平方求和值为每一训练数据单元的预测标签值的平方值与真实标签值的平方值之和;

[0146]

真实标签值在训练数据单元不属于文本特征标签时为零。

[0147]

可见,实施本可选实施例所描述的装置,通过给出重合度具体的计算方式,使重合度损失函数直接用于表征预测标签分布和真实标签分布之间的重合度,能够使得模型训练优化中通过优化该损失函数即可优化模型的预测能力,有效避免现有的基于交叉熵损失进行优化的方法中标签分布不平衡所带来的不良训练效果的情况。并且,通过在计算过程中引入第一修正因子和第二修正因子,避免了负样本对文本识别模型的训练起不到作用从而降低效率的情况发生,优化了文本识别模型的训练过程。

[0148]

在一个可选的实施例中,如图4所示,基于重合度损失优化模型的文本识别装置还包括训练模块303,用于执行以下步骤训练得到训练好的文本识别模型:

[0149]

从符合第一预设条件的多个训练文本中获得训练数据,对文本识别模型进行训练;

[0150]

当文本识别模型在训练中满足第二预设条件时,将文本识别模型作为训练好的文本识别模型。

[0151]

可见,实施本可选实施例所描述的装置,能够提高训练文本中存在目标标签类型的概率,并且使训练完成的文本识别模型具有较好的预测效果。

[0152]

在一个可选的实施例中,如图4所示,训练模块303从符合第一预设条件的多个训练文本中获得训练数据的具体方式,包括:

[0153]

对于每一符合第一预设条件的训练文本,根据该训练文本中的每一训练文本单元的是否属于文本特征标签以及位置,逐一生成该训练文本中每一训练文本单元对应的标签,得到该训练文本对应的标签序列;

[0154]

对所有训练文本对应的标签序列进行独热编码,得到训练数据。

[0155]

可见,实施本可选实施例所描述的装置,能够将训练文本对应的标签序列转换为独热编码,使得数据的分类更准确,从而预测结果更准确。

[0156]

在一个可选的实施例中,第一预设条件包括:

[0157]

训练文本的类型与待预测文本的类型相同;和/或,

[0158]

第二预设条件包括:

[0159]

与训练数据中的当前训练数据对应的重合度损失函数的值小于或等于设定阈值。

[0160]

可见,实施本可选实施例所描述的装置,可以提高训练文本中存在目标标签类型的概率,使模型训练效果更好。

[0161]

实施例四

[0162]

请参阅图5,图5是本发明实施例公开的又一种基于重合度损失优化模型的文本识别装置的结构示意图。如图5所示,该基于重合度损失优化模型的文本识别装置可以包括:

[0163]

存储有可执行程序代码的存储器401;

[0164]

与存储器401耦合的处理器402;

[0165]

处理器402调用存储器401中存储的可执行程序代码,执行本发明实施例一或本发明实施例二所描述的基于重合度损失优化模型的文本识别方法中的步骤。

[0166]

实施例五

[0167]

本发明实施例公开了一种计算机程序产品,该计算机程序产品包括存储了计算机程序的非瞬时性计算机可读存储介质,且该计算机程序可操作来使计算机执行前述实施例所描述的基于重合度损失优化模型的文本识别方法中的步骤。

[0168]

以上所描述的装置实施例仅是示意性的,其中所述作为分离部件说明的模块可以是或者也可以不是物理上分开的,作为模块显示的部件可以是或者也可以不是物理模块,即可以位于一个地方,或者也可以分布到多个网络模块上。可以根据实际的需要选择其中的部分或者全部模块来实现本实施例方案的目的。本领域普通技术人员在不付出创造性的劳动的情况下,即可以理解并实施。

[0169]

本说明书中的各个实施例均采用递进的方式描述,各个实施例之间相同相似的部分互相参见即可,每个实施例重点说明的都是与其他实施例的不同之处。尤其,对于系统实施例而言,由于其基本相似于方法实施例,所以描述的比较简单,相关之处参见方法实施例的部分说明即可。

[0170]

通过以上的实施例的具体描述,本领域的技术人员可以清楚地了解到各实施方式可借助软件加必需的通用硬件平台的方式来实现,当然也可以通过硬件。基于这样的理解,上述技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,存储介质包括只读存储器(read-only memory,rom)、随机存储器(random access memory,ram)、可编程只读存储器(programmable read-only memory,prom)、可擦除可编程只读存储器(erasable programmable read only memory,eprom)、一次可编程只读存储器(one-time programmable read-only memory,otprom)、电子抹除式可复写只读存储器(electrically-erasable programmable read-only memory,eeprom)、只读光盘(compact disc read-only memory,cd-rom)或其他光盘存储器、磁盘存储器、磁带存储器、或者能够用于携带或存储数据的计算机可读的任何其他介质。

[0171]

还需要说明的是,术语“包括”、“包含”或者其任何其他变体意在涵盖非排他性的包含,从而使得包括一系列要素的过程、方法、商品或者设备不仅包括那些要素,而且还包括没有明确列出的其他要素,或者是还包括为这种过程、方法、商品或者设备所固有的要素。在没有更多限制的情况下,由语句“包括一个

……”

限定的要素,并不排除在包括所述要素的过程、方法、商品或者设备中还存在另外的相同要素。

[0172]

最后应说明的是:本发明实施例公开的一种基于重合度损失优化模型的文本识别方法及装置所揭露的仅为本发明较佳实施例而已,仅用于说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解;其依然可以对前述各项实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或替换,并不使相应的技术方案的本质脱离本发明各项实施例技术方案的精神和范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1