由视频生成音素资源文件的方法及相关设备与流程

1.本发明涉及音视频处理技术领域,尤其涉及一种由视频生成音素资源文件的方法及相关设备。

背景技术:

2.adobe character animator是adobe公司出品的一款动作捕获和动画制作软件,它可以为用户提供用于直观地制作2d(二维)人物动画、实时动画,以及发布动画的一款动画制作软件。开发人员在使用该软件制作动画时,由于该软件并不提供音素生成的api接口,开发人员在开发过程中也就无法随心所欲修改音素生成结果,这就使得利用该软件进行动画开发相当不便,制作出的动画效果不佳。

3.因此,现有技术还有待于改进和发展。

技术实现要素:

4.本发明的主要目的在于提供一种由视频生成音素资源文件的方法及相关设备。

5.本发明第一方面提供了一种由视频生成音素资源文件的方法,包括以下步骤:

6.从视频文件中抽取得到音频文件;

7.对所述音频文件进行数字化处理,得到音频数据;

8.将所述音频数据输入语音识别模型中获得中文字词数据;

9.将所述中文字词数据转换为带有音调的拼音数据;

10.对所述拼音数据进行字母韵母拆分得到中文音素数据;

11.将所述音频数据和所述中文音素数据进行对齐处理,获得所述中文音素数据中各中文音素的起始时间和结束时间;

12.新建音素资源文件,将所述中文音素数据中各所述中文音素以及各所述中文音素的所述起始时间和所述结束时间逐行填入所述音素资源文件中。

13.在本发明第一方面一种可选的实施方式中,所述新建音素资源文件,将所述中文音素数据中各所述中文音素以及各所述中文音素的所述起始时间和所述结束时间逐行填入所述音素资源文件中之后包括:

14.将所述音素资源文件中的各所述中文音素替换为发音相近的英文音素。

15.在本发明第一方面一种可选的实施方式中,所述对所述音频文件进行数字化处理,得到音频数据包括:

16.将所述音频文件导入到音频采样率转换软件中;

17.设置所述音频采样率转换软件中导出的音频采样率为16khz,采样位数为16bit;

18.对所述音频文件进行采样率转换,获取转换后所述音频文件中的所述音频数据。

19.在本发明第一方面一种可选的实施方式中,所述将所述音频数据输入语音识别模型中获得中文字词数据包括:

20.将所述音频数据通过torchaudio模块提取声学特征;

21.将所述声学特征输入到conformer网络来生成所述中文字词数据。

22.在本发明第一方面一种可选的实施方式中,所述将所述中文字词数据转换为带有音调的拼音数据包括:

23.将所述中文字词数据输入到python-pypinyin模块中进行拼音转换,获得带有音调的拼音数据。

24.在本发明第一方面一种可选的实施方式中,所述将所述音频数据和所述中文音素数据进行对齐处理,获得所述中文音素数据中各中文音素的起始时间和结束时间包括:

25.将所述音频数据和所述中文音素数据输入到kaldi语音识别工具箱中进行音频和中文音素的对齐,获得所述中文音素数据中各中文音素的起始时间和结束时间。

26.在本发明第一方面一种可选的实施方式中,所述将所述音素资源文件中的各所述中文音素替换为发音相近的英文音素包括:

27.预先人工创建中文音素和英文音素之间的映射表;

28.按照所述映射表将所述音素资源文件中的各所述中文音素替换为发音相近的英文音素。

29.本发明第二方面提供了一种由视频生成音素资源文件的装置,所述由视频生成音素资源文件装置包括:

30.抽取模块,用于从视频文件中抽取得到音频文件;

31.数字化处理模块,用于对所述音频文件进行数字化处理,得到音频数据;

32.字词识别模块,用于将所述音频数据输入语音识别模型中获得中文字词数据;

33.拼音识别模块,用于将所述中文字词数据转换为带有音调的拼音数据;

34.拆分模块,用于对所述拼音数据进行字母韵母拆分得到中文音素数据;

35.对齐模块,用于将所述音频数据和所述中文音素数据进行对齐处理,获得所述中文音素数据中各中文音素的起始时间和结束时间;

36.新建模块,用于新建音素资源文件,将所述中文音素数据中各所述中文音素以及各所述中文音素的所述起始时间和所述结束时间逐行填入所述音素资源文件中。

37.本发明第三方面提供了一种由视频生成音素资源文件的设备,其特征在于,所述由视频生成音素资源文件的设备包括:存储器和至少一个处理器,所述存储器中存储有指令,所述存储器和所述至少一个处理器通过线路互连;

38.所述至少一个处理器调用所述存储器中的所述指令,以使得所述由视频生成音素资源文件的设备执行如上述任一项所述的由视频生成音素资源文件的方法。

39.本发明第四方面提供了一种计算机可读存储介质,所述计算机可读存储介质上存储有计算机程序,其特征在于,所述计算机程序被处理器执行时实现如上述任一项所述的由视频生成音素资源文件的方法。

40.有益效果:本发明提供了一种由视频生成音素资源文件的方法及相关设备,其中方法包括:从视频文件中抽取得到音频文件;对音频文件进行数字化处理得到音频数据;将音频数据输入语音识别模型中获得中文字词数据;将中文字词数据转换为带有音调的拼音数据;对拼音数据进行字母韵母拆分得到中文音素数据;将音频数据和中文音素数据进行对齐处理,获得中文音素数据中各中文音素的起始时间和结束时间;新建音素资源文件,将中文音素数据中各中文音素以及各中文音素的述起始时间和结束时间逐行填入音素资源

文件中。本发明的方法可以提取出视频中包含的音素以及音素的始末时间并生成音素资源文件,以供开发者进行编辑,开发者制作动画时具有更大的发挥空间。

附图说明

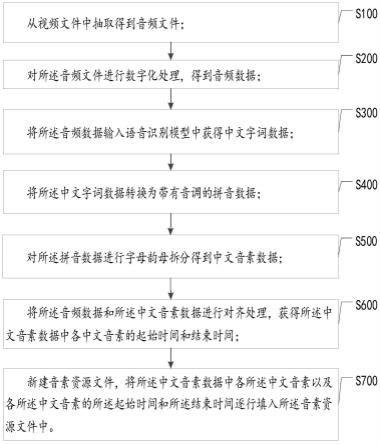

41.图1为本发明一种由视频生成音素资源文件的方法的一个实施例示意图;

42.图2为本发明一种由视频生成音素资源文件的装置的一个实施例示意图;

43.图3为本发明一种由视频生成音素资源文件的设备的一个实施例示意图。

具体实施方式

44.本发明实施例提供了一种由视频生成音素资源文件的方法及相关设备。本发明的说明书和权利要求书及上述附图中的术语“第一”、“第二”、“第三”、“第四”等(如果存在)是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理解这样使用的数据在适当情况下可以互换,以便这里描述的实施例能够以除了在这里图示或描述的内容以外的顺序实施。此外,术语“包括”或“具有”及其任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。

45.参见图1,本发明第一方面提供了一种由视频生成音素资源文件的方法,包括以下步骤:

46.s100、从视频文件中抽取得到音频文件;在该步骤中,用户可以输入视频文件也可以是音频文件,若用户输入的是视频文件,则需要从视频文件提取出音频文件;

47.s200、对所述音频文件进行数字化处理,得到音频数据;在该步骤中,对音频文件进行数字化处理的目的主要是将音频文件中音频数据的采样频率提升至预设值,采样率是指一秒钟采样的次数,采样率越高,还原的声音也就越真实。

48.示例性的,所述对所述音频文件进行数字化处理,得到音频数据包括:将所述音频文件导入到音频采样率转换软件中;设置所述音频采样率转换软件中导出的音频采样率为16khz,采样位数为16bit;对所述音频文件进行采样率转换,获取转换后所述音频文件中的所述音频数据。音频采样率转换过程中采用插值算法来提升音频采样率,采样位数(位深度)为16bit表示用16位(2个字节)来表示对该采样点的电平(通俗点来说和音量大小成正比)进行编码时所能达到的精确程度,也就是把纵轴分为16份描述电平大小。在该步骤中,还需要将音频数据整合成单声道。

49.s300、将所述音频数据输入语音识别模型中获得中文字词数据;

50.在步骤s300中,所述将所述音频数据输入语音识别模型中获得中文字词数据包括:将所述音频数据输入torchaudio模块提取声学特征;将所述声学特征输入到conformer网络生成所述中文字词数据。

51.torchaudio模块支持以wav和mp3格式加载音频数据,由于torchaudio模块中所有变换都是nn.modules或jit.scriptmodules,所以通过torchaudio模块得到的提取得到的声学特征可以随时用作神经网络的一部分。而本发明中所使用的conformer网络结构包含front-end,back-end,融合层,解码器和语言模型,其中,front-end:使用了将第一卷积层

替换为核大小为5

×7×

7的3d卷积的resnet18网络,最后使用了gap;音频使用了基于1d卷积的resnet18的网络,第一层滤波器尺寸为80(5ms),第一个block下采样4倍,随后每个block下采样2倍。最后声学特征下采样至每秒25帧以匹配视觉特征。back-end:将resnet特征投影到dk维空间,使用相对位置信息编码后送入conformer encoder;融合层:串接back-end输出的声学和视觉特征通过mlp投影到dk维空间。mlp是一层线性投影层,输出4

×dk

维特征,随后是bn、relu和最终线性层,输出维度dk。解码器:有embedding模块和一组mhsa组成。embedding模块中,一串从1到l-1的索引前缀被投影到embedding向量,l是目标长度索引。为embedding添加了绝对位置编码(sin)。随后是两个注意力模块和ffn模块,将来位置上的注意力矩阵被盖上了掩膜,第一个自注意力模块是q=k=v,第二个是之前自注意力模块的输出作为q,encoder输出的表征作为k和v。语言模型:基于transformer的语言模型,epoch=10,把数据集transcription中的一千六百二十万个词用来训练。通过浅层融合合并来自语言模型的加权先验分数。

52.在该步骤中,本发明技术方案提取特征和识别特征分别采用了torchaudio模块以及conformer网络结构,通过torchaudio模块提取到的音频数据的声学特征更加的真实,损失更少,通过conformer网络结构来识别提取到的声学特征,识别速度更快,准确率更高。

53.s400、将所述中文字词数据转换为带有音调的拼音数据;在该步骤中,就是将上一步获取得到的中文字词翻译成拼音,例如输入一段文字“如果说梦想是一棵常青树”,经转换后就或获得“ru2,guo3,meng4,xiang3,shi4,yi1,ke1,chang2,qing1,shu4”的带有音调的拼音数据,以“ru2”为例,“2”代表了“u”的声调为第二声。

54.示例性的,所述将所述中文字词数据转换为带有音调的拼音数据包括:将所述中文字词数据输入到python-pypinyin模块中进行拼音转换,获得带有音调的拼音数据。python-pinyin库是一个汉字拼音转换工具,其主要功能有:根据词组智能匹配最正确的拼音。支持多音字,简单的繁体支持,注音支持,支持多种不同拼音风格。

55.s500、对所述拼音数据进行字母韵母拆分得到中文音素数据;在该步骤中,以上一步获得的“ru2,guo3,meng4,xiang3,shi4,yi1,ke1,chang2,qing1,shu4”为例,进行字母韵母拆分后就会得到“r,u_2,g,uo_3,m,eng_4,x,iang_3,s,iang_3,y,i_1,k,e_1,ch,ang_2,q,ing_1,sh,u_4”,的中文音素数据。

56.s600、将所述音频数据和所述中文音素数据进行对齐处理,获得所述中文音素数据中各中文音素的起始时间和结束时间;在该步骤中,具体来说,所述将所述音频数据和所述中文音素数据进行对齐处理,获得所述中文音素数据中各中文音素的起始时间和结束时间包括:

57.将所述音频数据和所述中文音素数据输入到kaldi语音识别工具箱中进行音频和中文音素的对齐,获得所述中文音素数据中各中文音素的起始时间和结束时间。kaldi是当前最流行的开源的语音识别工具包,旨在提供灵活且可扩展的组件,包括多种语音信号处理,语音识别,声纹识别和深度神经网络。kaldi的代码主要用c++编写,在此之上使用bash和python脚本做了一些工具。对齐的步骤包括:提取声学特征(mfcc+pitch),计算倒谱均值方差归一化系数(cmvn);训练单音子声学模型mono,单音子gmm-hmm模型训练完成后,使用测试集进行解码来测试识别率,然后用单音子模型对数据做对齐。

58.在该步骤中,就是播放音频数据,获得每个中文音素在这段音频中的发声时间(包

括开始时间和结束时间),以上述“r,u_2,g,uo_3,m,eng_4,x,iang_3,s,iang_3,y,i_1,k,e_1,ch,ang_2,q,ing_1,sh,u_4”为例,获得了r的发声起始时间为0.090,结束时间为0.135,u_2的发声起始时间为0.135,结束时间为0.195,

………

,sh的发声起始时间为2.160,结束时间为2.215,u_4的发声起始时间为2.215,结束时间为2.240。

59.s700、新建音素资源文件,将所述中文音素数据中各所述中文音素以及各所述中文音素的所述起始时间和所述结束时间逐行填入所述音素资源文件中。在该步骤中,各个中文音素和各个起始时间和结束时间在所述音素资源文件中,按照“1、0.090 0.135r;另取一行,2、0.135 0.195u_2,再另取一行,3、0.195 0.240g;以此类推,直至,最后一行,23 2.215 2.240u_4”,得到音素资源文件。

60.在本发明第一方面一种可选的实施方式中,所述新建音素资源文件,将所述中文音素数据中各所述中文音素以及各所述中文音素的所述起始时间和所述结束时间逐行填入所述音素资源文件中之后包括:将所述音素资源文件中的各所述中文音素替换为发音相近的英文音素。

61.具体来说,所述将所述音素资源文件中的各所述中文音素替换为发音相近的英文音素包括:预先人工创建中文音素和英文音素之间的映射表;按照所述映射表将所述音素资源文件中的各所述中文音素替换为发音相近的英文音素。在该步骤中,由于本发明技术方案中的音素资源文件主要是要用到adobe character animator软件中的,所以要将音素资源文件中的各个中文音素转换成adobe character animator软件中的音素样式,举例来说,在中文音素中,a_0表示“a”这个音的轻声,a_1表示“a”这个音的第一声,且a的发音口型,与adobe软件中"aa"的发音口型相似,故将"aa"替换“a”。

62.总的来说,本发明由视频生成音素资源文件的方法的流程如下:用户输入视频,则从视频中抽取音频部分,将音频采样率转换为16khz,采样位数设置为16bit,利用torchaudio模块进行中文语音识别,对音频数据提取声学特征,之后再输入conformer网络结构来识别音频数据中的中文字词。使用pypinyin模块将中文字词转换为带有音调的拼音形式,将音频文件和生成的拼音,通过kaldi模块进行音频和拼音的对齐,并将结果以每一行

‘

起始时间’,

‘

结束时间’,

‘

拼音’的形式,储存至文档中,人工创建adobe character animator所需音素样式与中文拼音的一一对应关系,并通过编写脚本,将步骤四生成文档中的拼音全部转换为所需音素。本发明将现有的一系列模块组合在一起,实现了端到端的音素生成一条龙功能,用户在输入音/视频后,会生成一段文本格式(便于用户修改其中的任何内容)的音素及每个音素的始末时间,这对于视频创作者而言,有了更大的发挥空间。

63.参见图2,本发明第二方面提供了一种由视频生成音素资源文件的装置,所述由视频生成音素资源文件装置包括:

64.抽取模块10,用于从视频文件中抽取得到音频文件;

65.数字化处理模块20,用于对所述音频文件进行数字化处理,得到音频数据;

66.字词识别模块30,用于将所述音频数据输入语音识别模型中获得中文字词数据;

67.拼音识别模块40,用于将所述中文字词数据转换为带有音调的拼音数据;

68.拆分模块50,用于对所述拼音数据进行字母韵母拆分得到中文音素数据;

69.对齐模块60,用于将所述音频数据和所述中文音素数据进行对齐处理,获得所述中文音素数据中各中文音素的起始时间和结束时间;

70.新建模块70,用于新建音素资源文件,将所述中文音素数据中各所述中文音素以及各所述中文音素的所述起始时间和所述结束时间逐行填入所述音素资源文件中。

71.在本发明第二方面一种可选的实施方式中,所述由视频生成音素资源文件的装置还包括:

72.转换模块,用于将所述音素资源文件中的各所述中文音素替换为发音相近的英文音素。

73.在本发明第二方面一种可选的实施方式中,所述数字化处理模块20包括:

74.导入单元,用于将所述音频文件导入到音频采样率转换软件中;

75.设置单元,用于设置所述音频采样率转换软件中导出的音频采样率为16khz,采样位数为16bit;

76.转换单元,用于对所述音频文件进行采样率转换,获取转换后所述音频文件中的所述音频数据。

77.在本发明第二方面一种可选的实施方式中,所述字词识别模块30包括:

78.特征提取单元,用于将所述音频数据输入torchaudio模块中提取声学特征;

79.识别单元,用于将所述声学特征输入到conformer网络识别得到所述中文字词数据。

80.在本发明第二方面一种可选的实施方式中,所述拼音识别模块40具体用于:

81.将所述中文字词数据输入到python-pypinyin模块中进行拼音转换,获得带有音调的拼音数据。

82.在本发明第二方面一种可选的实施方式中,所述对齐模块60具体用于:

83.将所述音频数据和所述中文音素数据输入到kaldi语音识别工具箱中进行音频和中文音素的对齐,获得所述中文音素数据中各中文音素的起始时间和结束时间。

84.在本发明第二方面一种可选的实施方式中,所述转换模块包括:

85.预设单元,用于预先人工创建中文音素和英文音素之间的映射表;

86.转换单元,用于按照所述映射表将所述音素资源文件中的各所述中文音素替换为发音相近的英文音素。

87.图3是本发明实施例提供的一种由视频生成音素资源文件的设备的结构示意图,该由视频生成音素资源文件的设备可因配置或性能不同而产生比较大的差异,可以包括一个或一个以上处理器80(central processing units,cpu)(例如,一个或一个以上处理器)和存储器90,一个或一个以上存储应用程序或数据的存储介质100(例如一个或一个以上海量存储设备)。其中,存储器和存储介质可以是短暂存储或持久存储。存储在存储介质的程序可以包括一个或一个以上模块(图示没标出),每个模块可以包括对由视频生成音素资源文件的设备中的一系列指令操作。更进一步地,处理器可以设置为与存储介质通信,在由视频生成音素资源文件的设备上执行存储介质中的一系列指令操作。

88.本发明的由视频生成音素资源文件的设备还可以包括一个或一个以上电源110,一个或一个以上有线或无线网络接口120,一个或一个以上输入输出接口130,和/或,一个或一个以上操作系统,例如windows serve,mac os x,unix,linux,freebsd等等。本领域技术人员可以理解,图3示出的由视频生成音素资源文件的设备结构并不构成对由视频生成音素资源文件的设备的限定,可以包括比图示更多或更少的部件,或者组合某些部件,或者

不同的部件布置。

89.本发明还提供一种计算机可读存储介质,该计算机可读存储介质可以为非易失性计算机可读存储介质,该计算机可读存储介质也可以为易失性计算机可读存储介质,所述计算机可读存储介质中存储有指令,当所述指令在计算机上运行时,使得计算机执行所述的由视频生成音素资源文件的方法的步骤。

90.所属领域的技术人员可以清楚地了解到,为描述的方面和简洁,上述描述的系统或装置、单元的具体工作过程,可以参考前述方法实施例中的对应过程,在此不再赘述。

91.所述集成的单元如果以软件功能单元的形式实现并作为独立的产品销售或使用时,可以存储在一个计算机可读取存储介质中。基于这样的理解,本发明的技术方案本质上或者说对现有技术做出贡献的部分或者该技术方案的全部或部分可以以软件产品的形式体现出来,该计算机软件产品存储在一个存储介质中,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本发明各个实施例所述方法的全部或部分步骤。而前述的存储介质包括:u盘、移动硬盘、只读存储器(read-only memory,rom)、随机存取存储器(random access memory,ram)、磁碟或者光盘等各种可以存储程序代码的介质。

92.以上所述,以上实施例仅用以说明本发明的技术方案,而非对其限制;尽管参照前述实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的精神和范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1