一种多标签眼底图像分类系统、方法及电子设备

一种多标签眼底图像分类系统、方法及电子设备

【技术领域】

1.本发明涉及眼底图像分类技术领域,尤其涉及一种多标签眼底图像分类系统、方法及电子设备。

背景技术:

2.随着医疗科技的发展,使用眼底相机对眼睛进行眼底检查变得愈加方便,这种检查方式已大范围的普及。与此同时,大量的眼底图像数据被存储,如何对这些医疗图像大数据进行合理的处理和分析,充分挖掘其潜在价值成为了近些年的研究热点。此外,使用人工智能对眼底图像进行处理,不仅开发了医疗大数据的价值,更能缓解中国现在医疗资源紧张,医护人员工作压力大的问题。

3.在眼底图像处理的技术中,可以直接对眼底图像的关键部位进行分割,再进一步进行分类判断疾病,如专利文献(cn113011450)中公开的一种青光眼识别的方法,基于深度学习的人工神经网络对眼底图像的视盘及视杯区域进行特征提取和训练分类完成对青光眼的患病预测,但该模块处理时对左右眼图像分别处理,未考虑到双眼特征之间的影响。

4.如专利文献(cn104881683)中公开的一种基于组合分类器的白内障图像分类方法及分类装置,通过小波变换、轮辅方法和纹理分析提取特征,其次通过支持向量机和bp神经网进行预测分类,得到了较高的分类精确度。但该模块仅实现对白内障疾病的二分类,适用范围较小,不适于大范围的进行推广。

5.如专利文献(cn202110075947)中公开的一种基于gacnn的多标签眼底图像识别方法,通过建立构建gacnn模型对带标签图像进行训练,构建图注意网络处理各标签的关系完成模型建立,但该发明图像特征提取能力较差,不能较好地解决各标签之间的关联性问题,导致分类结果准确度低。

6.在现有技术中,大部分研究对眼底图像的处理都是将左、右眼图像作为独立的个体进行处理,忽略了病人双眼之间的关系。而疾病的发病机制和治疗手段复杂多变,因此仅从图像水平上进行疾病的研究是不够充分的。本发明就是设计了一种多标签眼底图像分类系统、方法及电子设备。

技术实现要素:

7.本发明的目的是针对现有技术的缺陷,提供了一种多标签眼底图像分类系统、方法及电子设备。为了实现以上目的,本发明采用以下技术方案:

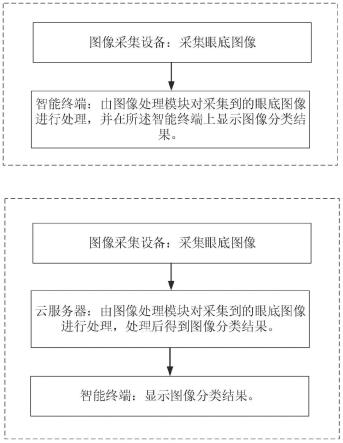

8.一种多标签眼底图像分类系统,其特征在于,该系统包括:

9.图像采集设备,包括摄像头,第一通信模块;

10.智能终端,包括电脑或手机,其中电脑或手机包括图像处理模块、第二通信模块;

11.云服务器,包括图像处理模块、第三通信模块;

12.所述系统有两种工作方式,方式一:所述图像采集设备采集眼底图像后,由所述第一通信模块通过所述第二通信模块,发送采集到的眼底图像至所述智能终端,再由图像处

理模块对采集到的眼底图像进行处理,并在所述智能终端上显示图像分类结果;

13.方式二:所述图像采集设备采集眼底图像后,由所述第一通信模块通过所述第三通信模块,发送采集到的眼底图像至所述云服务器,再由图像处理模块对采集到的眼底图像进行处理,由所述第三通信模块通过所述第二通信模块发送图像分类结果至所述智能终端并显示。

14.进一步,所述图像处理模块,包括特征提取模块、图像拼接模块、图卷积计算模块、多标签输出模块、分类预测模块,其中,

15.所述特征提取模块包括efficientnet-b4主干网,对图像特征进行提取;

16.所述图像拼接模块,对提取到的图像特征进行拼接,得到图像特征矩阵x;

17.所述图卷积计算模块,对拼接后的图像特征进行计算,输出特征

18.所述分类预测模块包括lightgbm算法模块,对特征进行多标签分类输出。

19.进一步,所述图像拼接模块包括图像拼接、特征拼接、标签拼接三种拼接方式;所述图像拼接为对左、右眼图像进行水平或竖直拼接;所述特征拼接为对左、右眼图像分别对应的特征进行组合;所述标签拼接为对左、右眼图像分别对应的标签进行组合;

20.所述图卷积计算模块包括自注意机制模块、图卷积模块、混合图卷积模块;

21.所述自注意机制模块通过3个1*1的卷积核提取图像特征矩阵x的三个特征f,g,h;

22.f(x)=wf·

x,g(x)=wg·

x,h(x)=wh·

x

ꢀꢀꢀꢀꢀꢀꢀꢀ

(1)

[0023][0024]

c是图像特征矩阵x的通道数,wf、wg、wh是可学习参数权重矩阵。

[0025]

再对f(x)和g(x)进行计算:

[0026]

α

j,i

=softmax(f(xi)

t

×

g(xj))

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(3)

[0027]

其中,t代表类别数,共有8个类别。得到自注意机制模块的输出参数

[0028][0029]

其中v是另一个1*1的卷积核,m是其他维度相乘得到的值。

[0030]

进一步,所述图卷积模块包括构建邻接矩阵a和各层图卷积运算;

[0031]

进一步,所述构建邻接矩阵a包括以下步骤:

[0032]

z1.利用glove算法将多标签图像对应的标签进行词向量编码转换为向量特征;

[0033]

z2.利用标签之间依赖特性即条件概率构造标签相关矩阵a:其中a的每个元素表示为a

mn

,a

mn

=p(am/an)表示当n标签出现时m标签出现的概率,有:

[0034][0035]

其中,bm是m标签出现的总次数,e

mn

是n标签和m标签同时出现的总次数;

[0036]

进一步,所述各层图卷积运算由下述公式实现:

[0037][0038]

其中h

(l)

是第1层顶点,d是对角矩阵,由计算得到,a

ij

是a中元素,a是所述邻接矩阵a,w

(l)

是第1层的可训练权值,h

(l+1)

是第1+1层顶点,σ(x)是激活函数。

[0039]

进一步,所述混合图卷积模块对所述自注意机制模块的输出β

j,i

和所述图卷积模块的输出y进行计算,得到特征

[0040][0041]

其中,γ是可训练的权值。

[0042]

一种眼底图像分析方法,其特征在于,所述方法包括:

[0043]

s1.获取待分类的眼底图像;

[0044]

s2.对待分类的眼底图像进行预处理;

[0045]

s3.对待分类的眼底图像进行图像拼接,并进行特征提取,获得图像特征矩阵;

[0046]

s4.将图像特征矩阵输入预先设计的混合图卷积模型;

[0047]

s5.输出处理后的特征

[0048]

s6.将输出的处理后的特征输入lightgbm算法;

[0049]

s7.输出多标签分类结果;

[0050]

一种云服务器,其特征在于,包括通信模块、分析模块和存储模块,用于执行所述眼底图像分析方法。所述通信模块负责获取待分类的眼底图像及输出分类结果;分析模块用于对眼底图像进行处理;存储模块用于对眼底图像分析所涉及的数据进行存储。

[0051]

一种电子设备,其特征在于,包括:

[0052]

图像采集设备,包括摄像头,第一通信模块;

[0053]

智能终端,包括电脑或手机,其中电脑或手机包括图像处理模块、第二通信模块;

[0054]

云服务器,包括图像处理模块、第三通信模块;

[0055]

所述系统有两种工作方式,方式一:所述图像采集设备采集眼底图像后,由所述第一通信模块通过所述第二通信模块,发送采集到的眼底图像至所述智能终端,再由图像处理模块对采集到的眼底图像进行处理,并在所述智能终端上显示图像分类结果;

[0056]

方式二:所述图像采集设备采集眼底图像后,由所述第一通信模块通过所述第三通信模块,发送采集到的眼底图像至所述云服务器,再由图像处理模块对采集到的眼底图像进行处理,由所述第三通信模块通过所述第二通信模块发送图像分类结果至所述智能终端并显示。

【附图说明】

[0057]

为了更清楚地说明本发明实施例中的技术方案,下面将对实施例描述中所需要使用的附图作简单地介绍,显而易见地,下面描述中的附图仅仅是本发明的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动的前提下,还可以根据这些附图获得其他的附图。

[0058]

其中:

[0059]

图1是本发明实施例的多标签眼底图像分类系统两种工作方式示意图

[0060]

图2是本发明实施例的多标签眼底图像分类系统的图像处理模块工作流程示意图

[0061]

图3是本发明实施例的自注意机制模块示意图;

[0062]

图4是本发明实施例的图卷积模块示意图;

[0063]

图5是本发明实施例的混合图卷积模块示意图;

[0064]

图6是本发明实施例的多标签眼底图像分类系统图像处理结果示意图。

【具体实施方式】

[0065]

下面将结合本发明实施例中的附图,对本发明实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅仅是本发明一部分实施例,而不是全部实施例。基于本发明中的实施例,本领域普通技术人员在没有做出创造性的劳动前提下所获得的所有其他实施例,都属于本发明保护的范围。本发明的目的是针对现有技术的缺陷,提供了一种多标签眼底图像分类系统、方法及电子设备。

[0066]

实施例一

[0067]

一种多标签眼底图像分类系统,其特征在于,该系统包括:

[0068]

图像采集设备,包括摄像头,第一通信模块;

[0069]

智能终端,包括电脑或手机,其中电脑或手机包括图像处理模块、第二通信模块;

[0070]

云服务器,包括图像处理模块、第三通信模块;

[0071]

所述系统有两种工作方式,如图1所示方式一:所述图像采集设备采集眼底图像后,由所述第一通信模块通过所述第二通信模块,发送采集到的眼底图像至所述智能终端,再由图像处理模块对采集到的眼底图像进行处理,并在所述智能终端上显示图像分类结果;

[0072]

方式二:所述图像采集设备采集眼底图像后,由所述第一通信模块通过所述第三通信模块,发送采集到的眼底图像至所述云服务器,再由图像处理模块对采集到的眼底图像进行处理,由所述第三通信模块通过所述第二通信模块发送图像分类结果至所述智能终端并显示。

[0073]

所述图像处理模块如图2所示,包括特征提取模块、图像拼接模块、图卷积计算模块、多标签输出模块、分类预测模块,其中,

[0074]

所述特征提取模块包括efficientnet-b4主干网,对图像特征进行提取;

[0075]

所述图像拼接模块,对提取到的图像特征进行拼接,得到图像特征矩阵x;

[0076]

所述图卷积计算模块,对拼接后的图像特征进行计算,输出特征

[0077]

所述分类预测模块包括lightgbm算法模块,对特征进行多标签分类输出。

[0078]

所述图像拼接模块包括图像拼接、特征拼接、标签拼接三种拼接方式;所述图像拼接为对左、右眼图像进行水平或竖直拼接;所述特征拼接为对左、右眼图像分别对应的特征进行组合;所述标签拼接为对左、右眼图像分别对应的标签进行组合;

[0079]

所述图卷积计算模块包括自注意机制模块、图卷积模块、混合图卷积模块;

[0080]

所述自注意机制模块如图3所示通过3个1*1的卷积核提取图像特征矩阵x的三个特征f,g,h;

[0081]

f(x)=wf·

x,g(x)=wg·

x,h(x)=wh·

x

ꢀꢀꢀꢀꢀꢀꢀ

(1)

[0082][0083]

c是图像特征矩阵x的通道数,wf、wg、wh是可学习参数权重矩阵。

[0084]

再对f(x)和g(x)进行计算:

[0085]

α

j,i

=softmax(f(xi)

t

×

g(xj))

ꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀꢀ

(3)

[0086]

其中,t代表类别数,共有8个类别。得到自注意机制模块的输出参数

[0087]

[0088]

其中v是另一个1*1的卷积核,m是其他维度相乘得到的值。

[0089]

所述图卷积模块,如图4所示,包括构建邻接矩阵a和各层图卷积运算;

[0090]

所述构建邻接矩阵a包括以下步骤:

[0091]

z1.利用glove算法将多标签图像对应的标签进行词向量编码转换为向量特征;

[0092]

z2.利用标签之间依赖特性即条件概率构造标签相关矩阵a:其中a的每个元素表示为a

mn

,a

mn

=p(am/an)表示当n标签出现时m标签出现的概率,有:

[0093][0094]

其中,bm是m标签出现的总次数,e

mn

是n标签和m标签同时出现的总次数;

[0095]

所述各层图卷积运算由下述公式实现:

[0096][0097]

其中h

(l)

是第1层顶点,d是对角矩阵,由计算得到,a

ij

是a中元素,a是所述邻接矩阵a,w

(l)

是第1层的可训练权值,h

(l+1)

是第1+1层顶点,σ(x)是激活函数。

[0098]

所述混合图卷积模块,如图5所示对所述自注意机制模块的输出β

j,i

和所述图卷积模块的输出y进行计算,得到特征

[0099][0100]

其中,γ是可训练的权值。

[0101]

一种云服务器,其特征在于,包括通信模块、分析模块和存储模块,用于执行权利要求10所述的眼底图像分析方法。所述通信模块负责获取待分类的眼底图像及输出分类结果;分析模块用于对眼底图像进行处理;存储模块用于对眼底图像分析所涉及的数据进行存储。

[0102]

一种电子设备,其特征在于,包括:

[0103]

图像采集设备,包括摄像头,第一通信模块;

[0104]

智能终端,包括电脑或手机,其中电脑或手机包括图像处理模块、第二通信模块;

[0105]

云服务器,包括图像处理模块、第三通信模块;

[0106]

所述系统有两种工作方式,方式一:所述图像采集设备采集眼底图像后,由所述第一通信模块通过所述第二通信模块,发送采集到的眼底图像至所述智能终端,再由图像处理模块对采集到的眼底图像进行处理,并在所述智能终端上显示图像分类结果;

[0107]

方式二:所述图像采集设备采集眼底图像后,由所述第一通信模块通过所述第三通信模块,发送采集到的眼底图像至所述云服务器,再由图像处理模块对采集到的眼底图像进行处理,由所述第三通信模块通过所述第二通信模块发送图像分类结果至所述智能终端并显示。

[0108]

实施例二

[0109]

本实施例通过在四个预测模型中使用三种不同拼接方式对同一组测试集进行分类,其中指定图像拼接方式为模式1,指定特征拼接方式为模式2,指定标签拼接方式为模式3。由表1可以看出,四个预测模型表现出高度的一致性,均为模式1比模式2具有更好的预测效果,模式2比模式3具有更好的分类效果。因此,本发明选择模式1的图像拼接方式作为输入图像的融合模式。

[0110]

表1多个预测模型下不同拼接形式的分类效果对比

[0111][0112]

实施例三

[0113]

本实施例通过消融实验对比在多个预测模型中添加混合gcn模型前后对同一测试集的分类效果。由表2可以看出添加混合gcn模型后所有评价指标都得到了改进。

[0114]

表2多个预测模型下添加混合gcn模型前后的分类效果对比

[0115][0116]

实施例四

[0117]

本实施例通过消融实验评估特征提取模块及分类输出模块的功能。首先采用gbdt作为分类输出模型,efficientnet-b4,resnet50,vgg19,inception-v3四个特征提取模型对同一测试集的分类效果如表3。由表3可以看出改进的特征提取模块可以为复合模型带来更准确的预测,当efficientnet-b4374与gbdt耦合时,预测结果最好,f1值为89.74%。。

[0118]

表3特征提取模块消融实验的结果

[0119][0120]

分别以lightgbm、xgboost、gbdt、fc四个模型作为分类器的复合模型的分类输出模块对同一测试集进行分类,分类结果如表4。如表4所示,使用相同的特征提取模型,不同

的多标签分类输出模块,对网络预测指标有影响。本发明提出的复合模型在指标方面优于全连接的单卷积神经网络模型。使用lightgbm的模型对分类器的f1可以达到大约91.60%,性能有了显著的提升。其中,在几种复合模型的比较中,lightgbm的性能优于xgboost,而xgboost383的性能优于gbdt。

[0121]

表4分类输出模块消融实验的结果

[0122][0123]

实施例五

[0124]

本实施例对比本发明模型与其他5个模型的最佳结果,比较结果如表8。可以看出,本发明建立的最优模型优于板块中的其他模型,说明了本发明提出的复合模型的优越性。

[0125]

表5其他模型的分类结果对比

[0126]

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1