一种基于局部异常的强泛化深度伪造人脸检测方法

1.本发明涉及伪造人脸检测技术领域,尤其涉及一种基于局部异常的强泛化深度伪造人脸检测方法。

背景技术:

2.随着网络通讯技术的飞速发展,信息传播的效率和范围大大提升,信息安全问题不容小觑。由于深度学习的迅猛发展而兴起的伪造人脸视频,这类深度伪造人脸视频,主要是利用深度学习方法对真实人脸的表情、属性、身份进行篡改,以及生成完全不存在的假人脸。目前一系列的软件如zao和fake app等,达到了1亿多的累计下载量。同时,在目前互联网上1500多套开源工具的加持下,超高分辨率的伪造产物在视觉上已经达到了无痕编辑,即使是动态篡改产物也超越了人眼可以辨别的范畴。

3.深度伪造技术在实现人脸替换的同时,可以充分拟合人脸的面部表情及特征细节,不仅可以替换人脸,还可以控制其面部表情变化。目前已经涌现了许多方法来进行伪造人脸的检测,但是目前的伪造检测方法大多数依赖训练数据驱动,在模型见过的数据集上性能优异,而在跨数据集检测时性能较差。由于伪造方法的多样性,目前人脸伪造算法最大的难点在于其泛化性。

技术实现要素:

4.发明目的:针对以上问题,本发明提出一种基于局部异常的强泛化深度伪造人脸检测方法。仅通过伪造图像本身携带的信息就暴露出局部异常信号,提升对人脸伪造视频的检测精度,并且大幅提高检测算法在未知数据集上的性能。

5.技术方案:为实现本发明的目的,本发明所采用的技术方案是:一种基于局部异常的强泛化深度伪造人脸检测方法,包括如下步骤:

6.(1)对训练数据集中的真假人脸视频进行帧分解,将视频格式文件转化为连续的图像帧序列,对图像帧序列,使用人脸检测器检测出人脸位置;对每一张图像帧剪裁人脸框,得到连续的人脸图像训练集;

7.(2)将(1)中得到的人脸图像输入自适应空域富模型,在通过对空域富模型滤波核施加一个约束条件,使其中心元素保持为-1,其余元素之和保持为1;该约束空域富模型进行滤波处理时,自适应地更新高通滤波器中的各个滤波元素提取高频噪声特征;

8.(3)将(1)中得到的人脸图像输入噪声流,即将(2)中自适应空域富模型提取的高频噪声特征输入骨干网络resnet18模型的前3个block,并计算二分类交叉熵损失;

9.(4)将(1)中得到的人脸图像输入rgb流,即将(1)中人脸图像依次输入resnet18模型的前3个block,并在每个block后进行局部增强;

10.(5)在(4)中rgb流骨干网络最后的池化层提取特征图输入局部异常模块计算异常得分,结合(3)中的二分类交叉熵损失得到最终的异常损失,利用反向传播对局部异常模块与骨干网络进行更新,得到训练好的局部异常检测网络;

11.(6)获取待检测数据集,剪裁人脸图像,输入训练好的局部异常检测网络进行最终人脸真假分类。

12.进一步的,所述步骤(2)中,自适应空域富模型的具体操作如下:

13.(2.1)从空域富模型的30个滤波器中选择中心元素分别为2,4,12的3个高通滤波器;

14.(2.2)将所选择的3个滤波器在通道维度扩展至维度为3,以匹配输入图像的3通道;

15.(2.3)对3个滤波器分别用2,4,12作为量化因子对其进行量化操作,使其中心元素值为-1,其余元素值之和为1;

16.(2.4)在网络训练的每次反向传播后,将其中心元素值重置为-1,其余元素之和重置为1。

17.进一步的,所述步骤(5)中,二阶局部异常模型的操作如下:

18.(5.1)将从池化层提取的源特征图x=f(i)∈rh×w×c按通道维度的方向划分为n

×

n个图像块,其中,i表示输入图像,f表示骨干网络,h,w,c分别表示特征图的长度、宽度和通道数,每个图像块的大小为h

×

w,h,w分别表示图像块的长度与宽度,其中h=h//n,w=w//n;

19.(5.2)设(m,n)为图像块的横坐标索引与纵坐标索引,则对于一个位于(m,n)位置的图像块用x

mn

进行表示,分别计算该图像块与其正上方、正下方、正左方、正右方这四个方位最近邻图像块的相似度;

20.(5.3)将四个方位次近邻的图像块也纳入相似度的计算范围中,即对一个图像块x

mn

的八个图像块对{x

mn

,x

m+i,n+j

},i∈{0,

±

1,

±

2},j∈{0,

±

1,

±

2},两两计算相似度;

21.(5.4)设计1

×

1卷积操作f,将特征图投射到统一的新维度空间,然后将特征利用全连接层输出真/假的二类分类概率,最后引入二分类的交叉熵损失用于约束卷积网络:

[0022][0023]

(5.5)在数据集中真假标签的监督下,对(5.3)所述的八个图像块对中的每一对图形块的相似度取平均值,并根据(5.4)中全连接层输出的概率作为真假分类的结果。

[0024]

进一步的,使用mtcnn逐帧地对图像帧序列进行人脸检测,mtcnn将返回3组返回值:

[0025]

1)图像中包含人脸的概率;2)人脸矩形框位置信息,以(x,y,w,h)进行表示,其中x,y表示以图像左上角点为原点,检测到的人脸矩形的左上角横纵坐标,w,h分别表示矩形框的宽和高;3)检测到的人脸的5个关键点位置;

[0026]

设定人脸概率阈值,当mtcnn返回检测到人脸的概率低于阈值时,不对该图像进行剪裁;对于检测到的人脸,首先根据以下公式计算人脸框中心坐标点p

center

:

[0027][0028]

以p

center

为中心坐标,以w,h中较长的边作为参照,扩展α倍,扩展公式如下所示:

[0029][0030]

其中,rect

new

表示扩展后的人脸矩形框位置信息,其四个元素同样分别表示新矩

形框的左上角横纵坐标以及其宽和高。

[0031]

进一步的,所述步骤(4)中,在每个block后进行局部增强,在每个卷积block后的特征图分块后进行变形,具体地,卷积网络中定义了如下操作:

[0032][0033]

其中,x代表输入特征,y代表和x同尺寸的输出特征,都以向量形式表示;i是需要被计算相似度的图像块的索引坐标,j是被关联计算到的周边图像块的索引坐标;c(x)为正则化的系数;g是一个线性嵌入层,是一个一元函数;f代表对i和j两两间相似度的计算操作,是高斯函数,表示如下:

[0034][0035]

其中,是点对点间的相似度计算;对上述的高斯函数进行扩展,用于计算投影后在新维度空间内的相似度,如下所示:

[0036][0037]

其中,θ(xi)=w

θ

xi和φ(xj)=w

φ

xj是两个嵌入层;

[0038]

线性嵌入层g表示为:g(xj)=wgxj,其中wg是一个被学习的权重矩阵,在空间上是1

×1×

1的卷积操作;还设置了作为正则化的系数;经此操作,使感受野集中于所需要的局部信息的提取。

[0039]

有益效果:与现有技术相比,本发明的技术方案具有以下有益的技术效果:

[0040]

本发明公开的基于局部异常的强泛化深度伪造人脸检测方法能够大大提高检测模型在未知域的泛化能力。相比于xception等网络层数较深的模型,本发明仅需要resnet18浅层网络作为骨干架构,且不拘泥于伪造算法的类型,在无辅助数据集的情况下就可以推广到未知域,达到顶尖的检测精度。同时,本发明也可以作为模块任意的链接到深度卷积模型中,对于多种伪造算法都有效果。

附图说明

[0041]

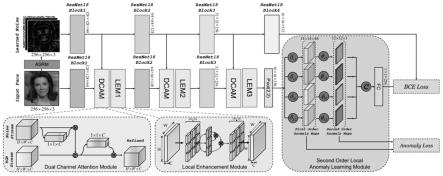

图1是本发明方法的总体流程图;

[0042]

图2是自适应空域富模型(asrm)的流程图;

[0043]

图3是骨干网络resnet18的主体结构;

[0044]

图4是局部增强模块结构示意图;

[0045]

图5是局部异常模块结构示意图。

具体实施方式

[0046]

下面结合附图和实施例对本发明的技术方案作进一步的说明。

[0047]

如图1所示的是本发明的一种基于局部异常的强泛化深度伪造人脸检测方法的总体流程图,其步骤如下:

[0048]

(1)对训练数据集中的真假人脸视频进行帧分解,将视频格式文件转化为连续的图像帧序列,对图像帧序列,使用mtcnn人脸检测器检测出人脸位置。对每一张图像帧剪裁

人脸框,得到连续的人脸图像训练集。

[0049]

具体地来说,使用mtcnn逐帧地对图像帧序列进行人脸检测时,mtcnn将返回3组返回值:1)图像中包含人脸的概率;2)人脸矩形框位置信息,以(x,y,w,h)进行表示,其中x,y表示以图像左上角点为原点,检测到的人脸矩形的左上角横纵坐标,w,h分别表示矩形框的宽和高;3)检测到的人脸的5个关键点位置。

[0050]

本发明将人脸概率阈值设定为0.85,即当mtcnn返回检测到人脸的概率低于0.85时,不对该图像进行剪裁。

[0051]

对于检测到的人脸,首先根据以下公式计算人脸框中心坐标点p

center

:

[0052][0053]

以p

center

为中心坐标,以w,h中较长的边作为参照,扩展α倍,扩展公式如下所示:

[0054][0055]

其中,rect

new

表示扩展后的人脸矩形框位置信息,四个元素同样分别表示新矩形框的左上角横纵坐标以及其宽和高。

[0056]

(2)将(1)中得到的人脸图像输入自适应空域富模型(adaptive spatial rich model,asrm),在通过对空域富模型(srm)滤波核施加一个约束条件,使其中心元素保持为-1,其余元素之和保持为1;该约束空域富模型进行滤波处理时,自适应地更新高通滤波器中的各个滤波元素提取高频噪声特征。

[0057]

自适应空域富模型(asrm)结构如图2所示;从空域富模型(srm)的30个滤波器中选择中心元素分别为2,4,12的3个高通滤波器,将所选择的3个滤波器在通道维度扩展至维度为3(即这些滤波器在rgb通道重复3遍),以匹配输入图像的3通道,如图2所示。对3个滤波器分别用2、4、12作为量化因子对其进行量化操作,使其中心元素值为-1,其余元素值之和为1,使滤波器在通过网络学习的时候能保持高通滤波器的特性。

[0058]

(3)将(1)中得到的人脸图像输入噪声流,即将(2)中asrm提取的高频噪声特征输入骨干网络resnet18模型的前3个block,并计算二分类交叉熵损失(binary cross entropy loss,bce loss)。骨干网络resnet 18的主体结构如图3所示。

[0059]

(4)将(1)中得到的人脸图像输入rgb流,即将(1)中人脸图像依次输入resnet18模型的前3个block,并在每个block后进行局部增强(lem)。如图4所示,为了缓解深度网络下感受野过大的问题,保证所提取的特征图的局部信息有效性,在每个卷积block后的特征图分块后进行变形,更具体地来说,就是卷积网络中定义了如下操作:

[0060][0061]

其中,x代表输入特征,y代表和x同尺寸的输出特征,都以向量形式表示。i是需要被计算相似度的图像块的索引坐标,j是所有可能被关联计算到的周边图像块的索引坐标。c(x)为正则化的系数;g是一个线性嵌入层,是一个一元函数;f代表对i和j两两间相似度的计算操作,它本质上是高斯函数,表示如下:

[0062]

[0063]

其中,是点对点间的相似度计算,这种计算方法在深度卷积神经网络中更容易实现。为了便于计算投影后在新维度空间内的相似度,对上述的高斯函数进行了简单的扩展,如下所示:

[0064][0065]

其中,θ(xi)=w

θ

xi和φ(xj)=w

φ

xj是两个嵌入层。g是一个线性嵌入层,本质上是一个一元函数g(xj)=wgxj,其中wg是一个要被学习的权重矩阵,在空间上是1

×1×

1的卷积操作。还设置了作为正则化的系数。经此操作,就使得感受野更专注于所需要的局部信息的提取。

[0066]

(5)在(4)中rgb流骨干网络最后的池化层提取特征图输入局部异常模块(second order anomaly)计算异常得分,结合(3)中的二分类交叉熵损失得到最终的异常损失(anomaly loss),利用反向传播对局部异常模块与骨干网络进行更新,得到训练好的局部异常检测网络。

[0067]

如图5所示,首先,将从池化层提取的源特征图x=f(i)∈rh×w×c按通道维度的方向划分为n

×

n个图像块,其中,i表示输入图像,f表示骨干网络,h,w,c分别表示特征图的长度、宽度和通道数,每个图像块的大小为h

×

w,h,w分别表示图像块的长度与宽度,其中h=h//n,w=w//n。

[0068]

下面开始提取局部特征,设(m,n)为图像块的横坐标索引与纵坐标索引,则对于一个位于(m,n)位置的图像块用x

mn

进行表示,分别计算该图像块与其正上方、正下方、正左方、正右方这四个方位最近邻图像块的相似度。

[0069]

为了扩大一个图像块的局部信息量,将四个方位次近邻的图像块也纳入相似度的计算范围中。即对一个图像块x

mn

及其上、下、左、右、次上、次下、次左、次右这八个图像块构成八个对{x

mn

,x

m+i,n+j

},i∈{0,

±

1,

±

2},j∈{0,

±

1,

±

2},两两计算相似度。

[0070]

在图x中,f(m,n)代表一个图像块在h和w方向在一系列卷积操作f之后的坐标。f(m+i,n+j)代表其周边图像块。

[0071]

另外,为了便于相似度计算,设计了1

×

1卷积操作f,将特征图投射到统一的新维度空间。从空间上来看,这些图像块间形成的对实际上是个三维向量,它们的尺寸是2

×1×

c或者1

×2×

c。然后将特征利用全连接层输出真/假的二类分类概率,最后,引入了二分类的交叉熵损失来约束卷积网络。

[0072][0073]

因为本发明的预训练是有监督的,每一个卷积层最后都会输出一个二维灰度图像。在数据集中真假标签的监督下,对上述八个图像块对中的每一对图形块的相似度取平均值,并根据全连接层输出的概率作为真假分类的结果。

[0074]

(6)获取待检测数据集,剪裁人脸图像,输入训练好的局部异常检测网络进行最终人脸真假分类。

[0075]

本实施例在ff++(包括deepfake、face to face、face shifter、neural texture这四个子集)大型伪造人脸视频数据集上进行了训练与测试,表1中展示了ff++数据集的基本信息。本实施例测试了不同序列长度n的变化对检测精度的影响,并与著名的时空特征提

取模型cnn-lstm进行了对比,dfdc-p上的相关结果展示在表2中,celeb-df的结果展示在表3中。可以发现,在两个数据集上,随着序列长度的增加,精度也随之增加直到帧数达到15帧,并且无论n的大小,本发明所提出的方案的精度总是高于著名的cnn-lstm模型,进一步证明了本方案在时域特征融合中的优越性。

[0076]

表1两个数据集的基本信息

[0077]

数据集真实视频/伪造视频总帧数(百万)分辨率ff++1000/4000358.8/2116.8多尺度dfdc-p1131/411388.4/1783.3180p-2160pceleb-df890/5639358.8/2116.8多尺度

[0078]

表2 dfdc-p上不同帧数对于检测精度的影响

[0079]

序列长度369121518本方案84.7683.1482.7585.2884.8183.19cnn-lstm79.0880.5080.2880.7881.9179.75

[0080]

表3 ff++内部跨库测试精度

[0081]

序列长度369121518本方案95.8696.2796.1797.1296.9195.28cnn-lstm95.2295.0695.1396.5396.3895.28

[0082]

以上所述是本发明的优选实施方式,应当指出,对于本技术领域的普通技术人员来说,在不脱离本发明技术原理的前提下,还可以做出若干改进和变形,这些改进和变形也应视为本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1