手势位置确定方法及相关装置、交互方法及相关装置与流程

本发明涉及交互领域,尤其涉及一种手势位置确定方法及相关装置、交互方法及相关装置。

背景技术:

1、随着ar/vr技术的进步,越来越多的ar/vr设备被运用到人们的日常生活中,人们可以佩戴ar/vr设备,以在ar/vr设备的视野内,基于交互手势进行各种操作。

2、目前有一种交互方法,是利用多个摄像头,捕捉ar/vr设备视野中使用者的交互手势,以及该交互手势所在的位置。对于此种交互方法,通过摄像头捕捉画面,分析使用者的交互手势具有一定的局限性,比如使用者的交互手势可能不在视野范围内,或者被其他物体遮挡,或者由于视角的原因无法获取完整的使用者手部画面等等,此时则无法准确的分析出使用者的交互手势,那么交互则比较容易出错。

3、除此之外,还有一种交互方法,该交互方法基于传感手套进行,传感手套在手的各个关节上均设置传感器,以检测使用者的交互手势以及位置,对于此种交互方法,由于需要基于传感手套才能实现,传感手套对使用者的手指具有一定的束缚作用,而且传感手套上设置了大量的传感器,重量也较重,因此使用者的使用体验不佳。

技术实现思路

1、本发明的主要目的在于提供一种手势位置确定方法及相关装置、交互方法及相关装置,旨在解决背景技术中所提到的问题。

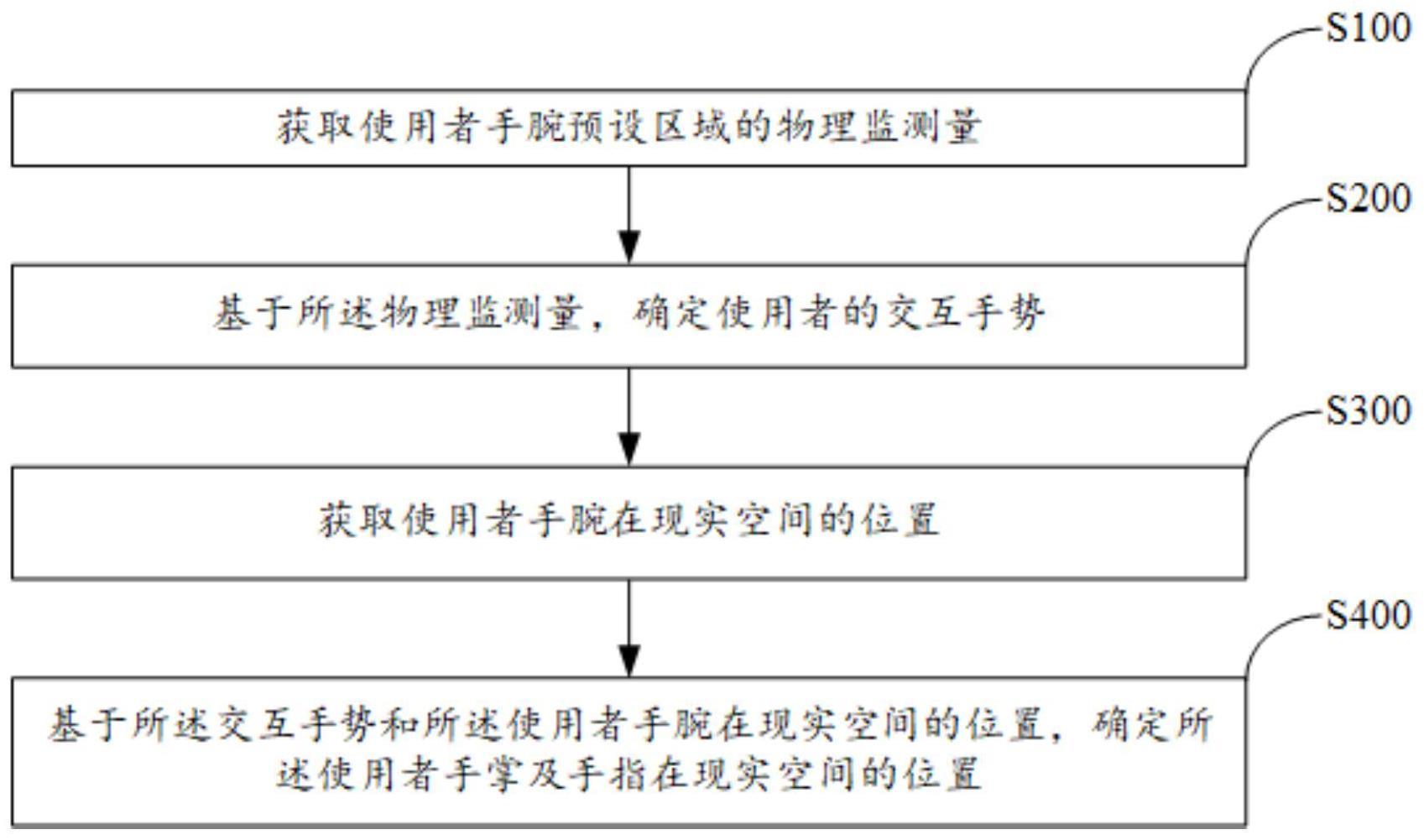

2、为实现上述目的,本发明提供一种手势位置确定方法,运用于交互设备,该手势位置确定方法包括:

3、获取使用者手腕预设区域的物理监测量;

4、基于所述物理监测量,确定使用者的交互手势;

5、获取使用者手腕在现实空间的位置;

6、基于所述交互手势和所述使用者手腕在现实空间的位置,确定所述使用者手掌及手指在现实空间的位置。

7、在本技术实施例中,所述物理监测量由第一设备采集,所述第一设备设有腕带,所述腕带上设有多个压力传感器;

8、所述获取使用者手腕预设区域的物理监测量包括:

9、基于所述腕带上的多个压力传感器,获取所述使用者手部在进行交互时手腕预设区域的压力值。

10、在本技术实施例中,所述基于所述物理监测量,确定使用者的交互手势,包括:

11、基于手势估计模型、所述多个压力传感器的压力值,以及所述使用者的手部描述信息,确定使用者的交互手势。

12、在本技术实施例中,所述手部描述信息至少包括使用者的年龄、性别、手腕周长和手掌尺寸中的一项;

13、所述手势估计模型基于第一数据集预先训练得到;

14、所述第一数据集包括多个压力值,所述多个压力值包括不同用户佩戴所述腕带完成不同交互手势时,所述腕带上各个压力传感器的压力值;

15、不同用户的手部描述信息不同。

16、在本技术实施例中,所述交互设备包括第二设备,所述第二设备包括双目摄像头;

17、所述获取使用者手腕在现实空间的位置,包括:

18、基于所述双目摄像头获取包含所述使用者手腕的第一影像,所述第一影像的获取时间与所述物理监测量的监测时间相同;

19、基于手部关键点识别模型识别所述第一影像中的手腕关键点;

20、基于双目摄像头的空间定位法,得到所述手腕关键点在现实空间的位置;

21、基于所述手腕关键点在现实空间的位置,确定所述使用者手腕在现实空间的位置。

22、在本技术实施例中,所述手部关键点识别模型基于第二数据集预先训练得到,其中,所述第二数据集包括多个第二影像,各个第二影像的采集条件不同,所述采集条件至少包括用户、拍摄角度和交互手势中的一项;

23、所述手部关键点识别模型通过以下方式预先训练得到:

24、将多个所述第二影像输入所述手部关键点识别模型,得到每个所述第二影像的手部特征值,并对每个所述第二影像标记手部关键点,其中,所述手部关键点包括手腕关键点、手掌关键点和手指关键点;

25、针对每个第二影像,将所述第二影像中的手部特征值与所述第二影像中的各个手部关键点位置绑定,以便得到与第二数据集对应的映射集,所述映射集包括每个第二影像的手部特征值与手部关键点位置的映射关系。

26、在本技术实施例中,所述基于所述交互手势和所述使用者手腕在现实空间的位置,确定所述使用者手掌及手指在现实空间的位置,包括:

27、基于所述使用者的交互手势、所述使用者手腕在现实空间的位置,以及预先获取的所述使用者手部关键点的相对位置关系,确定所述使用者手掌及手指在现实空间的位置;

28、其中,所述使用者手部关键点的相对位置关系包括:手掌关键点与手腕关键点的相对位置关系,及手指关键点与手腕关键点的相对位置关系。

29、在本技术实施例中,所述使用者手部关键点的相对位置关系基于如下方式获取:

30、基于所述双目摄像头获取包含所述使用者手部的第三影像,其中所述第三影像包含所述使用者手部的全部关键点;

31、将所述第三影像输入所述手部关键点识别模型,得到所述第三影像的手部特征值;

32、基于所述手部特征值以及所述映射集,获取所述第三影像中手部的各个关键点;

33、基于所述第三影像中手部的各个关键点,获取所述使用者手部关键点的相对位置关系。

34、在本技术实施例中,当所述使用者手部位于所述双目摄像头的视野范围内时,所述确定所述使用者手掌及手指在现实空间的位置,包括:

35、基于所述第一影像中的使用者手腕关键点在现实空间的位置、所述使用者的交互手势,以及所述使用者手部关键点的相对位置关系,确定所述使用者手掌关键点和手指关键点在现实空间的位置;

36、基于所述使用者手掌关键点和手指关键点在现实空间的位置,确定所述使用者手掌及手指在现实空间的位置。

37、在本技术实施例中,所述第一设备还包括加速度计,所述加速度计用于获取使用者手部的加速度,所述确定所述使用者手掌及手指在现实空间的位置,包括:

38、基于所述双目摄像头获取包含所述使用者手腕的第四影像;

39、基于所述手部关键点识别模型,获取所述第四影像中使用者的手腕关键点;

40、基于双目摄像头的空间定位法,确定所述第四影像中的使用者的手腕关键点在现实空间的位置;

41、基于所述第四影像中的使用者的手腕关键点在现实空间的位置,以及所述使用者手部的加速度,确定所述使用者的手腕关键点后续在现实空间的位置;

42、基于所述使用者的手腕关键点后续在现实空间的位置、所述使用者后续的交互手势,以及所述使用者手部关键点的相对位置关系,确定所述使用者手掌关键点及手指关键点后续在现实空间的位置;

43、基于所述使用者手掌关键点及手指关键点后续在现实空间的位置,确定所述使用者手掌及手指后续在现实空间的位置。

44、在本技术实施例中,当所述使用者手部位于所述双目摄像头的视野范围外时,所述第四影像为所述使用者手腕位于所述视野范围内的最后一帧影像,所述确定所述使用者手掌及手指在现实空间的位置,包括:

45、基于所述手部关键点识别模型,获取所述第四影像中使用者的手腕关键点;

46、基于双目摄像头的空间定位法,确定所述第四影像中的使用者的手腕关键点在现实空间的位置;

47、基于所述第四影像中的使用者的手腕关键点在现实空间的位置,以及所述使用者手部的加速度,确定所述使用者手部位于所述双目摄像头视野范围外时,所述使用者的手腕关键点在现实空间的位置;

48、基于所述使用者手部位于所述双目摄像头视野范围外时手腕关键点在现实空间的位置、所述使用者的交互手势,以及所述使用者手部关键点的相对位置关系,确定所述使用者手部位于所述双目摄像头的视野范围外时,所述使用者手掌关键点及手指关键点在现实空间的位置;

49、基于所述使用者手部位于所述双目摄像头的视野范围外时,所述使用者手掌关键点及手指关键点在现实空间的位置,确定所述使用者手部位于所述双目摄像头的视野范围外时,所述使用者手掌及手指在现实空间的位置。

50、本技术实施例还提出一种交互方法,所述交互方法包括:

51、采用上述任一项所述的手势位置确定方法,获取使用者的交互手势及使用者手腕、手掌、手指在现实空间的位置;

52、基于所述交互手势和所述使用者手腕、手掌、手指在现实空间的位置,确定所述使用者所做出的交互信息。

53、本技术还提出一种手势位置确定装置,运用于交互设备,所述手势位置确定装置包括:

54、获取模块,用于获取使用者手腕预设区域的物理监测量;

55、处理模块,用于基于所述使用者手腕预设区域的物理检测量,确定使用者的交互手势;以及

56、基于所述包含使用者手腕的影像确定使用者手腕在现实空间的位置;以及

57、基于所述交互手势和所述使用者手腕在现实空间的位置,确定所述使用者手掌及手指在现实空间的位置。

58、在本技术实施例中,所述手腕预设区域的物理检测量为手腕预设区域的压力值,所述获取模块被配置为,获取所述使用者手部在进行交互时手腕预设区域的压力值。

59、在本技术实施例中,所述处理模块设有手势估计模型,所述获取模块还用于获取所述使用者的手部描述信息;

60、所述处理模块还被配置为:基于所述手势估计模型、所述使用者手腕预设区域的压力值,以及所述使用者的手部描述信息,确定使用者的交互手势。

61、在本技术实施例中,所述手部描述信息至少包括使用者的年龄、性别、手腕周长和手掌尺寸中的一项;

62、所述处理模块还被配置为,通过第一数据集预先训练所述手势估计模型;

63、其中,所述第一数据集包括多个压力值,所述多个压力值包括不同用户佩戴所述腕带完成不同交互手势时,所述腕带上各个压力传感器的压力值;

64、所述多个用户的年龄、性别、手腕周长和手掌尺寸中的至少一项不同。

65、在本技术实施例中,所述处理模块还被配置为:

66、获取包含所述使用者手腕的第一影像,其中,所述第一影像基于双目摄像头采集得到;基于手部关键点识别模型识别所述第一影像中的手腕关键点;

67、基于双目摄像头的空间定位法,得到所述手腕关键点在现实空间的位置;

68、基于所述手腕关键点在现实空间的位置,确定所述使用者手腕在现实空间的位置。

69、在本技术实施例中,所述处理模块还包括手部关键点识别模型,所述处理模块还被配置为,通过如下方式对所述手部关键点识别模型进行预先训练:

70、获取第二数据集,所述第二数据集包括多个第二影像,各个第二影像的采集条件不同,所述采集条件至少包括用户、拍摄角度和交互手势中的一项;

71、将所述多个第二影像输入所述手部关键点识别模型,得到每个所述第二影像的手部特征值,并对每个所述第二影像标记手部关键点,其中,所述手部关键点包括手腕关键点、手掌关键点和手指关键点;

72、针对每个第二影像,将所述第二影像中的手部特征值与所述第二影像中的各个手部关键点位置绑定,以便得到与第二数据集对应的映射集,所述映射集包括每个第二影像的手部特征值与手部关键点位置的映射关系。

73、在本技术实施例中,所述处理模块还被配置为:

74、基于所述使用者的交互手势、所述使用者手腕在现实空间的位置,以及预先获取的所述使用者手部关键点的相对位置关系,确定所述使用者手掌及手指在现实空间的位置;

75、其中,所述使用者手部关键点的相对位置关系包括:手掌关键点与手腕关键点的相对位置关系,及手指关键点与手腕关键点的相对位置关系。

76、在本技术实施例中,所述获取模块还用于获取包含所述使用者手部的第三影像,其中所述第三影像基于双目摄像头采集得到,所述第三影像包含所述使用者手部的全部关键点;

77、所述处理模块还被配置为,通过如下方式获取使用者手部关键点的相对位置:

78、将所述第三影像输入所述手部关键点识别模型,得到所述第三影像的手部特征值;

79、基于所述手部特征值以及所述映射集,获取所述第三影像中手部的各个关键点;

80、基于所述第三影像中手部的各个关键点,获取所述使用者手部关键点的相对位置关系。

81、在本技术实施例中,当所述使用者手部位于所述交互设备视野范围内时所述处理模块还被配置为:

82、基于所述第一影像中的使用者手腕关键点在现实空间的位置、所述使用者的交互手势,以及所述使用者手部关键点的相对位置关系,确定所述使用者手掌关键点和手指关键点在现实空间的位置;

83、基于所述使用者手掌关键点和手指关键点在现实空间的位置,确定所述使用者手掌及手指在现实空间的位置。

84、在本技术实施例中,所述获取模块用于获取使用者手部的加速度以及包含使用者手腕的第四影像,所述处理模块还被配置为:

85、基于所述手部关键点识别模型,获取所述第四影像中使用者的手腕关键点;

86、基于双目摄像头的空间定位法,确定所述第四影像中的使用者的手腕关键点在现实空间的位置;

87、基于所述第四影像中的使用者的手腕关键点在现实空间的位置,以及所述使用者手部的加速度,确定所述使用者的手腕关键点后续在现实空间的位置;

88、基于所述使用者的手腕关键点后续在现实空间的位置、所述使用者后续的交互手势,以及所述使用者手部关键点的相对位置关系,确定所述使用者手掌关键点及手指关键点后续在现实空间的位置;

89、基于所述使用者手掌关键点及手指关键点后续在现实空间的位置,确定所述使用者手掌及手指后续在现实空间的位置。

90、在本技术实施例中,所述第四影像为所述使用者手腕位于所述交互设备的视野范围内的最后一帧影像,当所述使用者手部位于所述交互设备的视野范围外时,所述处理模块还被配置为:

91、基于所述手部关键点识别模型,获取所述第四影像中使用者的手腕关键点;

92、基于双目摄像头的空间定位法,确定所述第四影像中的使用者的手腕关键点在现实空间的位置;

93、基于所述第四影像中的使用者的手腕关键点在现实空间的位置,以及所述使用者手部的加速度,确定所述使用者手部位于所述双目摄像头视野范围外时,所述使用者的手腕关键点在现实空间的位置;

94、基于所述使用者手部位于所述双目摄像头视野范围外时手腕关键点在现实空间的位置、所述使用者的交互手势,以及所述使用者手部关键点的相对位置关系,确定所述使用者手部位于所述双目摄像头的视野范围外时,所述使用者手掌关键点及手指关键点在现实空间的位置;

95、基于所述使用者手部位于所述双目摄像头的视野范围外时,所述使用者手掌关键点及手指关键点在现实空间的位置,确定所述使用者手部位于所述双目摄像头的视野范围外时,所述使用者手掌及手指在现实空间的位置。

96、本技术还提出一种交互装置,包括第一设备和第二设备,所述第二设备包括如上述任一项所述的手势位置确定装置以及判断模块,所述判断模块被配置为:

97、基于所述手势位置确定装置确定的所述使用者手腕、手掌、手指在现实空间的位置,确定所述使用者手部在虚拟空间的位置;以及

98、基于所述手势位置确定装置确定的所述交互手势和所述使用者的手腕、手掌和手指在虚拟空间的位置,确定所述使用者所做出的交互信息。

99、在本技术实施例中,所述第一设备包括腕带,所述腕带上设有多个压力传感器,所述多个压力传感器用于监测所述使用者手腕预设区域的压力值;

100、所述第二设备包括双目摄像头。

101、在本技术实施例中,所述第一设备为智能手表或智能手环,所述智能手表和所述智能手环均包括所述腕带;

102、所述第二设备为智能电话,所述智能电话包括双目摄像头。

103、本发明还提出一种存储介质,其上存储有计算机程序,所述计算机程序被处理器执行时实现上述的方法。

104、本发明还提出一种计算设备,所述计算设备包括处理器,所述处理器用于执行存储器中存储的计算机程序时实现上述的方法。

105、通过以上描述可知,本技术所提出的手势位置确定方法,通过获取手腕预设区域的物理监测量来确定使用者的交互手势,无论视角如何,手部是否被遮挡,均能够准确的确定交互手势,相较于现有技术中通过计算机视觉基于使用者的手部图像来确定交互手势更加的准确;另外,相较于现有技术中直接根据手部图像计算手部的位置,本技术则先获取手腕的位置,而后再根据交互手势和手腕的位置来确定手指和手掌的位置,而手腕的轮廓相较于手掌、手指更加的规则,因而根据手腕的位置推测的手掌、手指的位置,准确度较高,而且无论在何种视角下,何种交互手势下,手腕基本都能够被捕捉到,避免因手部影像不全而无法识别的情况发生。

- 还没有人留言评论。精彩留言会获得点赞!