数据处理方法、装置、设备及存储介质与流程

1.本技术涉及自动驾驶技术领域,尤其涉及一种数据处理方法、装置、设备及存储介质。

背景技术:

2.现阶段对于自动驾驶的研究大多是通过搭载有摄像头和雷达的车辆对行驶过程中的自车信息、周围环境信息、周围车辆行人行动轨迹信息以及当时天气光照等信息进行采集,然后将采集到的信息导入自动驾驶仿真平台进行当时驾驶环境还原以及驾驶模拟。

3.然而,对于目前通过车辆采集信息的形式而言,每次都只有开车出行且在确保各种传感器数据指标工作正常的情况下,才能够正常准确地进行采集工作。即便如此,由于开车出行是采集工作的前提,势必会存在开车采集的缺陷和弊端。例如,每次开车出行所能够采集到的驾驶环境和驾驶里程数有限。但若同时使用多辆车进行采集,又会带来采集成本昂贵的问题。又例如,有些驾驶场景所需的信息虽然可以基于自车去采集,但信息采集过程中的危险性和代价均又很高。比如采集危险换道、追尾、事故等一些在日常开车过程中都有可能遇到的这些危险驾驶场景相关的信息。另外,所采集到的信息若要支撑自动驾驶仿真使用,又还要根据这些信息进行驾驶场景分类。并且,目前利用开车所采集到的信息构建驾驶场景分类的方法都是通过指标统计的方式得以实现,分类准确性和智能化均存在不足,效率也相对低下。

4.可见,针对目前开车采集信息的方式以及利用所采集到的信息进行驾驶场景分类所存在的上述缺陷及弊端亟需一种解决方案。

技术实现要素:

5.本技术提供一种数据处理方法、装置、设备及存储介质,旨在解决现有技术中开车进行信息采集以及利用开车采集到的信息进行驾驶场景分类所存在的缺陷及弊端。

6.第一方面,本技术提供一种数据处理方法,包括:

7.通过无人机采集可用视频数据,所述可用视频数据中包含有行驶车辆的图像;

8.根据所述可用视频数据得到所述行驶车辆的标准轨迹数据,并根据所述行驶车辆的标准轨迹数据得到所述行驶车辆的行驶特征数据;

9.根据所述行驶车辆的行驶特征数据对初始驾驶场景分类模型进行训练得到目标驾驶场景分类模型。

10.在一种可能的设计中,在得到所述目标驾驶场景分类模型后,还包括:

11.利用目标驾驶场景分类模型对目标车辆的驾驶数据进行分类,分类出的驾驶场景用于仿真平台进行自动驾驶模拟的仿真。

12.在一种可能的设计中,所述通过无人机采集可用视频数据,包括:

13.利用所述无人机获取目标道路区域预设高度范围内的原始视频数据;

14.对所述原始视频数据进行视频内容筛选,以将包含有所述行驶车辆的图像的原始

视频数据确定为所述可用视频数据。

15.在一种可能的设计中,所述根据所述可用视频数据得到所述行驶车辆的标准轨迹数据,包括:

16.对所述可用视频数据进行图像抖动修复处理,得到标准图像数据;

17.对所述标准图像数据进行车辆提取及轨迹跟踪处理,得到所述行驶车辆的轨迹数据;

18.对所述行驶车辆的轨迹数据进行坐标转换,得到所述行驶车辆的标准轨迹数据,所述坐标转换用于所述无人机的相对坐标系与大地坐标系之间的数据转化。

19.在一种可能的设计中,所述对所述可用视频数据进行图像抖动修复处理,得到标准图像数据,包括:

20.根据所述无人机的定位信息对所述可用视频数据进行所述无人机标准定位点转换,所述标准定位点转换用于将采集所述可用视频数据时的参照采集点转换为标准采集点,以对所述可用视频数据实现所述图像抖动修复处理;

21.将转换为所述标准采集点后的可用视频数据确定为所述标准图像数据。

22.在一种可能的设计中,所述对所述行驶车辆的轨迹数据进行坐标转换,得到所述行驶车辆的标准轨迹数据,包括:

23.根据所述无人机的坐标信息和所述目标道路区域中关键点坐标信息对第一坐标矩阵数据进行所述坐标转换,得到大地坐标系中的第二坐标矩阵数据,所述第一坐标矩阵数据用于在所述无人机的相对坐标系中表征所述行驶车辆的轨迹数据;

24.将所述第二坐标矩阵表征的所述行驶车辆的轨迹数据确定为所述行驶车辆的标准轨迹数据。

25.在一种可能的设计中,所述根据所述行驶车辆的标准轨迹数据获得所述行驶车辆的行驶特征数据,包括:

26.根据所述行驶车辆的标准轨迹数据获取每个行驶车辆在当前轨迹点的特征数据,并对所述特征数据进行结构化,得到所述行驶车辆的行驶特征数据;

27.其中,所述行驶车辆的行驶特征数据包括所述每个行驶车辆的速度、加速度、转向角、车辆编号以及车辆尺寸。

28.在一种可能的设计中,所述根据所述行驶车辆的行驶特征数据对初始驾驶场景分类模型进行训练得到目标驾驶场景分类模型,包括:

29.根据所述行驶车辆的行驶特征数据和多个分类驾驶场景对所述初始驾驶场景分类模型进行训练得到中间驾驶场景分类模型,所述多个分类驾驶场景包括直行驾驶场景、转弯驾驶场景、变道驾驶场景、超车驾驶场景、跟车驾驶场景、避让驾驶场景以及第一危险驾驶场景;

30.根据第二危险驾驶场景以及所述第二危险驾驶场景中事故车辆的行驶特征数据对所述中间驾驶场景分类模型进行训练得到所述目标驾驶场景分类模型。

31.在一种可能的设计中,在得到所述目标驾驶场景分类模型之后,还包括:

32.根据模型解释工具对所述目标驾驶场景分类模型进行分析,得到碰撞特征数据集,所述碰撞特征数据集包括多个两车之间距离临界值构成的数据集、多个车辆车速临界值构成的数据集以及多个两车相对车速临界值构成的数据集;

33.将与所述目标驾驶场景分类模型分类出的危险驾驶场景正相关的碰撞特征数据集确定为正激励样本;

34.将与所述目标驾驶场景分类模型分类出的危险驾驶场景负相关的碰撞特征数据集确定为负激励样本;

35.对所述正激励样本和所述负激励样本进行可视化展示,以获得目标数据范围,并利用所述目标数据范围内的碰撞特征数据集获得碰撞参数;

36.其中,所述碰撞参数包括跟车时距和避撞时间。

37.在一种可能的设计中,在获得所述碰撞参数之后,还包括:

38.根据重新获取的所述行驶车辆的行驶特征数据对所述目标驾驶场景分类模型进行优化;

39.根据优化后的目标驾驶场景分类模型对所述碰撞参数进行优化。

40.第二方面,本技术提供一种数据处理装置,包括:

41.获取模块,用于通过无人机采集可用视频数据,所述可用视频数据中包含有行驶车辆的图像;

42.处理模块,用于根据所述可用视频数据得到所述行驶车辆的标准轨迹数据,并根据所述行驶车辆的标准轨迹数据获得所述行驶车辆的行驶特征数据;

43.训练模块,用于根据所述行驶车辆的行驶特征数据对初始驾驶场景分类模型进行训练得到目标驾驶场景分类模型。

44.在一种可能的设计中,所述数据处理装置,还包括:分类模块;所述分类模块,用于:

45.利用目标驾驶场景分类模型对目标车辆的驾驶数据进行分类,分类出的驾驶场景用于仿真平台进行自动驾驶模拟的仿真。

46.在一种可能的设计中,所述获取模块,具体用于:

47.利用所述无人机获取目标道路区域预设高度范围内的原始视频数据;

48.对所述原始视频数据进行视频内容筛选,以将包含有所述行驶车辆的图像的原始视频数据确定为所述可用视频数据。

49.在一种可能的设计中,所述处理模块,包括:

50.第一处理子模块,用于对所述可用视频数据进行图像抖动修复处理,得到标准图像数据;

51.第二处理子模块,用于对所述标准图像数据进行车辆提取及轨迹跟踪处理,得到所述行驶车辆的轨迹数据;

52.第三处理子模块,用于对所述行驶车辆的轨迹数据进行坐标转换,得到所述行驶车辆的标准轨迹数据,所述坐标转换用于所述无人机的相对坐标系与大地坐标系之间的数据转化。

53.在一种可能的设计中,所述第一处理子模块,具体用于:

54.根据所述无人机的定位信息对所述可用视频数据进行所述无人机的标准定位点转换,所述标准定位点转换用于将采集所述可用视频数据时的参照采集点转换为标准采集点,以对所述可用视频数据实现所述图像抖动修复处理;

55.将转换为所述标准采集点后的可用视频数据确定为所述标准图像数据。

56.在一种可能的设计中,所述第三处理子模块,具体用于:

57.根据所述无人机的坐标信息和所述目标道路区域中关键点坐标信息对第一坐标矩阵数据进行所述坐标转换,得到大地坐标系中的第二坐标矩阵数据,所述第一坐标矩阵数据用于在所述无人机的相对坐标系中表征所述行驶车辆的轨迹数据;

58.将所述第二坐标矩阵数据表征的所述行驶车辆的轨迹数据确定为所述行驶车辆的标准轨迹数据。

59.在一种可能的设计中,所述处理模块,还包括:第四处理子模块;所述第四处理子模块,用于:

60.根据所述行驶车辆的标准轨迹数据获取每个行驶车辆在当前轨迹点的特征数据,并对所述特征数据进行结构化,得到所述行驶车辆的行驶特征数据;

61.其中,所述行驶车辆的行驶特征数据包括所述每个行驶车辆的速度、加速度、转向角、车辆编号以及车辆尺寸。

62.在一种可能的设计中,所述训练模块,包括:

63.第一训练子模块,用于根据所述行驶车辆的行驶特征数据和多个分类驾驶场景对所述初始驾驶场景分类模型进行训练得到中间驾驶场景分类模型,所述多个分类驾驶场景包括直行驾驶场景、转弯驾驶场景、变道驾驶场景、超车驾驶场景、跟车驾驶场景以及、避让驾驶场景以及第一危险驾驶场景;

64.第二训练子模块,用于根据第二危险驾驶场景以及所述第二危险驾驶场景中事故车辆的行驶特征数据对所述中间驾驶场景分类模型进行训练得到所述目标驾驶场景分类模型。

65.在一种可能的设计中,所述处理模块,还用于:

66.根据模型解释工具对所述目标驾驶场景分类模型进行分析,得到碰撞特征数据集,所述碰撞特征数据集包括多个两车之间距离临界值构成的数据集、多个车辆车速临界值构成的数据集以及多个两车相对车速临界值构成的数据集;

67.将与所述目标驾驶场景分类模型分类出的危险驾驶场景正相关的碰撞特征数据集确定为正激励样本;

68.将与所述目标驾驶场景分类模型分类出的危险驾驶场景负相关的碰撞特征数据集确定为负激励样本;

69.对所述正激励样本和所述负激励样本进行可视化展示,以获得目标数据范围,并利用所述目标数据范围内的碰撞特征数据集获得碰撞参数。

70.在一种可能的设计中,所述数据处理装置,还包括:优化模块;所述优化模块,用于:

71.根据重新获取的所述行驶车辆的行驶特征数据对所述目标驾驶场景分类模型进行优化;

72.根据优化后的目标驾驶场景分类模型对所述碰撞参数进行优化。

73.第三方面,本技术提供一种电子设备,包括:处理器,以及与所述处理器通信连接的存储器;

74.所述存储器存储计算机执行指令;

75.所述处理器执行所述存储器存储的计算机执行指令,以实现如第一方面所提供的

任意一种可能的数据处理方法。

76.第四方面,本技术提供一种计算机可读存储介质,所述计算机可读存储介质中存储有计算机执行指令,所述计算机执行指令被处理器执行时用于实现如第一方面所提供的任意一种可能的数据处理方法。

77.第五方面,本技术提供一种计算机程序产品,包括计算机执行指令,该计算机执行指令被处理器执行时用于实现第一方面所提供的任意一种可能的数据处理方法。

78.本技术提供一种数据处理方法、装置、设备及存储介质,首先通过无人机采集可用视频数据,所采集到的可用视频数据中包含有行驶车辆的图像,然后根据可用视频数据得到行驶车辆的标准轨迹数据,并根据行驶车辆的标准轨迹数据得到行驶车辆的行驶特征数据,再根据行驶车辆的行驶特征数据对初始驾驶场景分类模型进行训练得到目标驾驶场景分类模型。通过无人机采集可用视频数据,并基于无人机采集到的可用视频数据得到行驶车辆的行驶特征数据以进行模型训练,得到用于驾驶场景的分类的目标驾驶场景分类模型,从而基于机器学习手段和利用无人机进行信息采集的方式获得目标驾驶场景分类模型,克服了现有技术中开车进行信息采集所存在的缺陷和弊端以及采用指标统计进行驾驶场景分类所存在的不足,提升了分类准确性和智能化以及分类效率。

附图说明

79.为了更清楚地说明本技术实施例或现有技术中的技术方案,下面将对实施例或现有技术描述中所需要使用的附图作一简单地介绍,显而易见地,下面描述中的附图是本技术的一些实施例,对于本领域普通技术人员来讲,在不付出创造性劳动性的前提下,还可以根据这些附图获得其他的附图。

80.图1为本技术实施例提供的一种应用场景示意图;

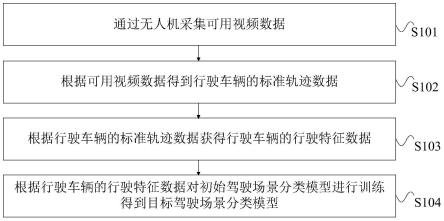

81.图2为本技术实施例提供的一种数据处理方法的流程示意图;

82.图3为本技术实施例提供的另一种数据处理方法的流程示意图;

83.图4为本技术实施例提供的再一种数据处理方法的流程示意图;

84.图5为本技术实施例提供的又一种数据处理方法的流程示意图;

85.图6为本技术实施例提供的又一种数据处理方法的流程示意图;

86.图7为本技术实施例提供的又一种数据处理方法的流程示意图;

87.图8为本技术实施例提供的一种数据处理装置的结构示意图;

88.图9为本技术实施例提供的又一种数据处理装置的结构示意图;

89.图10为本技术实施例提供的一种电子设备的结构示意图。

具体实施方式

90.这里将详细地对示例性实施例进行说明,其示例表示在附图中。下面的描述涉及附图时,除非另有表示,不同附图中的相同数字表示相同或相似的要素。以下示例性实施例中所描述的实施方式并不代表与本技术相一致的所有实施方式。相反,它们仅是与如所附权利要求书中所详述的、本技术的一些方面相一致的方法和装置的例子。

91.本技术的说明书和权利要求书及上述附图中的术语“第一”、“第二”、“第三”“第四”等(如果存在)是用于区别类似的对象,而不必用于描述特定的顺序或先后次序。应该理

解这样使用的数据在适当情况下可以互换,以便这里描述的本技术的实施例例如能够以除了在这里图示或描述的那些以外的顺序实施。此外,术语“包括”和“具有”以及他们的任何变形,意图在于覆盖不排他的包含,例如,包含了一系列步骤或单元的过程、方法、系统、产品或设备不必限于清楚地列出的那些步骤或单元,而是可包括没有清楚地列出的或对于这些过程、方法、产品或设备固有的其它步骤或单元。

92.现阶段对于自动驾驶的研究而言,大多通过开车出行采集信息的方式进行信息采集,这种开车采集的方式存在诸多缺陷和弊端。并且,所采集到的信息若要支撑自动驾驶仿真使用,又还需对驾驶场景进行分类。另外,现有技术中利用开车出行采集到的信息进行驾驶场景分类是通过指标统计的方式得以实现,使得分类准确性和智能化均存在不足,并且分类效率还相对低下。

93.针对现有技术中存在的上述问题,本技术提供一种数据处理方法、装置、设备及存储介质。本技术提供的数据处理方法的发明构思在于:通过无人机采集包含有行驶车辆的图像,以获得可用视频数据,然后根据可用视频数据首先得到行驶车辆的标准轨迹数据,再根据标准轨迹数据得到行驶特征数据,最后利用行驶车辆的行驶特征数据对初始驾驶场景分类模型进行训练,得到可用进行驾驶场景分类的目标驾驶场景分类模型。基于机器学习手段和利用无人机进行信息采集的方式获得用于驾驶场景分类的目标驾驶场景分类模型,克服了现有技术中开车进行信息采集所存在的缺陷和弊端以及采用指标统计进行驾驶场景分类所存在的不足,提升了分类准确性和智能化以及分类效率。

94.以下,对本技术实施例的示例性应用场景进行介绍。

95.图1为本技术实施例提供的一种应用场景示意图,如图1所示,无人机10上可以搭载有高清摄像头来采集目标道路区域预设高度范围内的视频数据,目标道路区域可以例如不同特性车辆20的行驶道路,比如高速公路、城市间快速公路、服务区、城区等允许无人机10进行图像采集的区域。预设高度范围例如高空100米至200米范围内的不同高度。无人机10采集到可以视频数据中包含有行驶车辆的图像。电子设备30被配置为可以执行本技术实施例提供的数据处理方法,首先获得无人机10所采集到的可用视频数据,然后根据可用视频数据得到行驶车辆的标准轨迹数据,并根据标准轨迹数据得到行驶特征数据,再利用行驶车辆的行驶轨迹特征数据对初始驾驶场景分类模型进行训练,得到目标驾驶场景分类模型。目标驾驶场景分类模型可以对目标车辆的驾驶数据进行分类,分类出的驾驶场景可以用于自动驾驶仿真平台40进行自动驾驶模拟的仿真操作。

96.需要说明的是,无人机10的型号可用根据实际工况设置,本技术实施例对此不作限定。电子设备30可以为计算机、服务器或者服务器集群,本技术实施例亦不作限定。图1中的电子设备30以计算机为例示出。

97.需要说明的是,上述应用场景仅仅是示意性的,本技术实施例提供的数据处理方法、装置、设备及存储介质包括但不仅限于上述应用场景。

98.图2为本技术实施例提供的一种数据处理方法的流程示意图。如图2所示,本技术实施例提供的数据处理方法,包括:

99.s101:通过无人机采集可用视频数据。

100.其中,可用视频数据中包含有行驶车辆的图像。

101.利用搭载高清摄像头的无人机进行图像拍摄,根据无人机所拍摄到的包含有行驶

车辆的图像的视频数据得到可用视频数据。

102.在一种可能的设计中,步骤s101可能的实现方式如图3所示。图3为本技术实施例提供的另一种数据处理方法的流程示意图。如图3所示,本技术实施例包括:

103.s1011:利用无人机获取目标道路区域预设高度范围内的原始视频数据。

104.搭载有高清摄像头的无人机在有车辆行驶且允许无人机拍摄的区域进行预设高度范围内的拍摄,将拍摄到的视频数据定义为原始视频数据。

105.有车辆行驶且允许无人机拍摄的区域则为目标道路区域,例如不同特性车辆的行驶道路,比如高速公路、城市间快速公路、服务区、城区等允许无人机进行图像采集的区域。预设高度范围可以包括高空100米至200米范围内的不同高度。

106.s1012:对原始视频数据进行视频内容筛选,以将包含有行驶车辆的图像的原始视频数据确定为可用视频数据。

107.对无人机拍摄到的原始视频数据的视频内容进行筛选,以筛选出包含有行驶车辆的图像的原始视频数据,将筛选出的原始视频数据确定为可用视频数据,可用视频数据的视频内容则包含有行驶车辆的图像。

108.可以理解的是,若从原始视频数据中不能筛选出包含有行驶车辆的图像,则利用无人机重新采集原始视频数据。

109.本技术实施例提供的数据处理方法,通过无人机在目标道路区域预设高度范围进行拍摄,并对拍摄到的原始视频数据的视频内容进行筛选,以筛选出包含有行驶车辆的图像的原始视频数据,将筛选出的原始视频数据确定为可用视频数据,实现利用无人机采集信息,避免开车出行采集信息所存在的缺陷和不足。并且,利用无人机进行信息采集能够在短时间进行大量驾驶行为的数据采集,有利于根据可用视频数据获得模型训练所需数据。

110.s102:根据可用视频数据得到行驶车辆的标准轨迹数据。

111.在获得可用视频数据后,根据可用视频数据获得能够表征行驶车辆的行驶轨迹的标准轨迹数据例如车辆gps数据,以便于得到行驶车辆的速度、加速度等数据。

112.例如,根据可用视频数据得到行驶车辆的标准轨迹数据可以通过对可用视频数据进行图像抖动修复处理、车辆提取及轨迹跟踪处理以及坐标转换的预处理得以实现。

113.图像抖动修复处理是对可用视频数据进行采集点定位修复,以确保视频内容中的图像不存在扭曲、变形、不一致等情况。车辆提取及轨迹跟踪处理是为了提取出行驶车辆并对其轨迹跟踪以确保连续视频帧中的行驶车辆为同一行驶车辆。坐标转换是将行驶车辆基于无人机视角的相对位置转化为物理空间真实的位置。

114.在一种可能的设计中,步骤s102可能的实现方式如图4所示。图4为本技术实施例提供的再一种数据处理方法的流程示意图。如图4所示,本技术实施例包括:

115.s1021:对可用视频数据进行图像抖动修复处理,得到标准图像数据。

116.s1022:对标准图像数据进行车辆提取及轨迹跟踪处理,得到行驶车辆的轨迹数据。

117.s1023:对行驶车辆的轨迹数据进行坐标转换,得到行驶车辆的标准轨迹数据。

118.其中,坐标转换用于无人机的相对坐标系与大地坐标系之间的数据转化。

119.例如,首先对可用视频数据进行图像抖动修复处理,将处理后的结果确定标准图像数据。换言之,标准图像数据中的图像不存在扭曲、变形、不一致等情况。进一步对标准图

像数据进行车辆提取及轨迹跟踪处理,将处理后得到的结果确定为行驶车辆的轨迹数据。

120.其中,行驶车辆的轨迹数据可以例如行驶车辆相对于无人机视角的位置以及移动轨迹,而这些位置和移动轨迹并非为行驶车辆真实的位置和移动轨迹,故而还需对行驶车辆的轨迹数据进行坐标转换,以得到行驶车辆真实的位置和移动轨迹,也即行驶车辆的标准轨迹数据。

121.坐标转换的处理手段用于无人机的相对坐标系与大地坐标系之间的数据转化,通过坐标转换处理,可以使得相对于无人机视角的位置和移动轨迹转化为相对于真实物理空间的真实位置和移动轨迹,也即行驶车辆的标准轨迹数据。无人机的相对坐标系用于表征无人机视角,大地坐标系则用于表征真实物理空间的视角。

122.本技术实施例提供的数据处理方法,对可用视频数据分别进行图像抖动修复处理、车辆提取及轨迹跟踪处理以及坐标转换,得到行驶车辆的标准轨迹数据,进而可以利用行驶车辆的标准轨迹数据获的行驶特征数据,以根据行驶特征数据进行模型训练。

123.s103:根据行驶车辆的标准轨迹数据获得行驶车辆的行驶特征数据。

124.行驶车辆的标准轨迹数据可以例如gps数据,根据行驶车辆的标准轨迹数据可以获得每个行驶车辆在当前轨迹点的特征数据,特征数据可以例如每个行驶车辆的速度、加速度、转向角、车辆编号以及车辆尺寸等数据。

125.进一步为了使得该特征数据具有高度统一的数据结构以便于模型训练的运用,则对特征数据进行结构化,得到行驶车辆的行驶特征数据。换言之,特征数据与行驶特征数据包括有相同的数据,不同在于行驶特征数据为结构化数据,相对于特征数据而言采用了统一的数据结构进行表示,例如采用excel格式进行表示等。

126.s104:根据行驶特征数据对初始驾驶场景分类模型进行训练得到目标驾驶场景分类模型。

127.将行驶特征数据作为训练样本对初始驾驶场景分类模型进行训练,得到目标驾驶场景分类模型。其中,初始驾驶场景分类模型可以为具有初步驾驶场景分类能力的分类模型,比如,可以参照行驶特征数据对应可以视频数据中行驶车辆的图像,对行驶特征数据对应驾驶场景进行人工标注,利用人工标注出的驾驶场景以及行驶特征数据对原始分类模型进行训练,得到具有初步驾驶场景分类能力的初始驾驶场景分类模型。

128.对初始驾驶场景分类模型进行训练得到目标驾驶场景分类模型,得到的目标驾驶场景分类模型用于对目标车辆的驾驶数据进行驾驶场景分类,从而基于机器学习实现驾驶场景的分类,不同于现有技术中通过指标统计的方式进行驾驶场景分类,可以有效提升分类准确性和智能化以及分类效率。

129.其中,得到初始驾驶场景分类模型时所用的原始分类模型可以例如lr(logistic regression,逻辑回归)、lightgbm(light gradient boosting machine,梯度提升机器算法)、xgboost(extreme gradient boosting,梯度提升决策树)等模型,本技术实施例对此不作限定。

130.本技术实施例提供的数据处理方法,首先通过无人机采集可用视频数据,所采集到的可用视频数据中包含有行驶车辆的图像,然后根据可用视频数据得到行驶车辆的标准轨迹数据,并根据标准轨迹数据得到行驶车辆的行驶特征数据,根据行驶车辆的行驶特征数据对初始驾驶场景分类模型进行训练,得到目标驾驶场景分类模型。通过无人机采集可

look once)算法或者其他目标检测算法,本技术实施例对于对象识别与定位算法的具体内容不作限定。

146.在提取出行驶车辆后,再基于目标跟踪算法对提取出的行驶车辆所在位置进行轨迹跟踪,通过确保连续视频帧中的行驶车辆为同一行驶车辆,得到当前行驶车辆的移动轨迹,从而得到行驶车辆的移动轨迹。目标跟踪算法可以例如deepsort(detection based tracking)算法等。

147.进而将行驶车辆所在位置以及移动轨迹确定为行驶车辆的轨迹数据。

148.s204a:根据无人机的定位信息和目标道路区域中关键点坐标信息对第一坐标矩阵数据进行坐标转换,得到大地坐标系中的第二坐标矩阵数据。

149.其中,第一坐标矩阵数据用于在无人机的相对坐标系中表征行驶车辆的轨迹数据。

150.s204b:将第二坐标矩阵数据表征的行驶车辆的轨迹数据确定为行驶车辆的标准轨迹数据。

151.由于从可用视频数据中获得的行驶车辆的轨迹数据是基于无人机视角得到的,其中的行驶车辆所在位置和移动轨迹并非真实物理空间的真实位置和移动轨迹。故而需对行驶车辆的轨迹数据进行坐标转换,转换后的行驶车辆的轨迹数据即为行驶车辆的标准轨迹数据,以使得行驶车辆的轨迹数据可以与真实物理空间中的地图数据相匹配,从而获知行驶车辆在真实物理空间中的位置点和轨迹点,例如行驶车辆的地理坐标以及所在车道等。

152.例如,可以根据无人机的定位信息和目标道路区域中关键点坐标信息对行驶车辆的轨迹数据进行坐标转换,也就是将无人机的相对坐标系转换为大地坐标系,转换后的坐标矩阵数据为第二坐标矩阵数据,将第二坐标矩阵数据所表征的行驶车辆的轨迹数据确定为行驶车辆的标准轨迹数据。

153.其中,在无人机坐标系中行驶车辆的轨迹数据通过第一坐标矩阵数据表示。在无人机的相对坐标系中,无人机为原点,无人机的右方为横轴,上方为纵轴。第二坐标矩阵数据则是在大地坐标系中表征行驶车辆的轨迹数据,将第二坐标矩阵数据所表征的数据定义为行驶车辆的标准轨迹数据。大地坐标系中地面上的位置用大地经度、大地纬度和大地高表示。另外,无人机的定位信息用于表征无人机的所在位置。

154.可选地,目标道路区域中关键点坐标信息可以为无人机拍摄过程中所选用的参照物的坐标信息,本技术实施例对于所选用的参照物的具体内容不作限定,例如可以为行驶车辆几何中心、行驶车辆的左车灯、右车灯等等。

155.s205:根据行驶车辆的标准轨迹数据获得行驶车辆的行驶特征数据。

156.步骤s205的可能实现方式、原理及技术效果与步骤s103的可能实现方式、原理及技术效果相类似,详细内容可参考前述描述,在此不再赘述。

157.s206a:根据行驶车辆的行驶特征数据和多个分类驾驶场景对初始驾驶场景分类模型进行训练,得到中间驾驶场景分类模型。

158.其中,多个分类驾驶场景包括直行驾驶场景、转弯驾驶场景、变道驾驶场景、超车驾驶场景、跟车驾驶场景、避让驾驶场景以及第一危险驾驶场景。

159.初始驾驶场景分类模型已具有初步驾驶场景分类能力,利用初始驾驶场景分类模型对行驶车辆的行驶特征数据进行驾驶场景预测,得到的预测结果为多个分类驾驶场景,

可以包括但不限于直行驾驶场景、转弯驾驶场景、变道驾驶场景、超车驾驶场景、跟车驾驶场景、避让驾驶场景以及第一危险驾驶场景。进而将行驶特征数据和多个分类驾驶场景作为训练样本对初始驾驶场景分类模型进行训练,得到中间驾驶场景分类模型。

160.s206b:根据第二危险驾驶场景以及第二危险驾驶场景中事故车辆的行驶特征数据对中间驾驶场景分类模型进行训练,得到目标驾驶场景分类模型。

161.为了加强中间驾驶场景分类模型对危险驾驶场景的分类准确性,进一步利用危险驾驶数据对中间驾驶场景分类模型进行训练,危险驾驶数据包括第二危险驾驶场景和第二危险驾驶场景中发生危险事件的车辆即事故车辆的行驶特征数据。

162.可选地,第二危险驾驶场景是指发生危险事件的驾驶场景,例如撞车事件等,第二危险驾驶场景可以来自第三数据方,本技术实施例对于第二危险驾驶场景的来源不作限定。第二危险驾驶场景中事故车辆的行驶特征数据可以包括事故车辆的速度、加速度、转向角、车辆编号以及车辆尺寸等数据。需要说明的是,事故车辆的行驶特征数据也为结构化后的数据。

163.上述模型训练过程可以为任意能够实现模型训练的过程,具体可根据所选用的原始分类模型的自身特征设置相应训练过程,本技术实施例对于具体地训练过程不作限定。

164.在一种可能的设计中,第二危险驾驶场景以及事故车辆的行驶特征数据的获取方式如图6所示。图6为本技术实施例提供的又一种数据处理方法的流程示意图。如图6所示,本技术实施例包括:

165.s301:获取发生危险事件的驾驶场景对应的事故视频数据。

166.获取发生危险事件的驾驶场景对应的视频数据,该视频数据为事故视频数据,该事故视频数据可以来自于第三数据方。

167.s302:根据事故视频数据获取事故车辆的标准轨迹数据,并根据事故车辆的标准轨迹数据获得事故车辆的行驶特征数据。

168.事故视频数据可以来源于无人机采集,则可以采用如步骤s202a至步骤s204b所示步骤根据事故视频数据获取到事故车辆的标准轨迹数据,并对事故车辆的标准轨迹数据采用例如步骤s103所示步骤,根据事故车辆的标准轨迹数据获得事故车辆的行驶特征数据。

169.需要说明的是,在选用事故视频数据时,所选用的视频片段中可以包括发生危险事件前预设时长的视频片段,例如发生撞车前30秒的视频片段也为事故视频数据的一部分,有利于提高训练后模型进行驾驶场景分类的敏锐度,还有利于提高分类准确性。

170.s207:利用目标驾驶场景分类模型对目标车辆的驾驶数据进行分类,分类出的驾驶场景用于仿真平台进行自动驾驶模拟的仿真。

171.利用目标驾驶场景分类模型对目标车辆的驾驶数据进行分类,以分类出该目标车辆的驾驶场景。分类出的驾驶场景可以用于自动驾驶的仿真平台进行自动驾驶模拟的仿真,以为自动驾驶仿真提供数据支持。

172.其中,目标车辆为待进行驾驶场景分类的车辆,驾驶数据则为表示目标车辆驾驶行为的视频数据。仿真平台中运行有自动驾驶仿真软件,用于进行驾驶原以及驾驶模拟等仿真测试。

173.本技术实施例提供的数据处理方法,通过无人机采集可用视频数据,并基于无人机采集到的可用视频数据得到行驶车辆的标准轨迹数据进而得到行驶特征数据,根据行驶

特征数据对初始驾驶场景分类模型进行训练,得到目标驾驶场景分类模型,并利用目标驾驶场景分类模型对目标车辆的驾驶数据进行分类,分类结果用于自动化驾驶模拟的仿真,克服了现有技术中数据采集以及驾驶场景分类存在的不足,提升了分类准确性、智能化以及分类效率,对自动化驾驶技术提供了有力支持。

174.在得到目标驾驶场景分类模型之后,还可以利用目标驾驶场景分类模型确定其所分类出的危险驾驶场景中的碰撞参数以及对碰撞参数的优化,使得所确定的碰撞参数相比于现有技术中通过经验值得到的碰撞参数具有更好的准确性和可控性。

175.在一种可能的设计中,得到目标驾驶场景分类模型之后,还可以包括如图7所示步骤。图7为本技术实施例提供的又一种数据处理方法的流程示意图。如图7所示,本技术实施例包括:

176.s401:根据模型解释工具对目标驾驶场景分类模型进行分析,得到碰撞特征数据集。

177.其中,碰撞特征数据集包括多个两车之间距离临界值构成的数据集、多个车辆车速临界值构成的数据集以及多个两车相对车速临界值构成的数据集。

178.例如,在目标驾驶场景分类模型每一次进行驾驶场景分类时,采用模型解释工具shap对目标驾驶场景分类模型进行分析,每一次都可以得到shap值,每一次得到的shap值可以包括两车之间距离临界值、车辆车速临界值以及两车相对车速临界值。在目标驾驶场景分类模型多次的运行过程中,即可得到多个两车之间距离临界值、多个车辆车速临界值以及多个两车相对车速临界值。将多个两车之间距离临界值构成的数据集、多个车辆车速临界值构成的数据集以及多个两车相对车速临界值构成的数据集统称为碰撞特征数据集。

179.s402:将与目标驾驶场景分类模型分类出的危险驾驶场景正相关的碰撞特征数据集确定为正激励样本。

180.s403:将与目标驾驶场景分类模型分类出的危险驾驶场景负相关的碰撞特征数据集确定为负激励样本。

181.s404:对正激励样本和负激励样本进行可视化展示,以获得目标数据范围,并利用目标数据范围内的碰撞特征数据集获得碰撞参数。

182.其中,碰撞参数包括跟车时距和避撞时间。

183.得到碰撞特征数据集合后,依据目标驾驶场景分类模型分类出的危险驾驶场景对碰撞特征数据集合中的两车之间距离临界值、车辆车速临界值以及两车相对车速临界值进行筛选。例如,分别获取正激励样本和负激励样本,并对其进行可视化展示,以便于筛选出满足要求的两车之间距离临界值、车辆车速临界值以及两车相对车速临界值所在范围即目标数据范围,进而利用所选用的范围内的两车之间距离临界值、车辆车速临界值以及两车相对车速临界值计算得到碰撞参数,碰撞参数包括跟车时距(time headway,thw)和避撞时间(time to collision,ttc)。

184.本技术实施例提供的数据处理方法利用模型训练得到目标驾驶场景分类模型,进而基于目标驾驶场景分类模型以及用于计算碰撞参数所用数据的数据分布确定碰撞参数,不同于现有技术中根据经验值设置碰撞参数,提高了对于危险驾驶场景分类的的准确性和可控性。

185.可选地,在获得碰撞参数之后,还可以进一步对其进行优化。例如首先根据重新获

取的行驶车辆的行驶特征数据对目标驾驶场景分类模型进行优化,然后根据优化后的目标驾驶场景分类模型对碰撞参数进优化,进一步提高准确性和可控性。

186.图8为本技术实施例提供的一种数据处理装置的结构示意图。如图8所示,本技术实施例提供的数据处理装置400,包括:

187.获取模块401,用于通过无人机采集可用视频数据,可用视频数据中包含有行驶车辆的图像;

188.处理模块402,用于根据可用视频数据得到行驶车辆的标准轨迹数据,并根据行驶车辆的标准轨迹数据获得行驶车辆的行驶特征数据;

189.训练模块403,用于根据行驶车辆的行驶特征数据对初始驾驶场景分类模型进行训练,得到目标驾驶场景分类模型。

190.在图8基础上,图9为本技术实施例提供的另一种数据处理装置的结构示意图。如图9所示,本技术实施例提供的数据处理装置400,还包括:分类模块404。该分类模块404,用于:

191.利用目标驾驶场景分类模型对目标车辆的驾驶数据进行分类,分类出的驾驶场景用于仿真平台进行自动驾驶模拟的仿真。

192.在一种可能的设计中,获取模块401,具体用于:

193.利用无人机获取目标道路区域预设高度范围内的原始视频数据;

194.对原始视频数据进行视频内容筛选,以将包含有行驶车辆的图像的原始视频数据确定为可用视频数据。

195.在一种可能的设计中,处理模块402,包括:

196.第一处理子模块,用于对可用视频数据进行图像抖动修复处理,得到标准图像数据;

197.第二处理子模块,用于对标准图像数据进行车辆提取及轨迹跟踪处理,得到行驶车辆的轨迹数据;

198.第三处理子模块,用于对行驶车辆的轨迹数据进行坐标转换,得到行驶车辆的标准轨迹数据,坐标转换用于无人机的相对坐标系与大地坐标系之间的数据转化。

199.在一种可能的设计中,第一处理子模块,具体用于:

200.根据无人机的定位信息对可用视频数据进行无人机的标准定位点转换,标准定位点转换用于将采集可用视频数据时的参照采集点转换为标准采集点,以对可用视频数据实现图像抖动修复处理;

201.将转换为标准采集点后的可用视频数据确定为标准图像数据。

202.在一种可能的设计中,第三处理子模块,具体用于:

203.根据无人机的坐标信息和目标道路区域中关键点坐标信息对第一坐标矩阵数据进行坐标转换,得到大地坐标系中的第二坐标矩阵数据,第一坐标矩阵数据用于在无人机的相对坐标系中表征行驶车辆的轨迹数据;

204.将第二坐标矩阵数据表征的行驶车辆的轨迹数据确定为行驶车辆的标准轨迹数据。

205.在一种可能的设计中,处理模块402,还包括:第四处理子模块。该第四处理子模块,用于:

206.根据行驶车辆的标准轨迹数据获取每个行驶车辆在当前轨迹点的特征数据,并对特征数据进行结构化,得到行驶车辆的行驶特征数据;

207.其中,行驶车辆的行驶特征数据包括每个行驶车辆的速度、加速度、转向角、车辆编号以及车辆尺寸。

208.在一种可能的设计中,训练模块403,包括:

209.第一训练子模块,用于根据行驶车辆的行驶特征数据和多个分类驾驶场景对初始驾驶场景分类模型进行训练,得到中间驾驶场景分类模型,多个分类驾驶场景包括直行驾驶场景、转弯驾驶场景、变道驾驶场景、超车驾驶场景、跟车驾驶场景以及、避让驾驶场景以及第一危险驾驶场景;

210.第二训练子模块,用于根据第二危险驾驶场景以及第二危险驾驶场景中事故车辆的行驶特征数据对中间驾驶场景分类模型进行训练得到目标驾驶场景分类模型。

211.在一种可能的设计中,处理模块402,还用于:

212.根据模型解释工具对目标驾驶场景分类模型进行分析,得到碰撞特征数据集,碰撞特征数据集包括多个两车之间距离临界值构成的数据集、多个车辆车速临界值构成的数据集以及多个两车相对车速临界值构成的数据集;

213.将与目标驾驶场景分类模型分类出的危险驾驶场景负相关的碰撞特征数据集确定为正激励样本;

214.将与目标驾驶场景分类模型分类出的危险驾驶场景负相关的碰撞特征数据集确定为负激励样本;

215.对正激励样本和负激励样本进行可视化展示,以获得目标数据范围,并利用目标数据范围内的碰撞特征数据集获得碰撞参数。

216.在一种可能的设计中,数据处理装置400,还包括:优化模块。该优化模块,用于:

217.根据重新获取的行驶车辆的行驶特征数据对目标驾驶场景分类模型进行优化;

218.根据优化后的目标驾驶场景分类模型对碰撞参数进行优化。

219.本技术实施例提供的数据处理装置,可以执行上述方法实施例中的数据处理方法的相应步骤,其实现原理和技术效果类似,在此不再赘述。

220.图10为本技术实施例提供的一种电子设备的结构示意图。如图10所示,该电子设备500可以包括:处理器501,以及与处理器501通信连接的存储器502。

221.存储器502,用于存放程序。具体地,程序可以包括程序代码,程序代码包括计算机执行指令。

222.存储器502可能包含高速ram存储器,也可能还包括非易失性存储器(mom-volatile memory),例如至少一个磁盘存储器。

223.处理器501用于执行存储器502存储的计算机执行指令,以实现数据处理方法。

224.其中,处理器501可能是一个中央处理器(cemtral processimg umit,简称为cpu),或者是特定集成电路(applicatiom specific imtegrated circuit,简称为asic),或者是被配置成实施本技术实施例的一个或多个集成电路。

225.可选地,存储器502既可以是独立的,也可以跟处理器501集成在一起。当存储器502是独立于处理器501之外的器件时,电子设备500,还可以包括:

226.总线503,用于连接处理器501以及存储器502。总线可以是工业标准体系结构

(industry standard architecture,简称为isa)总线、外部设备互连(peripheral component,pci)总线或扩展工业标准体系结构(extended industry standard architecture,eisa)总线等。总线可以分为地址总线、数据总线、控制总线等,但并不表示仅有一根总线或一种类型的总线。

227.可选的,在具体实现上,如果存储器502和处理器501集成在一块芯片上实现,则存储器502和处理器501可以通过内部接口完成通信。

228.本技术还提供了一种计算机可读存储介质,该计算机可读存储介质可以包括:u盘、移动硬盘、只读存储器(rom,read-omly memory)、随机存取存储器(ram,ramdom accessmemory)、磁盘或者光盘等各种可以存储程序代码的介质,具体的,该计算机可读存储介质中存储有计算机执行指令,计算机执行指令用于上述实施例中的数据处理方法。

229.本技术还提供了一种计算机程序产品,包括计算机执行指令,该计算机指令被处理器执行时实现上述实施例中的数据处理方法。

230.本领域技术人员在考虑说明书及实践这里公开的发明后,将容易想到本技术的其它实施方案。本技术旨在涵盖本技术的任何变型、用途或者适应性变化,这些变型、用途或者适应性变化遵循本技术的一般性原理并包括本技术未公开的本技术领域中的公知常识或惯用技术手段。说明书和实施例仅被视为示例性的,本技术的真正范围和精神由权利要求书指出。

231.应当理解的是,本技术并不局限于上面已经描述并在附图中示出的精确结构,并且可以在不脱离其范围进行各种修改和改变。本技术的范围仅由所附的权利要求书来限制。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1