一种基于transformer的跨尺度目标检测方法及系统与流程

1.本发明涉及计算机技术领域,具体涉及一种基于transformer的跨尺度目标检测方法及系统。

背景技术:

2.跑道侵入是引起跑道安全事故的主要因素,对跑道侵入事件进行有效监控是保障民航安全、提升航班运行效率的重要手段。目前,使用最广泛的场面目标监视设备如场监雷达、广播式自动相关监视(ads-b)和多点定位(mlat),应用于跑道安全监控方面存在稳定性不足、依赖性较强、更新率较低、存在监视盲区等问题。基于视觉的目标检测技术作为现有监视设备的重要补充,可有效解决上述问题。

3.现有基于图像的目标检测方法大致可分为两大类,一类是以r-cnn[1]为代表的两阶段目标检测方法,另一类是以yolo[2]为代表的单阶段目标检测方法。两阶段目标检测方法预先提取一系列较可能是目标的候选区域,再利用卷积神经网络提取特征替代传统手工设计特征;单阶段目标检测方法使用端到端架构,省去了区域选择过程,仅进行卷积神经网络计算,便可回归到图像目标类别和位置信息。

[0004]

基于视觉的防跑道侵入系统首先使用监控摄像头捕获跑道、联络道区域的实时视频流信息,再利用基于图像的目标检测方法自动检测监控区域中的航空器、车辆、人员等目标。然而,由于航空器、车辆和人员之间存在巨大的物理尺寸差异,因此相同图像上不同目标之间的尺度差异非常大;此外,由于机场飞行区协调施工难度大,监控摄像头点位选择非常受限,因此不同监控摄像机拍摄的图像之间,不同目标尺度也存在显著差异。

[0005]

现有方法通常使用卷积神经网络(cnn)来解决目标检测问题,使用mosaic、图像翻转等方法增强训练数据,从而提升模型性能。然而,cnn感受野通常从很小,且依赖于归纳偏差,很难捕获图像全局特征。因此,现有方法很难处理真实防跑道侵入中跨尺度目标检测问题。

技术实现要素:

[0006]

为解决现有技术方案的不足,本发明旨在设计一种基于transformer的跨尺度目标检测方法及系统,用于解决真实防跑道侵入中的跨尺度目标检测问题,总体提高目标检测精度,进一步降低模型的误检率和漏检率,提升基于视频的防跑道侵入系统的可用性和稳定性。

[0007]

本技术提供了一种基于transformer的跨尺度目标检测方法,所述方法包括:

[0008]

生成训练数据集;

[0009]

将所述训练数据集中的视频图像数据作为训练样本,设计目标函数,训练预先建立的目标检测模型;

[0010]

基于transformer的跨尺度目标检测算法,利用训练好的目标检测模型对待检测的图像进行检测,输出目标检测结果,以确定目标位置和类别信息。

[0011]

优选的,所述生成训练数据集包括:基于预先采集的视频图像数据构建应用场景监控视频集,通过整理现有公开数据以及下载爬虫数据的方式分别建立公开目标检测数据集和网络爬虫数据集;并对各数据集中的视频图像数据进行数据标注,构成训练数据集。

[0012]

进一步地,所述基于预先采集的视频图像数据构建应用场景监控视频集,通过整理现有公开数据以及下载爬虫数据的方式分别建立公开目标检测数据集和网络爬虫数据集包括:

[0013]

接收防跑道侵入现场摄像头拍摄的关键道口实时视频数据;利用rtsp协议拉取视频流,再使用opencv的videocapture包解析拉取的视频流信息,利用videowriter将解析得到的视频帧写入.mp4视频流文件,获得应用场景监控视频集;

[0014]

将跑道区域常见目标类型从现有公开数据中筛选出来,形成面向跑道侵入应用的公开目标检测数据集;

[0015]

其中,所述常见目标包括:航空器、车辆、人员;

[0016]

根据实际需求从图像检索网站搜索关键词并使用python爬虫技术下载的相关图像,将通过网络爬虫搜集到的所述相关图像通过人工筛选方式进行二次过滤,获得网络爬虫数据集。

[0017]

优选的,所述对各数据集中的视频图像数据进行数据标注包括:使用darklabel标注软件,标记应用场景监控视频集和网络爬虫数据集中的目标所在位置,使用标记框中心点x坐标、标记框中心点y坐标、标记框宽和高所组成的四维向量表示。

[0018]

优选的,所述预先建立的跨尺度目标检测模型包括依次连接的主干网络、颈部网络和头部网络;

[0019]

所述主干网络,用于提取高层图像特征;

[0020]

所述颈部网络分布于主干网络中的每一层,用于从不同尺度、不同处理阶段对主干网络提取的特征进行融合和再处理,对每个尺度分别输出处理后的特征;

[0021]

所述头部网络与颈部网络输出的不同尺度特征一一对应,用于根据颈部网络提取到的特征,确定目标检测结果。

[0022]

优选的,所述设计目标函数具体包括:分别以检测框损失、置信度损失和目标类别损失最小为目标设计目标函数;其中,

[0023]

所述检测框损失通过计算检测框与真值之间的距离获得;

[0024]

所述置信度损失通过计算检测目标的可信度获得;

[0025]

所述目标类别损失是基于交叉熵损失函数评估估计类别和真值之间的距离获得。

[0026]

优选的,所述确定目标检测结果之后还包括:筛选头部网络输出的目标检测结果,以实现检测框的非极大值抑制;

[0027]

所述筛选头部网络输出的目标检测结果具体包括:遍历所有检测框,若任意两个检测框之间存在交叠,则计算两个检测框之间的交并比;当交并比大于阈值t,则认为这两个检测框属于同一目标,保留置信度较大的检测框;通过循环对所有检测框的非极大值抑制,并输出最终检测结果。

[0028]

一种基于transformer的跨尺度目标检测系统,包括关键道口监控摄像头、视觉处理服务器、防跑道侵入显示设备、关键道口视频流数据处理模块、transformer推理系统和防跑道侵入融合显示系统;

[0029]

其中,所述关键道口监控摄像头,用于采集、编码并推送关键道口实时视频数据;

[0030]

视觉处理服务器,用于运行核心视觉处理算法,对关键道口视频流数据中的目标实现定位和识别;其中,所述核心视觉处理算法为transformer推理方法;

[0031]

防跑道侵入显示设备,用于显示关键道口实时视频数据,同时显示跑道侵入事件的目标位置和类别信息。

[0032]

优选的,所述关键道口监控摄像头包括设置于摄像头外层的防护罩和相机加热装置;

[0033]

所述视觉处理服务器包括:联网模块、高性能计算模块;

[0034]

所述联网模块,用于前端摄像头和管制终端之间的数据传输;

[0035]

所述高性能计算模块,用于对输入视频数据进行推理计算;

[0036]

所述防跑道侵入显示设备包括:大屏显示模块和交互显示模块;

[0037]

所述大屏显示模块,用于显示机场内所有被监控道口实时视频及叠加信号;

[0038]

所述交互显示模块,用于为管制员显示管制交互界面;

[0039]

所述关键道口视频流数据处理模块包括:拉流单元和解码单元;

[0040]

所述拉流单元,用于使用rtsp协议拉取摄像头采集到的视频流数据;

[0041]

所述解码单元,用于采用ffmpeg内置解码算法,将拉取到的视频流解码成视频帧;

[0042]

所述transformer推理系统包括:视频帧预处理单元、transformer检测推理单元和结果预测单元;

[0043]

所述视频帧预处理单元,用于将解码单元,提取的单帧视频数据进行预处理,使用双线性插值方法将原始视频帧归一化到指定分辨率;

[0044]

所述transformer检测推理单元,用于将预处理结果输入transformer跨尺度目标检测模型,输出目标检测结果,包括:检测框、置信度和目标类别信息;

[0045]

所述结果预测单元,用于筛选目标检测结果;如果两个筛选结果之间存在交叠,则计算二者之间的交并比,当交并比大于某预先设定阈值t,则认为这两个检测框属于同一个目标,因此将置信度较小的检测框删掉;通过不断循环最终实现对交叠框的非极大值抑制,并输出最终检测结果;

[0046]

所述防跑道侵入融合显示系统包括:防跑道侵入预警告警模块和多源数据融合显示模块;

[0047]

所述防跑道侵入预警告警模块,用于结合跨尺度目标检测方法输出的目标位置和类别信息,估计目标在监控道口区域的位置;

[0048]

其中,所述类别信息包括航空器、车辆和人员;

[0049]

所述目标位置信息包括联络道、跑道、天空、机坪;

[0050]

所述多源数据融合显示模块,用于结合视频定位数据和机场场面多源监视数据,综合显示跑道区域目标活动情况;

[0051]

其包括:视频定位数据显示单元和场面多源监视数据显示单元;

[0052]

所述视频定位数据显示单元,用于显示道口目标活动情况,以及是否进入/脱离跑道;

[0053]

所述场面多源监视数据显示单元,用于综合显示跑道区域目标整体态势,根据机场实际场面监视源安装使用情况,接入多种监视源数据;当视频信号判断当前跑道上包括

多个目标时,利用监视数据提供的目标经纬度信息辅助视频信号实现侵入告警,并通过屏幕闪烁/提示音多种信源输出告警信息;

[0054]

其中,所述监视源数据包括场监雷达、ads-b、mlat。

[0055]

本发明的有益效果体现在:

[0056]

本发明提供的一种基于transformer的跨尺度目标检测方法及系统,首先生成训练数据集,将训练数据集中的视频图像数据作为训练样本;其次,设计目标函数,训练预先建立的目标检测模型;最后基于transformer的跨尺度目标检测算法,利用训练好的目标检测模型对待检测的图像进行检测,输出目标检测结果,以确定目标位置和类别信息。从而有效解决了真实防跑道侵入中的跨尺度目标检测问题,实现了提高目标检测精度的总体目标,进一步降低模型的误检率和漏检率,提升基于视频的防跑道侵入系统的可用性和稳定性。

[0057]

本发明提出的基于transformer的跨尺度目标检测方法及系统,可以实现跑道区域目标的自动检测,并对侵入目标进行预警/告警,极大地提升了机场跑道安全防护能力,进一步提高了智慧空管建设水平。

附图说明

[0058]

为了更清楚地说明本发明具体实施方式或现有技术中的技术方案,下面将对具体实施方式或现有技术描述中所需要使用的附图作简单地介绍。在所有附图中,类似的元件或部分一般由类似的附图标记标识。附图中,各元件或部分并不一定按照实际的比例绘制。

[0059]

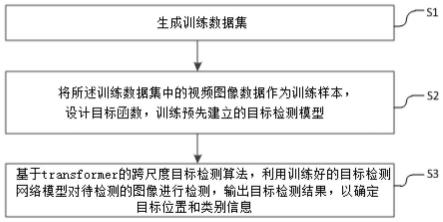

图1为本发明提供的基于transformer的跨尺度目标检测方法流程图;

[0060]

图2为本发明实施例1提供的基于transformer的跨尺度目标检测方法功能结构框图;

[0061]

图3为本发明实施例1提供的数据收集功能结构框图;

[0062]

图4为本发明实施例1提供的基于transformer的跨尺度目标检测算法功能结构框图;

[0063]

图5为本发明提供的基于transformer的跨尺度目标检测系统功能结构框图;

[0064]

图6为本发明实施例2提供的关键道口监控摄像头功能结构框图;

[0065]

图7为本发明实施例2提供的视觉处理服务器功能结构框图;

[0066]

图8为本发明实施例2提供的防跑道侵入显示设备功能结构框图;

[0067]

图9为本发明实施例2提供的关键道口视频流数据功能结构框图;

[0068]

图10为本发明实施例2提供的基于transformer的跨尺度目标检测方法功能结构框图;

[0069]

图11为本发明实施例2提供的防跑道侵入融合显示系统功能结构框图。

[0070]

其中,数据准备100、基于transformer的跨尺度目标检测算法200、应用场景监控视频集101、公开目标检测数据集102、网络爬虫数据集103、数据标注104、数据增广105、主干网络201、颈部网络202、头部网络203、非极大值抑制204、损失函数设计205、关键道口监控摄像头s100、视觉处理服务器s200、防跑道侵入显示设备s300、关键道口视频流数据处理模块s400、transformer推理系统s500、防跑道侵入融合显示系统s600、摄像头防护设计s101、联网功能s201、高性能计算功能s202、摄像头安装设计s102、大屏显示s301、交互显示

s302、拉流单元s401、解码单元s402、视频帧预处理s501、transformer检测推理s502、结果预测s503、防跑道侵入预警/告警模块s601、多源数据融合显示模块s602。

具体实施方式

[0071]

下面将结合附图对本发明技术方案的实施例进行详细的描述。以下实施例仅用于更加清楚地说明本发明的技术方案,因此只作为示例,而不能以此来限制本发明的保护范围。

[0072]

需要注意的是,除非另有说明,本技术使用的技术术语或者科学术语应当为本发明所属领域技术人员所理解的通常意义。

[0073]

一、本发明具体实施方式中提供一种基于transformer的跨尺度目标检测方法,如图1所示,所述方法包括:

[0074]

s1生成训练数据集;

[0075]

s2将所述训练数据集中的视频图像数据作为训练样本,设计目标函数,训练预先建立的目标检测模型;

[0076]

s3基于transformer的跨尺度目标检测算法,利用训练好的目标检测模型对待检测的图像进行检测,输出目标检测结果,以确定目标位置和类别信息。

[0077]

步骤s1中,所述生成训练数据集包括:基于预先采集的视频图像数据构建应用场景监控视频集,通过整理现有公开数据以及下载爬虫数据的方式分别建立公开目标检测数据集和网络爬虫数据集;并对各数据集中的视频图像数据进行数据标注,构成训练数据集。

[0078]

基于预先采集的视频图像数据构建应用场景监控视频集,通过整理现有公开数据以及下载爬虫数据的方式分别建立公开目标检测数据集和网络爬虫数据集包括:

[0079]

接收防跑道侵入现场摄像头拍摄的关键道口实时视频数据;利用rtsp协议拉取视频流,再使用opencv的videocapture包解析拉取的视频流信息,利用videowriter将解析得到的视频帧写入.mp4视频流文件,获得应用场景监控视频集;

[0080]

将跑道区域常见目标类型从现有公开数据中筛选出来,形成面向跑道侵入应用的公开目标检测数据集;其中,所述常见目标包括:航空器、车辆、人员;

[0081]

根据实际需求从图像检索网站搜索关键词并使用python爬虫技术下载的相关图像,将通过网络爬虫搜集到的所述相关图像通过人工筛选方式进行二次过滤,获得网络爬虫数据集。

[0082]

对各数据集中的视频图像数据进行数据标注包括:使用darklabel标注软件,标记应用场景监控视频集和网络爬虫数据集中的目标所在位置,使用标记框中心点x坐标、标记框中心点y坐标、标记框宽和高所组成的四维向量表示。

[0083]

步骤s2中,所述预先建立的跨尺度目标检测模型包括依次连接的主干网络、颈部网络和头部网络;

[0084]

所述主干网络,用于提取高层图像特征;

[0085]

所述颈部网络分布于主干网络中的每一层,用于从不同尺度、不同处理阶段对主干网络提取的特征进行融合和再处理,对每个尺度分别输出处理后的特征;

[0086]

所述头部网络与颈部网络输出的不同尺度特征一一对应,用于根据颈部网络提取到的特征,确定目标检测结果。目标检测结果即包括预估的检测框、置信度和目标类别。

[0087]

步骤s2中,设计目标函数具体是指:分别以检测框损失、置信度损失和目标类别损失最小为目标设计目标函数;其中,所述检测框损失通过计算检测框与真值之间的距离获得;所述置信度损失通过计算检测目标的可信度获得;所述目标类别损失是基于交叉熵损失函数评估估计类别和真值之间的距离获得。

[0088]

在执行步骤s3中的确定目标检测结果之后还包括:筛选头部网络输出的目标检测结果,以实现检测框的非极大值抑制;

[0089]

所述筛选头部网络输出的目标检测结果具体包括:遍历所有检测框,若任意两个检测框之间存在交叠,则计算两个检测框之间的交并比;当交并比大于阈值t,则认为这两个检测框属于同一目标,保留置信度较大的检测框;通过循环对所有检测框的非极大值抑制,并输出最终检测结果。

[0090]

步骤s3中,在输出输出最终检测结果后,基于输出的最终检测结果即可确定目标位置和类别信息。

[0091]

实施例1:

[0092]

本发明实施例1提出一种基于transformer的跨尺度目标检测方法,如图2所示。具体包括:

[0093]

数据准备100、基于transformer的跨尺度目标检测算法200。

[0094]

所述数据准备100,用于收集、标注并增广用于训练目标检测模型的图像数据,获取高多样性、多尺度变化的训练数据集。

[0095]

所述基于transformer的跨尺度目标检测算法200,用于设计有效解决跨尺度目标检测问题的基于transformer的网络结构,输出目标检测框和类别等信息。

[0096]

其中,数据准备100的功能结构框图,如图3所示。具体包括:应用场景监控视频集101、公开目标检测数据集102、网络爬虫数据集103、数据标注104。

[0097]

所述应用场景监控视频集101,收集防跑道侵入现场摄像头拍摄的视频。首先利用rtsp协议拉取视频流,再使用opencv的videocapture包解析拉取的视频流信息,利用videowriter将解析出来的视频帧写入.mp4视频流文件。

[0098]

所述公开目标检测数据集102,收集包括coco、voc在内的公开目标检测数据集,将跑道区域常见目标类型(航空器、车辆、人员等)从数据集中筛选出来,形成面向跑道侵入应用的公开目标检测数据集。

[0099]

所述网络爬虫数据集103,使用python爬虫技术从百度图像、搜狗图像等图像检索网站搜集关键词包含飞机、航空器、汽车、皮卡、面包车、卡车、小轿车、行人等在内的相关图像。通过网络爬虫搜集到的图像将再一次通过人工筛选进行过滤。

[0100]

所述数据标注104,使用darklabel标注软件将上述应用场景监控视频集101和网络爬虫数据集103中的目标所在位置标记出来,使用标记框中心点x坐标、标记框中心点y坐标、标记框宽和高所组成的四维向量表示。公开目标检测数据集102已包含标注信息,可以直接使用。

[0101]

所述数据增广105,使用数据增广方法增加数据多样性,包括:(1)图像左右翻转/旋转,增强图像上目标的视角特性;(2)图像放缩,增加数据集中目标尺度的多样性;(3)mosaic,对数据集中的样本进行随机组合变换后生成新的拼图样本,用于增加小目标样本的多样性。

[0102]

其中,基于transformer的跨尺度目标检测算法200的功能结构框图,如图4所示。具体包括:主干网络backbone 201、颈部网络neck 202、头部网络head 203。

[0103]

所述主干网络backbone 201,用于提取高层图像特征。由于常用主干网络在图像分类、目标检测等任务中表现出很强的特征提取能力,如vgg、resnet、densenet、mobilenet、efficientnet、cspdarknet等,因此,在实施过程中,通常使用上述包括但不局限于上述网络中的一种。本发明使用resnet50作为主干网络,但使用其他主干网络仍受到本发明的保护。对主干网络中的每一层,

[0104]

所述颈部网络neck 202,用于从不同尺度、不同处理阶段对主干网络提取的特征进行融合和再处理。常用的颈部聚合网络有fpn、panet、nas-fpn、bifpn、asff、sam等。本发明使用panet作为颈部网络,分别将主干网络resnet50输出的不同尺度的特征融合到panet对应尺度的模块中,并对每个尺度分别输出处理后的特征。注意,使用其他颈部聚合网络仍然受被发明的保护。

[0105]

所述头部网络head 203,根据前述网络提取到的特征,确定目标位置和类别。由于防跑道侵入场景中目标尺度差异非常大,因此上述输出的不同尺度特征分别对应一个头部网络,用于提取不同尺度的目标。当使用底层、高分辨率的特征图时,网络对微小目标更为敏感;当使用高层、低分辨率的特征图时,网络对大型目标更为敏感。本发明头部网络使用transformer架构,每个transformer编码模块由一个多头注意模块(multi-attention-head)和一个多层感知机(mlp)构成。

[0106]

所述非极大值抑制204,用于筛选上述头部网络输出的目标检测结果。通过遍历所有候选框,若任意两个候选框之间存在交叠,则计算两个候选框之间的交并比(iou)。假设置信度高的候选框具有更高的准确性。因此,当交并比大于阈值t,认为这两个候选框属于同一目标,则保留置信度较大的检测框。通过不断循环最终可实现对所有候选框的非极大值抑制,并输出最终检测结果。

[0107]

所述损失函数设计205,即具体实施方式步骤s2中的目标函数,用于模型训练中参数更新:(1)检测框损失,用于评估估计的检测框和真值之间的距离;(2)置信度损失,用于评估检测目标的可信度;(3)目标类别损失,使用交叉熵损失函数,用于评估估计类别和真值之间的距离。

[0108]

此外,主干网络可以使用本发明中的resnet50,也可使用其他类型的主干网络替代,如vgg、resnet、densenet、mobilenet、efficientnet、cspdarknet、swin transformer等;

[0109]

颈部网络可以使用本发明中的panet,也可使用其他颈部网络替代,如fpn、nas-fpn、bifpn、asff、sam等。

[0110]

二、基于同一技术构思,本发明具体实施方式中还提供一种基于transformer的跨尺度目标检测系统,包括关键道口监控摄像头、视觉处理服务器、防跑道侵入显示设备、关键道口视频流数据处理模块、transformer推理系统和防跑道侵入融合显示系统;

[0111]

其中,所述关键道口监控摄像头,用于采集、编码并推送关键道口实时视频数据;

[0112]

视觉处理服务器,用于运行核心视觉处理算法,对关键道口视频流数据中的目标实现定位和识别;其中,所述核心视觉处理算法为transformer推理方法;

[0113]

防跑道侵入显示设备,用于显示关键道口实时视频数据,同时显示跑道侵入事件

的目标位置和类别信息。

[0114]

所述关键道口监控摄像头包括设置于摄像头外层的防护罩和相机加热装置;

[0115]

所述视觉处理服务器包括:联网模块、高性能计算模块;

[0116]

所述联网模块,用于前端摄像头和管制终端之间的数据传输;

[0117]

所述高性能计算模块,用于对输入视频数据进行推理计算;

[0118]

所述防跑道侵入显示设备包括:大屏显示模块和交互显示模块;

[0119]

所述大屏显示模块,用于显示机场内所有被监控道口实时视频及叠加信号;

[0120]

所述交互显示模块,用于为管制员显示管制交互界面;

[0121]

所述关键道口视频流数据处理模块包括:拉流单元和解码单元;

[0122]

所述拉流单元,用于使用rtsp协议拉取摄像头采集到的视频流数据;

[0123]

所述解码单元,用于采用ffmpeg内置解码算法,将拉取到的视频流解码成视频帧;

[0124]

所述transformer推理系统包括:视频帧预处理单元、transformer检测推理单元和结果预测单元;

[0125]

所述视频帧预处理单元,用于将解码单元,提取的单帧视频数据进行预处理,使用双线性插值方法将原始视频帧归一化到指定分辨率;

[0126]

所述transformer检测推理单元,用于将预处理结果输入transformer跨尺度目标检测模型,输出目标检测结果,包括:检测框、置信度和目标类别信息;

[0127]

所述结果预测单元,用于筛选目标检测结果;如果两个筛选结果之间存在交叠,则计算二者之间的交并比,当交并比大于某预先设定阈值t,则认为这两个检测框属于同一个目标,因此将置信度较小的检测框删掉;通过不断循环最终实现对交叠框的非极大值抑制,并输出最终检测结果;

[0128]

所述防跑道侵入融合显示系统包括:防跑道侵入预警告警模块和多源数据融合显示模块;

[0129]

所述防跑道侵入预警告警模块,用于结合跨尺度目标检测方法输出的目标位置和类别信息,估计目标在监控道口区域的位置;

[0130]

其中,所述类别信息包括航空器、车辆和人员;

[0131]

所述目标位置信息包括联络道、跑道、天空、机坪;

[0132]

所述多源数据融合显示模块,用于结合视频定位数据和机场场面多源监视数据,综合显示跑道区域目标活动情况;

[0133]

多源数据融合显示模块包括:视频定位数据显示单元和场面多源监视数据显示单元;

[0134]

所述视频定位数据显示单元,用于显示道口目标活动情况,以及是否进入/脱离跑道;

[0135]

所述场面多源监视数据显示单元,用于综合显示跑道区域目标整体态势,根据机场实际场面监视源安装使用情况,接入多种监视源数据;当视频信号判断当前跑道上包括多个目标时,利用监视数据提供的目标经纬度信息辅助视频信号实现侵入告警,并通过屏幕闪烁/提示音多种信源输出告警信息;

[0136]

其中,所述监视源数据包括场监雷达、ads-b、mlat。还可以包含气象数据、灯光状态数据、以及其他的机场场面数据。

[0137]

实施例2:本发明实施例2提供一种基于transformer的跨尺度目标检测系统,如图5所示。具体包括:

[0138]

关键道口监控摄像头s100、视觉处理服务器s200、防跑道侵入显示设备s300、关键道口视频流数据处理模块s400、transformer推理系统s500、防跑道侵入融合显示系统s600。

[0139]

其中,所述s100、s200、s300描述防跑道侵入硬件装置,所述s400、s500、s600描述防跑道侵入软件系统。

[0140]

所述关键道口监控摄像头s100,用于采集、编码并推送关键道口实时视频数据;

[0141]

所述视觉处理服务器s200,用于运行核心视觉处理算法,实现对视频中目标的定位和识别等任务;

[0142]

所述防跑道侵入显示设备s300,用于显示实时视频,以增强管制员情景意识,同时目标位置、类别等信息,以辅助管制员综合判断;

[0143]

所述关键道口视频流数据处理模块s400,即关键道口监控摄像头s100采集到的视频流数据,用作防跑道侵入系统的输入数据;

[0144]

所述transformer推理系统s500,即运行在视觉处理服务器s200上的核心算法,用于对关键道口视频流数据处理模块s400中的目标实现跨尺度、高精度、高效的定位和识别;

[0145]

所述防跑道侵入融合显示系统s600,即防跑道侵入显示设备s300上显示的人机交互系统,用于实现对跑道侵入事件的预警和告警等功能。

[0146]

本发明实施例2提出的一种基于transformer的跨尺度目标检测系统中,关键道口监控摄像头s100的功能结构框图,如图6所示。具体包括:摄像头防护设计s101、摄像头安装设计s102。

[0147]

所述摄像头防护设计s101,主要考虑室外监控摄像头对环境的适应性,在摄像头外层增加防护罩等防护装置。此外,针对粉尘、雨天等,设计远程控制雨刮,针对雪天、冰冻等天气,设计相机外部加热装置。

[0148]

所述摄像头安装设计s102,对于塔台、航站楼楼顶等点位,一般只需增加一个小型平台用于加固相机,对于飞行区内的点位,选择下滑台附近区域,但由于位置较低,一般还需增加具有一定高度的支架。选择上述点位的目的是尽量避免大规模供电、供网的施工工作。

[0149]

本发明提出一种基于transformer的跨尺度目标检测系统,其中,视觉处理服务器s200的功能结构框图,如图7所示。具体包括:联网功能s201、高性能计算功能s202。

[0150]

所述联网功能s201,用于前端摄像头和管制终端之间的数据传输。当管制终端位于机场塔台区域,可考虑使用机场5g网络、4g lte网络或机场内部专用网络等实现数据传输;当管制终端位于远程管制中心时,还需增加供应商专网,以实现视频流数据的远程传输。

[0151]

所述高性能计算功能s202,视觉处理服务器需具备高性能计算公能,用于对输入视频数据的高效推理计算,一般根据监控道口规模,考虑配备多张高性能显卡(gpu)。当一台服务器无法支撑计算,可考虑多服务器模式或服务器集群模式。

[0152]

其中,防跑道侵入显示设备s300功能结构框图,如图8所示。具体包括:大屏显示s301、交互显示s302。

[0153]

所述大屏显示s301,使用曲面监控大屏,用于显示机场内所有被监控道口实时视频及叠加信号,考虑使用电视墙的方式显示。

[0154]

所述交互显示s302,使用电脑显示屏,用于为管制员显示管制交互界面。

[0155]

本发明提出一种基于transformer的跨尺度目标检测系统,其中,关键道口视频流数据s400功能结构框图,如图9所示。具体包括:拉流单元s401、解码单元s402。

[0156]

所述拉流单元s401,使用rtsp协议拉取摄像头采集到的视频流数据,采用的拉流连接形式一般为rtsp://username:password@cameraip,其中,username和password分别表示访问对应监控摄像头所设置的用户名和密码,cameraip表示摄像头ip地址。

[0157]

所述解码单元s402,将拉取到的视频流解码成视频帧,通常采用ffmpeg内置解码算法对视频流进行解码。

[0158]

其中,transformer推理方法s500的功能结构框图,如图10所示。具体包括:视频帧预处理s501、transformer检测推理s502、结果预测s503。

[0159]

所述视频帧预处理s501,用于将解码单元s402提取的单帧视频数据进行预处理,使用双线性插值方法将原始视频帧归一化到指定分辨率,如480*640。

[0160]

所述transformer检测推理s502,用于将上述预处理结果输入transformer推理网络,网络结构详见“基于transformer的跨尺度目标检测方法”,输出可能的目标检测框、置信度和目标类别信息。

[0161]

所述结果预测s503,用于进一步筛选上述目标检测结果。如果两个筛选结果之间存在交叠,则计算二者之间的交并比,当交并比大于某预先设定阈值t,则认为这两个检测框属于同一个目标,因此将置信度较小的检测框删掉。通过不断循环最终可实现对交叠框的非极大值抑制,并输出最终检测结果。

[0162]

本发明提出一种基于transformer的跨尺度目标检测系统,其中,防跑道侵入融合显示系统s600的功能结构框图,如图11所示。具体包括:

[0163]

防跑道侵入预警/告警模块s601、多源数据融合显示模块s602。

[0164]

所述防跑道侵入预警/告警模块s601,结合前述跨尺度目标检测方法s500输出的目标位置和类别信息,估计目标在监控道口区域的位置。其中,类别信息主要包括航空器、车辆、人员和其他(如动物),目标位置信息包括联络道、跑道、天空、机坪等。通常使用目标所在检测框中心表示目标位置,但是,由于视角差异,检测框中心点可能存在视角偏差。为解决上述问题,本发明利用检测框底边中心点坐标区分目标所在位置,因为对于地面目标来说,底边中心点通常可近似于目标与地面的连接点,从而减少由于高度导致的视角偏差,实现高精度目标位置估计。

[0165]

所述多源数据融合显示模块s602,同时使用视频定位数据和机场场面多源监视数据,用于综合显示跑道区域目标活动情况。其中,视频定位数据主要用于显示道口目标活动情况,以及是否进入/脱离跑道等;场面多源监视数据用于综合显示跑道区域目标整体态势,根据机场实际场面监视源安装使用情况,可以接入包含场监雷达、ads-b、mlat等在内的多种监视源数据。当视频信号判断当前跑道上包括多个目标时,可利用监视数据提供的目标经纬度信息辅助视频信号实现侵入告警等功能,告警信息可通过屏幕闪烁/提示音等多种信源输出。

[0166]

最后应说明的是:以上各实施例仅用以说明本发明的技术方案,而非对其限制;尽

管参照前述各实施例对本发明进行了详细的说明,本领域的普通技术人员应当理解:其依然可以对前述各实施例所记载的技术方案进行修改,或者对其中部分或者全部技术特征进行等同替换;而这些修改或者替换,并不使相应技术方案的本质脱离本发明各实施例技术方案的范围,其均应涵盖在本发明的权利要求和说明书的范围当中。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1