一种分体式飞行车辆鸟瞰图实时拼接及车位检测方法

1.本发明属于无人驾驶车辆领域,具体涉及一种分体式飞行车辆鸟瞰图实时拼接及车位检测方法。

背景技术:

2.鱼眼相机是指带有鱼眼镜头的相机,是一种焦距极短并且视角接近或等于180

°

的镜头。16mm或焦距更短的镜头。它是一种极端的广角镜头。也正是由于视角大,仅仅只需要用4个鱼眼相机就可完成环视鸟瞰图拼接。相机标定是通过一定方法求得成像模型中的各个未知量(5个内参、6个外参以及畸变参数)。相机标定主要有传统标定方法和自标定方法两类,传统标定方法需要标定参照物,参照物的参数已知,然后分析拍摄到的参照物图像,求得相机参数,如直接线性变换(dlt)方法、tsai两步标定法和张正友平面标定法等。传统方法操作相对复杂,但精度较高。鸟瞰图(bird’seyeview,bev)是从鸟的视角去俯视看到的视图,好处就在于视野宽广,对比清晰。从自动驾驶角度来看,我们更关心跟车辆在同一平面上的物体(尤其是车和人)以及物体与道路之间的关系,如果垂直俯视则可以在x、y两个维度上得到比例相同的物体轮廓,更利于展示和分析。卷积神经网络(convolutionalneuralnetworks,cnn)是一类包含卷积计算且具有深度结构的前馈神经网络(feedforwardneuralnetworks),是深度学习(deeplearning)的代表算法之一。卷积神经网络具有表征学习(representationlearning)能力,能够按其阶层结构对输入信息进行平移不变分类(shift-invariantclassification)。cnn用于目标检测时,图片送入神经网络后可输出预测框的位置、长宽、类别、置信度等信息。这里的车位检测输出的数据是车位角点位置坐标、形状、方向和置信度。方向梯度直方图(histogramoforientedgradient,hog)特征是一种在计算机视觉和图像处理中用来进行物体检测的特征描述子。hog特征通过计算和统计图像局部区域的梯度方向直方图来构成特征。其本质是梯度的统计信息,而梯度主要存在于边缘的地方。

3.专利cn201910549926.9提供了一种车载环视相机全景鸟瞰图生成方法,根据车辆建立标定场景;车辆上设有多个车载环视相机;根据相机在标定场景中设定相对应的棋盘格;棋盘格中设有多个角点;根据标定场景和相机内参得到每个相机图片至鸟瞰图的单应性转换矩阵;利用单应性转换矩阵将多个相机图片转换至鸟瞰图;对鸟瞰图中的重叠区域进行融合,并输出拼接后的环视鸟瞰图。

4.现有技术一的单应性变换矩阵有较多约束,比如需要预先设置标定场景,棋盘格的一边需要与占位框相贴合,需要棋盘格较多,每个相机要对应两个棋盘格,且每个相机对应的两个棋盘格的间距相等,而且棋盘格需要形成对称分布的形式。

5.现有技术一在拼接鸟瞰图时使用的是融合拼接的方法,这种方法虽然能够取得较好的融合效果但是会增大计算量,延长拼接时间,影响鸟瞰图拼接的实时性。

6.专利cn202011230752.9提供了一种车位检测方法,根据车辆外至少两个方位的图像,生成鸟瞰图像;以车位为整体目标对所述鸟瞰图像进行车位检测,确定检测出的车位的

定位信息。

7.现有技术二在进行车位检测是以车位为整体目标进行的,由于鸟瞰图的视野有限,如果需要整个车位才能进行检测,那么车辆与车位的距离较近不利于自动泊车,对检测距离有较大约束。

8.现有技术二在检测不同形状的车位时需要多个深度神经网络模型,每个模型对应一种车位类型,在进行自动泊车时需要选用相应的模型进行车位检测,模型复杂度大。

技术实现要素:

9.本发明所为了解决背景技术中存在的技术问题,目的在于提供了一种分体式飞行车辆鸟瞰图实时拼接及车位检测方法。

10.为了解决技术问题,本发明的技术方案是:

11.一种分体式飞行车辆鸟瞰图实时拼接及车位检测方法,所述方法包括:

12.对环视鱼眼相机图像数据,进行相机内、外参的标定,得到鱼眼相机的内参、畸变向量和单应性变换矩阵;

13.基于鱼眼相机的内参、畸变向量,对环视鱼眼相机图像数据进行去畸变处理,得到去畸变的图像数据;

14.对去畸变的图像数据,基于单应性变换矩阵,进行环视相机鸟瞰图拼接处理,得到以飞行车辆为中心的鸟瞰图;

15.把所述以飞行车辆为中心的鸟瞰图,送入预设的车位检测模型中的卷积神经网络中,得到车位入口线的两个角点坐标;预设的车位检测模型保留了mobilenetv3的主干部分,去掉后面的池化层和全连接层,改用一个卷积层将网络输出调整成我们想要的尺度和维度。

16.基于车位入口线的两个角点坐标,利用预设的约束条件和先验信息推理出车位末端的两个角点坐标;

17.用获取的车位入口线的两个角点坐标和车位末端的两个角点坐标,对以飞行车辆为中心的鸟瞰图进行车位截取,对截取后的车位图像进行hog特征提取,并判断车位是否空余,用不同颜色表示空余车位和已用车位,即实现了飞行车辆的鸟瞰图拼接和车位检测。

18.进一步,通过鱼眼相机采集环视鱼眼相机图像数据。

19.进一步,获取环视鱼眼相机图像数据,对环视鱼眼相机图像数据进行相机内参标定,获取鱼眼相机内参k和畸变向量d,即可完成图像的去畸变处理,具体包括:

20.对环视鱼眼相机图像数据寻找棋盘格角点,得到棋盘格角点坐标;

21.对所述棋盘格角点坐标进行亚像素优化,得到优化后的棋盘格角点坐标;

22.基于优化后的棋盘格角点坐标,利用张正友标定法估计计算相机内参,得到标定结果,并根据新的图像数据不断优化标定结果;

23.θd=θ(1+k1θ2+k2θ4+k3θ6+k4θ8);

24.其中,k1,k2,k3,k4是鱼眼相机畸变参数d,对鱼眼相机的畸变,使用k1,k2,k3,k4为系数的θ多项式进行描述;

[0025][0026]

其中,f

x

和fy是鱼眼相机的焦距,c

x

和cy是像素坐标系原点相对于物理坐标系原点的相对位移,相机内参矩阵用k表示;

[0027]

利用相机内参k和畸变参数d得到映射矩阵,即得到无畸变和修正转换关系;

[0028]

基于无畸变和修正转换关系,对环视鱼眼相机图像数据重映射实现去畸变处理。

[0029]

进一步,对相机进行外参标定,具体包括:

[0030]

利用飞行车辆的四周各安装的一个鱼眼相机以及每个相机前放置的一块标定板,得到未取畸变的原始图像;

[0031]

根据所述相机内参k和畸变向量d对所述原始图像进行图像畸变矫正,得到去畸变之后的图片;

[0032]

利用无人机或者站在较高处使用摄影设备,得到包含飞行车辆以及四块标定板的鸟瞰图;

[0033]

对所述鸟瞰图预处理,得到预处理后的鸟瞰图;

[0034]

所述去畸变之后的图片为原始图像,所述预处理后的鸟瞰图为目标图像,对所述原始图像和目标图像进行标定板角点检测,得到两种视角下标定板的角点坐标;

[0035]

利用原始图像和目标图像的角点坐标得到所述畸变之后的图片到预处理后的鸟瞰图的单应性转换矩阵h。

[0036]

进一步,所述预处理具体包括:旋转鸟瞰图使车头位于正前方并保持垂直,裁剪鸟瞰图比例并调整鸟瞰图分辨率,对调整后的鸟瞰图进行居中缩放,使车辆处于鸟瞰图中央。

[0037]

进一步,进行环视相机鸟瞰图拼接处理,具体包括:

[0038]

利用所述单应性变换矩阵h,得到去畸变图片转换的鸟瞰图;

[0039]

对去畸变图片转换的鸟瞰图,选择直接拼接或融合拼接,得到以飞行车辆为中心的鸟瞰图;

[0040]

若选用融合拼接,根据像素点到重叠区域边界的距离进行rgb值融合;

[0041][0042]

p=σpa+(1-σ)pb;

[0043]

其中,是像素点与重叠区域边界的夹角,为重叠区域的夹角,pa和pb为重叠区域像素点的rgb值,p为融合后该点的rgb值;

[0044]

把所述以飞行车辆为中心的鸟瞰图,送入预设的车位检测模型中的卷积神经网络中,得到车位入口线的两个角点的坐标和方位信息。

[0045]

进一步,利用预设的约束条件和先验信息推理出车位末端的两个角点坐标;具体包括:

[0046]

根据距离约束筛选出成对的车位入口线角点;

[0047]

t1≤‖p1p2‖≤t2;

[0048]

其中t1和t2是车位入口宽度的取值范围,属于先验信息,p1和p2是车位入口线的两个角点;

[0049]

满足距离约束的角点还需判断这对角点是否能行成有效的车位入口线,然后根据所述成对角点进行车位分类,根据两个角点的方向信息判断类型,得到车位是垂直车位、平行车位、锐角车位还是钝角车位以及车位的角度;

[0050]

利用所述车位角度和入口线两个角点的坐标,得到车位末端的两个角点坐标;

[0051][0052][0053]

其中p1、p2、p3和p4是车位的四个角点,d是车位的深度,属于先验信息,α是车位的角度。

[0054]

进一步,对截取后的车位图像进行hog特征提取,并判断车位是否空余,具体包括:

[0055]

对所述车位图像,进行hog特征提取,得到提取特征后的图像;

[0056]

对所述提取特征后的图像进行方差计算,判断车位是否空余;

[0057]

var《0.083;

[0058]

其中,var是图像的方差值,0.083是判断车位是否空余的阈值,属于先验信息;若方差小于0.083,则车位空余,反之,已有车辆。

[0059]

一种分体式飞行车辆鸟瞰图实时拼接及车位检测系统,所述系统包括:

[0060]

一个或多个处理器;

[0061]

存储器,用于存储一个或多个程序;

[0062]

当所述一个或多个程序被所述一个或多个处理器执行时,使得所述一个或多个处理器执行上述中任一所述的一种分体式飞行车辆鸟瞰图实时拼接及车位检测方法。

[0063]

与现有技术相比,本发明的优点在于:

[0064]

在相机外参标定时,标定板的放置没有限制要求,只需拍摄的图片能够正确识别图中标定板的角点即可,且只需要4块标定板放在4个方位就能完成标定,降低标定操作复杂度,减少成本。

[0065]

在鸟瞰图拼接过程中,可以有选择的使用直接拼接或融合拼接,根据应用场景灵活选择拼接方式,若需要较高的实时性则使用直接拼接,若要有较高的拼接质量则使用融合拼接。

[0066]

利用深度神经网络检测车位角点,根据车位先验信息推理出车位四点坐标,使检测距离大大增加,不再需要整个车位的图像。同时检测角点的方法可以只需一种网络模型,就能通过后处理,推理出不同类型车位的四点坐标,降低模型复杂度。

[0067]

利用hog特征提取的方法,使在进行车位检测的同时也能判断车位是否空余,也保证了实时性。

附图说明

[0068]

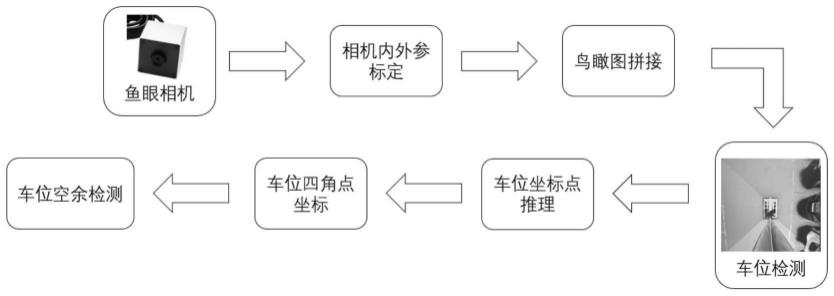

图1、本发明实施例提供的一种分体式飞行车辆鸟瞰图实时拼接及车位检测方法流程图;

[0069]

图2、本发明实施例提供的鱼眼相机外参标定所需鸟瞰图示例;

[0070]

图3、本发明实施例提供的标定所用棋盘格示意图;

[0071]

图4、本发明实施例提供的鱼眼相机标定流程图;

[0072]

图5、本发明实施例提供的融合拼接原理图;

[0073]

图6、本发明实施例提供的拼接后的鸟瞰图示例;

[0074]

图7、本发明实施例提供的推理车位坐标原理图;

[0075]

图8、本发明实施例提供的车位图像提取hog特征流程图;

[0076]

图9、本发明实施例提供的鸟瞰图车位检测示意图。

具体实施方式

[0077]

下面结合实施例描述本发明具体实施方式:

[0078]

需要说明的是,本说明书所示意的结构、比例、大小等,均仅用以配合说明书所揭示的内容,以供熟悉此技术的人士了解与阅读,并非用以限定本发明可实施的限定条件,任何结构的修饰、比例关系的改变或大小的调整,在不影响本发明所能产生的功效及所能达成的目的下,均应仍落在本发明所揭示的技术内容能涵盖的范围内。

[0079]

同时,本说明书中所引用的如“上”、“下”、“左”、“右”、“中间”及“一”等的用语,亦仅为便于叙述的明了,而非用以限定本发明可实施的范围,其相对关系的改变或调整,在无实质变更技术内容下,当亦视为本发明可实施的范畴。

[0080]

实施例

[0081]

本发明实施例提供的环视鱼眼相机鸟瞰图拼接及车位检测方法应用于分体式飞行车辆上,对分体式飞行车辆布置多个鱼眼相机实时采集图像进行鸟瞰图拼接,并对拼接的鸟瞰图做车位检测,得到车位相对于飞行车辆的位置信息,从而为飞行车辆自动泊车提供位置信息,有利泊车后与飞行器进行对接。

[0082]

图1为本发明实施例提供的一种分体式飞行车辆鸟瞰图实时拼接及车位检测方法流程图,如图1所示,所述方法包括:

[0083]

步骤101,鱼眼相机内外参标定。

[0084]

在分体式飞行车辆的四周布置多个环视相机,这里的环视相机可以是鱼眼相机也可以是普通相机,本例中选用的鱼眼相机,因此只需4个鱼眼相机即可实现360度环视。在进行参数标定之前需要确定选用相机的分辨率和帧率。

[0085]

图3为本发明实施例提供的棋盘格示意图,在本例中,选用的棋盘格标定板为600mm*600mm的规格,角点数为8*8,单个黑白方块的尺寸为60mm*60mm。首先是内参标定,相机内参是指相机的预设内参矩阵和畸变参数。先用鱼眼相机拍摄多张棋盘格标定板的图片,标定板需要在图片中处于不同位置,且需要标定板的角点清晰可见,然后用张正友标定法进行内参标定,需要足够数量的有效图片才能获得较好的标定效果,可以多次标定提高标定精度。标定完成后可获得相机内参k和畸变系数d。

[0086]

图4为本发明实施例提供的鱼眼相机标定流程图,完成内参标定后就可以进行外参标定了。在飞行车辆四个方位如图2所示,分别放置一块标定板,保证光线环境和标定板距离,确保标定板在环视相机中清晰且易于检测角点。获取四个视角的相机图像并利用相机内参k和畸变系数d生成去畸变图像。再利用无人机或者也可以站在高处用摄影设备拍摄鸟瞰图,尽可能使四块标定板在鸟瞰图中是出于同一水平面的。拍摄的鸟瞰图需要手动处

理一下,旋转图片使车头位于正前方并保持垂直,裁剪图片比例并调整图片分辨率,这个分辨率将会是最后拼接鸟瞰图时生成图片的分辨率,最后对调整后的图片进行居中缩放,使车辆处于图片中央。以上操作均是为了保证最后拼接出来的图像方位正确。再用去畸变图片和鸟瞰图计算单应性转换矩阵时需要分别对鸟瞰图中的三个标定板进行遮挡,如计算前视相机单应性转换矩阵时,则将鸟瞰图中左右以及后面的标定板涂黑处理。分别对4组图片(去畸变图片和遮盖后的鸟瞰图)检测标定板角点,计算单应性转换矩阵h。

[0087]

步骤102,鸟瞰图实时拼接。

[0088]

鸟瞰图是通过将相机图像平面的像素重投影到水平地面上,这里具体是利用单应性转换矩阵将去畸变的图像转换成鸟瞰图。完成4个方向去畸变图像的转换后,4张鸟瞰图的图像已对应相机的方位,例如前视相机的鸟瞰图仅在上半部分有图像,其他地方均为黑色。

[0089]

获得了4个方位的鸟瞰图后就可以进行拼接了,可以有选择的使用直接拼接或融合拼接,根据应用场景灵活选择拼接方式,若需要较高的实时性则使用直接拼接,若要有较高的拼接质量则使用融合拼接。直接拼接时,截取车辆图片四角与鸟瞰图四角的连线间的图像得到对应的鸟瞰图,这里的车辆图片可根据自己的需要替换,选择合适的分辨率即可,再将四各方位的截取后的鸟瞰图放在对应的位置就完成了拼接,如图6所示为直接拼接后的鸟瞰图示例。融合拼接时,则需要对相邻鸟瞰图重叠区域根据距离来计算rgb值的权重。如图5所示。根据如下算法对重叠区域的每个像素rgb值进行融合,最后获得融合后的鸟瞰图。

[0090][0091]

p=σpa+(1-σ)pb;

[0092]

其中,是像素点与重叠区域边界的夹角,为重叠区域的夹角,pa和pb为重叠区域像素点的rgb值,p为融合后该点的rgb值。由该算法可知,距离a越近的像素点rgb值占比越大,反之亦然。

[0093]

如果需要实时拼接鸟瞰图,可以对鱼眼相机的图像每个一定时间进行截取,替换原始图片,比如每隔15帧截取一次图片,然后用相机内参k、畸变系数d和单应性转换矩阵h重复上述工作就能实现实时鸟瞰图拼接。

[0094]

步骤103,车位检测及车位推理。

[0095]

本实例的车位检测方法是基于深度神经网络的方法,需要提前训练好神经网络模型,保存检测效果最好的模型权重。将拼接好的鸟瞰图输入网络模型,得到鸟瞰图中车位入口线角点的位置坐标、方向、形状以及置信度,这里的形状是指角点分为l型和t型。而方向是指角点定义的方向,t型角点的图案是对称的,们将其方向定义为沿对称轴的方向。对于l形角点,定义的方向是l的一边,其旋转90度后与另一边重合。获得了鸟瞰图中的角点后我们还需对其进行筛选,利用距离约束,车位入口线角点间的距离需要满足如下公式。

[0096]

t1≤‖p1p2‖≤t2;

[0097]

其中t1和t2是车位入口宽度的取值范围,属于先验信息,p1和p2是车位入口线的两个角点。

[0098]

满足距离约束的角点还需判断这对角点是否能形成有效车位。得到鸟瞰图中可形

成车位的成对入口线角点,利用成对的角点获取车位的方向和深度信息,图7为本发明实施例提供的推理车位坐标原理图,根据该原理图,利用如下公式推理出车位的另两个角点。

[0099][0100][0101]

其中p1、p2、p3和p4是车位的四个角点,d是车位的深度,属于先验信息,α是车位的角度。

[0102]

步骤104,车位空余判断。

[0103]

图8为本发明实施例提供的车位图像提取hog特征流程图。根据车位的坐标,确定车位在鸟瞰图中的位置,如果坐标点超出图幅范围,则将坐标点修正至车位连线与图片边界的交点处。得到车位四个角点修正在鸟瞰图中的坐标后,将车位以外的部分设为黑色,即rgb值为(255,255,255)。获取车位外接矩形坐标,通过透视变换将车位转换成外接矩形的形状,裁剪图片保留车位部分并同意图幅大小,为的是保证每个车位的尺寸一致,减小对后续判断车位空余的影响。得到统一大小的车位图片后,通过hog特征提取,生成车位hog图像。如车位中停有车辆,那么hog特征的分布比较杂乱,而没有车时则是均匀分布,因此考虑通过计算方差的形式,当方差小于一定阈值时车位空余,反之已停放车辆,本例的方差阈值取为0.083,该数值通过试验得出。这样我们就可以通过设置车位颜色来显示无车和有车的车位,如图9所示。

[0104]

参考文献(如专利/论文/标准)

[0105]

[1]张蓉,熊琪,张放,等.一种车载环视相机全景鸟瞰图生成方法:,cn110288527a[p].2019.

[0106]

[2]吉方成,谭日成,侯文博.一种车位检测方法及装置,自动泊车方法及装置:,cn112298168a[p].2021.

[0107]

[3]huang j,zhang l,shen y,et al.dmpr-ps:a novel approach for parking-slot detection using directional marking-point regression[c]//2019ieee international conference on multimedia and expo(icme).ieee,2019.

[0108]

[4]li w,cao l,yan l,et al.vacant parking slot detection in the around view image based on deep learning[j].sensors(basel,switzerland),2020,20(7).

[0109]

上面对本发明优选实施方式作了详细说明,但是本发明不限于上述实施方式,在本领域普通技术人员所具备的知识范围内,还可以在不脱离本发明宗旨的前提下做出各种变化。

[0110]

不脱离本发明的构思和范围可以做出许多其他改变和改型。应当理解,本发明不限于特定的实施方式,本发明的范围由所附权利要求限定。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1