基于感数信息的弱监督显著目标检测系统及方法

1.本发明涉及显著目标检测深度学习领域,尤其是涉及一种基于感数信息的弱监督显著目标检测系统及方法。

背景技术:

2.显著目标检测任务的目的是发现图像中在视觉感受上最明显的目标,并预测相应的显著目标图。这类问题在深度学习领域已经有很大的发展。但由于训练深度模型所使用的像素级标注的成本较高,通常使用图像标签(image tag)来作为弱监督信号。但是,图像标记只能用于标注物体的固定类别。

3.长期以来,由于该任务在许多计算机视觉任务中发挥重要作用,例如视觉跟踪、图像编辑、图像恢复等,所以吸引了大量的研究人员关注。今年来,由于深度卷积神经网络的发展,显著性检测任务的研究也取得了许多进展。

4.然而,这些最新的方法大多是基于cnn的,它们依赖于大量的像素级标签进行训练。对于这样的图像分割任务,采集大量的像素级显著性标签既费力又低效。例如,一个有经验的工作人员注释一个图像通常需要几分钟。这个缺点限制了可用训练样本的数量。

5.一些方法提出使用图像标签来解决显著性检测问题,利用类激活图作为粗显著图,同时使用由无监督方法得到的显著图,以作为虚拟标签训练分割网络。一些方法提出一种两阶段方法,将类别标签分配到目标区域,并利用真值图对预测的显著图进行微调。还有一些方法提出了一个统一的框架,可以利用图像标签,图像描述和伪标签等多种弱监督信息进行显著性检测。这些方法都利用了来自pascal voc数据集和microsoft coco数据集的图像标签,以获得优越的性能。即便训练用的数据集标注了多个物体,这些方法也是在有限类别内检测通用物体,而不是显著物体。因此,图像类别标签不能保证显著性。

技术实现要素:

6.本发明的目的就是为了克服上述现有技术存在的缺陷而提供一种基于感数信息的弱监督显著目标检测系统及方法,解决了依赖于大量的像素级标签的费力低效的问题,以及在有限类别内检测通用物体,而不是显著物体的问题,提升了可用训练样本的数量,保证了图像类别标签的显著性。

7.本发明的目的可以通过以下技术方案来实现:

8.一种基于感数信息的弱监督显著目标检测系统,包括:

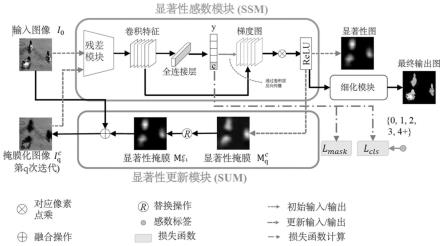

9.显著性感数模块:对输入图像根据显著目标的个数不同执行分类任务,输出初始显著性图;

10.显著性更新模块:将显著性感数模块输出的初始显著性图与原始图像进行图像融合作为下一次迭代时显著性感数模块的新输入图像;

11.细化模块:对迭代完成后显著性感数模块输出的完整的显著性图进行细化输出显著目标检测结果图。

12.优选地,所述的显著性感数模块为五分类网络。

13.优选地,述的显著性感数模块使用resnet-101作为骨架网络。

14.优选地,所述的显著性感数模块采用交叉熵损失函数作为分类损失函数。

15.优选地,所述的显著性感数模块采用grad-cam方法提取网络中的高响应区域作为初始显著性图。

16.优选地,所述的显著性更新模块进行图像融合的过程表示为:

[0017][0018]

其中,为第q次迭代时过程显著性感数模块的新输入图像,i0为原始图像,

⊙

表示元素对应相乘,σ为阈值矩阵,σ中的所有元素值都等于σ,为第q-1次迭代显著性感数模块输出的初始显著性图,ω为尺度参数,sigmoid为激活函数,q≥1。

[0019]

优选地,所述的显著性更新模块采用掩膜挖掘损失函数来提取更大的响应区域,所述的掩膜挖掘损失函数表示为:

[0020][0021]

其中,l

mask

为掩膜挖掘损失函数,n为数据集大小,yc(ic)表示对类别c进行掩膜化图像ic的预测值。

[0022]

优选地,所述的显著性感数模块和显著性更新模块同步训练,训练时损失函数表示为:

[0023]

l=l

cls

+αl

mask

[0024]

其中,l为总损失函数,l

cls

为显著性感数模块的交叉熵损失函数,l

mask

为显著性更新模块的掩膜挖掘损失函数,α为权重参数。

[0025]

优选地,所述的细化模块采用crf方法进行细化输出显著目标检测结果图。

[0026]

一种基于感数信息的弱监督显著目标检测方法,该方法基于所述的基于感数信息的弱监督显著目标检测系统,该方法包括:

[0027]

将显著性物体感数任务作为一个分类任务,根据显著目标的个数进行分类得到初始显著性图;

[0028]

融合原始图像和初始显著性图,作为下一次迭代的新输入图像,对新输入图像再次进行分类,将初始显著性图逐步扩展为完整的显著性图;

[0029]

对完整的显著性图进行细化得到显著目标检测结果图。

[0030]

与现有技术相比,本发明具有如下优点:

[0031]

(1)本发明感数信息作为一种弱监督信息是首次使用,这种信息更容易获得,标注成本更低;而且他比常见的弱监督信息图像标签(image tag)相比,更加贴合显著性检测的定义;为了利用感数信息,实用分类网络来获得初始显著图,这种比利用常见的弱监督信息图像标签(image tag)相比,更易学习,因为图像标签的多分类通常都是千分类问题;此外,在更新过程中,利用sum实现端对端优化,不必使用伪标签反复训练。

[0032]

(2)本发明提出利用感数信息作为弱监督信号来进行显著目标检测任务,这可以充分利用感数信息的类别无关性质,与其他先进弱监督方法相比,本发明提出的方法可以达到领先的性能;与一些全监督方法相比,方法也具有可比性。

[0033]

(3)本发明的方法捕获了显著目标的完整区域,而那些使用图像标签的方法忽略了显著目标的某些部分,本发明感数信息有助于识别多个对象之间的边界,与图像标签训练的框架相比,感数信息训练的框架具有更好的性能,充分体现了感数信的优越性,此外感数信息也更易获得和标注。

[0034]

(4)本发明显著性更新模块更新后的结果在外观上更加完整,而没有更新的结果由于神经网络的特性,只关注于一个有限的显著区域。在dut-omron数据集上,使用sum模块迭代10次和50次后,显著性预测的fω和mae度量分别为0.638/0.252和0.704/0.139,显著性更新模块提高了显著性检测的性能。

附图说明

[0035]

图1为本发明一种基于感数信息的弱监督显著目标检测系统的结构框图。

具体实施方式

[0036]

下面结合附图和具体实施例对本发明进行详细说明。注意,以下的实施方式的说明只是实质上的例示,本发明并不意在对其适用物或其用途进行限定,且本发明并不限定于以下的实施方式。

[0037]

实施例

[0038]

如图1所示,本实施例提供一种基于感数信息的弱监督显著目标检测系统,包括:

[0039]

显著性感数模块:对输入图像根据显著目标的个数不同执行分类任务,输出初始显著性图;

[0040]

显著性更新模块:将显著性感数模块输出的初始显著性图与原始图像进行图像融合作为下一次迭代时显著性感数模块的新输入图像;

[0041]

细化模块:对迭代完成后显著性感数模块输出的完整的显著性图进行细化输出显著目标检测结果图。

[0042]

显著性感数模块为五分类网络,述的显著性感数模块使用resnet-101作为骨架网络,显著性感数模块采用交叉熵损失函数作为分类损失函数。显著性感数模块采用grad-cam方法提取网络中的高响应区域作为初始显著性图。

[0043]

本发明感数信息作为一种弱监督信息是首次使用,这种信息更容易获得,标注成本更低;而且他比常见的弱监督信息图像标签(image tag)相比,更加贴合显著性检测的定义;为了利用感数信息,实用分类网络来获得初始显著图,这种比利用常见的弱监督信息图像标签(image tag)相比,更易学习,因为图像标签的多分类通常都是千分类问题;此外,在更新过程中,利用sum实现端对端优化,不必使用伪标签反复训练。

[0044]

显著性更新模块进行图像融合的过程表示为:

[0045][0046]

其中,为第q次迭代时过程显著性感数模块的新输入图像,i0为原始图像,

⊙

表示元素对应相乘,σ为阈值矩阵,σ中的所有元素值都等于σ,为第q-1次迭代显著性感数模块输出的初始显著性图,ω为尺度参数,sigmoid为激活函数,q≥1。

[0047]

显著性更新模块采用掩膜挖掘损失函数来提取更大的响应区域,掩膜挖掘损失函

数表示为:

[0048][0049]

其中,l

mask

为掩膜挖掘损失函数,n为数据集大小,yc(ic)表示对类别c进行掩膜化图像ic的预测值。

[0050]

显著性感数模块和显著性更新模块同步训练,训练时损失函数表示为:

[0051]

l=l

cls

+αl

mask

[0052]

其中,l为总损失函数,l

cls

为显著性感数模块的交叉熵损失函数,l

mask

为显著性更新模块的掩膜挖掘损失函数,α为权重参数。

[0053]

细化模块采用crf方法进行细化输出显著目标检测结果图。

[0054]

在上述基于感数信息的弱监督显著目标检测系统的基础上,本实施例提供一种基于感数信息的弱监督显著目标检测方法,该方法,该方法包括:

[0055]

将显著性物体感数任务作为一个分类任务,根据显著目标的个数进行分类得到初始显著性图;

[0056]

融合原始图像和初始显著性图,作为下一次迭代的新输入图像,对新输入图像再次进行分类,将初始显著性图逐步扩展为完整的显著性图;

[0057]

对完整的显著性图进行细化得到显著目标检测结果图。

[0058]

具体地:

[0059]

步骤1:显著图提取

[0060]

1.1)将显著性物体感数任务作为一个分类任务,根据显著目标的个数不同将他们分类。本实施例将显著性物体感数任务作为一个分类任务,根据显著目标的个数不同将他们分为五类,分别是:0、1、2、3和4+。每类不同层计算的特征图具有相同的分辨率。使用resnet-101作为骨架网络,使用交叉熵损失函数作为分类损失函数l

cls

,为了获得更稠密的显著性预测图,骨架网络最后两个下采样层的步长设定为1,从而跳过子采样,并使用扩展算法增加后续卷积核的扩展速率以扩大其接受域,以此在分类层之前生成原始图像1/8大小的特征图;

[0061]

1.2)采用grad-cam方法提取网络中的高响应区域来作为初始显著性图;

[0062]

步骤2:初始显著图优化

[0063]

2.1)融合原始图像和显著性图以作为下一次迭代的新输入图像。从视觉上看,融合过程是将当前已经检测到的显著性的区域从原始图像中抠除;

[0064]

2.2)引入掩膜挖掘损失函数l

mask

来提取更大的响应区域,在此损失函数下,网络学习提取目标对象中那些不太显著但仍旧相关的部分,同时保持对感数信息的识别能力,降低对类别c的预测误差;

[0065]

步骤3:显著性图边缘细化

[0066]

3.1)采用slic方法生成的超像素作为基本表示单元。这些超像素被组织成邻接图,以在空间和特征维度上进行建模;

[0067]

3.2)对每一个超像素学习一个非线性的回归方程,增强图单元之间的连接性和平滑性并为每个超像素计算显著性评分。

[0068]

步骤1所述的resnet-101网络,在imagenet数据集上进行预训练,该网络原始的

1000分类全连接层被替换为5分类全连接层。

[0069]

步骤1所述的grad-cam方法提取网络中的高响应区域来作为初始显著性图,这个图中也包含了梯度信息,在最后的反向传播阶段可以输入到卷积层中。梯度信息代表了网络推理过程中每个神经元的重要性。假设最后一层卷积层的输出特征的通道数为k,对于一个给定的图像,令fk为神经元k的激活图,其中k∈[1,k]。对每个类别c,将分数yc相对于激活图fk的梯度求均值,得到c类

[0070]

的神经元重要度权重

[0071][0072]

其中i和j表示特征图的坐标,且n=m

×

h。根据神经元重要度权重,可以计算出激活图mc:

[0073][0074]

relu函数过滤了梯度值中的负值,因为只有正值对相对应的分类决策有贡献,但负值是对其他类别的分类决策起作用的。显著性图的尺寸与最后一层卷积层特征图尺寸一致(也就是原始图像的1/8大小)。由于显著性图是在每次前向推理中直接得到的,使得它们可以参与到训练阶段,并在训练过程中得到优化。

[0075]

步骤2所述的融合原始图像和显著性图以作为下一次迭代的新输入图像,定义i0为原始图像,定义为第q次迭代过程中的输入图像(q≥1),定义为类别c在第q次迭代过程中的显著性图。融合过程可以由下式表达:

[0076][0077]

其中

⊙

表示元素对应相乘,σ是一个阈值矩阵,其中的所有元素值都等于σ。在尺度参数ω的作用下,当时,掩膜项更接近1,反之则更接近0。其强制包含目标类中尽可能少的特性。

[0078]

步骤2所述的引入掩膜挖掘损失函数l

mask

来提取更大的响应区域,如下式所示:

[0079][0080]

其中n是数据集大小,yc(ic)表示对类别c进行掩膜化图像ic的预测值。在训练阶段,总的损失函数l是分类损失l

cls

和掩膜挖掘损失l

mask

的组合:

[0081]

l=l

cls

+αl

mask

[0082]

其中α是权重参数,设置为1。

[0083]

步骤3:对网络输出结果图进行细化

[0084]

本步骤中细化方法采用流行的crf方法,输入是网络输出图,输出是本方法的最终效果图。

[0085]

本发明提出利用感数信息作为弱监督信号来进行显著目标检测任务,这可以充分利用感数信息的类别无关性质,与其他先进弱监督方法相比,本发明提出的方法可以达到领先的性能;与一些全监督方法相比,方法也具有可比性。本发明的方法捕获了显著目标的

完整区域,而那些使用图像标签的方法忽略了显著目标的某些部分,本发明感数信息有助于识别多个对象之间的边界,与图像标签训练的框架相比,感数信息训练的框架具有更好的性能,充分体现了感数信的优越性,此外感数信息也更易获得和标注。本发明显著性更新模块更新后的结果在外观上更加完整,而没有更新的结果由于神经网络的特性,只关注于一个有限的显著区域。在dut-omron数据集上,使用sum模块迭代10次和50次后,显著性预测的fω和mae度量分别为0.638/0.252和0.704/0.139,显著性更新模块提高了显著性检测的性能。

[0086]

上述实施方式仅为例举,不表示对本发明范围的限定。这些实施方式还能以其它各种方式来实施,且能在不脱离本发明技术思想的范围内作各种省略、置换、变更。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1