一种命名实体识别方法及终端与流程

1.本发明涉及自然语言处理技术领域,尤其涉及一种命名实体识别方法及终端。

背景技术:

2.命名实体识别(named entity recognition,ner)是信息提取、问答系统、句法分析、知识图谱构建等应用领域的重要基础工具,在自然语言处理技术走向实用化的过程中占有重要地位。简单说就是从一段自然语言文本中找出相关实体,并标注出其位置以及类型。与分类问题相比,序列标注问题中,当前的预测标签不仅与当前的输入特征相关,还与之前的预测标签相关,即预测标签序列之间是有强相互依赖关系的。在传统机器学习中,lstm(long short-term memory,长短期记忆网络)+crf(条件随机场)是ner目前的主流模型。它的目标函数不仅考虑了输入的状态特征函数,而且还包含了标签转移特征函数。在crf求解中,这是一个动态规划问题,可以使用维特比算法进行解码。目前最主流的ner模型基本都是embedding层、双向rnn(recurrent neural network,循环神经网络)层、tanh(hyperbolic tangent function,双曲正切函数)激活层以及最后的crf层构成,该模型的优点在于为一个位置进行标注的过程中可以利用丰富的内部及上下文特征信息,但仍存在以下不足:

3.1、需要按顺序进行序列计算,所以如果面对长句子,距离较远的依赖关系相比之下很难捕获到;

4.2、缺少字符之间的关联度。

技术实现要素:

5.本发明所要解决的技术问题是:提供一种命名实体识别方法及终端,能够有效提高命名实体识别的准确率。

6.为了解决上述技术问题,本发明采用的一种技术方案为:

7.一种命名实体识别方法,包括步骤:

8.获取文本,并对所述文本进行分词,得到文字序列,所述文字序列包括字符文字序列;

9.基于所述字符文字序列使用特征增强算法进行特征增强,得到增强后的多元特征,并基于所述增强后的多元特征获取特征向量;

10.使用多头注意力机制对所述特征向量进行时序编码,输出得到时序特征;

11.对所述时序特征进行预测,得到最优标注序列,并根据所述最优标注序列,得到所述文本对应的命名实体识别结果。

12.为了解决上述技术问题,本发明采用的另一种技术方案为:

13.一种命名实体识别终端,包括存储器、处理器及存储在存储器上并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现以下步骤:

14.获取文本,并对所述文本进行分词,得到文字序列,所述文字序列包括字符文字序

列;

15.基于所述字符文字序列使用特征增强算法进行特征增强,得到增强后的多元特征,并基于所述增强后的多元特征获取特征向量;

16.使用多头注意力机制对所述特征向量进行时序编码,输出得到时序特征;

17.对所述时序特征进行预测,得到最优标注序列,并根据所述最优标注序列,得到所述文本对应的命名实体识别结果。

18.本发明的有益效果在于:基于字符文字序列使用特征增强算法进行特征增强,得到增强后的多元特征,并基于增强后的多元特征获取特征向量,使用多头注意力机制对特征向量进行时序编码,输出得到时序特征,通过基于增强后的多元特征获取特征向量,能够融合多元特征,利用多元特征有利于模型学习到更多的语义信息,且利用多头注意力机制能够有效地获取字符序列之间的注意力,可在计算过程中将序列中任意两个字符直接联系起来,缩短距离依赖,有效利用特征完整表达整个文本的特征以及上下文特征,且字符之间能够相互关联,从而有效提高了命名实体识别的准确率。

附图说明

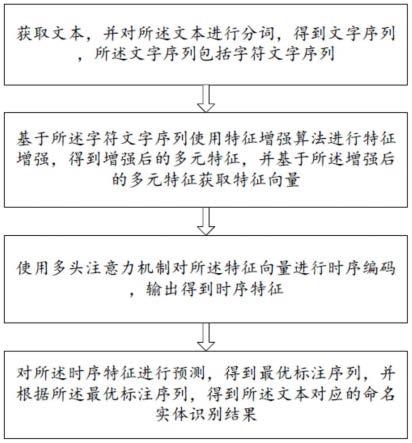

19.图1为本发明实施例的一种命名实体识别方法的步骤流程图;

20.图2为本发明实施例的一种命名实体识别终端的结构示意图;

21.图3为本发明实施例命名实体识别方法中的时序特征获取的步骤示意图;

22.图4为本发明实施例命名实体识别方法中的特征增强与融合示意图;

23.图5为本发明实施例命名实体识别方法中的注意力计算网络示意图;

24.图6为本发明实施例命名实体识别方法中的时序特征获取的结构示意图。

具体实施方式

25.为详细说明本发明的技术内容、所实现目的及效果,以下结合实施方式并配合附图予以说明。

26.请参照图1,本发明实施例提供了一种命名实体识别方法,包括步骤:

27.获取文本,并对所述文本进行分词,得到文字序列,所述文字序列包括字符文字序列;

28.基于所述字符文字序列使用特征增强算法进行特征增强,得到增强后的多元特征,并基于所述增强后的多元特征获取特征向量;

29.使用多头注意力机制对所述特征向量进行时序编码,输出得到时序特征;

30.对所述时序特征进行预测,得到最优标注序列,并根据所述最优标注序列,得到所述文本对应的命名实体识别结果。

31.从上述描述可知,本发明的有益效果在于:基于字符文字序列使用特征增强算法进行特征增强,得到增强后的多元特征,并基于增强后的多元特征获取特征向量,使用多头注意力机制对特征向量进行时序编码,输出得到时序特征,通过基于增强后的多元特征获取特征向量,能够融合多元特征,利用多元特征有利于模型学习到更多的语义信息,且利用多头注意力机制能够有效地获取字符序列之间的注意力,可在计算过程中将序列中任意两个字符直接联系起来,缩短距离依赖,有效利用特征完整表达整个文本的特征以及上下文

特征,且字符之间能够相互关联,从而有效提高了命名实体识别的准确率。

32.进一步地,所述对所述文本进行分词,得到文字序列包括:

33.将所述文本按照字符分词规则进行字符分词,得到字符文字序列;

34.将所述文本使用分词工具进行词语分词,得到词语文字序列。

35.由上述描述可知,对文本进行字符分词的同时进行词语分词,得到字符文字序列和词语文字序列,以不同的文本长度进行分词,以便后续互相学习特征,以提高命名实体识别的准确率。

36.进一步地,所述将所述文本使用分词工具进行词语分词,得到词语文字序列包括:

37.将所述文本使用jieba分词工具或hanlp分词工具进行词语分词,得到词语文字序列。

38.由上述描述可知,可根据实际情况任意选择使用jieba分词工具或hanlp分词工具对文本进行词语分词,提高了灵活性和适用性。

39.进一步地,所述基于所述字符文字序列使用特征增强算法进行特征增强,得到增强后的多元特征包括:

40.根据所述字符文字序列进行转换,得到多元特征;

41.使用特征增强算法对所述多元特征进行特征增强,得到增强后的多元特征。

42.由上述描述可知,使用特征增强算法对多元特征进行特征增强,后续便于网络学习增强后的多元特征,以获取更多的语义信息。

43.进一步地,所述基于所述增强后的多元特征获取特征向量包括:

44.将所述增强后的多元特征使用线性映射进行特征维度扩充,得到扩充后的多元特征;

45.基于所述扩充后的多元特征进行特征融合,得到融合后的多元特征;

46.将所述融合后的多元特征输入至char embedding网络,输出得到字符特征向量;

47.将所述词语文字序列输入至预训练的bert模型,输出得到词特征向量。

48.由上述描述可知,将融合后的多元特征作为网络输入,输出得到的字符特征向量,利用字符特征向量和词特征向量可帮助模型学习到更多的文本语义信息。

49.进一步地,所述char embedding网络包括依次连接的全连接神经网络、随机失活层和激活函数;

50.所述将所述融合后的多元特征输入至char embedding网络,输出得到字符特征向量包括:

51.将所述融合后的多元特征输入至所述全连接神经网络,输出得到第一向量;

52.将所述第一向量输入至所述随机失活层,输出得到第二向量;

53.将所述第二向量输入至所述激活函数,输出得到字符特征向量。

54.由上述描述可知,全连接神经网络用于把一个特征空间线性变换到另一个特征空间,而随机失活层能够使神经网络不会去偏向于某一个节点特征,以减轻神经网络的过拟合,最后通过激活函数完成数据的非线性变换,解决线性模型的表达、分类能力不足的问题,从而提高了命名实体识别的准确性。

55.进一步地,所述使用多头注意力机制对所述特征向量进行时序编码,输出得到时序特征包括:

56.将所述字符特征向量输入至第一注意力计算网络,将所述词特征向量输入至第二注意力计算网络,并使用损失函数更新所述第一注意力计算网络和所述第二注意力计算网络,输出得到时序特征。

57.由上述描述可知,利用第一注意力计算网络和第二注意力计算网络的双网络结构能够使两个网络中的多元特征相互学习,实现并行计算和网络加深,以此制约和增强模型效果,能有效提升命名实体识别效果,尤其是处理边界问题,且提升了多实体类型。

58.进一步地,所述第一注意力计算网络包括第一多头注意力编码层和第一双向lstm网络;

59.所述第二注意力计算网络包括第二多头注意力编码层和第二双向lstm网络;

60.所述将所述字符特征向量输入至第一注意力计算网络,将所述词特征向量输入至第二注意力计算网络,并使用损失函数更新所述第一注意力计算网络和所述第二注意力计算网络,输出得到时序特征包括:

61.将所述字符特征向量输入至第一多头注意力编码层进行编码,得到字符注意力特征,并将所述字符注意力特征输入至所述第一双向lstm网络,输出得到字符时序特征;

62.将所述词特征向量输入至第二多头注意力编码层进行编码,得到词注意力特征,并将所述词注意力特征输入至第二双向lstm网络,输出得到词时序特征;

63.使用损失函数更新所述第一注意力计算网络和所述第二注意力计算网络,并根据所述字符时序编码和所述词时序编码输出得到时序特征。

64.由上述描述可知,使用双向lstm网络代替transformer原有的position-wise ffn,能够获取上下文联系而非获取单纯的位置的序列信息,进而提高命名实体识别的准确性。

65.进一步地,所述损失函数包括第一损失函数和第二损失函数;

66.所述使用损失函数更新所述第一注意力计算网络和所述第二注意力计算网络包括:

67.使用所述第一损失函数更新所述第一注意力计算网络,并使用所述第二损失函数更新所述第二注意力计算网络;

68.所述第一损失函数为:

[0069][0070]

式中,表示t-1时刻所述字符多头注意力网络的损失,β表示第一权重参数,表示t-1时刻所述词语多头注意力网络的损失;

[0071]

所述第二损失函数为:

[0072][0073]

式中,α表示第二权重参数。

[0074]

由上述描述可知,最终在模型训练时,将第一注意力计算网络和第二注意力计算网络的损失同时最小化,这两个网络会互相传递loss信息并同时更新,以此让两个网络的损失同时降到最低。

[0075]

请参照图2,本发明另一实施例提供了一种命名实体识别终端,包括存储器、处理

器及存储在存储器上并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现上述命名实体识别方法中的各个步骤。

[0076]

本发明上述的一种命名实体识别方法及终端能够适用于对自然语言进行命名实体识别的场景,以下通过具体实施方式进行说明:

[0077]

实施例一

[0078]

请参照图1和图3-图6,本实施例的一种命名实体识别方法,包括步骤:

[0079]

s1、获取文本,并对所述文本进行分词,得到文字序列,所述文字序列包括字符文字序列,具体包括:

[0080]

s11、获取文本;

[0081]

s12、将所述文本按照字符分词规则进行字符分词,得到字符文字序列,如图3所示;

[0082]

其中,所述字符分词规则包括英文字符分词规则、中文字符分词规则和符号字符分词规则,所述英文字符分词规则为按照单词分词,所述中文字符分词规则为按照单个字分词,所述符号字符分词规则为按照字符分词;

[0083]

具体的,将所述文本中的英文按照英文字符分词规则进行字符分词,将所述文本中的中文按照中文字符分词规则进行字符分词,将所述文本中的符号按照符号字符分词规则进行字符分词,得到字符文字序列;

[0084]

s13、将所述文本使用分词工具进行词语分词,得到词语文字序列;

[0085]

具体的,将所述文本使用jieba分词工具或hanlp分词工具进行词语分词,得到词语文字序列;

[0086]

s2、基于所述字符文字序列使用特征增强算法进行特征增强,得到增强后的多元特征,并基于所述增强后的多元特征获取特征向量,如图3所示,具体包括:

[0087]

s21、根据所述字符文字序列进行转换,得到多元特征;

[0088]

所述多元特征包括预训练bert特征、笔画特征、拼音特征、字形结构特征和郑码特征,如图4所示;

[0089]

其中,根据预训练bert模型对所述字符文字序列进行转换,得到预训练bert特征,即预训练bert embedding;

[0090]

s22、使用特征增强算法对所述多元特征进行特征增强,得到增强后的多元特征;

[0091]

s23、将所述增强后的多元特征使用线性映射进行特征维度扩充,得到扩充后的多元特征;

[0092]

具体的,将所述增强后的多元特征使用线性映射进行特征维度扩充,并与预训练bert embedding相结合,将映射维度确定为相同的维度,得到扩充后的多元特征,避免造成注意力偏移;

[0093]

s24、基于所述扩充后的多元特征进行特征融合,得到融合后的多元特征;

[0094]

s25、将所述融合后的多元特征输入至char embedding网络,输出得到字符特征向量,如图4所示,具体包括:

[0095]

其中,所述char embedding网络包括依次连接的全连接神经网络、随机失活层和激活函数,所述char embedding网络随整个网络模型同时训练优化;

[0096]

s251、将所述融合后的多元特征输入至所述全连接神经网络,输出得到第一向量;

[0097]

s252、将所述第一向量输入至所述随机失活层,输出得到第二向量;

[0098]

s253、将所述第二向量输入至所述激活函数,输出得到字符特征向量;

[0099]

s26、将所述词语文字序列输入至预训练的bert模型,输出得到词特征向量,如图3所示;

[0100]

在另一种可选的实施方式中,将所述词语文字序列输入至预设word2vec模型,输出得到词特征向量;

[0101]

s3、使用多头注意力机制对所述特征向量进行时序编码,输出得到时序特征;

[0102]

具体的,将所述字符特征向量输入至第一注意力计算网络,将所述词特征向量输入至第二注意力计算网络,并使用损失函数更新所述第一注意力计算网络和所述第二注意力计算网络,输出得到时序特征,如图5所示,具体包括:

[0103]

其中,所述第一注意力计算网络包括第一多头注意力编码层和第一双向lstm网络(图5中的双向循环神经网络);所述第二注意力计算网络包括第二多头注意力编码层和第二双向lstm网络;

[0104]

s31、将所述字符特征向量输入至第一多头注意力编码层进行编码,得到字符注意力特征,并将所述字符注意力特征输入至所述第一双向lstm网络,输出得到字符时序特征;

[0105]

具体的,将所述字符特征向量输入至第一多头注意力编码层进行编码后进行层归一化,得到字符注意力特征,并将所述字符注意力特征输入至所述第一双向lstm网络后进行层归一化,然后使用softmax层输出得到字符时序特征;

[0106]

s32、将所述词特征向量输入至第二多头注意力编码层进行编码,得到词注意力特征,并将所述词注意力特征输入至第二双向lstm网络,输出得到词时序特征;

[0107]

具体的,将所述词特征向量输入至第二多头注意力编码层进行编码后进行层归一化,得到词注意力特征,并将所述词注意力特征输入至所述第二双向lstm网络后进行层归一化,然后使用softmax层输出得到词时序特征;

[0108]

其中,所述注意力计算公式如下:

[0109]

multihead=concat(headi,....headh,)wo;

[0110][0111][0112]

式中,multihead表示多头注意力,wo表示权重矩阵参数,用于将多个矩阵拼接,该参数同样会随着训练不断更新,headi表示第i个注意力头的输出向量,headh表示第h个注意力头的输出向量,q表示查询向量,k表示键向量,v表示值向量,w

iq

表示训练过程中得到的第一参数,表示训练过程中得到的第二参数,表示训练过程中得到的第三参数,这些参数一般可以使用高斯(gaussian)、哈威尔(xavier)或者随机(random)初始化,且随着训练不断更新,dk表示所述查询向量或所述键向量的维度,attention()表示注意力计算,k

t

表示所述键向量的转置;

[0113]

s33、使用损失函数更新所述第一注意力计算网络和所述第二注意力计算网络,并根据所述字符时序编码和所述词时序编码输出得到时序特征,如图6所示,具体包括:

[0114]

所述损失函数包括第一损失函数和第二损失函数,所述损失函数采用二元交叉熵

损失(binary crossentropy loss);

[0115]

s331、使用所述第一损失函数更新所述第一注意力计算网络,并使用所述第二损失函数更新所述第二注意力计算网络;

[0116]

其中,所述第一损失函数为:

[0117][0118]

式中,表示t-1时刻所述字符多头注意力网络的损失,β表示第一权重参数,表示t-1时刻所述词语多头注意力网络的损失;

[0119]

所述第二损失函数为:

[0120][0121]

式中,α表示第二权重参数;

[0122]

s332、根据所述字符时序编码和所述词时序编码输出得到时序特征;

[0123]

其中,最终输出得到的时序特征是字符级别的;

[0124]

步骤s31~s33同步进行,将双网络结构(第一注意力计算网络和第二注意力计算网络)的损失loss同时最小化,且这两个网络会互相传递loss信息并同时训练与更新;

[0125]

s4、对所述时序特征进行预测,得到最优标注序列,并根据所述最优标注序列,得到所述文本对应的命名实体识别结果;

[0126]

实施例二

[0127]

请参照图2,本实施例的一种命名实体识别终端,包括存储器、处理器及存储在存储器上并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现实施例一中的命名实体识别方法中的各个步骤。

[0128]

综上所述,本发明提供的一种命名实体识别方法及终端,获取文本,并对所述文本进行分词,得到文字序列,所述文字序列包括字符文字序列;基于所述字符文字序列使用特征增强算法进行特征增强,得到增强后的多元特征,并基于所述增强后的多元特征获取特征向量;使用多头注意力机制对所述特征向量进行时序编码,输出得到时序特征;对所述时序特征进行预测,得到最优标注序列,并根据所述最优标注序列,得到所述文本对应的命名实体识别结果;具体的,将所述字符特征向量输入至第一注意力计算网络,将所述词特征向量输入至第二注意力计算网络,并使用损失函数更新所述第一注意力计算网络和所述第二注意力计算网络,输出得到时序特征,使用双向lstm网络代替transformer原有的position-wise ffn,能够获取上下文联系而非获取单纯的位置的序列信息;同时能够融合多元特征,利用多元特征有利于模型学习到更多的语义信息,且利用多头注意力机制能够有效地获取字符序列之间的注意力,可在计算过程中将序列中任意两个字符直接联系起来,缩短距离依赖,有效利用特征完整表达整个文本的特征以及上下文特征,且字符之间能够相互关联,从而有效提高了命名实体识别的准确率。

[0129]

以上所述仅为本发明的实施例,并非因此限制本发明的专利范围,凡是利用本发明说明书及附图内容所作的等同变换,或直接或间接运用在相关的技术领域,均同理包括在本发明的专利保护范围内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1