基于残差混合注意力网络的图像超分辨率重建模型及方法与流程

1.本发明涉及计算机视觉和图像处理技术领域,特别是一种基于残差混合注意力网络的图像超分辨率重建模型及方法。

背景技术:

2.在电子图像应用领域,人们经常期望得到高分辨率图像。高分辨率意味着图像中的像素密度高,能够提供更多的细节,而这些细节在许多实际应用中不可或缺。例如,高分辨率医疗图像对于医生做出正确的诊断是非常有帮助的;使用高分辨率卫星图像就很容易从相似物中区别相似的对象;如果能够提供高分辨的图像,计算机视觉中的模式识别的性能就会大大提高。

3.受资金和技术的限制,获取的图片在多数情况下难以达到期望的分辨率。然而图像在获取处理过程中受到多方面制约,如数字成像过程中的散焦、衍射等造成的光学模糊,快门速度有限造成的运动模糊,传感单元的密度将影响混叠效应,图像感光器内或图像传输过程中的随机噪声等,这些因素都会影响图像的生成质量。因此,寻找一种增强当前分辨率水平的方法是非常必须的。

4.图像超分辨率重建技术作为一种后处理手段,能够在不增加硬件成本的情况下增强图像的分辨率。图像超分辨率重建旨在从给定的低分辨率图像中通过算法还原出高分辨率图像。目前,图像超分辨率重建的方法主要可以分为三类:基于插值的超分辨率重建、基于重构的超分辨率重建以及基于学习的超分辨率重建。插值法是指通过在图像原有的像素周围插入新像素来加大图像的尺寸,插入像素后还要给这些像素赋值,从而恢复图像内容,达到提高图像分辨率的效果。这类方法计算较为简单、易于理解和实现,但是重建结果会出现振铃效应以及高频信息丢失严重的问题。重构法是对图像的获取过程建立观测模型,然后通过求解观测模型的逆问题来实现超分辨率重建。重构法在恢复细节上有了改进,但是随着尺度因子的增大它的性能有所下降,而且这个方法十分耗时。基于深度学习的超分辨率重建利用在低分辨率图像块与高分辨率图像块之间建立“端到端”的映射,对高频信息进行复原,取得了不错的重构结果。

5.目前主流的算法往往设计非常深的网络架构,需要长时间的训练,并且随着网络深度越深,训练难度越大,所需的训练技巧也随之增加。同时,低分辨率的输入中包含了丰富的低频信息,这些信息在通道之间被平等对待,阻碍了卷积神经网络的学习更多的高频信息。此外,目前用于超分辨率的卷积神经网络没有充分利用多个尺度上的特征,限制了网络的学习能力。同时,仅仅使用卷积神经网络构建模型,无法充分利用图像内部的自相似性,捕捉到图像内部的远距离依赖关系。因此,如何解决现有问题并重建出高质量的图像是十分必要的。

技术实现要素:

6.有鉴于此,本发明的目的在于提供一种基于残差混合注意力网络的图像超分辨率

重建模型及方法,实现恢复出更多的纹理细节,提高图像超分辨率重建精度。

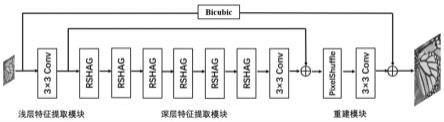

7.为实现上述目的,本发明采用如下技术方案:基于残差混合注意力网络的图像超分辨率重建模型,包括浅层特征提取模块、深层特征提取模块以及重建模块:所述浅层特征提取模块由一个3

×

3卷积层组成,利用卷积层擅于提取特征的特点,提取低分辨率输入图像的浅层特征,具体操作如下:

8.m0=h

sf

(i

lr

)

9.其中h

sf

(

·

)表示浅层特征提取模块,i

lr

表示输入的低分辨率图像,m0表示浅层特征图;

10.所述深层特征提取模块由多重残差分离混合注意力组和3

×

3的卷积组成,从浅层特征中提取高级特征,该过程表达如下:

[0011][0012]mdf

=f3×3(mn)

[0013]

其中表示第i个多重残差分离混合注意力组,n表示多重混合注意力残差组的数量,m

i-1

、mi、mn表示多重残差分离混合注意力组的中间特征图,f3×3(

·

)表示卷积核大小为3

×

3的卷积操作,m

df

表示深层特征图。

[0014]

所述重建模块由亚像素卷积层和3

×

3的卷积组成,利用一个亚像素卷积层对深层特征提取模块提取的深层特征进行上采样,将信息流重整为指定上采样倍率的特征图,该过程描述为:

[0015]isr

=h

up

(m

df

+m0)+bicubic(i

lr

)

[0016]

其中i

sr

表示超分辨率重建后的高分辨率图像,h

up

(

·

)表示重建模块,bicubic(

·

)表示对低分辨率图像进行双三次插值至目标分辨率。

[0017]

在一较佳的实施例中,所述多重残差分离混合注意力组由多个残差分离混合注意力模块和3

×

3卷积层构成。

[0018]

在一较佳的实施例中,所述残差分离混合注意力模块由两个1

×

1卷积层、一个残差三重注意力模块、一个高效swin transformer模块、残差连接、通道拆分及拼接操作构成,具体计算公式表达式如下:

[0019]

x1,x2=h

spl

(f1×1(x))

[0020]

y1=rtab(x1)

[0021]

y2=estb(x2)

[0022]

z=f1×1(h

cat

(y1,y2))+x

[0023]

其中,x表示残差分离混合注意力模块的输入特征,f1×1(

·

)表示1

×

1卷积层,h

spl

(

·

)表示通道拆分的操作,x1、x2表示拆分后的特征图,rtab表示残差三重注意力模块的操作,y1表示残差三重注意力模块的输出特征,estb表示高效swin transformer模块的操作,y2表示高效swin transformer模块的输出特征,h

cat

(

·

)表示通道拼接的操作,z表示残差分离混合注意力模块的输出特征。

[0024]

在一较佳的实施例中,所述残差三重注意力模块由两个3

×

3卷积层、relu激活函数、残差连接和一个三重注意力模块组成,具体计算公式表达式如下:

[0025]

xo=f

tam

(f3×3(relu(f3×3(xi))))+x

[0026]

其中,xi表示残差三重注意力模块的输入特征,xo表示残差三重注意力模块的输出特征,f

tam

(

·

)表示三重注意力模块的操作,relu(

·

)表示relu激活函数;其中三重注意力模块由两个跨维度交互模块和一个空间注意力模块构成,具体计算公式表达式如下:

[0027][0028]

其中表示两个跨维度交互模块的输出特征,表示空间注意力模块的输出特征,y表示三重注意力模块的输出特征。

[0029]

在一较佳的实施例中,所述跨维度交互模块包括一个7

×

7卷积层、维度置换操作、z-pool层、通道连接操作、最大池化操作及平均池化操作;具体的计算公式如下:

[0030]

x

′1=h

per

(x1)

[0031]

z-pool(x)=h

cat

(h

mp

(x),h

ap

(x))

[0032]

x

″1=z-pool(x

′1)

[0033][0034][0035]

其中,x

′1表示维度置换操作的结果,x

″1表示经过z-pool层操作的结果,h

per

(

·

)表示维度置换操作,z-pool(

·

)表示z-pool层的操作,h

cat

(

·

)表示在给定输入序列特征图中沿着特定维度进行连接的操作,h

mp

(

·

)和h

ap

(

·

)分别表示沿着特定维度的最大池化操作和平均池化操作,f7×7(

·

)表示卷积核大小为7

×

7的卷积操作,h

in

(

·

)表示实例归一化操作,δ(

·

)表示sigmoid函数,

·

表示按通道相乘操作。

[0036]

在一较佳的实施例中,所述空间注意力模块包括一个7

×

7卷积层、z-pool层及实例归一化操作,具体的计算公式如下:

[0037][0038]

其中x3、表示空间注意力模块的输入特征和输出特征。

[0039]

在一较佳的实施例中,所述高效swin transformer模块由两个层归一化操作、一个基于移动窗口的自注意力计算模块、一个局部特征提取前馈网络和残差连接构成;

[0040]

高效swin transformer模块的计算公式如下:

[0041]

q=ln(wqx)

[0042]

k=ln(wkx)

[0043]

v=ln(wvx)

[0044][0045][0046][0047]

其中,wq、wk、wv表示计算q,k,v的变换矩阵,ln(

·

)表示层归一化操作,q,k,v分别

表示查询、键和值矩阵,softmax(

·

)表示softmax函数,sw-msa(

·

)表示移动窗口自注意力模块,leff(

·

)表示局部增强多层感知器模块,表示高效swin transformer模块的输出特征,d表示k矩阵的维度,attention表示自注意力计算。

[0048]

本发明还提供了基于残差混合注意力网络的图像超分辨率重建方法,采用了所述的基于残差混合注意力网络的图像超分辨率重建模型,包括以下步骤:

[0049]

步骤s1:根据图像退化模型建立训练集,得到n个低分辨率图像i

lr

和与n个低分辨率图像i

lr

对应的真实高分辨率图像i

hr

;其中,n为大于1的整数;

[0050]

步骤s2:将所述低分辨率图像输入到浅层特征提取模块以提取图像的浅层特征;

[0051]

步骤s3:将浅层特征输入深层特征提取模块提取深层特征;

[0052]

步骤s4:将所述深层特征输入重建模块,进行亚像素卷积完成上采样处理,并重建出最后的高分辨率图像;

[0053]

步骤s5:通过损失函数对所述图像超分辨率重建模型进行优化,所述损失函数使用n个重建高分辨率图像与对应真实高分辨率图像间的平均l1误差,表达式为:

[0054][0055]

其中,l1表示l1损失函数。

[0056]

与现有技术相比,本发明具有以下有益效果:本发明将卷积神经网络和transformer结合起来,采用通道分离技术,将特征图拆分,并行地送入两个分支模块进行处理。通过残差分离混合注意力模块,融合基于卷积神经网络的三重注意力模块提取的局部特征和基于transformer的高效swin transformer模块提取的全局特征,得到丰富的高、低频信息。通过本发明的方法,可以获得细节更丰富的图像,实现更高精度的超分辨率重建。

附图说明

[0057]

图1是本发明优选实施例中的残差分离混合注意力网络结构图;

[0058]

图2是本发明优选实施例中的残差分离混合注意力组结构图;

[0059]

图3是本发明优选实施例中的残差分离混合注意力模块结构图;

[0060]

图4是本发明优选实施例中的残差三重注意力模块结构图;

[0061]

图5是本发明优选实施例中的高效swin transformer模块结构图;

[0062]

图6是本发明优选实施例的图像超分辨率重建方法的流程示意图。

具体实施方式

[0063]

下面结合附图及实施例对本发明做进一步说明。

[0064]

应该指出,以下详细说明都是例示性的,旨在对本技术提供进一步的说明。除非另有指明,本文使用的所有技术和科学术语具有与本技术所属技术领域的普通技术人员通常理解的相同含义。

[0065]

需要注意的是,这里所使用的术语仅是为了描述具体实施方式,而非意图限制根据本技术的示例性实施方式;如在这里所使用的,除非上下文另外明确指出,否则单数形式

也意图包括复数形式,此外,还应当理解的是,当在本说明书中使用术语“包含”和/或“包括”时,其指明存在特征、步骤、操作、器件、组件和/或它们的组合。

[0066]

如图1至6所示,本实施例提供了一种基于残差分离混合注意力网络的图像超分辨率重建模型,其中模型包括:浅层特征提取模块、深层特征提取模块和重建模块。浅层特征提取模块对低分辨率图像进行浅层特征的提取;深层特征提取模块由多个级联残差分离混合注意力组和全局残差连接组成,对浅层特征进行特征提取和融合,得到深层特征;重建模块使用亚像素卷积层对深层特征进行上采样,得到更高分辨率的图像。残差分离混合注意力模块采用通道分离技术将特征图拆分,并行地送入两个分支模块进行处理,融合残差三重注意力模块提取的局部特征和高效swin transformer模块提取的全局特征,得到丰富的高低频信息。

[0067]

步骤1,对输入图像进行浅层特征提取,具体为:

[0068]

利用卷积层擅于提取特征的特点,使用一个3

×

3卷积层提取低分辨率输入图像的浅层特征,具体操作如下:

[0069]

m0=h

sf

(i

lr

)

[0070]

其中h

sf

(

·

)表示浅层特征提取模块,i

lr

表示输入的低分辨率图像,m0表示浅层特征图;

[0071]

步骤2,将浅层特征通过多个级联残差分离混合注意力组和全局残差连接组成的深层特征提取模块,进行特征提取和特征融合,得到深层特征:

[0072]

步骤2.1,如图2所示,通过将浅层特征输入由n个级联残差分离混合注意力组与全局残差连接组成的深层特征提取模块,可以对浅层特征进行特征提取和特征融合,得到更丰富、更深层次的特征,其中级联残差分离混合注意力组包含m个级联残差分离混合注意力模块,本实例中取n=6,m=6。具体计算由下式表示:

[0073][0074]mdf

=f3×3(mn)

[0075]

其中表示第i个多重残差分离混合注意力组,n表示多重混合注意力残差组的数量,m

i-1

、mi、mn表示多重残差分离混合注意力组的中间特征图,f3×3(

·

)表示卷积核大小为3

×

3的卷积操作,m

df

表示深层特征图。

[0076]

图3为残差分离混合注意力模块的结构图,该模块包含1个残差三重注意力模块、1个高效swin transformer模块、两个1

×

1卷积层和通道拆分和连接操作,它的计算由下式表示:

[0077]

x1,x2=h

spl

(f1×1(x))

[0078]

y1=rtab(x1)

[0079]

y2=estb(x2)

[0080]

z=f1×1(h

cat

(y1,y2))+x

[0081]

其中,x表示残差分离混合注意力模块的输入特征,f1×1(

·

)表示1

×

1卷积层,h

spl

(

·

)表示通道拆分的操作,x1、x2表示拆分后的特征图,rtab表示残差三重注意力模块的操作,y1表示残差三重注意力模块的输出特征,estb表示高效swin transformer模块的操作,y2表示高效swin transformer模块的输出特征,h

cat

(

·

)表示通道拼接的操作,z表示残差

分离混合注意力模块的输出特征。

[0082]

图4为残差三重注意力模块的结构图,该模块包含一个两个3

×

3卷积层、relu激活函数、三重注意力模块、平均池化操作和残差连接。残差三重注意力模块通过利用特征图不同维度之间的相关性,充分利用cnn擅长提取固有特征的优势,使得网络可以学习更加丰富的图像信息,它的计算由下式表示:

[0083]

xo=f

tam

(f3×3(relu(f3×3(xi))))+x

[0084]

其中,xi表示残差三重注意力模块的输入特征,xo表示残差三重注意力模块的输出特征,f

tam

(

·

)表示三重注意力模块的操作,relu(

·

)表示relu激活函数。三重注意力模块由两个跨维度交互模块和一个空间注意力模块构成,具体计算公式表达式如下:

[0085][0086]

其中表示两个跨维度交互模块的输出特征,表示空间注意力模块的输出特征,y表示三重注意力模块的输出特征。跨维度交互模块包括一个7

×

7卷积层、维度置换操作、z-pool层、通道连接操作、最大池化操作、平均池化操作。具体的计算公式如下:

[0087]

x

′1=h

per

(x1)

[0088]

z-pool(x)=h

cat

(h

mp

(x),h

ao

(x))

[0089]

x

″1=z-pool(x

′1)

[0090][0091][0092]

其中,x

′1表示维度置换操作的结果,x

″1表示经过z-pool层操作的结果,h

per

(

·

)表示维度置换操作,z-pool(

·

)表示z-pool层的操作,h

cat

(

·

)表示在给定输入序列特征图中沿着特定维度进行连接的操作,h

mp

(

·

)和h

ap

(

·

)分别表示沿着特定维度的最大池化操作和平均池化操作,f7×7(

·

)表示卷积核大小为7

×

7的卷积操作,h

in

(

·

)表示实例归一化操作,δ(

·

)表示sigmoid函数,

·

表示按通道相乘操作,表示跨维度交互模块的输出特征。

[0093]

空间注意力模块包括一个7

×

7卷积层、z-pool层、实例归一化操作,具体的计算公式如下:

[0094][0095]

其中x3、表示空间注意力模块的输入特征和输出特征。

[0096]

图5为高效swin transformer模块的结构图,该模块包括两个层归一化操作、一个移动窗口自注意力模块、一个局部增强多层感知器模块和残差连接操作。它的计算由下式表示:

[0097]

q=ln(wqx)

[0098]

k=ln(wkx)

[0099]

v=ln(wvx)

[0100][0101][0102][0103]

其中,wq、wk、wv表示计算q,k,v的变换矩阵,d表示k矩阵的维度,attention表示自注意力计算,ln(

·

)表示层归一化操作,q,k,v表示查询、键和值矩阵,softmax(

·

)表示softmax函数,sw-msa(

·

)表示移动窗口自注意力模块,leff(

·

)表示局部增强多层感知器模块,表示高效swin transformer模块的输出特征。

[0104]

步骤3,对深层特征图进行重建,通过上采样预测的特征图重构为高分辨率图像,表达式如下:

[0105]isr

=h

up

(m

df

+m0)+bicubic(i

lr

)

[0106]

其中i

sr

表示超分辨率重建后的高分辨率图像,h

up

(

·

)表示重建模块,bicubic(

·

)表示对低分辨率图像进行双三次插值至目标分辨率。

[0107]

一种应用于上述图像超分辨率重建模型上的图像超分辨率重建方法,其具体内容如下所述。

[0108]

s1.根据图像退化模型建立训练集,得到n个低分辨率图像i

lr

和与n个低分辨率图像i

lr

对应的真实高分辨率图像i

hr

;其中,n为大于1的整数;

[0109]

s2.将所述低分辨率图像输入到浅层特征提取模块以提取图像的浅层特征;

[0110]

s3.将浅层特征输入深层特征提取模块提取深层特征;

[0111]

s4.将所述深层特征输入重建模块,进行亚像素卷积完成上采样处理,并重建出最后的高分辨率图像;

[0112]

s5.通过损失函数对所述图像超分辨率重建模型进行优化,所述损失函数使用n个重建高分辨率图像与对应真实高分辨率图像间的平均l1误差,表达式为:

[0113][0114]

其中,l1表示l1损失函数。

[0115]

为了更好地说明本发明的有效性,本发明实施例还采用对比实验的方式进行重建效果的比较。

[0116]

具体地,本发明实施例使用div2k中800幅高分辨率图像作为训练集,测试集分别使用set5,set14,b100,urban100,manga109。对原始高分辨率图像进行双三次下采样,得到相应的低分辨率图像。

[0117]

当构建好训练集后,在pytorch框架上进行模型的训练和测试。将训练集中低分辨率图像裁剪成64

×

64的图像块,每次随机输入48个64

×

64的图像块组,训练500个epoch。使用adam梯度下降法实现网络参数的优化,其中adam优化器的参数设置为β1=0.9,β2=0.999,ε=10-8

。学习率的初始设置为2

×

10-4

,并在第{250,400,425,450,475}个epoch之后缩小一半。rshab数目设置为36,通道数设置为180。使用峰值信噪比(psnr)和结构相似性

(ssim)来评估模型性能。本发明使用set5,set14,b100,urban100,manga109五个基准数据集来测试模型性能,对比实验选取了11个具有代表性的图像超分辨率重建方法与本发明的实验结果进行比较,实验结果如表1所示,其中rshan为本发明提出的方法。

[0118]

表1.在5个测试集上的平均psnr和ssim值比较

[0119][0120]

综上所述,本发明相对于现有技术具有如下的优点及效果:

[0121]

(1)本发明实施例通过采用残差分离混合注意力模块,将基于卷积神经网络的残差三重注意力模块的局部建模能力和高效swin transformer模块的非局部建模能力结合起来。在保证参数数量与目前性能最好的重建模型类似的前提下,有效地利用图像不同维度之间的信息关系,显著提高了超分辨率重建模型提取高频信息的能力,同时利用捕获的远距离依赖关系,使得提取的特征更加丰富。

[0122]

(2)本发明实施例通过采用全局残差内嵌级联残差的结构,使得网络能绕过低分辨率输入中的低频信息,学习更多高频残差信息,获取丰富的细节特征。并且不需要建立很深的网络,也能获得效果不错的高分辨率重建图像。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1