视频处理方法、装置、电子设备、存储介质及程序产品与流程

1.本技术涉及视频处理技术,尤其涉及一种虚拟场景的视频处理方法、装置、电子设备、计算机可读存储介质及计算机程序产品。

背景技术:

2.基于图形处理硬件的显示技术,扩展了感知环境以及获取信息的渠道,尤其是虚拟场景的多媒体技术,借助与人机交互引擎技术,能够根据实际应用需求实现受控于用户或人工智能的虚拟对象之间的多样化的交互,具有各种典型的应用场景,例如在游戏等虚拟场景中,能够模拟虚拟对象之间的真实的对战过程。

3.相关技术中会在虚拟场景中通过视频数据对推荐信息进行曝光,希望可以借助虚拟场景以及视频数据提高用户针对推荐信息的感知效率,但是相关技术中包括推荐信息的视频数据往往和虚拟场景存在内容上的割裂,难以真正将推荐信息与虚拟场景关联,因此用户难以像感知虚拟场景那样去感知推荐信息,无法提升针对推荐信息的感知效率。

技术实现要素:

4.本技术实施例提供一种虚拟场景的视频处理方法、装置、电子设备、计算机可读存储介质及计算机程序产品,能够将推荐信息的视频数据与虚拟场景之间进行无缝融合,提升播放视频时用户的感兴趣程度,从而提高针对推荐信息的推荐效率。

5.本技术实施例的技术方案是这样实现的:

6.本技术实施例提供一种虚拟场景的视频处理方法,包括:

7.获取第一视频数据,其中所述第一视频数据包括推荐信息;

8.获取所述虚拟场景中的虚拟元素;

9.将所述第一视频数据与所述虚拟元素进行融合处理,得到第二视频数据;

10.获取所述虚拟场景的第三视频数据,其中,所述第三视频数据包括所述虚拟场景的运行画面;

11.向终端发送所述第二视频数据以及所述第三视频数据,以使所述终端进行播放。

12.本技术实施例提供一种虚拟场景的视频处理装置,包括:

13.第一获取模块,用于获取第一视频数据,其中所述第一视频数据包括推荐信息;

14.第二获取模块,用于获取所述虚拟场景中的虚拟元素;

15.融合模块,用于将所述第一视频数据与所述虚拟元素进行融合处理,得到第二视频数据;

16.第三获取模块,用于获取所述虚拟场景的第三视频数据,其中,所述第三视频数据包括所述虚拟场景的运行画面;

17.发送模块,用于向终端发送所述第二视频数据以及所述第三视频数据,以使所述终端进行播放。

18.在上述方案中,在获取第一视频数据之前,所述第一获取模块,还用于获取目标账

号的账号特征以及多个候选信息的信息特征,并确定每个所述候选信息的信息特征与所述账号特征之间的第一特征距离,其中,所述目标账号是控制所述虚拟场景中虚拟对象的账号;基于所述第一特征距离对所述多个候选信息进行升序排序,并将排序在首位的候选信息作为所述推荐信息。

19.在上述方案中,在获取第一视频数据之前,所述第一获取模块,还用于获取所述虚拟场景的实时场景特征以及多个候选信息的信息特征,并确定每个所述候选信息的信息特征与所述实时场景特征之间的第二特征距离;基于所述第二特征距离对所述多个候选信息进行升序排序,并将排序在首位的候选信息作为所述推荐信息。

20.在上述方案中,所述融合模块,还用于:获取所述虚拟场景的虚拟对象以及所述虚拟场景的背景图像,作为所述虚拟元素;对所述虚拟场景的背景图像进行模糊处理,得到待合成背景图像;对所述待合成背景图像以及所述第一视频数据进行合成处理,得到背景合成视频数据;将所述虚拟对象添加至所述背景合成视频数据中,得到所述第二视频数据。

21.在上述方案中,所述融合模块,还用于:获取所述待合成背景图像中每个背景位置的待合成背景像素;针对所述第一视频数据中每个第一视频帧执行以下任意一种处理:获取所述第一视频帧的背景画面的多个背景像素,保持所述第一视频帧的前景画面的多个前景像素不变,利用所述待合成背景像素替换所述第一视频帧中相同背景位置的背景像素,得到背景合成视频帧;获取所述第一视频帧的背景画面的多个背景像素,保持所述第一视频帧的前景画面的多个前景像素不变,将所述待合成背景像素与所述第一视频帧中相同背景位置的背景像素进行合成处理,得到背景合成视频帧;对多个所述背景合成视频帧进行编码处理,得到所述背景合成视频数据。

22.在上述方案中,所述融合模块,还用于:获取对应所述第一视频数据的第一音频数据,并对所述第一音频数据进行解码处理,得到所述第一音频数据中的每个音频帧;获取所述虚拟对象的脸部特征以及动作特征,其中,所述脸部特征以及所述动作特征与所述第一音频数据中每个所述音频帧匹配;针对每个所述音频帧执行以下处理:利用与所述音频帧匹配的脸部特征以及动画特征进行特效渲染处理,得到包括所述虚拟对象的对象视频帧;从所述背景合成视频数据中提取对应所述音频帧的背景合成视频帧,并将所述对象视频帧与所述背景合成视频帧进行融合处理,得到对应所述音频帧的对象合成视频帧;将与多个所述音频帧一一对应的对象合成视频帧进行编码处理,得到所述第二视频数据。

23.在上述方案中,所述第二获取模块,还用于:将满足以下条件至少之一的虚拟对象,作为所述虚拟场景的虚拟元素:所述虚拟对象是目标账号曾经在所述虚拟场景中控制的虚拟对象;所述虚拟对象是所述虚拟场景中被控制总次数最多的虚拟对象;所述虚拟对象是所述虚拟场景中被所述目标账号控制次数最多的虚拟对象。

24.在上述方案中,所述发送模块,还用于当所述虚拟场景处于加载阶段时,向所述终端发送所述第二视频数据;当所述虚拟场景加载完成时,停止向所述终端发送所述第二视频数据,并向所述终端发送所述第三视频数据;在所述虚拟场景的运行过程中,当接收到所述终端发送的针对所述第三视频数据的暂停指令时,停止向所述终端发送所述第二视频数据,并继续向所述终端发送所述第二视频数据。

25.本技术实施例提供一种虚拟场景的视频处理方法,包括:

26.响应于针对所述虚拟场景的启动操作,显示所述虚拟场景的加载界面;

27.在所述加载界面中播放第二视频数据,其中,所述第二视频数据包括推荐信息和所述虚拟场景中的至少一个虚拟元素;

28.响应于所述虚拟场景的加载完成,取消播放所述第二视频数据,并播放所述第三视频数据,其中,所述第三视频数据包括所述虚拟场景的运行画面。

29.本技术实施例提供一种虚拟场景的视频处理装置,包括:

30.显示模块,用于响应于针对所述虚拟场景的启动操作,显示所述虚拟场景的加载界面;

31.播放模块,用于在所述加载界面中播放第二视频数据,其中,所述第二视频数据包括推荐信息和所述虚拟场景中的至少一个虚拟元素;

32.所述播放模块,还用于响应于所述虚拟场景的加载完成,取消播放所述第二视频数据,并播放所述第三视频数据,其中,所述第三视频数据包括所述虚拟场景的运行画面。

33.在上述方案中,所述虚拟元素包括所述虚拟场景的背景和所述虚拟场景的虚拟对象,所述第二视频数据包括处于所述背景中的虚拟对象,所述播放模块,还用于:在所述加载界面中显示所述虚拟对象实施对象动作以及播报第一音频数据;其中,所述第一音频数据是用于介绍所述推荐信息的音频数据,所述对象动作是所述虚拟对象在所述虚拟场景中的动作。

34.在上述方案中,所述播放所述第三视频数据之后,所述播放模块,还用于:响应于满足所述第三视频数据的取消播放条件,取消播放所述第三视频数据,并继续播放所述第二视频数据。

35.在上述方案中,所述播放模块,还用于:当距离当前时刻最近一次播放的第二视频数据具有未播放的接续内容时,播放对应所述接续内容的第二视频数据,其中,所述接续内容包括所述推荐信息,所述当前时刻是满足所述取消播放条件的时刻;当距离当前时刻最近一次播放的第二视频数据不具有未播放的接续内容时,播放包括另一个推荐信息的第二视频数据。

36.在上述方案中,所述播放模块,还用于:执行以下处理中任意一种:在人机交互界面中播放所述第二视频数据;显示第二视频数据播放入口,响应于针对所述第二视频数据播放入口的触发操作,在所述人机交互界面中播放所述第二视频数据;响应于满足所述第二视频数据的自动播放条件,在所述人机交互界面中播放所述第二视频数据。

37.在上述方案中,在响应于满足所述第二视频数据的自动播放条件,在所述人机交互界面中播放所述第二视频数据之前,所述播放模块,还用于:获取决策参考数据,其中,所述决策参考数据包括以下至少之一:目标账号的历史操作数据、所述目标账号的账号属性数据、所述虚拟场景的场景数据,所述目标账号是控制所述虚拟场景中虚拟对象的账号;调用第一神经网络模型执行以下处理:从所述决策参考数据中提取决策参考特征,并基于所述决策参考特征预测所述目标账号针对所述第二视频数据的偏好程度;当所述偏好程度小于偏好程度阈值时,确定满足所述第二视频数据的自动播放条件。

38.在上述方案中,在响应于满足所述第二视频数据的自动播放条件,在所述人机交互界面中播放所述第二视频数据之前,所述播放模块,还用于:从历史播放记录中获取在每次播放所述第二视频数据的历史时刻,并提取所述历史时刻的历史场景特征;对多个所述历史时刻的历史场景特征进行融合处理,得到融合场景特征;获取所述虚拟场景的当前场

景数据,并提取所述当前场景数据的当前场景特征;当所述当前场景特征与所述融合场景特征的相似度大于相似度阈值时,确定满足所述第二视频数据的自动播放条件。

39.在上述方案中,所述播放模块,还用于:执行以下处理中任意一种处理:当所述第三视频数据处于缓冲阶段时,确定满足所述取消播放条件;响应于目标账号针对所述第三视频数据的暂停操作,确定满足所述取消播放条件;响应于目标账号针对所述虚拟场景的设置操作,确定满足所述取消播放条件;其中,所述目标账号是控制所述虚拟场景中虚拟对象的账号。

40.在上述方案中,所述第二视频数据的显示样式的显著程度与第一特征参数负相关;其中,所述第一特征参数包括以下至少之一:目标账号的活跃程度、所述目标账号的等级、所述目标账号在所述虚拟场景的历史成绩、所述第二视频数据在所述虚拟场景中的播放次数;所述目标账号是控制所述虚拟场景中虚拟对象的账号。

41.本技术实施例提供一种电子设备,包括:

42.存储器,用于存储计算机可执行指令;

43.处理器,用于执行所述存储器中存储的计算机可执行指令时,实现本技术实施例提供的虚拟场景的视频处理方法。

44.本技术实施例提供一种计算机可读存储介质,存储有计算机可执行指令,用于被处理器执行时,实现本技术实施例提供的虚拟场景的视频处理方法。

45.本技术实施例提供一种计算机程序产品,包括计算机程序或计算机可执行指令,所述计算机程序或计算机可执行指令被处理器执行时,实现本技术实施例提供的虚拟场景的视频处理方法。

46.本技术实施例具有以下有益效果:

47.通过本技术实施例将虚拟场景中的虚拟元素融合到包括推荐信息的第一视频数据中,得到的第二视频数据中包括虚拟场景相关的元素,使得推荐信息通过虚拟场景元素与第三视频数据自然地融合,因此,不管是播放第二视频数据还是播放第三视频数据,都不会在内容层面出现割裂感,可以提升播放视频时用户的感兴趣程度,从而提高针对推荐信息的推荐效率。

附图说明

48.图1a是本技术实施例提供的虚拟场景的视频处理方法的应用模式示意图;

49.图1b是本技术实施例提供的虚拟场景的视频处理方法的应用模式示意图;

50.图2是本技术实施例提供的电子设备的结构示意图;

51.图3是本技术实施例提供的电子设备的结构示意图;

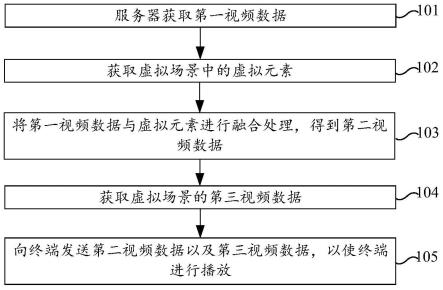

52.图4a-4d是本技术实施例提供的虚拟场景的视频处理方法的流程示意图;

53.图5是本技术实施例提供的虚拟场景的视频处理方法的界面示意图;

54.图6是本技术实施例提供的虚拟场景的视频处理方法的界面示意图;

55.图7是本技术实施例提供的虚拟场景的视频处理方法的界面示意图;

56.图8是本技术实施例提供的虚拟场景的视频处理方法的流程图;

57.图9是本技术实施例提供的虚拟场景的视频处理方法的流程图;

58.图10是本技术实施例提供的虚拟场景的视频处理方法的流程图;

59.图11是本技术实施例提供的虚拟场景的视频处理方法的流程图。

具体实施方式

60.为了使本技术的目的、技术方案和优点更加清楚,下面将结合附图对本技术作进一步地详细描述,所描述的实施例不应视为对本技术的限制,本领域普通技术人员在没有做出创造性劳动前提下所获得的所有其它实施例,都属于本技术保护的范围。

61.在以下的描述中,涉及到“一些实施例”,其描述了所有可能实施例的子集,但是可以理解,“一些实施例”可以是所有可能实施例的相同子集或不同子集,并且可以在不冲突的情况下相互结合。

62.在以下的描述中,所涉及的术语“第一\第二\第三”仅仅是是区别类似的对象,不代表针对对象的特定排序,可以理解地,“第一\第二\第三”在允许的情况下可以互换特定的顺序或先后次序,以使这里描述的本技术实施例能够以除了在这里图示或描述的以外的顺序实施。

63.除非另有定义,本文所使用的所有的技术和科学术语与属于本技术的技术领域的技术人员通常理解的含义相同。本文中所使用的术语只是为了描述本技术实施例的目的,不是旨在限制本技术。

64.对本技术实施例进行进一步详细说明之前,对本技术实施例中涉及的名词和术语进行说明,本技术实施例中涉及的名词和术语适用于如下的解释。

65.1)云游戏:游戏运行在服务端,服务端将压缩编码后的游戏画面传输给客户端,客户端进行显示。

66.2)高斯模糊:降低图像清晰度、减少图像层次和细节,对图像进行模糊的一种技术。

67.3)虚拟场景:利用设备输出的区别于现实世界的场景,通过裸眼或设备的辅助能够形成对虚拟场景的视觉感知,例如通过显示屏幕输出的二维影像,通过立体投影、虚拟现实和增强现实技术等立体显示技术来输出的三维影像;此外,还可以通过各种可能的硬件形成听觉感知、触觉感知、嗅觉感知和运动感知等各种模拟现实世界的感知。

68.4)虚拟对象:虚拟场景中进行交互的对象,受到用户或机器人程序(例如,基于人工智能的机器人程序)的控制,能够在虚拟场景中静止、移动以及进行各种行为的对象,例如游戏中的各种角色等。

69.相关技术中会在虚拟场景中通过视频数据对推荐信息进行曝光,希望可以借助虚拟场景以及视频数据提高用户针对推荐信息的感知效率,但是相关技术中包括推荐信息的视频数据往往和虚拟场景存在内容上的割裂,难以真正将推荐信息与虚拟场景关联,推荐信息的视频数据和虚拟场景内容有着较强的割裂感,因此用户难以像感知虚拟场景那样去感知推荐信息,无法提升针对推荐信息的感知效率,进而无法提升针对推荐信息的推荐效率。

70.相关技术中客户端在特定位置配置显示位,启动客户端之后,在显示位进行推荐信息曝光,或者需要用户手动操作滑动至指定页面后才能够在指定页面播放推荐信息的视频数据,通常用户浏览或者点击意愿不强,导致推荐信息的曝光较低。

71.针对上述技术问题,本技术实施例提供一种虚拟场景的视频处理方法、装置、电子

设备、计算机可读存储介质及计算机程序产品,能够降低推荐信息的视频数据与虚拟场景之间的割裂感,可以提升播放视频时用户的感兴趣程度,从而提高针对推荐信息的推荐效率。

72.下面说明本技术实施例提供的电子设备的示例性应用,本技术实施例提供的电子设备可以实施为终端,也可以实施为服务器。

73.为便于更容易理解本技术实施例提供的虚拟场景的视频处理方法,首先说明本技术实施例提供的虚拟场景的视频处理方法的示例性实施场景。终端运行客户端,在客户端的运行过程中输出包括有角色扮演的虚拟场景,虚拟场景是供游戏角色交互的环境,例如可以是城市街道的作战游戏环境;虚拟场景中包括虚拟对象,虚拟对象可以是受用户(或称玩家)控制的游戏角色,即虚拟对象受控于真实玩家,将响应于真实玩家针对控制器(包括触控屏、声控开关、键盘、鼠标和摇杆等)的操作而在虚拟场景中运动。举例来说,虚拟对象受用户控制在虚拟场景中移动并执行攻击、防守等一系列操作。

74.在一个实施场景中,参见图1a,图1a是本技术实施例提供的虚拟场景的视频处理方法的应用模式示意图,适用于一些游戏完全运行于服务器200的云游戏场景。一般地,适用于依赖服务器200的计算能力完成虚拟场景计算、并在终端400输出虚拟场景的应用模式。

75.在一些实施例中,响应于终端400接收到用户运行客户端的操作,终端400将客户端启动数据发送至服务器200,服务器200从广告提供方500获取包括推荐信息的第一视频数据(例如,从广告提供方拉取的原生广告视频),服务器200获取虚拟场景中的虚拟元素,并将第一视频数据与虚拟元素进行融合处理,得到第二视频数据,服务器200还会通过游戏引擎的渲染计算得到包括虚拟场景的运行画面的第三视频数据,具体而言,服务器200通过图形计算硬件计算显示所需要的数据,并完成显示数据的加载、解析和渲染,在图形输出硬件输出能够对虚拟场景形成视觉感知的视频帧,在服务器渲染计算第三视频数据的过程中,服务器200通过网络300向终端400发送融合有虚拟元素的第二视频数据,终端400播放第二视频数据,当服务器计算得到第三视频数据时,服务器200向终端400停止发送第二视频数据并向终端400发送第三视频数据,终端400播放第三视频数据。

76.在一些实施例中,终端400可以通过运行计算机程序来实现本技术实施例提供的虚拟场景的视频处理方法,例如,计算机程序可以是操作系统中的原生程序或软件模块;可以是本地(native)应用程序(app,application),即需要在操作系统中安装才能运行的程序,例如游戏app(即上述的客户端);也可以是小程序,即只需要下载到浏览器环境中就可以运行的程序;还可以是能够嵌入至任意app中的游戏小程序。总而言之,上述计算机程序可以是任意形式的应用程序、模块或插件。

77.本技术实施例可以借助于云技术(cloud technology)实现,云技术是指在广域网或局域网内将硬件、软件、网络等系列资源统一起来,实现数据的计算、储存、处理和共享的一种托管技术。

78.云技术是基于云计算商业模式应用的网络技术、信息技术、整合技术、管理平台技术、以及应用技术等的总称,可以组成资源池,按需所用,灵活便利。云计算技术将变成重要支撑。技术网络系统的后台服务需要大量的计算、存储资源。

79.作为示例,服务器200可以是独立的物理服务器,也可以是多个物理服务器构成的

服务器集群或者分布式系统,还可以是提供云服务、云数据库、云计算、云函数、云存储、网络服务、云通信、中间件服务、域名服务、安全服务、cdn、以及大数据和人工智能平台等基础云计算服务的云服务器。终端400可以是智能手机、平板电脑、笔记本电脑、台式计算机、智能音箱、智能手表、智能语音交互设备、智能家电、车载终端、飞行器等,但并不局限于此。终端400以及服务器200可以通过有线或无线通信方式进行直接或间接地连接,本技术实施例中不做限制。

80.在一些实施例中,参见图1b,图1b是本技术实施例提供的虚拟场景的形象处理系统的结构示意图,下面说明本技术实施例基于区块链网络的示例性应用。参见图1b,包括区块链网络600(示例性示出了区块链网络600包括的节点610-1、节点610-2)、服务器200、以及终端400,下面分别进行说明。

81.服务器200(映射为节点610-2)以及终端400(映射为节点610-1)均可以加入区块链网络600而成为其中的节点,图1b中示例性地示出了将终端400映射为区块链网络600的节点610-1,每个节点(例如节点610-1、节点610-2)都具有共识功能和记账(即维护状态数据库库,例如键值数据库)的功能。

82.每个节点(例如节点610-1)的状态数据库中记录有服务器400拉取的第二视频数据(融合有虚拟元素的广告视频),以使终端400可以查询状态数据库中记录的第二视频数据。

83.在一些实施例中,响应于接收到虚拟场景的加载请求,多个服务器200(每个服务器映射为区块链网络中的一个节点)获取第二视频数据(融合有虚拟元素的广告视频),针对第二视频数据,共识通过的节点数目超过节点数目阈值时,确定共识通过,服务器200(映射为节点610-2)将共识通过的第二视频数据发送至终端400(映射为节点610-1),并呈现在终端400的人机交互界面,并将第二视频数据进行上链存储。由于第二视频数据是经过多个服务器进行共识后得到的,因此可以确保原生广告的合法可靠性,又因为区块链网络的不易篡改的特性,因此上链存储的第二视频数据不会被恶意篡改。

84.参见图2,图2是本技术实施例提供的电子设备的结构示意图,以电子设备是终端为例进行说明,图2所示的终端400包括:至少一个处理器410、存储器450、至少一个网络接口420和用户接口430。终端400中的各个组件通过总线系统440耦合在一起。可理解,总线系统440用于实现这些组件之间的连接通信。总线系统440除包括数据总线之外,还包括电源总线、控制总线和状态信号总线。但是为了清楚说明起见,在图2中将各种总线都标为总线系统440。

85.处理器410可以是一种集成电路芯片,具有信号的处理能力,例如通用处理器、数字信号处理器(dsp,digital signal processor),或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等,其中,通用处理器可以是微处理器或者任何常规的处理器等。

86.用户接口430包括使得能够呈现媒体内容的一个或多个输出装置431,包括一个或多个扬声器和/或一个或多个视觉显示屏。用户接口430还包括一个或多个输入装置432,包括有助于用户输入的用户接口部件,比如键盘、鼠标、麦克风、触屏显示屏、摄像头、其他输入按钮和控件。

87.存储器450可以是可移除的,不可移除的或其组合。示例性的硬件设备包括固态存

储器,硬盘驱动器,光盘驱动器等。存储器450可选地包括在物理位置上远离处理器410的一个或多个存储设备。

88.存储器450包括易失性存储器或非易失性存储器,也可包括易失性和非易失性存储器两者。非易失性存储器可以是只读存储器(rom,read only memory),易失性存储器可以是随机存取存储器(ram,random access memory)。本技术实施例描述的存储器450旨在包括任意适合类型的存储器。

89.在一些实施例中,存储器450能够存储数据以支持各种操作,这些数据的示例包括程序、模块和数据结构或者其子集或超集,下面示例性说明。

90.操作系统451,包括用于处理各种基本系统服务和执行硬件相关任务的系统程序,例如框架层、核心库层、驱动层等,用于实现各种基础业务以及处理基于硬件的任务;

91.网络通信模块452,用于经由一个或多个(有线或无线)网络接口420到达其他计算设备,示例性的网络接口420包括:蓝牙、无线相容性认证(wifi)、和通用串行总线(usb,universal serial bus)等;

92.呈现模块453,用于经由一个或多个与用户接口430相关联的输出装置431(例如,显示屏、扬声器等)使得能够呈现信息(例如,用于操作外围设备和显示内容和信息的用户接口);

93.输入处理模块454,用于对一个或多个来自一个或多个输入装置432之一的一个或多个用户输入或互动进行检测以及翻译所检测的输入或互动。

94.在一些实施例中,本技术实施例提供的虚拟场景的视频处理装置可以采用软件方式实现,图2示出了存储在存储器450中的虚拟场景的视频处理装置455,其可以是程序和插件等形式的软件,包括以下软件模块:显示模块4551和播放模块4552,这些模块是逻辑上的,因此根据所实现的功能可以进行任意的组合或进一步拆分,将在下文中说明各个模块的功能。

95.参见图3,图3是本技术实施例提供的电子设备的结构示意图,以电子设备是服务器200为例,图3所示的服务器200包括:至少一个处理器210、存储器250、至少一个网络接口220。服务器200中的各个组件通过总线系统240耦合在一起。可理解,总线系统240用于实现这些组件之间的连接通信。总线系统240除包括数据总线之外,还包括电源总线、控制总线和状态信号总线。但是为了清楚说明起见,在图3中将各种总线都标为总线系统240。

96.处理器210可以是一种集成电路芯片,具有信号的处理能力,例如通用处理器、数字信号处理器(dsp,digital signal processor),或者其他可编程逻辑器件、分立门或者晶体管逻辑器件、分立硬件组件等,其中,通用处理器可以是微处理器或者任何常规的处理器等。

97.存储器250可以是可移除的,不可移除的或其组合。示例性的硬件设备包括固态存储器,硬盘驱动器,光盘驱动器等。存储器250可选地包括在物理位置上远离处理器210的一个或多个存储设备。

98.存储器250包括易失性存储器或非易失性存储器,也可包括易失性和非易失性存储器两者。非易失性存储器可以是只读存储器(rom,read only memory),易失性存储器可以是随机存取存储器(ram,random access memory)。本技术实施例描述的存储器250旨在包括任意适合类型的存储器。

99.在一些实施例中,存储器250能够存储数据以支持各种操作,这些数据的示例包括程序、模块和数据结构或者其子集或超集,下面示例性说明。

100.操作系统251,包括用于处理各种基本系统服务和执行硬件相关任务的系统程序,例如框架层、核心库层、驱动层等,用于实现各种基础业务以及处理基于硬件的任务;

101.网络通信模块252,用于经由一个或多个(有线或无线)网络接口220到达其他计算设备,示例性的网络接口220包括:蓝牙、无线相容性认证(wifi)、和通用串行总线(usb,universal serial bus)等。

102.在一些实施例中,本技术实施例提供的虚拟场景的视频处理装置可以采用软件方式实现,图3示出了存储在存储器250中的基于人工智能的数据处理装置255,其可以是程序和插件等形式的软件,包括以下软件模块:第一获取模块2551、第二获取模块2552、融合模块2553、第三获取模块2554以及发送模块2555,这些模块是逻辑上的,因此根据所实现的功能可以进行任意的组合或进一步拆分,将在下文中说明各个模块的功能。

103.本技术实施例提供的虚拟场景的视频处理方法可以由服务器200执行。参见图4a,图4a是本技术实施例提供的虚拟场景的视频处理方法的流程示意图,将结合图4a示出的步骤进行说明。需要说明的是,图4a示出的方法可以由服务器200运行的各种形式计算机程序执行。

104.在步骤101中,服务器获取第一视频数据。

105.作为示例,本技术实施例涉及到的视频数据默认包括音频数据,第一视频数据包括推荐信息,推荐信息可以为广告信息等希望曝光给用户的信息,在获取第一视频数据之前,可以执行以下处理从候选信息中获取推荐信息,从而可以获取包括推荐信息的完整广告视频数据,例如,完整广告视频数据是15秒的视频,第一视频数据可以是完整广告视频数据中的部分视频数据或者全部视频数据,获取目标账号的账号特征以及多个候选信息的信息特征,目标账号是控制虚拟场景中虚拟对象的账号,即目标账号是当前使用终端来体验虚拟场景的用户使用的账号,账号特征包括并不限于以下至少之一:表征账号的浏览记录的特征、表征账号的属性数据的特征,候选信息的信息特征包括并不限于以下至少之一:表征候选信息的类型的特征、表征候选信息的价格的特征、表征候选信息的推广人群的特征,并确定每个候选信息的信息特征与账号特征之间的第一特征距离,由于特征可以采取向量的形式来表示,因此第一特征距离可以利用两个向量之间的距离来表征,基于第一特征距离对多个候选信息进行升序排序,并将排序在首位的候选信息作为推荐信息,每次获取第一视频数据时可以获取一个推荐信息的至少一个广告视频,还可以获取排序在前的多个推荐信息的多个广告视频。通过本技术实施例可以获取符合用户兴趣的第一视频数据,从而提高针对推荐信息的推荐效率。

106.作为示例,第一视频数据包括推荐信息,推荐信息可以为广告信息等希望曝光给用户的信息,在获取第一视频数据之前,可以执行以下处理从候选信息中获取推荐信息,从而可以获取包括推荐信息的完整广告视频数据,例如,完整广告视频数据是15秒的视频,第一视频数据可以是完整广告视频数据中的部分视频数据或者全部视频数据,获取虚拟场景的实时场景特征以及多个候选信息的信息特征,场景特征包括并不限于以下至少之一:表征虚拟场景的环境数据的特征、表征虚拟场景的面向人群数据的特征,候选信息的信息特征包括并不限于以下至少之一:表征候选信息的类型的特征、表征候选信息的价格的特征、

表征候选信息的推广人群的特征,并确定每个候选信息的信息特征与实时场景特征之间的第二特征距离,由于特征可以采取向量的形式来表示,因此第二特征距离可以利用两个向量之间的距离来表征;基于第二特征距离对多个候选信息进行升序排序,并将排序在首位的候选信息作为推荐信息,每次获取第一视频数据时可以获取一个推荐信息的至少一个广告视频,还可以获取排序在前的多个推荐信息的多个广告视频。通过本技术实施例可以获取与虚拟场景匹配的第一视频数据,从而可以获取符合用户兴趣的第一视频数据,从而提高针对推荐信息的推荐效率。

107.在步骤102中,获取虚拟场景中的虚拟元素。

108.作为示例,对虚拟场景中的虚拟元素进行识别处理,得到多个候选虚拟元素,对候选虚拟元素进行筛选处理,得到后续步骤中使用的虚拟元素,虚拟元素包括以下至少之一:虚拟场景的背景图像、虚拟场景中的虚拟对象。

109.在一些实施例中,步骤102中获取虚拟场景中的虚拟元素,可以通过以下技术方案实现:将满足以下条件至少之一的虚拟对象,作为虚拟场景的虚拟元素:虚拟对象是目标账号曾经在虚拟场景中控制的虚拟对象,例如是目标账号最近一次在虚拟场景中控制的虚拟对象,虚拟对象是虚拟场景中被控制总次数最多的虚拟对象,例如,虚拟场景中有10个虚拟对象,其中虚拟对象a在100次虚拟场景运行记录中,有80次被用户选中在虚拟场景中进行交互,是被控制总次数最多的虚拟对象,只要虚拟对象a被任意用户选中,控制次数记录增加1次;虚拟对象是虚拟场景中被目标账号控制次数最多的虚拟对象,例如,虚拟场景中有10个虚拟对象,其中虚拟对象a在100次虚拟场景运行记录中,有40次被目标账号选中在虚拟场景中进行交互,是被目标账号控制次数最多的虚拟对象,只要虚拟对象a被目标账号选中,控制次数记录增加1次。

110.作为示例,除了上述方式获取虚拟对象之外,还可以根据虚拟对象在第二视频数据中的出现频次来筛选,例如虚拟对象a被融入第二视频数据的频次为10次,将频次超过频次阈值的虚拟对象作为虚拟场景的虚拟元素,还可以根据目标账号的账号特征进行筛选,账号特征用于表征目标账号针对虚拟对象的偏好,将虚拟对象的对象特征与账号特征之间的特征距离小于特征距离阈值的虚拟对象作为虚拟元素。

111.通过本技术实施例可以多样化过滤出作为虚拟元素的虚拟对象,从而可以在提升广告视频与虚拟场景关联度的前提下,使得广告视频中具有更多符合用户兴趣的内容,提高针对推荐信息的推荐效率。

112.在步骤103中,将第一视频数据与虚拟元素进行融合处理,得到第二视频数据。

113.作为示例,直接将原始的虚拟元素与第一视频数据进行融合处理,或者对原始的虚拟元素进行基于设定维度的变化处理,得到变化结果,并将变化结果与第一视频数据进行融合处理,设定维度包括以下至少之一:虚拟元素的尺寸、虚拟元素的颜色、虚拟元素的着装、虚拟元素的动作、虚拟元素的表情,或者对原始的虚拟元素进行元素组合,得到组合结果,将组合结果与第一视频数据融合处理;或者,将第一视频数据与虚拟元素进行融合处理之后,在融合结果中增加其他装饰性元素,得到第二视频数据;或者,将第一视频数据与虚拟元素进行融合处理之后,对融合结果进行向推荐信息的风格迁移处理,得到第二视频数据。

114.在一些实施例中,参见图4b,图4b是本技术实施例提供的虚拟场景的视频处理方

法的流程示意图,虚拟元素包括虚拟场景的虚拟对象以及虚拟场景的背景图像,步骤103中将第一视频数据与虚拟元素进行融合处理,得到第二视频数据,可以通过图4b示出的步骤实现。

115.在步骤1031中,对虚拟场景的背景图像进行模糊处理,得到待合成背景图像。

116.作为示例,对虚拟场景的背景图像进行高斯模糊处理,得到待合成背景图像,待合成背景图像是将要融合到第一视频数据中的图像。

117.在步骤1032中,对待合成背景图像以及第一视频数据进行合成处理,得到背景合成视频数据。

118.在一些实施例中,步骤1032中对待合成背景图像以及第一视频数据进行合成处理,得到背景合成视频数据,可以通过以下技术方案实现:获取待合成背景图像中每个背景位置的待合成背景像素,待合成背景图像的尺寸与第一视频数据的第一视频帧的尺寸相同,第一视频帧是对第一视频数据进行解码处理得到的,针对第一视频数据中每个第一视频帧执行以下任意一种处理:获取第一视频帧的背景画面的多个背景像素,相当于获取对应第一视频帧的每个背景位置的背景像素,背景位置是第一视频帧中处于属于背景部分的位置,背景像素是处于背景位置的像素,保持第一视频帧的前景画面的多个前景像素不变,利用待合成背景像素替换第一视频帧中相同背景位置的背景像素,得到背景合成视频帧,即利用待合成背景图像中背景位置的背景像素替换掉第一视频帧中背景位置的背景像素,获取第一视频帧的背景画面的多个背景像素,保持第一视频帧的前景画面的多个前景像素不变,将待合成背景像素与第一视频帧中相同背景位置的背景像素进行合成处理,得到背景合成视频帧,合成处理可以是对两个背景像素进行颜色值平均处理,利用平均处理结果的像素替换掉第一视频帧中背景位置的背景像素;对多个背景合成视频帧进行合成编码处理,得到背景合成视频数据。通过本技术实施例可以将待合成背景图像融入第一视频数据,从而使得第二视频数据的背景与虚拟场景具有关联性,提升用户针对第二视频数据的感兴趣程度,从而提高针对推荐信息的推荐效率。

119.在步骤1033中,将虚拟对象添加至背景合成视频数据中,得到第二视频数据。

120.在一些实施例中,步骤1033中将虚拟对象添加至背景合成视频数据中,得到第二视频数据,可以通过以下技术方案实现:获取对应第一视频数据的第一音频数据,并对第一音频数据进行解码处理,得到第一音频数据中的每个音频帧;获取虚拟对象的脸部特征以及动作特征,其中,脸部特征以及动作特征与第一音频数据中每个音频帧匹配;针对每个音频帧执行以下处理:利用与音频帧匹配的脸部特征以及动画特征进行特效渲染处理,得到包括虚拟对象的对象视频帧;从背景合成视频数据中提取对应音频帧的背景合成视频帧,并将对象视频帧与背景合成视频帧进行融合处理,得到对应音频帧的对象合成视频帧;将与多个音频帧一一对应的对象合成视频帧进行编码处理,得到第二视频数据。

121.在步骤104中,获取虚拟场景的第三视频数据。

122.作为示例,第三视频数据包括虚拟场景的运行画面,运行画面是通过游戏引擎进行渲染得到的,用户通过客户端控制虚拟对象与虚拟场景中其他虚拟对象进行交互,交互过程中所产生的实时动作数据由客户端发送至服务器,服务器会将实时动作数据渲染至虚拟场景的环境画面,由于虚拟场景的环境画面并不会如交互动作一样频繁变化,因此运行画面的渲染通常仅需要渲染虚拟对象的实时动作,从而可以实时得到虚拟场景的运行画

面,并将实时获取的运行画面编码为第三视频数据。

123.在步骤105中,向终端发送第二视频数据以及第三视频数据,以使终端进行播放。

124.在一些实施例中,参见图4c,图4c是本技术实施例提供的虚拟场景的视频处理方法的流程示意图,步骤105中向终端发送第二视频数据以及第三视频数据,可以通过图4c示出的步骤实现。

125.在步骤1051中,当虚拟场景处于加载阶段时,向终端发送第二视频数据。

126.在步骤1052中,当虚拟场景加载完成时,停止向终端发送第二视频数据。并向终端发送第三视频数据。

127.在步骤1053中,在虚拟场景的运行过程中,当接收到终端发送的针对第三视频数据的暂停指令时,停止向终端发送第二视频数据,并继续向终端发送第二视频数据。

128.作为示例,参见图9,图9是本技术实施例提供的虚拟场景的视频处理方法的流程图,在步骤901中,在游戏加载阶段中,服务器向客户端发送广告视频片段,在步骤902中,接收客户端发送的游戏开始指令,在步骤903中,服务器向客户端发送云游戏视频(第三视频数据),具体而言,在用户游戏视频加载结束之后,云游戏服务器暂停发送广告视频(第二视频数据),发送正常的游戏视频(第三视频数据),在步骤904中,接收客户端发送的暂停游戏指令,在步骤905中,服务器向客户端发送广告视频(第二视频数据),当用户手动暂停游戏、或者进行菜单栏操作、角色更换、皮肤更换等行为动作时,客户端发送暂停指令至云游戏服务器,云游戏服务器则继续把广告视频发送至客户端,当用户继续游戏时,服务器暂停发送广告视频开始发送游戏视频。用户在游玩游戏过程中,广告视频按照以上逻辑,在用户手动暂停游戏期间,持续发送至客户端,达到让用户一边进行游戏相关设置,一边曝光广告视频的目的。

129.通过本技术实施例将虚拟场景中的虚拟元素融合到包括推荐信息的第一视频数据中,得到的第二视频数据中包括虚拟场景相关的元素,后续将第二视频数据与虚拟场景的第三视频数据均发送至终端进行播放,从而降低推荐信息的视频数据与虚拟场景之间的割裂感,可以提升播放视频时用户的感兴趣程度,从而提高针对推荐信息的推荐效率。

130.本技术实施例提供的虚拟场景的视频处理方法可以由终端400执行。参见图4d,图4d是本技术实施例提供的虚拟场景的视频处理方法的流程示意图,将结合图4d示出的步骤进行说明。

131.需要说明的是,图4d示出的方法可以由终端400运行的各种形式计算机程序执行,并不局限于上述的客户端,例如上文的操作系统451、软件模块和脚本,因此客户端不应视为对本技术实施例的限定。

132.在步骤201中,响应于针对虚拟场景的启动操作,显示虚拟场景的加载界面。

133.在步骤202中,在加载界面中播放第二视频数据,其中,第二视频数据包括推荐信息和虚拟场景中的至少一个虚拟元素。

134.在一些实施例中,虚拟元素包括虚拟场景的背景和虚拟场景的虚拟对象,第二视频数据包括处于背景中的虚拟对象,步骤202中在加载界面中播放第二视频数据,可以通过以下技术方案实现:在加载界面中显示虚拟对象实施对象动作以及播报第一音频数据;其中,第一音频数据是用于介绍推荐信息的音频数据,对象动作是虚拟对象在虚拟场景中的动作。通过本技术实施例可以提高第二视频数据与虚拟场景的关联程度,从而有效提高用

户对第二视频数据的感兴趣程度,提高推荐信息的感知效率。

135.作为示例,虚拟元素包括虚拟场景的背景和虚拟场景的虚拟对象中至少之一,当虚拟元素包括背景时,第二视频数据是融入有虚拟场景的背景的广告视频,当虚拟元素包括虚拟对象时,第二视频数据是添加了虚拟对象的广告视频,虚拟对象会实施对象动作,且虚拟对象的口型与第一音频数据适配,相当于形成虚拟对象介绍推荐信息的视觉效果,虚拟对象可以是发起启动操作的用户上一次在虚拟场景中控制的虚拟对象等等。

136.在步骤203中,响应于虚拟场景的加载完成,取消播放第二视频数据,并播放第三视频数据,其中,第三视频数据包括虚拟场景的运行画面。

137.在一些实施例中,步骤203中播放第三视频数据之后,响应于满足第三视频数据的取消播放条件,取消播放第三视频数据,并继续播放第二视频数据。

138.在一些实施例中,执行以下处理中任意一种处理:当第三视频数据处于缓冲阶段时,确定满足取消播放条件;响应于目标账号针对第三视频数据的暂停操作,确定满足取消播放条件;响应于目标账号针对虚拟场景的设置操作,确定满足取消播放条件;其中,目标账号是控制虚拟场景中虚拟对象的账号。

139.作为示例,当游戏客户端处于初始化阶段时,第三视频数据正在缓冲,此时满足取消播放条件,第三视频数据处于未播放状态,为了有效利用用户的等待时间,可以在这个时间段播放第二视频数据,游戏客户端的初始化完毕,虚拟场景开始运行,此时满足取消播放条件,在人机交互界面中播放第三视频数据,以保证用户的正常游戏体验,响应于用户对第三视频数据的暂停操作,例如用户主动暂停游戏,此时满足取消播放条件,第三视频数据不会播放(处于未播放状态),因此会播放第二视频数据,或者响应于用户对虚拟场景的设置操作,例如对控件布局进行设置,对游戏分辨率进行设置,由于操作设置过程中不存在游戏交互行为,因此满足取消播放条件,第三视频数据处于未播放状态。通过本技术实施例可以利用各种不影响玩家正常游戏体验的时间间隙,提高显示资源利用率以及推荐信息的曝光率。

140.在一些实施例中,上述继续播放第二视频数据,可以通过以下技术方案实现:当距离当前时刻最近一次播放的第二视频数据具有未播放的接续内容时,播放对应接续内容的第二视频数据,其中,接续内容包括推荐信息,当前时刻是满足取消播放条件的时刻;当距离当前时刻最近一次播放的第二视频数据不具有未播放的接续内容时,播放包括另一个推荐信息的第二视频数据。通过本技术实施例可以使得间断播放的第二视频数据之间具有关联性,从而提高推荐信息的感知效率。

141.作为示例,广告视频a是针对推荐信息a的融入虚拟元素的广告视频(第二视频数据),广告视频b是针对推荐信息b的融入虚拟元素的广告视频(第二视频数据),广告视频c是针对推荐信息a的另一个融入虚拟元素的广告视频(第二视频数据),例如,最近一次播放的第二视频数据是完整的广告视频a中的前5秒,则广告视频a的后10秒内容则为接续内容,继续播放的第二视频数据是接续内容,当最近一次播放的第二视频数据不具有接续内容时,例如最近一次播放的第二视频数据是广告视频a最后的10秒内容,继续播放的第二视频数据是针对另一个推荐信息的广告视频,例如,广告视频b,或者继续播放的第二视频数据还可以是针对推荐信息的另一个广告视频,例如,广告视频c。

142.在一些实施例中,上述继续播放第二视频数据,可以通过以下技术方案实现:执行

以下处理中任意一种:在人机交互界面中播放第二视频数据;显示第二视频数据播放入口,响应于针对第二视频数据播放入口的触发操作,在人机交互界面中播放第二视频数据;响应于满足第二视频数据的自动播放条件,在人机交互界面中播放第二视频数据。通过手动方式可以提供用户选择的空间,通过自动的方式可提高人机交互效率。

143.在一些实施例中,在响应于满足第二视频数据的自动播放条件,在人机交互界面中播放第二视频数据之前,获取决策参考数据,其中,决策参考数据包括以下至少之一:目标账号的历史操作数据,操作数据可以表征用户的兴趣偏好)、目标账号的账号属性数据,属性数据可以也表征用户的兴趣偏好、虚拟场景的场景数据,场景数据可以表征游戏进度,例如是否处于某个总结阶段等等,目标账号是控制虚拟场景中虚拟对象的账号;调用第一神经网络模型执行以下处理:从决策参考数据中提取决策参考特征,并基于决策参考特征预测目标账号针对第二视频数据的偏好程度;当偏好程度小于偏好程度阈值时,确定满足第二视频数据的自动播放条件,第一神经网络模型是通过训练得到的,训练样本是第二视频数据的历史播放记录,当历史第二视频数据自动播放时被关闭,则该数据被标记为0,当历史第二视频数据自动播放时未被关闭,则该数据被标记为1,结合历史播放记录中获取的决策参数数据样本预测历史第二视频数据a的预测偏好程度为0.8,由于历史第二视频数据a的标记为1,则存在数值为0.2的误差,通过更新模型的参数来使得误差收敛于最小值。通过人工智能的方式确定出目标账号针对第二视频数据的偏好程度,从而可以实现智能化的自动播放,并且所播放的第二视频数据符合用户偏好,能够提高推荐信息的推荐效率。

144.在一些实施例中,在响应于满足第二视频数据的自动播放条件,在人机交互界面中播放第二视频数据之前,从历史播放记录中获取在每次播放第二视频数据的历史时刻,并提取历史时刻的历史场景特征;对多个历史时刻的历史场景特征进行融合处理,得到融合场景特征;获取虚拟场景的当前场景数据,并提取当前场景数据的当前场景特征;当当前场景特征与融合场景特征的相似度大于相似度阈值时,确定满足第二视频数据的自动播放条件。通过人工智能的方式确定出当前的虚拟场景是否合适播放第二视频数据,从而可以实现智能化的自动播放,有效提高智能化程度以及人机交互效率。

145.在一些实施例中,第二视频数据的显示样式的显著程度与第一特征参数负相关;其中,第一特征参数包括以下至少之一:目标账号的活跃程度、目标账号的等级、目标账号在虚拟场景的历史成绩、第二视频数据在虚拟场景中的播放次数;目标账号是控制虚拟场景中虚拟对象的账号。

146.作为示例,显著程度包括以下至少之一:清晰度(清晰度越高则显著程度越高)、色彩饱和度(色彩饱和度越高则显著程度越高)、亮度(亮度越高则显著程度越高)等等,以目标账号的等级为例进行说明,目标账号的等级越高,则第二视频数据的显著程度越高,从而激励用户在虚拟场景中具有更高的参与度以及更优质的参与成果。

147.下面,将说明本技术实施例在一个实际的应用场景中的示例性应用。

148.在一些实施例中,响应于终端接收到用户运行游戏客户端的操作,终端将游戏客户端启动数据发送至服务器,服务器获取包括推荐信息的第一视频数据(例如,从广告提供方拉取的原生广告视频),服务器获取虚拟场景中的虚拟元素,并将第一视频数据与虚拟元素进行融合处理,得到第二视频数据,服务器还会通过游戏引擎的渲染计算得到包括虚拟场景的运行画面的第三视频数据,具体而言,服务器通过图形计算硬件计算显示所需要的

数据,并完成显示数据的加载、解析和渲染,在图形输出硬件输出能够对虚拟场景形成视觉感知的视频帧,服务器向终端发送第二视频数据以及第三视频数据,终端对第二视频数据以及第三视频数据进行解码播放,可以是同时并行播放也可以是串行播放,解码播放过程可以是在智能手机的显示屏幕呈现二维的视频帧,或者,在增强现实/虚拟现实眼镜的镜片上投射实现三维显示效果的视频帧。

149.本技术实施例将原始广告视频和云游戏视频进行视频和音频流分割重组,将游戏背景、游戏角色等融入到广告视频中,通过服务端压缩编码发送至客户端,客户端进行解码展示,减少客户端从第三方广告平台拉取广告视频的时间,将广告视频插入至云游戏的视频流中,服务器灵活控制广告视频样式,将广告视频和云游戏虚拟角色形式进行拼接,提高广告的趣味性曝光率。

150.在一些实施例中,服务器结合当前用户特性,从第三方广告平台拉取指定广告(例如,符合用户兴趣的广告),将广告视频进行分段,并将分段得到的广告视频数据与当前游戏的虚拟元素进行合并,得到融合有虚拟元素的新广告视频,将新广告视频以及云游戏视频以视频流的形式发送至客户端,并且新广告视频的发送时间段嵌入至云游戏视频的暂停或者非游戏阶段,在客户端对接收到的视频数据进行解码展示。响应于用户点击进入云游戏页面的操作,在游戏的缓冲阶段接收新广告视频的视频数据,游戏加载完毕时接收服务器发送的云游戏视频,响应于用户设置操作或者存档操作,继续接收新广告视频的视频数据,从而实现新广告视频的延续播放,通过本技术实施例可以提高广告视频的曝光率和用户体验。

151.在一些实施例中,参见图5,图5是本技术实施例提供的虚拟场景的视频处理方法的界面示意图,人机交互界面501中显示游戏进行过程中的云游戏视频数据,响应于用户设置操作或者存档操作,云游戏服务器会推送包括虚拟元素的新广告视频502,从而用户可以同时操作游戏菜单(或者更改皮肤)并观看新广告视频,响应于用户继续游戏的操作,云游戏服务器暂停新广告视频的视频数据推送,改为推送云游戏视频数据。

152.在一些实施例中,参见图6,图6是本技术实施例提供的虚拟场景的视频处理方法的界面示意图,人机交互界面601中显示设置菜单602,响应于用户针对设置菜单602的设置操作,客户端向服务器发送暂停指令,服务器实时合成得到的新广告视频(融入有实时虚拟元素)或者将预先合成的新广告视频(融合有虚拟元素)发送至客户端,从而在用户操作设置菜单时,播放融有虚拟元素的新广告视频603,例如由虚拟角色播放语音的新广告视频。参见图7,图7是本技术实施例提供的虚拟场景的视频处理方法的界面示意图,响应于用户结束设置操作,例如人机交互界面701显示结束设置控件702,结束设置操作是针对结束设置控件702的触发操作,客户端向服务器发送继续指令,服务器继续推送云游戏视频。

153.在一些实施例中,用户启动云游戏之后,在云游戏初始化渲染时,云游戏服务器优先把用户上次选择的虚拟角色和广告视频进行合并,在合并之前或者合并之后可以将广告视频切割成云游戏渲染所需时间的小片段,从而在云游戏初始化渲染阶段进行广告展示。用户开始进入云游戏之后,服务器进行云游戏推流,不再曝光广告视频。用户需要暂停云游戏或者操作菜单栏时,客户端将暂停指令发送至服务器,服务器继续将未播报完的广告视频发送至客户端进行显示。用户操作完毕,客户端将继续游戏指令发送至服务器,服务器暂停广告视频推流,继续进行云游戏推流。此过程中,用户的操作不受到任何影响,只有在用

户暂停游戏时,将云游戏视频推流改为广告视频推流,由于广告视频的背景由服务器取游戏视频背景进行高斯模糊得到,添加虚拟角色的动画至广告视频进行合并,能够极大的消除广告视频和云游戏视频的视觉差异,增强广告视频的趣味性以及用户的观赏意愿。

154.在一些实施例中,参见图8,图8是本技术实施例提供的虚拟场景的视频处理方法的流程图,以实时获取用于进行二次加工的广告视频为例进行说明,在步骤801中,服务器根据用户的登录账号从第三方广告平台拉取定向的广告视频。在步骤802中,客户端登录后会启动云游戏,服务器进行云游戏视频渲染处理。在步骤803中,拉取到定向的广告视频后,服务器对广告视频进行分段切割。具体而言,首先根据用户在进入游戏之前所需的缓冲时长获取视频片段,后续以用户手动暂停游戏、用户操作菜单栏、切换角色、更换皮肤等手动标签作为切割点,当接收到用户的切割点标签之后,以切割点标签对应的时间戳作为分段切割的起点以再次进入游戏的时间戳作为分段切割的终点,即实时获取用于进行二次加工的广告视频,从起点的广告视频帧开始渲染推流直至终点的广告视频帧的渲染推流。在步骤804中,服务器截取当前游戏通用背景,对通用背景进行高斯模糊,将高斯模糊得到的背景和广告视频背景进行叠加,从而可以消除广告视频和云游戏视频的视觉效果差异,在步骤805中,服务器从当前游戏的角色数据库中,选择用户对应的虚拟游戏角色,生成游戏角色形象。在步骤806中,为游戏角色形象配置标准的行为动作,从而生成行为动作视频,将行为动作视频和广告视频进行合并,可以构成游戏虚拟角色指引播放广告视频的效果。在步骤807中,客户端展示经过合成的广告视频,具体而言,服务器将合成的广告视频发送至客户端,例如,在用户加载游戏的过程中服务器将合成的广告视频发送至客户端以优先进行广告视频片段播放。在步骤808中,响应于客户端进入游戏,客户端进行游戏展示,具体而言,在云游戏视频渲染结束后,客户端进行游戏展示。在步骤809中,响应于用户进行其他非游戏操作,客户端发送暂停指令到服务器,转入执行步骤803,从而在非游戏阶段也进行广告视频片段播放。在步骤810中,响应于接收到用户的继续游戏操作,客户端进行游戏展示。除了利用通用游戏背景图片做高斯模糊,还能够动态采集不同云游戏阶段的不同背景图片,动态的嵌入至广告视频,达到用户在任一时候暂停云游戏,客户端在后台播放广告视频时,广告视频和当前游戏背景都能达到视觉效果一致。

155.在一些实施例中,参见图9,图9是本技术实施例提供的虚拟场景的视频处理方法的流程图,游戏加载阶段服务器向客户端发送广告视频片段,接收客户端发送的游戏开始指令,服务器向客户端发送云游戏视频,具体而言,在用户游戏视频加载结束之后,云游戏服务器暂停发送广告视频,发送正常的游戏视频,接收客户端发送的暂停游戏指令,服务器向客户端发送广告视频片段,当用户手动暂停游戏、或者进行菜单栏操作、角色更换、皮肤更换等行为动作时,客户端发送暂停指令至云游戏服务器,云游戏服务器则继续把广告视频发送至客户端,当用户继续游戏时,服务器暂停发送广告视频开始发送游戏视频。用户在游玩游戏过程中,广告视频按照以上逻辑,在用户手动暂停游戏期间,持续发送至客户端,达到让用户一边进行游戏相关设置,一边曝光广告视频的目的。

156.在一些实施例中,参见图11,图11是本技术实施例提供的虚拟场景的视频处理方法的流程图。

157.在步骤1101中,客户端向云服务器发送游戏启动请求。

158.在步骤1102中,云服务器从广告提供方拉取第一视频数据,第一视频数据是广告

视频数据。

159.在步骤1103中,云服务器在第一视频数据中融入虚拟元素,得到第二视频数据。

160.在步骤1104中,云服务器进行缓冲阶段的渲染处理,得到第三视频数据,第三视频数据承载游戏画面.

161.在步骤1105中,当渲染过程还未结束时,云服务器将第二视频数据发送至客户端。

162.在步骤1106中,客户端播放第二视频数据。

163.在步骤1107中,当缓冲阶段的渲染过程结束时,云服务器将第三视频数据发送至客户端,并停止发送第二视频数据。

164.在步骤1108中,客户端播放第三视频数据。

165.在步骤1109中,客户端接收用户的游戏暂停操作,并将游戏暂停指令发送至云服务器。

166.在步骤1110中,云服务器将第二视频数据发送至客户端,并停止发送第三视频数据。

167.在步骤1111中,客户端播放第二视频数据。

168.在步骤1112中,客户端接收用户的游戏继续操作,并将游戏继续指令发送至云服务器。

169.在步骤1113中,云服务器将第三视频数据发送至客户端,并停止发送第二视频数据。

170.在一些实施例中,参见图10,图10是本技术实施例提供的虚拟场景的视频处理方法的流程图,以非实时获取用于进行二次加工的广告视频为例进行说明,在步骤1001中,服务器拉取广告视频,在步骤1002中,服务器渲染云游戏视频,在步骤1003中,服务器对游戏通用背景进行高斯模糊处理,在步骤1004中,服务器将游戏通用背景填充为广告视频背景,从而消除广告视频和客户端用户界面显示内容之间的割裂感,在步骤1005中,服务器选取当前用户的虚拟角色,生成三维动画形象,进而生成具有通用行为的三维动画形象的动画视频,在步骤1006中,将当前虚拟角色的动画视频和广告视频进行动画和视频的叠加,得到融合有虚拟元素的广告视频,最终可以得到利用虚拟角色播放广告的视频效果。相当于拉取到广告视频后,就开始提前加工广告视频,对于游戏缓冲期的广告视频,可以理解为是实时渲染得到的,在后续游戏运行过程中,广告视频整体都加工完成,因此后续不再需要实时渲染,直接根据客户端的指令继续推流广告视频,或者停止推流广告视频。

171.通过本技术实施例将游戏虚拟角色以及游戏通用背景嵌入广告视频,降低广告视频和游戏视频的割裂感,并且根据用户指令将广告视频以片段形式嵌入游戏视频,能提高广告视频与游戏视频的关联度以及广告视频的曝光率。

172.可以理解的是,在本技术实施例中,涉及到用户信息等相关的数据,当本技术实施例运用到具体产品或技术中时,需要获得用户许可或者同意,且相关数据的收集、使用和处理需要遵守相关国家和地区的相关法律法规和标准。

173.下面继续说明本技术实施例提供的虚拟场景的视频处理装置255的实施为软件模块的示例性结构,在一些实施例中,如图2所示,存储在存储器250的虚拟场景的视频处理装置255中的软件模块可以包括:第一获取模块2551,用于获取第一视频数据,其中第一视频数据包括推荐信息;第二获取模块2552,用于获取虚拟场景中的虚拟元素;融合模块2553,

用于将第一视频数据与虚拟元素进行融合处理,得到第二视频数据;第三获取模块2554,用于获取虚拟场景的第三视频数据,其中,第三视频数据包括虚拟场景的运行画面;发送模块2555,用于向终端发送第二视频数据以及第三视频数据,以使终端进行播放。

174.在一些实施例中,在获取第一视频数据之前,第一获取模块2551,还用于获取目标账号的账号特征以及多个候选信息的信息特征,并确定每个候选信息的信息特征与账号特征之间的第一特征距离,其中,目标账号是控制虚拟场景中虚拟对象的账号;基于第一特征距离对多个候选信息进行升序排序,并将排序在首位的候选信息作为推荐信息。

175.在一些实施例中,在获取第一视频数据之前,第一获取模块2551,还用于获取虚拟场景的实时场景特征以及多个候选信息的信息特征,并确定每个候选信息的信息特征与实时场景特征之间的第二特征距离;基于第二特征距离对多个候选信息进行升序排序,并将排序在首位的候选信息作为推荐信息。

176.在一些实施例中,融合模块2553,还用于:获取虚拟场景的虚拟对象以及虚拟场景的背景图像,作为虚拟元素;对虚拟场景的背景图像进行模糊处理,得到待合成背景图像;对待合成背景图像以及第一视频数据进行合成处理,得到背景合成视频数据;将虚拟对象添加至背景合成视频数据中,得到第二视频数据。

177.在一些实施例中,融合模块2553,还用于:获取待合成背景图像中每个背景位置的待合成背景像素;针对第一视频数据中每个第一视频帧执行以下任意一种处理:获取第一视频帧的背景画面的多个背景像素,保持第一视频帧的前景画面的多个前景像素不变,利用待合成背景像素替换第一视频帧中相同背景位置的背景像素,得到背景合成视频帧;获取第一视频帧的背景画面的多个背景像素,保持第一视频帧的前景画面的多个前景像素不变,将待合成背景像素与第一视频帧中相同背景位置的背景像素进行合成处理,得到背景合成视频帧;对多个背景合成视频帧进行编码处理,得到背景合成视频数据。

178.在一些实施例中,融合模块2553,还用于:获取对应第一视频数据的第一音频数据,并对第一音频数据进行解码处理,得到第一音频数据中的每个音频帧;获取虚拟对象的脸部特征以及动作特征,其中,脸部特征以及动作特征与第一音频数据中每个音频帧匹配;针对每个音频帧执行以下处理:利用与音频帧匹配的脸部特征以及动画特征进行特效渲染处理,得到包括虚拟对象的对象视频帧;从背景合成视频数据中提取对应音频帧的背景合成视频帧,并将对象视频帧与背景合成视频帧进行融合处理,得到对应音频帧的对象合成视频帧;将与多个音频帧一一对应的对象合成视频帧进行编码处理,得到第二视频数据。

179.在一些实施例中,第二获取模块2552,还用于:将满足以下条件至少之一的虚拟对象,作为虚拟场景的虚拟元素:虚拟对象是目标账号曾经在虚拟场景中控制的虚拟对象;虚拟对象是虚拟场景中被控制总次数最多的虚拟对象;虚拟对象是虚拟场景中被目标账号控制次数最多的虚拟对象。

180.在一些实施例中,发送模块2555,还用于当虚拟场景处于加载阶段时,向终端发送第二视频数据;当虚拟场景加载完成时,停止向终端发送第二视频数据,并向终端发送第三视频数据;在虚拟场景的运行过程中,当接收到终端发送的针对第三视频数据的暂停指令时,停止向终端发送第二视频数据,并继续向终端发送第二视频数据。

181.下面继续说明本技术实施例提供的虚拟场景的视频处理装置455的实施为软件模块的示例性结构,在一些实施例中,如图2所示,存储在存储器450的虚拟场景的视频处理装

置455中的软件模块可以包括:显示模块4551,用于响应于针对虚拟场景的启动操作,显示虚拟场景的加载界面;播放模块4552,用于在加载界面中播放第二视频数据,其中,第二视频数据包括推荐信息和虚拟场景中的至少一个虚拟元素;播放模块4552,还用于响应于虚拟场景的加载完成,取消播放第二视频数据,并播放第三视频数据,其中,第三视频数据包括虚拟场景的运行画面。

182.在一些实施例中,虚拟元素包括虚拟场景的背景和虚拟场景的虚拟对象,第二视频数据包括处于背景中的虚拟对象,播放模块4552,还用于:在加载界面中显示虚拟对象实施对象动作以及播报第一音频数据;其中,第一音频数据是用于介绍推荐信息的音频数据,对象动作是虚拟对象在虚拟场景中的动作。

183.在一些实施例中,播放第三视频数据之后,播放模块4552,还用于:响应于满足第三视频数据的取消播放条件,取消播放第三视频数据,并继续播放第二视频数据。

184.在一些实施例中,播放模块4552,还用于:当距离当前时刻最近一次播放的第二视频数据具有未播放的接续内容时,播放对应接续内容的第二视频数据,其中,接续内容包括推荐信息,当前时刻是满足取消播放条件的时刻;当距离当前时刻最近一次播放的第二视频数据不具有未播放的接续内容时,播放包括另一个推荐信息的第二视频数据。

185.在一些实施例中,播放模块4552,还用于:执行以下处理中任意一种:在人机交互界面中播放第二视频数据;显示第二视频数据播放入口,响应于针对第二视频数据播放入口的触发操作,在人机交互界面中播放第二视频数据;响应于满足第二视频数据的自动播放条件,在人机交互界面中播放第二视频数据。

186.在一些实施例中,在响应于满足第二视频数据的自动播放条件,在人机交互界面中播放第二视频数据之前,播放模块4552,还用于:获取决策参考数据,其中,决策参考数据包括以下至少之一:目标账号的历史操作数据、目标账号的账号属性数据、虚拟场景的场景数据,目标账号是控制虚拟场景中虚拟对象的账号;调用第一神经网络模型执行以下处理:从决策参考数据中提取决策参考特征,并基于决策参考特征预测目标账号针对第二视频数据的偏好程度;当偏好程度小于偏好程度阈值时,确定满足第二视频数据的自动播放条件。

187.在一些实施例中,在响应于满足第二视频数据的自动播放条件,在人机交互界面中播放第二视频数据之前,播放模块4552,还用于:从历史播放记录中获取在每次播放第二视频数据的历史时刻,并提取历史时刻的历史场景特征;对多个历史时刻的历史场景特征进行融合处理,得到融合场景特征;获取虚拟场景的当前场景数据,并提取当前场景数据的当前场景特征;当当前场景特征与融合场景特征的相似度大于相似度阈值时,确定满足第二视频数据的自动播放条件。

188.在一些实施例中,播放模块4552,还用于:执行以下处理中任意一种处理:当第三视频数据处于缓冲阶段时,确定满足取消播放条件;响应于目标账号针对第三视频数据的暂停操作,确定满足取消播放条件;响应于目标账号针对虚拟场景的设置操作,确定满足取消播放条件;其中,目标账号是控制虚拟场景中虚拟对象的账号。

189.在一些实施例中,第二视频数据的显示样式的显著程度与第一特征参数负相关;其中,第一特征参数包括以下至少之一:目标账号的活跃程度、目标账号的等级、目标账号在虚拟场景的历史成绩、第二视频数据在虚拟场景中的播放次数;目标账号是控制虚拟场景中虚拟对象的账号。

190.本技术实施例提供了一种计算机程序产品,该计算机程序产品包括计算机程序或计算机可执行指令,该计算机程序或计算机可执行指令存储在计算机可读存储介质中。电子设备的处理器从计算机可读存储介质读取该计算机可执行指令,处理器执行该计算机可执行指令,使得该电子设备执行本技术实施例上述的虚拟场景的视频处理方法。

191.本技术实施例提供一种计算机可读存储介质,其中存储有计算机可执行指令,当计算机可执行指令被处理器执行时,将引起处理器执行本技术实施例提供的虚拟场景的视频处理方法,例如,如图4a-4d示出的虚拟场景的视频处理方法。

192.在一些实施例中,计算机可读存储介质可以是fram、rom、prom、eprom、eeprom、闪存、磁表面存储器、光盘、或cd-rom等存储器;也可以是包括上述存储器之一或任意组合的各种设备。

193.在一些实施例中,可执行指令可以采用程序、软件、软件模块、脚本或代码的形式,按任意形式的编程语言(包括编译或解释语言,或者声明性或过程性语言)来编写,并且其可按任意形式部署,包括被部署为独立的程序或者被部署为模块、组件、子例程或者适合在计算环境中使用的其它单元。

194.作为示例,可执行指令可以但不一定对应于文件系统中的文件,可以可被存储在保存其它程序或数据的文件的一部分,例如,存储在超文本标记语言(html,hyper text markup language)文档中的一个或多个脚本中,存储在专用于所讨论的程序的单个文件中,或者,存储在多个协同文件(例如,存储一个或多个模块、子程序或代码部分的文件)中。

195.作为示例,可执行指令可被部署为在一个计算设备上执行,或者在位于一个地点的多个计算设备上执行,又或者,在分布在多个地点且通过通信网络互连的多个计算设备上执行。

196.综上所述,通过本技术实施例将虚拟场景中的虚拟元素融合到包括推荐信息的第一视频数据中,得到的第二视频数据中包括虚拟场景相关的元素,后续将第二视频数据与虚拟场景的第三视频数据均发送至终端进行播放从而避免推荐信息的视频数据与虚拟场景之间的割裂感过强,可以提升播放视频时的信息感知效率。

197.以上所述,仅为本技术的实施例而已,并非用于限定本技术的保护范围。凡在本技术的精神和范围之内所作的任何修改、等同替换和改进等,均包含在本技术的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1