基于稀疏化卷积网络剪枝的图像识别方法

1.本发明属于人工智能、图像处理与人工神经网络与计算交叉领域,主题内容是一种针对图像识别的非结构化剪枝进行稀疏网络训练,剔除冗余网络参数,提高图像识别精度方法。

背景技术:

2.在当今追求高效率的时代,基于设备采集的数据上传至服务器处理方式在就地应用上会倍感压力,而对应实时性要求较高的无人驾驶、人脸识别等终端

3.部署略显吃力。在基于实时性要求及部分网络中断情况下无人驾驶场景中,根据输入的视频数据实时对复杂路面下各目标识别,从中抽取关键目标进行融合分析,进而生成实时的应对策略;基于监控摄像头下对行人跟踪和罪犯识别等智能感知的场景中,终端实时部署先进神经网络的需求旺盛,这也使终端设备的存储及缓存能力面临一个很大的挑战。基于以上问题及挑战,深度网络模型的压缩与加速是一个迫切的研究点,它要求不仅是减少模型的参数,更重要的是能够降低模型运算时间,将模型的深度控制在合理的范围之内,从而满足实际应用的需要。

4.在基于权值进行剪枝的研究当中,han等人提出的剪枝-重训练框架,先根据权值绝对值大小剪枝,然后重训练剩下的权值以恢复准确率,但缺点是重训练的时间过长。针对以上问题,guo等人提出dynamic network surgery,即允许被剪枝的值重新激活从而重新连接到网络中来,因此极大的缩短重训练的时间。li等人提出了全局贪婪剪枝,选取filter权重和作为显著性度量.对每一层中的filter按照显著性从大到小排序,进而画出权重和关于排序后下标的曲线。在基于通道剪枝的研究当中,li等人将网络中每个卷积核矩阵按绝对值进行求和,将得到较小值的通道从网络中移除,实现vgg-net推理成本下降34%,resnet110推理成本下降38%的加速效果。liu等人利用batch-normalization中的缩放因子的大小来定义对应通道的重要性,并且为了约束bn层中缩放因子的大小,在目标方程中添加了一个稀疏正则项,使得更多缩放因子在训练中接近于0,以此提高剪枝效率。he等人通过裁剪图像超分网络rcan和san的模块数量,并利用知识蒸馏的方法来恢复模型精度。

技术实现要素:

5.本文在基于非结构化剪枝基础上,利用随机掩码(0或1)来进行网络初始化,剔除权重较小且接近0的网络参数,通过引入新的随机权重来替补被剪枝权重参数。同时对网络中权重进行线性缩放,进而实现神经网络稀疏化训练过程。仿真实验发现此方法剔除大量冗余参数,且提高网络的识别准确率。

6.主要技术方案包括:稀疏化剪枝部分,主要利用随机掩码初始化网络模型,利用预设定的权重保留比例进行计算,保留特定稀疏度的网络层权重数量,剔除对输出贡献度较小的网络权重,在剔除权重的同时要增加相同数量的随机权重更新和训练网络模型,最后通过线性缩放系数来遍历模型中参数,使得网络中最终参数与预设定的权重保留数量相

同。

7.实验仿真表明,该方法能够剔除网络中绝大部分冗余参数,提高神经网络的图像识别精确度。

附图说明

8.下面是该方法主要的附图。

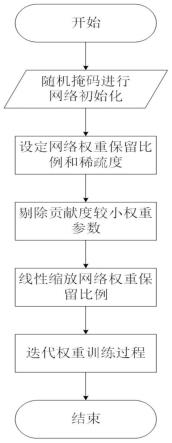

9.图1是本发明方法的流程图。

10.图2是cifar10、cifar100数据集图。

11.图3是本文方法在数据集cifar10条件下的测试图。

12.图4是本文方法在数据集cifar100条件下的测试图。

具体实施方式

13.下面结合附图和具体实施方式对本发明做进一步说明。

14.本发明的流程图如图1所示,基于稀疏化卷积网络剪枝的图像识别方法,该方法具体包括以下流程:

15.步骤一:利用随机掩码0或者1进行网络初始化

16.在对网络模型进行剪枝时,通常假设网络中参数是冗余的,采用0或者1掩码对网络中参数进行初始化操作。

17.步骤二:预设网络权重保留系数,计算并更新网络权重大小。

18.在进行网络剪枝时,需要评判不同网络参数对输出结果的影响程度。参数重要性评价可表示为显著性程度。

19.显著性程度为:

[0020][0021]

上式中si为显著性程度,wi是网络模型中参数权重,h

ii

为海森矩阵数值。

[0022]

通过引入显著性程度进行评价网络中参数重要性程度,根据重要性程度剔除贡献度较小且接近0的权重参数,同时增加相同数量的随机权重更新模型参数。

[0023]

同时,为保证网络模型中参数得到及时更新,本方法采用随机梯度下降方法更新和优化梯度传递,通过计算不同数据样本的均值与方差来改善梯度流传播方向,加速网络模型收敛过程。

[0024]

计算数据样本的均值及方差方法为:

[0025][0026]

[0027][0028][0029]

上式中中i为第i数据样本,na为样本总量,αa为数据样本平均值,为数据样本方差。为批量样本中经过标准化的表达式。γ、β为神经网络在网络中学习参数。

[0030]

步骤三:去除较小权重,引入相同数量随机权重进行模型更新训练。

[0031]

通过上述对权重参数重要性评估后,清除相对较小且对输出影响较小的权重,同时增加随机权重迭代网络训练。

[0032]

步骤四:通过线性缩放遍历模型中全部参数,使得网络参数量符合预设定的稀疏度。

[0033]

线性缩放网络层与层之间权重参数,使得剪枝后的网络参数量控制在某一范围内,同时使得剪枝后网络识别精度保证,两者维持动态权衡的状态。

[0034]

方法测试

[0035]

仿真实验选用公共数据集cifar10、cifar100,两个数据集中图片大小为32

×

32彩色图片,cifar10样本数据量为60000张,其中训练数据样本为50000,测试数据样本10000张,cifar100训练及测试比例与cifar10中比例保持一致。

[0036]

本方法从剪枝率和参数量、识别精度三方面来进行评估该方法的性能,剪枝率可以用来评价网络模型中剩余参数数量,剪枝率越高,说明网络模型中剩余参数量越少,在保证模型识别精度的前提下剪枝率越高,越能够反映模型压缩效果好。

[0037]

为了评估本文方法的剪枝效率,对神经网络进行预设定剪枝率进行剪枝,然后逐步提高剪枝率来渐渐达到压缩效率,同时也要保证精度的损失在预定范围内。利用剪枝率评估模型剔除冗余参数前后的精度变化情况程度,在保证精度前提下尽可能压缩模神经网络模型。

[0038]

图为本方法在vgg19和resnet32数据集上的测试数据。

[0039]

分别提取嵌入的水印信息和原始载体图像。可以看出,所提方法提取的水印信息与原始载体图像可以分离,提取的原始载体图像与初始的载体图像是一致的,验证了所提算法可以提取水印信息,而且还可以对载体图像进行恢复。

[0040]

表1为基于vgg19架构中本方法的剪枝测试结果

[0041]

数据集\剪枝率909598cifar1093.866893.380292.7592cifar10069.910271.367969.1384

[0042]

表2为基于resnet32架构中本方法的剪枝测试结果

[0043]

数据集\剪枝率909598cifar1092.782391.369789.2673cifar10069.906767.150960.1793

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1