一种执法记录仪定位方法及装置与流程

1.本技术涉及执法设备的领域,尤其是涉及一种执法记录仪定位方法及装置。

背景技术:

2.执法记录仪是民警执行公务时随身携带的集实时视音频摄录、照相和录音等功能于一体的取证技术装备。同时可以通过4g/5g无线实时视频传输,能够对执法过程中进行动态、静态的现场情况数字化记录,便于公安干警在各种环境中执法使用。同时,当需要警力增援时,需要对警员所持执法记录仪进行精准定位。

3.但是在相关技术的实际应用中,通常会出现执法记录仪定位不准确,导致警员在执法中出现问题。

技术实现要素:

4.为了解决在执法记录仪定位不准确的问题,本技术提供一种执法记录仪定位方法及装置。

5.本技术提供的一种执法记录仪定位方法采用如下技术方案。

6.一种执法记录仪定位方法,可选的,包括:接收用户端发送的视频数据,其中,所述视频数据通过广角拍摄得到;提取并校正所述视频数据中发生广角畸变的图像,得到校正后的图像组成的视频;通过增强现实将预存的虚拟地图模型与所述校正后的图像组成的视频匹配,并得到匹配度及匹配度排序;将匹配度排序在前的虚拟模型地点信息设置为预测的用户端地点信息;获取用户端的定位信息,当所述预测的用户端地点信息和所述定位信息一致时,确定用户端的地点信息。

7.通过采用上述技术方案,当服务器接收到用户端发送的通过广角拍摄的视频数据后,提取视频中发生广角畸变的图像帧,并对这些发生广角畸变的图像帧进行校正。将完成校正的图像帧组成视频,并通过增强现实的方法,与预存的虚拟地图模型进行匹配,并得到匹配度。将匹配度排序在前的虚拟模型的地点信息作为预测的用户端地点信息,以便于后续确定用户端实际的地点信息。

8.接收用户端的定位信息,当用户端的定位信息和预测的用户端地点信息一致时,确定用户端的地点信息。通过广角拍摄视频,有利于扩大拍摄范围,提高后续定位的准确性。通过与预存的虚拟地图模型进行匹配得到预测的用户端地点信息,并根据预测的地点与接收到用户端的定位是否一致的信息确定用户端的位置,有利于进一步提高对用户端的定位精确度。

9.可选的,所述提取并校正所述视频数据中发生广角畸变的图像,得到校正后的图像组成的视频;具体包括:

获取广角畸变图像,其中,所述广角畸变图像的信息处于空间直角坐标系一个平面中的同一圆形区域中;通过半球面修复广角畸变图像后,获取所述广角畸变图像在所述半球面上的第一投影图像,其中,所述半球面处于空间直角坐标系中;在除广角畸变图像所在平面外的另一坐标轴的方向,对所述第一投影图像的坐标点,通过预设的校正公式进行处理以完成畸变校正,得到第二投影图像;将所述第一投影图像和所述第二投影图像在同一平面上投影,并得到对应的第一视平面投影图像及第二视平面投影图像;将所述对应的第一视平面投影图像及第二视平面投影图像进行加权处理,得到校正后的图像,进而得到校正后的图像组成的视频。

10.通过采用上述技术方案,从用户端发送的视频中提取发生广角畸变的图像,其中,图像中的有效信息均处于空间直角坐标系一个平面的同一圆形区域中。其后,建立广角图像的畸变校正模型,通过半球面修复广角畸变的图像,并在空间直角坐标系中,获取广角畸变图像在半球面上的第一投影图像。

11.根据第一投影图像的坐标和校正公式得到第二投影图像,并将第一投影图像和第二投影图像在同一平面内进行投影,进而得到对应的第一视平面投影图像和第二视平面投影图像。将第一视平面投影图像和第二视平面投影图像进行加权处理得到最终校正完成的图像,进而得到校正后的图像组成的视频。通过对视频中发生广角畸变的图像进行校正处理,有利于避免发生因图像发生广角畸变而导致后续定位出现偏差的情况,有利于提高用户端的定位准确度。

12.可选的,所述通过增强现实将虚拟地图模型与所述校正后的图像组成的视频匹配之前的步骤,具体包括:接收地图信息,根据所述地图信息绘制所述虚拟地图模型,并存储所述虚拟地图模型。

13.通过采用上述技术方案,接收地图信息,并根据2d地图信息绘制3d虚拟地图模型,预存3d虚拟地图模型,以便于后续与校正后的图像组成的视频进行增强现实操作,有利于提高用户端的定位准确度。

14.可选的,所述接收用户端发送的视频数据之前的步骤,具体还包括:对所述用户端进行初始化校准。

15.通过采用上述技术方案,在接收用户端发送的视频数据之前,需要对用户端进行初始化校准操作,有利于提高用户端发送的视频数据的有效性。

16.可选的,所述方法还包括:当确定用户端的地点信息后,获取所述校正后的图像组成的视频中的场景特征的数量及所述虚拟地图模型中的场景特征的数量;若所述视频中的场景特征的数量多于所述虚拟地图模型中的场景特征的数量,则根据所述视频中的场景特征对所述虚拟地图模型的场景特征进行更新。

17.通过采用上述技术方案,当已经对用户端进行定位后,此时视频中的场景特征的数量多于虚拟地图模型中的场景特征的数量,那么需要将视频中新增的场景特征添加至虚拟地图模型中,以提高虚拟地图模型的完整度,有利于提高后续对用户端的定位准确度。

18.可选的,所述通过增强现实将虚拟地图模型与所述校正后的图像组成的视频匹配,并得到匹配度及匹配度排序;具体包括:提取所述虚拟地图模型中的第一场景特征,和所述视频中的第二场景特征;将所述第一场景特征和所述第二场景特征进行匹配,并得到匹配度;若所述匹配度超过预设的匹配度阈值,且超过预设匹配度阈值的虚拟地图模型的数量为至少一个,则将至少一个的所述虚拟地图模型根据匹配度进行排序。

19.通过采用上述技术方案,当通过增强现实将虚拟地图模型和校正后的图像组成的视频进行匹配时,是将虚拟地图模型中的第一场景特征和视频中的第二场景特征进行匹配。当第一场景特征和第二场景特征的匹配度超过预设的匹配度阈值时,对至少一个虚拟地图模型进行排序,有利于提高对用户端定位的准确性。

20.可选的,所述通过半球面修复广角畸变图像的步骤,具体包括:在空间直角坐标系的一个平面中,计算得到所述广角畸变图像的圆心坐标及半径;将所述半球面覆盖于广角畸变图像上,所述半球面的球心坐标与所述广角畸变图像的圆心坐标重合,所述半球面的半径与所述广角畸变图像的半径相等。

21.通过采用上述技术方案,在空间直角坐标系中的一个平面中,计算得到广角畸变图像的圆心坐标和半径。并将半球面的球心坐标设置为广角畸变图像的圆心坐标,同时,半球面的半径和广角畸变图像的半径相等。其后,将半球面覆盖至广角畸变图像上,对广角畸变图像进行修复,有利于后续得到修正后的视频,有利于进一步提高定位准确性。

22.可选的,所述获取用户端的定位信息,当所述预测的用户端地点信息和所述定位信息一致时,确定用户端的地点信息的步骤,具体包括:接收用户端发送的信号,并获取用户端的定位信息;若所述用户端的定位信息处于所述预测的用户端地点范围内,则确定用户端的地点信息。

23.通过采用上述技术方案,当通过增强现实对视频和虚拟地图模型进行匹配并得到匹配度排名在前的地点范围时,判断接收的用户端的经纬位置信息是否在这个匹配度排名在前的地点范围内。如果接收的用户端的经纬位置信息是否在这个匹配度排名在前的地点范围内,那么确定用户端的地点信息。有利于进一步提高定位的准确性。

24.可选的,所述方法还包括:若所述用户端的经纬位置处于所述预测的用户端地点范围外,则确定预测的用户端地点信息为用户端的地点信息。

25.通过采用上述技术方案,如果用户端的经纬位置处于预测的用户端地点范围外,那么就确定预测的用户端地点信息为用户端的地点信息。有利于避免接收用户端发送的信号不稳定导致定位不准确的情况。

26.本技术提供的一种执法记录仪定位装置采用如下技术方案。

27.一种执法记录仪定位装置,包括:获取模块、处理模块及判断模块;所述获取模块用于接收用户端发送的通过广角拍摄得到的视频数据,用于获取用户端的定位信息;所述处理模块用于提取并校正所述视频数据中发生广角畸变的图像,得到校正后

的图像组成的视频;用于通过增强现实将虚拟地图模型与所述校正后的图像组成的视频匹配,并得到匹配度及匹配度排名;用于将匹配度排序在前的虚拟模型地点信息设置为预测的用户端地点信息;用于当所述预测的用户端地点信息和所述定位信息一致时,确定用户端的地点信息;所述判断模块用于判断所述预测的用户端地点信息和所述定位信息是否一致。

28.通过采用上述技术方案,当服务器的获取模块接收到用户端发送的广角拍摄的视频数据后,处理模块提取视频中发生广角畸变的图像帧,并对这些发生广角畸变的图像帧进行校正。将完成校正的图像帧组成视频,并通过增强现实的方法,与预存的虚拟地图模型进行匹配,并得到匹配度。将匹配度排序在前的虚拟模型的地点信息作为预测的用户端地点信息,以便于后续确定用户端实际的地点信息。

29.获取模块接收用户端的定位信息,通过判断模块判断用户端的定位信息和预测的用户端地点信息是否一致。当用户端的定位信息和预测的用户端地点信息一致时,处理模块确定用户端的地点信息。通过广角拍摄视频,有利于扩大拍摄范围,提高后续定位的准确性。通过与预存的虚拟地图模型进行匹配得到预测的用户端地点信息,并根据预测的地点与接收到用户端的定位是否一致的信息确定用户端的位置,有利于进一步提高对用户端的定位精确度。

30.综上所述,本技术有以下有益技术效果:通过对用户端广角拍摄的视频进行校正,并通过增强现实的方法对视频和预存的虚拟地图模型进行匹配,得到匹配度最高的预测的用户端地点信息,最后通过判断预测的用户端地点信息和用户端的定位是否一致,确定用户端的位置,有利于提高对用户端的定位的准确度。

附图说明

31.图1是本技术实施例的一种执法记录仪定位方法的流程图。

32.图2是本技术实施例中校正广角畸变图像的示意图。

33.图3是本技术一实施例的场景特征匹配的场景图。

34.图4是本技术再一实施例的一种执法记录仪定位方法的示意图。

35.图5是本技术实施例的一种执法记录仪定位模块结构示意图。

36.附图标记说明:1、获取模块;2、处理模块;3、判断模块。

具体实施方式

37.为了使本技术领域的人员更好地理解本说明书中的技术方案,下面将结合本说明书实施例中的附图,对本说明书实施例中的技术方案进行清楚、完整地描述,显然,所描述的实施例仅是本技术一部分实施例,而不是全部的实施例。

38.在本技术实施例的描述中,“示性的”、“例如”或者“举例来说”等词用于表示作例子、例证或说明。本技术实施例中被描述为“示性的”、“例如”或者“举例来说”的任何实施例或设计方案不应被解释为比其它实施例或设计方案更优选或更具优势。确切而言,使用“示性的”、“例如”或者“举例来说”等词旨在以具体方式呈现相关概念。此外,术语“第一”、“第二”仅用于描述目的,而不能理解为指示或暗示相对重要性或者隐含指明所指示的技术特

征。由此,限定有“第一”、“第二”的特征可以明示或者隐含地包括一个或者更多个该特征。术语“包括”、“包含”、“具有”及它们的变形都意味着“包括但不限于”,除非是以其他方式另外特别强调。

39.专业名词:增强现实:增强现实(augmented reality,ar)技术是一种将虚拟信息与真实世界巧妙融合的技术,广泛运用了多媒体、三维建模、实时跟踪及注册、智能交互、传感等多种技术手段,将计算机生成的文字、图像、三维模型、音乐、视频等虚拟信息模拟仿真后,应用到真实世界中,两种信息互为补充,从而实现对真实世界的“增强”。

40.广角畸变:广角畸变是指用广角镜头拍摄的特写照片,广角镜头是一种焦距短于标准镜头、视角大于标准镜头、焦距长于鱼眼镜头、视角小于鱼眼镜头的摄影镜头。广角镜头又分为普通广角镜头和超广角镜头两种。

41.以下结合附图1-5对本技术作进一步详细说明。

42.本技术实施例公开一种执法记录仪定位方法。

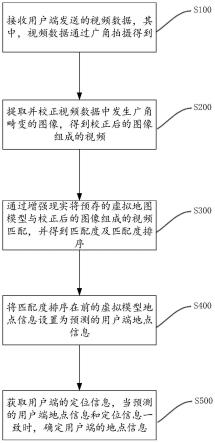

43.参考图1,一种执法记录仪定位方法包括步骤s100~s500。

44.步骤s100:接收用户端发送的视频数据,其中,视频数据通过广角拍摄得到。

45.步骤s100之前包括步骤s110。

46.步骤s110:对用户端进行初始化校准。

47.具体为:当警员a接在外出巡查时,遇到一些突发事件,此时需要对警员a进行定位,以获取警员a的地理位置。此时,警员a将执法记录仪开机,执法记录仪通过无线通讯和服务器连接。警员a打开拍摄功能后,服务器向开机并即将使用拍摄功能的警员a的执法记录仪发送初始化校准的信号。在本实施例中具体为在警员a的执法记录仪显示界面上,提示警员a根据显示界面上的“8”的轨迹移动执法记录仪,以提高警员a所使用的执法记录仪的精确度。

48.在警员a完成对执法记录仪的初始化校准后,对所发生的违法事件进行拍摄。在本实施例中,具体为,当机动车驾驶员开车不系安全带时,将其拦截在路边,并打开拍摄功能,对驾驶员、车身及车牌进行拍摄,并打开广角,拍摄周边的环境,广角拍摄有利于提高摄像视野的宽广度,增加画面的空间纵深感。

49.步骤s200:提取并校正视频数据中发生广角畸变的图像,得到校正后的图像组成的视频。

50.具体为:当警员a拍摄完成后,拍摄完成的视音频自动上传至服务器端。此时服务器端提取视频中发生广角畸变的图像,并对这些图像进行校正,得到校正后的视频。

51.参考图2,步骤s200包括步骤s210~s250。

52.步骤s210:获取发生广角畸变的图像,其中,广角畸变的图像信息处于空间直角坐标系一个平面中的同一圆形区域中。

53.具体为:服务器获取警员a发送的视频的帧率,根据帧率对图片进行提取,即得到图像。在本实施例中,警员a发送的视频帧率为12,那么每隔12帧提取一次即可得到对应的图像。视频是通过广角拍摄得到的,因此图像均为发生广角畸变的图像。

54.步骤s220:通过半球面修复广角畸变图像后,获取广角畸变图像在半球面上的第一投影图像,其中,半球面处于空间直角坐标系中。

55.步骤s220包括步骤s221~s222。

56.步骤s221:在空间直角坐标系的一个平面中,计算得到广角畸变图像的圆心坐标及半径。

57.步骤s222:将半球面覆盖于广角畸变图像上,半球面的球心坐标与广角畸变图像的圆心坐标重合,半球面的半径与广角畸变图像的半径相等。

58.具体为:在空间坐标系xyz中,广角畸变图像由于焦距变短,因此广角畸变图像的有效信息均处于一个圆形区域中。在本实施例中,广角畸变图像处于xoy平面中,此时,广角畸变图像可以用(x,y,0)表示,在xoy平面内的圆心坐标(x0,y0,0),半径为r。利用半球面对广角畸变图像进行修复,将球心坐标为(x0,y0,0),半径为r的半球面覆盖在广角畸变图像上。其后,将广角畸变图像校正为180度视角空间,即获取超广角畸变图像a(x,y)在半球面上的投影图像q(x,y,z)。

59.步骤s230:在除广角畸变图像所在平面外的另一坐标轴方向,对第一投影图像的坐标点,通过校正公式进行处理以完成畸变校正,得到第二投影图像。

60.具体为:在z轴的方向对投影图像q进行畸变校正,获得新的投影图像。根据畸变前的像素点、校正公式及校正系数,得到畸变校正后的像素点,进而得到校正后的图像q1。

61.步骤s240:将第一投影图像和第二投影图像在同一平面上投影,并得到对应的第一视平面投影图像及第二视平面投影图像。

62.具体为:在空间直角坐标系xyz中找到任意一个平面efgh,将图像q和图像q1投影至平面efgh上,分别得到对应的视平面投影图像。

63.步骤s250:将对应的第一视平面投影图像及第二视平面投影图像进行加权处理,得到校正后的图像,进而得到校正后的图像组成的视频。

64.具体为:根据一个加权系数t,其中t为0至1内的数值,和视平面投影图像的坐标点进行计算,得到新的坐标点组成的图像。将新的坐标点组成的图像根据视频的帧率组合成为新的校正后的视频。

65.步骤s300:通过增强现实将预存的虚拟地图模型与校正后的图像组成的视频匹配,并得到匹配度及匹配度排序。

66.步骤s300还包括步骤s310~s320。

67.步骤s310:提取虚拟地图模型中的第一场景特征,和视频中的第二场景特征。

68.步骤s320:将第一场景特征和第二场景特征进行匹配,并得到匹配度。

69.步骤s330:若匹配度超过预设的匹配度阈值,且超过预设匹配度阈值的虚拟地图模型的数量为至少一个,则将至少一个虚拟地图模型根据匹配度进行排序。

70.参考图3,具体为:当服务器得到校正后的图像后,通过ar技术,将预存的3d虚拟地图模型和视频进行匹配,具体为,将视频场景中的场景特征和3d虚拟地图模型中的场景特征进行匹配,例如,视频中的场景特征有5个路灯、5棵香樟树、在5棵香樟树中间位置的后方有一家大型超市以及在超市的隔壁有一家咖啡店。3d虚拟地图模型中地区o的场景特征与视频中的场景特征一致,那么得到场景特征的匹配度为100%。在3d虚拟地图模型中另一个地区p的场景特征为5个路灯、5棵香樟树、在5棵香樟树中间位置的后方有一家咖啡店,同时咖啡店楼下有一家便利店。此时场景特征的匹配度不足100%,但是超过了预设的匹配度阈值。那么将地区o和p根据匹配度进行排序。

71.步骤s400:将匹配度排序在前的虚拟模型地点信息设置为预测的用户端地点信息。

72.具体为:在本实施例中为将匹配度为100%的虚拟模型地点o所在区域范围设置为预测的用户端地点。

73.步骤s500:获取用户端的定位信息,当预测的用户端地点信息和定位信息一致时,确定用户端的地点信息。

74.具体为:通过gps定位或北斗定位,获取警员a所使用的执法记录仪的具体地理位置,如果执法记录仪的具体地理位置和预测的地区o的地理位置信息一致的时候,那么就确定警员a的地点信息,以便于在必要时通知其他警员出警。

75.在另一实施例中,若用户端的经纬位置处于预测的用户端地点范围外,则确定预测的用户端地点信息为用户端的地点信息。

76.具体为:当通过gps定位的警员a的地理位置不在预测的地区o的位置范围内时,存在警员a所持的执法记录仪在地区o的信号不佳的情况,此时直接确定预测的地区o的地点信息为警员a所在的地理区域。

77.参考图4,在再一实施例中,管理员可通过密码登陆执法记录仪管理软件,将出现多次出警行为的地理位置进行标注,以便于下次快速地对警员进行定位。

78.本技术另一实施例公开一种执法记录仪定位装置。

79.参考图5,一种执法记录仪定位装置包括:获取模块1、处理模块2及判断模块3。获取模块1用于接收用户端发送的通过广角拍摄的视频数据,用于获取用户端的定位信息。

80.处理模块2用于提取并校正视频数据中发生广角畸变的图像,得到校正后的图像组成的视频;用于通过增强现实将虚拟地图模型与校正后的图像组成的视频匹配,并得到匹配度;用于将匹配度排序在前的虚拟模型地点信息设置为预测的用户端地点信息;用于当预测的用户端地点信息和定位信息一致时,确定用户端的地点信息。

81.判断模块3用于判断预测的用户端地点信息和定位信息是否一致。

82.在另一可能的实施例中,获取模块1用于获取广角畸变图像,其中,广角畸变图像的信息处于空间直角坐标系一个平面中的同一圆形区域中;获取广角畸变图像在半球面上的第一投影图像,其中,半球面处于空间直角坐标系中。处理模块2用于通过半球面修复广角畸变图像,在除广角畸变图像所在平面外的另一坐标轴的方向,对第一投影图像的坐标点通过预设的校正公式进行处理以完成畸变校正,得到第二投影图像;将第一投影图像和第二投影图像在同一平面上投影,并得到对应的第一视平面投影图像及第二视平面投影图像;将第一视平面投影图像及第二视平面投影图像进行加权处理,得到校正后的图像,进而得到校正后的图像组成的视频。

83.在另一可能的实施例中,获取模块1用于接收地图信息。处理模块2用于根据地图信息绘制虚拟地图模型,并存储虚拟地图模型。

84.在另一可能的实施例中,处理模块2用于对用户端进行初始化校准。

85.在另一可能的实施例中,获取模块1用于当确定用户端的地点信息后,获取校正后的图像组成的视频中的场景特征的数量及虚拟地图模型中的场景特征的数量。处理模块2用于若视频中的场景特征的数量多于虚拟地图模型中的场景特征的数量,则根据视频中的场景特征对虚拟地图模型的场景特征进行更新。判断模块3用于判断若视频中的场景特征

的数量是否多于虚拟地图模型中的场景特征的数量。

86.在另一可能的实施例中,获取模块1用于获取超过预设匹配度阈值的虚拟地图模型的数量。处理模块2用于提取虚拟地图模型中的第一场景特征,和视频中的第二场景特征,将第一场景特征和第二场景特征进行匹配,并得到匹配度;若匹配度超过预设的匹配度阈值,且超过预设匹配度阈值的虚拟地图模型的数量为至少一个,则将至少一个的虚拟地图模型根据匹配度进行排序。判断模块3用于判断匹配度是否超过预设的匹配度阈值。

87.在另一可能的实施例中,处理模块2用于在空间直角坐标系的一个平面中,计算得到广角畸变图像的圆心坐标及半径。用于将半球面覆盖于广角畸变图像上,半球面的球心坐标与广角畸变图像的圆心坐标重合,半球面的半径与广角畸变图像的半径相等。

88.在另一可能的实施例中,获取模块1用于接收用户端发送的信号,并获取用户端的定位信息。处理模块2用于若用户端的定位信息处于预测的用户端地点范围内,则确定用户端的地点信息。判断模块3用于判断用户端的定位信息是否处于预测的用户端地点范围内。

89.在另一可能的实施例中,处理模块2用于若用户端的经纬位置处于预测的用户端地点范围外,确定预测的用户端地点信息为用户端的地点信息。判断模块3用于判断用户端的经纬位置是否处于预测的用户端地点范围外。

90.本技术实施例一种执法记录仪定位装置的实施原理为:当服务器的获取模块1接收到警员a通过广角拍摄的视频数据后,处理模块2提取视频中发生广角畸变的图像帧,并对这些发生广角畸变的图像帧进行校正。将完成校正的图像帧组成视频,并通过增强现实的方法,与预存的虚拟地图模型进行匹配,并得到匹配度。将匹配度排序在前的虚拟模型的地点信息作为预测的用户端地点信息,以便于后续确定用户端实际的地点信息。

91.获取模块1接收警员a所持执法记录仪的定位信息,通过判断模块3判断警员a所持执法记录仪的定位信息和预测的警员a的地点信息是否一致。当警员a所持执法记录仪的定位信息和预测的警员a的地点信息一致时,处理模块2确定警员a的地点信息。通过广角拍摄视频,有利于扩大拍摄范围,提高后续定位的准确性。通过与预存的虚拟地图模型进行匹配得到预测的用户端地点信息,并根据预测的地点与接收到警员a所持执法记录仪的定位是否一致的信息确定警员a的位置,有利于进一步提高对警员a所持执法记录仪的定位精确度。

92.需要说明的是:上述实施例提供的装置在实现其功能时,仅以上述各功能模块的划分进行举例说明,实际应用中,可以根据需要而将上述功能分配由不同的功能模块完成,即将设备的内部结构划分成不同的功能模块,以完成以上描述的全部或者部分功能。另外,上述实施例提供的装置和方法实施例属于同一构思,其具体实现过程详见方法实施例,这里不再赘述。

93.本具体实施方式的实施例均为本技术的较佳实施例,并非依此限制本技术的保护范围,故:凡依本技术的结构、形状、原理所做的等效变化,均应涵盖于本技术的保护范围之内。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1