一种基于深度神经网络声学模型的降维剪枝方法与流程

1.本发明涉及一种剪枝方法,特别是涉及一种基于深度神经网络声学模型的降维剪枝方法,属于机器学习技术领域。

背景技术:

2.随着计算机技术的发展,深度学习能够通过获取样本信息学习样本数据之间的内在规律和表示层次,进而能够实现样本图像、语言、声音和文字的学习,尤其是在语言识别方面,融合深度置信网络和受限玻尔兹曼机技术,极大程度上提升了语音识别的准确率,为现在的语音识别系统做出了重要的贡献,但是现在的语音识别声学模型在采用深度神经网络技术的前提下不能够得到广泛推广,很大原因是有限的计算配置无法满足深度神经网络声学模型庞大的计算需求,大规模的数据样本以及复杂的样本训练算法使得计算成本提升。因此,本发明提出一种降维剪枝方法,对深度神经网络声学模型中的硬剪枝筛选器和软剪枝筛选器进行降维,同时融合硬剪枝方法和软剪枝方法的优势,既具有软剪枝优良的搜索空间,又具备硬剪枝优良的剪枝精度和中等的收敛速度,在部分性能损失的前提下完成对深度神经网络的压缩,有助于降低深度神经网络声学模型的计算成本。

技术实现要素:

3.本发明的主要目的是为了解决现有深度神经网络声学模型在进行语音识别的过程中训练算法复杂且数据样本庞大,导致深度神经网络声学模型计算成本高的不足,而提供的一种基于深度神经网络声学模型的降维剪枝方法。

4.本发明的目的可以通过采用如下技术方案达到:

5.一种基于深度神经网络声学模型的降维剪枝方法,包括如下步骤:

6.s1.选择语音数据样本,并获取语音对应文本文件;

7.s2.创建语音识别深度神经网络:将网络中卷积层的总数设为k,在序号为i的卷积层内卷积核维数设为a

×b×d×

d,其中1≤i≤k, d记为卷积核的大小,b和a分别表示输入的通道数量和输出的通道数量,将第i层的输入张量设为ii,输入张量ii的空间尺寸为b

×hi

×

δi,其中hi为输入张量的宽度,δi记为输入张量的高度,将输出张量满足:

[0008][0009]

oi=y

i,j

*ii,

[0010]

其中,j记为输出通道的序号,oi是第i层卷积层的第j个输出通道,且满足y

i,j

记为第i层卷积层的第j个筛选器,且满足y

i,j

∈rb×d×d;

[0011]

s3.为软剪枝筛选器设置过渡衰变系数:将第i层剪枝率记为qi,删除第i层的a

×

qi个筛选器,修改后的输出张量尺寸变为 a

×

(1-qi)

×hi+1

×

δ

i+1

,对第i层修剪,修剪公式为:

[0012]

[0013]

式中:z

i,j

记为筛选器y

i,j

的布尔掩码,记为剪枝后得到的筛选器,

⊙

记为向量元素依次相乘的运算符号,j的取值范围为[1,a],如果y

i,j

被修剪,z

i,j

=0,如果y

i,j

未被修改,z

i,j

=1,θ记为软剪枝筛选器的过渡衰变系数,θ设为单调递减的函数,且满足0≤θ≤1,在0《θ≤ 1时,部分废弃剪枝筛选器的训练信息,但是因为剪枝筛选器不归零导致软剪枝模型不紧凑,设置过渡衰变系数θ,使得θ从1逐渐衰减到0,过渡衰变系数θ设为关于训练时数和的指数衰减函数,过渡衰变系数的公式为:

[0014][0015]

式中:θv(t)记为训练时数和为t的过渡衰变系数函数值,θ0记为渐进软剪枝和二次渐进软剪枝情况下的过渡衰变系数值,且此时θ0=1,t

hm

记为训练最大时数和,t的取值范围为[0,t

hm

),μ为衰变调节系数,μ无线趋近于0时满足:

[0016]

θv(t

hm-1)=μ,

[0017]

过渡衰变系数θ无限趋近于零的时候,软剪枝模型变成紧凑的软剪枝模型;

[0018]

s4.为硬剪枝筛选器设置过渡增长系数:在第i层卷积层内的第t 代的剪枝率为qi(t)时,将qi(t)

×

a个通道设为零,在通道中将具有最小l

2-范数的通道使用硬剪枝方法剪枝,具有最小l

2-范数通道的个数为同时,软剪枝方法剪枝的通道数为同时,软剪枝方法剪枝的通道数为其中记为过渡增长系数的函数值,同时利用一个单调递增的过渡增长系数控制硬剪枝的修剪占比,且过渡增长系数从0 逐渐增加到1,过渡增长系数的公式为:

[0019][0020]

式中:记为第i层卷积层内初始过渡增长系数的值,记为最终过渡增长系数函数值,且t的取值范围为[0,t

hm

);

[0021]

s5.为语音识别深度神经网络设置参数降维合并内核:利用维数为a

×b×d×

d的卷积核yi与一个维数为a

×

a(1-qi)的降维矩阵dr 相乘,经过反复训练学习降维矩阵dr,降维矩阵利用自然数直接驱动,卷积核yi利用两个不对称的辅助卷积核y

i1

以及y

i2

分别联合两个辅助降维矩阵dr

out

和dr

in

进行强化训练,加倍扩增输入通道和输出通道,使用这两个辅助降维矩阵将两个辅助卷积核变成原始卷积核的尺寸,转换公式为:

[0022]yi-m

=yi+γ1f

out

(dr

out

,y

i1

)+γ2f

in

(dr

in

,y

i2

),

[0023]

式中:y

i-m

记为强化卷积核,f

out

(dr

out

,y

i1

)和f

in

(dr

in

,y

i2

)分别记为辅助卷积核y

i1

和y

i2

的控制矩阵,γ1和γ2分别记为两个常数掩模,掩模的维度为d

×

d,将辅助卷积核y

i1

和y

i2

控制矩阵f

out

(dr

out

,y

i1

)和 f

in

(dr

in

,y

i2

)分别转化为a

×b×1×

d维和a

×b×d×

1维,约束两个辅助卷积核,学习不同信息,

[0024]

s6.对语音数据样本进行识别,为识别的语音设定评分标准,进行准确度评分。

[0025]

作为本发明进一步的方案,s1中的语音数据样本利用爬虫技术从公共语音库获取。

[0026]

作为本发明进一步的方案,s3中当θ=0时,软剪枝和渐进软剪枝分别是二次软剪

枝和二次渐进软剪枝的特殊情况,硬剪枝筛选与渐进软剪枝筛选的剪枝率都是从0逐渐增加到最终的剪枝率,将硬剪枝筛选看作是渐进软剪枝除了停止更新修剪筛选外θ=0的特例,渐变掩模的公式为:

[0027][0028]

式中:记为渐变掩模,s

i,j

记为剪枝筛选器z

i,j

的渐变率,只针对未经修剪的剪枝筛选器更新权重。

[0029]

作为本发明进一步的方案,s4中将设为0,将设为1,将t

hm

设为200。

[0030]

作为本发明进一步的方案,s5中联合训练的三个非对称卷积核使用联合加法合并输出。

[0031]

作为本发明进一步的方案,s6中语音识别评分标准公式为:

[0032][0033]

式中:pr记为语音识别综合得分,p1记为第一准确度,用于表示识别字数占总字数百分比大于等于0且小于40%的百分比;p2记为第一准确度,用于表示识别字数占总字数百分比大于等于40%且小于 60%的百分比;p3记为第三准确度,用于表示识别字数占总字数百分比大于等于60%且小于等于100%的百分比。

[0034]

本发明的有益技术效果:按照本发明的基于深度神经网络声学模型的降维剪枝方法,通过对软剪枝筛选设置从1到0逐渐衰减的过渡衰变系数,再对硬剪枝设置从0到1逐渐递增的过渡增长系数能够融合硬剪枝和软剪枝的优势,使得剪枝既具备软剪枝优良的搜索空间又具备硬剪枝优良的剪枝精度,使得声学模型更加紧凑,在部分性能损失的前提下完成对深度神经网络的压缩,参数降维合并内核的设置能够优化计算,有助于降低深度神经网络声学模型的计算成本。

附图说明

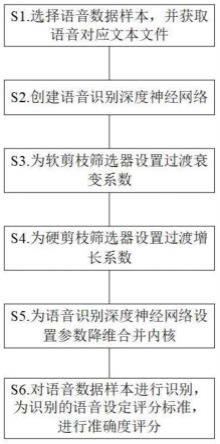

[0035]

图1为按照本发明的基于深度神经网络声学模型的降维剪枝方法流程图。

具体实施方式

[0036]

为使本领域技术人员更加清楚和明确本发明的技术方案,下面结合实施例及附图对本发明作进一步详细的描述,但本发明的实施方式不限于此。

[0037]

如下步骤:

[0038]

s1.选择语音数据样本,并获取语音对应文本文件;

[0039]

其中,s1中的语音数据样本利用爬虫技术从公共语音库获取。

[0040]

s2.创建语音识别深度神经网络:将网络中卷积层的总数设为k,在序号为i的卷积层内卷积核维数设为a

×b×d×

d,其中1≤i≤k, d记为卷积核的大小,b和a分别表示输入的通道数量和输出的通道数量,将第i层的输入张量设为ii,输入张量ii的空间尺寸为b

×hi

×

δi,其中hi为输入张量的宽度,δi记为输入张量的高度,将输出张量满足:

[0041]

[0042]

oi=y

i,j

*ii,

[0043]

其中,j记为输出通道的序号,oi是第i层卷积层的第j个输出通道,且满足y

i,j

记为第i层卷积层的第j个筛选器,且满足y

i,j

∈rb×d×d;

[0044]

s3.为软剪枝筛选器设置过渡衰变系数:将第i层剪枝率记为qi,删除第i层的a

×

qi个筛选器,修改后的输出张量尺寸变为 a

×

(1-qi)

×hi+1

×

δ

i+1

,对第i层修剪,修剪公式为:

[0045][0046]

式中:z

i,j

记为筛选器y

i,j

的布尔掩码,记为剪枝后得到的筛选器,

⊙

记为向量元素依次相乘的运算符号,j的取值范围为[1,a],如果y

i,j

被修剪,z

i,j

=0,如果y

i,j

未被修改,z

i,j

=1,θ记为软剪枝筛选器的过渡衰变系数,θ设为单调递减的函数,且满足0≤θ≤1,在0《θ≤ 1时,部分废弃剪枝筛选器的训练信息,但是因为剪枝筛选器不归零导致软剪枝模型不紧凑,设置过渡衰变系数θ,使得θ从1逐渐衰减到0,过渡衰变系数θ设为关于训练时数和的指数衰减函数,过渡衰变系数的公式为:

[0047][0048]

式中:θv(t)记为训练时数和为t的过渡衰变系数函数值,θ0记为渐进软剪枝和二次渐进软剪枝情况下的过渡衰变系数值,且此时θ0=1,t

hm

记为训练最大时数和,t的取值范围为[0,t

hm

),μ为衰变调节系数,μ无线趋近于0时满足:

[0049]

θv(t

hm-1)=μ,

[0050]

过渡衰变系数θ无限趋近于零的时候,软剪枝模型变成紧凑的软剪枝模型;

[0051]

s3中当θ=0时,软剪枝和渐进软剪枝分别是二次软剪枝和二次渐进软剪枝的特殊情况,硬剪枝筛选与渐进软剪枝筛选的剪枝率都是从0逐渐增加到最终的剪枝率,将硬剪枝筛选看作是渐进软剪枝除了停止更新修剪筛选外θ=0的特例,渐变掩模的公式为:

[0052][0053]

式中:记为渐变掩模,s

i,j

记为剪枝筛选器z

i,j

的渐变率,只针对未经修剪的剪枝筛选器更新权重。

[0054]

s4.为硬剪枝筛选器设置过渡增长系数:在第i层卷积层内的第t 代的剪枝率为qi(t)时,将qi(t)

×

a个通道设为零,在通道中将具有最小l

2-范数的通道使用硬剪枝方法剪枝,具有最小l

2-范数通道的个数为同时,软剪枝方法剪枝的通道数为同时,软剪枝方法剪枝的通道数为其中记为过渡增长系数的函数值,同时利用一个单调递增的过渡增长系数控制硬剪枝的修剪占比,且过渡增长系数从0 逐渐增加到1,过渡增长系数的公式为:

[0055][0056]

式中:记为第i层卷积层内初始过渡增长系数的值,记为最终过渡增长系数函数值,且t的取值范围为[0,t

hm

);

[0057]

s4中将设为0,将设为1,将t

hm

设为200。

[0058]

s5.为语音识别深度神经网络设置参数降维合并内核:利用维数为a

×b×d×

d的卷积核yi与一个维数为a

×

a(1-qi)的降维矩阵dr 相乘,经过反复训练学习降维矩阵dr,降维矩阵利用自然数直接驱动,卷积核yi利用两个不对称的辅助卷积核y

i1

以及y

i2

分别联合两个辅助降维矩阵dr

out

和dr

in

进行强化训练,加倍扩增输入通道和输出通道,使用这两个辅助降维矩阵将两个辅助卷积核变成原始卷积核的尺寸,转换公式为:

[0059]yi-m

=yi+γ1f

out

(dr

out

,y

i1

)+γ2f

in

(dr

in

,y

i2

),

[0060]

式中:y

i-m

记为强化卷积核,f

out

(dr

out

,y

i1

)和f

in

(dr

in

,y

i2

)分别记为辅助卷积核y

i1

和y

i2

的控制矩阵,γ1和γ2分别记为两个常数掩模,掩模的维度为d

×

d,将辅助卷积核y

i1

和y

i2

控制矩阵f

out

(dr

out

,y

i1

)和 f

in

(dr

in

,y

i2

)分别转化为a

×b×1×

d维和a

×b×d×

1维,约束两个辅助卷积核,学习不同信息,

[0061]

s5中联合训练的三个非对称卷积核使用联合加法合并输出。

[0062]

s6.对语音数据样本进行识别,为识别的语音设定评分标准,进行准确度评分。

[0063]

s6中语音识别评分标准公式为:

[0064][0065]

式中:pr记为语音识别综合得分,p1记为第一准确度,用于表示识别字数占总字数百分比大于等于0且小于40%的百分比;p2记为第一准确度,用于表示识别字数占总字数百分比大于等于40%且小于 60%的百分比;p3记为第三准确度,用于表示识别字数占总字数百分比大于等于60%且小于等于100%的百分比。

[0066]

通过评价标准的设置能够结合三种准确度占比的语音文件数量占整体样本文件数量的百分比,能够分阶对三种程度语音识别准确度进行综合考虑,使得评分标准更加合理。

[0067]

综上,本发明通过对软剪枝筛选设置从1到0逐渐衰减的过渡衰变系数,再对硬剪枝设置从0到1逐渐递增的过渡增长系数能够融合硬剪枝和软剪枝的优势,使得剪枝既具备软剪枝优良的搜索空间又具备硬剪枝优良的剪枝精度,使得声学模型更加紧凑,在部分性能损失的前提下完成对深度神经网络的压缩,参数降维合并内核的设置能够优化计算,有助于降低深度神经网络声学模型的计算成本。

[0068]

以上所述,仅为本发明进一步的实施例,但本发明的保护范围并不局限于此,任何熟悉本技术领域的技术人员在本发明所公开的范围内,根据本发明的技术方案及其构思加以等同替换或改变,都属于本发明的保护范围。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1