基于数据自选择与标记自校正算法的图像偏差数据分类方法

1.本发明属于图像识别领域和深度学习技术领域,涉及图像偏差数据的分类,特别涉及一种基于数据自选择与标记自校正算法的图像偏差数据分类方法。

背景技术:

2.近些年,图像识别领域得益于深度神经网络等机器学习技术,取得了令人瞩目的成就。而这些成功应用大多建立在收集的图像训练数据容量大、样本标记质量高的理想前提下。由于充分的图像训练数据资源能够忠实地反映测试/评估环境分布,因而具有强大拟合能力的深度神经网络在其基础上往往能够获得对于测试数据具有良好泛化能力的标记识别函数。然而,为了避免获取高质量标记数据集所耗费巨大人力与物力资源消耗,越来越多的真实场景应用往往需要借助类似于众包或搜索引擎等手段来粗略获取标记数据资源。而通过此类方式获得的训练数据往往并不具备预期的高质量标准,导致训练数据并不能准确体现真实的测试环境的内在特性,进而导致所谓数据分布偏差问题,即在训练数据上习得的识别函数无法有效泛化应用于测试环境的严重问题。这种数据偏差问题领域内公认最常见的类型有两种。一是类不均衡图像数据偏差,即训练数据不同类别数据量存在显著差异的问题;二是弱标记图像数据偏差,即数据标记中存在大量模糊甚至错误的标记,典型的例子如噪音标注,缺失标注,以及多个候选标记,这分别对应于图像识别领域的标记噪音学习,半监督学习和偏标记学习。因此对这类偏差数据进行有效学习是图像识别领域十分重要的问题,也是将图像识别算法应用到真实场景必须突破的富有挑战的技术基础。

3.解决这类问题的核心思想是发展样本选择和标记校正技术。数据选择技术主要通过评估数据质量来对其进行针对性遴选或不同程度抑制/放大其在训练中发挥的作用,标记校正技术需要挑选出数据中蕴含错误标记的样本并对其标记进行校正并将其在训练中重新利用。近年来,多种思路不同的数据样本选择和标记校正方案被提出,但是距离实用性还有很大距离。这主要是由两点导致的,一是现有的方案需要过多人工干预,如人工设定挑选多少样本参与到训练中,人工设定标签生成规则;二是现有的方案大多是针对特定图像识别任务进行特别设计,缺乏对广泛图像识别任务的通用性、一般性与普适性。

技术实现要素:

4.为了克服上述现有技术的缺点,本发明的目的在于提供一种基于数据自选择与标记自校正算法的图像偏差数据分类方法。

5.为了实现上述目的,本发明采用的技术方案是:

6.基于数据自选择与标记自校正算法的图像偏差数据分类方法,包括如下步骤:

7.s1:获取图像训练数据集d和元数据集设定批尺寸大小n,m,最大迭代次数t,时间集成动量α∈[0,1),teacher模型权值平均动量β∈[0,1),beta分布超参数γ》0;

[0008]

s2:初始化分类器模型参数w

(0)

和cmw-net模型参数θ

(0)

,初始化平均预测z

(0)

=0[n

×

c]

,teacher模型权值

[0009]

s3:对所有图像训练数据集d的c个类别的样本数进行k均值聚类,将其聚类中心升序排序,获得实现对图像偏差数据集的任务层次的偏差特征提取;

[0010]

s4:分别从图像训练数据集d和元数据集随机选取mini-batch样本:sampleminibatch(d;n)和产生参数λ~beta(γ,γ),设置λ为max(λ,1-λ);

[0011]

s5:计算teacher模型权值平均获得分类器模型的集成预测

[0012]

s6:利用批训练数据sampleminibatch(d;n),产生新的索引序列idx=torch.randperm(n),基于mixup数据增广方法生成新的数据通过随机梯度下降更新获得

[0013]

s7:利用元数据通过随机梯度下降更新获得θ

(t+1)

;

[0014]

s8:重新利用训练数据sampleminibatch(d;n),以及s6生成的新的数据使用随机梯度下降更新获得w

(t+1)

;

[0015]

s9:重复s4-s8,经过t次停机,输出w

(t)

和θ

(t)

,其中w

(t)

和θ

(t)

是算法最终获得的分类器模型和cmw-net模型;得到的w

(t)

完成了基于图像偏差训练数据集d的鲁棒学习,利用得到的w

(t)

对新的图像偏差数据进行高质量的标记预测。

[0016]

与现有技术相比,本发明的有益效果是:

[0017]

1)本发明的元学习器,称之为cmw-net,是一个只有单隐层的多层感知器网络,可以实现对具有相似数据偏差类型的任务进行其共有的权值函数学习,而排除掉预期偏差性质相异任务的有害干扰,从而有望对各个类别任务得到更为准确、更有针对性的合理权值函数设计规律。因而可以适应不同图像数据偏差问题,实现样本自选择和标记自校正功能。

[0018]

2)不同于现有方法需要对每个图像数据偏差问题人工单独设计识别,本发明使用统一的自动化识别方法,可以在广泛图像数据偏差问题上达到sota表现,如图像识别领域的类不平衡,特征无关、特征相关以及真实的标记噪音,半监督学习,偏标记学习等。

[0019]

3)本发明习得的cmw-net模型蕴含着对复杂偏差数据的赋权规律总结,通过从小尺度的图像数据集上训练好的cmw-net模型,可以即插即用地迁移到大尺度图像数据集上的赋权设计。因为样本赋权规律已直接设定而无须对其付出计算代价重新计算,将其直接嵌入在大尺度图像偏差数据集上分类算法之中,辅助算法自动调整样本在算法中发挥的作用,从而实现简单高效的样本自选择和标记自校正算法功能。

附图说明

[0020]

利用附图对本发明作进一步的说明,但附图中的内容不构成对本发明的任何限制。

[0021]

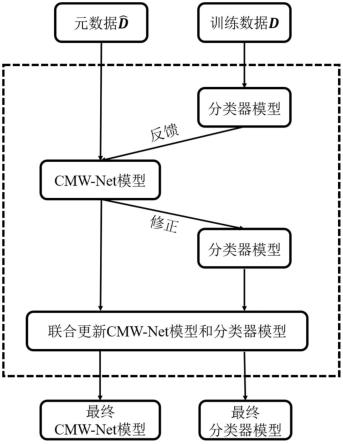

图1为本发明的流程图。

[0022]

图2为本发明提出的cmw-net模型示意图。

[0023]

图3展示的是本发明方法在图像领域类不均衡偏差数据上的性能表现。

[0024]

图4展示的是本发明方法在图像领域特征无关标记噪音的偏差数据上的性能表现。

[0025]

图5展示的是本发明方法在图像领域特征相关标记噪音的偏差数据上的性能表现。

[0026]

图6展示的是本发明方法在图像领域真实标记噪音的偏差数据上的性能表现。

[0027]

图7展示的是本发明方法在图像领域不同偏差数据下习得的背后赋权规律的可视化。

[0028]

图8展示的是本发明方法习得的cmw-net模型迁移到图像领域公开的最大规模webvision真实偏差数据上的自动赋权设计,获得的性能表现。

[0029]

图9展示的是本发明方法在图像领域偏标记学习的偏差数据上的性能表现。

[0030]

图10展示的是本发明方法在图像领域半监督学习的偏差数据上的性能表现。

具体实施方式

[0031]

下面结合附图和实施例详细说明本发明的实施方式。

[0032]

如前所述,当前使用的图像识别方法通常假设训练集和测试集分布一致,而实际图像识别场景中收集的训练集与理想的测试集存在数据偏差现象,这导致在训练集上学习好的图像分类算法在测试集上性能很差。

[0033]

考虑到图像识别现实应用中的数据形式复杂多样,图像识别任务差异性显著,发展对多种异源图像识别任务适用的数据自选择和标记自校正普适算法对推动图像识别,特别是图像识别领域深度学习算法,在真实应用场景中有效应用具有重大促进价值。

[0034]

基于此,本发明提供了一种基于数据自选择与标记自校正算法的图像偏差数据分类方法,能够在不同的偏差训练数据下,通过对样本进行自动赋权和标记生成,实现对有效训练数据的遴选与错误标记的校正,显著提升对图像偏差数据的分类性能。

[0035]

在本发明的方法中,首先获取蕴含图像数据偏差问题的图像训练数据集以及构建少量干净无偏的元数据集;相对于在图像训练数据集上建立的分类器模型,在元数据集上建立一个具有自动赋权功能的元学习器cmw-net;利用随机梯度下降算法联合更新分类器模型和cmw-net模型,即通过分类器模型梯度下降格式得到分类器模型梯度更新函数;将其反馈给cmw-net模型,并利用元数据得到cmw-net模型参数更新,从而得到修正的分类器模型参数梯度格式;然后利用此修正格式完成分类器模型参数更新。据此,通过cmw-net模型的自适应赋权学习实现对图像偏差数据的数据自选择与标记自校正,进而保证对分类器模型的有效训练,获得对测试数据具有良好泛化能力的可靠标记预测函数。本发明具有易于用户理解、实现和可解释性等特点,使其能够鲁棒地适用于蕴含各类图像数据偏差的复杂应用场景,如图像领域的类不平衡,特征无关、特征相关以及真实的标记噪音,半监督学习,偏标记学习等。

[0036]

如图1所示,本发明方法具体可通过如下步骤和公式详细描述。

[0037]

s1:获取图像训练数据集和元数据集

其中xi为第i个图像训练样本,yi是xi对应的噪音标记,是第i个图像元样本,是对应的干净标记;n,m分别是图像训练数据集和元数据集的尺寸大小,设定批尺寸大小n,m,最大迭代次数t,时间集成动量α∈[0,1),模型权值平均动量β∈[0,1),beta分布超参数γ》0。

[0038]

对于一个分类问题,图像训练数据集d指含有数据偏差的图像数据(图像数据的标记存在噪音,图像数据类别分布不均衡),元数据集指构造的少量的没有偏差的图像数据集(图像数据的标记干净,图像数据类别分布均衡),表示潜在的真实的样本-标签无偏分布的元知识。相比于图像训练数据d包含数据偏差(如标记存在噪音,数据类别分布不均衡),额外构造一批无偏差的元数据集(标记干净,数据类别分布均衡)。在实际问题中,一般通过挑选训练数据中每类训练损失最小的数据,且每类挑选的图像数据数目相同,从而构建元数据集考虑到这样构建的元数据集会挑选简单模式样本,采用mixup数据增广的方式提高元数据的多样性。特别地,每个训练轮次都会重新构建元数据集,因此其能够随着训练过程动态改变。

[0039]

s2:初始化分类器模型参数w

(0)

和cmw-net模型参数θ

(0)

,初始化平均预测z

(0)

=0

[n

×

c]

,teacher模型权值其中c是图像训练数据集d包含的类别个数;图像偏差数据具有噪音标记和数据分布不均衡等特点,可以通过cmw-net模型的学习对每个样本施加一个0到1之间的权重,实现对有效图像训练数据的遴选与错误标记的校正,从而实现对图像偏差数据的鲁棒学习。

[0040]

分类器模型指在训练数据集d上希望学习得到的分类器f(x;w),可以是任何形式的机器学习模型,这里设置为一个深度网络模型。cmw-net模型试图通过元学习的学习方式,自动学习加权函数的格式,避免手动设计加权函数和参数预设等问题。

[0041]

一般地,通过对每个训练样本的损失施加权重v∈[0,1]来遴选对训练有益的图像数据样本,即通过极小化下面的加权损失来获取分类器模型的最优参数,进而增强分类器模型的泛化性和鲁棒性:

[0042][0043]

其中l是分类损失函数,一般取交叉熵损失函数。w和w

*

分别是分类器模型的参数和最优参数,vi是对第i个图像训练样本施加的样本权重,n是训练数据集的尺寸大小;对于带有数据偏差的图像训练数据集d,样本重加权策略倾向于对噪声标记样本施加很小甚至零权重来压制这些样本在学习中的负面作用。然而非常遗憾的是,这种方式显然浪费了这些样本可能内在蕴含的对分类器学习有益的信息。因此,一种更为科学的方式是对这些样本进行标记校正,并尽可能把校正标记后的样本重新,方式如下:

[0044]

ls(f(x;w),y)=vl(f(x;w),y)+(1-v)l(f(x;w),z),

ꢀꢀꢀ

(2)

[0045]

其中,v∈[0,1],表示样本权重,z表示伪软标记,ls(f(x;w),y)表示对图像训练数据集d的噪声标记样本进行标记校正以后计算的样本损失函数;

[0046]

将损失设置为交叉熵形式时,损失函数(2)可以等价重写为:

[0047]

ls(f(x;w),y)=-(vy+(1-v)z)

t

log(f(x;w)),

ꢀꢀꢀ

(3)

[0048]

该损失可以理解为对数据x在对其原始标记y修正改进后的软标记vy+(1-v)z上计算而得,旨在利用修正的标记对该数据进行重新利用而非简单舍弃,取代于传统重加权方法简单粗暴的抑制或丢弃样本的学习方式,这种策略显然更加有利于充分利用数据信息,从而得到更好的训练效果。通过自适应确定v和z,可以实现对图像偏差数据的自选择与标记自校正功能。

[0049]

为此,本发明构建的cmw-net模型,旨在适应不同的图像数据偏差类型,对每个图像训练样本自适应施加权重可以将伪软标记z、样本权重v、分类器模型参数与cmw-net模型参数放置于一个元学习框架进行更新,优化目标函数为:

[0050][0051][0052]

其中θ

*

和w

*

(θ,ω)是最优的cmw-net模型参数和分类器模型参数,和分别对应在元数据集和在图像训练数据集d上计算的损失函数,是在图像训练数据集d基于产生的伪软标记z计算的损失函数,是cmw-net模型,θ,ω是其参数,ni表示第i个样本xi所属的训练类别中包含的样本数。

[0053]

此时,针对具有数据偏差的图像训练数据集d学习的分类器模型的最优参数可以通过分别优化目标函数(5)获得,通过cmw-net模型的控制,可以实现样本自选择与标记自校正功能。

[0054]

示例地,cmw-net模型由两个分支组成,如附图2所示。一个分支可以表示为其中ni(i=1,2,

…

,n),表示第i个样本xi所属的图像训练类别中包含的样本数。该分支以ni作为任务知识输入,包含一个k个节点构成的隐藏层,其节点分别以k个尺寸参数按升序赋值(即μ1《μ2《

…

《μk)。这一分支的输出是一个k维的one-hot向量,其1元素位于其第k维,对应于与输入ni最接近的μk,其余维度的向量值均为0。另一个分支可以表示为θ)∈[0,1]k,其构建方式为以第i个样本的损失值作为输入,整体架构为一个1-100-k的mlp网络结构,即输入为一个节点,输出为k个节点,隐层为100个节点,该mlp网络结构包含一个隐藏层和一个k维输出的权值向量。每个隐层节点的激活函数设置为relu函数,输出节点的激活函数设置为sigmoid函数,保证输出范围在[0,1]之间。从而,cmw-net模型权重函数表达为:

[0055][0056]

其中表示两个向量之间的点积。通过输入样本水平的特征和任务水平的特征ni,cmw-net能够集中具有类似数据偏差类型的任务类进行其相应权值函数的针对

性学习,并同时允许蕴含不同数据偏差性质的任务类拥有相应不同的赋权方案。这使得该元模型对具有复杂数据偏差的学习任务,具备了更大的灵活性以及适应性。cmw-net模型最优参数可以通过极小化在元数据集上的计算的元损失函数(4)获得。

[0057]

teacher模型与分类器模型的结构一致,其参数通过对分类器模型每一步更新的参数进行指数滑动平均累积以后获得,可以认为是对分类器模型通过集成的方式获得的新模型。其主要功能是为图像偏差数据中筛选的噪音样本进行标记预测,让其矫正原始的噪音标记。

[0058]

s3:对所有图像训练数据集d的c个类别的样本数进行k均值聚类,将其聚类中心升序排序,获得其中μk是每个聚类的中心,k是聚类的类个数;实现对图像偏差数据集的任务层次的偏差特征提取。

[0059]

在本发明的实施例中,仅需简单地将k设置为3,即可以保证算法稳定地获得非常良好的效果。在此聚类设置下,事实上所训练获得的cmw-net能够有效区分相对小型规模、中等规模以及大型规模的任务子类,其相应样本加权函数设置规律也被实验验证的确具有类内数据偏差类型相对一致,类间数据偏差类型相对差异明显的特点,因而也具有很好的解释性。此时,cmw-net模型的结构参数ω通过k-means的方式确定下来,接下来通过求解双边优化目标(4)(5)确定参数θ。

[0060]

s4:分别从图像训练数据集d和元数据集随机选取mini-batch样本:sampleminibatch(d;n)和产生参数λ~beta(γ,γ),设置λ为max(λ,1-λ),其中λ是mixup的超参数,beta(γ,γ)是参数为γ的beta分布。

[0061]

分类器模型和cmw-net模型通过随机梯度下降进行更新,在每步迭代过程中,从总的训练数据里面随机选取mini-batch的样本进行学习。此外,通过mixup这一数据增广技术,可以增强模型对数据偏差的泛化和鲁棒能力。

[0062]

s5:计算teacher模型权值平均获得分类器模型的集成预测i=1,

…

,n;其中w

(t)

是分类器模型在第t步的参数,是teacher模型权值平均在第t步的参数,是分类器模型在第t步的集成预测,是分类器模型使用参数的模型预测输出。

[0063]

在本步骤中,使用对模型权值进行指数滑动平均后得到的teacher模型w

wa

,然后对teacher模型预测进行指数滑动平均获得最终伪软标记z,并使用其参与计算l

pse

(w)。

[0064]

s6:利用s4产生的批训练数据sampleminibatch(d;n),产生新的索引序列idx=torch.randperm(n),基于mixup数据增广方法生成新的数据通过随机梯度下降更新获得是分类器模型在第t+1步更新后的参数。

[0065]

为了更新分类器模型,每次迭代须从图像训练数据集d中选取mini-batch训练样本{(xi,yi),1≤i≤n},n<<n。然后通过mixup技术生成增广样本以及相应的标记,在上一步分类器模型参数w

(t)

的基础上,通过这些mini-batch训练样本增广后的样本,沿着优化目

标(5)的梯度下降方向改善分类器模型,此时分类器模型参数更新为:

[0066][0067]

其中η1是分类器模型相应的学习步长,是分类器模型相应的学习步长,(x,y)是从图像训练数据集d中采样的大小为n的批次样本集合,x[idx],y[idx]是对(x,y)按照随机产生的索引idx重新排列的新批次样本集合,z

(t+1)

是分类器模型对x在第t+1步的集成预测,是z

(t+1)

按照索引idx重新排列的新的集成预测,li和分别是样本(xi,yi)的分类损失函数,li=l(f(xi;w),yi),

[0068]

s7:利用s4产生的元数据通过随机梯度下降更新获得θ

(t+1)

;其中θ

(t+1)

是cmw-net模型在第t+1步更新后的参数;通过无偏的元数据的更高层次的指导,使得更新的cmw-net模型可以实现对图像偏差数据的有效训练数据的遴选与错误标记的校正。

[0069]

为了更新cmw-net模型,基于给出的分类器模型更新公式在优化目标(4)的基础上可以导出更新cmw-net模型参数θ的方法。具体地,在元数据集选取mini-batch训练样本1≤i≤m},然后可在上一步元模型参数θ

(t)

的基础上,对其更新如下

[0070][0071]

其中η2是cmw-net模型相应的学习率。注意在这里中蕴含的θ对应一个符号变量,而并非一个具体值,这一设置使得(8)中蕴含的梯度算子能够被有效计算。

[0072]

对于(8)的梯度计算,注意到

[0073][0074]

令

[0075][0076]

则(8)中θ

(t+1)

的计算根据如下推导:

[0077][0078]

即,若则意味着一个带有原标记图像训练样本的学习梯度与元数据上的平均梯度之间的相似度,大于带有校正伪软标记图像训练样本的学习梯度与元数据平均梯度间的相似度,此时cmw-net倾向于对该样本施加更高的权重,即这样的图像样本将被倾向于视为一个标记相对纯净的图像样本;否则,该图像样本将被倾向于被认为其标记蕴含噪声,cmw-net将通过对其施加更小权重以更大程度抑制原始标记图像样本的在学习中的作用,同时对相应伪标记图像样本产生更大权重,以产生显著样本标记矫正效果。

[0079]

s8:重新利用训练数据sampleminibatch(d;n),以及s6生成的新的数据使用随机梯度下降更新获得w

(t+1)

;其中w

(t+1)

是分类器模型在第t+1步更新后的参数。

[0080]

使用更新后的θ

(t+1)

,分类器模型的参数w可自然更新如下:

[0081][0082]

和w

(t+1)

可以直接通过自动可微的技术计算。

[0083]

s9:重复s4-s8,经过t次停机,输出w

(t)

和θ

(t)

,其中w

(t)

和θ

(t)

是算法最终获得的分类器模型和cmw-net模型;得到的w

(t)

完成了基于图像偏差训练数据集d的鲁棒学习,利用得到的w

(t)

对新的图像偏差数据进行高质量的标记预测。

[0084]

算法收敛输出的分类器模型用于图像测试数据的标记预测,而输出的cmw-net模型可以迁移泛化应用于对新的偏差数据集使用的分类算法进行样本权重赋值。在cmw-net模型的迁移泛化阶段,样本赋权规律已直接设定而无须对其重新计算,将其直接嵌入在某一个分类算法之中,即辅助算法自动调整样本在算法中发挥的作用,从而实现样本自选择和标记自校正的目标。

[0085]

具体来说,对于一个新的图像训练数据集首先需要通过k

均值对所有类别的图像样本数聚类以获得其聚类中心信息将其作为新任务的特征输入,即可直接应用已有的cmw-net模型对该图像偏差问题的分类器学习施加样本权重求解,相应优化框架为:

[0086][0087]

其中,z是分类器生成的伪软标记,表示所属类别中包含的图像样本数。可直接利用习得的cmw-net模型θ

*

≈θ

(t)

求解(12),从而获得分类器模型参数u

*

。求解(12)的整体算法流程如下:

[0088]

步骤1:获取图像偏差训练数据设定批尺寸大小n

′

,最大迭代次数t

′

,已获得的cmw-net模型θ

*

,时间集成动量α∈[0,1),模型权值平均动量β∈[0,1),mixup超参数γ》0。

[0089]

步骤2:初始化分类器模型参数u

(0)

,初始化平均预测z

(0)

=0

[n

×

c]

,teacher模型平均权值(不可训练)

[0090]

步骤3:对所有图像偏差训练数据类别的样本数进行k均值聚类,将其聚类中心升序排序,获得

[0091]

步骤4:从图像偏差训练数据dq随机选取mini-batch样本sampleminibatch(d;n);产生参数γ~beta(γ,γ),λ=max(λ,1-λ);

[0092]

步骤5:计算teacher模型权值平均获得集成预测

[0093]

步骤6:利用图像训练数据sampleminibatch(d;n),产生新的索引序列idx=torch.randperm(n),基于mixup数据增广方法生成新的图像数据torch.randperm(n),基于mixup数据增广方法生成新的图像数据通过公式(12),使用随机梯度下降更新获得u

(t+1)

;

[0094]

步骤7:重复s4-s6,经过t

′

次停机,输出u

(t

′

)

。得到的u

(t

′

)

完成了基于图像偏差训练数据集dq的鲁棒学习,可以对新的数据产生高质量的标记预测。

[0095]

在本发明的第一个实例中,采用图像领域的cifar-10和cifar-100数据集的长尾分布版本进行实验,相应数据集分别记为cifar-10-lt和cifar-100-lt。具体地,两个改造数据集包含与其相应原始cifar数据集相同的类别,通过指数函数来相应减少包含于每个类的训练样本数来构建。数据集的不平衡系数定义为蕴含最多样本数据的类别样本数除以对应最小类样本数目。元数据集从训练数据集中每类选取10个样本。分类器模型使用resnet32网络,采用随机梯度下降(sgd)训练学生网络,设置sgd的momentum为0.9,权重衰

减系数为5

×

10-4

,初始学习率为0.1,总迭代步数为20epoch,在迭代步数为160epoch和180epoch学习率分别除以100。使用adam优化器训练cmw-net模型,学习率设置为10-4

,权重衰减系数为10-5

。ce loss采用标准的交叉熵损失,没有施加权重函数,即所有样本均施加相同的权重1,focal loss和cb loss代表了预定义权值函数的sota方法。利用本发明方法在cifar-10-lt和cifar-100-lt(不平衡系数为200,100,50,20,10)上的性能表现(在测试集上的误差率)如图3所示。可以看出本发明方法对类不均衡偏差数据的鲁棒性显著强于对比的方法,即随着不平衡系数的改变,在测试集上的误差率下降的最少;并且本发明方法达到了加权方案的最好性能。

[0096]

在本发明的第二个实例中,数据集选取图像领域的cifar-10和cifar-100,其中训练数据集选取的各个数据集的训练集部分,元数据集从训练数据集中每类选取10个样本。分类器模型使用pre-resnet18网络。采用随机梯度下降(sgd)训练学生网络,设置sgd的momentum为0.9,权重衰减系数为5

×

10-4

,初始学习率为0.02,总迭代步数为300epoch,在迭代步数为150epoch学习率除以10。使用adam优化器训练cmw-net模型,学习率设置为10-3

,权重衰减系数为10-4

(下同)。ce loss表示直接将分类器模型用标准的交叉熵损失在噪音标记的偏差训练数据集上训练,forward表示通过标记转移矩阵来矫正预测偏差,gce表示通过鲁棒损失来处理噪声标记问题,m-correction和dividemix通过对样本损失设置阈值来将训练数据划分为干净和噪声数据,并对其分别构建标记改善网络来协同训练获得稳健的分类器。这一方法代表了处理此类数据偏差问题的sota方法。利用本发明方法在特征无关的标记噪音(symmetric对称标记噪声:随机挑选一定比例的训练数据,将其标记随机改变为其他任何一种标记;asymmetric非对称标记噪声,错误标记只发生在相似类之间)上的性能表现(在测试集上的准确率)如图4所示(噪音水平设置为20%、40%、60%、80%),可以看出本发明方法对特征无关的标记噪音的鲁棒性强于对比方法,即随着噪音水平的增加,在测试集上的准确率下降的最少;并且本发明方法几乎在所有的偏差情况下均达到了最好的性能。

[0097]

在本发明的第三个实例中,数据集选取图像领域的cifar-10和cifar-100(训练集和元数据集构造同实例二),分类器模型使用resnet34网络。采用随机梯度下降(sgd)训练学生网络,设置sgd的momentum为0.9,权重衰减系数为5

×

10-4

,初始学习率为0.02,总迭代步数为120epoch,在迭代步数为80epoch和100epoch学习率分别除以10。ce loss表示直接将分类器模型用标准的交叉熵损失在噪音标记的偏差训练数据集上训练,gce表示通过鲁棒损失来处理噪声标记问题,plc表示方法代表了为此类特征相关标记噪声专门设计的sota方法。利用本发明方法在特征相关标记噪声(噪音根据每个样本的后验分布产生,将其置信度最高的标记替换为置信度第二的标记。通过三种方式模拟这种标记噪声的产生方式:type-i,type-ii,type-iii)上的性能表现如图5所示(每种噪音生成方式设置噪音水平为35%、70%),可以看出本发明方法对特征相关的标记噪音的鲁棒性强于对比方法,即随着噪音水平的增加,在测试集上的准确率下降的最少;并且本发明方法在所有的偏差情况下均达到了最好的性能。

[0098]

在本发明的第四个实例中,数据集选取图像领域的animal-10n,web-bird、web-aircraft、web-car、mini-webvision真实的偏差数据集。依照各个数据集的的sota方法设置进行训练。本实例主要验证本发明方法针对不同的真实数据偏差问题算法的鲁棒性和可

泛化性,其性能表现如图6所示。可以看出本发明方法对各种形式的真实数据偏差,相比于对比方法,具有显著的鲁棒性和可泛化性;并且本发明方法在所有的真实偏差数据集下均达到了最好的性能。

[0099]

在本发明的第五个实例中,主要验证本发明设计的识别算法对拟合偏差数据的鲁棒性能力以及背后加权机制的理解。数据集选取cifar-10,实验设置分别与第二、三、四实验实例相同。如图7中(a)所示,cmw-net模型对类不均衡数据偏差分别产生了对应于小、中和大规模任务元类的三个权重函数。非常有趣的是,这三个自动训练获得权值函数形态与传统对此类问题推荐使用的设置方式非常相符,即分配与类样本数目呈现反比的权重,即对尾类(即样本数目较少的相应类别)而言,应该分配较大的权重,而反之亦然,从而尽可能加强尾类相对少量样本在学习中发挥的作用,从而缓解类不平衡偏差带来的训练异常。如图7中(b)所示,针对特征无关的对称标记噪音,cmw-net针对三个元类分别习得的权值函数具有相似的形态,很好地吻合了此种情况下各类同标记噪声分布的内涵;而对于非对称标记噪声情形,cmw-net算法能够针对不同的类自适应产生符合其偏差性质的权值函数,如图7中(c)所示,cmw-net算法针对中小规模元类所得的权值函数呈现单调递增的形态。这可以合理的解释为对于这些元类别数据,由其生成机制可知,其所有样本均带有准确标记,因而权值函数递增更有利于学习中对内涵信息丰富的边际样本进行侧重。而对于大规模元类,cmw-net所导出的权值函数呈现单调递减的形态,即其侧重于强调学习损失较小的样本,而异质损失较大样本对学习过程的影响。这同样可以合理的解释,由于这些元类别均蕴含显著噪声标记,这种权值函数有利于其排除噪声标记的干扰,从而实现鲁棒学习的目的。如图7中(d)所示,针对特征相关的标记噪音,cmw-net仍可以保持良好的表现,即可以很好地区分纯净与错误标记的样本。可以看出本发明方法可以根据训练数据集的数据偏差变化,自适应地调整背后的赋权规律,使得产生的加权方案可在不同的复杂数据偏差情况下执行。

[0100]

在本发明的第六个实例中验证本发明方法的可迁移性。所提的cmw-net方法习得的权重函数能够以即插即用的方式配备到其他图像偏差数据的分类学习任务中,而这种直接迁移使用的方式能够帮助新的学习任务避免繁琐的权值调参过程,因此辅助带有复杂偏差问题的大规模数据进行快速鲁棒学习具有特别的用途。迁移在实例四中在小的仿真偏差数据集cifar-10上习得的cmw-net模型迁移到图像领域公开的最大webvision真实偏差数据集上,其性能表现如图8所示。可以看出本发明方法迁移习得的cmw-net可以在新的真实图像偏差数据集很好地发挥数据自选择和标记自校正功能,甚至在这一挑战性数据上性能超越了目前保持sota方法,展现出它在实际应用场景的可用性和有效性。

[0101]

在本发明的第七个实例中验证本发明方法在图像领域的偏标记学习这一偏差数据上的表现。偏标记学习旨在解决每个数据样本都具有一组候选标签、且只有其中一个是正确标签的问题。在第一阶段,使用该问题上的sota方法proden进行学习,然后可以通过习得的模型预测产生具有单个噪声标签的偏差训练数据。数据集选取cifar-10和cifar-100,分类器模型使用resnet-32网络,采用随机梯度下降(sgd)训练,设置sgd的momentum为0.9,权重衰减系数为5

×

10-4

,初始学习率为0.1,总迭代步数为120epoch,在迭代步数为80epoch和100epoch,学习率分别除以10。利用本发明方法在cifar-10和cifar-100上的偏标记学习性能表现(在测试集上的误差率)如图9所示。可以看出本发明方法可以显著地提升基线proden方法对偏标记偏差数据的性能表现,展现出它在偏标记学习中的潜在可用性;并且

本发明方法达到了偏标记学习的最好性能。

[0102]

在本发明的第八个实例中验证本发明方法在图像领域的半监督学习这一偏差数据上的表现。为了降低样本标记的标注成本,半监督学习使用少量的高质量有标记数据和大量无标记数据集进行训练。选用这一问题的sota方法fixmatch作为基线方法。fixmatch模型启发式地使用置信度来遴选可靠的伪标记无标签样本参与训练,作为对比,本发明方法自适应地对无标签数据进行赋权,使得挖掘出更加可靠的无标签样本参与训练。利用本发明方法在cifar-10,cifar-100和imagenet上的半监督学习性能表现(在测试集上的误差率)如图10所示。可以看出本发明方法可以遴选出更加可靠的无标记样本参与训练,从而显著地提升基线fixmatch方法对半监督学习偏差数据的性能表现,展现出它在半监督学习中的潜在可用性;并且本发明方法达到了半监督学习的最好性能。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1