一种基于无人机集群的遮挡目标光学计算成像的实现方法与流程

1.本发明涉及遮挡物体计算成像技术领域,特别是一种基于无人机集群的遮挡目标光学计算成像的实现方法。

背景技术:

2.光学成像技术是将三维场景经过光学成像系统在二维的传感器上投影,进而获得与三维场景相关联的光学信息的技术。随着光学设计和传感器技术的发展,摄像机拍摄技术充满了生活的每个角落。但是,现实生活场景是三维的,由于光的直线传播原理,传统摄像机无法获取隐藏物体的光学图像。为此,x光检测、计算成像以及光子成像技术相继提出,分别可以对特定条件下的隐藏物体进行成像。上述方式或是利用电磁波的穿透性,或是基于对拍摄数据的大量关联计算,或对传感器件具有极高的灵敏度要求,无法做到利用可见光对隐藏物体进行高效成像。

3.遮挡物体计算成像技术常常用于合成孔径雷达探测领域,借助合成孔径雷达所采用电磁波段的穿透能力,对云雾遮挡等场景同样具备较好的成像效果,在防空预警、态势感知、海面监测等领域有着广泛应用。但在光学,尤其可见光波段的遮挡目标成像技术的研究发明相对较少。在遮挡目标光学成像领域,以基于光场计算和集成成像计算为代表的光学合成孔径技术,为遮挡目标光学成像的实现提供了新的技术途径。

4.光场计算作为七维光场的处理方法,颠覆了单一光学镜头成像过程中场景深度丢失的弊病,实现了对现实世界的光场信息记录和分析处理。由于光场计算同时记录了光线的角度信息,再利用光场计算算法对这些光线进行深度重构,可以计算合成现实中不存在的焦距、孔径或光圈参数的成像镜头对应的图像。这种计算成像方式摆脱了传统成像中光圈和景深不可兼得的限制,能够在超大光圈的拍摄环境下实现超景深的成像,另外基于合成孔径原理的光场成像技术由于具有较大光学等效孔径,能够“穿透”稀疏遮挡物体,并聚焦在目标物体上。虽然光场计算成像技术实现了超现实镜头的合成,但是由于其相机镜头固定,且成像方式不能与传统二维成像方式兼容等缺点,在需灵活应用的无人机目标光学成像场景中有很多使用限制。

5.集成成像计算同样作为三维场景光场信息的一种采集方式,在真三维显示、三维重建、合成孔径相机计算成像等领域具有较高的实用价值。集成成像计算的信息来自其微图像阵列,而微图像阵列又是通过微透镜阵列、相机阵列、计算机渲染等方式获取得到。集成成像微图像阵列获取过程中,摄像机数目巨大,且不同摄像机之间的相对空间位置和光轴方向都难以做到物理上的精确对齐。在传统集成成像摄像机阵列拍摄中,需要利用标定板对摄像机阵列拍摄图像进行校正,以克服不同摄像机的位姿差异带来的拍摄错误。但是,传统的集成成像摄像机阵列拍摄图像校正方法受限于标定板的尺寸大小,无法拍摄较大和超大的三维场景,严重限制了集成成像摄像机阵列拍摄的适用范围和实用性,进而制约了集成成像微图像阵列的数据来源,无法应用在无人机集群场景中。

6.鉴于目前本领域技术人员在基于无人机集群等灵活运动平台,对光学遮挡目标成

像尚无有效的解决方式的现状,因此,如何克服无人机光电吊舱在诸多环境中,对遮挡或隐藏目标无法成像的局限,使其具备遮挡目标成像能力,且成像位姿要求灵活,计算成像过程简单准确,是本领域技术人员广泛关注的热点。

技术实现要素:

7.为了克服当前无人机光电吊舱在诸多环境中,对遮挡或隐藏目标无法成像的局限,本发明提供一种基于无人机集群的遮挡目标光学计算成像的实现方法。

8.本发明公开了一种基于无人机集群的遮挡目标光学计算成像的实现方法,其包括:

9.步骤1:基于无人机集群的摄像机阵列的标定参数,得到所述摄像机阵列中每个摄像机对应的偏移方向和偏移量;其中,所述无人机集群中每个无人机均携带有摄像机,且无人集群携带的所有摄像机构成摄像机阵列;

10.步骤2:基于每个所述摄像机对应的偏移方向和偏移量,将所有摄像机引导至与基准摄像机相同的成像区域,基准摄像机为所述摄像机阵列中任意指定的摄像机;

11.步骤3:获取所述摄像机阵列中每个摄像机在运动过程中的在线精标定参数;其中,所述在线精标定参数由像素映射矩阵构成;

12.步骤4:基于所述标定参数和所述在线精标定参数,得到遮挡目标的图像。

13.进一步地,所述步骤1包括:

14.步骤11:计算所述摄像机阵列的标定参数;其中,所述标定参数包括成像外参数、成像内参数和离线粗映射参数;

15.步骤12:确定所述摄像机阵列与遮挡物、遮挡目标的空间位置关系;

16.步骤13:基于所述空间位置关系,计算每个摄像机对应的偏移方向和偏移量。

17.进一步地,所述步骤11包括:

18.所述摄像机阵列共有m

×

n个摄像机,其拍摄棋盘格标定板得到对应的m

×

n个标定视差图像,标定视差图像的分辨率为wr×hr

,检测标定视差图像中的棋盘格角点像素坐标;

19.基于每个标定板图像中的角点坐标,通过张氏标定法,得到所述摄像机阵列的第m列、第n行的摄像机的成像外参数和成像内参数;其中,所述成像外参数包括摄像机的旋转矩阵r

m,n

和平移矢量t

m,n

,所述成像内参数包括摄像机的焦距和主点偏移共同组成的内参数矩阵k

m,n

;

20.基于单应性变换原理,计算所述摄像机阵列中每个摄像机对应的单应性变换矩阵,并将其作为摄像机与基准摄像机的离线粗映射参数;其中,所述单应性变换矩阵为:

[0021][0022]

其中,h

m,n

为单应性变换矩阵,r0为基准摄像机的成像外参数中的旋转矩阵,m和n分别为摄像机阵列的第m列、第n行摄像机对应的索引值,m∈{1,2,3,

…

,m},n∈{1,2,3,

…

,n}。

[0023]

进一步地,所述步骤12包括:

[0024]

通过测量,得到目标场景区域中遮挡目标距离所述摄像机阵列的距离δdh;所述

摄像机阵列中两两摄像机之间的空间距离相同,均为δc;其中,所述目标场景区域包括遮挡物和遮挡目标;

[0025]

根据棋盘格标定板的尺寸,计算所述摄像机阵列在棋盘格标定板所处平面处拍摄的遮挡场景的范围大小wb×

hb。

[0026]

进一步地,所述偏移方向记为θ

m,n

,所述偏移量记为s

m,n

,且分别满足:

[0027]

θ

m,n

=(θ

x

,θy)

m,n

[0028]sm,n

=(s

x

,sy)

m,n

[0029]

其中,θ

x

、θy分别为偏移方向θ

m,n

在x轴和y轴的分量,s

x

、sy分别为偏移量s

m,n

在x轴和y轴的分量;

[0030]

θ

x

、θy、s

x

、sy分别满足:

[0031][0032][0033][0034][0035]

其中,round为对数值进行四舍五入取整的函数。

[0036]

进一步地,所述步骤2包括:

[0037]

计算目标场景区域相对每个摄像机坐标系的指示引导信息,以为无人机操作员提供引导指示信息;其中,所述指示引导信息包括目标场景区域在摄像机坐标系的方位角y

t

、俯仰角p

t

;

[0038]

其中,方位角y

t

和俯仰角p

t

分别表示为:

[0039]yt

=arctan((lon

t-lon

p

)*cos(lat

p

),(lat

t-lat

p

))

[0040][0041]

其中,(lon

p

,lat

p

,alt

p

)为无人机平台的地理坐标,由无人机平台的经度lon

p

、纬度lat

p

和高度alt

p

组成,(lon

t

,lat

t

,alt

t

)指示遮挡目标的地理坐标,由指示遮挡目标的经度lon

t

、纬度lat

t

和高度alt

t

组成,dist为计算两个坐标点的地距函数。

[0042]

进一步地,所述步骤3包括:

[0043]

将所述摄像机阵列中每个摄像机拍摄的图像与基准摄像机之间的遮挡物进行像素级匹配;其中,每个摄像机与基准摄像机之间的像素级匹配关系用像素映射矩阵表示,m和n分别为摄像机阵列的第m列、第n行摄像机对应的索引值,m∈{1,2,3,

…

,m},n∈{1,2,3,

…

,n}。

[0044]

进一步地,所述像素级匹配的过程为:

[0045]

利用sift、surf或orb算法分别提取需要像素级匹配的图像的特征点,并将不同图像的特征点进行匹配,通过ransac算法对错误匹配点进行剔除。

[0046]

进一步地,所述步骤4包括:

[0047]

步骤41:通过所述摄像机阵列获取目标场景区域图像;

[0048]

步骤42:基于单应性变换矩阵和像素映射矩阵,计算得到每个摄像机拍摄的目标场景区域图像对应的校正图像;

[0049]

步骤43:根据所述校正图像以及每个摄像机对应的偏移方向和偏移量,计算得到每个摄像机拍摄的目标场景区域图像对应的偏移图像;

[0050]

步骤44:基于所有偏移图像,计算得到目标场景区域图像中遮挡目标的图像。

[0051]

进一步地,所述校正图像与其对应的摄像机拍摄的目标场景区域图像满足:

[0052]i′

m,n

(x

′

,y

′

)=i

m,n

(x,y)

[0053]

其中:

[0054][0055]

其中,i'

m,n

(x',y')为校正图像,i

m,n

(x,y)为摄像机阵列的第m行、第n列的摄像机拍摄得到的目标场景区域图像,x和y分别为目标场景区域图像的像素坐标,x'和y'分别为校正图像的像素坐标;

[0056]

在所述步骤43中:

[0057]

所述偏移图像为i”m,n

(x”,y”),i

″

m,n

(x

″

,y

″

)=i

′

m,n

(x

′

,y

′

),

[0058][0059]

其中,x”和y”分别为偏移图像的像素坐标,s

x

为偏移量s

m,n

中方向为θ

x

的偏移量,sy为偏移量s

m,n

中方向为θy的偏移量;

[0060]

在所述步骤44中:

[0061]

所述遮挡目标的光学图像为:

[0062][0063]

其中,o(x”,y”)为遮挡目标的光学图像。

[0064]

由于采用了上述技术方案,本发明具有如下的优点:

[0065]

(1)具有遮挡目标成像能力。本发明赋能无人机集群摄像机,使其能够“穿透”遮挡物体,并聚焦在目标物体上,该能力是传统光电摄像机不具备的能力。

[0066]

(2)摄像机位姿要求灵活。本发明提供无人机集群摄像机在线标定方法,能够无人机集群摄像机在动态工作过程中获取目标场景的图像数据,根据场景内容,对各个摄像机动态实现图像对其和矫正,进而为光学遮挡物体计算成像过程提供无人机集群摄像机在线精标定参数。本发明的灵活性相比光场相机和集成成像相机阵列具备显著优势。

[0067]

(3)计算成像过程简单准确。本发明利用无人机集群摄像机获取目标场景区域的光电图像对应的偏移光电图像,计算得到遮挡目标的光学图像,该计算过程无其他依赖,无

需考虑光场相机中的成像串扰问题,计算过程大大简化。

[0068]

(4)成像深度范围可调。本发明中,当遮挡物体与光电摄像机的距离发生变化时,重复相同计算过程,可以对场景变化后的遮挡目标进行计算成像。该有益效果相比基于集成成像计算的遮挡物体成像方法,无需设定初始深度平面,成像深度可按需设置和调整。

[0069]

(5)本发明适用于动态复杂环境、目标遮挡隐蔽条件、目标搜索引导、光电目标识别确认等应用场景。

附图说明

[0070]

为了更清楚地说明本发明实施例中的技术方案,下面将对实施例描述中所需要使用的图作简单地介绍,显而易见地,下面描述中的图仅仅是本发明实施例中记载的一些实施例,对于本领域普通技术人员来讲,还可以根据这些图获得其他的图。

[0071]

图1为本发明一种基于无人机集群的遮挡目标光学计算成像方法场景示意图;

[0072]

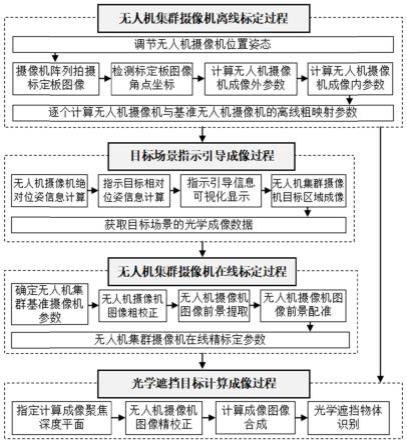

图2为本发明一种基于无人机集群的遮挡目标光学计算成像方法流程图;

[0073]

图3为本发明无人机集群摄像机在线标定过程;

[0074]

图4为本发明光学遮挡物体计算成像过程;

[0075]

图5为本发明光学遮挡物体成像实施例结果图。

[0076]

附图标号:1无人机1-4,2光电摄像机1-4视野,3遮挡目标的场景,4遮挡目标1,5遮挡目标2,6光电摄像机1,7光电摄像机2,8光电摄像机3,9光电摄像机4,10光电摄像机1图像,10光电摄像机2图像,12光电摄像机3图像,13基准光电摄像机图像,14遮挡目标光学计算图像。

具体实施方式

[0077]

结合图和实施例对本发明作进一步说明,显然,所描述的实施例仅是本发明实施例一部分实施例,而不是全部的实施例。本领域普通技术人员所获得的所有其他实施例,都应当属于本发明实施例保护的范围。

[0078]

本发明所提方法可以由无人机集群、无人机光电摄像机、遮挡目标的场景,以及遮挡目标共同组成的场景进行说明,如图1所示。无人机集群利用挂载的光电摄像机对感兴趣区域目标进行光学成像,但是由于无人机集群和感兴趣区域目标被遮挡场景所阻隔,感兴趣区域目标成为遮挡目标,挂载在无人机上的光电摄像机无法完整地获取得到遮挡目标的光学图像,无法利用某一无人机光电摄像机获取该目标的详细信息。在该场景中,无人机集群动态散布于遮挡目标的场景一侧,如何利用散布的无人机集群光电摄像机成像数据,实现对遮挡目标的光学计算成像,是本发明解决的问题场景。

[0079]

参见图2,本发明实施例包括如下过程:

[0080]

无人机集群摄像机离线标定、目标场景指示引导成像、无人机集群摄像机在线标定和光学遮挡物体计算成像四个主要过程。

[0081]

所述无人机集群摄像机离线标定过程,首先,计算无人机集群摄像机阵列的标定参数。初步调节无人机集群摄像机阵列,使得每个摄像机的拍摄范围都覆盖棋盘格标定板所在的空间,且无人机集群摄像机阵列与棋盘格标定板之间的距离为δdb。在无人机集群中,摄像机数目为m

×

n,拍摄棋盘格标定板得到对应的m

×

n标定视差图像,标定视差图像分

辨率为wr×hr

,检测标定视差图像中的棋盘格角点像素坐标。基于张氏标定法得到第m列、第n行无人机摄像机成像外参数和成像内参数,其中,成像外参数包括摄像机旋转矩阵r

m,n

和平移矢量t

m,n

,成像内参数包括摄像机焦距和主点偏移共同组成的内参数矩阵k

m,n

。基准摄像机成像外参数中的旋转矩阵标记为r0。其中,基准摄像机为无人机集群摄像机阵列中任意指定的摄像机。基于单应性变换原理,计算无人机集群摄像机阵列中每个摄像机对应的单应性变换矩阵h

m,n

,作为无人机摄像机与基准无人机摄像机的离线粗映射参数,h

m,n

表示为:

[0082][0083]

其中,m和n分别为摄像机阵列的第m列、第n行摄像机对应的索引值,m∈{1,2,3,

…

,m},n∈{1,2,3,

…

,n}。然后,确定无人机集群摄像机阵列与遮挡物体、隐藏物体的空间位置关系。通过测量,得到遮挡场景中隐藏物体距离无人机集群摄像机阵列的距离δdh。无人机集群摄像机阵列中的每一行、每一列相邻的摄像机之间的空间距离相同,都为δc,如图3所示。同时根据棋盘格标定板的尺寸,计算无人机集群摄像机阵列在棋盘格标定板所处平面处拍摄的遮挡场景范围大小wb×

hb。最后,根据每个摄像机在无人机集群摄像机阵列中的位置和遮挡场景与隐藏物体的空间关系,计算每个摄像机对应的偏移方向和偏移量。其中,偏移方向记为θ

m,n

,偏移量记为s

m,n

,且分别满足:

[0084]

θ

m,n

=(θ

x

,θy)

m,n

[0085]sm,n

=(s

x

,sy)

m,n

[0086]

其中,θ

x

、θy分别为偏移方向θ

m,n

在x轴和y轴的分量,s

x

、sy分别为偏移量s

m,n

在x轴和y轴的分量。θ

x

、θy、s

x

、sy分别满足:

[0087][0088][0089][0090][0091]

其中,round(*)表示对*向最近整数四舍五入取整。

[0092]

所述目标场景指示引导成像过程,目的是将所有摄像机引导至与基准摄像机相同的成像区域,该过程计算目标场景区域相对每个光电摄像机坐标系的指示引导信息,该指示引导信息包括目标场景区域在光电摄像机坐标系的方位角y

t

、俯仰角p

t

,该指示引导信息为量化信息,以可视化显示的方式为无人机操作员提供直观的引导指示信息。其中,目标场景区域在光电摄像机坐标系的方位角y

t

和俯仰角p

t

,通过目标场景区域和光电摄像机的地

理坐标组合而成的矢量得到,斜距d

t

由该矢量的模确定。其中,目标场景区域在光电吊舱摄像机坐标系的方位角y

t

和俯仰角p

t

为:

[0093]yt

=arctan((lon

t-lon

p

)*cos(lat

p

),(lat

t-lat

p

))

[0094][0095]

其中,(lon

p

,lat

p

,alt

p

)为无人机平台的地理坐标,由无人机平台的经度lon

p

、纬度lat

p

和高度alt

p

组成,(lon

t

,lat

t

,alt

t

)指示目标的地理坐标,由指示目标场景区域的经度lon

t

、纬度lat

t

和高度alt

t

组成,dist(a,b)为计算a和b两点的地距函数。

[0096]

所述无人机集群摄像机在线标定过程,指的是无人机集群摄像机在动态工作过程中获取目标场景的图像数据,根据场景内容,对各个摄像机动态实现图像对其和矫正,进而为光学遮挡物体计算成像过程提供无人机集群摄像机在线精标定参数,在线精标定参数由像素映射矩阵构成。在该过程,光电摄像机图像中遮挡目标的场景占据图像的绝大多数像素,同时也为该图像场景的前景,遮挡目标占据图像的极少数像素,为该图像场景的背景,无人机光电集群摄像机在线标定过程首先实现图像之间前景的像素级匹配。本发明中,不同无人机光电摄像机获取的目标场景区域图像的像素级匹配是通过多视角图像匹配技术,利用sift、surf或orb算法提取图像中的特征点,通过ransac算法,对错误匹配点进行剔除,进而实现每幅图像与基准摄像机获取的目标场景区域图像的匹配关系计算。每个无人机摄像机与基准摄像机之间的匹配关系用像素映射矩阵表示,其中,m和n分别为摄像机阵列的第m列、第n行摄像机对应的索引值,m∈{1,2,3,

…

,m},n∈{1,2,3,

…

,n}。

[0097]

所述光学遮挡物体计算成像过程,首先,利用无人机集群摄像机获取目标场景区域的光电图像,如图4所示,目标场景区域光电图像分辨率同样为wr×hr

。第m列、第n行摄像机拍摄得到目标场景区域光电图像为i

m,n

(x,y),其中,x和y分别为目标场景区域光电图像像素坐标。利用对应的单应性变换矩阵h

m,n

和像素映射矩阵计算得到对应的校正图像i'

m,n

(x',y'),i'

m,n

(x',y')与i

m,n

(x,y)满足:

[0098]i′

m,n

(x

′

,y

′

)=i

m,n

(x,y)

[0099]

其中:

[0100][0101]

然后,根据摄像机对应的偏移方向θ

m,n

和偏移量s

m,n

,计算对应的偏移光电图像i”m,n

(x”,y”),i”m,n

(x”,y”)与i'

m,n

(x',y')满足:

[0102]i″

m,n

(x

″

,y

″

)=i

′

m,n

(x

′

,y

′

)

[0103]

其中:

[0104][0105]

其中,x”和y”分别为偏移图像的像素坐标,s

x

是偏移量s

m,n

中方向为θ

x

的偏移量,sy是偏移量s

m,n

中方向为θy的偏移量。

[0106]

优选地,当x”不满足x”∈{1,2,3,

…

,wr},或y”不满足y”∈{1,2,3,

…

,hr}时,跳过该像素坐标的计算,以避免像素坐标的计算范围溢出。最后,利用偏移光电图像i”m,n

(x”,y”),计算得到遮挡目标的光学图像o(x”,y”):

[0107][0108]

其中,m∈{1,2,3,

…

,m},n∈{1,2,3,

…

,n},遮挡目标光学计算图像结果如图5所示。当遮挡物体与光电摄像机的距离δdh发生变化时,重复上述过程,可以对场景变化后的遮挡目标进行计算成像。

[0109]

以上显示和描述了本发明的基本原理和主要特征和本发明的优点。本行业的技术人员应该了解,本发明不受上述实施例的限制,上述实施例和说明书中描述的只是说明本发明的原理,在不脱离本发明精神和范围的前提下,本发明还会有各种变化和改进,这些变化和改进都落入要求保护的本发明范围内。本发明要求保护范围由所附的权利要求书及其等效物界定。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1