基于图卷积对比学习和XLNet的知识图谱嵌入方法

本发明涉及知识图谱嵌入,提供一种基于图卷积对比学习和xlnet的知识图谱嵌入方法。

背景技术:

1、知识图谱是构建多态异构大差异模型数据同源与自动适配,以及数据融合的关键技术。知识图谱嵌入(kge)是将知识库中的实体和关系映射到低维密度空间的方法。从最初的翻译模型到概率空间模型,kge一直在几何代数的方向上取得了不错的发展。随着深度学习的广泛应用,kge结合图神经网络又发展形成了多种效果不错的深度学习模型。而计算机视觉方向对比学习的广泛提出,及其表现出的良好效果也使得对比学习被快速应用于nlp等领域。

2、现有的知识图谱嵌入方法中,存在主要的缺点为:

3、1.知识图谱包含的图样本数据不足:图对比学习是基于生化数据集训练得到的模型,而生化数据集与知识图谱本身不同的地方在于:生化数据集相当于是由一个个生物化学分子构成的集合,每个生化分子代表着一个小型的图结构;知识图谱的构建是以大量离散的三元组为基础的,较为繁琐,构建完成后只有一个图。所以正是由于知识图谱和生化数据集的构造不同,造成其样本容量不同,给模型的训练造成了样本不足的问题,使得模型训练效果不佳。

4、2.知识图谱嵌入过程缺少语义特征:现有的知识图谱嵌入技术主要分为两种:基于图结构的嵌入和基于三元组的嵌入。其中,基于图结构的嵌入是将三元组通过node2vec算法构建出知识图谱的结点和边,使知识图谱形成一个图结构,然后再将图进行嵌入,该方法未考虑存在大量知识的知识图谱本身包含的丰富语义信息。基于三元组的嵌入方法是trans系算法所提供的嵌入方法,该方法直接将三元组的头尾实体和关系进行低维向量映射,然后在同一平面或加一个超平面的情况下进行嵌入,这种方法考虑到了头尾实体以及关系之间映射成为矩阵向量后的关系,但未考虑数据本身结构是一个包含了节点和边的特征信息的图结构。

5、3.对比学习的损失函数训练效果并非为适应当前任务的最佳函数:对比学习的优势不仅在于使用了数据增强,而且其损失函数适用于当前任务使训练效果达到最佳。但对比学习的提出最初是针对图像样本,并不是针对图结构样本和文本样本,因此,难以达到预期效果。

6、据此,提出一种基于图卷积对比学习和xlnet的知识图谱嵌入方法来解决上述缺陷。

技术实现思路

1、本发明的内容是提供一种基于图卷积对比学习和xlnet的知识图谱嵌入方法,其能够克服现有技术的某种或某些缺陷。

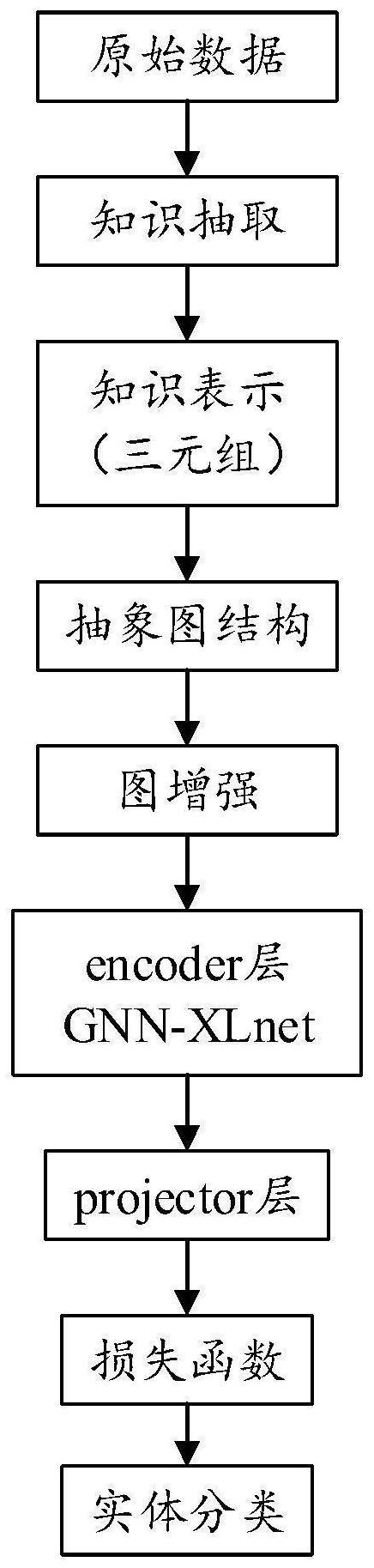

2、根据本发明的一种基于图卷积对比学习和xlnet的知识图谱嵌入方法,其包括以下步骤:

3、1)知识图谱图结构构建;

4、2)基于图对比学习框架的gnn-xlnet模型训练

5、2.1)图增强,用于增加知识图谱图结构正样本,得到aug1和aug2;

6、2.2)对比学习双塔结构第一层encoder编码器,aug1经上分支gnn-xlnet转换成对应的特征表示hi1,aug2经下分支gnn-xlnet转换成对应的特征表示hi2;

7、2.3)对比学习双塔结构第二层projector映射器,进一步将特征表示hi映射成另外一个空间里的向量zi,projector由两层mlp构成;

8、2.4)优化损失函数,使得参数训练效果更好,同时使用相似性函数进行增强样本之间的距离测量;

9、2.5)当模型产生的损失值满足设定要求或者达到最大迭代次数n,则终止模型的训练;

10、3)使用训练好的模型进行实体链接

11、3.1)将测试集数据的实体进行低维向量嵌入,使用wor2vec得到实体的向量表示;

12、3.2)使用基于图对比学习的gnn-xlnet模型获得知识图谱特征。

13、3.3)根据获得的特征将知识图谱嵌入,得到知识图谱的低维空间表示;

14、3.4)计算知识图谱中的实体与测试实体的相似度;

15、3.5)给出rank list,选取得分最高的为最佳匹配。

16、作为优选,步骤1)中,知识图谱图结构的构建具体包括:

17、1.1)知识表示

18、原始数据,按照数据的结构化程度,分为结构化数据、半结构化数据和非结构化数据,根据数据的不同结构化形式,采用不同的方法,将数据转换为三元组形式:

19、a、结构化数据处理

20、采用d2r技术转换为rdf数据;

21、b、半结构化数据处理

22、采用包装器的方式进行处理;

23、c、非结构化数据处理

24、抽取的知识包括实体、关系、属性。

25、1.2)抽象图结构

26、a、加载知识库数据集,数据集以rdf文件形式保存;

27、b、加载并解析rdf文件,得到数据集中的实体集合、关系集合和三元组集合以及对应的标签;

28、c、使用广度优先遍历算法,将实体集合作为节点集合,关系集合作为边集合进行图的构建,保存为邻接矩阵;

29、d、将构造出的图结构g输入模型进行训练。

30、作为优选,步骤2.1)中,针对图数据的数据增强策略包括以下四类:基于特征的增强、基于结构的增强、基于采样的增强和自适应的增强;

31、基于特征的增强方法随机或者手动的遮盖一小部分结点或者边的属性;对于给定的输入图g=(a,x),基于特征的增强只对结点的特征矩阵x或者边的特征矩阵xe进行增强;

32、基于结构的增强方法随机或者手动从原图中添加或者删除一小部分边;对于给定的输入图g=(a,x),基于结构的增强支队邻接矩阵进行增强;

33、基于采样的增强方法从原图中按照一定规则采样结点和对应的连边;给定一个输入图g=(a,x),基于采样的增强同时对邻接矩阵a和特征矩阵x进行增强;

34、基于自适应的增强方法采用注意力机制或者基于梯度的方法根据注意力权重或者梯度规模进行自适应采样。

35、作为优选,步骤2.2)中,gnn-xlnet用于捕捉属性与图结构信息之间重要的关联关系,gnn-xlnet同时计算每个节点的属性和边的生成损失,因此只需要为输入的图运行一次gnn;此外,gnn-xlnet处理带有子图采样的大规模图,并通过自适应嵌入队列减轻负采样带来的不准确损失;

36、gnn-xlnet过程如下:用一新节点的已知结构信息去估计一个该新节点的属性,反之亦然;生成过程分解为两个耦合的部分:给定已知的边的信息,生成节点属性;给定已知的边和刚生成的节点属性,生成剩余的边;这样,模型能捕获每个节点的属性和结构之间的依赖关系。

37、作为优选,步骤2.3)中,mlp是多层感知机,是多层的全连接的前馈神经网络,输入样本后,样本在网络中逐层前馈,得到最终输出值。

38、作为优选,步骤2.4)中,采用优化后的互信息最大损失函数来训练参数,如下:

39、

40、t(g)为增强图集,t(g)为增强图集子集,f为原始数据通过gnn编码器后的参数,i为互信息最大化函数,pg为图参数,w为增强数据通过gnn编码器后的参数;

41、这样能优化原始图g与增强图aug之间的互信息最大化,同时优化增强图集t(g)之间的互信息最小化,从而避免在表示学习中捕获冗余信息;采用的相似性计算函数采取对表示向量l2正则后的点积或者表示向量间的cosine相似性:s(zi,zj)=zitzj/(‖zi‖2‖zj‖2)

42、zi为输入参数i的矩阵或向量,zj为输入参数j的矩阵或向量,zit为参数i的转置,‖zi‖2为求zi的l2正则化,s()为求cosine相似性。

43、为了解决当前知识图谱样本不足问题,本发明采用图增强算法将样本数据进行数据增强,原始样本和增强样本分别进入对比学习框架的双塔模型进行训练,框架的两个分支使用参数共享。在知识图谱嵌入方面,大部分的技术只考虑了图结构或者是离散的三元组,为了解决语义特征使用不够充分问题,本发明使用gnn-xlnet模型使得在获取图结构的同时也获取语义特征,使得特征提取更丰富,效果更好。为了使得训练效果更佳,本发明将对比学习的损失函数进行了调整和改进,能最大化优化原始图与增强图之间的互信息,能最小化优化增强图之间的互信息。

44、本发明提出的深度学习模型能够更高效的学习到知识图谱的图结构特征和语义特征,为知识图谱嵌入做出了更好的提升,也为下游的实体链接等任务做了一个良好的铺垫。

45、本发明提出的知识图谱嵌入方法,既减少了数据标注的工作量,又使知识图谱具备了较高的精确度。

- 还没有人留言评论。精彩留言会获得点赞!