一种融合注意力机制与卷积神经网络的事件抽取方法

本发明属于自然语言处理领域的信息抽取技术,特别是,实现一种融合注意力机制与卷积神经网络的事件抽取方法。

背景技术:

1、信息抽取是从自然语言文本中抽取出特定的信息,从而将海量异构文本内容自动分类、提取和重构。信息抽取主要包括实体抽取、关系抽取、事件抽取,其中,事件抽取是将各种实体与关系高度结构化的抽取任务。事件抽取是从半结构、非结构化文本中,将目标相关的事件的重要论元识别出来,即通过获取事件触发词及事件相关论元信息,组织为事件信息,被广泛应用于语义搜索、情报分析、事件推理、风险预警、智能问答等领域。事件抽取任务分为事件识别与事件论元识别两部分,即发现事件触发词并确定事件类型、识别事件关键论元并确定论元角色。由于以事件为单位认识世界与解决问题更符合人类认知习惯,因此,事件抽取成为国内外工业界和学术界关注的热点。近年来,这些研究工作大部分是依赖深度学习来获取事件信息,目前,现有的事件抽取方法根据其使用的神经网络架构不同主要分为以下几类:

2、(1)基于卷积神经网络的事件抽取,使用卷积神经网络诱导k-grams信息,捕获局部语义特征,学习句子的组成语义特征,完成对事件信息的识别与抽取。这种方法可以处理多事件场景。但是,无法在不同上下文中编码词汇语义,若是想要获取更多的全局信息就需要层叠增大感受野。

3、(2)基于循环神经网络的事件抽取,使用循环神经网络建模序列信息,捕获参数角色和触发词子类型之间的依赖关系,挖掘文本中的时序信息与长距离关系。这种方法可以有效分析长依赖性文本,但是其本质是马尔科夫决策过程,无法很好学习全局的结构信息,忽略实体对的位置信息,同时,无法并行执行,速度较慢。

4、(3)基于注意力机制的事件抽取,学习不同距离词之间的依赖关系,分析词之间的权重判定语义关系重复利用事件模式信息,简化数据标注。这种方法可以捕捉重要语义信息能有效利用全局信息,但是,直接将序列两两比较,无法对位置进行很好的建模。

5、(4)基于上述神经网络的组合的事件抽取,通过堆叠两种或多种神经网络,提升对语义特征的抽取能力,可验证融合不同神经网络提升事件抽取的准确率和效率是有效的。

6、然而,现有目前的事件抽取方法仍然缺乏对文本中的语义特征的充分利用,忽视在事件抽取流程中事件类型与事件论元之间的语义相关性对于事件抽取准确率的提升。融合多种神经网络是一种有效的特征提取方式,但是,如何设计合适的神经网络实现对语义相关性的充分利用仍然有待研究。

技术实现思路

1、本发明的目的在于充分利用文本中语义相关性,设计一个融合多个神经网络的事件抽取方法,该方法能够实现在保证事件抽取的效率的情况下,提升事件抽取的准确率。

2、为达到以上目的,本发明采用的技术方案是:一种融合注意力机制与卷积神经网络的事件抽取方法,其特点在于:(1)通过卷积神经网络有效获取文学句子中的组合语义特征向量,对组合语义特征向量执行最大池化操作得到句子级别的局部特征与语义结构;(2)融合注意力机制通过计算同一句子中单词间的互相影响,来解决长距离依赖问题,注意力融合了来自于相同的注意力汇聚产生的不同的知识,这些知识的不同来源于相同的查询、键和值的不同的子空间表示,能够有效减少文本噪音对抽取效果的影响;(3)通过加载预训练模型(比如bert)生成的词向量为每个输入的单词映射对应的词向量表示,即通过微调动态地生成融合上下文信息的特征向量,将纯文本表示为分布式特征信息,实现使每个单词的隐状态都包含句子中不同位置单词的影响,同时避免参数空间的稀疏性。

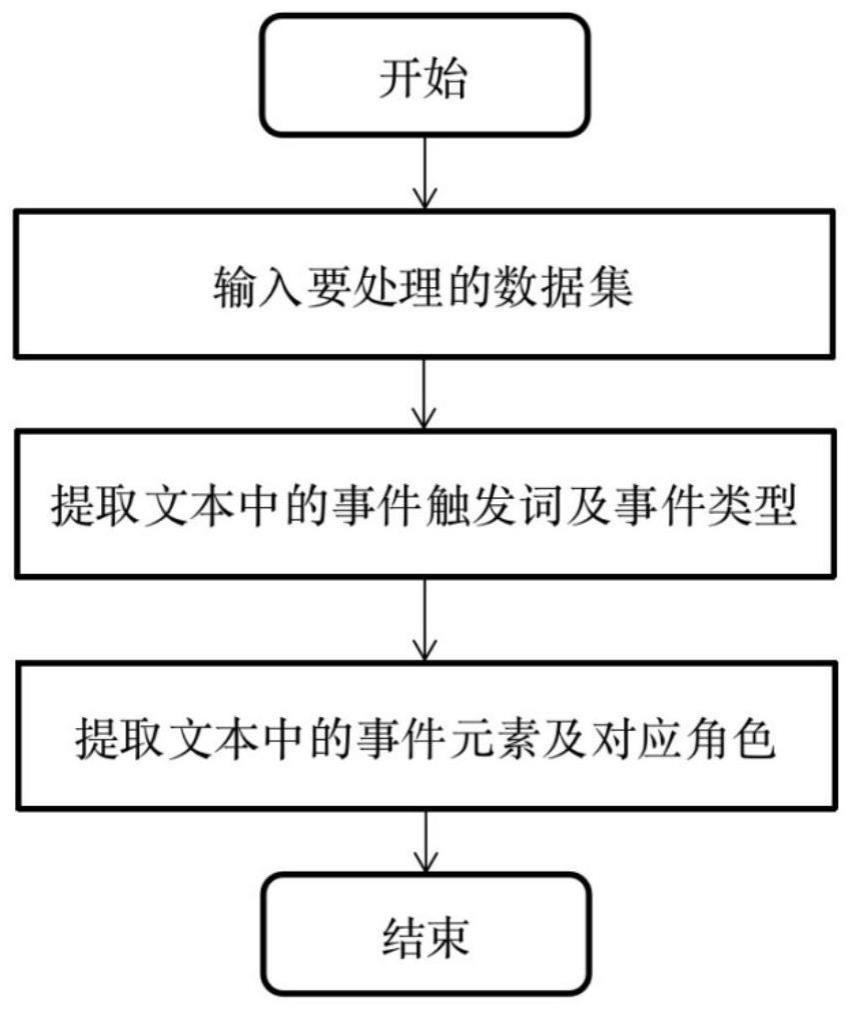

3、一种融合注意力机制与卷积神经网络的事件抽取方法,其步骤包括:

4、1)利用文本编码器对待提取文本内容进行特征表示,得到该待提取文本的分布式特征;

5、2)利用特征提取器从所述分布式特征中提取该待提取文本的语境特征及词汇之间的关联信息;

6、3)将该待提取文本的语境特征及词汇之间的关联信息输入事件触发词分类器,输出该待提取文本的事件触发词,然后基于该待提取文本的事件触发词确定该待提取文本的事件类型;

7、4)事件元素分类器根据该待提取文本的事件类型、语境特征,对该待提取文本中每个分词依次进行判断是否为事件元素;

8、5)使用元素角色分类器识别每一所述事件元素的角色类别。

9、进一步的,得到该待提取文本的分布式特征的方法为:所述文本编码器根据该待提取文本生成文本序列s=[x1,x2,x3,..,xn],其中,n为该待提取文本中的分词数,xi为该待提取文本中的第i个分词;然后对文本序列s中每一分词分别生成一词嵌入向量、分割向量、位置向量,将文本序列s以词嵌入向量、分割向量、位置向量三者求和的方式转换为输入序列t=(t1,t2,t3,..,tn),tn表示第n个分词的词嵌入向量、分割向量和位置向量合并后的融合向量;将序列t=(t1,t2,t3,..,tn)输入transformer层通过自注意力函数获取词间关联并分配权重,得到融合上下文信息的特征向量;将所述融合上下文信息的特征向量输入预训练模型,得到序列em={e1,e2,e3,...,en},即该待提取文本的分布式特征;en为第n个分词对应的词向量表示。

10、进一步的,所述特征提取器包括双向长短时记忆网络、卷积层和注意力单元;提取该待提取文本的语境特征及词汇之间的关联信息的方法为:首先将所述分布式特征输入所述双向长短时记忆网络,得到序列特征向量并输入所述卷积层;所述卷积层对所述序列特征向量进行卷积计算,得到该待提取文本的局部特征与语义结构高维特征向量;将所述语义结构高维特征向量输入所述注意力单元,得到该待提取文本中每一分词xi与目标实体的相关性特征向量ri,其中i∈[1,n]。

11、进一步的,所述事件触发词分类器将和ri拼接后输入至条件随机场中,得到该待提取文本中每一分词xi对应的事件类型;为分词xi对应的语义结构高维特征向量。

12、进一步的,所述预训练模型为bert模型。

13、一种服务器,其特征在于,包括存储器和处理器,所述存储器存储计算机程序,所述计算机程序被配置为由所述处理器执行,所述计算机程序包括用于执行上述方法中各步骤的指令。

14、一种计算机可读存储介质,其上存储有计算机程序,其特征在于,所述计算机程序被处理器执行时实现上述方法的步骤。

15、本发明通过文本编码器、特征提取器、事件触发词分类器、事件元素分类器、元素角色分类器完成事件抽取,步骤包括:

16、首先,利用文本编码器对待提取文本内容进行特征表示,将纯文本表示为分布式特征信息;

17、其次,利用特征提取器逐次获取不同抽象程度特征,先通过双向长短记忆网络从文本编码器处理得到的分布式特征中自动捕获文本句子特征;接着,通过卷积神经网络在每个词汇的周围提取局部特征,通过组合由卷积层提取的局部特征向量完成从双向长短记忆网络捕获的文本句子特征中进一步提取语境特征及词间关键信息特征的目的,使用注意力机制为不同的向量表示分配不同的权重,完成从双向长短记忆网络捕获的文本句子特征中学习词汇之间的关联信息,减少文本噪音对抽取效果的影响;

18、然后,利用卷积神经网络与注意力机制提取的深层特征,利用事件触发词分类器对新样本进行分类,判断词汇是否为事件触发词,并基于触发词信息对事件类别进行分类,完成事件类型识别;

19、接着,根据事件类型的特征与获取的特征,利用事件元素分类器对句中每个实体依次进行判断,判断词组是否为事件的元素。

20、最后,使用元素角色分类器判定获取的事件元素的角色类别,最终得到结构化的事件,包含触发词、事件元素及其类别。

21、文本编码器对待抽取信息的文本进行特征表示分为两个过程:特征表示模型构建和模型学习。具体执行步骤如下:

22、1)特征表示模型构建:准备包含n个词的文本序列s=[x1,x2,x3,..,xn],其中xi表示输入文本序列的第i个字符;将文本序列s以词嵌入向量、分割向量、位置向量三者求和的方式转换为输入序列t=(t1,t2,t3,..,tn),其中,词嵌入向量通过查询字向量表得到,分割向量表示词所属句,位置向量表示词位置信息,tn表示s中第n个分词的词嵌入向量+分割向量+位置向量;将序列t=(t1,t2,t3,..,tn)输入transformer层通过自注意力函数获取词间关联并分配权重,得到融合上下文信息的特征向量:

23、

24、q表示解码字隐向量,k是编码器中不同词对应的隐向量,q与编码区中每个词通过向量点积分别计算出一个值,通过softmax函数计算权值。直观来说,q,k,v是同一个句子,通过向量乘积获得词元之间的关系矩阵并归一化后,作用于输入句子自身,即通过多个不同线性变化对q,k,v投影,获取单头注意力:

25、

26、多头注意力机制是拼接不同自注意力机制结果,计算得到不同空间纬度位置信息:

27、multihead(q,k,v)=concat(head1,head2,head3,..,headn)w0;

28、2)模型学习:使用文学作品《格萨尔王传》训练集在特征表示模型上训练学习,动态地生成融合上下文信息的特征向量,得到序列em=bert(t),映射为em={e1,e2,e3,...,en},ei=[w1,w2,...,wm],em即为最终得到的分布式特征,ei为每个输入的字符对应的词嵌入向量,w∈[-1,1],m为指定的词向量维度。

29、特征提取器对分布式特征提取分为两个过程:句子级别特征捕获和高级语义特征捕获。具体执行步骤如下:

30、1)句子级别特征捕获:使用双向长短时记忆网络捕获句向量上下文信息,将分布式特征em输入双向长短时记忆网络,串联第i个字符的前向和后向输出得到第i个字符的序列特征向量,记为得到第i个字符的句子级语义表示li;

31、2)高级语义特征捕获:计算将获取的li通过卷积层使用多个卷积核进行组合完成局部特征提取,convk表示进行卷积运算,卷积核为k;计算完成不同卷积核处理后的最大池化操作,得到融合句子的局部特征与语义结构高维特征向量融合注意力机制,计算α=softmax(q*k),q表示解码字隐向量,k是编码器中不同词对应的隐向量,q与编码区中每个词通过向量点积分别计算出一个值,通过softmax函数计算权值;计算输出向量获取句中字与目标实体的相关性特征向量,ri为待提取文本中分词xi与目标实体的相关性特征向量,其中i∈[1,n]。

32、事件触发词分类器利用特征抽取器中和ri的向量拼接将其输入至条件随机场中,从而完成事件类型的获取,分为构建事件类型依赖关系和推测事件类型两部分。具体执行步骤如下:

33、1)构建事件类型依赖关系:使用条件随机场建模标签之间的依赖关系,对于给定语句s={x1,x2,..,xn}和它对应的序列标签y={y1,y2,..,yn},求在y给出的所有可能的标签序列上计算条件概率p(y\m);计算其中β(s)表示s中有可能的事件类型标签序列;计算f是将特征向量映射到事件类型标签的映射函数;计算wy是预测权值矩阵,是过渡权重;损失函数计算方式l=-∑xlogp(y|s);

34、2)推测事件类型:使用维特比算法解码输入模型τ=(a,b,π)和观测o={o1,o2,..,ot},初始化δ1(i)=πibi(o1),i∈[1,n];递推δt(i)=max1≤j≤n[δt-1(j)aji]bi(ot)与直到p*=max1≤i≤nδr(i)且i*r=argmax1≤i≤n[δr(i)];回溯最优路径求得最优路径得到分析结果,输出获取触发词对应事件类型。

35、事件元素分类器分为特征拼接、构建事件论元依赖关系、推测事件论元类型三部分。具体执行步骤如下:

36、1)特征拼接:将将该待提取文本中每一分词xi对应的事件类型映射为事件向量vi,拼接至ri后,获得融合事件类型信息的特征向量ri={vi,ri};

37、2)构建事件论元依赖关系:使用条件随机场建模标签之间的依赖关系,对于给定语句s={x1,x2,..,xn}和它对应的序列标签g={g1,g2,..,gn},求在y给出的所有可能的标签序列上计算条件概率p(g\s);计算其中β(s)表示s中有可能的事件论元标签序列;计算f是将特征向量映射到事件论元标签的映射函数;计算wg是预测权值矩阵,是过渡权重;损失函数计算方式l=-∑slog(g|s);

38、3)推测事件论元类型:使用维特比算法解码输入模型τ=(c,d,π)和观测o={o1,o2,..,ot},初始化δ1(i)=πibi(o1),i∈[1,n];递推δt(i)=max1≤j≤n[δt-1(j)aji]bi(ot)与直到,p*=max1≤i≤nδr(i)且i*r=argmax1≤i≤n[δr(i)];回溯最优路径求得最优路径得到分析结果,输出论元及论元角色。

39、与现有技术相比,本发明的积极效果为:

40、本发明通过上述融合多个神经网络的事件抽取方法,将卷积神经网络、注意力机制和预训练模型相结合,能够在保证训练效果的同时,有效提升模型训练速度;另一方面,该方法注意到事件类型与事件论元之间的语义关系对于事件抽取的重要性并专注于利用该关系,使得该模型与其他同类型模型相比,准确率与效率均有显著提升。

- 还没有人留言评论。精彩留言会获得点赞!