一种带降噪和纠错的图神经网络对话情感识别方法

本发明属于自然语言处理领域,涉及一种带降噪和纠错的图神经网络对话情感识别方法。

背景技术:

1、对话情感识别不同于传统的文本情感识别,对话情感识别受多种因素影响。在不同的语境下或来自不同的说话人,相同的话语都可能表示不同的情感。li等人在心理学研究中将对话中说话人的情感变化归纳为两个主要影响因素:自我依赖和说话人依赖。自我依赖是指说话人本人会受到自身情感的影响,说话人依赖是指对话双方的情绪会相互影响。在这些因素影响下,准确地识别话语情感是对话情感识别的挑战之一。

2、为了考虑上下文和说话人关系对话语情感的影响,研究学者hazarika、majumder等人利用循环神经网络(recurrent neural network,rnn)捕获对话的时间顺序,记忆不同说话人的上下文历史信息。由于rnn存在长期依赖的问题,即使同时考虑了对话的时间顺序和上下文的影响,这些基于rnn的模型在获取远距离上下文时表现不佳。此外,li等人结合外部知识库来学习话语中的常识知识,提高了模型的语言理解能力。然而,这些方法使会话建模变得复杂,而且远距离上下文的获取仍然有限。图神经网络(graph neural network,gnn)及其变体的出现在一定程度上缓解了rnn长期依赖的问题。由于gnn强大的关联性数据处理能力,越来越多的研究人员倾向于利用gnn进行对话情感识别。最近,song、gao等人在研究中结合gnn和预训练语言模型联系上下文理解对话中的语义句法信息,取得了先进的性能结果。

3、基于gnn的情感识别方法将对话视为一张图,图节点表示话语,边代表话语关系。对话关系是根据自我依赖和说话人之间的依赖建立起来的。然后考虑语义相似度来初始化图中的边权值,表示话语之间的影响。然而,利用所有上下文建立话语依赖时容易联系到弱相关甚至不相关的上下文话语,而考虑过少的上下文会使模型在日常场景的对话中表现不佳。这些方法忽略了对话中存在的另一个潜在影响因素——信息量。直观地,如果一个话语的信息量足够大,能够显著地改变他人的认知,引起情绪的变化,那么在情绪识别中就应该考虑该话语。经常有一些话语缺乏明显的情绪倾向,对情绪的感知贡献不大。将这些上下文作为引用联系起来会浪费计算资源。将语义相关性低和信息量低的话语称为噪声,这些噪声会干扰模型进行情感识别。

4、基于gnn的模型除了在建立话语依赖关系时容易将噪声引入模型外,在学习过程中也容易受到噪声的影响,导致学习特征信息出现错误。lian等人利用图关系神经网络捕捉人际关系和话语关系来修正话语的特征,这在一定程度上缓解了模型未充分理解对话关系导致的预测错误。据所知,目前在对话情感识别方向的纠错系统方面还缺乏相关的研究。

5、综合上述讨论,提出了一种带有降噪和纠错功能的图神经网络。为了减少模型训练时上下文引入的噪声信息,设计了上下文筛选模块来建立话语间的依赖关系。模块能同时考虑到上下文的语义相关性和信息量,使话语与语境具有强相关性和高信息量。这不仅避免了长距离上下文信息的丢失,而且还减少了对模型的噪声干扰。此外,设计了一种特征修正方法来进一步提高模型的性能。特征修正可以将预处理得到的语义特征和图处理得到的情感特征结合起来,通过门控机制控制错误信息,对特征中的部分错误进行修正。最后,在常用的对话数据集上进行了一些实验,包括与最新方法的比较。

技术实现思路

1、有鉴于此,本发明的目的在于提供一种带降噪和纠错的图神经网络对话情感识别方法。

2、为达到上述目的,本发明提供如下技术方案:

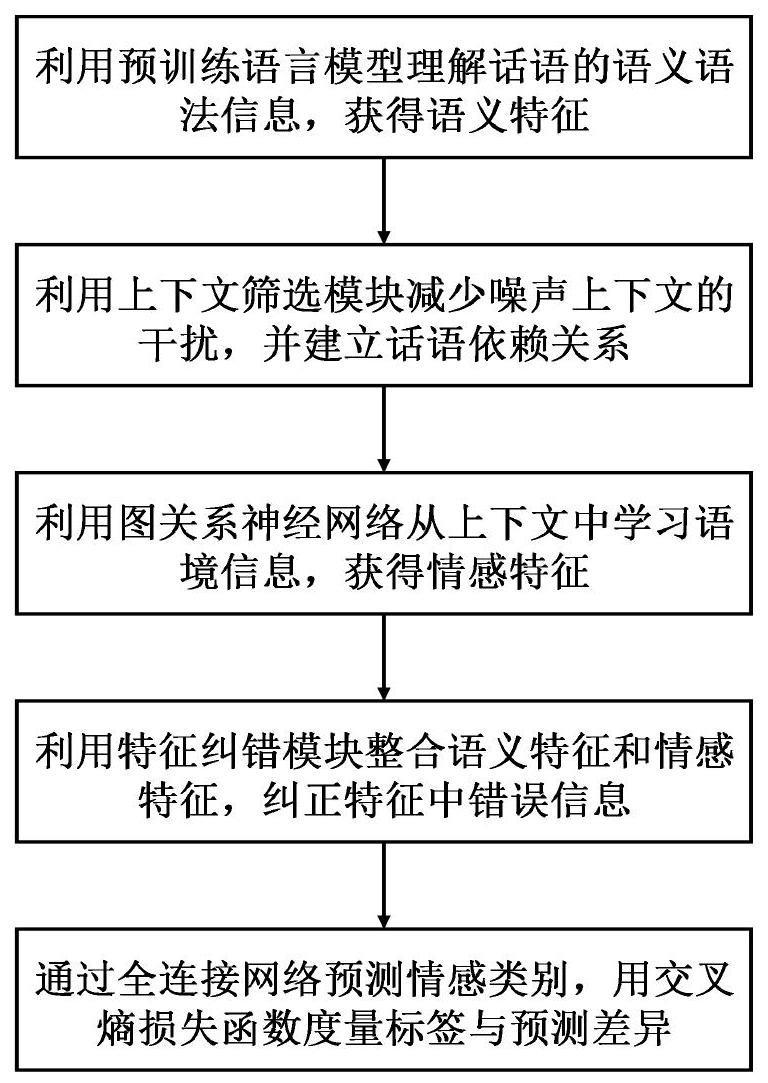

3、一种带降噪和纠错的图神经网络对话情感识别方法,该方法包括以下步骤:

4、步骤一:通过预处理模块,对话中的每句话语将被分词并添加特殊标志位[cls]和[sep]便于后续的分类任务,然后在预训练语言模型中被处理为语义特征;

5、步骤二:使用上下文筛选模块分别评估话语上下文的语义相关性和信息量,根据评估结果丢弃部分噪声上下文,并建立话语之间的依赖关系;

6、步骤三:利用关系图神经网络从上下文中学习语境信息,获得上下文嵌入的情感特征;

7、步骤四:利用特征纠错模块整合语义特征和情感特征,通过门控机制控制特征中的错误信息,纠正其中的部分错误;

8、步骤五:通过全连接网络预测话语情感类别,用交叉熵损失函数度量标签分布和模型预测分布之间的差异。

9、可选的,所述步骤一具体过程包括:首先按照对话顺序获得话语集合{u1,u2,...,un},利用分词器对话语进行分词处理,然后在分词结果前后添加特殊标志位[cls]和[sep]便于后续的分类任务;然后通过预训练语言模型将话语ui处理为1024维的语义特征向量hi的形式:

10、xi={[t1],[t2],...,[tn]},

11、xi={[cls],[t1],[t2],...,[tn],[sep]},

12、hi=roberta(xi).last_hidden_layer[0].

13、其中,xi为话语ui添加特殊标志位后的分词表示,hi是预训练语言模型roberta中最后一个隐藏层的[cls]所表示的特征向量;[cls]能够代表整句话语的语义特征向量,该向量能直接用于分类任务。

14、可选的,所述步骤二中,上下文筛选过程包括:使用余弦相似度来度量目标话语特征hi与上下文特征h之间的语义相关程度,用语义相似度矩阵s1来表示;

15、

16、

17、同时,使用信息熵来度量上下文中包含的信息量,已知话语含有越高的信息熵,其情感的不确定性越高,模型就需要对该话语重点分析;通过累加话语中每个词的信息熵,能够获得上下文的信息熵矩阵:

18、

19、

20、

21、其中,p(tj)表示话语ui中的第j个分词在对话中出现的频率;为了信息熵矩阵能匹配语义相关矩阵的维度,堆叠n个来构造与s1相同的信息熵矩阵得到

22、s=(1-α)·s1+α·s2

23、加权求和语义相关性矩阵s1和信息熵矩阵s2,对求和矩阵s中的每个元素进行筛选,去除部分分数较低的噪声上下文;

24、

25、其中,γ是一个超参数,表示阈值;sij表示上下文话语uj相对于目标话语ui的综合分数;maskij表示话语节点ui和uj之间的连接关系,1表示有连接,0表示无连接。

26、可选的,所述步骤三中,定义一个由n层的关系图神经网络构成的图处理模块,使用图注意力机制关注邻居节点中重要的节点,并赋予权重;

27、

28、话语节点ui将聚合在第l层的邻居节点信息来获得上下文对话语的影响,同时在一定程度上维持了第l层话语本身的情感信息:

29、

30、

31、其中是αij的归一化表示;然后,将每一层包含图结构信息和上下文信息的节点特征都堆叠起来,得到一个从浅层到深层的上下文嵌入的特征m:

32、m=concat(hl),l∈[0,l]

33、最后通过全连接层和激活函数输出话语的情感特征d,其中prelu激活函数能有效地缓解过拟合的问题:

34、d=prelu(wdm+bd)。

35、可选的,所述步骤四中,通过特征纠错模块整合来自预处理语言模块的语义特征以及来自图处理模块的情感特征,利用门控机制控制特征中的错误信息;

36、特征纠错模块的输入分为两个部分,上支路输入是来自于预处理模块的输出,表示话语的语义特征,用h来表示;下支路输入是来自于图处理模块的输出,表示话语的情感特征,用d来表示;然后,将两个支路输入加权求和得到融合特征c,融合特征将单独通过融合信息支路;在以往的大多数模型中,分类模块将直接对融合特征进行分类而没有控制其中的错误的信息;上下支路分别通过一个记忆门更新特征信息,其中记忆门由两种激活函数和一个乘法器组合得到;融合信息支路利用一个遗忘门遗忘部分融合特征信息,其中遗忘门由一个激活函数组成:

37、f=σ(wfh+qfd+bf)

38、同时,特征纠错模块将分别对上下支路的输入进行评估:

39、

40、

41、其中,σ是激活函数,w、q和b是可学习参数;记忆门由遗忘门和学习门组成,用来记住语义特征中重要的特征信息;语义特征h经过遗忘门z决定特征中有哪些信息需要更新,并在学习门c中学习新的特征信息,然后通过乘法器将语义特征h更新为同理,情感特征d被更新为针对融合特征中被遗忘的部分,使用上下支路中更新后的语义特征和情感特征作为补充,达到控制特征中错误信息的目的,得到输出c:

42、

43、其中f、h、d分别是纠错后的融合特征、语义特征和情感特征。

44、可选的,所述步骤五中,特征纠正处理后的输出将作为最终的话语分类特征,利用全连接网络获得话语ui中每个情感类别的概率pi,然后将概率最高的类别下标作为最终的情感预测标签yi:

45、pi=softmax(wcci+bc)

46、

47、其中是话语ui的预测情感,wc和bc分别是可训练权重和全连接层的偏置;使用交叉熵作为损失函数,函数的表达式为:

48、

49、其中,θ是模型中需要训练的参数集合,yi表示第i个情感标签的最高预测概率,表示第i个情感标签的真实值。

50、本发明的有益效果在于:本发明提出一种带降噪和纠错的图神经网络对话情感识别方法,包括:(1)设计了一个上下文筛选模块,能同时关注上下文的语义相关性和信息量,话语能通过该模块联系到相关性强且信息量高的上下文。(2)使用多层关系图神经网络聚合并传递邻居节点之间的节点信息以获得上下文嵌入的情感特征向量。(3)通过一个特征纠错模块,能够有效减少模型出现预测错误,提升了模型在情感识别中的性能。在对话情感识别中,模型情感预测出错是一种常见的现象。但是据所知,纯文本模态的对话情感识别很少有研究关注于纠正这些错误。因此,本发明同时结合了这些模块能够更准确地识别对话所表达的情感。

51、本发明的其他优点、目标和特征在某种程度上将在随后的说明书中进行阐述,并且在某种程度上,基于对下文的考察研究对本领域技术人员而言将是显而易见的,或者可以从本发明的实践中得到教导。本发明的目标和其他优点可以通过下面的说明书来实现和获得。

- 还没有人留言评论。精彩留言会获得点赞!