基于图卷积网络和深度学习网络的遥感图像场景分类方法与流程

本发明涉及属于遥感图像分类,具体涉及一种基于图卷积网络和深度学习网络的遥感图像场景分类方法。

背景技术:

1、高分辨率遥感图像分类是智能化遥感信息处理的一项重要任务,由于遥感图像分辨率的逐步提升,遥感图像的像素或者超像素仅仅包含地物底层信息,不能对图像高层语义内容进行描述,导致了传统的“面向像素”和“面向对象”的分类方法无法满足遥感图像高层次内容解译的需求。因此,“面向场景”的遥感图像分类引起了国内外研究学者的广泛关注,并成为了遥感领域的一个活跃的研究课题。目前所取得的研究成果基本上实现了从地物底层特征到高层场景语义理解上的跨越。高分辨率遥感场景分类任务的目的在于准确地识别出高分图像中局部区域高层次的知识抽象。例如,将一副高分辨率城市遥感图像划分为居民区、商业区和工业区场景这些抽象的语义类别。通常,一幅遥感场景中包含着多种地物类型,例如工业区场景中可能包含房屋建筑、道路、树木等一些地物目标。

2、与面向对象的分类任务不同,遥感场景中地物目标的形式多样、空间分布复杂等因素使得高分辨率遥感场景分类成为了一项相当有挑战性的任务,具体表现包括:(1)场景中地物目标多样化。由于遥感场景中地物目标在几何形状、尺度、方向、纹理等光学属性上的不同,语义类别相同的场景往往具有很大的视觉差异;(2)场景光照条件变化。在获取遥感图像时,成像条件的不同会导致相同类别的场景在辐射强度和颜色上出现很大差异;(3)场景类间相似性。不同的场景类别可能包含完全相同的地物类型,例如居民区和商业区这两类场景中都包括房屋、道路、树木、草坪等地物种类,两者的区别体现在这些地物的空间布局和密度分布上;(4)场景语义模糊性。某些复杂场景在视觉内容上可能与多种预定义的场景语义类别都十分接近,很难赋予其准确的语义类别。

3、其中(1)和(2)共同体现了遥感场景类内差异大的特点;(3)和(4)共同反映了遥感场景类间差异小的特点。另外,与自然场景图像拍摄时的水平视角不同,遥感场景拍摄时拍摄角度为自上而下的俯视视角,场景中地物的分布没有表现为明显的上下、前后的空间关系,也就是说,对遥感场景进行任意角度的旋转并不影响场景目视效果和对场景内容的解译。以上高分辨率遥感场景的这些特点导致了场景识别过程中很容易出现类别混淆的情况。为了提高场景分类准确性,需要从遥感场景自身特性出发,构造或自适应学习出场景描述能力更强的特征表达,从而跨越中低层场景特征与高层场景语义之间的“语义鸿沟”。因此,如何获得有较强场景描述能力和区分能力的场景级特征成为了遥感图像场景分类的关键问题。

技术实现思路

1、基于上述技术问题,本发明提供一种结合图卷积网络和深度学习网络的遥感图像场景分类方法,以遥感领域知识图谱为图数据构建图卷积网络,提取得到的特征更能够描述场景特点,之后利用深度学习网络在推荐区域二次提取特征,并将特征融合后,进行特征编码和特征学习,避免在分类时的场景类别混淆的情况,得到的分类结果精度高。

2、本发明提供一种基于图卷积网络和深度学习网络的遥感图像场景分类方法,该方法包括:

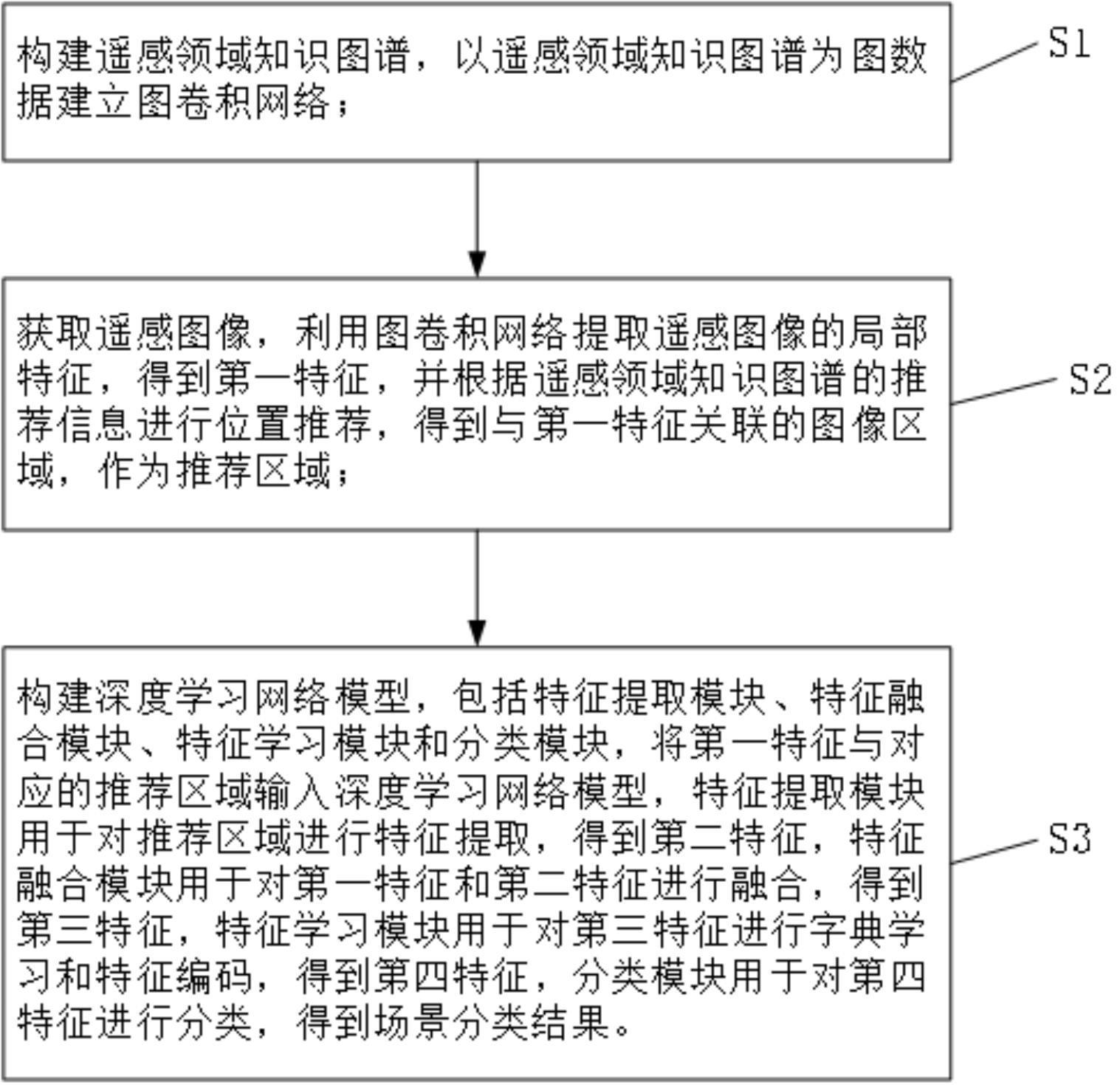

3、s1 构建遥感领域知识图谱,以遥感领域知识图谱为图数据建立图卷积网络;

4、s2 获取遥感图像,利用图卷积网络提取遥感图像的局部特征,得到第一特征,并根据所述遥感领域知识图谱的推荐信息进行位置推荐,得到与所述第一特征关联的图像区域,作为推荐区域;

5、s3 构建深度学习网络模型,包括特征提取模块、特征融合模块、特征学习模块和分类模块,将所述第一特征与对应的所述推荐区域输入所述深度学习网络模型,所述特征提取模块用于对所述推荐区域进行特征提取,得到第二特征,所述特征融合模块用于对所述第一特征和所述第二特征进行融合,得到第三特征,所述特征学习模块用于对所述第三特征进行在线字典学习和特征编码,得到第四特征,所述分类模块用于对所述第四特征进行分类,得到场景分类结果。

6、于本发明一具体实施例中,所述构建遥感领域知识图谱的步骤包括:

7、获取遥感样本数据,所述遥感样本数据包含场景标签,从所述遥感样本数据中提取得到场景显著对象、场景显著对象的区域;

8、根据所述场景显著对象和所述场景显著对象的区域构建遥感本体库;

9、获取地学知识和遥感资料,所述地学知识包括地学数据性知识、地学概念性知识、地学规律性知识,所述遥感资料包括场景资料、地物资料、环境资料、图像资料;

10、利用所述遥感本体库对所述地学知识和所述遥感资料进行本体化表达,得到扩充后的遥感本体库;

11、通过知识抽取的方法对所述扩充后的遥感本体库进行遥感实体的构建,并根据实体链接和实体归类在所述遥感实体之间建立具体关系;

12、将所述遥感实体、所述遥感实体间的关系图谱化,即得到遥感领域知识图谱。

13、于本发明一具体实施例中,所述遥感本体库包含对象属性、区域属性和关联关系属性中的至少一种,其中:

14、所述对象属性包括对象纹理结构、尺度大小和显著组成部分;

15、所述区域属性包括区域显著地物的类型组成、区域的行政区划名称、区域的地理结构类型和地质结构类型;

16、所述关联关系属性包括对象与对象之间、对象与地区之间的主要关联关系类型。

17、于本发明一具体实施例中,所述建立图卷积网络的步骤包括:

18、所述遥感领域知识图谱由节点和边构成,所述节点为所述遥感实体,所述边为所述遥感实体间的关系,根据所述节点和边构造邻接矩阵和对角矩阵,根据所述邻接矩阵和对角矩阵构建拉普拉斯矩阵;

19、通过傅里叶变换方法和所述拉普拉斯矩阵得到图卷积网络的卷积核;

20、以所述卷积核为基础构建图卷积网络,所述图卷积网络由两层图卷积层和一层图池化层构成。

21、于本发明一具体实施例中,步骤s2包括:

22、获取遥感图像,将所述遥感图像输入所述图卷积网络;

23、利用所述图卷积层对所述遥感图像进行图卷积操作,并利用所述图池化层进行最大图池化操作,输出得到的特征为所述第一特征;

24、利用遥感领域知识图谱中场景显著对象和场景显著对象的区域的知识,将所述第一特征相关联的区域进行标记,得到所述推荐区域。

25、于本发明一具体实施例中,所述特征提取模块包括深度学习网络,所述深度学习网络的最后一层为全连接层。

26、于本发明一具体实施例中,所述第一特征的维度与所述第二特征的维度相同。

27、于本发明一具体实施例中,所述特征学习模块包括在线字典和局部线性约束编码算法,所述在线字典通过遥感样本进行预训练得到。

28、于本发明一具体实施例中,预训练所述在线字典的步骤包括:

29、步骤一,获取遥感样本,对所述遥感样本进行密集sift特征提取,并对密集sift特征进行聚类,聚类中心作为原子构建在线字典;

30、步骤二,利用在线字典和局部线性约束编码算法对所述密集sift特征进行特征编码,得到所述密集sift矩阵的编码矩阵;

31、步骤三,根据在线字典学习算法基于所述编码矩阵逐个计算所述原子的重构误差;

32、步骤四,根据所有的所述原子的重构误差计算得到全局重构误差;

33、步骤五,利用所述全局重构误差通过最小二乘法对所述在线字典进行更新;

34、步骤六,重复步骤二-步骤五,直至重构误差达到预设要求或迭代次数达到预设值。

35、于本发明一具体实施例中,所述在线字典学习算法为mod算法。

36、本发明提供的一种基于图卷积网络和深度学习网络的遥感图像场景分类方法,相对于现有技术,本发明的技术方案具有如下有益效果:

37、(1)通过构建遥感领域知识图谱,学习遥感图像场景对象和区域的知识,并以遥感领域知识图谱为图数据建立图卷积网络,能够在保留图像的信息的前提下,降低图像的尺寸,并增大图卷积核的感受野,以便于提取到包含高层语义的特征,且能防止过拟合,提取到的第一特征能更好的描述场景的语义信息。

38、(2)遥感领域知识图谱能够针对第一特征进行周围区域的推荐,然后用深度学习网络在推荐区域进行二次特征提取,增加能够描述图像的特征,且第一特征与第二特征的维度相同,便于将两种特征进行融合,融合特征能够更加全面和更具代表性,对于易混淆的图像也有较高的分类准确率。

39、(3)本发明所采用的在线字典学习方法是在不断重构与编码的过程中学习字典,所得到的在线字典更具有表达能力,而局部约束线性编码算法能令同类场景的遥感图像的编码系数更相近,而不同场景间遥感图像的编码系数差异更大,能有效避免遥感图像场景分类时的场景易混淆的情况,且得到的第四特征具有局部性和稀疏性,更加的易于分类,提高了分类的准确率和精度。

- 还没有人留言评论。精彩留言会获得点赞!