基于多视图的物体三维重建方法、装置、设备及存储介质与流程

本发明属于物体三维建模,具体涉及一种基于多视图的物体三维重建方法、装置、设备及存储介质。

背景技术:

1、相较于二维图像,三维模型能提供场景物体的空间结构信息,有助于人们更好地对场景物体进行观察、理解和分析;因此,三维重建技术已成为计算机视觉和计算机图形学的研究热点和难点,且已经在元宇宙、电子商务、文化遗产保护等领域有着广泛的实际应用。

2、目前,三维重建方法主要有两种,一是使用工业级的激光扫描仪或rgb-d相机直接测量物体表面的深度信息,然后基于测量的深度信息来完成物体的三维重建,该方法虽然精度较高、简单直接,但数据采集设备昂贵,适用范围受到了很大的限制;另一种方法则是通过美术建模师使用专业的建模软件一点点重建出物体,该方法需要花费大量的时间,且需要较强的专业知识,使用范围依旧很狭小;因此,如何提供一种成本低、门槛低以及效率高的物体三维重建方法,已成为一个亟待解决的问题。

技术实现思路

1、本发明的目的是提供一种基于多视图的物体三维重建方法、装置、设备及存储介质,用以解决现有技术中所存在的成本高、花费时间长以及需要较强专业知识的问题。

2、为了实现上述目的,本发明采用以下技术方案:

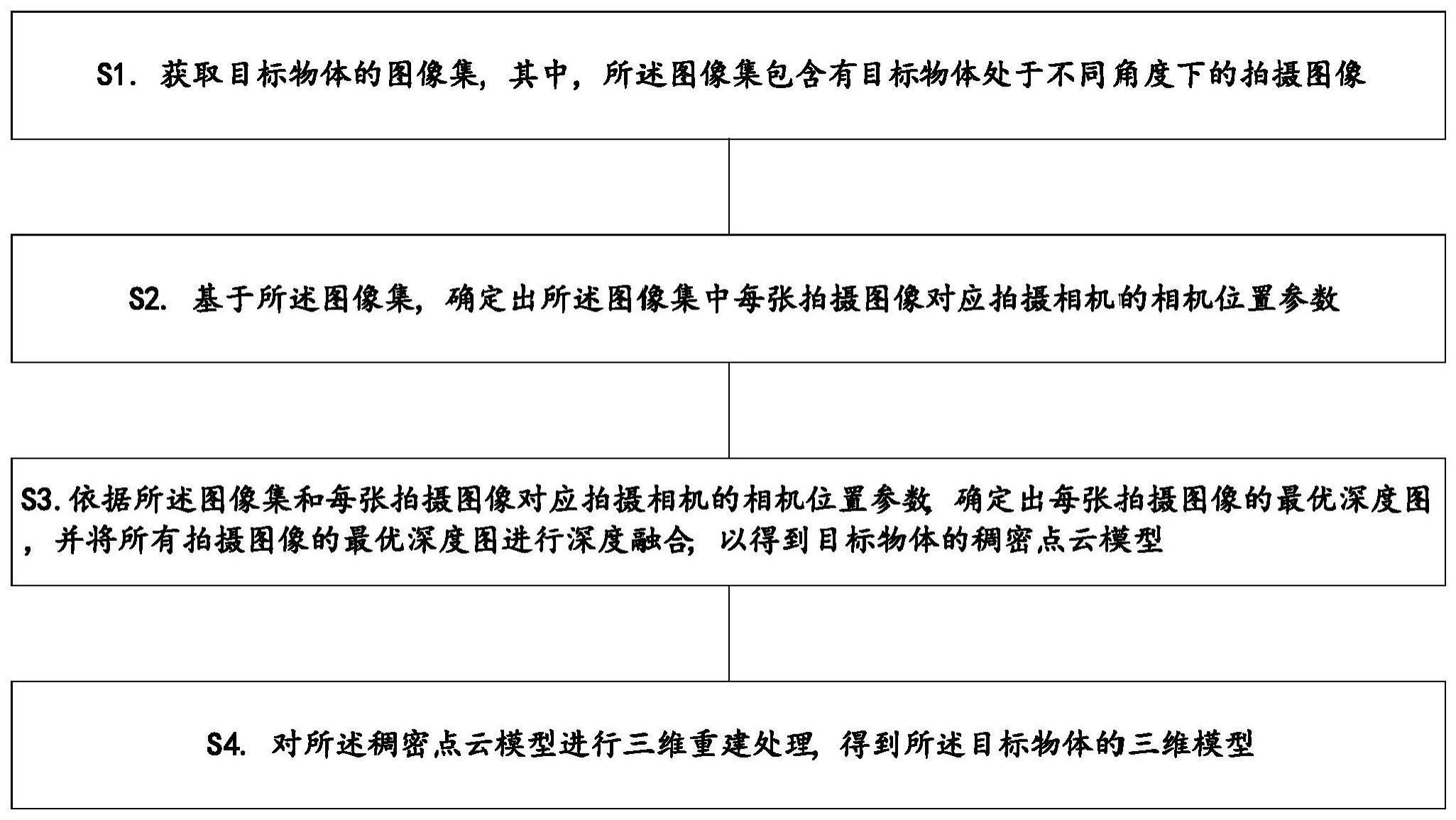

3、第一方面,提供了一种基于多视图的物体三维重建方法,包括:

4、获取目标物体的图像集,其中,所述图像集包含有目标物体处于不同角度下的拍摄图像;

5、基于所述图像集,确定出所述图像集中每张拍摄图像对应拍摄相机的相机位置参数;

6、依据所述图像集和每张拍摄图像对应拍摄相机的相机位置参数,确定出每张拍摄图像的最优深度图,并将所有拍摄图像的最优深度图进行深度融合,以得到目标物体的稠密点云模型;

7、对所述稠密点云模型进行三维重建处理,得到所述目标物体的三维模型。

8、基于上述公开的内容,本发明先获取目标物体在不同角度下的拍摄图像;而后,再确定出每张拍摄图像的相机位置参数,以便利用每张拍摄图像的相机位置参数,来确定出每张拍摄图像的最优深度图;如此,该步骤相当于得出了目标物体在不同角度下的深度信息,从而可为目标物体的三维建模提供数据基础;接着,本发明将所有拍摄图像的最优深度图进行深度融合,得到目标物体的稠密点云模型;最后,对融合得到的稠密点云模型进行三维重建处理,即可得到目标物体的三维模型;由此通过前述设计,本发明能够以物体的图像为输入,来直接输出物体的三维模型,不仅降低了使用者的技术门槛,极大地提升了操作的便捷性和三维重建效率,还无需使用专业的深度采集设备,从而降低了重建成本。

9、在一个可能的设计中,基于所述图像集,确定出所述图像集中每张拍摄图像对应拍摄相机的相机位置参数,包括:

10、对于所述图像集中的第i张拍摄图像和第i+1张拍摄图像,对所述第i张拍摄图像和所述第i+1张拍摄图像进行特征提取处理,得到所述第i张拍摄图像和所述第i+1张拍摄图像的特征点,以利用所述第i张拍摄图像和所述第i+1张拍摄图像的特征点,组成特征点集合;

11、基于所述特征点集合,对所述特征点集合中的各个特征点进行特征匹配,得到若干匹配特征对,其中,所述若干匹配特征对中的任一匹配特征对包括两个特征点,且所述任一匹配特征对中的两个特征点用于表征所述目标物体的同一位置;

12、基于所述若干匹配特征对,计算出所述第i张拍摄图像对应拍摄相机与所述第i+1张拍摄图像对应拍摄相机之间的共同位置参数;

13、利用所述共同位置参数,确定出所述第i张拍摄图像对应拍摄相机的相机位置参数,以及所述第i+1张拍摄图像对应拍摄相机的相机位置参数;

14、将i自加1,并重新对所述第i张拍摄图像和所述第i+1张拍摄图像进行特征提取处理,直至i等于n-1时,得到每张拍摄图像对应拍摄相机的相机位置参数,其中,i的初始值为1,且n为所述图像集中拍摄图像的总数量。

15、在一个可能的设计中,基于所述若干匹配特征对,计算出所述第i张拍摄图像对应拍摄相机与所述第i+1张拍摄图像对应拍摄相机之间的共同位置参数,包括:

16、基于每个匹配特征对,并按照如下公式(1),构建出每个匹配特征对的相机位置约束方程;

17、

18、上述式(1)中,pa1和pa2分别表示第a个匹配特征对内的两特征点的坐标矩阵,k、t和r依次表示第i张拍摄图像对应拍摄相机与所述第i+1张拍摄图像对应拍摄相机之间的第一内参矩阵、第一平移运动距离和第一旋转矩阵,t表示转置运算,a=1,2,..,a,且a表示所述特征对的总数量;

19、依据若干相机位置约束方程,计算得出所述第i张拍摄图像对应拍摄相机与所述第i+1张拍摄图像对应拍摄相机之间的第一内参矩阵、第一平移运动距离以及第一旋转矩阵;

20、利用所述第一内参矩阵、所述第一平移运动距离以及所述第一旋转矩阵,组成所述共同位置参数。

21、在一个可能的设计中,依据所述图像集和每张拍摄图像对应拍摄相机的相机位置参数,确定出每张拍摄图像的最优深度图,包括:

22、对于所述图像集中的第i张拍摄图像,利用所述第i张拍摄图像的相机位置参数,对目标图像进行视角校正,得到校正图像,其中,所述目标图像为所述图像集中去除所述第i张拍摄图像后所剩余的拍摄图像,且校正图像的拍摄角度与第i张拍摄图像的拍摄角度相同;

23、对于所述第i张拍摄图像中的第l个像素点,确定出第l个像素点的深度像素区域;

24、基于所述第l个像素点的深度像素区域以及所述校正图像,计算出所述第l个像素点的最优深度值;

25、将l自加1,并重新确定出所述第l个像素点的深度像素区域,直至l等于l时,得到所述第i张拍摄图像中所有像素点的最优深度值,以便利用第i张拍摄图像中所有像素点的最优深度值得到所述第i张拍摄图像的最优深度图,其中,l的初始值为1,且l为所述第i张拍摄图像中像素点的总数量;

26、将i自加1,并重新利用所述第i张拍摄图像的相机位置参数,对目标图像进行视角校正,直至i等于n时,得到每张拍摄图像的最优深度图,其中,i的初始值为1,且n为图像集中拍摄图像的总数量。

27、在一个可能的设计中,每张拍摄图像对应拍摄相机的相机位置参数均包括有:第二内参矩阵、第二旋转矩阵以及第二平移运动距离;

28、其中,利用所述第i张拍摄图像的相机位置参数,对目标图像进行视角校正,得到校正图像,包括:

29、对于目标图像中的第m张目标图像,利用所述第i张拍摄图像的相机位置参数,并采用如下公式(2),对所述第m张目标图像进行视角校正,得到所述第m张目标图像对应的校正图像;

30、

31、上述式(2)中,im′表示第m张目标图像对应的校正图像,k′、t′和r′依次表示所述第i张拍摄图像的相机位置参数中的第二内参矩阵、第二平移运动距离和第二旋转矩阵,表示深度假设值,n表示所述第i张拍摄图像的主轴方向矩阵,t表示转置运算,im表示第m张目标图像,m=1,2,...,m,m为目标图像的总数量。

32、在一个可能的设计中,基于所述第l个像素点的深度像素区域以及所述校正图像,计算出所述第l个像素点的最优深度值,包括:

33、基于所述第l个像素点的深度像素区域以及所述校正图像,并采用如下公式(3),计算出所述第l个像素点的最优深度值;

34、

35、上述式(3)中,θl′表示第l个像素点的最优深度值,sl(m)为相似度的概率函数,为第l个像素点的深度像素区域,与第m个校正图像中目标区域之间的颜色相似度,表示深度假设值,m表示校正图像的总数量,argmin表示取值最小时所对应的深度假设值,其中,所述目标区域在第m个校正图像中所表征的位置,与所述第l个像素点的深度像素区域在所述第i张拍摄图像中所表征的位置相同,且设置有多个。

36、在一个可能的设计中,对所述稠密点云模型进行三维重建处理,得到所述目标物体的三维模型,包括:

37、采用随机下采样算法,对所述稠密点云模型进行点云下采样处理,得到压缩后的点云模型;

38、采用泊松面片重建算法,对所述压缩后的点云模型进行面片重建,得到所述目标物体的三维模型。

39、第二方面,提供了一种基于多视图的物体三维重建装置,包括:

40、图像获取单元,用于获取目标物体的图像集,其中,所述图像集包含有目标物体处于不同角度下的拍摄图像;

41、相机参数确定单元,用于基于所述图像集,确定出所述图像集中每张拍摄图像对应拍摄相机的相机位置参数;

42、深度融合单元,用于依据所述图像集和每张拍摄图像对应拍摄相机的相机位置参数,确定出每张拍摄图像的最优深度图,并将所有拍摄图像的最优深度图进行深度融合,以得到目标物体的稠密点云模型;

43、三维重建单元,用于对所述稠密点云模型进行三维重建处理,得到目标物体的三维模型。

44、第三方面,提供了另一种基于多视图的物体三维重建装置,以装置为电子设备为例,包括依次通信相连的存储器、处理器和收发器,其中,所述存储器用于存储计算机程序,所述收发器用于收发消息,所述处理器用于读取所述计算机程序,执行如第一方面或第一方面中任意一种可能设计的所述基于多视图的物体三维重建方法。

45、第四方面,提供了一种存储介质,存储介质上存储有指令,当所述指令在计算机上运行时,执行如第一方面或第一方面中任意一种可能设计的所述基于多视图的物体三维重建方法。

46、第五方面,提供了一种包含指令的计算机程序产品,当指令在计算机上运行时,使计算机执行如第一方面或第一方面中任意一种可能设计的所述基于多视图的物体三维重建方法。

47、有益效果:

48、(1)本发明能够以物体图像为输入,来直接输出物体的三维模型,不仅降低了使用者的技术门槛,极大地提升了操作的便捷性和三维重建效率,还无需使用专业的深度采集设备,从而降低了重建成本。

- 还没有人留言评论。精彩留言会获得点赞!