一种基于Transformer地震信号分类识别方法

本发明涉及对地震信号震源类别分类识别研究,属于信号处理领域的信号分类领域,具体是一种基于transformer地震信号分类识别方法。

背景技术:

1、依据所观测到的地震波形信号区分识别观测波形对应事件源类型(如天然地震事件或人工爆破事件),近几十年来一直是地震学研究的难点和热点。近年来,与人类各种活动相关的人工爆破/爆炸的频度逐渐增加,例如爆破、核试验等,增加了获取天然地震目录的难度,也凸显了地震波形信号分类识别的必要性。因此,如何准确地识别天然地震和非天然地震具有十分重要的科学意义和现实意义。近年来,深度学习成为机器学习的一个热门研究方向。作为一种由多个隐藏层组成的多层神经网络学习算法,深度学习对输入数据的特征学习有着非常好的效果。在图像分类、图像分割和目标检测等方面取得极大的进展。在天然地震和人工爆破的地震信号分类识别研究中,深度学习能更好地提取地震信号特征包括蕴含在地震信号中的不同类型震源差异特征,根据所提取的特征进行准确的震源类型分类。卷积神经网络是深度学习中的热门研究方向,国内外的许多学者提出了基于卷积神经网络的地震信号识别研究,方法[chen r 2018]通过梅尔倒谱提取地震波形特征作为卷积神经网络输入,对地震和爆破进行识别分类(chen r,huang h,chai h.study on thediscrimination of seismic waveform signals between earthquake and explosionevents by convolutional neural network[j].progress in geophysics,2018,33(4):1331-1338.)。方法[yonggang w 2019]通过残差网络模型对天然地震和人工爆破识别,将波形转换为功率谱作为模型的输入,通过模型学习地震波形和爆破波形的频谱特征,提高震源类型分类识别能力(yonggang w,qianli y,tingting w,et al.earthquake andexplosion identification based on deep learning residual network model[j].地震学报,2019,41(5):646-657.);方法[tian x 2022]使用多输入卷积神经网络模型,将天然地震和人工爆破的波形信号和波形信号的时频数据作为模型的输入,提高模型的分类识别能力(tian x,wang m j,zhang x,et al.discrimination of earthquake and quarryblast based on multi-input convolutional neural network[j].chinese journal ofgeophysics,2022,65(5):1802-1812.)。方法[kong q 2022]通过将深度学习与p/s振幅比和局部震级等物理特征相结合,提高模型的泛化性能(kong q,wang r,walter w r,etal.combining deep learning with physics based features in explosion-earthquake discrimination[j].arxiv preprint arxiv:2203.06347,2022.)。方法[ku b2020]在卷积神经网络中引入se注意力机制,在地震事件分类中取得良好效果(ku b,kimg,ahn j k,et al.attention-based convolutional neural network for earthquakeevent classification[j].ieee geoscience and remote sensing letters,2020,18(12):2057-2061.)。

2、卷积神经网络在震源类型识别上取得很好的效果,但卷积神经网络中的卷积核存在感受野比较局限的问题,需要堆叠多层卷积-池化这类结构进行扩大感受野。但这样堆叠扩大的感受野会以某个中心原点向外高斯衰减,使实际感受野远小于理论感受野,不利于利用上下文信息进行特征捕获。

技术实现思路

1、本发明的目的是为了更好地学习到地震信号特征全局信息,提高天然地震和人工爆破的分类准确率,而提供一种基于transformer地震信号分类识别方法。这种方法能通过自注意力的方式捕获全局上下文信息,对目标建立其远距离依赖关系,提取更深层次的特征,提高震源信号的识别能力。

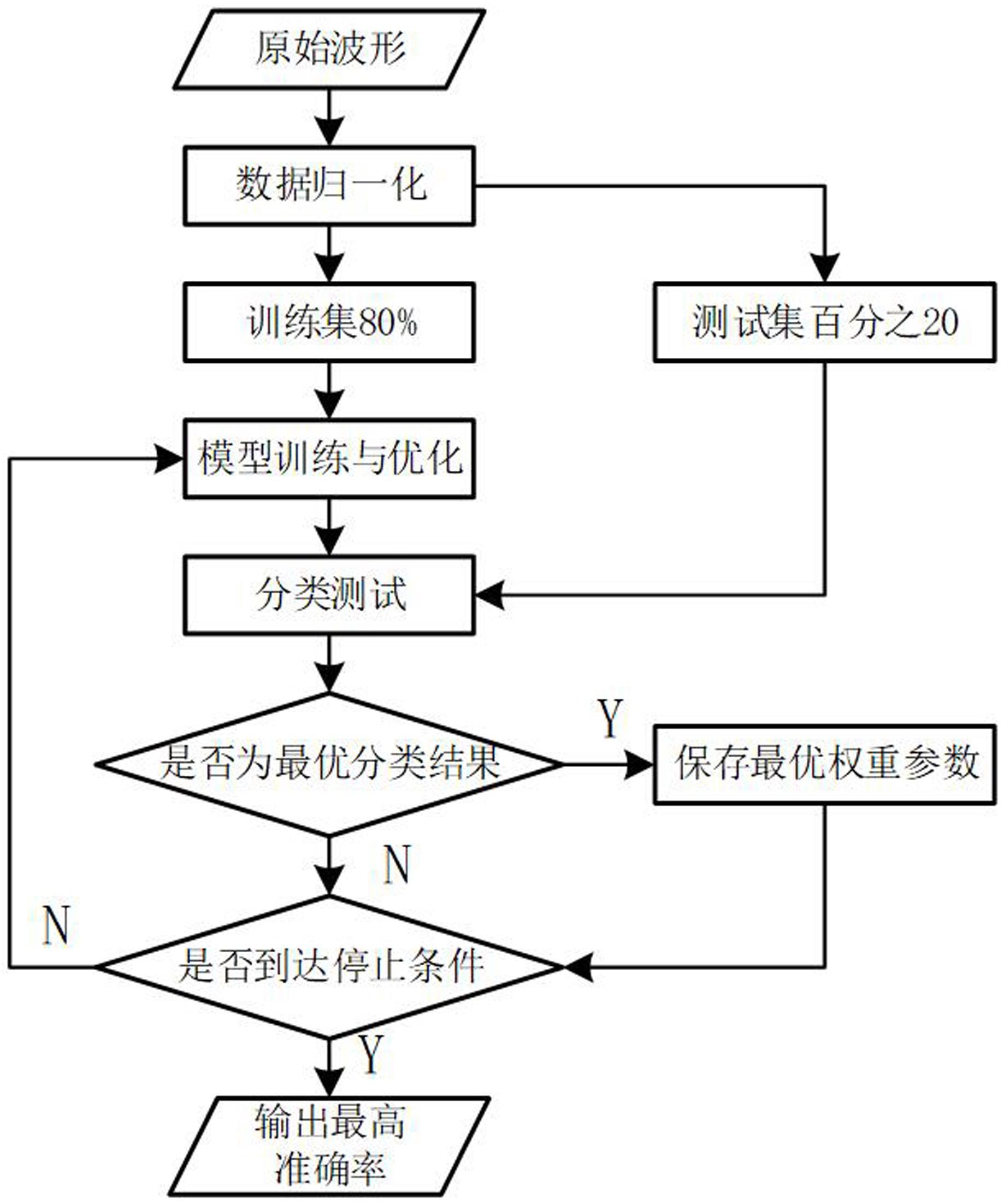

2、实现本发明目的是技术方案是:

3、一种基于transformer地震信号分类识别方法,包括如下步骤:

4、s1.数据获取:获取地震站台记录的三分量事件波形数据,其中三分量分别为东西分量、南北分量和垂直分量;将一个事件波形数据的三分量当作三个事件来进行识别,即把一个事件中的一个分量当作一个识别单元,以增加数据集的数量,使模型能学习到波形特征,具体实施过程包括以下两个处理:

5、s11:数据截取与去均值倾向:由于原始波形数据记录的时间长度不同,因此先对原始波形数据进行预处理,将原始波形截取相同的长度,原始波形数据中记录从p波初动到s波结束的时间相差较大,由几十秒至几百秒不等,为了充分将波形特征留在截取的长度范围内,截取时间为s波初动前的160秒开始,截取长度为327.68秒,采样频率为100hz,采样点为32768点,然后将数据通过差分法进行去除均值倾向,令h0=0,其运算公式为:

6、hk=dk-dk-1,k∈[1,n];

7、s12:数据归一化:不同地震信号数据幅值可能差距过大,同一地震信号台站距离震源的远近也会对幅值产生一定的影响,为了确保地震信号数据在相同的离散程度下进行比较,帮助模型更快地收敛,需要对实验使用的地震信号数据进行归一化处理,使用最大最小值归一化方法,将地震信号数据放缩至[0,1]区间,最大最小值归一化公式为:

8、

9、s2.构建主干网络:主干网络由地震波形数据进行特征提取,以学习地震信号的特征,然后对特征进行分类,主干网络主要由以下几步构成:

10、s21:构建自注意力模块:自注意力机制通过计算输入序列之间的相互影响,捕获全局上下文信息,对目标建立远距离依赖,解决传统注意力长距离依赖有限问题,注意力计算过程如下所示:

11、假设xi,i∈(1,2,3,…,n)为输入样本的特征图,wq,wk,wv分别为生成qi,ki,vi的模型权重系数,将xi,i∈(1,2,3,…,n)分别与wq,wk,wv权重系数相乘得到qi,ki,vi,i∈(1,2,3,…,n),计算qi与ki之间的相关性,除以k矩阵维度的平方根使用softmax函数对结果进行计算,与对应的vm相乘得到加权运算后特征图zi,i∈(1,2,3,…,n),计算公式为:

12、

13、s22:构建多头自注意力模块:多头自注意力模块是将qi,ki,vi整体看作一个头,通过多个不同的头来计算特征图中不同特征之间的相关性,将xi与多组wq,wk,wv相乘得到qi,ki,vi,i∈(1,2,3,…,n),并进行自注意力计算,得到不同头的计算结果,不同头的计算结果进行拼接后输入全连接层进行线性变换得到最终结果,公式为:

14、zhi=attention(qwiq,qwik,qwiv)

15、z1=concat(zh1,zh2,zh3)wl;

16、s23:构建窗口式多头自注意力模块:通过特征图按照窗口大小为16划分为多个窗口,然后每个特征图窗口x与不同的权重矩阵wq,wk,wv相乘得到相应的查询向量q、键向量k和值向量v,再对每个窗口进行多头自注意力的计算,计算结束后,将每个窗口特征图拼接成一个与划分窗口之前一样大小的特征图,然后基于构建出的窗口式多头自注意力模块构建滑动窗口多头自注意力模块,滑动窗口多头自注意力模块主要获取跨窗口信息;

17、s24:构建滑动窗口多头自注意力模块:滑动窗口多头自注意力机制是通过对窗口多头自注意力进行滑窗操作,即在特征图划分窗口之前,对特征数据做一个滚动操作,使不同窗口之间能够进行信息传递,获取长距离依赖,同时具有全局感受野,然后基于构建出的滑动窗口多头自注意力模块构建滑动窗口多头自注意力模块,滑动窗口多头自注意力模块主要获取跨窗口信息;

18、s25:构建空间置换滑动窗口多头自注意力模块:空间置换滑动窗口多头自注意力模块层采用了swin transformer网络结构中的滑动窗口多头注意力机制和shuffletransformer网络中的空间置换规则,在滑动窗口多头注意力机制(shifted windowsmulti-head self-attention,简称sw-msa)的前后对输入数据进行空间置换,不同的通道之间相互交换,使连续的两个窗口多头自注意力机制层的第二个窗口多头自注意力机制层能够接收来自不同窗口的输入,促进窗口间的信息交互;

19、s26:构建mlp模块:通过mlp模块对空间置换滑动窗口多头自注意力计算结果进行优化;

20、s27:构建总网络:总网络的第一层为卷积核大小为16,步长为16,通道数为12的卷积层,通过第一层的卷积层,将大小为32768×1震源信号分割成大小为2048×1的非重叠特征图,然后将得到的特征图输入到由窗口多头自注意力机制(windows multi-head self-attention,简称w-msa)层和空间置换滑动窗口多头自注意力机制(shuffle shiftedwindows multi-head self-attention,简称ssw-msa)层组成的transformer模块,提取特征图的全局信息,再将特征图输入合并层,对特征图进行间隔4个特征点采样,并拼接成一整个张量,尺寸缩小4倍,通道数升为4倍,再通过全连接层将通道数降为2倍,缩小特征图的尺寸大小,提升通道数,得到大小为512×24的特征图,w-msa层和ssw-msa层相比多头自注意力机制(multi-head self-attention,简称msa)层,能减少计算力和内存需求,提升局部建模能力,然后再分别经过1个transformer模块、1个合并层、1个w-msa和ssw-msa层,最后经过层归一化(layer normalization,简称ln)、全局池化和全连接层输出最终分类结果;

21、每个transformer模块由窗口多头自注意力机制层和空间置换滑动窗口多头自注意力机制层组成,窗口多头自注意力机制层和空间置换滑动窗口多头自注意力机制层由层归一化、窗口多头自注意力机制、空间置换滑动窗口多头自注意力机制(ssw-msa)和多层感知机(multi-layer perceptron,简称mlp)通过残差链接组成;具体过程可表示为:

22、xl=w-msa(ln(zl-1))+zl-1,

23、zl=mlp(ln(xl))+xl,

24、yl=ssw-msa(ln(zl))+zl,

25、zl+1=mlp(ln(yl))+yl,

26、其中xl,yl和zl分别表示w-msa模块、ssw-msa模块和多层感知机(mlp)模块的输出特征,当固定窗口多头自注意力机制的窗口大小为m后,假设多头自注意力有n个块数量,窗口式多头自注意力的每个窗口有m个块数量,则多头自注意力的和窗口多头自注意力计算复杂度为:

27、ω(msa)=4nc2+2n2c

28、ω(w-msa)=4nc2+2nmcc表示通道数,当m小于n时,模型的训练速度和计算效率会有提升;当m固定时,基于窗口自注意力的计算复杂度随n线性增长;

29、s3.在训练阶段,采用使用rmsprop优化器对模型的参数权重进行优化;

30、此阶段总结为:

31、(1)提出一个在一维时序数据中,相较于多头自注意力,计算复杂度更小的窗口多头自注意力;

32、(2)提出了一个基于空间置换和滑窗的窗口多头自注意力用于天然地震与人工爆破的分类识别,相对于多头自注意力机制对计算力和内存的超大量需求,使用基于窗口的多头注意力算法,减少模型训练时的计算力和内存需求;

33、s4.参数配准,训练模型;训练参数具体设置如下所示:

34、batch_size=64,epoch=1000,optimizer=adam,learning_rate=0.001;

35、实验环境具体设置如表1所示:

36、表1实验环境参数表

37、

38、本技术方案方法与resnet18卷积网络模型,基于多头注意力的vit模型,以及传统的svm算法等方法进行比较,本文方法能更准确地对天然地震和人工爆破进行区分。本文方法与上述方法相比,在不同信噪比的高斯白噪声下,大部分情况下分类准确率都优于上述方法,并且随着信噪比的降低仍然有着较高的准确率。

- 还没有人留言评论。精彩留言会获得点赞!