基于Retinex的非配对图像去沙尘方法

本发明属于图像处理,具体涉及一种基于retinex的非配对图像去沙尘方法。

背景技术:

1、由于沙尘粒子的吸收和散射,从沙尘暴天气拍摄的图像或视频通常会遭受严重的破坏,颜色漂移或细节信息丢失,这直接影响到高层计算机视觉任务的性能,如目标检测[1]和语义分割[2]。现有的通用图像增强算法在保留背景物体的颜色和细节信息的同时,很难去除前景灰尘。因此,在网络训练缺乏清晰灰尘图像对的限制下,基于深度学习的图像去沙尘方法的研究成为该领域的一个挑战。现有的图像除尘方法可以简单地分为传统方法[3-6]和基于深度学习的方法[7]、[8]。根据是否考虑物理退化过程或固有的自然特性,传统方法可进一步分为非基于模型的方法和基于模型的方法。基于模型的方法是通过对图像退化机理的先验知识来寻找物理模型上相应的逆处理。使用物理模型的方法要普遍好于非基于模型的方法。其中,大气散射模型和retinex模型是图像处理领域中应用最广泛的两种模型。然而,大气散射模型是一个简化的模型,由于忽略了大气粒子的吸收、辐射和多次散射,它通常不能准确地描述真实世界的沙尘成像,无法有效去除沙尘。retienx模型是一个非常通用和简单的理论,广泛应用于图像异常光照处理领域。相较于大气散射模型,其具有有效且强大的沙尘去除能力。

2、随着深度学习技术的蓬勃发展,越来越多的研究人员使用卷积神经网络(cnns)探索图像去沙尘问题。基于cnn的算法往往比传统算法的效果更好。而cnns的成功在一定程度上归功于现有的合成图像数据集或少数真实的配对图像。换言之,有效的基于监督学习的模型需要大量的配对沙尘图像进行训练,而这在现实世界中是很难收集的。而且,由于合成图像与真实图像之间的域不适用性,过度拟合于合成图像会导致网络无法有效处理真实图像,泛化能力降低。因此,为了进一步提高处理真实沙尘图像的泛化能力,一些研究者开始转向探索非配对学习图像去沙尘策略。

技术实现思路

1、本发明的目的在于针对图像去沙尘问题,提供一种基于retinex的非配对图像去沙尘方法,构建图像去沙尘模型dedustgan,dedustgan具有有效的弱监督,使用非配对的清晰和沙尘图像进行训练,这弥补了现实世界中缺乏清晰和沙尘图像对的限制;在本发明中,提出一种无参考融合策略,以融合物理模型恢复和网络直接映射的优点,更好的恢复沙尘图像。

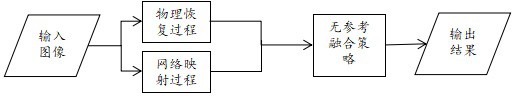

2、为实现上述目的,本发明的技术方案是:一种基于retinex的非配对图像去沙尘方法,构建图像去沙尘深度网络模型,包括照明估计网络和沙尘恢复网络,并提出无参考融合策略;输入图像分别经过照明估计网络和沙尘恢复网络得到物理恢复图像jretinex和网络除尘图像jrefine,而后使用无参考融合策略融合两种经过不同方式恢复的图像并输出最终的结果。

3、在本发明一实施例中,所述图像去沙尘深度网络模型基于retienx构建,具体如下:

4、基于retienx理论,图像i是反射率图像r乘以照明图像l,即图像中的每个像素值通过以下方法计算:

5、i(z)=r(z)*l(z) (1)

6、其中,*表示逐元素相乘;

7、为去除沙尘,将retinex模型修改为以下表达式:

8、idust(z)=jfree(z)*lt(z) (2)

9、其中,idust是沙尘图像,jfree是无沙尘图像即正常光照下的图像,lt是透射照明图像,z是像素位置;即将无沙尘图像作为沙尘图像的反射分量,建立沙尘图像和无沙尘图像之间的retienx模型,网络从沙尘图像中估计出透射照明图像得到正常光照下的图像即去沙结果。

10、在本发明一实施例中,图像去沙尘深度网络模型继承自cyclegan的主干网络包括由三个子网络组成的两个分支,即包括照明估计网络gl、沙尘恢复网络gj和鉴别器d;gl是一个u-net,它包括8个下采样层和8个上采样卷积层,gj是一个具有9个剩余块的resnet,d是一个具有5个卷积层的基本patchgan;

11、第一个分支:通过给出一组非配对的清晰和沙尘图像,首先将输入沙尘图像同时发送到照明估计网络和沙尘恢复网络,以分别估计出透射照明图像lt和网络除尘图像jrefine;将lt和jrefine根据retienx模型模拟沙尘图像的成像过程,生成新的沙尘图像;通过计算idust和iretinex之间的l1损失来训练gl,以准确地估计光照lt;最后,通过估计的lt结合输入的沙尘图像idust,根据retinex模型得到物理恢复图像jretinex作为第一个分支的最终输出;

12、第二个分支:对于第二个分支,增加一个鉴别器d,它接受非配对的沙尘图像idust和无尘图像jfree进行弱监督对抗性学习,并更新gj以学习idust和jfree之间的映射关系;然后得到另一个网络除尘图像jrefine作为第二个分支的最终输出。

13、在本发明一实施例中,所述使用无参考融合策略融合两种经过不同方式恢复的图像并输出最终的结果的具体实现方式如下:

14、无监督融合策略,采用无参考iqa中基于感知特征的niqe和piqe;首先,计算出jretinex和jrefine各自的niqe得分score1niqe、score2niqe和piqe得分score1piqe、score2piqe,通过式(3)、(4)分别获得jretinex的niqe权重wniqe和piqe权重wpiqe:

15、

16、

17、然后根据下式得到jretinex的整体权重:

18、

19、则jrefine的最终整体权重为wrefine=1-wretienx;

20、最后,将jretinex和jrefine与各自的整体权重相乘后做加法,最终结果被定义为:

21、jfused=jretinex×wretinex+jrefine×wrefine (6)

22、在本发明一实施例中,该方法提出的网络的损失函数包括对抗损失lg、重建损失lrec和身份损失lidt;其中,

23、对抗损失以生成对抗的方式更新沙尘恢复网络gj和鉴别器d,确保生成的jrefine能恢复的更加真实,也是整个网络有效的关键,其被定义为:

24、

25、其中表示期望;

26、使用l1损失构建idust和iretinex之间的重建损失lrec,其被定义为:

27、lrec=||idust-iretienx||1 (8)

28、身份损失lidt的作用是保留输入和输出颜色组成的一致性,还可以抑制gj生成不真实的伪像,同样使用l1损失定义它:

29、lidt=||jfree-gj(jfree)||1 (9)

30、综合所有的损失函数项,模型最终的损失函数是:

31、l=λlg+lrec+lidt (10)

32、其中,权重λ设置为0.2。

33、相较于现有技术,本发明具有以下有益效果:本发明方法提出了一个基于retinex的非配对图像去沙尘网络,将物理模型嵌入到深度学习网络中,融合物理过程恢复和神经网络非线性映射的优点更好地恢复沙尘图像。整个网络是弱监督的,因此可以使用真实未配对沙尘暴-干净图像训练我们的网络,避免了过度拟合于合成数据,提高网络的去沙尘能力和泛化能力。此外,提出了一个通用的无监督融合策略用于融合网络中的两张根据不同方式恢复出的图像。实验结果表明,该策略在不同领域的数据集都具有良好的性能。

- 还没有人留言评论。精彩留言会获得点赞!