基于卷积神经网络的双能CT图像域基材料分解方法

本发明属于双能ct图像分解,具体涉及一种基于卷积神经网络的双能ct图像域基材料分解方法。

背景技术:

1、双能ct成像技术广泛的应用于医学成像、公共安全和工业无损检测等领域,具有重要应用潜力和研究价值。与传统的单能ct成像技术相比,双能ct成像能够利用不同能谱下图像衰减信息获得被扫描物质的密度和结构分布等信息,具有更高的物质识别能力。

2、目前,基材料分解方法分为两大类:一类是将图像重建和基材料分解两个过程结合在一起的直接迭代基材料分解法,也叫“一步法”,此方法由于计算过程复杂,求解过程耗时较长,因此应用较少;另一类为“两步法”,即把图像重建和基材料分解分成了两步进行;“两步法”根据高低能投影数据集是否沿着相同的射线路径扫描可分为投影域和图像域基材料分解法。基于投影域的分解法理论上能有效消除射束硬化伪影的影响,但大多数双能ct无法满足高低能投影数据集沿着相同的射线路径进行扫描;基于图像域的分解法往往更加灵活,适用于大多数双能ct,在计算上也更为简便。

3、图像域若直接对ct图像进行线性矩阵反演,分解后的材料图像会受到噪声和伪影的严重影响。虽然各种正则化方法(例如全变分(tv)及其变种模型,非局部均值,字典学习等)可以较好的抑制噪声和伪影,但它们仍然面临着两个挑战:繁琐的参数调整和过度平滑导致的图像细节损失,限制了算法的实用性。

技术实现思路

1、本发明针对采用图像域基材料分解法对ct图像进行分解时,存在分解后的基材料由于细节损失造成图像质量较低的技术问题,目的在于提供一种基于卷积神经网络的双能ct图像域基材料分解方法。

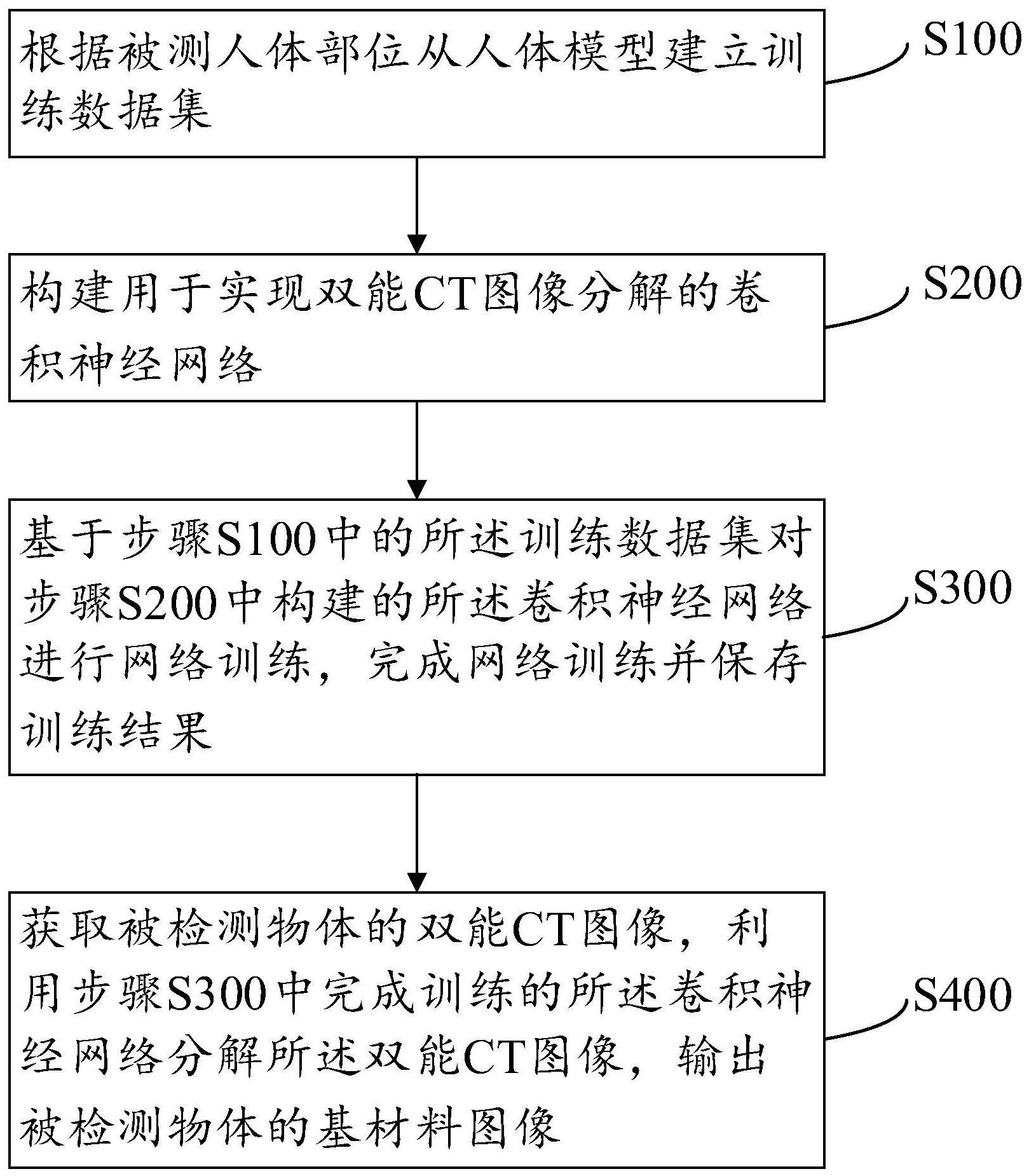

2、一种基于卷积神经网络的双能ct图像域基材料分解方法,包括:

3、步骤s100:根据被测人体部位从人体模型建立训练数据集;

4、步骤s200:构建用于实现双能ct图像分解的卷积神经网络;

5、步骤s300:基于步骤s100中的所述训练数据集对步骤s200中构建的所述卷积神经网络进行网络训练,完成网络训练并保存训练结果;

6、步骤s400:采集被检测物体的双能ct图像,利用步骤s300中完成训练的所述卷积神经网络分解所述双能ct图像,输出被检测物体的基材料图像。

7、作为优选方案,所述步骤s100包括:

8、步骤s110:根据扫描人体模型得到高能ct图像、低能ct图像,将所述高能ct图像和所述低能ct图像直接求逆分解得到骨和软组织的基材料图像;

9、步骤s120:将步骤s110得到的所述基材料图像、所述高能ct图像和所述低能ct图像进行预处理;

10、步骤s130:将步骤s120得到的mat格式数据用滑动窗口法分成图像块;

11、步骤s140:将步骤s130得到的数据制作成预设格式文件作为所述训练数据集。

12、作为优选方案,所述步骤s110中,将所述高能ct图像和所述低能ct图像直接求逆分解得到骨和软组织的基材料图像,包括:

13、所述基材料图像x=a-1y;

14、其中,为第l种材料的基图像,m为材料的种类数目,l的取值范围是1、2、…、m,r为实数,np是高能ct图像或低能ct图像的像素总数;

15、y为高能ct图像、低能ct图像组成的一个向量,yh和yl分别是预设的第一能量和预设的第二能量下的线性衰减系数图像,且所述第一能量高于所述第二能量,是yh的转置,是yl的转置,r为实数,np是高能ct图像或低能ct图像的像素总数;

16、a为线性衰减系数矩阵,a由a0和单位阵i的克罗内克积组成,ω1h为第l种材料在所述第一能量时的线性衰减系数,ω1l为第l种材料在所述第二能量时的线性衰减系数。

17、作为优选方案,所述步骤s120,包括:

18、分别将每张图像数据转换成mat格式数据。

19、作为优选方案,所述步骤s130,包括:

20、利用滑动窗口算法处理成65*65大小的图像块数据,其中,滑动窗口大小为5。

21、作为优选方案,所述步骤s140,包括:

22、利用制成tfrecord文件算法将步骤s130得到的数据打包存储在tfrecord文件中作为所述训练数据集。

23、作为优选方案,所述步骤s110中,在得到的所述得到高能ct图像和所述低能ct图像中,随机抽取若干所述高能ct图像和所述低能ct图像作为测试集,将其余所述高能ct图像和所述低能ct图像直接求逆分解得到骨和软组织的基材料图像;

24、所述步骤s300中对所述卷积神经网络完成网络训练后,还利用所述测试集对所述卷积神经网络进行测试;

25、所述步骤s400中利用的所述卷积神经网络是经训练和测试后的卷积神经网络。

26、作为优选方案,所述步骤s200中的所述卷积神经网络包括两个独立的卷积网络和一个全连接层;

27、两个所述卷积网络具有相同的层结构,分别对高能ct图像和低能ct图像进行基材料分解;

28、两个所述卷积网络得到的卷积结果通过所述全连接层组合。

29、作为优选方案,所述卷积网络具有四个卷积层,每一层所述卷积层后添加有bn(batch normalization,批归一化)层。

30、作为优选方案,所述卷积网络中,最后一层所述bn层后添加有cbam(convolutional block attention module)注意力机制。

31、作为优选方案,所述卷积网络中,激活函数为prelu。

32、作为优选方案,所述卷积神经网络的批的大小设置为1000,迭代次数设置为55,学习率设置为0.01。

33、本发明的积极进步效果在于:本发明采用基于卷积神经网络的双能ct图像域基材料分解方法,具有如下优点:

34、1、通过将卷积神经网络和双能ct图像域进行结合,实现一种端到端分解模型,一次性完成图像分解和噪声抑制,具有高分解精度和噪声鲁棒性。通过将卷积神经网络和双能ct图像域进行结合,使得分解的基材料图像质量得到很大程度的提升,可以避免由能谱数据噪声引起的基材料分解不准确的问题,提升基材料分解的精度和效率,帮助医生更好的阅片。

35、2、改进卷积神经网络的基本组件中包含有bn层,bn层的应用可以加快收敛速度,把每层的数据都在转换在均值为零,方差为1的状态下,这样每层数据的分布都是一样的训练会比较容易收敛,其次防止梯度爆炸和梯度消失,对参数调整效率也变高。

36、3、通过添加cbam注意力机制避免了卷积乘法带来的大量计算,使得其模块复杂度低,计算量小。注意力机制本质上是一种资源分配机制,它可以根据关注目标的重要性程度改变资源分配方式,使资源更多的向attention的对象倾斜。在卷积神经网络中,注意力机制所要分配的资源就是权重参数。在模型训练过程中对于attention的对象分配更多的权重参数,能够提高对于attention对象的特征提取能力,分解精度得到显著提高。

37、4、同时引入prelu激活函数,在保留有部分小于0的信息又达到了激活函数的目的,小于0的部分的斜率也是可学习的,比relu具有更好的激活效果。

- 还没有人留言评论。精彩留言会获得点赞!