一种对话理解分析方法、装置、及电子设备

本发明涉及自然语言理解,特别是涉及一种对话理解分析方法、装置、及电子设备。

背景技术:

1、任务型对话系统(task-oriented dialogue system,tod)通过人机交互协助用户完成预约、搜索等事务,是当今热门研究方向之一。其中,对话理解旨在识别用户意图和对话内容,是任务型对话系统中的关键模块。一般而言,该过程主要包括对话意图识别和语义槽填充两个任务。

2、目前对于对话意图识别和语义槽填充的实现方法主要包括四种:

3、第一种,单独建模实现对话意图识别和语义槽填充。第二种,意图识别和语义槽填充的联合模型。第三种,通过隐式融入知识来提升对话理解模型能力。第四种,通过显式融入知识来提升对话理解模型能力。

4、然而,目前的四种方法仍存在一定的弊端:

5、对于第一种方法,忽略了意图识别和语义槽填充任务间的强相关性,难以充分利用所有的有监督信息。对于第二种方法,缺乏相关的知识,在理解对话文本中的生僻或特有内容时常常出现困难。对于第三种方法,每次更新知识库,都需要重新训练对应的知识表征,拓展性差,训练成本高。对于第四种方法,这种方法未对知识进一步筛选,过多的知识会改变原始语义。同时,显式注入知识的方式会增加原始语句的长度,导致语义槽标签改变,混淆插入知识和原始语句,带来知识噪声,因此这种方法无法被直接应用到任务型对话理解问题上。

技术实现思路

1、有鉴于此,本发明旨在提出一种对话理解分析方法、装置、及电子设备,以解决目前的对话理解泛化性及准确性较差的问题。

2、为达到上述目的,本发明的技术方案是这样实现的:

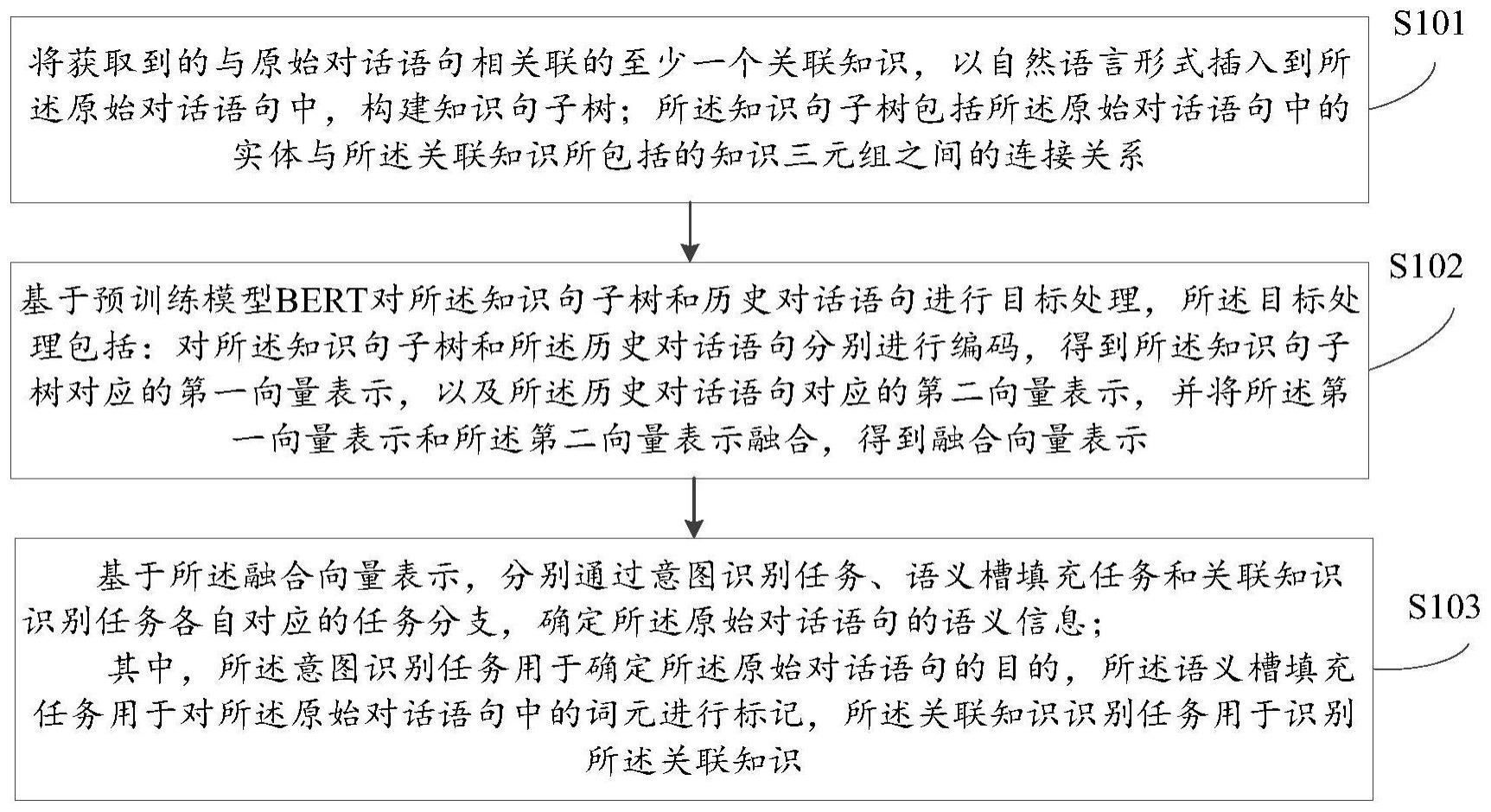

3、一种对话理解分析方法,包括:

4、将获取到的与原始对话语句相关联的至少一个关联知识,以自然语言形式插入到所述原始对话语句中,构建知识句子树;所述知识句子树包括所述原始对话语句中的实体与所述关联知识所包括的知识三元组之间的连接关系;

5、基于预训练模型bert对所述知识句子树和历史对话语句进行目标处理,所述目标处理包括:对所述知识句子树和所述历史对话语句分别进行编码,得到所述知识句子树对应的第一向量表示,以及所述历史对话语句对应的第二向量表示,并将所述第一向量表示和所述第二向量表示融合,得到融合向量表示;

6、基于所述融合向量表示,分别通过意图识别任务、语义槽填充任务和关联知识识别任务各自对应的任务分支,确定所述原始对话语句的语义信息;

7、其中,所述意图识别任务用于确定所述原始对话语句的目的,所述语义槽填充任务用于对所述原始对话语句中的词元进行标记,所述关联知识识别任务用于识别所述关联知识。

8、进一步地,所述将获取到的与原始对话语句相关联的至少一个关联知识,以自然语言形式插入到所述原始对话语句中,构建知识句子树,包括:

9、基于所述原始对话语句,确定预设知识库中多个预设知识三元组与所述原始对话语句之间的相关度;

10、将所述相关度超过预设值的至少一个知识三元组确定为所述关联知识;

11、将所述关联知识与所述原始对话语句中的关联词语连接,得到所述知识句子树;

12、其中,所述知识句子树至少包括一个分支,所述分支包括多个词元。

13、进一步地,所述确定预设知识库中多个知识三元组与所述原始对话语句之间的相关度,包括:

14、基于所述预训练模型bert,确定所述知识三元组所对应的第三向量表示与所述原始对话语句所对应的第四向量表示;

15、确定所述第三向量表示与所述第四向量表示之间的余弦距离;

16、将所述余弦距离的值作为所述相似度的值。

17、进一步地,在所述构建知识句子树之后,所述方法还包括:

18、按照文字顺序,分别对所述知识句子树中的每个词元添加位置索引;

19、基于所述位置索引,将所述知识句子树转换为序列形式语句;

20、所述基于预训练模型bert对所述知识句子树和历史对话语句进行目标处理,包括:

21、基于所述预训练模型bert对所述序列形式语句和所述历史对话语句进行目标处理。

22、进一步地,在所述基于预训练模型bert对所述知识句子树和历史对话语句进行目标处理之前,所述方法还包括:

23、按照文本顺序,分别在所述知识句子树的第一个词元之前、以及所述历史对话语句的第一个词元之前,添加令牌标签[cls];所述令牌标签用于分类;

24、将添加令牌标签的知识句子树、以及添加令牌标签的历史对话语句,输入所述预训练模型bert,以使所述预训练模型bert基于所述令牌标签生成所述第一向量表示,以及所述第二向量表示。

25、进一步地,所述预训练模型bert包括可视矩阵,所述可视矩阵用于确定所述原始对话语句和关联知识之间的权重关系;所述关联知识包括插入至所述原始对话语句中的至少一个知识三元组。

26、进一步地,所述关联知识识别任务是通过如下步骤进行识别的;

27、基于所述融合向量表示所携带的标签,确定所述关联知识;

28、其中,所述标签包括第一标签和第二标签,所述第一标签表征所述原始对话语句,所述第二标签表征所述关联知识。

29、进一步地,所述基于所述融合向量表示,分别通过意图识别任务、语义槽填充任务和关联知识识别任务各自对应的任务分支,确定所述原始对话语句的语义信息,包括:

30、基于意图识别任务分支,根据所述融合向量表示确定所述原始对话语句的目的,得到第一分支输出;

31、基于语义槽填充任务分支,根据所述融合向量表示对所述原始对话语句的词元进行标记,以识别所述原始对话语句中的目标内容,得到第二分支输出;所述目标内容包括所述原始对话语句中表征主要语义的内容;

32、基于关联知识识别任务分支,识别所述关联知识,得到第三分支输出;

33、结合所述第一分支输出、所述第二分支输出以及所述第三分支输出,确定所述原始对话语句的语义信息。

34、相对于现有技术,本发明所提供的对话理解分析方法具有如下优势:

35、本发明通过将获取到的与原始对话语句相关联的至少一个关联知识,以自然语言形式插入到所述原始对话语句中,构建知识句子树;所述知识句子树包括所述原始对话语句中的实体与所述关联知识所包括的知识三元组之间的连接关系;基于预训练模型bert对所述知识句子树和历史对话语句进行目标处理,所述目标处理包括:对所述知识句子树和所述历史对话语句分别进行编码,得到所述知识句子树对应的第一向量表示,以及所述历史对话语句对应的第二向量表示,并将所述第一向量表示和所述第二向量表示融合,得到融合向量表示;基于所述融合向量表示,分别通过意图识别任务、语义槽填充任务和关联知识识别任务各自对应的任务分支,确定所述原始对话语句的语义信息;其中,所述意图识别任务用于确定所述原始对话语句的目的,所述语义槽填充任务用于对所述原始对话语句中的词元进行标记,所述关联知识识别任务用于识别所述关联知识。

36、由于对当前对话语句添加关联知识得到知识增强的当前对话语句,即插即用,提升了知识增强的灵活性,并且不需要对模型进行重编码和训练,满足知识源动态发展的需要,提升了模型的泛用性和实用高效性。又通过多任务训练方法,对预设的对话理解模型进行训练,采用了多维度训练的方法,充分考虑了对话理解模型中意图识别和语义槽填充两个基本任务的相互依赖性,并获得了更好、更丰富的语义表征,使得模型对当前语义更加准确的理解,减少了知识噪声,提高了模型精度。

37、本发明的另一目的在于提供一种对话理解分析装置,以解决目前的对话理解泛化性及准确性较差的问题。

38、为达到上述目的,本发明的技术方案是这样实现的:

39、一种对话理解分析装置,包括:

40、插入模块,用于将获取到的与原始对话语句相关联的至少一个关联知识,以自然语言形式插入到所述原始对话语句中,构建知识句子树;所述知识句子树包括所述原始对话语句中的实体与所述关联知识所包括的知识三元组之间的连接关系;

41、目标处理模块,用于基于预训练模型bert对所述知识句子树和历史对话语句进行目标处理,所述目标处理包括:对所述知识句子树和所述历史对话语句分别进行编码,得到所述知识句子树对应的第一向量表示,以及所述历史对话语句对应的第二向量表示,并将所述第一向量表示和所述第二向量表示融合,得到融合向量表示;

42、确定模块,用于基于所述融合向量表示,分别通过意图识别任务、语义槽填充任务和关联知识识别任务各自对应的任务分支,确定所述原始对话语句的语义信息;

43、其中,所述意图识别任务用于确定所述原始对话语句的目的,所述语义槽填充任务用于对所述原始对话语句中的词元进行标记,所述关联知识识别任务用于识别所述关联知识。

44、所述的对话理解分析装置与上述的对话理解分析方法相对于现有技术具有相同的优势,在此不做赘述。

45、本发明的另一目的在于提供一种电子设备,以解决目前的对话理解泛化性及准确性较差的问题。

46、为达到上述目的,本发明的技术方案是这样实现的:

47、一种电子设备,包括:

48、处理器、存储器以及存储在所述存储器上并可在所述处理器上运行的计算机程序,所述处理器执行所述程序时实现上述任一项所述的对话理解分析方法。

49、所述的电子设备与上述的对话理解分析方法相对于现有技术具有相同的优势,在此不做赘述。

50、本发明的另一目的在于提供一种计算机可读介质,以解决目前的对话理解泛化性及准确性较差的问题。

51、为达到上述目的,本发明的技术方案是这样实现的:

52、一种计算机可读介质,包括:

53、当所述存储介质中的指令由电子设备的处理器执行时,使得电子设备能够执行上述任一项所述的对话理解分析方法。

54、所述的计算机可读介质与上述的对话理解分析方法相对于现有技术具有相同的优势,在此不做赘述。

- 还没有人留言评论。精彩留言会获得点赞!