一种基于改进YOLOv5的空中加油锥套检测方法与流程

本发明公开了一种基于改进yolov5的空中加油锥套检测方法,属于计算机视觉识别。

背景技术:

1、空中加油技术可在不改变原有航空器结构的基础上增加飞机的航程、留空时间、活动空间和有效载荷等,提升作战效能。自主空中加油要求在对接过程中传感器误差不低于厘米级,视觉导航具有快速实时、高精度的特点,成为了解决此问题的主要方法,而实现锥套精确的检测跟踪成为了完成这项技术的关键所在。

2、现有的锥套检测技术往往结合深度学习网络来进行方法研究。如西北工业大学的无人系统技术研究院将光流法与yolov3(you only look once,yolo)网络相结合,将临近帧提取的特征图对齐到当前帧进行特征聚合,以解决相机成像端由于运动模糊、失焦、遮挡等出现退化帧的问题(见陶承阳,袁杰,回天,《基于特征聚合的空中加油锥套检测算法》,《现代电子技术》,2022,45(13):152-158.)。此外,中国航空无线电电子研究所的汪刚志等采用改进的单激发多框探测器(single shot multibox detector,ssd)目标检测算法来设计多尺度信息的特征融合,提高了原有的测试速度和检测精度(见汪刚志,王新华,陈冠宇,《基于视觉的无人机空中加油目标识别技术研究》,《电子测量技术》,2020,43(13):89-94.)。由于仅仅采用了深度学习网络检测加油锥套,上述检测方法的实时性无法达到实际应用的需求,同时也不能较好的适应检测对象大小目标的尺度变化特征。

3、随着自主空中加油的需求变得越来越迫切,开发出一种能够在占用、消耗机载较少算力的同时有良好的实时性能,特别是满足快速识别和精确定位出加油锥套位置信息的算法显得尤为必要,本方案就是基于上述思路产生的。

技术实现思路

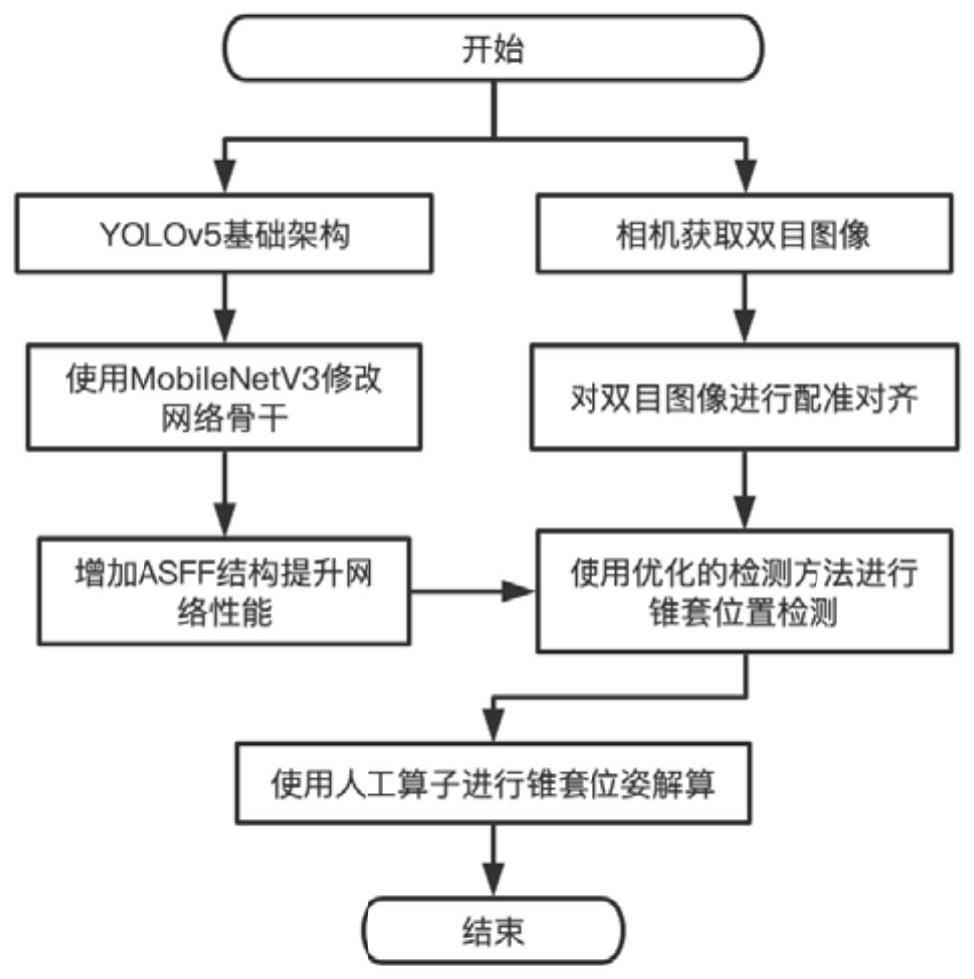

1、本发明所要解决的技术问题在于克服现有目标检测算法在空中加油过程中锥套从远端小目标到近端大目标的尺度变化适应不足的问题,以及当前算法误检率相对较高和机载算法实时性不足的问题。因此,提出一种基于改进yolov5的空中加油锥套检测方法,借鉴目标检测领域的先进成果yolov5目标检测框架,对双目图像利用图像配准方法先编码再解码,采用自适应金字塔特征融合(adaptively spatial feature fusion,asff)对yolov5轻量化目标检测算法进一步设计优化,利用人工算子对光学标记进行特征提取与匹配,进而推断出光学标记的三维坐标信息。

2、本发明为实现上述发明目的采用如下技术方案,一种基于改进yolov5的空中加油锥套检测方法,包括以下步骤:

3、a.使用双目相机采集加油场景下加油锥套图像;

4、b.使用基于特征的双目图像配准融合算法,对双目相机采集到的两组锥套图像进行配准,保证双视角图像中的锥套目标的像素每一行都对齐,得到两组图像的变换矩阵,逆运算即可成功匹配图像;

5、c.对yolov5检测模型的骨干网络和特征融合部分进行优化,将骨干网络替换为mobilenetv3结构;

6、d.对mobilenetv3引入一种针对深度卷积神经网络的高效通道注意力(efficientchannel attention,eca)模块,降低网络参数量;

7、e.在yolov5卷积网络中引入自适应特征金字塔融合模块;

8、f.使用优化后的检测模型对两组锥套图像进行检测,得到锥套目标的像素范围;

9、g.利用传统的人工算子对锥套目标进行解算,得到最终的锥套位姿。

10、所述步骤a具体为:相机获取加油场景下的相机双目图像camera_image_1,camera_image_2,保存到image[1,2]中,1和2表示图像序号,采用表达式image[1,2]=[camera_image_1,camera_image_2];

11、其中camera_image_1、camera_image_2表示双目相机获取到的两张原始rgb图像,所述rgb图像,是指是指由r(red)、g(green)、b(blue)三个基色分量组成的彩色图像。

12、所述步骤b采用基于特征的双目图像配准融合算法,是利用加速特征点提取和描述orb算法对双目相机采集到的两组锥套图像进行提取和匹配,在两组图像中进行特征点检测,然后生成特异性的描述子,使用对应的多组特征点进行计算得到两组图像的变换矩阵,逆运算即可成功匹配图像。

13、所述锥套图像进行提取过程如下:通过构建图像金字塔和灰度质心法提取锥套上的特征点处的缺点进行改进,得到具有尺度和旋转不变性的orb特征的图像信息,所述图像金字塔为将图像进行采样处理成不同大小并进行叠加,在不同大小的图像上对特征点进行提取,同时对相邻两层图形进行特征匹配;所述灰度质心法为将图像块的灰度值作为权重的中心。

14、对图像信息进行处理,同时计算每个特征点的角点响应,并将所有的计算结果进行排列,按顺序选取需求数目的特征点作为最终结果;

15、计算角点响应值的公式为:

16、r=detm-k(tracem)2 (1)

17、式中r为角点响应函数,k为经验常数通常取值0.04-0.06,m为特征值实对称矩阵,detm为矩阵m的行列式,tracem为矩阵轨迹。

18、所述锥套图像进行匹配过程如下:根据提取到的角点邻近区域的信息对该角点进行描述,形成二进制编码brief描述子,保留两组图像中锥套特征点匹配度较高的特征点作为匹配点,作为图像配准基本输入信息,建立单应性变换,即可完成两组图像的配准。

19、所述单应性变换是用无镜头畸变的相机从不同位置拍摄同一平面物体的图像之间存在单应性,可以用单应性变换表示:

20、

21、式中xl、yl表示左目图像的特征点的坐标,xr、yr表示右目图像的与左目相匹配的特征点的坐标,h3×3表示单应性矩阵,将单应性矩阵展开得:

22、

23、可转换为:

24、

25、一组匹配点可以获得2组方程,至少五组匹配点便可求解单应阵h3×3,从而获得左右目图像之间的转换关系,利用双目图像的配准即可实现仅检测一次即可同时获得双目图像中的锥套的坐标位置。

26、所述步骤d具体为:在高效通道注意力模块中,通道数为c,每个通道的注意力模块有k×c个参数,不同通道之间相互作用如下式:

27、

28、式中σ为sigmoid激活函数,表示yi的k个相邻通道的集合;

29、高效通道注意力模块使用大小为k的一维卷积核快速实现,即:

30、 ω=σ(c1dk(y)) (6)

31、式中c1dk表示大小为k的一维卷积核;

32、对一维卷积核k大小通过自适应选择方法,获取局部的跨通道交互信息,存在映射关系:

33、

34、此外,由于通道数c通常为2的整数次幂,用2(γ*k-b)代替exp(γ*k-b);给定通道数c,自适应确定核k大小为:

35、

36、式中|t|odd表示t最近的奇数,γ、b均为超参数。

37、所述步骤e所述自适应金字塔特征融合asff模块的功能为:使网络能够直接学习如何在其他级别对特征进行空间滤波,从而仅保留有用的信息以进行组合,从而提升网络对不同尺度目标的特征融合能力,可以解决一阶检测器中特征金字塔内部的不一致性;

38、所述asff模块融合的方法为:经过恒等缩放后,将三个特征图位置(i,j)处的向量进行加权融合得到新的空间位置(i,j)处的向量,系数权重由网络自适应学习学到,过程表示为:

39、

40、

41、式中各自的权重矩阵且代表从层级n的特征调整到层级l后(i,j)处的特征向量。

42、所述步骤f具体为:采用表达式object_location[1,2]=

43、f_network(i_match[1,2]),得到锥套目标的像素范围,通过将匹配后的双目图像match i_输入优化后的检测网络f_network,我们可以得到检测到的锥套目标的像素坐标object_location,其格式为

44、[x,y,w,h],其中x,y表示目标的中心点,w,h表示检测框的宽度和高度。

45、所述步骤g具体为:采用表达式object_pose=pose_calculate(i_match[1,2],object_location[1,2]),使用传统的人工算子对目标特征进行解算得到位姿,其中pose_calculate表示人工特征位姿解算方法,通过对匹配后的双目图像i_match的目标范围object_location内的人工特征进行提取解算,最后可以得到锥套目标的六自由度位姿[x,y,z,yaw,pitch,roll],其中x,y,z表示世界坐标下的锥套中心坐标,yaw,pitch,roll,表示三轴旋转角度。

46、本发明采用上述技术方案,具有以下有益效果:本发明使用基于特征的双目图像配准融合算法,对双目相机检测到的锥套图像进行配准,而后采用自适应金字塔特征融合对yolov5轻量化目标检测算法进一步设计优化,能够实现锥套图像识别算法的旋转不变性和尺寸不变性,使网络能够直接学习如何对特征进行空间滤波,并将不同级别的特征自适应地融合。最后使用优化后的目标检测方法对双视角图像解算,进而得到锥套相对于观测相机的位姿。该方法通过使用基于双目视觉的几何匹配保障了结果的稳定性,同时使用基于深度学习的自适应神经网络算法大大提升了对于目标的检测精度和速度,实现了对于加油锥套的快速检测和定位。

- 还没有人留言评论。精彩留言会获得点赞!