一种基于多图神经网络推理的文档级关系抽取方法与流程

本发明属于自然语言处理,特别是涉及一种基于多图神经网络推理的文档级关系抽取方法。

背景技术:

1、目前基于深度学习的文档级关系抽取方法主要有两大方向:(1)基于文档序列编码的方法;(2)基于文档图推理的方法,目前大多数方法都是基于文档图模型实现的,这主要是由于文档图充分地考虑了实体间的相互信息,用图结构把分散在不同句子中的实体联系起来,因而一定程度上避免了直接使用文档序列编码存在的长依赖问题。

2、虽然文档图在许多方法上都展现了优良的性能,但是仍存在以下不足:(1)现有方法在对文档图进行推理时通常只使用单一的图神经网络,然而文档图的节点关系是非常复杂的,特别是在构建文档图的过程中许多方法会使用多元路径关系,这导致使用单一结构的图神经网络难以充分地推理文档图信息,从而影响最终性能。(2)许多基于文档图的方法并没有考虑使用文档序列特征,导致得到的特征只能反映图信息,从而忽略文档原来的序列信息,使得性能难以提高。(3)训练过程中由于标注样本不足,大多数方法通常会使用自定义的负样本辅助训练,然而使用这些负样本也会带来一定程度的噪音问题。

3、如一种基于关联句选择和关系图推理的文档级关系抽取方法(公开号:cn113468325a,公开日:2021-10-01),抽取方法包括如下步骤:获取文档中包含头实体的第一句子集合和包含尾实体的第二句子集合,选择第一句子集合和第二句子集合中在文档内位置相近的若干个句子作为关联句;对关联句中的每个字符进行文本编码,将所有关联句中的实体编码融合,作为关系图模型的实体节点输入,获取实体相关的最短语义依存字符,作为关系图模型的依存节点输入。

4、该抽取方法能够通过关联句选择仅保留有助于实体关系判断的句子,然后使用基于图卷积神经网络的关系图推理提高了准确率,但该抽取方法现只使用单一的图神经网络,难以充分的推理文档图信息,从而影响最终性能,同时没有考虑使用文档序列特征,导致得到的特征只能反映图信息,从而忽略文档原来的序列信息,使得性能难以提高。

技术实现思路

1、针对背景技术中存在的技术缺陷,本发明提出一种基于多图神经网络推理的文档级关系抽取方法,解决了上述技术问题以及满足了实际需求,具体的技术方案如下所示:

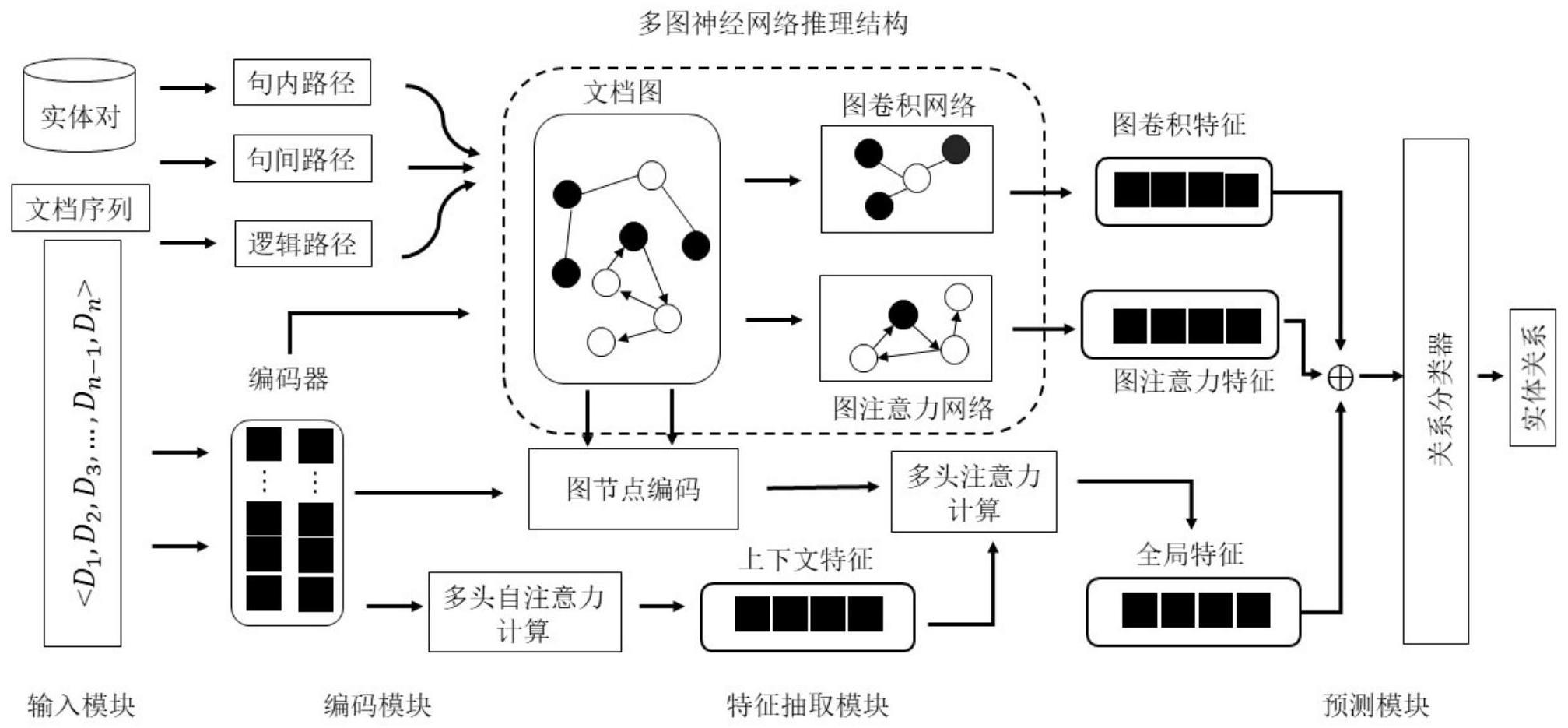

2、本发明涉及一种基于多图神经网络推理的文档级关系抽取方法,包括以下步骤,

3、步骤1:获得文档数据集与给定的对照实体对,所述文档数据集包括训练文档数据集与待测文档数据集,所述对照实体对包括第一对照实体对与第二对照实体对;

4、步骤2:构建基于多图神经网络推理的前文档级关系抽取模型,并将步骤1的训练文档数据集分为若干组训练文档序列与第一对照实体对输入前文档级关系抽取模型内进行训练,输出所述训练文档序列的第一文档实体对关系预测概率,并得到训练好的后文档级关系抽取模型;

5、步骤3:将待测文档数据集与给定的第二对照实体对,输入步骤2中训练好的所述后文档级关系抽取模型内,得到对应待测文档数据集的第二文档实体对关系预测概率。

6、作为本发明的进一步技术方案,上述步骤1中的训练文档数据集与待测文档数据集分别划分为不同的批次,每个所述批次设有一组文档序列,分别为训练文档序列与待测文档序列,所述训练文档序列设有第一文档实体对,所述待测文档序列设有第二文档实体对。

7、作为本发明的进一步技术方案,上述步骤2包括以下步骤,

8、步骤2.1:输入,输入步骤1中训练文档序列与第一对照实体对;

9、步骤2.2:特征抽取,将步骤2.1的训练文档序列计算推理得到图卷积特征、图注意力特征与全局注意力特征;

10、步骤2.3:根据步骤2.1中第一对照实体对的位置信息,在步骤2.2的图卷积特征、图注意力特征与全局注意力特征中找到对应的向量表示,进行拼接得到最终的关系特征,并在此基础上计算所述训练文档序列的第一文档实体对关系预测值;

11、步骤2.4:基于2.3的基础上引入平衡交叉熵损失函数改善噪音问题,并使用所述平衡交叉熵损失函数训练前文档级关系抽取模型。

12、作为本发明的进一步技术方案,上述步骤2.2包括,

13、步骤2.2.1:编码,所述前文档级关系抽取模型对输入的训练文档序列进行编码,将步骤2.1训练文档序列中的文档输入到编码器中,得到序列编码;

14、步骤2.2.2:构建文档图,对于步骤2.1训练文档序列中任意给定的一个文档,构建一个文档图,所述文档图包含节点集合和路径边合集,所述节点集合包括文档中句子节点的集合、实体节点的集合,所述路径边合集包括句内路径的集合、句间路径的集合以及逻辑路径的集合,并构建所述文档图对应的邻接矩阵;

15、步骤2.2.3:图神经网络推理,将步骤2.1的序列编码与步骤2.2.2的节点集合生成图节点编码,并使用logsumexp函数得到图节点编码矩阵,然后把所述图节点编码矩阵与邻接矩阵输入多图神经网络部件进行推理,所述多图神经网络部件包括图卷积神经网络gcn与图注意力网络gat,分别得到图卷积特征和图注意力特征;

16、步骤2.2.4:生成全局注意力特征,计算步骤2.2.1中序列编码得到多头自注意力特征,并将所述多头自注意力特征进行拼接得到上下文特征,并利用步骤2.2.3的图节点编码矩阵与所述上下文特征计算,得到带图节点编码信息的文档序列全局注意力特征。

17、作为本发明的进一步技术方案,所述句内路径、句间路径以及逻辑路径在两个实体之间出现不同类型的路径会将被保留下来,对于多条同一类型的路径只保留第一条通过的路径,所述句内路径与句间路径为实际路径,所述逻辑路径为虚拟路径。

18、作为本发明的进一步技术方案,所述图卷积神经网络gcn构造一个设有若干层的网络,对所述图节点编码矩阵和邻接矩阵进行分层计算,获得所述文档图的图卷积编码矩阵,所述图卷积编码矩阵为图卷积特征。

19、作为本发明的进一步技术方案,所述图注意力网络gat先计算所述节点集合中两个节点之间的注意力值,然后通过所述注意力值聚合节点,并更新所述节点的节点编码,将所述节点集合中每个节点的多头注意力编码都计算出来,拼接为一个多头注意力矩阵,所述多头注意力矩阵为图注意力特征。

20、作为本发明的进一步技术方案,所述注意力值的计算方向是单向的。

21、本发明具有的有益效果在于:

22、区别于此前大多数方法只使用单一的图神经网络结构,本发明构建了一个多图神经网络推理部件,该部件使得本发明的模型可从多角度来推理文档图特征,提升了关系预测的性能。

23、除了使用文档图特征之外,本发明也为文档序列构建了一个全局特征,该全局特征将文档图的节点信息融入至文档序列中,这让模型在保留图特征的同时又加入了序列特征辅助关系预测。

24、针对训练过程中使用负样本引入的噪音问题,本发明使用了一个正负样本平衡损失函数以降低负样本在训练过程中带来的噪音问题。

25、本发明在多个公开数据集上进行了实验,结果表明,本发明在这两个基准数据集上的关系抽取性能优于目前主流的模型。

- 还没有人留言评论。精彩留言会获得点赞!