一种深度学习大模型的多方共享系统与方法与流程

本发明属于深度学习模型,涉及到一种深度学习大模型的多方共享系统与方法。

背景技术:

1、神经网络是由大量的、简单的处理单元(称为神经元)广泛地互相连接而形成的复杂网络系统,它反映了人脑功能的许多基本特征,是一个高度复杂的非线性动力学习系统。神经网络具有大规模并行、分布式存储和处理、自组织、自适应和自学能力,特别适合处理需要同时考虑许多因素和条件的、不精确和模糊的信息处理问题。神经网络的一个重要性质是它可以自动地从数据中学习到合适的权重参数。神经网络的结构由输入、输出和隐藏层构成。每个层包含的单元可将输入数据转换为信息,作为下一层用于特定的预测任务。深度学习是加深了层的深度神经网络,加深了层的网络可以用更少的参数达到同等水平的表现力,通过加深层,可以减少学习数据,从而高效地进行学习。通过加深网络,就可以分层次地分解需要学习的问题。深度学习大模型是巨大参数量(1000亿以上)的深度学习模型,一般需要在大规模数据集上进行训练。深度学习大模型包括语言大模型、视觉大模型和多模态大模型。深度学习大模型在通用任务的处理上胜过了大多数微调小模型,并且出现了在小规模预训练模型中不存在的“涌现”能力,进一步强化了深度学习大模型的智能程度。

2、深度学习大模型是人类探索世界过程中所创造知识与能力的一种表现形式,深度学习大模型汇聚的知识与能力越多,其通用性、处理能力越强。深度学习大模型需要大量的数据和算力进行训练,其技术复杂度和资源投入导致只有少数组织机构具备训练深度学习大模型的能力。深度学习大模型的拥有者一般不会将最大模型、源代码、训练数据集直接开源。通常会提供 api 接口的方式向用户提供服务,api接口方式操作简单,使用者按照api接口要求提供信息并会收到反馈结果,深度学习大模型对于使用者而言为“黑箱操作”,使用者无法直接参与深度学习大模型的优化与提升导致对深度学习大模型的了解仅限于功能层面。在现实世界中,数据、算法、算力作为人工智能的三要素由于产权和责任等原因分散在不同的组织机构中。掌握算法、算力的高科技公司数据来源有限,掌握数据的企业、医疗机构、政府部门等从隐私保护、数据安全的角度出发不能出现数据外流。从而导致人工智能三要素处于不同程度的割裂状态。

3、中国发明专利公开说明书cn114065903a公开了深度学习模型的参数重用方法、装置、终端及存储介质。深度学习模型的参数重用方法通过根据预设的数据集进行初始的训练得到目标模型,再获取预先训练好的与该目标模型在网络结构上部分或全部相同的原模型,然后通过将原模型的网络结构与目标模型相同的层的参数逐个替换至目标模型上,再在验证集上对替换后的目标模型进行验证,验证通过则认为该参数可从原模型重用至目标模型,直至所有参数均验证完成。该技术方案通过逐个参数验证筛选的方式实现了参数的重用,但存在能力单向传递、仅限于结构相似模型的两两之间传递的模式,适用范围有限。

技术实现思路

1、为了解决上述技术问题,本发明提供一种深度学习大模型的多方共享系统,把深度学习大模型不同颗粒度的数字孪生体给不同的用户,在满足不同用户对深度学习大模型不同粒度需求的基础上,通过深度学习大模型与各个数字孪生体交互模型参数、算子实现深度学习大模型业务层面的分布式训练和应用。解决了目前深度学习大模型获取数据有限和拓展应用困难的问题。与此相应,本发明的另一个要解决的技术问题是提供一种深度学习大模型的多方共享方法。

2、第一方面,本发明解决上述技术问题的一种深度学习大模型的多方共享系统包括:

3、用户中心模块,以用户账户信息、用户基础档案信息及用户行为特征信息为基础的统一用户信息库,并提供用户认证、管理功能;

4、检索中心模块,提供基于文本、语音、视频的检索功能;

5、参数中心模块,提供对模型参数的管理功能;

6、数据显示模块,提供数据的图、表显示功能;

7、数字孪生模块,提供数字孪生体的生成、部署、运行、维护、注销的全生命周期管理功能;

8、模型管理模块,提供对模型的版本管理、设置功能

9、算子中心模块,提供对算子的生成、设置、注销、统计分析的管理功能;

10、模型能力评估模块,提供混淆矩阵、分类评估对模型的能力进行评估功能;

11、交互控制模块,对参数交互提供控制功能;

12、运行监控模块,对所述系统以及相关联的数字孪生体的运行状况提供监控,并对异常状况发出告警消息;

13、安全防护模块,提供防范网络攻击、数据篡改功能;

14、存储模块,对所述系统所需以及所述系统运行产生的数据进行存储;

15、所述系统以输入参数以及相连接的模型参数和算子为基础构建深度学习大模型数字孪生体,深度学习大模型本体与数字孪生体之间以参数方式交互,在数据安全与隐私保护的基础上实现分布在不同归属方手中的算力、算法、数据三个人工智能核心要素的有机结合。

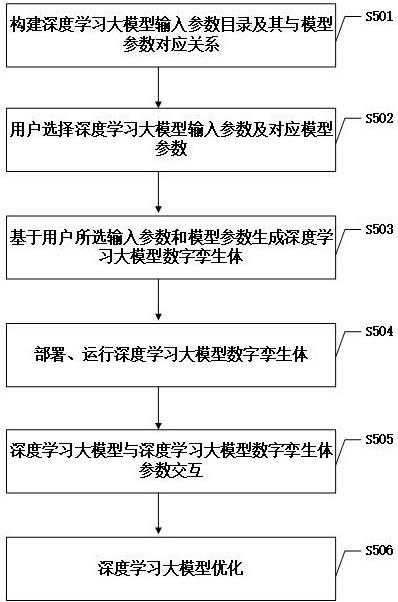

16、第二方面,本发明提供一种深度学习大模型的多方共享方法,该方法包括:

17、s1,构建深度学习大模型输入参数目录及其与模型参数对应关系;

18、s2,用户选择深度学习大模型输入参数及对应模型参数;

19、s3,基于用户所选输入参数和模型参数生成深度学习大模型数字孪生体;

20、s4,部署、运行深度学习大模型数字孪生体;

21、s5,深度学习大模型与深度学习大模型数字孪生体参数交互;

22、s6,深度学习大模型优化。

23、可选的,步骤s2,用户选择深度学习大模型输入参数时,所述系统默认其对应的模型参数与算子自动选择。

24、步骤s1可进一步具体为:

25、s101,建立深度学习大模型输入参数目录;

26、s102,建立模型参数的空间位置;

27、s103,建立模型算子的空间位置;

28、s104,建立模型参数与对应算子的连接关系;

29、s105,建立输出参数的空间位置;

30、s106,建立输出参数与隐藏层中的直接连接模型参数或对应算子的连接关系;

31、s107,建立深度学习大模型输入参数与模型参数的连接关系。

32、可选的,步骤s101,输入参数目录可以参照《中国图书馆分类法》或《国民经济行业分类》构建检索结构。

33、可选的,步骤s101,输入参数目录可以由用户基于深度学习大模型功能的不同粒度(任务、单词)自行组合。

34、可选的,步骤s102,建立模型参数的空间位置,空间位置可由矩阵行、列和神经网络层数组成。

35、步骤s2可进一步具体为:

36、s201,用户注册、登录;

37、s202,用户基于输入参数目录检索所需输入参数;

38、s203,用户选择输入参数;

39、s204,所述系统标记根据用户所选输入参数与隐藏层直接相连的模型参数或算子;

40、s205,所述系统标记隐藏层中与上一层被标记的参数直接相连的模型参数或算子,至隐藏层模型参数或算子标记完毕;

41、s206,所述系统选择与隐藏层已标记模型参数或算子直接连接的输出层参数。

42、可选的,步骤s203,用户选择输入参数时,所述系统根据功能完整性要求提出模型参数关联关系提示用户增加必要模型参数选项。

43、可选的,步骤s204、步骤s205中的标记方式为选择项的选中,标记的目的是为了区别相关或非相关的模型参数和算子,不限制标记的方式。

44、可选的,步骤s204,对于连续性的输入参数和模型参数,可以采用链式结构仅标记边缘的模型参数或算子。

45、步骤s3可进一步具体为:

46、s301,基于深度学习大模型运行环境构建数字孪生体容器;

47、s302,基于用户所选输入参数、模型参数及对应算子、输出参数生成深度学习大模型数字孪生体。

48、可选的,步骤s301,向用户提出部署环境要求。

49、可选的,步骤s302,用户设置是否允许所述系统的其他用户复制该深度学习大模型数字孪生体。

50、步骤s4可进一步具体为:

51、s401,用户在部署环境中登录所述系统;

52、s402,所述系统识别用户身份以及对应的深度学习大模型数字孪生体;

53、s403,用户选择在本地环境中部署;

54、s404,所述系统检查部署环境是否符合部署要求;

55、s405,不符合要求则提示用户调整部署环境至符合要求;

56、s406,所述系统在符合要求的环境中完成深度学习大模型数字孪生体部署。

57、s407,深度学习大模型数字孪生体启动、自检;

58、s408,深度学习大模型数字孪生体工作状态显示。

59、步骤s5可进一步具体为:

60、s501,所述系统通知深度学习大模型数字孪生体模型参数刷新信息;

61、s502,深度学习大模型数字孪生体使用方接受刷新参数;

62、s503,所述系统向深度学习大模型数字孪生体发送参数及对应空间信息;

63、s504,深度学习大模型数字孪生体根据收到的参数及对应空间信息替换对应的参数;

64、s505,深度学习大模型数字孪生体参数更新;

65、s506,深度学习大模型数字孪生体向所述系统发送参数刷新信息;

66、s507,所述系统接收深度学习大模型数字孪生体的参数。

67、可选的,步骤s506,深度学习大模型数字孪生体向所述系统发送参数刷新信息,信息可包括:训练数据描述信息、评估结果信息以及参数前后变化信息。

68、步骤s6可进一步具体为:

69、s601,所述系统评估来自深度学习大模型数字孪生体的参数;

70、s602,所述系统接受深度学习大模型数字孪生体的参数;

71、s603,深度学习大模型参数更新。

72、第三方面,本发明提供了一种计算机设备,包括存储器、处理器以及存储在所述存储器中并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现如第二方面中任一项所述的深度学习大模型的多方共享方法。

73、第四方面,本发明提供了一种可读存储介质,包括计算机可读指令,其特征在于,当计算机读取并执行所述计算机可读指令时,使得计算机实现第二方面中任一项所述的深度学习大模型的多方共享方法。

74、与现有技术相比,本发明的有益效果为:采用深度学习大模型的多方共享系统与方法,基于参数交互的形式,解决了目前三个人工智能要素:数据、算法、算力的割裂问题。实现了深度学习模型业务层面的分布式训练,不但避免了不同业务层面的重复训练投入,而且满足不同业务层面对深度学习大模型不同粒度的差异化需求。

- 还没有人留言评论。精彩留言会获得点赞!