目标语义层级挖掘的红外与可见光图像融合方法

本发明涉及图像信息处理,尤其涉及一种目标语义层级挖掘的红外与可见光图像融合方法。

背景技术:

1、红外传感器根据物体发出的热辐射信息来形成图像,因此可以良好的捕捉目标的结构与轮廓,不易受外部环境因素(如光照条件)的影响。但红外图像受其成像原理的限制,无法体现被捕捉场景中的纹理等细节信息且图像分辨率较低。而可见光传感器根据光的反射原理进行成像,可见光传感器在良好的照明条件下可以获得分辨率高、纹理等细节信息丰富的可见光图像,但可见光图像的质量易受外部环境的影响。红外与可见光图像的融合旨在生成同时具备两种模态优势的融合图像,在理想状态下,该融合图像可以包含各个模态中互补的有效信息,抛弃冗余信息,可以准确、全面地描述实际场景并且有效地缓解了数据体积增大的问题。因此,此技术也被广泛地应用于遥感、医学、安防等领域。

2、现有的图像融合算法可以分为两类:传统算法与基于深度学习的算法。在传统算法领域,li等人在《mdlatlrr:a novel decomposition method for infrared andvisible image fusion》提出了一种基于潜在低秩表示的多级图像分解方法,将源图像分解为细节部分和基础部分,然后对于不同的部分设计相应的融合算法来实现图像融合任务;晁等在《一种基于小波变换的图像融合算法》中提出了基于小波变换的图像融合方法,并针对小波分解的不同频率域研究设计了不同的系数选择方案。

3、在基于深度学习的领域,zhang等人《ifcnn:a general image fusion frameworkbased on convolutional neural network》设计了一种通用的全卷积模型,该模型对于每个输入图像利用一个卷积神经网络提取特征,然后根据输入图像的类型选择合适融合规则将输入图像的特征进行融合并生成融合结果。王等人在《基于多分支cnn的高光谱与全色影像融合处理》设计了两个独立的分支网络逐级计算光谱特征与空间特征,提升了融合后图像空间细节。ma等人在《swinfusion:cross-domain long-range learning for generalimage fusion via swin transformer》提出了一个卷积神经网络与swin transformer结合的图像融合框架,利用卷积神经网络提取图像的局部特征,利用swin transformer提取图像的全局特征,最终把局部与全局特征进行融合来生成融合结果。有关融合模型约束的研究往往会与方法框架等方面向结合,ma等人《fusiongan:agenerative adversarialnetwork for infrared and visible image fusion》在对抗生成损失中加入图像的内容损失,约束生成器输出的结果更加真实且减小图像内容(如纹理,边缘等)的丢失,提升了网络的融合效果。

4、然而,现有的图像大多数融合算法仅仅利用比较单一的图像信息,使融合算法中的融合特征缺乏多样性,因此无法进一步提升其融合性能。而本方法通过设计层级挖掘模块通过两个层次充分挖掘图像的语义信息并将其整合到图像融合特征中,从而增加图像融合特征的多样性,有效地提升图像融合性能。

技术实现思路

1、为了利用多方面的图像信息提升图像融合性能,本发明提出了一种目标语义层级挖掘的红外与可见光图像融合方法。层级挖掘模块通过两个层次全面地整合多个级别的语义信息来帮助图像融合模型提升其特征的多样性,从而使得图像融合模型可以利用多方面信息进行融合,提升图像融合模型的图像融合性能。因此本发明的关键是设计层级挖掘模块,来挖掘目标语义中不同层级的信息。

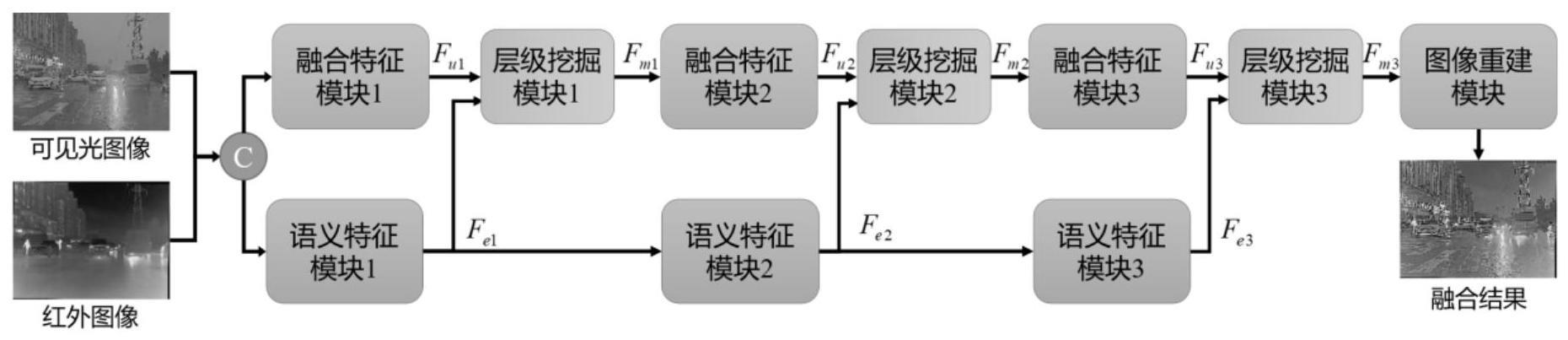

2、本发明的技术方案如下:一种目标语义层级挖掘的红外与可见光图像融合方法,基于图像融合网络实现;所述图像融合网络包括融合特征模块、语义特征模块、层级挖掘模块与图像重建模块;源图像对输入至图像融合网络后,融合特征模块提取源图像对的图像融合特征fuj,语义特征模块提取源图像对的图像语义特征fej;层级挖掘模块挖掘多个层级的目标语义特征并进行整合,多次重复特征提取与挖掘后,通过图像重建模块生成融合结果;

3、所述图像融合网络的损失函数为ssim损失;首先计算两幅输入图像x、y之间的ssim数值,如公式1所示,

4、

5、其中,μx、μy为输入图像x、y各自的均值,σx、σy为输入图像x、y各自的标准差,σxy为输入图像x、y之间的协方差;所述ssim损失计算如公式2所示;

6、

7、其中,if为融合结果,ii为输入的红外图像,iv输入的可见光图像;当if包含ii、iv中信息越多时,lf越趋近于0,该损失用于约束图像融合网络生成的结果包含输入源图像对的信息。

8、所述层级挖掘模块包括三个支路,分别为上方支路、中间支路和下方支路;所述上方支路用于直接传输图像融合特征;所述中间支路为权重支路,用于计算挖掘图像语义特征不同层级的权重;

9、第j个层级挖掘模块的中间支路计算过程如下,首先通过两个分支计算通道权重wcj与空间权重wsj,如公式3至5所示;

10、

11、wcj=p×1(fc×3(tuj)) (4)

12、wsj=c×2(tuj) (5)

13、其中,是由图像融合特征fuj经过一层平均池化p×1后与图像语义特征fej级联得到,由tuj经过一层全局平均池化p×1,再经过三层全连接层得到,其中前两层全连接层以relu为激活函数,最后一层全连接层以sigmoid为激活函数;由tuj经过两层卷积层c×2获得,其中第一层卷积层以relu为激活函数,第二层卷积层以sigmoid为激活函数;

14、所述下方支路用于图像语义特征的映射;图像语义特征首先经过两层以relu为激活函数的卷积层,通道权重wcj与空间权重wsj通过复制扩展数据维度为将通道权重wcj的对应位置元素分别与经过两层卷积映射的图像语义特征fej相乘得到通道挖掘特征fcj,如公式6所示;

15、fcj=c×2(fej)×wcj (6)

16、将空间权重wsj的对应位置元素分别与经过两层卷积映射的图像语义特征fej相乘,得到空间挖掘特征fsj,如公式7所示,

17、fsj=c×2(fej)×wsj (7)

18、通道挖掘特征fcj、空间挖掘特征fsj与上方支路的图像融合特征相加整合为多样化特征,再经过两层以relu为激活函数的卷积层输入至融合特征模块中,其过程如公式8所示;

19、fmj=c×2(fsj+fcj+fuj) (8)

20、其中,fmj为第j个层级挖掘模块的输出。

21、所述图像重建模块根据最终层级挖掘模块输出的多样化特征生成融合结果;图像重建模块包括六层卷积层,前五层卷积层以relu作为激活函数,最后一层卷积层以sigmoid作为激活函数。

22、所述融合特征模块包括六个卷积层并分为两支路,每个支路均由两个卷积层构成;源图像对通过两个卷积层计算特征,所得特征分别经过两个支路上的卷积层进行进一步的特征提取;两个支路的输出经级联以得到图像融合特征;所述图像融合网络中第j个融合特征模块的计算过程通过公式9与10所示;

23、txj=c×2(fmj-1) (9)

24、

25、其中,fuj表示图像融合特征;输入fmj-1为第j-1个层级挖掘模块的输出,j=1、2、3,当j=1时,fm0为输入的源图像对;c×2代表两个以relu为激活函数的卷积层,表示特征图通道维度级联;

26、所述语义特征模块通过4层以relu为激活函数的卷积层构成,采用语义分割任务对语义特征模块进行训练获得其权重,从而使语义特征模块提取到图像中的语义信息。

27、本发明的有益效果:相较于仅利用单一图像融合特征的融合方法,本发明通过不同层次的挖掘图像中目标语义并将其整合到图像融合网络中,有效地提升了图像融合网络中特征的多样性,从而可以获得更高质量的图像融合结果。

- 还没有人留言评论。精彩留言会获得点赞!