基于遗忘曲线模板更新的孪生网络目标跟踪方法

本发明属于基于视频的单目标跟踪,涉及基于遗忘曲线模板更新的孪生网络目标跟踪方法。

背景技术:

1、单目标跟踪是指,对于一组视频图像序列,由人工指定出在视频图像序列的第一帧时某个目标所在位置后,根据目标跟踪算法计算出该目标在后续帧中的位置的过程。单目标跟踪时计算机视觉领域的一个重要研究方向,它旨在使得计算机能够拥有人类对于目标的持续捕捉的能力。而以深度学习为基础的基于孪生神经网络的目标跟踪算法是当前的一个主流研究方向,其成果在科研领域与生活应用中都起到重要作用。

2、随着智能监控、自动驾驶和人机交互等领域的飞速发展,各个领域对计算机视觉技术的需求也越来越高。视频目标跟踪是计算机视觉领域的一个热点研究分支,其目的主要是对视频序列第一帧中人工标定的任意目标,通过跟踪算法预测后续每一视频帧中目标的位置。在目标跟踪过程中,面临着许多难题,主要可以分为外部因素和内部因素两大类,外部因素如:背景杂乱、光照变化、相似无干扰和遮挡等问题。内部因素如:非刚性形变、运动模糊、旋转和尺度变化等问题,如何在应对以上难题的同时实时鲁棒地跟踪目标是目标跟踪算法的目标。

3、随着深度学习算法的发展迅猛,深度学习与目标跟踪算法的结合也越来越受到人们的重视。其中,基于孪生神经网络结构的算法是一个主流的方向。通过使用第一帧给出的目标图像生成模板,对后续的图像进行互相关运算,得到的响应图中的最大值的位置映射到原图就是目标最可能所在的位置。通常情况下基于孪生神经网络的目标跟踪算法所使用的目标模板是保持不变的,这就导致跟踪器无法适应目标外观变化,另外现在的许多涉及模板更新的方法缺乏一个良好的模板更新机制,比如怎么设定一个阈值判断条件,使用不可靠模板更新很容易污染模板。

技术实现思路

1、本发明的目的是提供基于遗忘曲线模板更新的孪生网络目标跟踪方法,解决现有技术中存在的对于目标跟踪过程中物体外表形变鲁棒性较差的问题以及进行模板更新导致模板被污染的问题。

2、本发明所采用的技术方案是,基于遗忘曲线模板更新的孪生网络目标跟踪方法,具体按照以下步骤实施:

3、步骤1,构建整体网络,并对整体网络结构进行端到端的训练;

4、步骤2,使用步骤1训练好的整体网络对即将进行跟踪的视频图像序列进行初始化跟踪处理,得到本次跟踪任务的初始目标模板与目标的初始位置信息;

5、步骤3,得到步骤2的初始目标模板后,开始跟踪流程,视频图像序列的每一帧将计算出一个目标在图像中的位置,并在图像中对应处显示出来,得到跟踪结果响应图;

6、步骤4,得到步骤3的跟踪结果响应图后,使用双层模板更新阈值判断机制判断当前跟踪结果是否可靠,若可靠则更新模板,若不可靠则不更新模板;

7、步骤5,重复步骤3~步骤4,直至跟踪完毕所有视频图像序列,跟踪任务结束。

8、本发明的特征还在于,

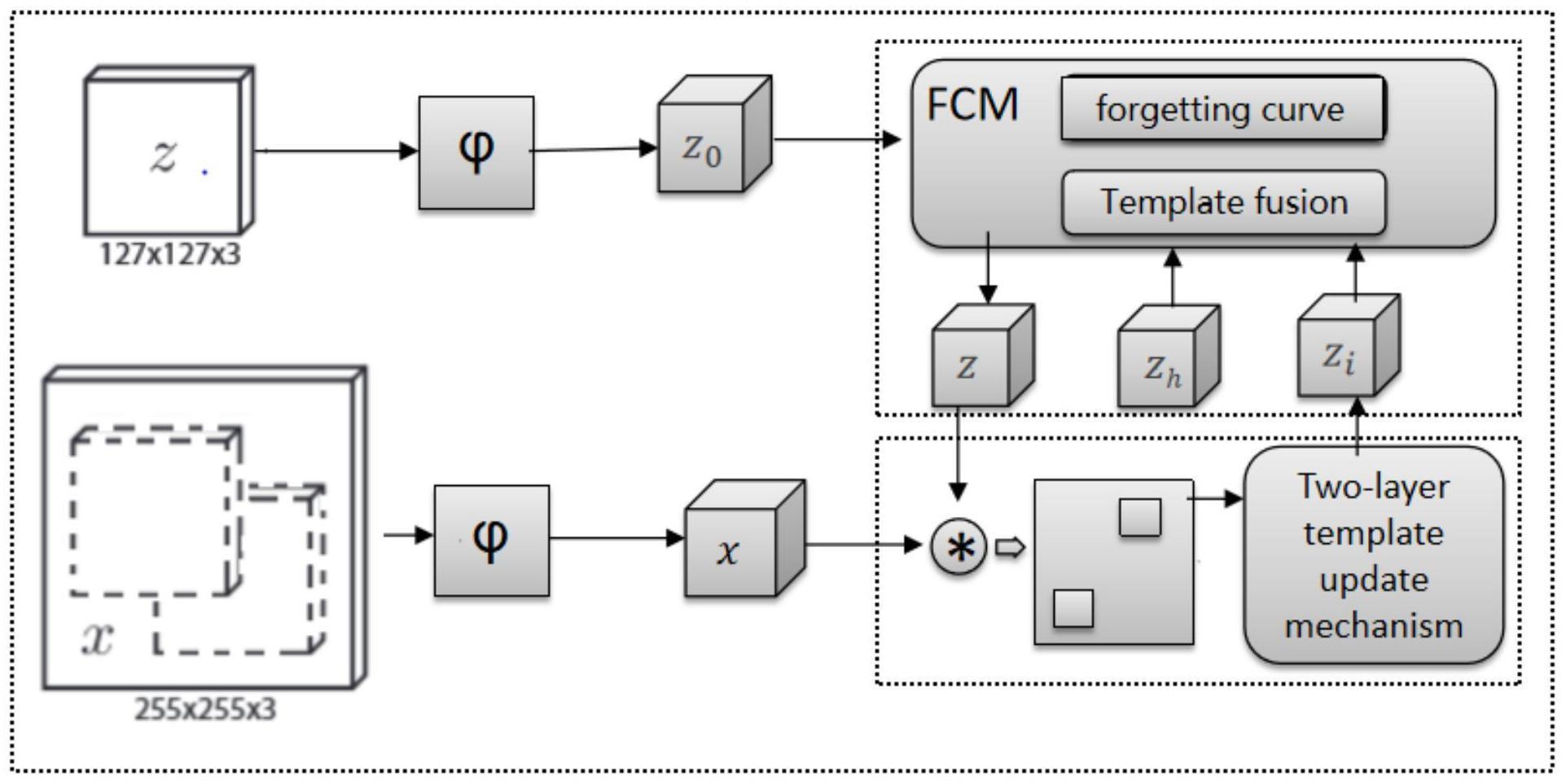

9、步骤1中,整体网络结构分为四部分:第一部分是用于深度特征提取的孪生神经网络,即特征提取网络,第二部分是包含基于遗忘曲线以及模板融合的模板更新模块,即fcm模块,第三部分是用于通过特征图准确定位目标的互相关网络,即目标位置预测模块;第四部分是用于判断当前结果是否可靠的双层模板更新阈值判断机制,即阈值判断模块。

10、步骤1中,对整体网络的结构进行端到端的训练具体为:使用元学习one-shotlearning,在每个数据集视频中随机选取四个视频帧组成图片对,前三张作为目标图,最后一张作为搜索图用来训练网络,每个视频选取10个图片对,每个图片对含有四张视频帧,第一张视频帧为该视频的第一帧,后面3张图在视屏中随机选取,第二张和第三张图片间距不超过15帧,第三张和第四张图片间距不超过10帧,前三张视频帧作为目标图用于合成跟踪模板,最后一张视频帧作为搜索图,在搜索图处理中,导入到模板更新模块的三张图片是一样,均是图片对的最后一张图,训练50次,batch_size设为8,一次导入的图片为32对,损失函数采用logistic损失函数。

11、生成训练用图片对,需要对选取的图片进行数据增强,数据增强具体按照以下步骤实施:

12、步骤1.1,首先在训练集中选择出的样本进行随机拉伸randomstretch操作,拉伸后的尺寸倍数设置为0.095~1.005之间,放大后需要填充的部分使用线性插值法填充;然后进行中心裁剪centercrop操作,即从训练图片对的中心处裁剪出尺寸为263*263的区域,接着进行随机裁剪randomcrop操作,从训练图片对中的随机位置裁剪出大小为255*255的区域,最后进行裁剪转换,原始的got-10k数据集中图片的box,即目标位置框,以(left、top、weight、height)形式给出,也就是目标框距离图片左边框与上边框的距离和目标框本身的宽与高,通过裁剪转换操作将目标框坐标形式转化为(y、x、h、w)即中心点的坐标与目标框的高和宽;

13、步骤1.2,进行loss的计算:

14、使用的损失函数公式为:

15、l(y,v)=log(1+exp(-yv))

16、式中,v是样本真实得分,y∈{+1,-1}是ground truth的标签,l为样本的损失;

17、步骤1.3,计算出损失后,使用梯度下降法进行参数优化,随机梯度下降方法sgd的计算公式如下:

18、argminθe(z,x,y)l(y,f(z,x;θ))

19、以此可得到最优参数θ;经过50遍的训练后网络的最终loss稳定在0.1以下,则训练过程结束。

20、步骤2的具体过程为:

21、步骤2.1,在视频图像序列的第一帧图像上指定出目标的位置,将目标从图像中截取后进行缩放,得到尺寸为127*127*3的目标图片,然后将目标图片传入整体网络中的特征提取网络,输出的深度特征即为初始模板,初始模板的尺寸为6*6*256,单位为像素,初始模板的计算公式如下:

22、

23、其中,z为输入的目标图片,函数代表特征提取网络,代表特征提取网络的输出,即目标模板;

24、步骤2.2,进行参数的初始化:

25、在视频图像序列第一帧中,由人工标定给出的目标位置信息被称为box,box有四条信息分别是目标的横坐标、纵坐标、宽度、高度,因此第一帧是不需要进行跟踪运算的,只需要按照给定的box将对应的目标初始中心坐标与初始宽高设定的成box内的数值,即完成了目标的初始化过程。

26、步骤3的具体过程为:

27、步骤3.1,提取深度特征:

28、以图像视频序列的上一帧跟踪结果中的目标坐标为中心,截取出搜索区域,并将搜索区域裁剪成patch传入特征提取网络提取出搜索区域的深度特征,得到搜索图x;

29、步骤3.2,基于遗忘曲线以及模板融合的模板更新:

30、步骤3.2.1,遗忘曲线:

31、将初始模板z-initial和当前模板z-c送入fcm模块,首先计算遗忘曲线的保留值,具体计算公式如下:

32、

33、其中λ示百分比的保留率,t表示时间,以帧为单位,c和k为常数;

34、步骤3.2.2,模板融合:

35、在经过特征提取之后,将得到初始模板z-initial、历史模板z-h和当前模板z-c传入fcm模块进行多模板融合操作;

36、在第一帧模板初始化阶段,将初始模板赋值给当前模板z-c、历史模板z-h和初始模板z-initial,并通过遗忘曲线机制赋予三个模板权重,再将三者堆叠在一起经过进行模板融合得到跟踪模板z,公式如下:

37、

38、式中,zi为初始模板,zh为历史模板,zc为当前模板;

39、步骤3.2.3,计算跟踪结果:

40、最后,通过跟踪模板z与搜索图x互相关得到响应图,具体计算公式如下:

41、

42、式中,表示特征嵌入函数,bii表示每个位置对应的值,*表示互相关操作。

43、步骤4中,双层模板更新阈值判断机制的具体过程为:

44、第一层:使用apce和最大响应值f-max作为判断依据,判断当前跟踪结果是否可靠,是否进行模板更新;apce的定义公式如下所示:

45、

46、式中,rmax、rmin分别表示得分图上的最大值和最小值,rw,h表示得分图第w行第h列的值;

47、若apce和f-max都低于预先设定的阈值,则放弃模板更新,进入下一次跟踪,若都高于阈值则将当前跟踪结果送入fcm模块进行参数匹配以及模板融合,从而进行模板更新;

48、第二层:如果第一层阈值判断结果可靠,进行模板更新的情况下,需要通过计算当前跟踪结果与初始模板的余弦相似度并与预先设定的阈值比较,判断跟踪结果是否为跟踪目标,是否要进行遗忘曲线值重置,计算公式如下所示:

49、

50、式中,值的范围为[-1,1],-1为完全不相似,1为完全相似,a表示的初始模板,bi表示第i帧的跟踪结果。

51、本发明的有益效果是,本发明基于遗忘曲线模板更新的孪生网络目标跟踪方法,首先提出了一种基于遗忘曲线的多模板融合模块(fcm模块),通过遗忘曲线赋予初始模板动态权重,将初始模板特征传播到每一个可靠模板上,抑制目标以外的背景噪声;在此基础上,还提出一种双层模板更新阈值判断机制,引入apce与皮尔逊相关系数相辅相成,能够在跟踪过程中找到可靠的时机更新跟踪模板,并且能够在更新模板时找到可靠的时机去重置遗忘曲线值,在帮助跟踪器不断适应目标外观变化的同时,还能极大地减少由于模板更新引入的背景噪声,防止跟踪漂移,同时这些模块都是可嵌入式的,方便快捷,既能提高跟踪器的性能,又不会影响跟踪器的实时性能。

- 还没有人留言评论。精彩留言会获得点赞!