基于自适应权重的联邦半监督学习系统、方法及其应用与流程

本发明涉及数字信息的传输,例如电报通信的,特别涉及一种基于自适应权重的联邦半监督学习系统、方法及其应用。

背景技术:

1、近年来,由于互联网的快速发展以及在社会上的大规模普及,涌现出海量的多媒体数据,例如互联网短视频、生活照片等。大多数的智能设备生产公司也受益于此大规模的数据,利用这些数据对智能检测模型、分类模型进行迭代。

2、然而,以手机为例,大多数的手机照片、视频属于用户个人隐私,这些数据是智能算法无法收集到的,那么如何在保护用户隐私的同时利用这些专属于某个用户的数据来迭代一个针对该用户的个性化智能算法,又或者,对于存在于多个国家的人工智能公司来说,如何在不共享数据的前提下综合其他公司的模型优势更新迭代模型就成为了亟待解决的问题。这些问题可以归结为一个始于数据隐私考虑的机器学习难题,而联邦学习技术则可以很好的解决这个问题。

3、联邦学习主要是在一个服务端(server)的组织监控下利用多个客户端来联合训练一个模型,与此同时,客户端无需传输任何自己的隐私数据,仅仅只需要模型参数的传输。例如,某手机公司作为服务端,所有该品牌用户持有的手机作为大量的客户端,服务端分发训练算法模型到用户,用户利用本地算力和本地数据更新该模型后又上传到服务端,这种分布式训练的方式可以非常好地保护用户的隐私安全,在模型训练过程中,用户和用户之间、用户和服务端之间都不存在敏感的隐私数据的传输。这种训练方案目前已经大量应用在用户产品更新、跨地区公司安全等技术领域。

4、然而,过去的大多数联邦学习技术主要都集中在对监督学习的研究上,即假设所有用户端的数据都是有标注的,然而在实际场景中,标注大量的本地数据会带来更多的人力资源消耗以及成本增加,因此,如何利用少量标注数据和大量的未标注数据来训练并达到更高的模型性能成为节省人力成本的关键。特别地,在联邦学习中,大多数的用户端数据冗杂,标注所有的图片或信息数据是不可能现实的,且在进行联邦学习时,所有客户端的本地数据是异构的,还是以前述举例,所有的用户手机分别独自作为客户端,因为个人的拍照偏好及生活场景的差异,导致每个用户的数据都是不同的,进而客户端之间的训练数据域差距很大,数据量也存在差异。

5、面对这些挑战,jeong等人在"federated semi-supervised learning withinter-client consistency & disjoint learning"中提出了一种实际的联邦半监督方法,即在每一个客户端中仅仅需要极少的标注数据就能提升模型性能,为了解决不同用户端之间数据异构的问题,其通过传输不同客户端之间的模型共识信息来决策数据伪标签的质量,以此来提高主模型在不同域上的性能;除此之外,为了缓解因为传输模型交互信息带来的通讯资源消耗,jeong还采用了一种稀疏化的模型参数传输方式,以此来降低模型在通讯中带来的带宽消耗。尽管如此,早期的工作往往在每一个客户端中采用一些传统的半监督学习方案例如fixmatch、fedmatch等,没有充分的考虑到这些方法在联邦学习应用中的问题。例如,这些半监督方法往往都是利用固定阈值来筛选未标注数据的高质量的伪标签,但是针对任何一个客户端,其训练的过程可能都是不一样的,其训练数据的分布也会和其他的客户端不一样,因此导致训练的状态也会有极大的差异,对所有的客户端都采用一个固定的阈值来筛选伪标签将使得模型在训练时缺失灵活性;另一方面,对于一个客户端,模型训练过程中一直保持固定的阈值对于数据的利用也是不充分的,主要原因在于训练初期模型的判断能力低而在训练末期模型的判断准确率高,如何精心设计伪标签的阈值成为提高半监督模型的关键。

技术实现思路

1、本发明解决了现有技术中存在的问题,提供了一种基于自适应权重的联邦半监督学习系统、方法及其应用。

2、本发明所采用的技术方案是,一种基于自适应权重的联邦半监督学习方法,所述方法对在联邦学习中的任一客户端中的标注数据及未标注数据进行训练,利用未标注数据的loss反向更新全联接模块,基于更新后的全联接模块生成新的权重,从而获得新的loss并重复反向更新全联接模块,重复训练步骤,进行半监督学习。本发明通过衡量未标注数据在优化过程中的权重来细粒度的调整主模型,在未标注数据更新全联接模块时主模型不更新。

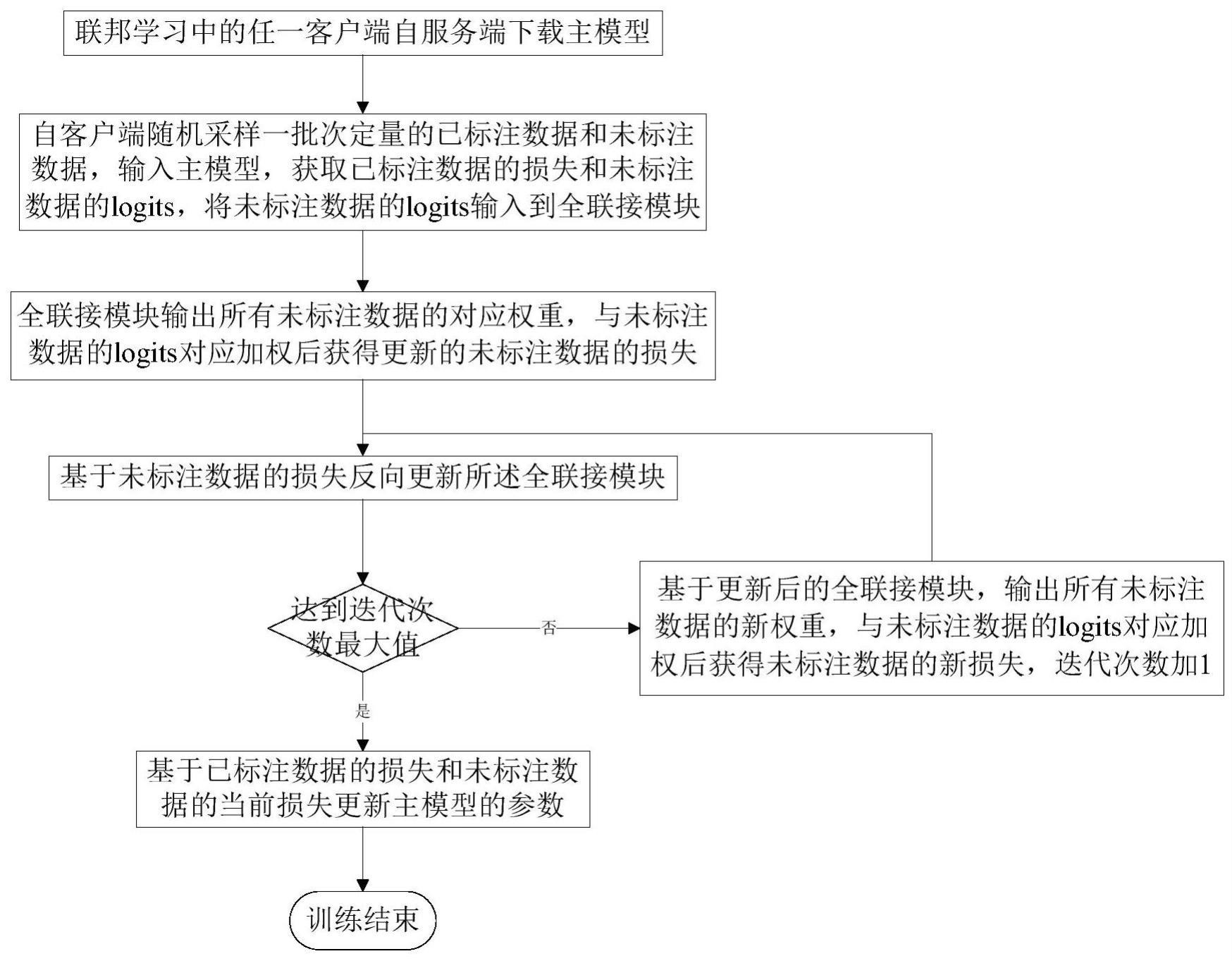

3、优选地,所述方法包括以下步骤:

4、步骤1:联邦学习中的任一客户端自服务端下载主模型;所述客户端中存储有本地数据,本地数据包括已标注数据及未标注数据;定义迭代次数最大值;

5、步骤2:自客户端随机采样一批次定量的已标注数据和未标注数据,输入主模型,获取已标注数据的损失和未标注数据的logits,将未标注数据的logits输入到全联接模块;其中,已标注数据和未标注数据的比例是固定的,比例可以依据需求进行调整;

6、步骤3:全联接模块输出所有未标注数据的对应权重,与未标注数据的logits对应加权后获得更新的未标注数据的损失;

7、步骤4:基于未标注数据的损失反向更新所述全联接模块;若已经达到迭代次数最大值,则进行步骤6,否则,进行下一步;

8、步骤5:基于更新后的全联接模块,输出所有未标注数据的新权重,与未标注数据的logits对应加权后获得未标注数据的新损失,迭代次数加1,重复步骤4;

9、步骤6:基于已标注数据的损失和未标注数据的当前损失更新主模型的参数,训练结束。

10、优选地,所述步骤1中,主模型为可替换的分类模型resnet,包括但不限于resnet9、resnet18、resnet34、resnet50或者其他可用的网络结构。

11、优选地,所述步骤2中,未标注数据多于已标注数据,在实际应用中,应为已标注数据的15倍以上。

12、优选地,所述步骤6中,训练时,已标注数据输入主模型进行训练,并采用交叉熵进行监督;未标注数据通过全联接模块学习每个数据的权重计算损失,根据损失更新全联接模块的参数,重复预设次数后,基于未标注数据损失和标注数据损失更新主模型。

13、优选地,客户端更新主模型且迭代预设轮次后,将最新的主模型上传至服务端。

14、优选地,所有客户端上传的模型基于融合策略进行模型融合。

15、优选地,融合策略为每隔预设时间根据客户端提交的参数文件进行融合,或选择若干客户端上传的参数文件进行融合;前者间隔的时间为5h、12h、24h等,根据客户端提交的参数文件进行融合,后者根据客户端上传的参数文件选择前n个参数文件进行融合,n小于客户端的总数。在实际应用中,参数融合的策略为根据客户端的数据量计算各个客户端的参数文件权重占比,进而更新到服务器端。

16、一种采用所述的基于自适应权重的联邦半监督学习方法的系统,所述系统包括:

17、一服务端,用于进行全局管理并配置有迭代更新的主模型;

18、若干客户端,用于获取本地数据、通过主模型完成本地数据的处理、更新主模型并上传至服务端;

19、任一所述客户端从服务端下载主模型并利用本地数据对主模型进行训练、更新,上传更新后的主模型至服务端。

20、一种所述的基于自适应权重的联邦半监督学习方法的应用,应用于异构客户端及其异构数据间的半监督学习。

21、本发明涉及一种基于自适应权重的联邦半监督学习系统、方法及其应用,对在联邦学习中的任一客户端中的标注数据及未标注数据进行训练,利用未标注数据的loss反向更新全联接模块,基于更新后的全联接模块生成新的权重,从而获得新的loss并重复反向更新全联接模块,重复训练步骤,进行半监督学习;系统以服务端全局管理并配置有迭代更新的主模型,以客户端获取本地数据、从服务端下载主模型并利用本地数据对主模型进行训练、更新,上传更新后的主模型至服务端;应用于异构客户端及其异构数据间的半监督学习。

22、本发明的有益效果在于:

23、(1)针对过去联邦半监督学习在本地算法上过于依赖固定阈值而导致在所有具有不同域的数据的客户端上缺乏灵活性等问题,提出了一种自适应的权重更新机制,以权重衡量每一个无标注数据在本次迭代更新下对于参数更新的贡献大小,有效提高在半监督训练过程中,模型在多个客户端数据域不同的情形下的灵活性;

24、(2)针对在训练过程中未标注数据的质量判断需要动态决策,以此增加模型训练过程中未标注数据利用的充分性;定义双重优化的算法机制,根据模块在标注数据上的性能反馈,自适应调节每一个未标注数据的权重参数,根据标注数据的准确度定义权重调节,使得模型根据其自主的训练进程来自适应地更新在每一个未标注数据的权重,模型灵活性更高,鲁棒性更强;

25、(3)适用于多个数据分布场景中,取得相比于过去方法更好的模型精度;

26、(4)不需要进行客户端之间的信息交互,更好地避免隐私问题;

27、(5)设计训练的整体结构,使得无标签数据在训练时能够根据不同数据的重要性对模型优化产生影响。

- 还没有人留言评论。精彩留言会获得点赞!