一种跨视频源的目标交接定位方法及系统与流程

本发明涉及视频目标定位,尤其涉及一种跨视频源的目标交接定位方法及系统。

背景技术:

1、近年来,随着深度学习以及各种优秀的神经网络模型出现,智能监控视频的发展也越来越好,但是在多个视频源如摄像头在协同进行目标的定位时,依旧存在一些问题,例如在跨视频源的目标跟踪定位过程中,目标交接都局限在简单的实现目标信息从a摄像头传递到b摄像头中,然后在b摄像头中继续进行跟踪,但由于不同摄像头或者摄像头安装时不同姿态都可能导致跟踪目标定位的结果有误差,此时直接对目标进行交接处理,则导致目标位置点出现跳跃以及轨迹突变的情况。可见,现有技术存在缺陷,亟待解决。

技术实现思路

1、本发明所要解决的技术问题在于,提供一种跨视频源的目标交接定位方法及系统,能够实现借助重合视域的特点和参数来更加精准地定位对象,以达到更加好的跨视频源的目标交接定位效果。

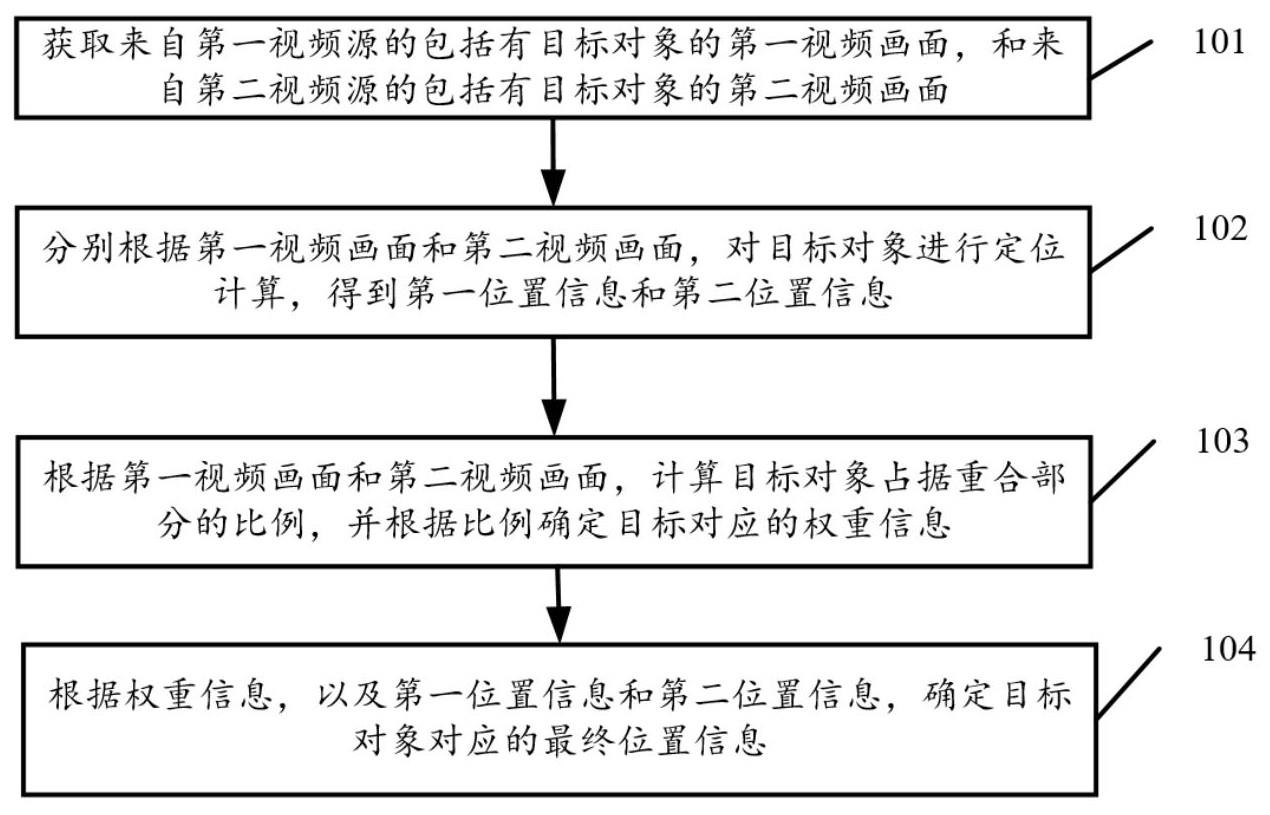

2、为了解决上述技术问题,本发明第一方面公开了一种跨视频源的目标交接定位方法,所述方法包括:

3、获取来自第一视频源的包括有目标对象的第一视频画面,和来自第二视频源的包括有所述目标对象的第二视频画面;所述第一视频画面与所述第二视频画面有重合部分;

4、分别根据所述第一视频画面和所述第二视频画面,对所述目标对象进行定位计算,得到第一位置信息和第二位置信息;

5、根据所述第一视频画面和所述第二视频画面,计算所述目标对象占据所述重合部分的比例,并根据所述比例确定所述目标对应的权重信息;

6、根据所述权重信息,以及所述第一位置信息和所述第二位置信息,确定所述目标对象对应的最终位置信息。

7、作为一种可选的实施方式,在本发明第一方面中,所述分别根据所述第一视频画面和所述第二视频画面,对所述目标对象进行定位计算,得到第一位置信息和第二位置信息,包括:

8、基于同名点信息坐标系转换算法,对所述第一视频源和所述第二视频源进行坐标系的统一,得到所述第一视频源和所述第二视频源分别对应的坐标转换关系式;

9、根据所述第一视频源对应的坐标转换关系式,以及所述第一视频画面,对所述目标对象进行定位计算,得到第一位置信息;

10、根据所述第二视频源对应的坐标转换关系式,以及所述第二视频画面,对所述目标对象进行定位计算,得到第二位置信息。

11、作为一种可选的实施方式,在本发明第一方面中,所述根据所述第一视频画面和所述第二视频画面,计算所述目标对象占据所述重合部分的比例,并根据所述比例确定所述目标对应的权重信息,包括:

12、根据所述第一视频画面和所述第二视频画面,计算所述目标对象相对于所述重合部分的一个边界的目标距离;所述边界对应于所述第一视频源的视域边界或所述第二视频源的视域边界;

13、根据所述目标距离和所述重合部分的总长度的比例,计算所述目标对象对应的权重信息。

14、作为一种可选的实施方式,在本发明第一方面中,所述目标对象在移动中逐渐远离所述第一视频源并靠近所述第二视频源;所述根据所述第一视频画面和所述第二视频画面,计算所述目标对象相对于所述重合部分的一个边界的目标距离,包括:

15、根据所述第一视频画面和所述第二视频画面,确定所述目标对象的对象位置,以及所述重合部分中与所述第二视频源的视域边界对应的目标边界;

16、计算所述对象位置与所述目标边界相对于视频源的摄像朝向的投影距离,得到目标距离;

17、计算所述重合部分相对于视频源的摄像朝向的投影长度,得到所述重合部分的总长度。

18、作为一种可选的实施方式,在本发明第一方面中,所述根据所述目标距离和所述重合部分的总长度的比例,计算所述目标对象对应的权重信息,包括:

19、计算所述目标距离和所述重合部分的总长度的距离比例值;

20、将所述距离比例值确定为所述第一视频源对应的第一权重;

21、计算1与所述距离比例值的差值,确定为所述第二视频源对应的第二权重。

22、作为一种可选的实施方式,在本发明第一方面中,所述计算1与所述距离比例值的差值,确定为所述第二视频源对应的第二权重之后,所述方法还包括:

23、将所述第一视频画面输入至预先训练好的速度预测神经网络模型和定位精准预测神经网络模型,以得到输出的所述第一视频画面对应的第一速度预测值和第一定位精准度预测值;所述速度预测神经网络模型通过包括有多个训练视频画面和对应的速度标注的训练数据集训练得到;所述定位精准预测神经网络模型通过包括有多个训练视频画面和对应的定位精准度标注的训练数据集训练得到;

24、计算出与所述第一速度预测值成反比的第一速度权重,以及计算出与所述第一定位精准度预测值成正比的第一定位权重,以及计算出第一模型相关权重;所述第一模型相关权重与第一预测表征值成正比;所述第一预测表征值为所述第一速度预测值和所述第二定位精准度预测值的比值与预设的比值阈值之间的差值,用于表征模型预测的准确程度;

25、计算所述第一速度权重、所述第一定位权重和所述第一模型相关权重与所述第一权重的乘积,以得到新的第一权重;

26、将所述第二视频画面输入至所述速度预测神经网络模型和所述定位精准预测神经网络模型,以得到输出的所述第二视频画面对应的第二速度预测值和第二定位精准度预测值;

27、计算出与所述第二速度预测值成反比的第二速度权重,以及计算出与所述第二定位精准度预测值成正比的第二定位权重,以及计算出第二模型相关权重;所述第二模型相关权重与第二预测表征值成正比;所述第二预测表征值为所述第二速度预测值和所述第二定位精准度预测值的比值与所述比值阈值之间的差值,用于表征模型预测的准确程度;

28、计算所述第二速度权重、所述第二定位权重和所述第二模型相关权重与所述第二权重的乘积,以得到新的第二权重。

29、作为一种可选的实施方式,在本发明第一方面中,所述根据所述权重信息,以及所述第一位置信息和所述第二位置信息,确定所述目标对象对应的最终位置信息,包括:

30、计算所述第一位置信息和所述第一权重的第一乘积;

31、计算所述第二位置信息和所述第二权重的第二乘积;

32、计算所述第一乘积和所述第二乘积的和,得到所述目标对象对应的最终位置信息。

33、本发明第二方面公开了一种跨视频源的目标交接定位系统,所述系统包括:

34、获取模块,用于获取来自第一视频源的包括有目标对象的第一视频画面,和来自第二视频源的包括有所述目标对象的第二视频画面;所述第一视频画面与所述第二视频画面有重合部分;

35、定位模块,用于分别根据所述第一视频画面和所述第二视频画面,对所述目标对象进行定位计算,得到第一位置信息和第二位置信息;

36、计算模块,用于根据所述第一视频画面和所述第二视频画面,计算所述目标对象占据所述重合部分的比例,并根据所述比例确定所述目标对应的权重信息;

37、确定模块,用于根据所述权重信息,以及所述第一位置信息和所述第二位置信息,确定所述目标对象对应的最终位置信息。

38、作为一种可选的实施方式,在本发明第二方面中,所述定位模块分别根据所述第一视频画面和所述第二视频画面,对所述目标对象进行定位计算,得到第一位置信息和第二位置信息的具体方式,包括:

39、基于同名点信息坐标系转换算法,对所述第一视频源和所述第二视频源进行坐标系的统一,得到所述第一视频源和所述第二视频源分别对应的坐标转换关系式;

40、根据所述第一视频源对应的坐标转换关系式,以及所述第一视频画面,对所述目标对象进行定位计算,得到第一位置信息;

41、根据所述第二视频源对应的坐标转换关系式,以及所述第二视频画面,对所述目标对象进行定位计算,得到第二位置信息。

42、作为一种可选的实施方式,在本发明第二方面中,所述计算模块根据所述第一视频画面和所述第二视频画面,计算所述目标对象占据所述重合部分的比例,并根据所述比例确定所述目标对应的权重信息的具体方式,包括:

43、根据所述第一视频画面和所述第二视频画面,计算所述目标对象相对于所述重合部分的一个边界的目标距离;所述边界对应于所述第一视频源的视域边界或所述第二视频源的视域边界;

44、根据所述目标距离和所述重合部分的总长度的比例,计算所述目标对象对应的权重信息。

45、作为一种可选的实施方式,在本发明第二方面中,所述目标对象在移动中逐渐远离所述第一视频源并靠近所述第二视频源;所述计算模块根据所述第一视频画面和所述第二视频画面,计算所述目标对象相对于所述重合部分的一个边界的目标距离的具体方式,包括:

46、根据所述第一视频画面和所述第二视频画面,确定所述目标对象的对象位置,以及所述重合部分中与所述第二视频源的视域边界对应的目标边界;

47、计算所述对象位置与所述目标边界相对于视频源的摄像朝向的投影距离,得到目标距离;

48、计算所述重合部分相对于视频源的摄像朝向的投影长度,得到所述重合部分的总长度。

49、作为一种可选的实施方式,在本发明第二方面中,所述计算模块根据所述目标距离和所述重合部分的总长度的比例,计算所述目标对象对应的权重信息的具体方式,包括:

50、计算所述目标距离和所述重合部分的总长度的距离比例值;

51、将所述距离比例值确定为所述第一视频源对应的第一权重;

52、计算1与所述距离比例值的差值,确定为所述第二视频源对应的第二权重。

53、作为一种可选的实施方式,在本发明第二方面中,所述计算模块计算1与所述距离比例值的差值,确定为所述第二视频源对应的第二权重之后,还执行以下步骤:

54、将所述第一视频画面输入至预先训练好的速度预测神经网络模型和定位精准预测神经网络模型,以得到输出的所述第一视频画面对应的第一速度预测值和第一定位精准度预测值;所述速度预测神经网络模型通过包括有多个训练视频画面和对应的速度标注的训练数据集训练得到;所述定位精准预测神经网络模型通过包括有多个训练视频画面和对应的定位精准度标注的训练数据集训练得到;

55、计算出与所述第一速度预测值成反比的第一速度权重,以及计算出与所述第一定位精准度预测值成正比的第一定位权重,以及计算出第一模型相关权重;所述第一模型相关权重与第一预测表征值成正比;所述第一预测表征值为所述第一速度预测值和所述第二定位精准度预测值的比值与预设的比值阈值之间的差值,用于表征模型预测的准确程度;

56、计算所述第一速度权重、所述第一定位权重和所述第一模型相关权重与所述第一权重的乘积,以得到新的第一权重;

57、将所述第二视频画面输入至所述速度预测神经网络模型和所述定位精准预测神经网络模型,以得到输出的所述第二视频画面对应的第二速度预测值和第二定位精准度预测值;

58、计算出与所述第二速度预测值成反比的第二速度权重,以及计算出与所述第二定位精准度预测值成正比的第二定位权重,以及计算出第二模型相关权重;所述第二模型相关权重与第二预测表征值成正比;所述第二预测表征值为所述第二速度预测值和所述第二定位精准度预测值的比值与所述比值阈值之间的差值,用于表征模型预测的准确程度;

59、计算所述第二速度权重、所述第二定位权重和所述第二模型相关权重与所述第二权重的乘积,以得到新的第二权重。

60、作为一种可选的实施方式,在本发明第二方面中,所述确定模块根据所述权重信息,以及所述第一位置信息和所述第二位置信息,确定所述目标对象对应的最终位置信息的具体方式,包括:

61、计算所述第一位置信息和所述第一权重的第一乘积;

62、计算所述第二位置信息和所述第二权重的第二乘积;

63、计算所述第一乘积和所述第二乘积的和,得到所述目标对象对应的最终位置信息。

64、本发明第三方面公开了另一种跨视频源的目标交接定位系统,所述系统包括:

65、存储有可执行程序代码的存储器;

66、与所述存储器耦合的处理器;

67、所述处理器调用所述存储器中存储的所述可执行程序代码,执行本发明第一方面公开的跨视频源的目标交接定位方法中的部分或全部步骤。

68、本发明第四方面公开了一种计算机存储介质,所述计算机存储介质存储有计算机指令,所述计算机指令被调用时,用于执行本发明第一方面公开的跨视频源的目标交接定位方法中的部分或全部步骤。

69、与现有技术相比,本发明具有以下有益效果:

70、本发明能够利用目标对象在重合视域中的占比来计算权重,以调整目标对象的位置计算,从而能够实现借助重合视域的特点和参数来更加精准地定位对象,以达到更加好的跨视频源的目标交接定位效果。

- 还没有人留言评论。精彩留言会获得点赞!