基于人工智能的无人机云台相机目标识别跟踪方法及系统与流程

本发明涉及目标识别跟踪技术,尤其涉及基于人工智能的无人机云台相机目标识别跟踪方法及系统。

背景技术:

1、随着无人机技术的迅速发展,无人机已广泛应用于农业、测绘、电影制作、安全监控等多个领域。其中,无人机云台相机的目标识别与跟踪技术是近年来研究的热点,它能够实现对地面或空中目标的自动识别和持续跟踪。

2、申请号为:202111156436.6的发明公开了一种针对远距离高速运动目标的智能跟踪拍摄系统,包括光学系统、稳定平台系统和显控系统,以全景摄像机作为视觉传感器,将自适应目标检测跟踪方法与车载两轴三维稳定平台相融合,在目标跟踪方法中,结合全局相机引导特写相机跟踪拍摄与特写相机闭环检测双机制,提升整体系统的跟踪精度,保证目标处于视频画面中央。该现有技术存在的缺陷包括:虽然系统提供了手动与自动检测转换的功能,但在实际操作中,频繁切换可能会导致操作复杂性增加,增加误操作的风险;尽管有稳定平台系统,但在复杂的环境或恶劣的天气条件下,保持稳定的跟踪可能仍然是一个挑战;自适应算法可能在某些特定情况下失效,例如在目标与背景颜色相似或目标速度变化很大的情况下。

3、因此,急需一种基于人工智能的无人机云台相机目标识别跟踪方法及系统。

技术实现思路

1、本发明提供了一种基于人工智能的无人机云台相机目标识别跟踪方法及系统,以解决现有技术中存在的虽然系统提供了手动与自动检测转换的功能,但在实际操作中,频繁切换可能会导致操作复杂性增加,增加误操作的风险;尽管有稳定平台系统,但在复杂的环境或恶劣的天气条件下,保持稳定的跟踪可能仍然是一个挑战;自适应算法可能在某些特定情况下失效,例如在目标与背景颜色相似或目标速度变化很大的情况下的上述问题。

2、为了达到上述目的,本发明提供如下技术方案:

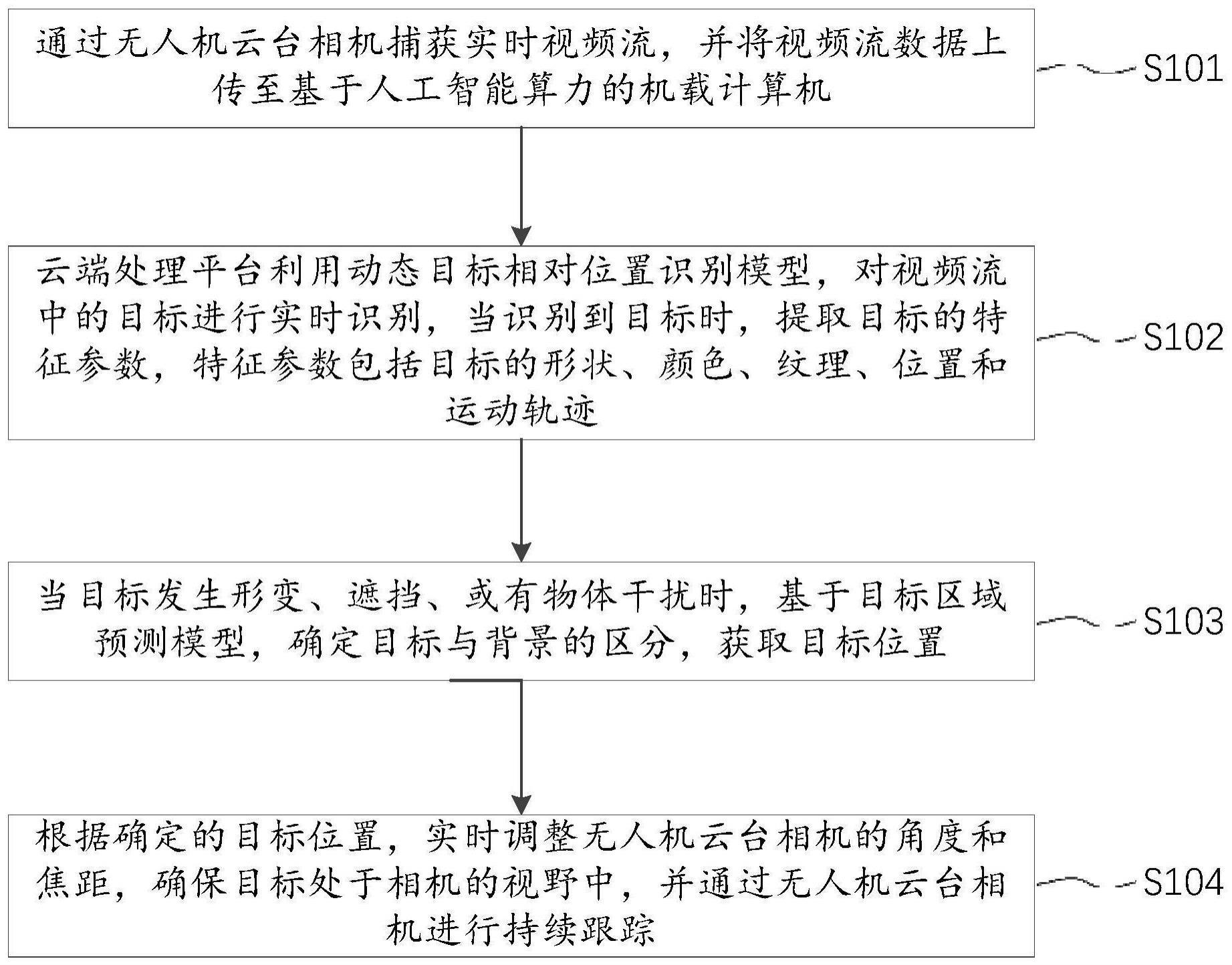

3、基于人工智能的无人机云台相机目标识别跟踪方法,包括:

4、s101:通过无人机云台相机捕获实时视频流,并将视频流数据上传至基于人工智能算力的机载计算机;

5、s102:基于人工智能算力的机载计算机利用动态目标相对位置识别模型,对视频流中的目标进行实时识别,当识别到目标时,提取目标的特征参数,特征参数包括目标的形状、颜色、纹理、位置和运动轨迹;

6、s103:当目标发生形变、遮挡、或有物体干扰时,基于目标区域预测模型,确定目标与背景的区分,获取目标位置;

7、s104:根据确定的目标位置,实时调整无人机云台相机的角度和焦距,确保目标处于相机的视野中,并通过无人机云台相机进行持续跟踪。

8、其中,s101步骤包括:

9、s1011:启动无人机云台相机,基于预设的目标捕获参数,自动调整相机设置,其中,目标捕获参数包括焦距、曝光时间和光圈大小;

10、s1012:无人机云台相机实时捕获视频流,其中,通过内置的图像处理算法,对捕获的视频流进行实时压缩和编码,获取编码后的视频流数据;

11、s1013:通过预设的无线通信协议,将编码后的视频流数据实时上传至基于人工智能算力的机载计算机,同时确保数据的完整性和安全性。

12、其中,s102步骤包括:

13、s1021:基于深度学习算法,对目标识别数据库中的目标识别捕获数据进行特征提取,根据获取的特征,构建动态目标相对位置识别模型,将特征和对应的目标位置作为输入,通过反向传播算法优化动态目标相对位置识别模型参数;

14、s1022:利用动态目标相对位置识别模型,对视频流中的目标进行实时识别,当识别到目标时,启动特征参数提取过程;

15、s1023:提取目标的特征参数,对目标的形状、颜色、纹理进行分析,再计算目标的位置和运动轨迹。

16、其中,s103步骤包括:

17、s1031:当目标发生形变、遮挡或有物体干扰时,启动目标区域预测模型,利用目标区域预测模型,对视频中的目标与背景进行区分;

18、s1032:在目标与背景区分过程中,先对目标的形状、颜色、纹理和运动特性进行分析,然后根据目标区域预测模型确定目标与背景的界限;

19、s1033:根据目标区域预测模型的预测结果,获取目标对应位置,通过反馈机制对预测结果进行核对,若预测结果与实际情况不符时,对目标区域预测模型进行实时调整和优化。

20、其中,s104步骤包括:

21、s1041:根据确定的目标位置,计算目标与无人机云台相机当前视野的相对位置;

22、s1042:实时调整无人机云台相机的角度,计算目标的移动速度和方向,预测目标的下一位置,提前调整无人机云台相机的角度;

23、s1043:根据目标与相机的距离,动态调整相机的焦距,当目标临时失去或模糊时,通过目标反馈机制重新定位并跟踪目标。

24、其中,s1011步骤包括:

25、启动无人机云台相机时,根据实际目标位置与期望目标位置,在无人机云台坐标系下的差值设置云台伺服驱动控制器,云台伺服驱动控制器根据输入误差计算得到虚拟控制指令,驱动伺服执行机构调整云台水平方向与垂直方向的转动;

26、其中,无人机根据被跟踪目标所在位置及无人机当前飞行目标状态估计目标的实际位置,设定无人机飞行期望轨迹;无人机飞行控制器根据无人机飞行实际轨迹和期望轨迹计算虚拟控制指令,并驱动无人机执行机构完成无人机飞行控制。

27、其中,s1022步骤包括:

28、利用动态目标相对位置识别模型对视频流中的目标进行实时识别过程中,读取视频流中的视频序列图像,并判断视频序列图像是否为第一帧图像;若为第一帧图像,则利用目标检测算法对输入图像全局检测,并选取设定范围内的置信度得分最高的目标选框作为被跟踪目标的初始位置信息;若不是第一帧图像,则裁剪图像,使图像大小为前一帧检测得到的目标选框尺寸的5倍,裁剪图像中心位置为前一帧目标选框的中心坐标,若无前一帧检测结果,则以目标检测结果作为裁剪标准,根据目标初始位置信息裁剪包括目标图信息,并利用网络模板分支提取目标特征信息,输出6×6×256特性图;

29、将6×6×256特性图作为动态目标相对位置识别模型网络输入,利用已训练的两个卷积层将特征图扩展为4×4(×2k×256)通道的特征图与4×4(×4k×256)通道的特征图,其中,k表示k个锚点;利用检测分支提取裁剪图像特征信息,并输出大小为22×22×256的特征图;对特征图中k个锚点进行排序,并选择设定范围得分最高的锚点作为目标跟踪检测结果,并输出该锚点的得分与坐标信息,该坐标信息为当前帧目标位置信息。

30、其中,s1031步骤包括:

31、当目标发生形变、遮挡或有物体干扰,启动目标区域预测模型时,将目标区域预测模型中的卷积层后增加对应通道选择层,根据已知帧目标及周围背景区域像素点的类别标注,对最后一个卷积层的通道进行排序和筛选,通过排序和筛选获得目标的语义特征,对语义特征进行二值化操作,二值化后的语义特征被当作掩膜模板将目标分块,在对候选目标进行表示时,通过对可靠区域和不可靠区域表示系数的差值项进行设定范数约束,保证同一个候选目标不同局部区域在选择字典原子及类别判断上的一致性。

32、其中,基于人工智能的无人机云台相机目标识别跟踪系统,包括:

33、捕获视频流单元,用于通过无人机云台相机捕获实时视频流,并将视频流数据上传至基于人工智能算力的机载计算机;

34、目标识别单元,用于基于人工智能算力的机载计算机利用动态目标相对位置识别模型,对视频流中的目标进行实时识别,当识别到目标时,提取目标的特征参数,特征参数包括目标的形状、颜色、纹理、位置和运动轨迹;

35、目标与背景区分单元,用于当目标发生形变、遮挡、或有物体干扰时,基于目标区域预测模型,确定目标与背景的区分,获取目标位置;

36、目标跟踪单元,用于根据确定的目标位置,实时调整无人机云台相机的角度和焦距,确保目标处于相机的视野中,并通过无人机云台相机进行持续跟踪。

37、其中,捕获视频流单元包括:

38、捕获视频流第一子单元,用于启动无人机云台相机,基于预设的目标捕获参数,自动调整相机设置,其中,目标捕获参数包括焦距、曝光时间和光圈大小;

39、捕获视频流第二子单元,用于无人机云台相机实时捕获视频流,其中,通过内置的图像处理算法,对捕获的视频流进行实时压缩和编码,获取编码后的视频流数据;

40、捕获视频流第三子单元,用于通过预设的无线通信协议,将编码后的视频流数据实时上传至基于人工智能算力的机载计算机,同时确保数据的完整性和安全性。

41、与现有技术相比,本发明具有以下优点:

42、基于人工智能的无人机云台相机目标识别跟踪方法,包括:通过无人机云台相机捕获实时视频流,并将视频流数据上传至基于人工智能算力的机载计算机;基于人工智能算力的机载计算机利用动态目标相对位置识别模型,对视频流中的目标进行实时识别,当识别到目标时,提取目标的特征参数,特征参数包括目标的形状、颜色、纹理、位置和运动轨迹;当目标发生形变、遮挡、或有物体干扰时,基于目标区域预测模型,确定目标与背景的区分,获取目标位置;根据确定的目标位置,实时调整无人机云台相机的角度和焦距,确保目标处于相机的视野中,并通过无人机云台相机进行持续跟踪。能够在目标形变、遮挡或有物体干扰的情况下,准确地确定目标位置,提高目标识别和跟踪的精准度。

43、本发明的其它特征和优点将在随后的说明书中阐述,并且,部分地从说明书中变得显而易见,或者通过实施本发明而了解。

44、下面通过附图和实施例,对本发明的技术方案做进一步的详细描述。

- 还没有人留言评论。精彩留言会获得点赞!