基于深度无关数据集的图像去雾方法、计算机设备、介质和电子设备

本技术涉及图像处理,尤其涉及图像去雾。

背景技术:

1、现有的图像去雾技术,最初是通过现实有雾场景采集的方式为图像去雾任务提供数据集,但这样的采集工作存在几个难点。第一,不同天气情况下,雾的分布不同,如在有风情况下,雾会呈现一种非均匀的分布受到人类进行指针仪表读数获取方法的启发,本发明着重在仪表形态变换模块和仪表内容识别模块进行改进。而在无风的天气下,雾大致呈现一种均匀的分布,如果将不同分布的雾放在一起,会是模型的训练更加困难。第二,在现实场景中,很难一个场景的有雾图像和其对应的清晰图像。目前比较主流的方法是,在一个相对静止的场景中,使用人工造雾的方式,获得同一场景的有雾图像和清晰图像。由于以上几个难点,使得真实场景的数据集数据量较小,不适合用于图像去雾模型的训练。

2、后续通过分析有雾图像的成因,并对其进行建模,并使用大气散射模型(asm)人工合成有雾图像,大大的减小了用于图像去雾模型训练的数据集的收集难度。后续的去雾工作就采用asm来合成有雾图像并制作用于模型训练和测试的数据集。从实验结果中发现,使用合成数据集训练模型,模型学习到的分布存在一些问题。合成数据集中雾的分布和场景深度之间存在着强相关性,模型可能会被这个先验信息误导而忽视雾的浓度信息,使模型学习场景深度而不是雾的浓度来恢复图像。这会导致有雾图像的雾的分布不符合“越远越浓”这个先验的时候,模型对其的恢复效果较差。

3、目前u-net架构在去雾领域也广为使用,但通过实验发现无论是将编码器的特征图与解码器的特征图进行拼接操作还是相加操作都无法很好的平衡模型学习能力与计算复杂度之间的关系。具体表现为,拼接特征融合方法可以丰富特征数量,提高模型的学习能力,但计算复杂度较高,模型参数量较大。与之相反,相加或加权相加特征融合方法可以将计算复杂度大幅降低,但随之损失的是模型的学习能力。

4、综上,现有的图像去雾数据集存在一些限制。数据集生成方式主要有人工采集和合成两种方法。然而,人工采集的数据集受限于数量和多样性,无法涵盖各种不同的场景和雾的浓度。另一方面,合成数据集虽然可以生成大量数据,但往往使模型过多地学习场景深度而非雾的分布,从而降低了模型的去雾能力。此外,在传统的特征融合方法中,常见的做法是对应通道相加或加权相加。尽管这种方法计算量较小,但由于简单地叠加特征会导致信息丢失,从而降低了模型的学习能力和去雾效果。另一种特征融合方法是基于特征拼接,它可以更好地保留特征的细节信息,提升模型的学习能力。然而,这种方法需要更多的计算资源,导致速度较慢。

技术实现思路

1、本发明目的是为了解决现有图像去雾处理能力低且无法同时保证去雾效果和计算速度的问题,提供了基于深度无关数据集的图像去雾方法、计算机设备、介质和电子设备。

2、本发明是通过以下技术方案实现的,本发明一方面,提供一种基于深度无关数据集的图像去雾方法,所述方法包括:

3、步骤1、合成引导模型学习雾浓度的深度无关数据集,具体包括:

4、通过混洗无雾图像和对应的深度图像的配对,解耦雾的分布和场景深度之间的关系,将雾的分布完全独立于场景;

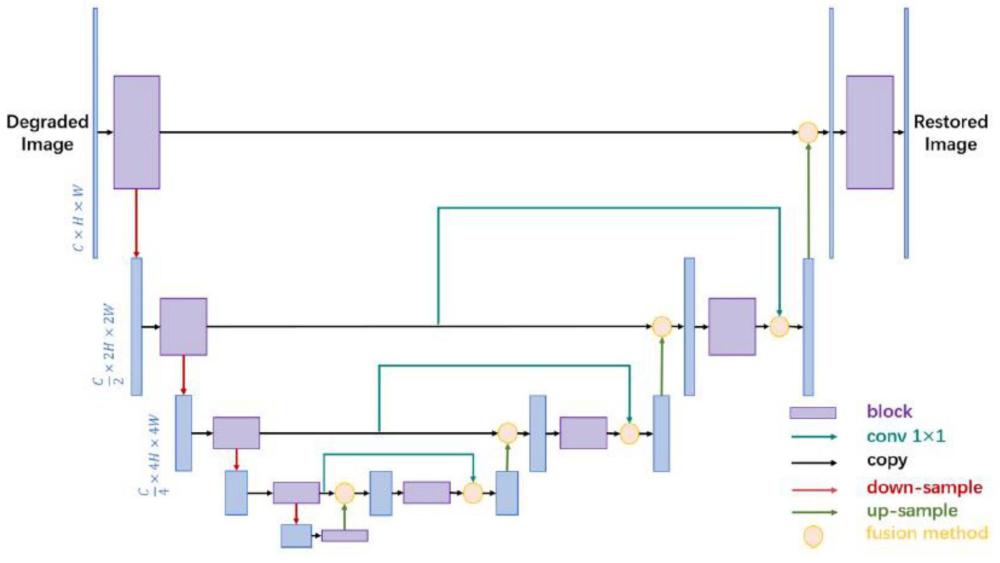

5、步骤2、在u-net去雾架构中引入卷积跳跃连接模块,所述卷积跳跃连接模块为一个卷积层,获得改进后的u-net网络;

6、步骤3、利用步骤1中的深度无关数据集训练步骤2中的改进后的u-net网络,获得基于深度无关数据集的图像去雾模型;

7、步骤4、利用步骤3中的基于深度无关数据集的图像去雾模型对图像进行去雾处理。进一步地,步骤1中的合成公式为:

8、i*(x)=j(x)·t*(x)+a·(1-t*(x))

9、

10、其中,t*是根据新配对的深度图d*(x)计算出的透射率,i*(x)是合成的深度无关的有雾图像,j(x)是清晰的无雾图像,a是大气光,β是大气散射系数。

11、进一步地,步骤1中,所述通过混洗无雾图像和对应的深度图像的配对,解耦雾的分布和场景深度之间的关系,将雾的分布完全独立于场景,具体为:

12、在大气散射模型的基础上,通过混洗无雾图像和对应的深度图像的配对,解耦了雾的分布和场景深度之间的关系,将雾的分布完全独立于场景。

13、进一步地,步骤2,具体包括:

14、在u-net去雾架构中,对编码器特征提取模块的输出特征进行卷积,并将卷积后的结果与对应层的解码器模块输出的特征相加,再将相加后的特征图输入到下一阶段的解码器模块中。

15、进一步地,所述卷积跳跃连接模块的公式为:

16、

17、其中,是引入的具有与ki相同通道数的卷积层的第i个通道,xi和yi分别表示来自跳跃连接和上采样的特征图x和y的第i个通道,ki是第i个通道对应的卷积核,c是每个输入的通道数。

18、进一步地,步骤1中,所述u-net去雾架构,具体为:基于相加或加权相加特征融合方法的u-net去雾架构。

19、进一步地,步骤2中,所述基于相加或加权相加特征融合方法的公式为:

20、

21、第二方面,本发明提供一种计算机设备,包括存储器和处理器,所述存储器中存储有计算机程序,当所述处理器运行所述存储器存储的计算机程序时执行如上文所述的一种基于深度无关数据集的图像去雾方法的步骤。

22、第三方面,本发明提供一种计算机可读存储介质,所述计算机可读存储介质中存储有多条计算机指令,所述多条计算机指令用于使计算机执行如上文所述的一种基于深度无关数据集的图像去雾方法。

23、第四方面,本发明提供一种电子设备,包括:

24、至少一个处理器;以及,

25、与所述至少一个处理器通信连接的存储器;其中,

26、所述存储器存储有可被所述至少一个处理器执行的指令,所述指令被所述至少一个处理器执行,以使所述至少一个处理器能够执行如上文所述的一种基于深度无关数据集的图像去雾方法。

27、本发明的有益效果:

28、本方面对去雾数据集生成方法和去雾模型进行了改进,并在此基础上完成了一种基于深度无关数据集的图像去雾方法。

29、首先,在数据集方面,本发明提出了一种全新的合成方法,该方法能够解耦雾的浓度和场景深度之间的关系,从而生成一个与深度无关的数据集,将其命名为深度无关去雾数据集(da-haze)。将雾的浓度和场景深度关系解耦,使图像中雾的浓度与场景完全无关,来引导模型学习雾的浓度来恢复图像,学习到去雾的本质,提高了模型在各种雾分布下的泛化能力。

30、其次,同时本发明改进了基于u-net的去雾架构中的跳跃连接特征融合方法。提出了一种全新的卷积跳跃连接(csc),其能够以计算复杂度较低的“相加”方法实现与“拼接”方法相当的效果。csc通过为相加的特征融合方法引入一个单独的卷积层,对编码器特征进行卷积,并将卷积后的结果于解码器的特征相加,来提高相加特征融合方法的特征表示能力,进而在几乎不增加计算复杂度的同时提高模型的去雾表现。

31、本发明适用于图像去雾。

- 还没有人留言评论。精彩留言会获得点赞!