一种基于人工智能的智慧课堂行为分析方法及系统与流程

本发明涉及图像处理,特别涉及一种基于人工智能的智慧课堂行为分析方法及系统。

背景技术:

1、智慧课堂,是以建构主义学习理论为依据,以“互联网+”的思维方式和大数据、云计算等新一代信息技术打造的智能、高效的课堂。采用现代化的分析工具和分析方法对数据进行加工、挖掘和分析,据此进行教学决策,依靠数据精准地掌握学情和调整教学策略。

2、现有技术当中,通过对课堂进行监控,然后基于图像的分析对学生的行为进行检测识别,是主要的教学质量检测手段,但由于教室场景的复杂性,图像处理时需要针对每个学生进行目标识别,数据处理量大,检测效率较低,仅适用于课后的检测分析的场景,不利于课堂实时监测。

技术实现思路

1、针对现有技术的不足,本发明的目的在于提供一种基于人工智能的智慧课堂行为分析方法及系统,旨在解决现有技术中,检测效率较低的技术问题。

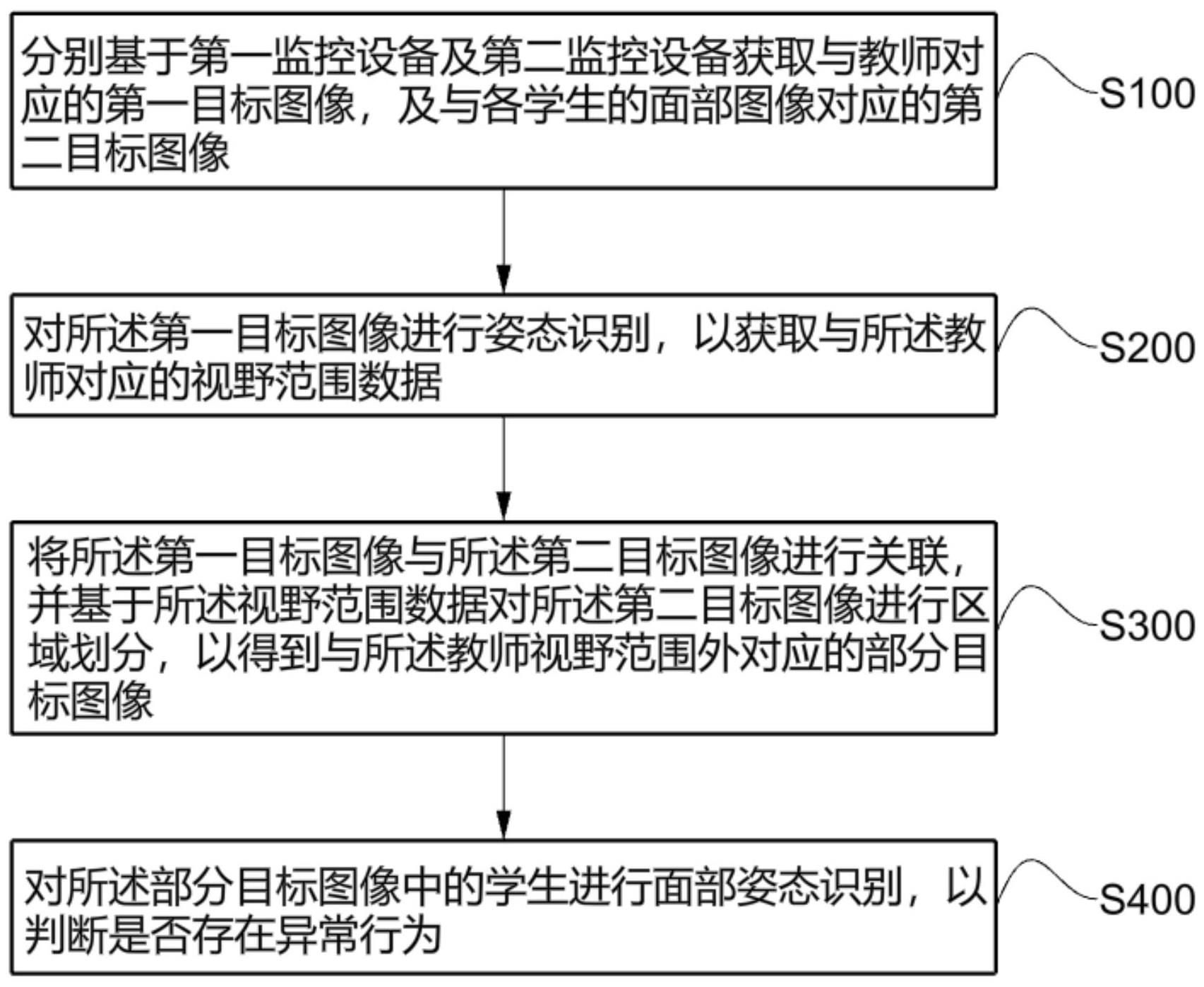

2、为了实现上述目的,本发明是通过如下技术方案来实现的:一种基于人工智能的智慧课堂行为分析方法,包括以下步骤:

3、分别基于第一监控设备及第二监控设备获取与教师对应的第一目标图像,及与各学生的面部图像对应的第二目标图像;其中,分别基于第一监控设备及第二监控设备获取与教师对应的第一目标图像,及与各学生的面部图像对应的第二目标图像的步骤具体包括:基于第一监控设备实时获取教室内的第一目标视频,基于第一抽帧频率对所述第一目标视频进行关键帧提取,以获取与教师对应的第一目标图像;对所述第一目标图像进行姿态识别,以获取与所述教师对应的视野范围数据;判断所述视野范围数据是否处于预设范围内;若所述视野范围数据处于预设范围外,基于第二监控设备获取与所述第一目标图像对应的第二目标图像,所述第二目标图像包括各学生的面部姿态图像;

4、将所述第一目标图像与所述第二目标图像进行关联,并基于所述视野范围数据对所述第二目标图像进行区域划分,以得到与所述教师视野范围外对应的部分目标图像;

5、对所述部分目标图像中的学生进行面部姿态识别,以判断是否存在异常行为。

6、根据上述技术方案的一方面,将所述第一目标图像与所述第二目标图像进行关联的步骤具体包括:

7、将所述第一目标图像与所述第二目标图像进行对齐,并基于所述第二目标图像生成包括与教师位置对应的投影坐标点的第三目标图像。

8、根据上述技术方案的一方面,对所述第一目标图像进行姿态识别的步骤具体包括:

9、对所述第一目标图像进行关键点分析,以获取所述教师的左、右肩关键点坐标,并基于以下计算表达式得到第一斜率,以判断教师的侧身角度:

10、;

11、式中,(,)为左肩关键点坐标,(,)为右肩关键点坐标,为避免分母为零的常数。

12、根据上述技术方案的一方面,基于所述视野范围数据对所述第二目标图像进行区域划分的步骤之前,所述方法还包括:

13、基于所述投影坐标点在所述第三目标图像上生成标准视野区域,并根据所述侧身角度对所述标准视野区域进行调节,以得到视野范围数据。

14、根据上述技术方案的一方面,对所述部分目标图像中的学生进行面部姿态识别的步骤具体包括:

15、对所述部分目标图像进行关键点分析,以获取所述学生的耳朵及眼睛的关键点坐标,并基于以下计算表达式得到第二斜率,以判断是否存在低头行为:

16、;

17、式中,(,)为左/右耳的关键点坐标,(,)为左/右眼的关键点坐标,为避免分母为零的常数。

18、根据上述技术方案的一方面,所述方法还包括:基于第二监控设备实时获取教室内的第二目标视频,基于第二抽帧频率对所述第二目标视频进行关键帧提取,以获取与各学生对应的第二目标图像。

19、另一方面,本发明还提供了一种基于人工智能的智慧课堂行为分析系统,包括:

20、第一获取模块,用于分别基于第一监控设备及第二监控设备获取与教师对应的第一目标图像,及与各学生的面部图像对应的第二目标图像,所述第一获取模块具体用于:基于第一监控设备实时获取教室内的第一目标视频,基于第一抽帧频率对所述第一目标视频进行关键帧提取,以获取与教师对应的第一目标图像;对所述第一目标图像进行姿态识别,以获取与所述教师对应的视野范围数据;判断所述视野范围数据是否处于预设范围内;若所述视野范围数据处于预设范围外,基于第二监控设备获取与所述第一目标图像对应的第二目标图像,所述第二目标图像包括各学生的面部姿态图像;

21、处理模块,用于将所述第一目标图像与所述第二目标图像进行关联,并基于所述视野范围数据对所述第二目标图像进行区域划分,以得到与所述教师视野范围外对应的部分目标图像;

22、第二识别模块,用于对所述部分目标图像中的学生进行面部姿态识别,以判断是否存在异常行为。

23、根据上述技术方案的一方面,所述处理模块具体用于:

24、将所述第一目标图像与所述第二目标图像进行对齐,并基于所述第二目标图像生成包括与教师位置对应的投影坐标点的第三目标图像。

25、根据上述技术方案的一方面,所述第一识别模块具体用于:

26、对所述第一目标图像进行关键点分析,以获取所述教师的左、右肩关键点坐标,并基于以下计算表达式得到第一斜率,以判断教师的侧身角度:

27、;

28、式中,(,)为左肩关键点坐标,(,)为右肩关键点坐标,为避免分母为零的常数。

29、根据上述技术方案的一方面,所述处理模块还用于:基于所述投影坐标点在所述第三目标图像上生成标准视野区域,并根据所述侧身角度对所述标准视野区域进行调节,以得到视野范围数据。

30、根据上述技术方案的一方面,所述第二识别模块具体用于:对所述部分目标图像进行关键点分析,以获取所述学生的耳朵及眼睛的关键点坐标,并基于以下计算表达式得到第二斜率,以判断是否存在低头行为:

31、;

32、式中,(,)为左/右耳的关键点坐标,(,)为左/右眼的关键点坐标,为避免分母为零的常数。

33、根据上述技术方案的一方面,所述第一获取模块具体用于:基于第一监控设备实时获取教室内的第一目标视频,基于第一抽帧频率对所述第一目标视频进行关键帧提取,以获取与教师对应的第一目标图像;

34、对所述第一目标图像进行姿态识别,以获取与所述教师对应的视野范围数据;

35、判断所述视野范围数据是否处于预设范围内;

36、若所述视野范围数据处于预设范围外,基于第二监控设备获取与所述第一目标图像对应的第二目标图像,所述第二目标图像包括各学生的面部姿态图像。

37、根据上述技术方案的一方面,所述系统还包括:

38、第二获取模块,用于基于第二监控设备实时获取教室内的第二目标视频,基于第二抽帧频率对所述第二目标视频进行关键帧提取,以获取与各学生对应的第二目标图像。

39、与现有技术相比,本发明的有益效果在于:通过分别基于第一监控设备及第二监控设备获取与教师对应的第一目标图像,及与各学生的面部图像对应的第二目标图像,并基于第一目标图像对教师的姿态进行识别,进而基于教师的视野范围数据对第二目标图像进行处理,得到于教师视野范围外对应的部分目标图像,最后通过对部分目标图像进行识别分析,相对于现有技术中对全部学生目标进行检测识别,相对减少了教师可以实时观察到的学生图像的数据处理量,提高了检测效率,便于实时判断当前视野外的学生是否存在异常行为,利于课堂实时监测的应用场景。

- 还没有人留言评论。精彩留言会获得点赞!