一种SAR小样本目标检测方法及系统与流程

本发明涉及成孔径雷达(sar,synthetic aperture radar)自动目标识别,具体涉及一种sar小样本目标检测方法及系统。

背景技术:

1、合成孔径雷达(syntheic aperture radar,sar)具有在任何天气和日夜条件下提供高分辨率地面图像的独特能力。这使得sar在军事和民用领域中得到广泛的应用。其中,船舶目标的自动检测识别是一项重要任务,旨在保障海上交通的安全和打击非法海上活动。然而,受限于sar图像的特性和海洋环境的复杂性,此领域面临诸多挑战。

2、早期sar目标检测识别算法研究集中在传统方法上,主要基于手工特征和有限的浅学习表示,可以分为三个步骤:预处理、候选区域提取和判别。基于恒定虚警率(cfar)的方法是种常用的候选区域提取方法,根据阈值将像素区域分为船舶和非船舶两类,面对小型船舶和复杂海上场景,建模难度比较大。深度学习的崛起解决了传统方法缺乏鲁棒性和普适性的问题,端到端的架构精简了手工设计等繁杂流程。基于深度学习sar目标检测识别方法可以分为两类:一类是两阶段检测,利用cnn网络对预选框进行两次回归和分类,经典的两阶段检测算法有faster r-cnn、r-fcn、fpn、mask r-cnn等;另一类是一阶段检测,使用全卷积网络对预选框进行一次分类和回归,代表算法有yolo、ssd、retinanet和cornernet等。两阶段检测算法精度更高,一阶段算法预测速度更快。zhou等提出了一种基于yolov5的多尺度船舶检测网络,利用跨阶段部分网络提高特征表示能力,和带有融合系数模块的特征金字塔网络来自适应融合特征映射,在模型大小和推理时间之间有很好的权衡。文献《sun w,huang x.semantic attention-based network for inshore sar shipdetection[c]//international conference on digital image processing.2021.》提出了sanet(semantic attention-based network),结合语义注意、焦点丢失、标签和锚分配,在不增加计算量的情况下提高检测性能。以上现有的大多数算法都是基于庞大的训练数据实现问题拟合和精度提升,难以应对数据采集困难的情况和特定小样本场景描述。

技术实现思路

1、本发明所要解决的技术问题在于现有的大多数sar目标检测算法都是基于庞大的训练数据实现问题拟合和精度提升,难以应对数据采集困难的情况和特定的小样本场景。

2、本发明通过以下技术手段解决上述技术问题的:一种sar小样本目标检测方法,包括以下步骤:

3、步骤一:在vit网络架构上,训练出用于语义特征提取的dino-vit模块;

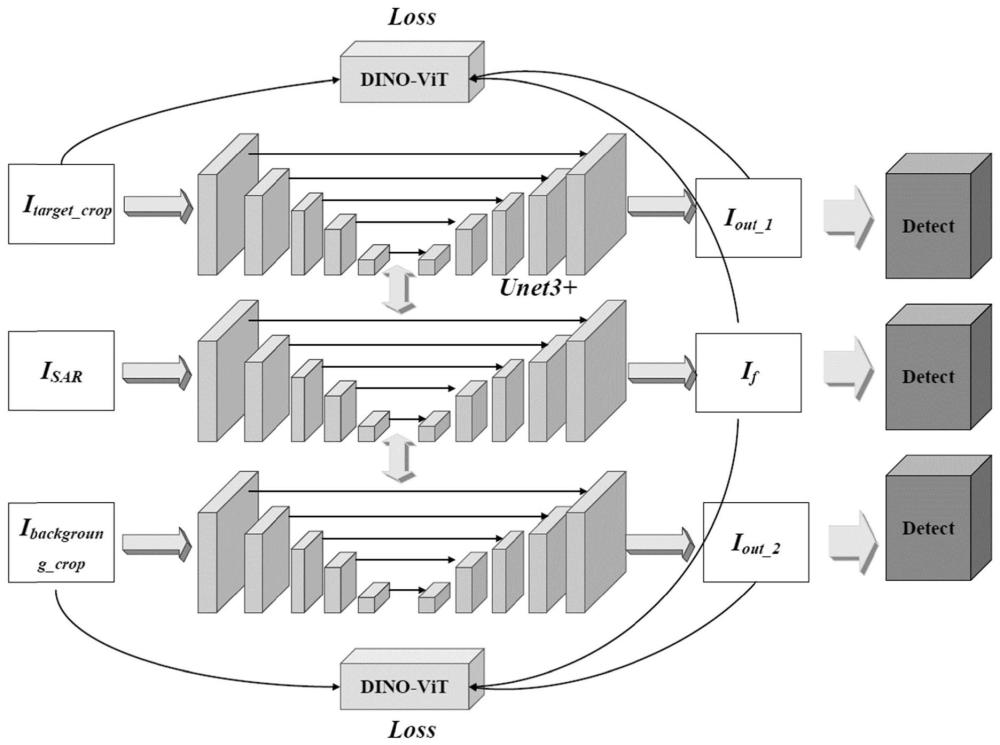

4、步骤二:将源图像isar、对源图像isar进行属性变换得到的图像itarget_crop以及图像ibackground_crop分别作为输入,送入unet3+网络的三条支路,通过参数共享实现特征增强与融合;

5、步骤三:利用预训练的dino-vit模块提取增强特征的语义信息,构建损失函数,训练unet3+网络,同时还通过回归分类损失约束训练与unet3+网络输出端连接的检测网络,所有的损失函数值最小时停止训练,得到训练好的模型,该模型定义为目标检测模型;

6、步骤四:将实时采集的图像输入训练好的目标检测模型中的unet3+网络,其三条支路生成不同侧重点的图像,作为有效特征层送入检测网络,得到目标检测结果。

7、进一步地,所述步骤一包括:

8、基于ssdd数据集在vit网络架构上,使用无标签自蒸馏的方式训练出适应sar图像的语义特征提取模块,该模块定义为dino-vit模块。

9、进一步地,所述步骤二包括:

10、所述源图像isar即为采集的sar图像,对sar图像进行随机裁剪、水平翻转、色彩抖动生成图像itarget_crop,对sar图像进行随机裁取、水平翻转和高斯模糊处理生成图像ibackground_crop。

11、进一步地,所述步骤三中构建损失函数包括:

12、所述损失函数包含背景空间结构约束、目标外观结构约束、键值细节约束,计算公式为

13、lcon=alstru+blapp+clkey

14、其中,lcon表示特征提取的内容损失,lcon由背景空间结构损失lstru,目标外观结构损失lapp和键值损失lkey构成,a、b、c均是用来平衡损失的超参数。

15、更进一步地,所述背景空间结构损失lstru利用余弦自相关性计算多头注意力机制的键值,使得生成图像能保留更多sar图像的目标结构信息,定义如下:

16、lstru=||(s(isar)-s(if))+(s(ibackground_crop)-s(iout_2))||f

17、式中if、iout_1分别表示融合图像、突出背景信息的属性变换图像itarget_crop对应的输出,s(i)表示计算图像的余弦自相关性,||||f表示计算frobenius范数。

18、更进一步地,所述目标外观结构损失lapp从vit特征空间提取[cls]标记,利用标记约束网络对sar图像的目标外观纹理保留,目标外观结构损失lapp定义如下:

19、lapp=||(tcls(itarget_crop)-tcls(if))+(tcls(itarget_crop)-tcls(iout_1))||2

20、式中,tcls(·)表示提取关于图像的[cls]标记,||||2计算l2范数。

21、更进一步地,所述vit特征空间的键值描述了一些细节结构信息,通过键值损失lkey能保留源图像的细节纹理特征,所述键值损失lkey的定义如下:

22、lkey=(1-λ)||k(itarget_crop)-k(iout_1)||f+λ||k(isar)-k(if)||f

23、式中,k(·)表示提取关于图像的键值信息,λ是均衡参数。

24、进一步地,所述步骤三中回归分类损失包括分类损失函数和回归损失函数;

25、使用vfl loss函数,构建分类损失函数;

26、使用ciou loss+dfl函数,构建回归损失函数。

27、本发明还提供一种sar小样本目标检测系统,包括:

28、预训练单元,用于在vit网络架构上,训练出用于语义特征提取的dino-vit模块;

29、数据处理单元,用于将源图像isar、对源图像isar进行属性变换得到的图像itarget_crop以及图像ibackground_crop分别作为输入,送入unet3+网络的三条支路,通过参数共享实现特征增强与融合;

30、模型训练单元,用于利用预训练的dino-vit模块提取增强特征的语义信息,构建损失函数,训练unet3+网络,同时还通过回归分类损失约束训练与unet3+网络输出端连接的检测网络,所有的损失函数值最小时停止训练,得到训练好的模型,该模型定义为目标检测模型;

31、检测输出单元,用于将实时采集的图像输入训练好的目标检测模型中的unet3+网络,其三条支路生成不同侧重点的图像,作为有效特征层送入检测网络,得到目标检测结果。

32、进一步地,所述预训练单元还用于:

33、基于ssdd数据集在vit网络架构上,使用无标签自蒸馏的方式训练出适应sar图像的语义特征提取模块,该模块定义为dino-vit模块。

34、进一步地,所述数据处理单元还用于:

35、所述源图像isar即为采集的sar图像,对sar图像进行随机裁剪、水平翻转、色彩抖动生成图像itarget_crop,对sar图像进行随机裁取、水平翻转和高斯模糊处理生成图像ibackground_crop。

36、进一步地,所述模型训练单元中构建损失函数包括:

37、所述损失函数包含背景空间结构约束、目标外观结构约束、键值细节约束,计算公式为

38、lcon=alstru+blapp+clkey

39、其中,lcon表示特征提取的内容损失,lcon由背景空间结构损失lstru,目标外观结构损失lapp和键值损失lkey构成,a、b、c均是用来平衡损失的超参数。

40、更进一步地,所述背景空间结构损失lstru利用余弦自相关性计算多头注意力机制的键值,使得生成图像能保留更多sar图像的目标结构信息,定义如下:

41、lstru=||(s(isar)-s(if))+(s(ibackground_crop)-s(iout_2))||f

42、式中if、iout_1分别表示融合图像、突出背景信息的属性变换图像itarget_crop对应的输出,s(i)表示计算图像的余弦自相关性,||||f表示计算frobenius范数。

43、更进一步地,所述目标外观结构损失lapp从vit特征空间提取[cls]标记,利用标记约束网络对sar图像的目标外观纹理保留,目标外观结构损失lapp定义如下:

44、lapp=||(tcls(itarget_crop)-tcls(if))+(tcls(itarget_crop)-tcls(iout_1))||2

45、式中,tcls(·)表示提取关于图像的[cls]标记,||||2计算l2范数。

46、更进一步地,所述vit特征空间的键值描述了一些细节结构信息,通过键值损失lkey能保留源图像的细节纹理特征,所述键值损失lkey的定义如下:

47、lkey=(1-λ)||k(itarget_crop)-k(iout_1)||f+λ||k(isar)-k(if)||f

48、式中,k(·)表示提取关于图像的键值信息,λ是均衡参数。

49、进一步地,所述模型训练单元中回归分类损失包括分类损失函数和回归损失函数;

50、使用vfl loss函数,构建分类损失函数;

51、使用ciou loss+dfl函数,构建回归损失函数。

52、本发明的优点在于:

53、(1)本发明对源图像isar进行属性变换得到图像itarget_crop以及图像ibackground_crop分别作为输入,送入unet3+网络的三条支路,属性变换的方式既增加了空间信息随机性,又减少冗余信息,还使得样本数扩增,并且还构建损失函数对模型进行训练,从而不需要庞大的训练数据即可进行问题拟合和精度提升,能够用于数据采集困难的情况和特定的小样本场景。

54、(2)本发明利用dino-vit的知识蒸馏方式生成针对sar图像的语义先验模块,利用vit特征空间的[cls]标记表示前景目标,键的自相似性表示背景空间结构,通过语义损失函数约束网络拟合方向,使源图像的前景背景语义信息得到区分,为检测提供有效特征层。

55、(3)本发明网络整体上通过三支路共享参数的方式实现前背景特征分离,实现有效信息的均衡与增强,生成的前景图像、背景图像、融合图像作为有效特征层进行分类和回归,提升检测准确率。

- 还没有人留言评论。精彩留言会获得点赞!