基于跨模态特征校准和动态融合的多光谱行人检测方法与流程

本发明涉及人工智能和行人检测,尤其涉及一种基于跨模态特征校准和动态融合的多光谱行人检测方法。

背景技术:

1、行人检测技术通过计算机算法自动检测图像或视频中的行人目标,是计算机视觉领域中的一个重要研究方向。随着人工智能和深度学习技术的快速发展,行人检测技术在交通管理、智能监控、自动驾驶等领域具有广泛应用前景。

2、传统行人检测方法只利用单模态信息,检测结果不佳。光学图像是对人类最直观的模态但是容易受到光照条件的影响,而红外图像在低光照条件下仍可用于检测但是却缺乏纹理信息。近些年来,基于深度学习的多光谱行人检测已成为行人检测领域的前沿研究方向,并取得了显著的突破。这主要得益于深度神经网络强大的特征提取能力,可以很好地提取不同模态信息对行人的丰富特征。但是基于深度学习的多光谱行人检测仍存在以下问题:

3、1)多模态互补信息难以挖掘。不同模态信息之间具有互补性,但是同样具有模态冗余性,目前主流的多光谱行人检测技术仍难以有效消除模态相关噪声的干扰,无法充分挖掘不同模态间图像的互补信息;

4、2)多模态互补信息融合方式单一。现有的多光谱行人检测方法只是简单地相加/级联多模态特征,忽略了不同模态之间复杂多样的互补特性,使得现有静态的融合方法在复杂场景下的行人检测效果不足。

5、由于可见光-红外两种图像之间存在着复杂多样的互补性和冗余性,目前,多光谱行人检测方法仍然无法充分挖掘和利用不同模态图像间对解译任务的有效信息。

技术实现思路

1、为解决上述现有技术中存在的技术问题,本发明的目的在于提供一种的基于跨模态特征校准和动态融合的多光谱行人检测方法,能够充分利用复杂多样的互补信息,实现更好的检测性能。

2、为实现上述发明目的,本发明提供一种基于跨模态特征校准和动态融合的多光谱行人检测方法,包括以下步骤:

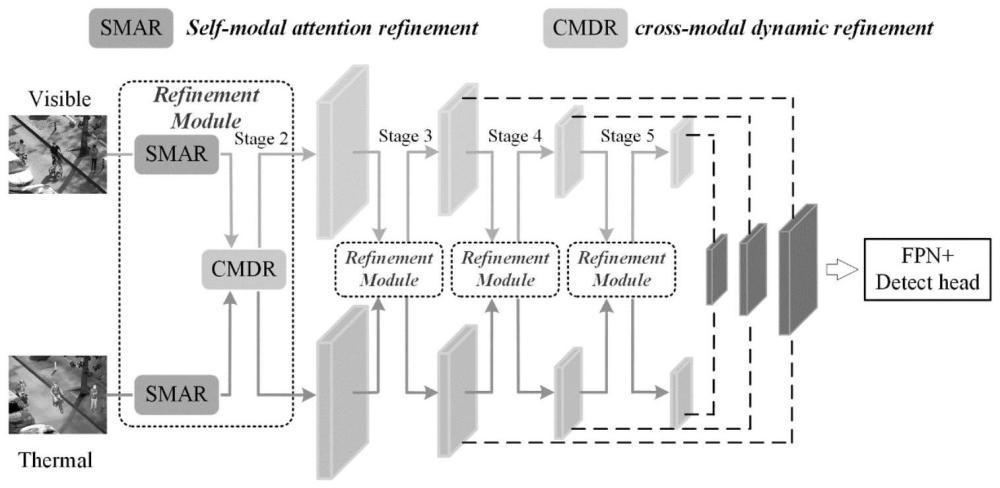

3、步骤s1、构建双流特征提取网络提取可见光图像和红外图像的特征;

4、步骤s2、构建跨模态特征校准子网络;

5、步骤s3、构建多模态动态融合子网络;

6、步骤s4、构建基于跨模态特征校准和动态融合的多光谱行人检测网络;

7、步骤s5、训练基于跨模态特征校准和动态融合的多光谱行人检测网络;

8、步骤s6、利用所述步骤s5中训练完成的基于跨模态特征校准和动态融合的多光谱行人检测网络进行行人检测。

9、根据本发明的技术方案,所述步骤s1中,具体包括:

10、获取可见光-红外图像行人检测数据,构建可见光和红外配对数据集;

11、将数据集按照预设比例分成训练集和测试集;

12、采用cspdarknet53主干网络作为可见光和红外图像的特征提取网络,将包含可见光和红外图像的训练集输入到特征提取网络中,形成多尺度可见光和红外特征图,输出多个特征提取层级的可见光和红外图像特征对。

13、根据本发明的技术方案,所述步骤s2中,在所述步骤s1输出的多个特征提取层级上,可见光和红外的两个模态之间相互利用另一模态的全局信息和局部信息,从通道和空间两个维度来校准当前模态特征,消除模态相关噪声,得到互补的可见光校准特征图和红外校准特征图。

14、根据本发明的技术方案,所述步骤s3中,采用动态融合方式将可见光校准特征图和红外校准特征图,聚合成可见光和红外融合特征图。

15、根据本发明的技术方案,所述步骤s4中,通过特征金字塔结构,融合具有丰富语义信息的高层级特征图和具有定位信息的低层级特征图,得到具有多尺度目标检测能力的三个层级特征图,进而采用检测头,对特征图上每个像素点输出其为行人的置信度得分和坐标。

16、根据本发明的技术方案,所述步骤s5中,采用所述步骤s1中的训练集对基于跨模态特征校准和动态融合的多光谱行人检测网络进行训练,基于随机梯度下降优化算法,设置学习率衰减策略,对所述步骤s4构建的基于跨模态特征校准和动态融合的多光谱行人检测网络的参数进行更新至收敛。

17、根据本发明的技术方案,所述步骤s5中还包括:采用所述步骤s1中的测试集对完成训练的基于跨模态特征校准和动态融合的多光谱行人检测网络进行验证。

18、根据本发明的技术方案,在所述步骤s2中,从通道和空间两个维度来校准当前模态特征,具体包括:

19、对于通道校准,将v和t沿着空间维度嵌入成可见光通道注意力向量和红外通道注意力向量以捕获通道之间的相关性,消除冗余性,其中,表示可见光图像特征,表示红外图像特征,则:

20、

21、其中,||表示通道拼接操作,δ表示sigmoid激活函数,fsplit表示通道切分函数,是||的反操作;

22、利用全局上下文和局部上下文两种嵌入方式局部上下文嵌入flc(x)采用逐点卷积以强调每个空间位置的通道响应,则有:

23、flc(x)=pwconvl2(relu(pwconvl1(x)))

24、其中,relu是relu激活函数,pwconvl2和pwconvl1是逐点卷积,卷积核大小分别为2c/r*2c*1*1和2c*2c/r*1*1,r是通道压缩率,全局上下文嵌入选用空间维度全局平均池化方式:

25、

26、其中,fswap是空间维度平均池化,pwconvg2和pwconvg1的卷积核大小与pwconvl2和pwconvl1分别保持一致;

27、最后,通道校准后的可见光图像特征vcr与红外图像特征vcr表示为:

28、

29、

30、对于空间校准,将vcr和tcr沿着通道维度嵌入成可见光空间注意力向量和红外空间注意力向量以捕获空间相关性,消除冗余性,则有:

31、

32、通道嵌入包括全局上下文和局部上下文两种嵌入方式:

33、

34、对于全局上下文采用通道平均池化fcwap压缩每个模态特征,并将其在通道维度进行拼接以获得空间嵌入:

35、

36、其中convg2和convg1是卷积操作,其卷积核大小分别为1*2*3*3和2*1*3*3;

37、对于局部上下文fls(vcr,tcr),采用组卷积和交织拼接操作获得空间嵌入:

38、

39、其中组卷积gconvl2和gconvl1的卷积核大小分别为c*2*3*3和2c*1*3*3;

40、最后,空间校准后的可见光图像特征vsr与红外图像特征vsr为:

41、

42、

43、本发明与现有技术相比,具有如下有益效果:

44、本发明提出了一种基于跨模态特征校准和动态融合的多光谱行人检测方法,采用跨模态特征校准方法,通过注意力机制让多模态特征在空间和通道两个维度上互相利用另一个模态全局和局部信息校准当前模态的特征,进而消除模态相关冗余性,突出模态之间的互补性,有助于更好的多模态特征融合,进而提升多光谱行人检测能力。

45、进一步地,本发明,采用多模态特征动态融合方法,可以根据多模态特征自适应地调整多种静态卷积核的权重,更好地在卷积核空间中捕获多模态特征之间复杂的互补信息,从而提升多模态特征的融合能力,提升多光谱行人检测的检测性能。

- 还没有人留言评论。精彩留言会获得点赞!