基于响应融合及自适应尺度处理的目标跟踪方法

本发明属于图像和视频处理,更进一步涉及计算机视觉领域一种基于响应融合及自适应尺度处理的目标跟踪方法。

背景技术:

1、目标跟踪作为图像和视频处理领域的一个研究热点,已在运动物体跟踪、交通控制、智能机器人、雷达制导、医学图像处理、监控系统、人机交互、行人检测、动作识别等实际应用中发挥着重要作用。目标跟踪的核心任务是精准地估测出目标的位置、运动状态、尺度大小等信息。相关滤波类目标跟踪算法通过初始化第一帧信息得到一个滤波器,后续检测图像输入时,通过特征提取、建模计算后与滤波器逐元素进行点乘得到输出响应,然后定位响应峰值位置,即可得到新一帧目标位置。在实际应用中,目标往往同时具有快速运动、形变、外观变化、光照模糊、尺度变化等特性,且跟踪场景中存在较多的复杂背景干扰。传统的相关滤波类目标跟踪算法的特征通常较为单一,因此其适用的目标类型有限,且对复杂背景的抗干扰能力弱,当遇到复杂情况时,这类算法缺乏一定的场景判断与处理能力,容易造成跟踪漂移和目标丢失。

技术实现思路

1、本发明针对现有技术的不足,提出了一种基于响应融合及自适应尺度处理的目标跟踪方法,以解决相关滤波类跟踪算法特征提取有效性和丰富性不足、快速尺度变化时应对能力差、抗干扰能力弱的问题,提高在背景杂波、相似干扰、尺度变化等场景下目标跟踪算法的综合性能。

2、为实现上述目的,本发明的具体步骤如下:

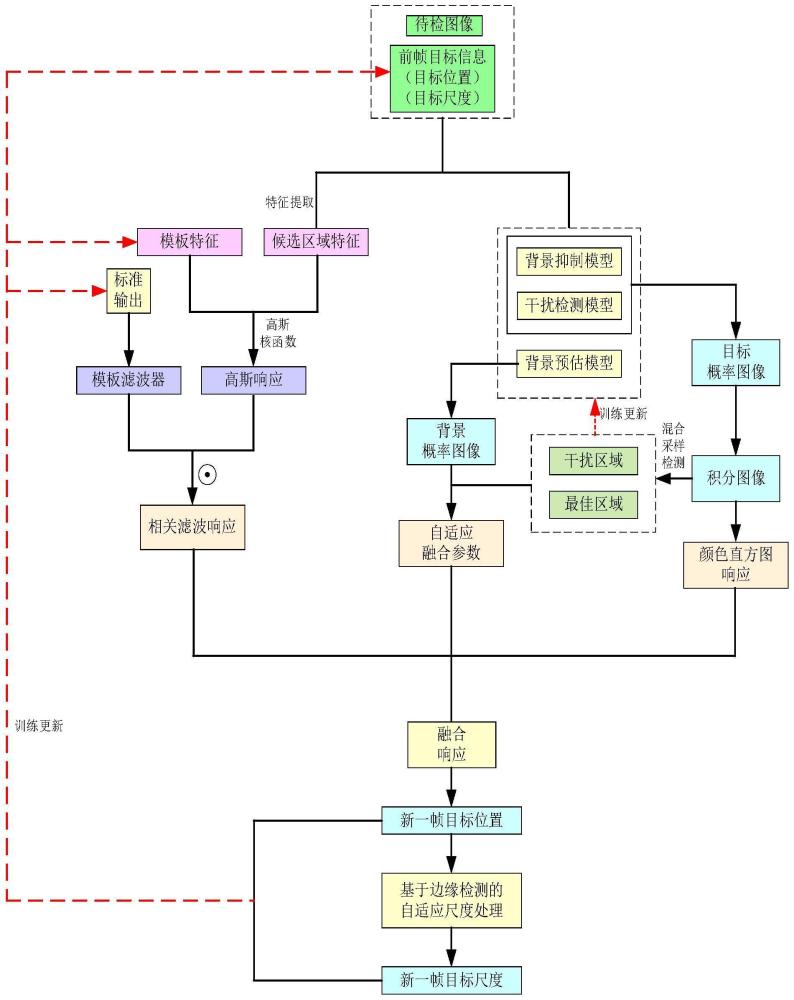

3、基于响应融合及自适应尺度处理的目标跟踪方法,包括如下步骤:

4、步骤1:算法开始前,完成包括固定权重、估计值在内的参数初始化,进行赋值;

5、步骤2:对输入的第一帧图像,计算背景抑制模型和干扰检测模型,并融合得到背景预估模型;

6、步骤3:初始化相关滤波模型,由第一帧图像的目标位置、尺度大小提取基础样本块;

7、步骤4:根据第t帧检测图像,计算相关滤波响应rescf、颜色直方图响应resco及自适应融合参数v;

8、步骤5:在第t帧检测图像中,计算融合响应res,定位融合响应res的峰值位置,得到第t+1帧图像中目标位置;

9、步骤6:在第t帧检测图像中,进行尺度计算,首先由第t帧检测图像提取图像块并计算其有效值,然后进行边缘检测并对检测结果进行自适应尺度处理,在完成尺度计算后,得到t+1帧目标尺度,结合步骤5中的目标位置,即可实现目标跟踪;

10、步骤7:完成检测部分后,进入相关滤波训练部分;

11、步骤8:处理下一帧图像,重复步骤4~7。

12、在一个实施例中,步骤1所述参数初始化,在计算颜色直方图响应的流程中:对颜色直方图进行处理时,添加颜色直方图学习率和颜色直方图通道长度,以实现更好的特征提取效果;对颜色直方图响应进行计算时,添加直方图模型融合权重,对背景抑制模型和干扰检测模型进行融合,以提高颜色直方图响应的背景抑制能力和目标相似物的抗干扰能力。

13、在一个实施例中,所述步骤2,模型计算步骤如下:

14、步骤2.1,在模型的训练阶段,将背景抑制模型概率分布查找表公式表示为:

15、

16、其中,i为输入图像,t为目标区域,s为背景区域,co表示像素点o的rgb值的组合为c,为输入图像i中目标区域t内的rgb值组合为c的像素个数,为输入图像i中背景区域s内的rgb值组合为c的像素个数,ψ为背景抑制直方图,其表达式为ψ=1-ξ·(p(co|o∈s)-p(co|o∈t)),式中ξ为背景抑制系数,用于控制抑制背景的程度,i(o)∈i(t∪s)表示当像素点o处于目标区域t或背景区域s的条件;

17、步骤2.2,在模型的训练阶段,将干扰检测模型概率分布查找表公式表示为:

18、

19、其中,g为潜在的干扰区域,w为设定的强化权重,为输入图像i中潜在的干扰区域g内的rgb值组合为c的像素个数;

20、步骤2.3,将背景抑制模型与干扰检测模型进行融合,得到背景预估模型,表示为:

21、p(o∈t|co)=τ·p(o∈t|t,s,co)*+(1-τ)·p(o∈t|t,g,co)*

22、式中的τ为直方图模型融合权重。

23、在一个实施例中,所述步骤3,相关滤波模型的初始化步骤如下:

24、步骤3.1,在求解相关滤波响应的过程中,使用正则化最小二乘法解决相关滤波模型的求解优化问题;

25、步骤3.2,通过核算子将样本q映射到特征空间,以提升样本的表征能力;

26、步骤3.3,带核正则化最小二乘法闭式解的形式为:

27、α=(k+λi)-1y

28、式中,α为模板滤波器,其每个元素为αi,y为标准输出向量,其每个元素为yi,i为单位矩阵,λ是赋予单位矩阵大小的常量,通常在训练前设定,k为循环矩阵,其元素为kij=κ(qi,qj),(qi,qj)是对线性样本q行中的元素表示;

29、步骤3.4,将循环矩阵k的相关性质用于下式,得到模板滤波器α、模板特征x的表达公式;

30、

31、f(xt)=(1-η)f(xt-1)+ηf(xnew)

32、f(αt)=(1-η)f(αt-1)+ηf(αnew)

33、式中,η为学习率,xt-1、αt-1分别表示前一帧的模板特征与模板滤波器,xnew、αnew分别表示当前帧新计算得到的模板特征与模板滤波器,xt、αt分别表示当前帧的最终模板特征与模板滤波器。

34、在一个实施例中,所述步骤4,计算步骤如下:

35、步骤4.1,在第t帧检测图像中,由上一帧图像的目标位置信息pt-1和尺度大小st-1提取搜寻框模块和区域特征,由背景抑制模型训练得到的颜色概率分布检查表lutt、抗干扰模型训练得到的颜色概率分布检查表lutg、背景预估模型训练得到的颜色概率分布检查表luts计算待检帧的目标概率图像m、背景概率图像ms,并对m进行积分得到积分图像mint;公式如下:

36、

37、式中,m由前一帧的干扰检测模型概率分布查找表公式计算得到,(m,n)表示m的行列索引,(i,j)表示mint的行列索引,上式表示对目标概率图像m的元素实施累加操作;

38、步骤4.2,通过m、ms、mint计算颜色直方图响应resco;

39、

40、式中,分别表示积分图像的左上、右下、右上、左下采样区域,区域的尺寸大小为积分图像与目标大小的差值;|t|表示目标区域面积;

41、步骤4.3,由模板滤波器α、模板特征x计算相关滤波响应rescf,公式如下:

42、

43、步骤4.4,对mint进行混合采样检测,得到潜在的干扰区域g和最佳的目标区域t’,由t’和m计算自适应融合参数v;最后进行颜色直方图感知模型训练,下一帧图像处理时使用t’、g训练更新lutt、lutg、luts;

44、

45、式中,th为过拟合权重阈值;

46、

47、

48、

49、式中,分别为计算得到的概率分布查找表,上标t表示本帧最终参数,上标t-1表示前一帧参数,上标new表示最新计算得到的参数,ηc为直方图参数学习率。

50、在一个实施例中,步骤5计算融合响应res的公式如下所示:

51、res=υ·resco+(1-υ)·rescf

52、定位res的峰值位置,得到目标位置pt。

53、在一个实施例中,所述步骤6,边缘检测的公式如下:

54、

55、式中mv为边缘强度,其表达式为

56、

57、式中thb为边缘强度灵敏系数,maxv、minv分别为图像有效最大值和图像有效最小值,g1、g2的表达式为

58、

59、

60、式中m为像素点o的灰度值,其右下角数字表示o在3×3遍历模板中的位置索引。

61、在一个实施例中,由pt提取图像块并利用灰度直方图统计的方式,提取图像的有效最值,首先,定义两个像素数量百分比,然后,在灰度分布直方图中提取出满足这两个百分比时的对应灰度值,即可分别得到图像有效最大值maxv和图像有效最小值minv。

62、在一个实施例中,所述对检测结果进行自适应尺度处理,步骤为:

63、(1)对输入图像块进行基于有效最值的形体边缘检测;

64、(2)对检测后的图像进行遍历,并由遍历框得分公式计算每个遍历框的得分sr,计算式为:

65、

66、式中,mi为不同边缘组ei的所有边缘点的边缘强度mv之和,rw和rh分别为选出的矩形框r的宽度和高度,rin是r的内部中心框,其高宽大小为r的1/2,κ为偏差系数。

67、(3)进行得分sr筛选,保留高于设定得分的候选框,记录其位置与大小;

68、(4)对得到的候选框再次进行遍历,每次提取出该候选框大小的子图像块,与跟踪中的模板特征按照下式进行相关滤波响应计算,公式如下:

69、

70、式中,为子图像块与模板特征的高斯响应的向量形式;

71、(5)若resp的大小达到了设定条件阈值,说明其对应的子图像块的尺度计算置信度最高,需进行目标尺度更新,取该子图像块的尺度大小作为最终目标尺度大小。

72、在一个实施例中,步骤7相关滤波的训练部分,由pt、st提取基础样本块,训练更新模板滤波器α、模板特征x,下一帧使用。

73、与现有技术相比,本发明的有益效果是:

74、在具有复杂杂波背景、尺度变化、运动模糊类型的实验中,本发明方法的auc值以及跟踪精度值相较于其他对比算法均有明显的提升,这是由于本发明在传统颜色直方图模型的基础上建立了背景抑制模型和干扰区域检测模型的融合模型,对复杂背景干扰有一定的抵抗能力;引入了基于形体边缘检测的自适应尺度处理策略,使得应对尺度变化较大的场景时追踪效果更好;本发明将不同特征的响应相融合,弥补了单一特征的局限性,使得面对运动模糊的场景时,仍有较高的追踪精度。综合来看,本发明的算法在跟踪鲁棒性、跟踪成功率、auc值、跟踪精度等方面均优于常用的现有技术,与常用的现有技术相比,在应对复杂背景、尺度变化较大、运动模糊的场景时的效果更为优秀。

- 还没有人留言评论。精彩留言会获得点赞!