基于特征扰动对抗的隐蔽性图注入攻击

:对抗攻击在图数据上是指通过对图结构或图属性进行修改,以欺骗机器学习模型的方法。这些攻击旨在通过对图中的节点、边或属性进行精心设计的修改,使得模型产生错误的预测结果或分析结果。研究领域主要关注两个方面:对抗攻击和对抗防御。对抗攻击:对抗攻击旨在找到针对图数据的漏洞,并利用这些漏洞来欺骗机器学习模型。常见的对抗攻击方法包括节点攻击、边攻击、属性攻击等。节点攻击可以通过删除或添加一些关键节点来破坏图结构;边攻击可以通过添加或删除边来改变图的连接关系;属性攻击可以修改节点或边的属性值来误导模型的预测结果。这些攻击方法旨在最大程度地改变图数据,同时尽可能减少攻击痕迹,使得攻击难以被检测到。对抗防御:为了保证图数据的安全性,研究者们提出了各种防御措施来抵抗对抗攻击。这些措施包括基于图结构的防御、基于属性的防御、基于模型的防御等。基于图结构的防御方法主要通过改变图的拓扑结构或增加噪声来增加攻击的难度;基于属性的防御方法则通过检测异常属性、属性融合或属性压缩等方式来提高模型的鲁棒性;基于模型的防御方法则通过设计更加鲁棒的机器学习模型,例如图神经网络模型,来抵御对抗攻击。这个领域的研究旨在提高机器学习模型对图数据的鲁棒性和安全性,以应对恶意攻击者可能对图数据进行的修改和操纵。

背景技术

0、

背景技术:

1、随着图神经网络在现实社会中的广泛应用,且在诸多领域取得了显著成果,人们对于其网络稳定性、安全性和可靠性的需求也在不断扩大,对于网络鲁棒性的研究受到了研究者们的关注,因而涌现出了很多对于原有网络模型改进提升的方法,在提升其效果的同时加强了鲁棒性,还有一些对于网络攻击的防御手段,保护模型或数据免受攻击的干扰。

2、对于图对抗攻击,干扰原始的输入图并对模型的性能造成破坏只是成功的第一步,除此之外对于攻击者还需要想办法抵御这些防御方法的识别。早在图修改攻击时,攻击者们便有了相关的应对手段。由于gma的攻击主要是对于原始图内的边的增删以及特征的修改,因此nettack在这两方面做了优化以使扰动不明显。对于图结构,使用似然比检验来估计干扰图和原始图的度分布是否源于同意分布,进而对结构的攻击进行限制;对于节点特征,通过特征共现性的思想,对于一个节点的特征,将随机游走一步能到达的特征视为不显著特征,以此对特征进行优化。

3、相比于图修改攻击,尽管节点注入攻击破坏性更强,更加适用于现实中的攻击场景,但研究发现现有方法注入的节点很容易与原始正常节点区分开来,增加了被防御方法识别的风险。对此,g-nia采用目标节点正确分类的节点表示和错误分类的节点表示来指导特征生成,并通过映射函数将网络输出映射到原图指定的特征空间来进行限制。tdgia使用clamp函数限制特征的边界,同时为了平滑优化过程,通过smoothmap函数将特征平滑地重新映射到界限范围内。

4、本章从模型的优化过程入手,提出了基于特征扰动对抗的隐蔽性图注入攻击。在通过代理模型训练的流程中,对攻击节点特征的更新迭代加以限制,将注入的节点伪装成正常节点,使防御方法不可察觉,在保留破坏性的同时让注入节点的特征与原始节点的特征相似。

技术实现思路

0、

技术实现要素:

1、(1)节点特征的反向传播

2、本节以常用的两层图卷积神经网络为例,介绍网络中如何通过反向传播更新节点特征,网络公式如下:

3、

4、

5、选取负对数似然函数作为损失函数,则

6、l=-log z (3)

7、随后,逐层进行传播。首先是损失函数对于z的梯度:

8、

9、其中,y是真实标签的one-hot编码。接着是第二层的反向传播:

10、

11、之后,是对第一层激活函数的处理:

12、

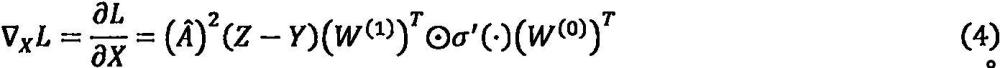

13、⊙表示逐元素乘法。relu激活函数的梯度σ′对于负输入为0,对于正输入为1。最后,是第一层反向传播对于x的梯度:

14、

15、其中,h(0)=x,表示模型开始输入的隐藏表示为x。

16、对上面的公式进行整理。以表示w(0),w(1)分别代表大小为d×f和f×k,d为特征的维度,f为中间层的维度,k为数据集的类别个数。对于relu激活函数的梯度σ′,设σ′(·)为n×f的矩阵,矩阵元素满足如下公式:

17、

18、综上,可以得到损失函数关于x微分:

19、

20、(2)基于欧式距离的攻击隐蔽性提升

21、前文提到,需要通过限制攻击节点的特征来实现隐蔽性的攻击,因此本节通过减小特征之间的距离来实现这一点。具体的,采用欧式距离来度量特征之间的相似性,即

22、

23、计算结果越小,说明两个节点的特征越相近。对于图对抗攻击的场景,对于每个攻击节点,计算其每个邻居与其特征的距离,从而用来评价注入特征的相似性,具体公式如下:

24、

25、其中,dv是节点v的度数,n(v)是节点v的邻居节点。dis用于表示攻击节点与其邻居节点的特征相似性,值越小,特征越相近。

26、本节在实际的攻击特征优化的过程中,通过dis修正特征的更新方向,使其贴近原有的邻居节点,但又不偏离整体的攻击方向。于是,本章通过添加对抗损失来实现这一点,具体公式如下:

27、latk=lnll+λc(g,g′) (12)

28、其中,c(g,g′)是基于欧氏距离相似性评分的正则化项,λ≥0为对应的权重。c(g,g′)的具体实现如下:

29、

30、接着继续解析c(g,g′)在如何在反向传播中微调特征,以单个攻击节点v举例。为了求出关于xv的梯度,首先对欧式距离的平方进行微分,之后再进行调整,欧几里得范数的平方为:

31、

32、该平方范数关于xv的导数为:

33、

34、输出结果是一个向量,其中每个分量都是平方差相对于xv的相应分量的导数。实际范数(非平方)的导数涉及将链式法则应用于平方根函数,公式如下:

35、

36、最终,可以得到欧式距离关于特征的梯度为

37、

38、(3)注入节点更新

39、至此,通过两节的公式推导,得出了在网络中节点特征的反向传播公式。依此,便能实现对于注入节点特征的迭代更新与微调,公式如下:

40、

41、其中,lr表示学习率,sign(·)用来判断元素符号,大于0返回1,等于0返回0,小于0返回-1。

42、(4)算法流程

43、选择某种节点注入方法进行攻击节点注入。

44、输入邻接矩阵a和特征矩阵x到模型m,得到模型输出pred。

45、通过pred计算损失lnll。

46、为每个节点计算其邻居节点关于特征的欧氏距离dis。

47、利用模型m通过lnll和dis优化注入节点的特征。

48、更新图。

- 还没有人留言评论。精彩留言会获得点赞!