一种破坏通道混合和令牌混合机制的对抗样本生成方法及其测试方法

本发明涉及属于计算机视觉领域中对抗机器学习技术,具体涉及一种破坏通道混合和令牌混合机制的对抗样本生成方法其测试方法。

背景技术:

1、卷积神经网络已经成为计算机视觉领域的事实标准,基于卷积神经网络的深度神经网络不断提高计算机视觉的分类性能,例如resnet、vgg、fasterrcnn、yolo等。然而随着自然语言处理领域中基于注意力的变压器的发展,出现了一些应用这种变压器结构的新模型,例如vit、t2t-vit等。这些模型的性能已经赶上cnn模型,正挑战着cnn的在计算机视觉领域中的位置。随着进一步研究,研究者发现卷积和注意力机制对于良好的性能不是唯一的,仅使用多层感知机也能实现良好的性能,因此提出了mlp-mixer。

2、众所周知,dnn存在安全隐患,容易受到对抗样本的攻击。攻击者向干净输入中添加精心设计且不宜察觉的扰动,导致模型输出错误的结果。由于dnns的潜在风险,了解最近提出的vit和mlp-mixer是否容易受到对抗攻击非常重要。 vit的对抗转移性已得到较为充分的研究,相比之下,mlp-mixer还没有在黑盒对抗背景下被仔细研究,目前尚未有关于针对mlp-mixer对抗攻击转移性的研究。本发明特别关注基于转移性的对抗攻击,研究如何提高mlp-mixer生成的对抗样本的转移性。

3、mlp-mixer与cnns的架构不同。mlp-mixer与vit类似,使用图片patch作为输入,但不使用任何卷积和注意力机制,取而代之的是,mlp-mixer的架构完全基于多层感知机(mlp)。mlp-mixer的mixer层包含两种类型的层,一种是混合空间位置信息,称为token-mixing mlps,一种是混合通道信息,称为channel-mixing mlps。来自不同patch和通道的信息能够充分混合,使mlp-mixer能够获取图像的主要信息。扰乱mlp-mixer 的信息混合机制,避免对抗样本对源模型过拟合,即可提高对抗样本跨架构的转移性。

4、本发明提出了一种新的转移性攻击,能够控制mlp-mixer每个mixer层的输入,打破mlp-mixer的通道混合和令牌混合机制。本发明能够遮蔽mixer层的部分输入,实现类似于dropout的效果,防止生成的对抗样本对mlp-mixer过拟合,提高对抗样本攻击目标模型的欺骗率。

技术实现思路

1、本发明的目的是针对现有技术存在的不足,通过使用ma能够遮蔽mixer层的部分输入,实现类似于dropout的效果,防止生成的对抗样本对mlp-mixer过拟合,提高对抗样本攻击目标模型的欺骗率,解决了现有技术在白盒mlp-mixer模型上生成的对抗样本转移性效果差,攻击未知结构黑盒模型成功率低等不足。

2、本发明所述的一种破坏通道混合和令牌混合机制的对抗样本生成方法包括如下步骤:

3、步骤1:针对mlp-mixer模型中的mixer层,对每个mixer层输入以概率p进行随机遮蔽,使mlp-mixer模型形成目标模型,攻击mlp-mixer的通道混合和令牌混合机制,防止生成的对抗样本对mlp-mixer过拟合;

4、步骤2:基于步骤1提出maxwell attack 对抗样本生成方法,具体包括如下步骤:

5、步骤2.1:以mixer-b/16、mixer-l/16、mixer-glu作为白盒替代模型;

6、步骤2.2:输入一张干净图片x和其真实标签y;

7、步骤2.3:设置对抗扰动的修改范围为,攻击迭代次数为t,攻击步长为;

8、步骤2.4:设置对mixer层输入进行随机遮蔽的概率阈值p;

9、步骤2.5:设置伯努利分布生成遮蔽矩阵m的概率值pm;

10、步骤2.6:设置损失函数,使用交叉熵作为损失函数;

11、步骤2.7:将图片x输入白盒替代模型mixer-b/16;

12、步骤2.8:与pgd对抗攻击方法相结合;

13、步骤2.9:根据步骤1获取所述目标模型输出,根据步骤2.6设置的损失函数计算损失值;

14、步骤2.10:根据损失值反向传播获取图像梯度;

15、步骤2.11:根据图像梯度更新图片x的像素值,并根据修改范围对图片x的像素进行裁剪;

16、步骤2.12:重复步骤2.9至2.11,直到迭代次数达到t,生成对抗样本;

17、步骤2.13:分别与mi-fgsm、di-fgsm、ti-fgsm对抗攻击方法相结合,重复步骤2.9至2.12;

18、步骤2.14:分别与攻击vit模型的对抗攻击方法self-ensemble和tokenrefinement相结合,重复步骤2.8至2.13;

19、步骤2.15:将图片x分别输入白盒替代模型mixer-l/16和mixer-glu,重复步骤2.8至2.14。

20、优选的,对mixer层输入进行随机遮蔽的形式包括如步骤:

21、步骤1:生成遮蔽概率p,p服从均匀分布;

22、步骤2:当p<p时,生成遮蔽矩阵m,遮蔽矩阵m与mixer层的输入大小一致,m是服从伯努利分布的01矩阵,其伯努利分布的概率值为pm;

23、步骤3:将mixer层的输入与遮蔽矩阵m进行元素相乘,对输入进行随机遮蔽,获得的结果输入到mixer层中;

24、步骤4:当p>p时,不对输入进行随机遮蔽,直接输入到mixer层中。

25、一种破坏通道混合和令牌混合机制的对抗样本测试方法:

26、基于maxwell attack 对抗样本生成方法生成的对抗样本在未知结构黑盒模型上进行攻击测试的步骤为:

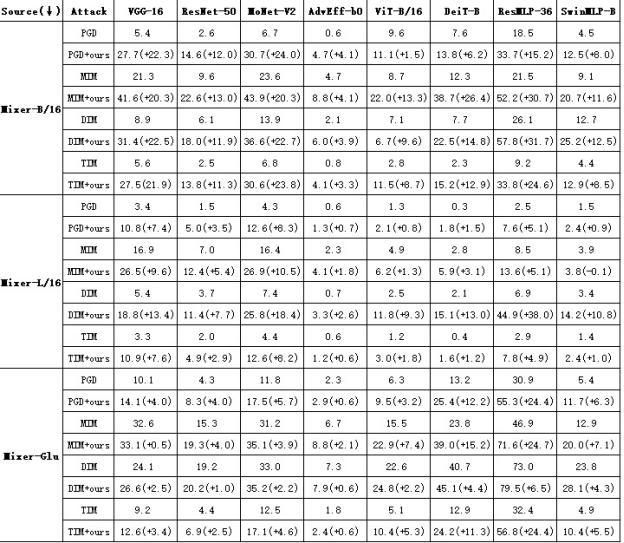

27、选用vgg-16、resnet-50、mobilenet-v2、advefficientnet-b0、vit-b/16、deit-b、resmlp-36、swinmlp-b作为黑盒未知结构模型,用于测试maxwell attack对抗样本生成方法生成的对抗样本在面对未知结构的黑盒模型的攻击成功率,测试模型包含vits、cnns、鲁棒性cnns和mlps等不同结构的神经网络模型,具体如下;

28、步骤1:使用生成的对抗样本和对应真实标签y,输入上述未知的识别模型上进行非靶向攻击实验;

29、步骤2:将生成的对抗样本和对应真实标签y送入vgg-16分类模型,将模型输出的结果与真实标签y作对别,如果预测标签与真实标签y不相同则说明攻击成功,相同则说明攻击失败;

30、步骤3:将生成的对抗样本和对应真实标签y送入resnet-50分类模型,将模型输出的结果与真实标签y作对别,如果预测标签与真实标签y不相同则说明攻击成功,相同则说明攻击失败;

31、步骤4:将生成的对抗样本和对应真实标签y送入mobilenet-v2分类模型,将模型输出的结果与真实标签y作对别,如果预测标签与真实标签y不相同则说明攻击成功,相同则说明攻击失败;

32、步骤5:将生成的对抗样本和对应真实标签y送入advefficientnet-b0分类模型,将模型输出的结果与真实标签y作对别,如果预测标签与真实标签y不相同则说明攻击成功,相同则说明攻击失败;

33、步骤6:将生成的对抗样本和对应真实标签y送入vit-b/16分类模型,将模型输出的结果与真实标签y作对别,如果预测标签与真实标签y不相同则说明攻击成功,相同则说明攻击失败;

34、步骤7:将生成的对抗样本和对应真实标签y送入deit-b分类模型,将模型输出的结果与真实标签y作对别,如果预测标签与真实标签y不相同则说明攻击成功,相同则说明攻击失败;

35、步骤8:将生成的对抗样本和对应真实标签y送入resmlp-36分类模型,将模型输出的结果与真实标签y作对别,如果预测标签与真实标签y不相同则说明攻击成功,相同则说明攻击失败;

36、步骤9:将生成的对抗样本和对应真实标签y送入swinmlp-b分类模型,将模型输出的结果与真实标签y作对别,如果预测标签与真实标签y不相同则说明攻击成功,相同则说明攻击失败。

37、有益效果在于:使用本发明所述技术方案,在白盒mlp-mixer模型上生成对抗样本,攻击其他不同结构、不同类型的神经网络可以大幅度提升黑盒攻击成功率。该方法与对抗攻击算法pgd、mim、dim和tim相结合,能够提高mixer-b/16生成的对抗样本在resmlp-36上20%左右的成功率,其中dim结合该方法后mixer-l16生成对抗样本在resmlp-36上能提高38.0%的成功率。

- 还没有人留言评论。精彩留言会获得点赞!