一种大模型联邦学习方法、装置、存储介质及电子设备与流程

本说明书涉及计算机,尤其涉及一种大模型联邦学习方法、装置、存储介质及电子设备。

背景技术:

1、联邦学习是一种常用的分布式机器学习方法,其能够使各参与方在不泄露原始数据的情况下,通过安全的机制交互模型参数,从而达到协同训练的效果。这种方法能有效帮助多个机构在保护私有数据的情况下进行神经网络模型的协同训练。

2、随着人工智能技术的不断发展,基于人工智能构建的大模型在各领域中的应用越来越广泛,例如大语言模型(large language model,llm)等生成式模型。由于大模型的参数量级非常庞大,通常在十亿以上,导致在联邦学习中频繁的模型参数交换过程会十分冗长且复杂,产生大量的成本。

3、因此,如何更加简单高效地实现大模型的联邦学习是一个亟待解决的问题。

技术实现思路

1、本说明书提供一种大模型联邦学习方法、装置、存储介质及电子设备,以至少部分地解决现有技术存在的上述问题。

2、本说明书采用下述技术方案:

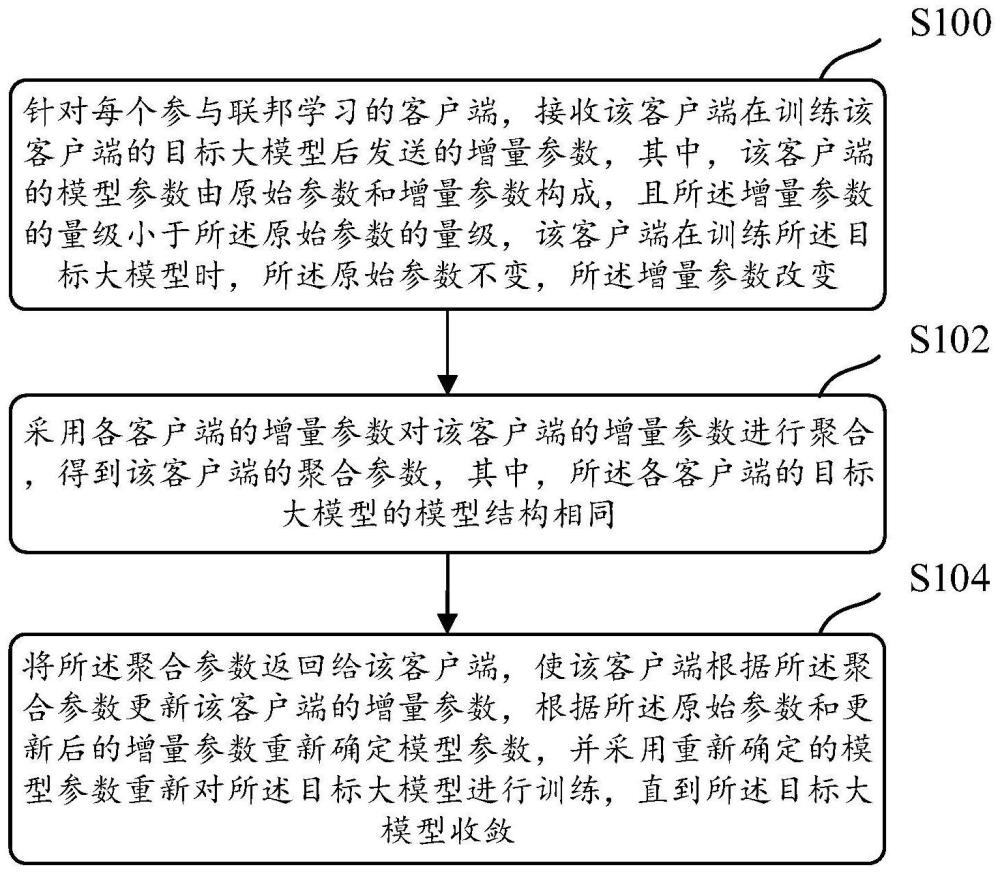

3、本说明书提供了一种大模型联邦学习方法,所述方法应用于服务端,包括:

4、针对每个参与联邦学习的客户端,接收该客户端在训练该客户端的目标大模型后发送的增量参数,其中,该客户端的模型参数由原始参数和增量参数构成,且所述增量参数的量级小于所述原始参数的量级,该客户端在训练所述目标大模型时,所述原始参数不变,所述增量参数改变;

5、采用各客户端的增量参数对该客户端的增量参数进行聚合,得到该客户端的聚合参数,其中,所述各客户端的目标大模型的模型结构相同;

6、将所述聚合参数返回给该客户端,使该客户端根据所述聚合参数更新该客户端的增量参数,根据所述原始参数和更新后的增量参数重新确定模型参数,并采用重新确定的模型参数重新对所述目标大模型进行训练,直到所述目标大模型收敛。

7、可选地,采用各客户端增量参数对该客户端的增量参数进行聚合,得到该客户端的聚合参数,具体包括:

8、确定该客户端的增量参数与每个客户端的增量参数之间的聚合权重;

9、根据所述聚合权重,采用各客户端的增量参数对该客户端的增量参数进行聚合,得到该客户端的聚合参数。

10、可选地,确定该客户端的增量参数与每个客户端的增量参数之间的聚合权重,具体包括:

11、确定各客户端在训练目标大模型时采用的训练样本的总数量;

12、将参与联邦学习的客户端确定为聚合客户端,并将该客户端确定为目标客户端;

13、针对每个聚合客户端,确定该聚合客户端在训练目标大模型时采用的训练样本的数量在所述总数量中的占比,并确定该聚合客户端的增量参数与所述目标客户端的增量参数之间的相似度;

14、根据所述占比与所述相似度,确定该聚合客户端与所述目标客户端之间的聚合权重。

15、本说明书提供了一种大模型联邦学习方法,所述方法应用于客户端,包括:

16、获取目标大模型,冻结所述目标大模型的原始参数,并初始化所述目标大模型的增量参数,其中,所述目标大模型的模型参数由所述原始参数与所述增量参数构成,所述增量参数的量级小于所述原始参数的量级;

17、对所述目标大模型进行训练,调整所述目标大模型的增量参数;

18、将所述增量参数发送给服务端,得到所述服务端返回的聚合参数,其中,所述聚合参数是所述服务端根据参与联邦学习的各客户端发送的增量参数进行聚合得到的;

19、根据所述聚合参数更新所述目标大模型的增量参数,根据所述原始参数和更新后的增量参数重新确定所述目标大模型的模型参数,并采用重新确定的模型参数重新对所述目标大模型进行训练,直到所述目标大模型收敛。

20、可选地,调整所述目标大模型的增量参数,具体包括:

21、采用正则化规则调整所述目标大模型的增量参数。

22、本说明书提供了一种大模型联邦学习装置,包括:

23、接收模块,用于针对每个参与联邦学习的客户端,接收该客户端在训练该客户端的目标大模型后发送的增量参数,其中,该客户端的模型参数由原始参数和增量参数构成,且所述增量参数的量级小于所述原始参数的量级,该客户端在训练所述目标大模型时,所述原始参数不变,所述增量参数改变;

24、聚合模块,用于采用各客户端的增量参数对该客户端的增量参数进行聚合,得到该客户端的聚合参数,其中,所述各客户端的目标大模型的模型结构相同;

25、返回模块,用于将所述聚合参数返回给该客户端,使该客户端根据所述聚合参数更新该客户端的增量参数,根据所述原始参数和更新后的增量参数重新确定模型参数,并采用重新确定的模型参数重新对所述目标大模型进行训练,直到所述目标大模型收敛。

26、可选地,所述聚合模块,具体用于确定该客户端的增量参数与每个客户端的增量参数之间的聚合权重;根据所述聚合权重,采用各客户端的增量参数对该客户端的增量参数进行聚合,得到该客户端的聚合参数。

27、可选地,所述聚合模块,具体用于确定各客户端在训练目标大模型时采用的训练样本的总数量;将参与联邦学习的客户端确定为聚合客户端,并将该客户端确定为目标客户端;针对每个聚合客户端,确定该聚合客户端在训练目标大模型时采用的训练样本的数量在所述总数量中的占比,并确定该聚合客户端的增量参数与所述目标客户端的增量参数之间的相似度;根据所述占比与所述相似度,确定该聚合客户端与所述目标客户端之间的聚合权重。

28、本说明书提供了一种大模型联邦学习装置,包括:

29、获取模块,用于获取目标大模型,冻结所述目标大模型的原始参数,并初始化所述目标大模型的增量参数,其中,所述目标大模型的模型参数由所述原始参数与所述增量参数构成,所述增量参数的量级小于所述原始参数的量级;

30、训练模块,用于对所述目标大模型进行训练,调整所述目标大模型的增量参数;

31、发送模块,用于将所述增量参数发送给服务端,得到所述服务端返回的聚合参数,其中,所述聚合参数是所述服务端根据参与联邦学习的各客户端发送的增量参数进行聚合得到的;

32、更新模块,用于根据所述聚合参数更新所述目标大模型的增量参数,根据所述原始参数和更新后的增量参数重新确定所述目标大模型的模型参数,并采用重新确定的模型参数重新对所述目标大模型进行训练,直到所述目标大模型收敛。

33、可选地,所述训练模块,具体用于采用正则化规则调整所述目标大模型的增量参数。

34、本说明书提供了一种计算机可读存储介质,所述存储介质存储有计算机程序,所述计算机程序被处理器执行时实现上述大模型联邦学习方法。

35、本说明书提供了一种电子设备,包括存储器、处理器及存储在存储器上并可在处理器上运行的计算机程序,所述处理器执行所述程序时实现上述大模型联邦学习方法。

36、本说明书采用的上述至少一个技术方案能够达到以下有益效果:

37、在本说明书提供的大模型联邦学习方法中,针对每个参与联邦学习的客户端,接收该客户端在训练该客户端的目标大模型后发送的增量参数,其中,该客户端的模型参数由原始参数和增量参数构成,且所述增量参数的量级小于所述原始参数的量级,该客户端在训练所述目标大模型时,所述原始参数不变,所述增量参数改变;采用各客户端的增量参数对该客户端的增量参数进行聚合,得到该客户端的聚合参数,其中,所述各客户端的目标大模型的模型结构相同;将所述聚合参数返回给该客户端,使该客户端根据所述聚合参数更新该客户端的增量参数,根据所述原始参数和更新后的增量参数重新确定模型参数,并采用重新确定的模型参数重新对所述目标大模型进行训练,直到所述目标大模型收敛。

38、在采用本说明书提供的大模型联邦学习方法执行针对大模型的联邦学习时,可令参与联邦学习的各客户端冻结目标大模型的原始参数,额外设置增量参数,并在训练目标大模型时仅调整增量参数;客户端每完成一次训练后,仅向服务端传输增量参数,并由服务端聚合各客户端的增量参数,得到各客户端的聚合参数;最终,服务端可向客户端返回聚合参数,客户端将聚合参数作为新的增量参数重新训练目标大模型,直到目标大模型收敛。采用本方法可有效减少联邦学习的过程中各客户端与服务端之间需要传输的数据量,在保证协同训练的效果的同时大幅提高联邦学习的效率。

- 还没有人留言评论。精彩留言会获得点赞!