一种基于多模态特征细化和融合的显著性物体检测方法

本技术涉及图像处理领域,具体涉及一种基于多模态特征细化和融合的显著性物体检测方法。

背景技术:

1、近年来,随着深度学习研究的日益加深,显著性目标检测sod得到了显著的改善,但在复杂场景中识别出显著物体,仍然具备以下问题:比如当目标和背景颜色相接近时,或者光照变化导致的场景过亮或过暗时,或者遇到透明物体的识别等复杂前景,仅仅依赖rgb图像实现准确的检测仍具备很大的挑战。受启发于人眼不仅能够感知场景中的颜色、形状、纹理等外观信息,还可以通过双目视觉系统捕获场景的深度信息,形成立体感,因此深度图作为深度信息的直观表达形式被引入rgb显著性目标检测进行信息补充。

2、在早期的工作中,rgb-d显著性目标检测任务的关注点是具有先验知识的手工深度特征,例如距离拍照相机更近会使得目标更加显著。这些方法通常使用以往使用过的基于对比度的网络框架进行不同规模的预测。尽管基于手工特征的rgb-d显著目标检测已经取得了很好的成果,但是在解决复杂的背景下的显著目标以及带有噪声的深度信息时,依然面对很大的挑战。

3、因基于手工特征的方法存在许多限制并且深度学习技术在提取复杂特征具有优越性,近年来已经有越来越多的rgb-d检测工作使用深度神经网络,尤其是卷积神经网络,其中包括单流rgb-d显著目标检测模型,双流rgb-d显著目标检测模型。因此仿照rgb显著目标检测,部分研究人员设计一些单流网络并取得了一定的效果。zhao j x等人在2019年发表的《contrast prior and fluid pyramid integration for rgbd salient objectdetection》文献中,为了增强rgb-d表示信息的能力,提出一种流体金字塔模块来将不同级别的特征通过大量的短连接结合起来,巧妙地将深度特征通过特征增强模块融合进所提出的单流网络中,但单流网络的结构决定了其局限性,深度图和rgb图形所包含的信息各有侧重并不能简单的进行整合。而双流网络可有效的进行信息的利用,使得特征提取更加充分。因此,双流网络使用的更为广泛。这意味着每个网络分支都将有一个对应的cnn并有一个对应的节点将其进行融合来得到最终的显著性预测。根据融合点的深度,双流网络包括三类,早期融合、末期融合以及多级融合。比如,qu l、he s和zhang j等人在2017年发表的《rgbdsalient object detection via deep fusion》文献中提出将来自rgb和深度信息流的低级特征融合起来作为训练使用的一个共享cnn,但由此带来的不足就是特征提取不充分且无法区分不同模态的特征。不同于早期融合机制,han j、chen h和liu n等人在2017年发表的《cnns-based rgb-dsaliency detection via cross-view transfer and multiviewfusion》”文献中提出了结合来自双流网络的特征来获取鲁棒的全局上下文信息,这种方法比早期融合能获得更好的目标定位,但是由于缺少浅层融合信息,因此得到的预测图较为粗糙。为了探索多层次的交叉跨模态特征,最近一些工作将注意力转移到设计多层次跨模态融合框架。

技术实现思路

1、本发明的目的在于,提供一种基于多模态特征细化和融合的显著性物体检测方法,缓解了现有rgb-d显著性检测方法中存在的目标边缘检测模糊及内部检测不完整的问题,并且能够有效对特征进行增强并将增强后的特征进行充分融合,缓解了现有模型在特征提取阶段所提取到特征模态单一以及包含过多非显著特征的问题。

2、本发明采取的技术方案是:一种基于多模态特征细化和融合的显著性物体检测方法,包括如下步骤:

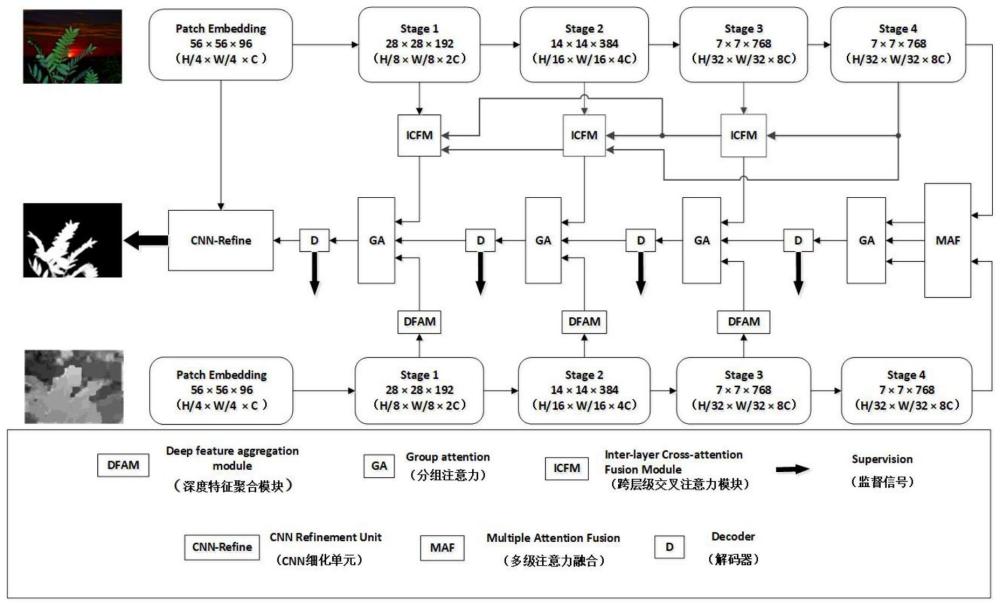

3、s1:构建显著性物体检测模型,所述显著性物体检测模型包括swin-transformer主干网络、跨层级交叉注意力融合模块icfm、深度特征聚合模块dfam、多级注意力机制模块maf、分组注意力单元ga和解码器;

4、所述swin-transformer主干网络包括rgb分支和depth分支,所述rgb分支和所述depth分支均包括补丁嵌入模块patch embedding和n个阶段stage,其中,rgb分支用于提取输入图像不同阶段的rgb特征fr,depth分支用于提取输入图像不同阶段的深度特征fd;

5、所述跨层级交叉注意力融合模块icfm设置有n-1个,所述rgb分支中前n-1个阶段stage提取的不同阶段的rgb特征fr分别输入n-1个跨层级交叉注意力融合模块icfm中进行特征细化,生成多分辨率特征fmr;

6、所述深度特征聚合模块dfam设置有n-1个,所述depth分支中前n-1个阶段stage提取的不同阶段的深度特征fd分别输入n-1个深度特征聚合模块dfam中进行增强,生成增强特征yd;

7、所述多级注意力机制模块maf用于对所述rgb分支中第n个阶段stage提取的rgb特征fr,n和所述depth分支中第n个阶段stage提取的深度特征fd,n进行互补性融合,生成注意力增强特征h,增强特征高层语义的表达能力;

8、所述分组注意力单元ga设置有n个,所述分组注意力单元ga用于融合对应阶段的rgb特征fr和深度特征fd,生成跨模态特征,并由解码器进行处理,生成当前阶段的解码特征并输入至下一阶段的分组注意力单元ga中指导下一阶段的rgb特征和深度特征进行交互融合;其中,第n个阶段分组注意力单元ga的输入为所述多级注意力机制模块maf的输出,其余n-1个阶段的分组注意力单元ga的输入为对应阶段的多分辨率特征fmr和增强特征yd以及解码器输出的上一阶段的解码特征;

9、s2:对所述显著性物体检测模型进行训练,使用训练完毕的显著性物体检测模型对输入图像进行检测,由解码器输出各个阶段的解码特征;

10、s3:使用cnn细化单元提取输入图像中rgb图像的边缘特征,并与所述第n个阶段的解码特征通过注意力进行融合,将融合后特征回归为显著性物体图像,生成预测显著图。

11、进一步地,将三个连续阶段的rgb特征fr,i、fr,i+1和fr,i+2耦合为两组,其中,第一组为第i个阶段的rgb特征fr,i和第i+1个阶段的rgb特征fr,i+1,第二组为第i+1个阶段的rgb特征fr,i+1和第i+2个阶段的rgb特征fr,i+2,i=1,2,…,n,并将两组配对的rgb特征输入第i个跨层级交叉注意力融合模块icfm;每组配对的rgb特征中阶段较高的rgb特征进行两次复制,分别嵌入为键向量k和值向量v,阶段较低的rgb特征进行一次复制,嵌入为查询向量q;对每组键向量k、查询向量q和值向量v进行标准比例的点积注意力运算和线性投影来产生注意力特征ca;将两个注意力特征ca在通道和空间分辨率上进行转换,然后添加到阶段较低的rgb特征中,生成融合特征z;使用改进resnet模块对融合特征z进行特征增强,生成多分辨率特征fmr,所述改进resnet模块包括层归一化、两个连续的线性层mlp和残差连接。

12、进一步地,第i个跨层级交叉注意力融合模块icfm的特征处理过程的具体表达式为:

13、qi=wqfr,i;

14、ki+1=wkfr,i+1;

15、vi+1=wvfr,i+1;

16、

17、

18、

19、其中,qi表示第i个阶段的rgb特征fr,i复制后对应的查询向量,wq表示对应于查询向量q的权重矩阵,ki+1表示第i+1个阶段的rgb特征fr,i+1复制后对应的键向量,wk表示对应于键向量k的权重矩阵,vi+1表示第i+1个阶段的rgb特征fr,i+1复制后对应的值向量,wv表示对应于值向量v的权重矩阵,cai表示查询向量qi、键向量ki+1和值向量vi+1运算所得的注意力特征,dm表示查询向量qi、键向量ki+1和值向量vi+1的维度,表示键向量ki+1的转置,linear表示线性操作,softmax表示激活函数操作,zi表示第i个跨层级交叉注意力融合模块icfm生成的融合特征,u2表示倍率为2的上采样操作,u4表示倍率为4的上采样操作,fimr表示第i个跨层级交叉注意力融合模块icfm生成的多分辨率特征,mlp表示两个连续的线性层操作,ln表示层归一化操作,表示相加操作。

20、进一步地,所述深度特征聚合模块dfam将对应阶段的深度特征经过膨胀卷积层扩大感受野,生成膨胀卷积特征xdconv,同时将对应阶段的深度特征通过卷积后在通道维度上切割为n个分组特征x,并将所述分组特征x进行卷积操作,并在卷积过程中将相邻结果进行融合,生成n个卷积融合特征y,将n个卷积融合特征y进行卷积操作生成特征y’,最后将膨胀卷积特征xdconv、对应阶段的深度特征和特征y’融合生成增强特征yd。

21、进一步地,第i个深度特征聚合模块dfam的特征处理过程的具体表达式为:

22、x'=conv(fd,i);

23、xj=split(x',n);

24、

25、y'=c(concat(yj)) 1≤j≤n;

26、xdconv,i=dconv(fd,i);

27、

28、其中,fd,i表示第i个阶段的深度特征,c表示1×1卷积操作,x'表示第i个阶段的深度特征fd,i经过卷积之后得到的特征,split表示在通道维度上对特征进行切割,n表示切割的份数,xj表示第j个分组特征,yj表示第j个卷积融合特征,c3×3表示3×3的卷积操作,y'表示n个卷积融合特征yj进行卷积操作后生成特征,concat表示通道维度的叠加操作,xdconv,i表示第i个阶段的深度特征fd,i经过膨胀卷积操作得到的膨胀卷积特征,dconv表示膨胀卷积操作,表示相加操作。

29、进一步地,所述多级注意力机制模块maf包括两个注意力融合模块afm和一个多模态融合模块mfm;所述注意力融合模块afm包括空间注意力机制、通道注意力机制和一个跨层级交叉注意力融合模块icmf,两个注意力融合模块afm分别对第n个阶段的rgb特征fr,n和第n个阶段的深度特征fd,n进行增强,生成rgb注意力融合特征gr和深度注意力融合特征gd,将rgb注意力融合特征gr和深度注意力融合特征gd相加得到注意力融合特征grd,并将rgb注意力融合特征gr、深度注意力融合特征gd和注意力融合特征grd输入多模态融合模块mfm;

30、所述多模态融合模块mfm根据rgb注意力融合特征gr、深度注意力融合特征gd和注意力融合特征grd生成混淆矩阵hy,并将混淆矩阵hy分别与rgb注意力融合特征gr和深度注意力融合特征gd进行运算,生成rgb注意力增强特征hr和深度注意力增强特征hd。

31、进一步地,所述多级注意力机制模块maf的特征处理过程的具体表达式为:

32、

33、

34、

35、

36、

37、

38、其中,gr表示rgb注意力融合特征,gd表示深度注意力融合特征,grd表示注意力融合特征,sa表示空间注意力机制操作,ca表示通道注意力机制操作,conv表示卷积操作,hy表示混淆矩阵,r表示形状重塑,c表示1×1卷积操作,hr表示rgb注意力增强特征,hd表示深度注意力增强特征。

39、进一步地,在解码器的解码过程和cnn细化单元生成预测显著图的过程中引入损失函数作为监督信号,以二元交叉熵损失作为损失函数,测量结构相似性的ssim损失以及iou损失,具体计算公式为:

40、

41、lmixture(s,gt)=lbce(s,gt)+lssim(s,gt)+liou(s,gt);

42、其中,ltotal表示整体损失,lmixture表示ssim损失以及iou损失的组合,s表示最终的预测显著图,gt表示人工标注的正确标签,sm表示第m个阶段的预测显著图,gtm表示第m个阶段经过下采样之后的正确标签,m=1,2,…,n,lbce表示bce损失,lssim表示ssim损失,liou表示iou损失。

43、进一步地,所述cnn细化单元运用vgg网络主干的前两层提取输入图像中rgb图像的边缘特征。

44、本发明的有益效果在于:

45、(1)本发明通过跨层级交叉注意力融合模块icfm和深度特征聚合模块dfam分别对rgb特征和深度特征进行细化增强;跨层级交叉注意力融合模块icfm利用来自上层的语义来指导低级特征的生成,使用交叉注意力操作来融合多分辨率特征,并沿着自上而下的路径逐步传播更高层次的语义信息,从而可以有效地抑制背景中的冗余特征并强调显著区域;深度特征聚合模块dfam通过膨胀卷积和分组卷积以及残差网络的思想,对传入的特征进行通道维度的分割并将分割之后的特征进行卷积,在卷积过程中将相邻的结果进行融合获得包含多尺度信息的特征,最后将包含多尺度信息的特征与膨胀卷积特征以及原特征进行融合,可以有效的获取多尺度特征以及得到更大的感受野,达到强化显著特征的目的;

46、(2)本发明通过所述多级注意力机制模块maf对rgb特征和深度特征进行互补性融合,生成注意力增强特征,增强特征高层语义的表达能力,能够更有效地将编码器特征传输到解码器级,并在此过程中细化输入特征和抑制特征的噪声;

47、(3)本发明使用分组注意力单元ga对每个位置的交互过程提供全局指导,通过分组注意力单元ga内部的掩码来抑制处于不同的尺度和来自不同的模态特征进行交互时产生的负面影响,使得两个模态的特征信息可以在显著性引导向量的引导下进行充分的交互,生成更加精准的预测显著图。

- 还没有人留言评论。精彩留言会获得点赞!