一种基于时域滤波神经辐射场的稀疏图像视图合成方法

本发明属于计算机视觉和三维场景理解领域,具体为一种基于时域滤波神经辐射场的稀疏图像视图合成方法。

背景技术:

1、稀疏图像视图合成是三维视觉领域一项重要的任务,旨在从给定的一组图像中,合成一个新的视图或图像的技术过程。稀疏视图合成的主要挑战在于如何使用有限的数据来合理地推断和填充视图之间的空白区域。

2、现有技术区别如下:

3、与专利cn114241113a“一种基于深度引导采样的高效神经辐射场渲染方法”的技术对比中

4、1.专利cn114241113a中,设计一种深度引导特征,在目标视图前,采样若干深度平面,利用提取到的图片特征在每个深度平面上构建以方差为代价的代价体;利用基于3d卷积的神经网络处理代价体获取概率体,并得到每一个像素上的深度。

5、2.在本专利中,设计一种深度先验特征,在训练前通过预训练深度模型引入额外的约束条件,增强了网络在处理稀疏输入图像时的泛化性,从而显著提高了在新视角下合成视图的质量,减少了伪影的产生。

6、3.专利cn114241113a中,使用深度误差公式在训练过程中引导神经网络训练。在其深度可能所处的区间[d(u,v)-d(u,v),d(u,v)+d(u,v)],采样nk{xk∣k=1,…,nk},k取值为2~8,其中xk为目标视图标准化设备坐标空间的坐标。

7、4.在本专利中,使用基于排序的深度比较公式m1表示对于深度误差的余量,在比较公式中,随机抽取深度图d2上的两个深度像素,记为dk12,dk22,dk12<dk22,如果d1与d2的深度排序不一致,则对神经辐射场施加惩罚,通过该方式约束神经辐射场估计的相对深度排序与预训练模型的深度排序结果一致,从而将预训练模型的深度先验蒸馏到神经辐射场中。

8、与专利cn116957931a“一种基于神经辐射场的相机图像画质提升方法”的技术对比中

9、1、专利cn116957931a中,利用高清图像先验数据进行超分重建网络预训练,预训练所需的高清图像不仅仅局限于好相机所拍摄的图像,也可以从其他地方获取,输入和输出均为高分辨率图像,通过transformer编码器进行特征提取和编码,获得稀疏特征codebook,将codebook再经过transformer解码器重构出高清图像;

10、2、在本专利中,设计一种深度先验特征,在训练前通过预训练深度模型引入额外的约束条件,增强了网络在处理稀疏输入图像时的泛化性,从而显著提高了在新视角下合成视图的质量,减少了伪影的产生。

11、3、专利cn116957931a中,,基于步骤预训练获得的稀疏特征和解码器部分的网络权重将被冻结,该部分需训练transformer的编码器结构,步骤s4所需的训练数据来源于步骤s1和步骤s2,输入为低清图像,输出为与之对应高清图像,使通过低清图像获得的稀疏编码本,与通过高清图像获得的稀疏编码本误差最小,实现低清图像到高清图像的画质提升

12、4、在本专利中,使用基于排序的深度比较公式m1表示对于深度误差的余量,在比较公式中,随机抽取深度图d2上的两个深度像素,记为dk12,dk22,dk12<dk22,如果d1与d2的深度排序不一致,则对神经辐射场施加惩罚,通过该方式约束神经辐射场估计的相对深度排序与预训练模型的深度排序结果一致,从而将预训练模型的深度先验蒸馏到神经辐射场中。

技术实现思路

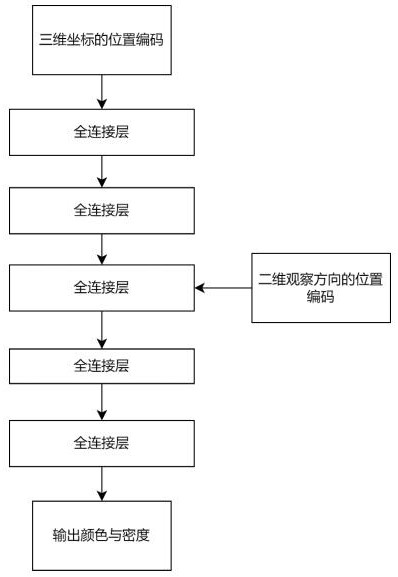

1、为解决上述技术问题,本发明提出了一种基于时域滤波神经辐射场的稀疏图像视图合成方法,本方法使用了一种基于时域滤波的去噪方案,用于减少在稀疏输入下合成新视图的噪声,提高渲染质量,且为了提高神经辐射场的几何提取能力,本方法引入了深度先验网络,并增加了帧间几何一致性损失。

2、为实现上述目的,本发明采取的技术方案是:

3、一种基于时域滤波神经辐射场的稀疏图像视图合成方法,包括预处理阶段、神经辐射场训练阶段和渲染阶段,其特征在于,各阶段如下:

4、1)预处理阶段:

5、对输入的相关rgb图像进行一系列处理,得到场景的外观信息和深度几何信息,再通过运动恢复结构算法来获取图像对应的相机位姿;

6、2)神经辐射场训练阶段:

7、通过基于约束的神经辐射场模型,解决因输入数据稀疏而导致的网络约束不足问题,通过引入额外的约束条件,增强了网络在处理稀疏输入图像时的泛化性;

8、3)渲染阶段:

9、使用基于时域滤波的神经辐射场模型,解决由于多层感知机表示的神经辐射场渲染开销大,无法通过超采样的方式降低合成图像的锯齿噪声问题,通过在时域内应用滤波技术,有效分摊超采样所需的计算负担到连续的帧上,从而在不增加额外的网络推理次数的前提下,显著提升了合成图像的质量,并有效减少了噪声与锯齿现象。

10、进一步,步骤1)预处理阶段具体包括如下步骤:

11、步骤1.1:深度先验获取,将rgb图像输入现有的深度估计网络depth-anything获得相对于的深度估计图像d;

12、步骤1.2:对应搜索,在输入图像i={ii|i=1...ni}中识别场景重叠中相同点投影,并输出一组经过几何验证的图像对c和每个点的图像投影图;

13、步骤1.3:增量重建,将步骤1.2输入场景图处理为为对应图像的相机姿态估计p={pc∈se(3)|c=1...np}和一组稀疏的场景重建点云x={xk∈r3|k=1...nx}。

14、进一步,所述预处理阶段步骤1.2中:

15、实施了一种特征提取方法:对于每个图像ii,通过sfm算法检测一组位于xj∈r2的局部特征集合fi={(xj,fj)|j=1...nfi},通过外观描述符fi表示,这些特征应该在辐射度和几何变化下保持不变,这样sfm才能在多个图像中唯一识别它们;

16、通过比较特征的外观描述fj来确定特征对应关系,为图像ib中的每个特征在图像ia中寻找最匹配的特征,再通过对潜在重叠的图像对集合c进行确认,由于匹配仅基于外观,不能保证结构的一致性,因此通过投影几何估计特征点之间的映射关系作为验证标注,不同的映射根据图像对的空间配置描述了它们的几何关系,单应性变换矩阵h描述了相机捕捉景时物体在世界坐标系和像素坐标系之间的位置映射关系;对极几何使用已标定的本质矩阵e或未标定的基础矩阵f来描述移动下不同视角的相机关系如果一个变换在不同图像间映射了足够数量的特征点,则认为这些特征点在几何上得到了验证。

17、进一步,所述预处理阶段步骤1.3中:

18、通过两张经过特别选择的图像来构建初始化模型,选择能看到最多三角化点的图像,目的是为了最小化相机重建中的不确定性,当新图像从另一角度捕捉到场景的同时,利用三角测量来确认新的场景点xk,并将其整合入场景点集x。

19、进一步,步骤2)神经辐射场训练阶段具体包括如下步骤:

20、步骤2.1:利用单目深度先验作为在输入视点下基于排序的深度先验,计算排序损失,蒸馏预训练模型中的几何提取能力,对于一个相机位姿为p的rgb图像i,首先通过神经辐射场从相机位姿p出发,渲染出深度图dnerf并随机选取局部区域d1,同时将图像i送入depth anything生成预估深度图dda并选择相同的局部区域d2,设k1,k2为深度图像上的两个2d坐标;

21、步骤2.2:如果相邻的深度像素在depth anything提供的深度图中体现为连续,那么将这种连续性的约束应用于nerf对应的深度像素,从而保证其连续性,knn(·)为最邻近函数,对于当前像素k1,用于返回在depth anything的深度图上已k1为中心某个小区域k个最邻近深度值,公式如下;

22、

23、步骤2.3:未知视点相机姿态生成,认为已知视点相机位姿空间限制了未知视点相机空间,所从已知视点相机位姿空间中推断未知视点相机位姿空间,并在该空间中采样,生成未知视点相机位姿,公式如下;

24、punknown={[r|t]|r~runknown|t,t~tunknown}

25、步骤2.4:重要性采样,采用多维高斯分布采样,即为只需要在训练前计算一次每场输入图像的相机视锥体,计算出重叠次数最多的中心区域,该区域认为是需要重建物体的重点区域,采样公式如下;

26、

27、步骤2.5:未知视点局部几何光滑性约束,在未知视点v∈punknown计算出该视点下深度图dv,然后计算局部几何光滑性约束损失,其中rv表示在该视点下的相机向场景投射的集合,patch为局部大小,公式如下。

28、

29、步骤2.6:未知视点局部颜色正则化,对于未知视点v′∈punknown,计算该视点下神经辐射场生成的图像块的似然估计,并在训练阶段最大化该似然估计,公式如下;

30、

31、进一步,步骤3)渲染阶段具体包括如下步骤:

32、步骤3.1:生成低差异序列,在神经辐射场中,对于每一帧中来说,每个像素只能有一根光线进行采样着色,为了对每一帧的所有像素生成不同的光线样本,需要在相机投影矩阵中添加一个视口子像素偏移,而每帧的偏移通常是从一个均匀分布的采样序列中生成,从而可以让每个像素被多帧中生成的样本均匀覆盖,在渲染中,为了让时域滤波累积结果尽快收敛,该序列必须有这样的性质:序列中任意长度的子序列都必须在像素上均匀分布;

33、步骤3.2:像素坐标重投影,在神经辐射场渲染中,由于帧与帧之间相机位置在发生变动,当前像素对应的三维点在上一帧中会有不同的像素坐标,所以需要对每个像素计算在上一帧中的对应位置来获得历史数据;

34、步骤3.3:颜色重采样,通过双线性插值来重采样;

35、步骤3.4:颜色混合,将每个像素的累积样本加权平均存储为单个颜色,这既是当前帧的输出,也是下一帧的历史输入结果,公式如下。

36、

37、进一步,所述渲染阶段步骤3.2中:

38、通过从深度缓冲区重建每个像素在裁剪空间三维坐标,并通过当前帧与上一帧的相机投影矩阵mn和mn-1来计算,公式如下。

39、

40、对于神经辐射场体渲染中,考虑第i帧像素点p采样光线ri(p),经过mlp网络计算一系列的采样点,其三维空间坐标为:

41、

42、且对应的权重为:

43、

44、计算获得该像素值神经辐射场深度z,通过该深度重建裁剪空间三维坐标:

45、

46、然后计算获得上一帧对应像素点坐标。

47、本发明与现有技术相比,其显著优点在于:

48、本发明公开了一种基于时域滤波神经辐射场的稀疏图像视图合成方法,本方法创新性引入一种时域滤波的神经辐射场模型,旨在解决由于多层感知机表示的神经辐射场渲染开销大,无法通过超采样的方式降低合成图像的锯齿噪声等问题,通过在时域内应用滤波技术,有效分摊超采样所需的计算负担到连续的帧上,从而在不增加额外的网络推理次数的前提下,显著提升了合成图像的质量,并有效减少了噪声与锯齿现象。此外为了提高神经辐射场的几何提取能力,方法引入了深度先验网络,并设计了帧间几何一致性损失,增强神经辐射场在多视图上的表达能力,提高网络的泛化性能。

- 还没有人留言评论。精彩留言会获得点赞!