基于深度空间变换的注视目标估计方法及相关装置

本发明属于图像处理领域,涉及一种基于深度空间变换的注视目标估计方法及相关装置。

背景技术:

1、人类注视行为表明其视觉注意力,反映个人感兴趣的目标。人类具有非凡的能力来理解他人的注视方向,了解是否被注视,或跟随他人的注视方向来识别他们的目标,确定他人的注意力。研究注视行为有助于理解个人意图,预测行为,乃至预测人们互动。注视目标估计在实际应用中是推断场景中的人在某时刻或某段时间感兴趣的目标注视目标。在人类交互系统,计算机视觉和机器人技术以下领域中具有重要应用,其中重要的是理解感兴趣的对象,进一步预测其关注对象。

2、在线下课堂双视角场景中的注视目标估计,存在不同坐标系下的视角深度信息,导致图像难对齐,无法充分利用深度信息,传统学生注视显著性区域检测算法对多人多物教室环境全局上下文建模能力弱,线下课堂中学生的注视目标估计准确率收到了严重影响。注视目标估计解决方案中,中国专利申请cn111723707a,公开了一种基于视觉显著性的注视点估计方法及装置,使用最小二乘算法对预测的注视点进行校正,输出最终注视点;中国专利申请cn110780739a,公开了一种基于注视点估计的眼控辅助输入方法,利用眼睛注视实现对目的词语的选择,但是他们均并没有考虑图像深度信息。因此,为了更加准确地对注视目标进行估计,需要解决不同视角图像对齐、深度信息丢失等问题。

3、对于不同视角图像对齐,现有研究多采用仿射变换的方法对两个视角进行图像坐标系对齐,再进行跨视角的注视目标估计。然而,直接坐标转换方法具有以下缺点,一是真实线下课堂的3d空间环境投影到2d图像上时会丢失深度信息,导致特征维度丢失问题,图像中出现的对象较多时,无深度信息的2d图像易出现互相遮挡,畸变等问题,后续模型无法正确建模实际对象,导致不同视角下学生和感兴趣目标的估计性能较差。二是传统显著性检测算法对于教室场景中人/物复杂的情况,全局上下文建模能力弱、结构信息缺失,对于人/物复杂的教室场景中小目标显著性检测困难,无法准确对学生注视的显著性区域进行预测。

技术实现思路

1、本发明的目的在于克服上述现有技术的缺点,提供一种基于深度空间变换的注视目标估计方法及相关装置。

2、为达到上述目的,本发明采用以下技术方案予以实现:

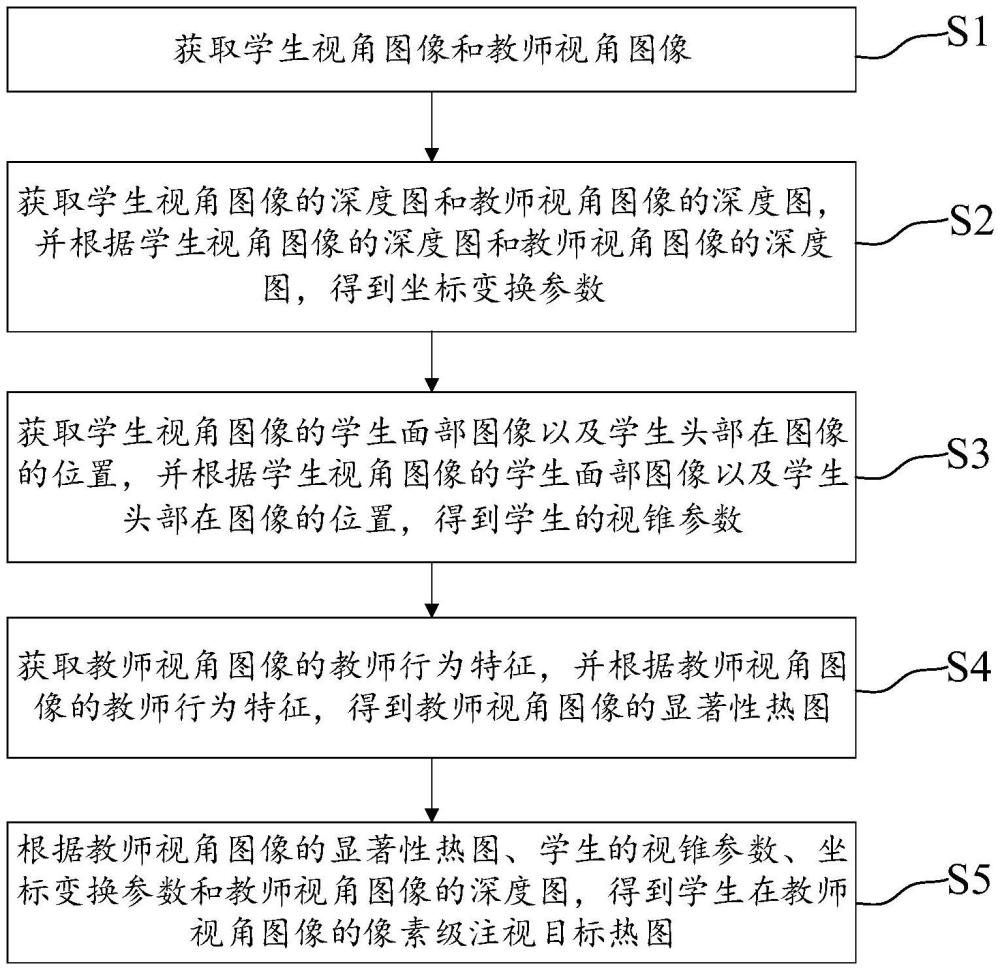

3、本发明第一方面,提供一种基于深度空间变换的注视目标估计方法,包括:

4、获取学生视角图像和教师视角图像;

5、获取学生视角图像的深度图和教师视角图像的深度图,并根据学生视角图像的深度图和教师视角图像的深度图,得到坐标变换参数;

6、获取学生视角图像的学生面部图像以及学生头部在图像的位置,并根据学生视角图像的学生面部图像以及学生头部在图像的位置,得到学生的视锥参数;

7、获取教师视角图像的教师行为特征,并根据教师视角图像的教师行为特征,得到教师视角图像的显著性热图;

8、根据教师视角图像的显著性热图、学生的视锥参数、坐标变换参数和教师视角图像的深度图,得到学生在教师视角图像的像素级注视目标热图。

9、可选的,所述获取学生视角图像的深度图和教师视角图像的深度图包括:

10、根据学生视角图像和教师视角图像,采用基于左右一致性的深度估计方法,获取学生视角图像的深度图和教师视角图像的深度图。

11、可选的,所述根据学生视角图像的学生面部图像以及学生头部在图像的位置,得到学生的视锥参数包括:

12、将学生视角图像的学生面部图像以及学生头部在图像的位置输入至预训练的多层感知机模型,得到学生的视锥参数;

13、其中,预训练的多层感知机模型基于训练数据,通过训练方式实现学生视角图像的学生面部图像以及学生头部在图像的位置与学生的视锥参数之间的映射;

14、其中,学生的视锥参数以学生眼部中心为圆锥体坐标顶点。

15、可选的,所述获取教师视角图像的教师行为特征,并根据教师视角图像的教师行为特征,得到教师视角图像的显著性热图包括:

16、通过若干个卷积层提取教师视角图像的特征图;

17、根据教师在教师视角图像中的位置,从教师视角图像的特征图对应位置进行裁剪,再通过全局池化层和全连接层得到教师视角图像的教师行为特征表示向量;

18、将教师的行为特征表示向量同教师视角图像的特征图进行逐元素相乘操作后,通过softmax层进行处理,获得教师视角图像的显著性热图。

19、可选的,所述根据教师视角图像的显著性热图、学生的视锥参数、坐标变换参数和教师视角图像的深度图,得到学生在教师视角图像的像素级注视目标热图包括:

20、根据坐标变换参数,将学生的视锥参数对齐到教师视角图像中,得到学生的对齐视锥参数;以及根据学生的对齐视锥参数、教师视角图像的显著性热图以及教师视角图像的深度图,通过预训练的编码器-解码器模型,得到学生在教师视角图像的像素级注视目标热图。

21、可选的,所述根据学生的对齐视锥参数、教师视角图像的显著性热图以及教师视角图像的深度图,通过预训练的编码器-解码器模型,得到学生在教师视角图像的像素级注视目标热图包括:

22、根据学生的对齐视锥参数得到学生注视目标的可能区域热图;

23、将教师视角图像的显著性热图与学生注视目标的可能区域热图进行逐元素相乘操作,得到学生注视热图;

24、将学生注视热图与教师视角图像的深度图进行结合,并通过编解码操作得到学生在教师视角图像的像素级注视目标热图。

25、可选的,所述编码器-解码器模型在编码器阶段使用两个1×1的卷积层进行降维,并采用relu函数确保编码的非线性;所述编码器-解码器模型在解码器阶段使用四个3×3的反卷积层来进行上采样。

26、本发明第二方面,提供一种基于深度空间变换的注视目标估计系统,包括:

27、图像获取模块,用于获取学生视角图像和教师视角图像;

28、深度模块,用于获取学生视角图像的深度图和教师视角图像的深度图,并根据学生视角图像的深度图和教师视角图像的深度图,得到坐标变换参数;

29、学生注视模块,用于获取学生视角图像的学生面部图像以及学生头部在图像的位置,并根据学生视角图像的学生面部图像以及学生头部在图像的位置,得到学生的视锥参数;

30、显著性模块,用于获取教师视角图像的教师行为特征,并根据教师视角图像的教师行为特征,得到教师视角图像的显著性热图;

31、注视目标估计模块,用于根据教师视角图像的显著性热图、学生的视锥参数、坐标变换参数和教师视角图像的深度图,得到学生在教师视角图像的像素级注视目标热图。

32、本发明第三方面,提供一种计算机设备,包括存储器、处理器以及存储在所述存储器中并可在所述处理器上运行的计算机程序,所述处理器执行所述计算机程序时实现上述基于深度空间变换的注视目标估计方法的步骤。

33、本发明第四方面,提供一种计算机可读存储介质,所述计算机可读存储介质存储有计算机程序,所述计算机程序被处理器执行时实现上述基于深度空间变换的注视目标估计方法的步骤。

34、与现有技术相比,本发明具有以下有益效果:

35、本发明基于深度空间变换的注视目标估计方法,首先根据学生视角图像的深度图和教师视角图像的深度图得到坐标变换参数,根据学生视角图像的学生面部图像以及学生头部在图像的位置得到学生的视锥参数,根据教师视角图像的教师行为特征得到教师视角图像的显著性热图,然后结合教师视角图像的显著性热图、学生的视锥参数、坐标变换参数和教师视角图像的深度图,得到学生在教师视角图像的像素级注视目标热图,实现学生的注视目标估计。该方法结合双视角深度空间变换,并通过对显著性、凝视姿势和两种视图角之间几何关系的联合估计,实现学生与被观测物体不在同一视角图像情况下注视目标的估计,解决了线下课堂目标估计中的深度信息缺失、双视角坐标系不对齐和对多人多物教室环境全局上下文建模能力不足等问题,比现有方法能够更好地跟踪注视目标,对教育分析、机器人及计算机视觉等领域具有重大的工业应用价值。

- 还没有人留言评论。精彩留言会获得点赞!