基于衰减噪声扰动的自适应保隐私分布式学习方法及装置

本发明属于分布式机器学习的,更具体地,涉及一种基于衰减噪声扰动的自适应保隐私分布式学习方法及装置。

背景技术:

1、随着人工智能技术的快速发展和广泛应用,机器学习已经成为解决各种复杂问题的有力工具,大量的个人数据被用于训练和优化机器学习模型。但随着数据量和模型的复杂性不断增加,人们需要更强大的计算资源来进行模型训练。分布式机器学习允许在多个计算节点上同时进行模型训练,所以它是一种能够满足大规模数据处理和复杂模型训练需求的方法。

2、然而,由于个人数据往往包含敏感信息,如身份信息和医疗档案等,使用传统的分布式模型训练方法可能会面临隐私泄露的风险,对于用户而言,随着数据的共享和分析,个人隐私面临着越来越大的风险。

3、在实践中,分布式机器学习中涉及的计算节点通常会维持其本地数据的隔离,仅通过共享模型参数或梯度等信息来实现合作。然而,这种信息共享存在着潜在的数据隐私泄露风险,因为恶意方可利用这些信息推断出原始数据的敏感性。尽管这种方法在一定程度上有助于保护用户隐私,但攻击者可能仍能利用共享的模型参数或梯度推断出原始数据,从而带来潜在的隐私泄露风险。因此,如何在数据共享和隐私保护之间取得平衡成为一项重要的研究课题。

4、中国专利文献cn116911382a公开一种资源有限联邦边缘学习中的异步聚合与隐私保护方法,该方法通过改进延迟补偿机制,对模型陈旧度阈值范围内的模型参数进行延迟补偿,衰减系数采用一种钟形曲线函数,陈旧度越大衰减越快;对超过陈旧度阈值的客户端,则强制与当前全局参数进行同步,进入下一轮次本地训练。

5、中国专利文献cn115983598a公开一种基于分布式深度强化学习的微网隐私保护与能量调度方法,首先利用动作网络与本地环境进行交互,获取相应的动作策略,生成对应的噪声及独立发电单元功率,再根据环境参数与所选动作判断是否满足约束条件,计算奖励值。随后动作神经网络与价值神经网络提取历史数据进行学习,最后根据所学模型,价值网络对动作网络选择的动作进行反馈,引导动作网络追寻更高的奖励值。

6、上述方案可以实现模型训练过程中参数的隐私保护。

7、差分隐私(differential privacy,dp)是一种数据隐私保护方法,其原理在于向数据引入控制的随机扰动,以确保个人数据在数据分析过程中不会泄露敏感信息。这种方法的核心思想是通过添加噪声,使得无法从分析结果中准确推断出原始数据的具体内容,从而实现对用户隐私的有效保护。dp为权衡隐私保护和数据分析之间的关系提供了一种解决方案,允许人工智能系统从个人数据中学习和提取有价值的信息,同时保障个人隐私的安全性。在基于扰动的隐私保护方法中,差分隐私被认为具有最高的安全级别。

8、在机器学习领域中,差分隐私通常通过对梯度进行扰动来实现,常见的方法是添加与数据敏感度成比例的高斯噪声来引入扰动。因此,扰动强度的大小直接影响着数据分析的准确度。较高的扰动强度可以提供更好的隐私保护效果,但会降低数据分析的精确性,反之亦然,隐私保护水平与扰动强度密切相关。然而由于不同数据样本的特征和属性存在差异,所以两个数据样本可能会有较大的敏感度,从而导致噪声过多,严重影响模型训练的效果。所以如何在隐私保护效果与精确性之间找到平衡,成为一个迫切需要解决的问题。

9、为了解决这个问题,差分隐私在机器学习领域中通常采用梯度裁剪技术来限制梯度的敏感度,即根据预先设定的裁剪边界对梯度进行调整。通过梯度裁剪,可以控制噪声的引入,以平衡隐私保护和模型训练的效果。然而,设置裁剪边界时需要权衡噪声方差和裁剪偏差之间的关系,较大的裁剪边界会引入较大的噪声方差,而较小的边界则可能导致梯度方向产生偏差。由于噪声和梯度偏差所带来的误差是无法避免的,因此在设置裁剪阈值时需要找到一个合适的平衡点,这样差分隐私可以提供足够的隐私保护,又不会显著降低模型的效用。

10、在机器学习领域中,这种权衡是差分隐私应用中的一个重要问题。需要综合考虑隐私保护、数据效用和模型的收敛性,但是在实际应用中合适的裁剪阈值是很难确定的,目前尚未找到一种有效的方法来解决这个问题。而现有的大部分研究主要关注于对称无向网络,并且仅考虑了在模型更新中添加恒定方差的噪声,忽视了时变调整方差以减轻噪声误差的可能。

11、基于此,本发明设计一种基于衰减噪声扰动的自适应保隐私分布式学习方法,以解决上述问题。

技术实现思路

1、本发明旨在克服上述现有技术的至少一种缺陷,提供一种基于衰减噪声扰动的自适应保隐私分布式学习方法,通过添加噪声以有效保护数据隐私,同时减小噪声误差保证数据的准确性。

2、本发明还公开一种加载有基于衰减噪声扰动的自适应保隐私分布式学习方法的装置。

3、本发明详细的技术方案如下:

4、一种基于衰减噪声扰动的自适应保隐私分布式学习方法,应用于分布式的分布式学习系统,所述分布式学习系统包含自节点及其相邻节点,且每个节点均具有一个用于图像分类识别任务的本地数据集;所述方法包括:

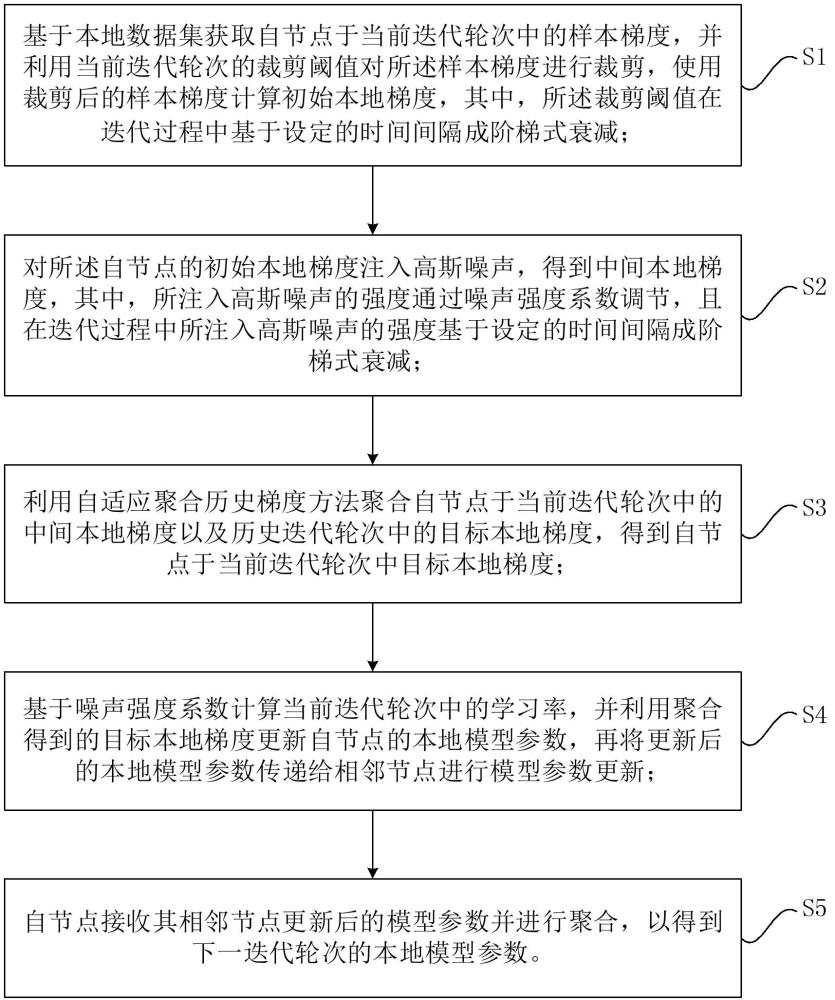

5、s1、基于本地数据集获取自节点于当前迭代轮次中的样本梯度,并利用当前迭代轮次的裁剪阈值对所述样本梯度进行裁剪,使用裁剪后的样本梯度计算初始本地梯度,其中,所述裁剪阈值在迭代过程中基于设定的时间间隔成阶梯式衰减;

6、s2、对所述自节点的初始本地梯度注入高斯噪声,得到中间本地梯度,其中,所注入高斯噪声的强度通过噪声强度系数调节,且在迭代过程中所注入高斯噪声的强度基于设定的时间间隔成阶梯式衰减;

7、s3、利用自适应聚合历史梯度方法聚合自节点于当前迭代轮次中的中间本地梯度以及历史迭代轮次中的目标本地梯度,得到自节点于当前迭代轮次中目标本地梯度;

8、s4、基于噪声强度系数计算当前迭代轮次中的学习率,并利用聚合得到的目标本地梯度更新自节点的本地模型参数,再将更新后的本地模型参数传递给相邻节点进行模型参数更新;

9、s5、自节点接收其相邻节点更新后的模型参数并进行聚合,以得到下一迭代轮次的本地模型参数。

10、根据本发明优选的,所述s1中,自节点在第轮迭代中的样本梯度为,其中,表示自节点在第轮迭代中的去偏参数,表示自节点在第轮迭代从其本地数据集中抽样的样本;

11、利用当前迭代轮次的裁剪阈值对所述样本梯度进行裁剪,具体为:当时,有:

12、(1);

13、式(1)中:表示裁剪后的样本梯度;表示第轮迭代的裁剪阈值;表示第一时间间隔;

14、其中,裁剪阈值在迭代过程中基于设定的第一时间间隔成阶梯式衰减,即:

15、(2);

16、式(2)中:表示下一第一时间间隔内的裁剪阈值;表示衰减系数。

17、根据本发明优选的,所述s1中,使用裁剪后的样本梯度计算初始本地梯度为:

18、(3);

19、式(3)中:表示自节点在第轮迭代中的初始本地梯度;表示自节点的本地数据集中的样本总数;表示本地数据集中的第个样本。

20、根据本发明优选的,所述s2中,对所述自节点的初始本地梯度注入高斯噪声,得到中间本地梯度为:

21、(4);

22、式(4)中:表示自节点在第轮迭代中的中间本地梯度;,表示自节点在第轮迭代中的第二噪声强度系数,表示总迭代次数,表示第二时间间隔,且第二噪声强度系数在迭代过程中基于设定的第二时间间隔成阶梯式减小;表示期望为0、方差为的高斯噪声。

23、根据本发明优选的,所述s3具体包括:

24、判断当前迭代轮次中的第二噪声强度系数与上一迭代轮次中的第二噪声强度系数是否相等,若,则有:

25、(6);

26、式(6)中:表示自节点在第轮迭代中的目标本地梯度;为超参数,取值为[0,1);表示自节点在第轮迭代中的目标本地梯度。

27、根据本发明优选的,所述s4中,基于噪声强度系数计算当前迭代轮次中的学习率为:

28、(9);

29、式(9)中:表示第轮迭代中的学习率;表示初始学习率;表示自节点在第轮迭代中的学习率系数;,表示自节点在第轮迭代中的第一噪声强度系数,且第一噪声强度系数在迭代过程中基于设定的第二时间间隔成阶梯式增大;

30、并利用聚合得到的目标本地梯度更新自节点的本地模型参数,即:

31、(10);

32、式(10)中:表示更新得到的自节点的中间模型参数;表示更新前的自节点的本地模型参数。

33、根据本发明优选的,所述s5中,自节点接收其相邻节点更新后的模型参数并进行聚合,以得到下一迭代轮次的本地模型参数,具体为:

34、(11);

35、式(11)中:表示自节点在第轮迭代中的本地模型参数;表示节点数量;表示在第轮迭代中相邻节点到自节点的权重;表示更新得到的相邻节点的中间模型参数;表示自节点在第轮迭代中的标量推送权重;表示更新得到的相邻节点的标量推送权重;表示自节点在第轮迭代中的去偏参数。

36、在本发明的另一个方面当中,提供了一种实现基于衰减噪声扰动的自适应保隐私分布式学习方法的装置,所述装置包括:

37、梯度获取模块,用于基于本地数据集获取自节点于当前迭代轮次中的样本梯度,并利用当前迭代轮次的裁剪阈值对所述样本梯度进行裁剪,使用裁剪后的样本梯度计算初始本地梯度,其中,所述裁剪阈值在迭代过程中基于设定的时间间隔成阶梯式衰减;

38、梯度加噪模块,用于对所述自节点的初始本地梯度注入高斯噪声,得到中间本地梯度,其中,所注入高斯噪声的强度通过噪声强度系数调节,且在迭代过程中所注入高斯噪声的强度基于设定的时间间隔成阶梯式衰减;

39、梯度聚合模块,用于利用自适应聚合历史梯度方法聚合自节点于当前迭代轮次中的中间本地梯度以及历史迭代轮次中的目标本地梯度,得到自节点于当前迭代轮次中目标本地梯度;

40、参数更新模块,用于基于噪声强度系数计算当前迭代轮次中的学习率,并利用聚合得到的目标本地梯度更新自节点的本地模型参数,再将更新后的本地模型参数传递给相邻节点进行模型参数更新;

41、参数聚合模块,用于对相邻节点更新后的模型参数进行聚合,以得到自节点于下一迭代轮次的本地模型参数。

42、在本发明的另一个方面当中,还提供了一种电子设备,包括:

43、至少一个处理器;以及存储器,所述存储器存储指令,当所述指令被所述至少一个处理器执行时,使得所述至少一个处理器执行如上所述的基于衰减噪声扰动的自适应保隐私分布式学习方法。

44、在本发明的另一个方面当中,还提供了一种机器可读存储介质,其存储有可执行指令,所述指令当被执行时使得所述机器执行如上所述的基于衰减噪声扰动的自适应保隐私分布式学习方法。

45、与现有技术相比,本发明的有益效果为:

46、(1)本发明提供的一种基于衰减噪声扰动的自适应保隐私分布式学习方法,采用具有时间变化的噪声方差和裁剪阈值,在迭代过程中,通过阶梯式降低注入噪声的强度,可以减少对梯度方向的负面影响,并且使用自适应聚合历史梯度(aa)的方法来进一步减小噪声误差,提高整体性能;同时,通过调整噪声方差和学习率来为每个节点提供个性化的隐私保护水平。

47、(2)本发明方法结合了push-sum技术,适用于一般的时变通信拓扑。

48、(3)本发明方法首次给出了噪声误差与梯度陈旧性偏差在有向(不对称)、稀疏和时变的通用通信拓扑下的收敛分析。

- 还没有人留言评论。精彩留言会获得点赞!