一种基于视觉的餐饮安全监测系统与方法与流程

本发明属于视觉监测餐饮安全的,具体是涉及一种基于视觉的餐饮安全监测系统与方法。

背景技术:

1、中国发明专利号为202210673405.6的专利公布了一种明厨亮灶场景下工作人员着装规范检测方法及装置,该方法的训练阶段包括以下步骤:通过摄像头获取输入图像,对输入图像中的目标行人框进行识别,获取包括帽子穿戴情况和围裙穿戴情况的行人服饰信息,并对行人服饰信息进行标注,形成数据集,和存储已标注的数据样本,并将数据样本划分为训练数据和测试数据;获取模块,获取模块用于利用上述方法对输入图像进行编码。该方法的不足之处在于:(1)没有对厨房工作人员的鞋子与口罩进行监测;(2)没有对厨师尝菜行为的规范性进行监测;(3)没有抽烟、用手机的监测;(4)没有废弃物的监测;(5)没有起火与烟雾的监测;(6)没有食材筐、案板、刀具放置规范的监测;(7)没有人不符合规范的监测;(8)没有老鼠、猫、黄鼠狼、狗等小动物的监测;(9)监测是在压缩图中进行,但压缩后原图中的较小的物体和物体的细节已经变小或消失,降低了监测的准确性与可靠性;(10)没有说明对较小物体或在较远的距离时如何识别出物体以及如何看清物体的细节。

2、中国发明专利号为202011550793.6的专利公布了一种基于人工智能明厨亮灶规范检测识别方法,包括以下步骤:s1:收集明厨亮灶相关图片数据;s2:对s1步骤中采集的图片进行清洗;s3:采用模型预测推理明厨亮灶图片;s4:将训练图片与s2步骤中不含明厨亮灶的图片做mixup融合;s5:采用明厨亮灶图片训练pp-yolo模型;s6:采用训练好的pp-yolo模型推理预测监测目标对象;s6:采用训练好的pp-yolo模型推理预测检测目标对象,所述的目标对象包括厨师衣服对象、厨师帽子对象、口罩对象、老鼠对象、抽烟对象,采用人员佩戴融合监测算法判断每个人员是否正确佩戴帽子和衣服。该方法的不足之处在于:(1)没有对厨房工作人员的鞋子进行监测;(2)没有对厨师尝菜行为的规范性进行监测;(3)没有抽烟、用手机的监测;(4)没有废弃物的监测;(5)没有起火的与烟雾的监测;(6)没有食材筐、案板、刀具放置规范的监测;(7)没有猫、黄鼠狼、狗等小动物的监测;(8)监测是在压缩图中进行,但压缩后原图中的较小的物体和物体的细节已经变小或消失,降低了监测的准确性与可靠性;(9)没有人不符合规范的监测;(10)没有说明对较小物体或在较远的距离时如何识别出物体以及如何看清物体的细节。

技术实现思路

1、为了克服上述现有技术的不足,本发明提供了一种基于视觉的餐饮安全监测系统与方法,用于在整个餐饮加工区域内,准确地识别出监测餐饮安全的各种目标物,进而对餐饮安全实施可靠的监测。

2、本发明的目的通过以下技术方案实现:

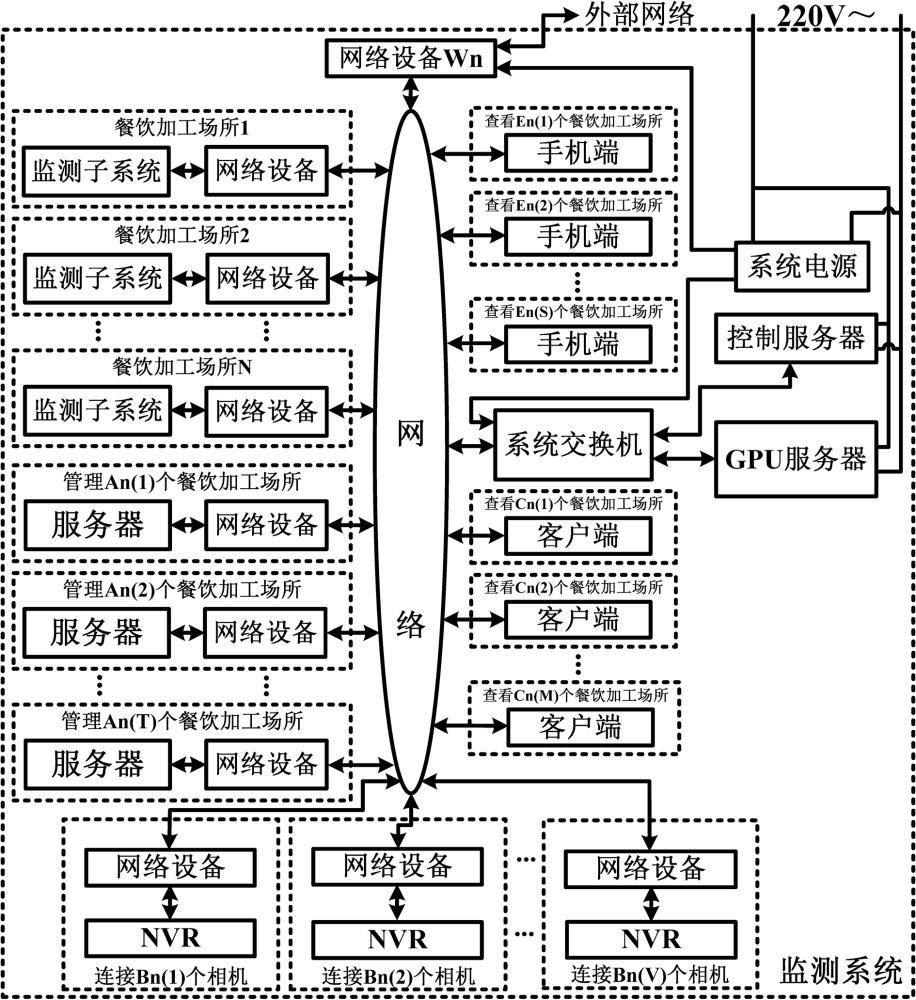

3、本发明提供一种基于视觉的餐饮安全监测系统,所述的系统包括控制服务器、n个监测子系统、t个服务器、v个nvr、gpu服务器、系统交换机、网络、网络设备、网络设备wn、s个手机端、m个客户端与系统电源;所述的控制服务器连接所述的系统交换机,并通过所述的系统交换机连接所述的gpu服务器;所述的控制服务器通过所述的系统交换机和网络以及网络设备连接如下设备:连接所述的t个服务器中的每个服务器,连接所述的v个nvr中的每个nvr,连接所述的n个监测子系统中的每个监测子系统中的交换机并通过该交换机连接监测子系统中的智能分析器,所述的控制服务器通过所述的系统交换机和网络连接所述的s个手机端中的每个手机端,连接所述的m个客户端中的每个客户端,连接所述的网络设备wn并通过所述的网络设备wn连通外部网络;所述的t个服务器中管理an(t)个餐饮加工场所的服务器通过所述的网络设备与网络连接an(t)个监测子系统中的交换机并通过该交换机连接监测子系统中的智能分析器,t=1,2,...,t,而且an(1)+an(2)+...+an(t)=n;所述的v个nvr中连接bn(v)个相机的nvr通过所述的网络设备与网络至少连接一个监测子系统中的交换机且通过该交换机至少连接监测子系统中的一个相机,并且一共连接bn(v)个相机,v=1,2,...,v,每个bn(v)均是正整数;所述的系统电源连接所述的系统交换机、网络设备wn并为所述的系统交换机、网络设备wn提供所需的直流电源;其中,n、t、v、s与m均是正整数。

4、本发明所述的监测子系统包括智能分析器、交换机、网络设备、q个相机与电源;其中,q是正整数;所述的智能分析器连接所述的交换机,并通过所述的交换机连接所述的网络设备、所述的q个相机中的每个相机,并通过所述的交换机、网络设备、网络、系统交换机连接所述的控制服务器,还通过所述的交换机、网络设备、网络连接所述的t个服务器中的一个服务器;所述的监测子系统中的这q个相机采集的图像覆盖一个餐饮加工的全部区域;所述的电源连接所述的智能分析器、交换机、网络设备,并为所述的智能分析器、交换机、网络设备提供所需的直流电源。

5、所述的方法的步骤如下:

6、步骤a、生成神经网络;所述的神经网络是能识别目标物的神经网络;所述的目标物至少包括k个目标物;k个目标物包括28个目标物、m1个目标物b1、m2个目标物b2、m2个目标物b3;k、m1与m2均是正整数;其中,28个目标物中的目标物1,目标物2,...,目标物28依次是货架,桌子,柜子,固定放置的桶,灶台,抽油烟机,立柱,老鼠,猫,黄鼠狼,狗,人,着装规范的人,用专用尝菜用具尝菜的人,帽子戴的不规范的人,口罩戴的不规范的人,上衣穿的不规范的人,裤子穿的不规范的人,鞋子穿的不规范的人,抽香烟的人,用手机的人,用炒菜勺尝菜的人,跑步的人,肢体状态异常的人,没有废弃物的地面,有废弃物的地面,火,烟雾;m1个目标物b1是m1个颜色的食材筐的目标物,m2个目标物b2是m2个颜色的案板的目标物,m2个目标物b3是m2个颜色刀把的刀具的目标物;所述的人不是不符合规范的人,不符合规范的人包括帽子戴的不规范的人、口罩戴的不规范的人、上衣穿的不规范的人、裤子穿的不规范的人、鞋子穿的不规范的人、抽香烟的人、用手机的人、用炒菜勺尝菜的人、跑步的人、肢体状态异常的人;所述的废弃物是宽度≥thingw和高度≥thingh的废弃物;所述的火是宽度≥thingw和高度≥thingh的火;所述的thingw和thingh分别对应所述的相机采集图像的x向的实际宽度和y向的实际高度;

7、步骤b、监测处理;

8、监测处理的步骤如下:

9、步骤b.1、设置q的初值为1;q是所述的监测子系统中监测区域的编号;

10、步骤b.2、如果本步骤的执行时间处在监测区域q的相机的监测时间以内,则转步骤b.3;否则转步骤b.7;

11、步骤b.3、基于神经网络识别目标物,得到识别集idenset(q);

12、步骤b.4、根据所述的识别集idenset(q)监测事件或根据差图监测事件;

13、步骤b.5、如果监测到事件,则转步骤b.6;否则转步骤b.7;

14、步骤b.6、事件处理;

15、步骤b.7、对所述的q加1;

16、步骤b.8、如果q>q;则转步骤b.1;否则转步骤b.2;其中,q是监测子系统中监测区域的数量。

17、所述的基于神经网络识别目标物,得到识别集idenset(q)的步骤如下:

18、步骤4.1、所述的智能分析器从监测区域q的相机输出的视频图像中截取一帧图像;所述的图像的宽度为w(q)和高度为h(q);

19、步骤4.2、将所述的图像压缩成压缩图像;所述的压缩图像是宽度为w和高度为h的图像;其中,w和h是神经网络处理图像的宽度和高度,并且w和h需满足如下关系式:

20、w≥detectw×idnxpn/thingw

21、h≥detecth×idnypn/thingh

22、式中, detectw与detecth分别是所述的相机监测区域的宽度与高度;idnxpn与idnypn分别是所述的神经网络识别物体的x向最小像素点与y向最小像素点;

23、步骤4.3、基于神经网络从所述的压缩图像中识别出目标物,并得到识别集idenset(q);所述的识别集idenset(q)中的元素至少包括从所述的压缩图像中识别出的背景目标物的数量、框住每个目标物的最小外接矩形和每个目标物的识别符;目标物k的识别符是所述的神经网络识别出该目标物k的标记符,目标物k的标记符是对目标物k赋予的不同于其它目标物的符号,k=1,2,...,k;其中,k是目标物的编号;k是目标物的数量;

24、步骤4.4、结束基于神经网络识别目标物,得到识别集idenset(q)的处理。

25、所述的根据所述的识别集idenset(q)监测事件或根据差图监测事件的步骤如下:

26、根据所述的识别集idenset(q),监测有烟雾的事件;

27、根据所述的识别集idenset(q),监测有烟雾的事件的步骤如下:

28、根据所述的识别集idenset(q),记录背景目标物的最大数量;所述的背景目标物包括货架、桌子、柜子、固定放置的桶、灶台、抽油烟机与立柱;所述的背景目标物的数量是所述的识别集idenset(q)中背景目标物的数量;

29、根据所述的识别集idenset(q)和背景目标物的最大数量,监测有烟雾的事件;监测出有烟雾的事件是指所述的识别集idenset(q)中背景目标物的数量小于背景目标物的最大数量;

30、根据所述的识别集idenset(q),监测起火的事件;监测出起火的事件是指在所述的识别集idenset(q)中至少有一个目标物的识别符是目标物是火的识别符,并且该目标物没有处在任何一个灶台的范围框内;

31、根据所述的识别集idenset(q),监测有废弃物的地面的事件;监测出有废弃物的地面的事件是指在所述的识别集idenset(q)中至少有一个目标物的识别符是目标物是有废弃物的地面的识别符;

32、根据所述的识别集idenset(q),监测食材筐位置不正确的事件;监测出食材筐位置不正确的事件是指在所述的识别集idenset(q)中至少有一个目标物的识别符是目标物是食材筐的识别符,并且该目标物没有处在该目标物的范围框以内;所述的食材筐是指m1个颜色的食材筐;

33、如果本步骤的执行时间处在监测小动物的时间段,则根据差图监测有小动物的事件;监测出有小动物的事件是指小动物识别符号集idenanimalsymset(q)中至少有一个目标物的识别符是目标物是小动物的识别符;所述的小动物包括老鼠、猫、黄鼠狼、狗;

34、根据所述的识别集idenset(q),获得识别符号集idenpeoplesymset(q)和获得刀板位置识别符bdandknplace(q);其中,识别符号集idenpeoplesymset(q)中的元素是包含人的目标物的识别符;

35、根据所述的识别符号集idenpeoplesymset(q),监测不符合规范的人的事件;监测出不符合规范的人的事件是指所述的识别符号集idenpeoplesymset(q)中至少有一个目标物的识别符是目标物是不符合规范人的识别符,或者还需满足asm的条件;不符合规范人的目标物包括目标物15,目标物16,...,目标物24;所述的asm的条件是指如果目标物的识别符是持续动作目标物的识别符,则监测出不符合规范的人的事件需满足actn/s≥setminn/s∧

36、acttime≥mintime的条件;其中,2次/s≤setminn/s≤5次/s,2s≤mintime≤4s;actn/s与setminn/s分别是持续动作目标物的识别符在一秒内监测到的次数与设定的持续动作目标物的识别符在一秒内监测到的最小次数;acttime与mintime分别是监测到的持续动作目标物的识别符持续的时长与设定的监测到的持续动作目标物的识别符持续的最小时长;所述的持续动作目标物是指目标物23与目标物24;

37、根据所述的刀板位置识别符bdandknplace(q),监测案板位置不正确或刀具位置不正确的事件;监测出案板位置不正确或刀具位置不正确的事件是指刀板位置识别符bdandknplace(q)=false;所述的案板包括m2个颜色的案板;所述的刀具包括m2个颜色刀把的刀具。

38、监测区域q的相机的监测时间和监测小动物的时间段的设置与监测区域q的范围框的设置的步骤如下:

39、对每个监测区域q的相机在一天内每个监测时间段c的监测起始时刻与监测结束时刻进行设置,并对监测小动物的时间段进行设置,c=1,2,...,c(q),q=1,2,...,q;其中,c是监测时间段按照一天内监测时间的先后顺序形成的编号;c(q)是一天内监测时间段的数量,c(q)是正整数;

40、监测区域q的范围框的设置是指对每个监测区域q的相机采集图像中有限制范围的目标物的范围框进行设置,q=1,2,...,q;所述的范围框对应实际灶台的范围,或者对应该目标物实际放置正确的范围;有限制范围的目标物包括目标物5灶台,m1个颜色的食材筐的目标物,m2个颜色的案板的目标物,m2个颜色刀把的刀具的目标物。

41、所述的根据差图监测有小动物的事件的步骤如下:

42、步骤7.1、设置小动物识别符号集idenanimalsymset(q)为空集;其中,q是监测区域的编号;

43、步骤7.2、从视频图像中得到差图;所述的差图是由监测区域q的相机输出的本帧图像与输出的前l帧的图像作差得到的差图;其中,1≤l≤12;

44、步骤7.3、从所述的差图得到差异矩形集diffrectset;

45、步骤7.4、如果|diffrectset|≥1,则转步骤7.5;否则转步骤7.6;

46、步骤7.5、识别处理所述的差异矩形集diffrectset,得到小动物识别符号集idenanimalsymset(q);

47、步骤7.6、结束根据差图监测有小动物的事件的处理。

48、所述的根据所述的识别集idenset(q),获得识别符号集idenpeoplesymset(q)和获得刀板位置识别符bdandknplace(q)的步骤如下:

49、步骤8.1、设置n的初值为1、n1的初值为0,设置识别符号集idenpeoplesymset(q)为空集,设置刀板位置识别符bdandknplace(q)=true;其中,n是所述的识别集idenset(q)中目标物的编号;n1是记录所述的识别集idenset(q)中包含人的目标物的编号;包含人的目标物包括目标物12,目标物13,...,目标物24;

50、步骤8.2、如果目标物(n)的识别符是包含人的目标物的识别符,或是包含案板的目标物的识别符,或是包含刀具的目标物的识别符,则转步骤8.3;否则转步骤8.9;包含案板的目标物包括m2个颜色的案板的目标物;包含刀具的目标物包括m2个颜色刀把的刀具的目标物;

51、步骤8.3、根据矩形compprect(q,n)从所述的图像中获取图像imgp(n);图像imgp(n)是宽度为w和高度为h的图像;所述的矩形compprect(q,n)是所述的识别集idenset(q)中框住目标物(n)的最小外接矩形;

52、步骤8.4、用所述的神经网络识别图像imgp(n),得到图像imgp(n)的识别符idensym(q,n);

53、步骤8.5、如果目标物(n)的识别符是包含人的目标物的识别符,则转步骤8.6;否则转步骤8.8;

54、步骤8.6、对所述的n1加1;

55、步骤8.7、将识别符idensym(q,n)以名称idenpeoplesym(q,n1)增加到识别符号集

56、idenpeoplesymset(q);本步骤完成后转步骤8.9;

57、步骤8.8、获得刀板位置识别符bdandknplace(q);

58、获得刀板位置识别符bdandknplace(q)的步骤如下:

59、步骤8.8.1、如果识别符idensym(q,n)所对应的目标物没有处在该目标物的范围框以内,则转步骤8.8.2;否则转步骤8.8.3;

60、步骤8.8.2、设置刀板位置识别符bdandknplace(q)=false;

61、步骤8.8.3、结束获得刀板位置识别符bdandknplace(q)的处理;

62、步骤8.9、对所述的n加1;

63、步骤8.10、如果n>nc(q),则转步骤8.11;否则转步骤8.2;其中,nc(q)是所述的识别集idenset(q)中目标物的数量;

64、步骤8.11、结束根据所述的识别集idenset(q),获得识别符号集idenpeoplesymset(q)和获得刀板位置识别符bdandknplace(q)的处理。

65、所述的根据矩形compprect(q,n)从所述的图像中获取图像imgp(n)的步骤如下:

66、步骤9.1、用公式(1)计算所述的矩形compprect(q,n)在所述的图像的矩形prect(n)的左边界值psx(n)、右边界值pex(n)、上边界值psy(n)、下边界值pey(n),

67、psx(n)=int[cpsx(n)×w(q)/w],pex(n)=int[cpex(n)×w(q)/w]

68、psy(n)=int[cpsy(n)×h(q)/h],pey(n)=int[cpey(n)×h(q)/h](1)

69、(1)式中,cpsx(n)、cpex(n)、cpsy(n)、cpey(n)分别是所述的矩形compprect(q,n)的左边界值、右边界值、上边界值、下边界值;w(q)和h(q)分别是所述的图像的宽度和高度;int[]是取整数运算;

70、步骤9.2、用公式(2)计算所述的矩形prect(n)的宽度pw(n)和高度ph(n),

71、pw(n)=pex(n)-psx(n)+1

72、ph(n)=pey(n)-psy(n)+1 (2)

73、步骤9.3、如果pw(n)≤w∧ph(n)≤h,则转步骤9.4;否则转步骤9.5;

74、步骤9.4、根据prect(n)的边界值,从所述的图像中获取包含整个矩形prect(n)的图像imgp(n);本步骤完成后转步骤9.7;所述的图像imgp(n)是宽度为w和高度为h的图像;

75、步骤9.5、根据prect(n)的边界值,从所述的图像中获取包含整个矩形prect(n)的图像eimgp(n);eimgp(n)的宽度为epw(n)和高度为eph(n);epw(n)与eph(n)由公式(3)计算,

76、epw(n)=pw(n),eph(n)=int[h×pw(n)/w] if pw(n)/w≥ph(n)/h

77、epw(n)=int[w×ph(n)/h],eph(n)=ph(n) else (3)

78、步骤9.6、将图像eimgp(n)压缩成宽度为w和高度为h的图像imgp(n);

79、步骤9.7、结束根据矩形compprect(q,n)从所述的图像中获取图像imgp(n)的处理。

80、所述的事件处理的步骤如下:

81、生成事件记录;所述的生成事件记录是指智能分析器生成事件记录集;所述的事件记录集至少包括如下元素:事件名称,事件发生的时间,事件发生的地点,事件类型,反映事件的图片,或者还包括gif动图,或者还包括短视频,或者还包括反映事件的视频录像;

82、上传事件记录;所述的上传事件记录是指智能分析器通过所述的交换机、网络设备、网络、系统交换机将事件记录集上传到所述的控制服务器;

83、记录事件:记录事件是指所述的控制服务器将事件记录集保存到所述的控制服务器的存储设备;

84、事件记录发布;事件记录发布是指所述的控制服务器通过所述的系统交换机与网络将事件记录集发布到有查看所述的事件记录集权限的客户端,和有查看所述的事件记录集权限的手机端;

85、事件报警处理;所述的事件报警处理是指如果判断所述的事件是有烟雾的事件,则进行报警通知;如果判断所述的事件是起火的事件,则进行报警通知以及事件外传;所述的报警通知是指所述的控制服务器通过所述的系统交换机与网络将有烟雾或起火的事件信息发送给相关的手机端和客户端;所述的事件外传是指所述的控制服务器通过所述的系统交换机、网络、网络设备wn将事件记录集传输到外部网络中系统设定的地方。

86、所述的生成神经网络的步骤如下:

87、步骤11.1、设置获取图片的数量picnum,设置如下集合为空集:图集、预处理集、压缩集、设定目标物的图集、设定目标物的处理集、处理集;其中,picnum是≥3000的正整数;设定目标物至少包括目标物8,目标物9,...,目标物26,m2个颜色的案板的目标物,m2个颜色刀把的刀具的目标物;

88、步骤11.2、获取图集;

89、步骤11.3、用所述的图集获得处理集;

90、步骤11.4、将所述的处理集拆分为训练集和测试集;

91、步骤11.5、训练神经网络模型;训练神经网络模型是指用所述的训练集中的每组图片与文件训练神经网络模型;一组图片与文件是指一张图片和该图片的标注文件;

92、步骤11.6、测试神经网络模型;测试神经网络模型是指用所述的测试集中的每组图片与文件测试神经网络模型,并统计每种目标物测试的数量与每种目标物测试正确的数量;

93、步骤11.7、统计每种目标物k的测试正确率,k=1,2,...,k;

94、步骤11.8、若每种目标物k的测试正确率均≥设定的正确率,则转步骤11.10;否则转步骤11.9;

95、步骤11.9、增大picnum值,增大后转步骤11.2;增大picnum值是指增大后picnum=增大前的picnum×chgscalev,其中,1.1≤chgscalev≤2.4;

96、步骤11.10、将神经网络模型编译成神经网络;所述的神经网络是指能识别所述的目标物的神经网络;

97、步骤11.11、将所述的神经网络写入所述的系统中的每个智能分析器;

98、步骤11.12、结束生成神经网络的处理。

99、所述的获取图集的步骤如下:

100、获取录像;获取录像是指获取包含目标物的d1段视频录像;d1是正整数;

101、获取图片;获取图片是指从每段视频录像d1中截取图片,

102、d1=strdx,strdx+1,...,d1,并将截取图片增加到暂存集tmpset(d),d=strd,strd+1,...,d;其中,d1是未截取图片的视频录像段的编号;strdx是未截取图片的视频录像段的起始编号;d是暂存集的编号;strd是暂存集的起始编号;d是暂存集的数量,d是正整数;

103、过滤图片;过滤图片是指将每个没有进行过滤处理的暂存集tmpset(d)进行过滤处理,d=strd,strd+1,...,d;过滤处理暂存集tmpset(d)是指将暂存集tmpset(d)中不相同的图片保存到图集;暂存集tmpset(d)中两张图片不相同是指这两张图片中的目标物至少有一个目标物不同,或者两张图片中的目标物的数量不同,或者至少存在一个目标物k使得parea(d,a1,k)∩parea(d,a2,k)为空集,a1≠a2∧k∈z[1,k];其中,parea(d,a1,k)、parea(d,a2,k)分别是图片pt(d,a1)中的目标物k所在的区域、图片pt(d,a2)中的同一个目标物k所在的区域,并且parea(d,a1,k)∩parea(d,a2,k)的运算是将图片pt(d,a1)与图片pt(d,a2)处在同一个图像坐标系下进行的运算;其中,图片pt(d,a1)与图片pt(d,a2)均是暂存集tmpset(d)中的图片;z[m1,m2]是整数m1到整数m2的集合,m1≤m2。

104、所述的用所述的图集获得处理集的步骤如下:

105、标注处理;标注处理是指用自动标注软件对所述的图集中的每张未标注的图片进行自动标注,获得该图片的标注文件,再将该图片与该图片的标注文件增加到预处理集;所述的标注文件至少包括从被标注图片中识别出的每个目标物的如下数据:标记目标物位置的矩形、目标物的标记符;其中,所述的目标物的标记符是对不同目标物赋予的互不相同的符号;

106、修正处理;修正处理是指用修改标注软件对所述的预处理集中未修正的标注文件进行修正,并将修正正确的标注文件保存到所述的预处理集中的原标注文件;对标注文件进行修正是指如果标注文件中有不正确的标注,则修正该标注文件为正确的标注文件;所述的正确的标注文件至少包括被标注图片中的每个目标物的如下数据:框住目标物的最小外接矩形、目标物正确的标记符;

107、压缩处理;压缩处理是指压缩所述的预处理集中的每张未压缩的图片得到该图片的压缩图片,并且压缩该图片的标注文件得到压缩图片的标注文件;再将压缩图片和压缩图片的标注文件增加到压缩集;所述的压缩图片是宽度为w和高度为h的图片;所述的压缩图片的标注文件是标注压缩图片的标注文件;

108、从所述的预处理集获取设定目标物的处理集;

109、用所述的压缩集和所述的设定目标物的处理集构成处理集。

110、所述的从所述的预处理集获取设定目标物的处理集的步骤如下:

111、步骤14.1、从所述的预处理集获取设定目标物的图集;

112、步骤14.2、用设定目标物的图集构成设定目标物的处理集;

113、用设定目标物的图集构成设定目标物的处理集的步骤如下:

114、步骤14.2.1、对设定目标物的图集进行标注处理;对设定目标物的图集进行标注处理是指用自动标注软件对所述的设定目标物的图集中的每张未标注的图片进行自动标注,获得该图片的标注文件,并将所述的图片与该图片的标注文件增加到所述的设定目标物的处理集;

115、步骤14.2.2、对设定目标物的处理集进行修正处理;对设定目标物的处理集进行修正处理是指用修改标注软件对所述的设定目标物的处理集中的每个未修正的标注文件进行修正,并将修正正确的标注文件保存到所述的设定目标物的处理集的原标注文件。

116、所述的从所述的预处理集获取设定目标物的图集的步骤如下:

117、步骤15.1、设置pj的初值为pstrj,设置v的初值为strv,设置preprocpn为所述的预处理集中图片的数量;pj是所述的预处理集中未取过图片的编号;pstrj是所述的预处理集中未取过图片的起始编号;v是设定目标物的图集中图片的编号;strv是设定目标物的图集中图片的起始编号;未取过图片是指未获取过设定目标物的图片;

118、步骤15.2、从图片p(pj)与标注文件labpfile(pj)中获取设定目标物的图片;所述的图片p(pj)与标注文件labpfile(pj)均是预处理集中的图片与标注文件;

119、从图片p(pj)与标注文件labpfile(pj)中获取设定目标物的图片的步骤如下:

120、步骤15.2.1、设置m的初值为1;其中,m是所述的预处理集中的标注文件labpfile(pj)中目标物的编号;

121、步骤15.2.2、如果目标物(m)的识别符是设定目标物的识别符,则转步骤15.2.3;否则转步骤15.2.7;

122、步骤15.2.3、对所述的v加1;

123、步骤15.2.4、从所述的标注文件labpfile(pj)中取出框住目标物(m)的最小外接矩形rect(m);

124、步骤15.2.5、根据所述的最小外接矩形rect(m),从图片p(pj)中获取图片apimg(v);其中,图片apimg(v)是包含整个矩形rect(m)且宽度为w和高度为h的图片;

125、根据所述的最小外接矩形rect(m),从图片p(pj)中获取图片apimg(v)的步骤如下:

126、步骤15.2.5.1、用公式(4)计算所述的最小外接矩形rect(m)的宽度rw(m)和高度rh(w),

127、rw(m)=rex(m)-rsx(m)+1

128、rh(m)=rey(m)-rsy(m)+1 (4)

129、(4)式中,rsx(m)、rex(m)、rsy(m)、rey(m)分别是矩形rect(m)的左边界值、右边界值、上边界值、下边界值;

130、步骤15.2.5.2、如果 rw(m)≤w∧rh(m)≤h,则转步骤15.2.5.3;否则转步骤15.2.5.4;

131、步骤15.2.5.3、根据rect(m)的边界值从所述的图片p(pj)中获取包含整个矩形rect(m)的w*h的区域,并将这w*h的区域的图像保存为图片apimg(v);本步骤完成后转步骤15.2.5.5;其中,w*h的区域是宽度为w和高度为h的区域;

132、步骤15.2.5.4、根据rect(m)的边界值从所述的图片p(pj)中获取包含整个矩形rect(m)的erw*erh的区域,并将这erw*erh的区域的图像压缩成w*h的图像,再将这w*h的图像保存为图片apimg(v);其中,erw*erh的区域是宽度为erw和高度为erh的区域;erw和erh由公式(5)计算,

133、erw=rw(m),erh=int[h×rw(m)/w] if rw(m)/w≥rh(m)/h

134、erw=int[w×rh(m)/h],erh=rh(m) else (5)

135、步骤15.2.5.5、结束获取图片apimg(v)的处理;

136、步骤15.2.6、将所述的图片apimg(v)增加到所述的设定目标物的图集;

137、步骤15.2.7、对所述的m加1;

138、步骤15.2.8、如果m>mp(pj),则转步骤15.2.9,否则转步骤15.2.2;其中,mp(pj)是标注文件labpfile(pj)中目标物的数量;

139、步骤15.2.9、结束从图片p(pj)与标注文件labpfile(pj)中获取设定目标物的图片的处理;

140、步骤15.3、对所述的pj加1;

141、步骤15.4、如果pj>preprocpn,则转步骤15.5;否则转步骤15.2;

142、步骤15.5、结束获取设定目标物的图集的处理。

143、与现有技术相比,本发明专利的一种基于视觉的餐饮安全监测系统与方法的显著进步和技术特点是:本发明的技术路线是,a、生成识别目标物的神经网络,b、基于神经网络识别出目标物得到识别集,再根据识别集监测事件;所述的事件包括烟雾、起火、地面有废弃物、食材筐放置不正确、案板放置不正确、刀具放置不正确、出现小动物、不符合规范的人;当监测到人、小动物、案板、刀具时,从原图中截取包含人、小动物、案板、刀具且宽度为w和高度为h的图像,再由yolov8神经网络从该图像中识别出小动物、不符合规范的人、案板位置或刀具位置不正确;所述的不符合规范包括着装不规范、尝菜不规范、抽烟、用手机、跑步、肢体状态异常,并且监测时以原图的分辨率识别小动物、人的肢体、案板侧面的颜色、刀具刀把的颜色;实现的技术目的是,大幅提高监测的内容和监测的准确性与可靠性;取得的技术效果是,为食品卫生安全提供全智能全方位地监测。

- 还没有人留言评论。精彩留言会获得点赞!