一种基于弱监督学习的白内障眼底图像增强方法

本发明属于计算机视觉及医学人工智能领域,涉及图像复原技术,具体为一种基于弱监督学习的白内障眼底图像增强方法。

背景技术:

1、不同于自然图像增强,眼底图像增强算法需要较好地保持图像的结构细节,以增强后续诊断的准确性。因此,针对自然图像的增强算法无法直接迁移到眼底图像增强任务中。鉴于此,研究人员逐渐开始关注眼底图像增强任务。小样本学习(fsl)由于能够从相对较少的样本中获取图像类别信息,在该领域越来越受到关注。

2、眼底图像增强是视觉感知的基础,服务于一系列高级语义理解任务,如分割、检测等。该技术着重于将捕获图像中的退化信息加以恢复,尽可能地生成接近真实世界下的图像,以满足高级语义理解任务的应用需求。通过白内障图像和经过本发明的网络模型增强后的眼底图像对比可以看出,白内障患者的视网膜较为模糊,图像可读性较差。而经过增强后,图像中包含更丰富的信息且保留了图像结构,有助于在进一步高级语义理解任务中的应用。

3、目前的白内障眼底图像增强方法通常采用有监督的学习方法来恢复图像的细节。然而,配对白内障视网膜图像获取十分费时、费力。人工合成的方法虽然能获得大量的配对图像,但是仅使用合成函数无法覆盖白内障图像所有的退化因素,使得网络在真实白内障退化的场景中泛化能力不足,在进一步的高级语义理解任务中应用受限。而无监督学习方法由于缺乏监督约束,在增强过程中图像细节易丢失。

技术实现思路

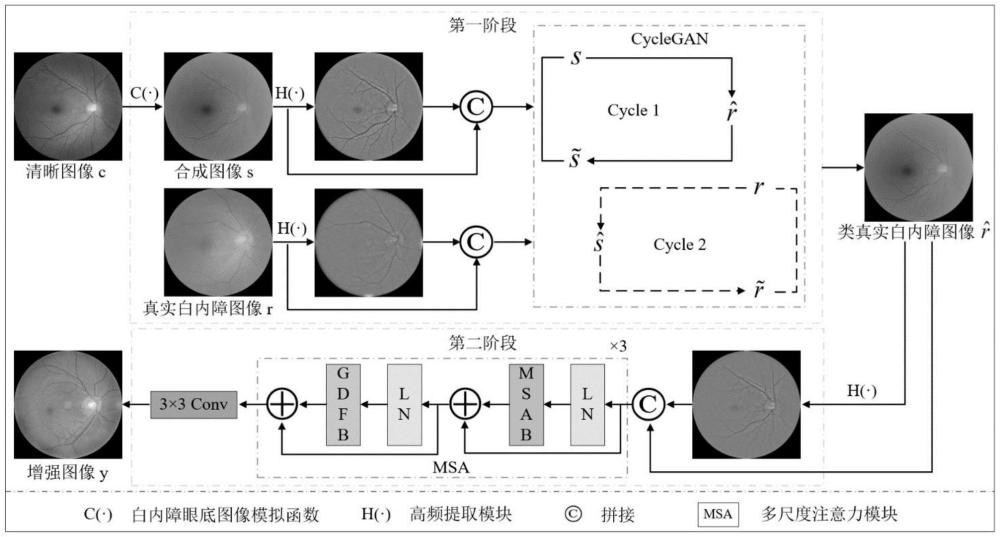

1、针对上述问题,本发明提出了一种基于弱监督学习的两阶段多尺度注意白内障眼底图像增强方法,通过提出类真实白内障图像合成阶段,利用cyclegan网络进行域转换,以合成配对的类真实白内障图像,解决了大量配对数据难以获取的问题,并且通过网络的学习,可以覆盖更多的退化因素。且为了进一步提取眼底图像细节并减少增强过程中伪影的产生,提出了一个多尺度注意白内障眼底增强阶段,以学习更多有用的白内障图像增强特征,有助于在视觉感知任务中的应用。

2、为实现上述目的,本发明的技术方案为:

3、一种基于弱监督学习的白内障眼底图像增强方法,该方法包括以下步骤:

4、步骤1:利用白内障眼底图像模拟来处理清晰眼底图像,得到模拟的类白内障眼底合成图像;白内障检测面板对输入的合成图像和真实白内障图像首先进行欧式距离变换,再通过高斯滤波处理结果;

5、步骤2:通过cyclegan网络对合成图像和真实白内障图像进行双向域转换,得到类真实白内障图像;

6、步骤3:利用高频提取模块h(·)提取类真实白内障图像的高频分量信息;

7、步骤4:将步骤3中提取的高频分量信息输入至白内障眼底图像增强网络的多尺度注意力模块,以使网络模型学习更多有用的白内障图像增强特征,以类真实白内障图像的均方误差损失、颜色损失、总离散像素变化损失、结构一致性损失作为总损失训练白内障眼底图像增强网络;

8、步骤5:将所需要增强的白内障眼底图像输入训练好的网络中,得到对应的增强后的白内障眼底图像。

9、基于上述方案,该方法适用于白内障眼底图像增强,来解决现有方法忽略视觉感知中语义理解任务需求导致在语义理解任务中应用受限的问题。模拟类白内障眼底图像并对其进行处理,再利用cyclegan网络进行双向域转换,能够生成更接近于真实白内障情况的图像。利用高频提取模块提取类真实白内障图像的高频分量信息,并输入到多尺度注意力模块中,能够促使网络模型专注于图像中的关键特征,尤其是与白内障相关的高频细节;多尺度注意力模块能够进一步提升网络对不同尺度特征的捕捉能力,从而学习到更多有用的白内障图像增强特征。采用包括均方误差损失、颜色损失、总离散像素变化损失和结构一致性损失在内的综合损失函数来训练白内障眼底图像增强网络,不仅关注像素级的差异,还考虑到了图像的颜色保真度、结构相似性和整体视觉效果,从而确保增强后的图像在多个维度上都达到较优的状态。该方法采用弱监督学习方式,相比于全监督学习,它对标注数据的需求较低,可以更加灵活地应用于实际场景。这对于白内障眼底图像这种难以大量获取高质量标注数据的领域尤为重要,有助于降低数据标注成本,提高方法的实用性和可推广性。

10、进一步的,步骤1所述利用白内障眼底图像模拟来处理清晰眼底图像,得到模拟的类白内障眼底合成图像c(sc),具体由以下公式表示:

11、c(sc)=α·sc*gb(rb,σb)+β·j*gl(rl,σl)·(lc-sc) (1)

12、其中,c(sc)表示模拟的类白内障眼底合成图像;sc表示清晰眼底图像,其中c表示图像的r,g,b通道;α和β分别表示清晰眼底图像的权重和来自白内障的噪声;*表示卷积操作;gb和gl分别表示用于清晰眼底图像平滑和白内障检测面板的高斯滤波器;g(r,σ)表示以r为半径,σ为空间常数的高斯滤波器;j表示白内障检测面板,lc表示sc的最高强度。

13、进一步的,步骤2具体为:通过两个gan网络,分别学习从合成图像域s到真实白内障图像域r的映射和从真实白内障图像域r到合成图像域s的映射。

14、进一步的,步骤3所述利用高频提取模块提取类真实白内障图像的高频分量信息,具体为:高频提取模块g(·)首先通过低通高斯滤波器提取类真实白内障图像的低频分量,然后将低频分量与类真实白内障图像相减得到类真实白内障图像的高频分量,高频提取模块h(·)的过程由以下公式表示:

15、h(i)=i-i*gp(rp,σp) (2)

16、其中,i表示类真实白内障图像,gp(rp,σp)表示一个以rp为半径,σp为空间常数的高斯滤波器。

17、进一步的,步骤4所述多尺度注意力模块的学习过程可以表示为:

18、mi=fi+fmsab(ln(fi)) (3)

19、fi+1=mi+fgdfb(ln(mi)) (4)

20、fi和fi+1分别表示多尺度注意力模块的输入和输出特征,mi表示提取到的多尺度特征,fmsab(·)表示msab模块,fgdfb(·)表示gdfb模块,ln(·)表示层归一化操作。

21、进一步的,步骤4所述以类真实白内障图像的均方误差损失、颜色损失、总离散像素变化损失、结构一致性损失作为总损失训练白内障眼底图像增强网络,具体包括:

22、步骤4.1:在类真实白内障图像合成阶段,使用cyclegan网络中的损失函数对类真实白内障图像合成阶段进行训练,损失函数表示为lcyclegan,其计算过程如下式所示:

23、

24、其中,s和r分别代表源域和目标域,表示从s域向r域的映射函数,表示从r域向s域的映射函数;ds和dr分别代表源域和目标域的鉴别器,lgan和lcyc分别表示对抗损失和循环一致性损失,λ为权重;

25、步骤4.2:为保持眼底的结构信息,还使用了gfenet中的结构损失lr,总的损失函数如下表示为ltotal,其计算过程如下式所示:

26、

27、其中,sg表示源域的结构图;rg表示目标域的结构图;表示源域结构图的真实值;表示目标域结构图的真实值;

28、步骤4.3:在多尺度注意力模块白内障图像增强阶段,利用均方误差损失lmse来约束图像的结构变化,颜色损失lcolor来约束图像的颜色亮度变化,总离散像素变化损失ltv来约束图像的边缘,结构一致性损失lssim恢复图像的亮度和结构;该步骤各损失相加作为总的损失函数,总的损失函数可以表示为:

29、

30、其中,rgb表示r,g,b通道,maxcrgb表示预测图像中rgb三通道中最大的值;c表示预测的图像;y表示真实的图像;结构相似性指数

31、本发明的有益效果包括:

32、本发明提出了一种基于弱监督学习的白内障眼底图像增强方法,包括两阶段的网络,分别用于生成类真实白内障图像和白内障图像增强。在网络的第一阶段,利用cyclegan进行域转换,合成配对的类真实白内障图像。此外,为了进一步提取眼底图像的细节信息,并减少在图像增强过程中伪影的产生,在网络的第二阶段,提出了多尺度注意力模块,以学习更多有用的白内障图像增强特征,有助于在视觉感知任务中的应用。实验结果验证了本方法在白内障眼底图像增强、眼底血管分割和眼底疾病检测三种感知任务中均取得了较好的结果。

- 还没有人留言评论。精彩留言会获得点赞!