一种多尺度注意力卷积神经网络的红外可见光图像融合方法

本发明属于图像融合领域,尤其涉及基于多尺度注意力和卷积神经网络的红外可见光图像方法。

背景技术:

1、红外图像是红外摄像机在红外波段的辐射所得到的图像,可见光图像是摄像机在人眼可见的可见光波段中所得图像。由于理论和技术限制,单个模态传感器拍摄的图像不能有效、全面地描述成像场景。红外传感器通过捕捉物体发出的热辐射,可以突出显著目标,但红外图像对场景纹理细节的描述能力较差,容易受到噪声的影响。相反,可见光传感器通过捕获反射光信息,其图像通常包含丰富的纹理信息,但对环境很敏感。所以,通过提取红外图像的显著性信息,以及可见光图像的细节信息,将两张图像的有用信息集中在一张图像上,最后的融合结果是具有突出目标和丰富细节的融合图像,即融合结果综合两种类型图像的优点。

2、红外和可见光图像融合是一种典型的多源融合任务,在计算机视觉中有着广泛的应用,如目标检测、跟踪、识别等应用场景。现有的融合方法通常对不同类型的源图像在融合过程中使用相同的变换或表示。然而,这种方式不适用于红外和可见光图像,因为红外图像中的热辐射区域和可见光图像中的细节内容是两种截然不同的表现。此外,现有方法中的融合规则大多采用人工设计的方式,融合过程越来越复杂,存在实现难度大和计算成本高的问题。这种传统的方法对提取的特征建模和设计融合规则非常费时费力,因此,其性能在很大程度上受到限制。

3、基于深度学习的图像融合方法可以在一定程度上解决传统方法的局限性,从而获得更好的融合性能,但现今仍存在一些需要改进的问题。现在所用的深度学习方法基本上都是卷积神经网络方法,卷积神经网络虽然效率很高,但是这种方法打断了图像的相关性,不能很好地提取图像多方面的相关信息,如红外和可见光图像的互补特征,对后续的图像融合造成一定的影响。虽然卷积网络提取特征快速,不过对特征辨识较差,容易将冗余特征融合到融合图像中,使融合图像视觉质量变差。而且损失函数设计的不恰当,造成融合图像的颜色失真。

技术实现思路

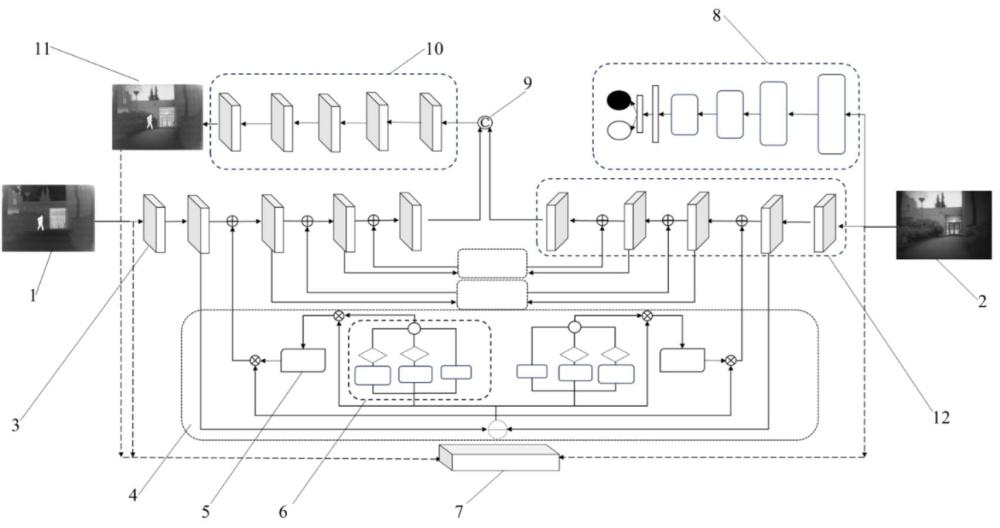

1、为了克服现有技术的不足,本发明提出了一种多尺度注意力卷积神经网络的红外可见光图像融合方法。利用卷积神经网络对不同源的红外和可见光图像进行特征提取,初步提取图像中的显著信息和细节信息,但是如果仅仅使用卷积神经网络,就会造成特征信息不全面的问题,从一种图像提取的信息没有相关性,对后续的结果造成很大的影响。所以本发明不仅使用了卷积神经网络,还在这个卷积神经网络后并联了一个多尺度注意力模块,用来处理红外和可见光图像的互补特征,以及去除冗余特征,弥补了卷积神经网络的这一缺陷,并且所得的融合结果也更具自然性,最终得到理想的融合结果。还采用损失函数模块进行多方面的损失约束,使融合图像融合成功不出现颜色失真与光谱污染,弥补了卷积神经网络融合红外和可见光图像缺陷。

2、为实现上述目的,本发明采用了如下技术方案:

3、一种多尺度注意力卷积神经网络的红外可见光图像融合方法,包括:

4、s1、构建多尺度注意力卷积神经网络:将多尺度全局平均池化注意力单元和并行结构通道注意力单元串联组成多尺度注意力模块,将所述多尺度注意力模块并联到卷积神经网络,构建多尺度注意力卷积神经网络;所述多尺度注意力卷积神经网络还包括光照判别辅助网络和损失函数模块,所述光照判别辅助网络与卷积神经网络和多尺度注意力模块并行运行,可见光图像输入到这个辅助网络计算光照概率权重赋予给损失函数模块;所述损失函数模块用于对生成的融合图像进行损失计算来指导多尺度注意力卷积神经网络训练与优化;

5、s2、训练光照判别辅助网络:将批处理可见光图像输入到光照判别辅助网络计算光照概率权重赋予给损失函数模块;

6、s3、训练多尺度注意力卷积神经网络:批处理红外和可见光图像并输入到卷积神经网络,得到红外图像和可见光图像的原特征,将原特征进行差分操作得到两种互补特征,将两种互补特征输入到多尺度注意力模块处理后得到带注意力权重的两种互补特征,然后将带注意力权重的两种互补特征叠加反馈到卷积神经网络与红外图像原特征和可见光图像原特征相加得到红外图像总特征和可见光图像总特征,红外图像总特征和可见光图像总特征进行通道维度的拼接后经卷积神经网络的图像重构器重构为融合图像,利用损失函数模块对融合图像进行损失计算,指导多尺度注意力卷积神经网络对融合图像的质量进行优化,得到完成训练的多尺度注意力卷积神经网络;

7、s4、利用训练完成的多尺度注意力卷积神经网络进行红外和可见光图像融合,得到最优融合图像。

8、进一步地,输入到卷积神经网络的批处理红外和可见光图像分辨率为n×n,是成对的图像且尺寸一致。

9、进一步地,所述卷积神经网络中的卷积层用于提取红外和可见光图像的原特征,记、分别为输入的红外图像的原特征表示和可见光图像的原特征表示,卷积神经网络中分别用于提取红外和可见光图像原特征的卷积层分为5个,第1个采用1×1卷积层,后面采用4个3×3卷积层,卷积层均采用激活函数处理非线性关系。

10、进一步地,卷积神经网络并联多尺度注意力模块,进行红外图像和可见光图像原特征的差分操作,采取特征相减方式得到互补特征,所述互补特征为和。

11、进一步地,所述多尺度注意力模块的多尺度全局平均池化注意力单元对互补特征处理表示为:

12、(1)

13、(2)

14、(3)

15、(4)

16、其中,表示为1×1全局平均池化层, 表示为2×2全局平均池化层,表示为4×4全局平均池化层,分别对输入的两种互补特征进行不同尺度的池化操作,、、和、、分别表示经多尺度全局平均池化注意力单元中不同尺度的全局平均池化层处理后的红外互补特征和可见光互补特征,上标1,2,4表示对应的、、全局平均池化层。表示sigmoid函数,表示插值。和分别表示最终经过多尺度全局平均池化注意力单元后的红外互补特征和可见光互补特征。

17、进一步地,多尺度注意力模块中,经过多尺度全局平均池化注意力单元的带注意力权重的互补特征与原互补特征逐元素相乘,再经过并行结构通道注意力单元,并行结构通道注意力单元串联在多尺度全局平均池化注意力单元之后,其对多尺度全局平均池化注意力单元的输出进行处理,经过并行结构通道注意力单元的处理后的特征再与原互补特征逐元素相乘,表示为:

18、(5)

19、 (6)

20、其中,pcau表示并行结构通道注意力单元进行处理,表示特征逐元素相乘。

21、经过并行结构通道注意力单元的带注意力权重的互补特征与原互补特征逐元素相乘后,将处理得到后的互补特征作为补充信息添加到红外图像原特征和可见光图像原特征中,得到红外图像总特征和可见光图像总特征,表示为:

22、(7)

23、(8)

24、其中,分别表示红外图像的总特征和可见光图像的总特征,表示特征逐元素相加。

25、图像特征的融合方式为所述红外总特征和可见光总特征进行通道维度的拼接,实现两者总特征的融合,表示为:

26、(9)

27、其中,分别表示红外图像的总特征和可见光图像的总特征,表示融合特征,c(·)指的是红外图像的总特征和可见光图像的总特征在通道维度上的连接。

28、图像重构器由5个卷积层组成,卷积层采用激活函数处理非线性关系。图像重构器从融合的特征中恢复融合图像,表示为:

29、(10)

30、多尺度注意力卷积神经网络这整个网络通过对输入的红外图像和输入的可见光图像计算强度损失,辅助强度损失和梯度损失来构造损失函数模块,损失函数模块作为一个总体损失来指导整个多尺度注意力卷积神经网络的训练,定义为:

31、(11)

32、其中,、、是分别表征强度损失、辅助强度损失、梯度损失重要性的权重参数。

33、进一步地,所述强度损失表示为带权重系数的红外图像强度损失和可见光图像强度损失之和。表示为:

34、(12)

35、(13)

36、(14)

37、其中,和分别为输入图像的高度和宽度,为范数。、、分别表示为红外图像、可见光图像、融合图像,和表示红外图像强度损失和可见光图像强度损失,和表示红外图像强度和可见光图像强度的权重系数,由光照判别辅助网络的输出提供。

38、进一步地,光照判别辅助网络由四个卷积层和两个完全连接层组成。卷积层采用激活函数处理非线性关系。两个完全连接层根据光照信息计算光照概率生成红外图像强度和可见光图像强度的权重系数和。

39、进一步地,所述的辅助强度损失为融合图像保持最优的强度分布,表示为:

40、(15)

41、其中,表示逐元素的最大选择。

42、进一步地,所述的梯度损失表示为:

43、 (16)

44、其中,表示测量图像纹理信息的梯度算子。是指绝对运算。

45、本发明与现有技术相比有如下优点:

46、(1). 本发明相比于传统方法不需要手动设计极其复杂的融合规则,减少了特征提取和融合过程。

47、(2). 本发明相比于卷积神经网络,增加了多尺度注意力模块和光照判别辅助网络,使融合图像的信息更加全面,实现红外特征信息和可见光特征信息充分融合,突显不同尺度特征,显著提升信息量。

48、(3). 本发明所提出的红外与可见光图像融合网络方法能在复杂场景中能消除冗余特征,提升图像融合质量。

- 还没有人留言评论。精彩留言会获得点赞!