基于物联网的安防设备

1.本技术涉及智能控制领域,且更为具体地,涉及一种基于物联网的安防设备。

背景技术:

2.指纹锁是常用的安防设备,其综合了物联网技术、计算机信息技术、电子技术、机械技术和五金工艺等。如今,指纹锁已被广泛地应用于各种场合中,例如,被应用于家庭,可以避免因钥匙丢失而带来的麻烦,再如被应用于公司,可以结合指纹锁来控制公司门的开启和关闭。

3.但是,在指纹锁的实际应用中,发现由于在录入指纹时用户的指纹处于规范且标准状态,但是在实际用户刷指纹时,用户的指纹表面可能存在水渍,用户可能并非以标准的姿势进行刷指纹,导致实施采集的指纹数据与实际录入的指纹之间的差异过大,而导致门禁无法开启,给用户造成诸多不便。

4.因此,期待一种优化的基于物联网的安防设备。

技术实现要素:

5.为了解决上述技术问题,提出了本技术。本技术的实施例提供了一种基于物联网的安防设备,其通过对所采集的指纹图像进行去雾处理,再利用基于深度卷积神经网络的特征提取器来提取所采集的指纹图像和录入的指纹图像的高维图像特征,并在高维特征空间中来比较两者的相似度,以提高匹配的精准度并兼顾安全性。

6.根据本技术的一个方面,提供了一种基于物联网的安防设备,其包括:

7.指纹采集单元,用于从数据库获取用户录入的参考指纹图像以及获取由部署于指纹锁内的摄像头采集的用户按压指纹图像;

8.去雾单元,用于将所述用户按压指纹图像通过基于对抗生成网络的去雾生成器以得到生成用户按压指纹图像;

9.指纹特征提取单元,用于将所述参考指纹图像和所述生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构;

10.差分单元,用于计算所述参考特征图和所述校验特征图之间的差分特征图;

11.判断单元,用于将所述差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配;以及

12.控制结果生成单元,用于响应于所述分类结果为用户按压指纹图像与参考指纹匹配,生成解锁控制指令。

13.在上述基于物联网的安防设备中,所述指纹特征提取单元,包括:检测指纹特征提取子单元,用于使用所述第一卷积神经网络的多层卷积层对所述生成用户按压指纹图像进行深度卷积编码以由所述多层卷积层的最后一层输出深度校验特征图;第一空间注意力子单元,用于将所述深度校验特征图输入所述第一卷积神经网络的第一空间注意力模块以得

到第一空间注意力图;以及,注意力施加子单元,用于计算所述深度校验特征图和所述第一空间注意力图的按位置点乘以得到所述校验特征图。

14.在上述基于物联网的安防设备中,所述指纹特征提取单元,包括:参考指纹特征提取子单元,用于使用所述第二卷积神经网络的多层卷积层对所述参考指纹图像进行深度卷积编码以由所述多层卷积层的最后一层输出深度参考特征图;第二空间注意力子单元,用于将所述深度参考特征图输入所述第二卷积神经网络的第二空间注意力模块以得到第二空间注意力图;以及,注意力作用子单元,用于计算所述深度参考特征图和所述第二空间注意力图的按位置点乘以得到所述参考特征图。

15.在上述基于物联网的安防设备中,所述差分单元,进一步用于:以如下公式计算计算所述参考特征图和所述校验特征图之间的差分特征图;

16.其中,所述公式为:

[0017][0018]

其中,f1表示所述参考特征图,f2表示所述校验特征图,fc表示所述差分特征图,表示按位置差分。

[0019]

在上述基于物联网的安防设备中,所述判断单元,包括:以如下公式对所述差分特征图进行处理以生成分类结果;

[0020]

其中,所述公式为:

[0021]

softmax{(wn,bn):

…

:(w1,b1)|project(f)},其中project(f)表示将所述差分特征图投影为向量,w1至wn为各层全连接层的权重矩阵,b1至bn表示各层全连接层的偏置矩阵。

[0022]

在上述基于物联网的安防设备中,所述基于物联网的安防设备,还包括用于对所述基于对抗生成网络的去雾生成器、所述孪生网络模型和所述分类器进行训练的训练模块。

[0023]

在上述基于物联网的安防设备中,所述训练模块,包括:训练数据采集单元,用于获取训练数据,所述训练数据包括训练参考指纹图像、获取由部署于所述指纹锁内的摄像头采集的训练用户按压指纹图像、以及,所述训练用户按压指纹图像与所述训练参考指纹是否匹配的真实值;训练去雾单元,用于将所述训练用户按压指纹图像通过所述基于对抗生成网络的去雾生成器以得到训练生成用户按压指纹图像;训练指纹特征提取单元,用于将所述训练参考指纹图像和所述训练生成用户按压指纹图像通过所述包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到训练参考特征图和训练校验特征图;训练差分单元,用于计算所述训练参考特征图和所述训练校验特征图之间的训练差分特征图;训练判断单元,用于将所述训练差分特征图通过分类器以得到分类损失函数值;特征提取模式消解损失单元,用于计算所述训练参考特征图和所述训练校验特征图的特征提取模式消解的抑制损失函数值,所述特征提取模式消解的抑制损失函数值与由所述训练参考特征图展开得到的第一特征向量和由所述训练校验特征图展开得到的第二特征向量之间的差分特征向量的二范数的平方有关;以及,训练单元,用于以所述特征提取模式消解的抑制损失函数值和所述分类损失函数值之间的加权和作为分类损失函数值对所述基于对抗生成网络的去雾生成器、所述孪生网络模型和所述分类器进行训练。

[0024]

根据本技术的另一方面,提供了一种基于物联网的安防方法,其包括:

[0025]

从数据库获取用户录入的参考指纹图像以及获取由部署于指纹锁内的摄像头采集的用户按压指纹图像;

[0026]

将所述用户按压指纹图像通过基于对抗生成网络的去雾生成器以得到生成用户按压指纹图像;

[0027]

将所述参考指纹图像和所述生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构;

[0028]

计算所述参考特征图和所述校验特征图之间的差分特征图;

[0029]

将所述差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配;以及

[0030]

响应于所述分类结果为用户按压指纹图像与参考指纹匹配,生成解锁控制指令。

[0031]

根据本技术的再一方面,提供了一种电子设备,包括:处理器;以及,存储器,在所述存储器中存储有计算机程序指令,所述计算机程序指令在被所述处理器运行时使得所述处理器执行如上所述的基于物联网的安防方法。

[0032]

根据本技术的又一方面,提供了一种计算机可读介质,其上存储有计算机程序指令,所述计算机程序指令在被处理器运行时使得所述处理器执行如上所述的基于物联网的安防方法。

[0033]

与现有技术相比,本技术提供的一种基于物联网的安防设备,其通过对所采集的指纹图像进行去雾处理,再利用基于深度卷积神经网络的特征提取器来提取所采集的指纹图像和录入的指纹图像的高维图像特征,并在高维特征空间中来比较两者的相似度,继而提高匹配的精准度,以生成相应的控制指令。

附图说明

[0034]

通过结合附图对本技术实施例进行更详细的描述,本技术的上述以及其他目的、特征和优势将变得更加明显。附图用来提供对本技术实施例的进一步理解,并且构成说明书的一部分,与本技术实施例一起用于解释本技术,并不构成对本技术的限制。在附图中,相同的参考标号通常代表相同部件或步骤。

[0035]

图1图示了根据本技术实施例的基于物联网的安防设备的应用场景图;

[0036]

图2图示了根据本技术实施例的基于物联网的安防设备的框图;

[0037]

图3图示了根据本技术实施例的基于物联网的安防设备的框图;

[0038]

图4图示了根据本技术实施例的基于物联网的安防设备中推断模块的系统架构图;

[0039]

图5图示了根据本技术实施例的基于物联网的安防设备中指纹特征提取单元的框图;

[0040]

图6图示了根据本技术实施例的基于物联网的安防设备中指纹特征提取单元的框图;

[0041]

图7图示了根据本技术实施例的基于物联网的安防设备中训练模块的系统架构图;

[0042]

图8图示了根据本技术实施例的基于物联网的安防方法的流程图;

具体实施方式

[0043]

下面,将参考附图详细地描述根据本技术的示例实施例。显然,所描述的实施例仅仅是本技术的一部分实施例,而不是本技术的全部实施例,应理解,本技术不受这里描述的示例实施例的限制。

[0044]

场景概述

[0045]

针对上述技术问题,本技术的申请人发现在用户刷指纹时,如果用户指纹表面存在水渍,可所采集的图像会发生雾化模糊,导致匹配失败;当用户并非以标准的姿势进行刷指纹时,因所采集的指纹仅是录入指纹的局部且发生了旋转,会导致匹配失败。在第一失败场景中,可通过对所采集的指纹图像进行去雾处理来提升匹配精准度,在第二失败场景中,可利用基于深度卷积神经网络的特征提取器来提取所采集的指纹图像和录入的指纹图像的高维图像特征,并在高维特征空间中来比较两者的相似度,继而提高匹配的精准度。

[0046]

具体地,在本技术的技术方案中,首先从数据库获取用户录入的参考指纹以及获取由部署于指纹锁内的摄像头采集的用户按压指纹图像。然后,将所述用户按压指纹图像通过基于对抗生成网络的去雾生成器以得到生成用户按压指纹图像。如上所述,在用户刷指纹时,如果用户指纹表面存在水渍,可所采集的图像会发生雾化模糊,相应地,在本技术的技术方案中,使用基于对抗生成网络的去雾生成器对所述用户按压指纹图像进行对抗生成以得到所述生成用户按压指纹图像。具体地,所述基于对抗生成网络的去雾生成器包括生成器和鉴别器,其中,所述生成器用于生成去雾图像,所述鉴别器用于计算去雾图像和真实图像之间的鉴别器损失函数值,并基于所述鉴别器损失函数值作为损失函数值并通过bp算法来更新所述生成器的神经网络参数。

[0047]

在得到所述生成用户按压指纹图像后,将所述参考指纹图像和所述生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构。也就是,将所述参考指纹图像和经去雾处理后的所述生成用户按压指纹图像通过具有对称网络结构的孪生网络模型,其中,所述孪生网络模型的第一卷积神经网络和第二卷积神经网络用于对所述参考指纹图像和所述生成用户按压指纹图像进行显式空间编码提取所述参考指纹图像和所述生成用户按压指纹图像中的高维局部隐含特征以得到所述参考特征图和校验特征图。

[0048]

考虑到在本技术的技术方案中,所述参考指纹图像和所述生成用户按压指纹图像中各个像素对于后续匹配判断的重要性不同,这方面特性可通过空间注意力机制来关注。也就是,优选地,在本技术的技术方案中,将空间注意力机制集成于所述第一卷积神经网络和所述第二卷积神经网络。

[0049]

在得到参考特征图和所述校验特征图后,计算所述参考特征图和所述校验特征图之间的差分特征图。也就是,计算所述参考指纹图像和所述生成用户按压指纹图像在高维特征空间中的特征分布的差异。在一个具体的示例中,计算所述参考特征图和所述校验特征图之间的按位置差分以得到所述差分特征图。接着。将所述差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配,进一步地,当

所述分类结果为用户按压指纹图像与参考指纹匹配时,生成解锁控制指令来进行指纹解锁门禁,通过这样的方式,可在兼顾安全性的同时,提高匹配的精准度。

[0050]

特别地,在本技术的技术方案中,由于分类特征图是计算所述参考特征图和所述校验特征图之间的差分特征图得到的,因此在训练过程中,分类器的分类损失函数在梯度反向传播时会分别通过所述第一卷积神经网络和所述第二卷积神经网络,从而可能由于异常的梯度发散导致所述第一卷积神经网络和所述第二卷积神经网络的特征提取模式的消解,从而影响所述差分特征图的分类结果的准确性。

[0051]

因此,优选地,引入针对所述参考特征图和所述校验特征图的特征提取模式消解的抑制损失函数,表示为:

[0052][0053][0054]

这里,v1和v2分别是所述参考特征图和所述校验特征图展开后得到的特征向量,m1和m2分别是所述分类器对于所述特征向量v1和v2的权重矩阵,||

·

||f表示矩阵的f范数,且表示向量的二范数的平方。

[0055]

具体地,所述特征提取模式消解的抑制损失函数通过以交叉熵形式使得分类器相对于不同特征向量的权重矩阵的差异分布与特征向量的真实的特征差异分布保持一致,来保证梯度反向传播时的定向导数在梯度传播的分支点附近得到正则化,也就是,将梯度针对所述第一卷积神经网络和所述第二卷积神经网络的特征提取模式进行过加权,这样,就对特征提取模式的消解进行了抑制,提升了所述参考特征图和所述校验特征图的特征表达能力,也就相应提升了所述差分特征图的分类结果的准确性。这样,提高指纹匹配判断的精准度,以兼顾安全性和敏感性。

[0056]

基于此,本技术提出了一种基于物联网的安防设备,其包括:指纹采集单元,用于从数据库获取用户录入的参考指纹图像以及获取由部署于指纹锁内的摄像头采集的用户按压指纹图像;去雾单元,用于将所述用户按压指纹图像通过基于对抗生成网络的去雾生成器以得到生成用户按压指纹图像;指纹特征提取单元,用于将所述参考指纹图像和所述生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构;差分单元,用于计算所述参考特征图和所述校验特征图之间的差分特征图;判断单元,用于将所述差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配;以及,控制结果生成单元,用于响应于所述分类结果为用户按压指纹图像与参考指纹匹配,生成解锁控制指令。

[0057]

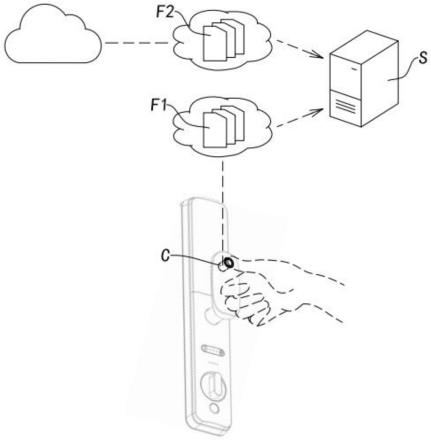

图1图示了根据本技术实施例的基于物联网的安防设备的应用场景图。如图1所示,在该应用场景中,通过部署于指纹锁内的摄像头(例如,如图1中所示意的c)采集用户的按压指纹图像(例如,如图1中所示意的f1),以及从数据库获取用户录入的参考指纹图像(例如,如图1中所示意的f2)。接着,将上述图像输入至部署有用于基于物联网的安防算法的服务器(例如,图1中的s)中,其中,所述服务器能够以所述基于物联网的安防算法对上述图像进行处理,以生成用于表示用户按压指纹图像与参考指纹是否匹配的分类结果,进而

生成相应的控制指令。

[0058]

在介绍了本技术的基本原理之后,下面将参考附图来具体介绍本技术的各种非限制性实施例。

[0059]

示例性系统

[0060]

图2图示了根据本技术实施例的基于物联网的安防设备的框图。如图2所示,根据本技术实施例的基于物联网的安防设备300包括推断模块,其中,所述推断模块包括:指纹采集单元310;去雾单元320;指纹特征提取单元330;差分单元340;判断单元350;以及,控制结果生成单元360。

[0061]

其中,所述指纹采集单元310,用于从数据库获取用户录入的参考指纹图像以及获取由部署于指纹锁内的摄像头采集的用户按压指纹图像;所述去雾单元320,用于将所述用户按压指纹图像通过基于对抗生成网络的去雾生成器以得到生成用户按压指纹图像;所述指纹特征提取单元330,用于将所述参考指纹图像和所述生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构;所述差分单元340,用于计算所述参考特征图和所述校验特征图之间的差分特征图;所述判断单元350,用于将所述差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配;以及,所述控制结果生成单元360,用于响应于所述分类结果为用户按压指纹图像与参考指纹匹配,生成解锁控制指令。

[0062]

图4图示了根据本技术实施例的基于物联网的安防设备中推断模块的系统架构图。如图4所示,在所述基于物联网的安防设备300的系统架构中,在推断过程中,首先通过所述指纹采集单元310从数据库获取用户录入的参考指纹图像以及获取由部署于指纹锁内的摄像头采集的用户按压指纹图像;所述去雾单元320将所述指纹采集单元310获取的用户按压指纹图像通过基于对抗生成网络的去雾生成器以得到生成用户按压指纹图像;接着,所述指纹特征提取单元330将所述指纹采集单元310获取的参考指纹图像和所述去雾单元320得到的生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构;所述差分单元340计算所述指纹特征提取单元330生成的参考特征图和所述校验特征图之间的差分特征图;然后,所述判断单元350将所述差分单元340计算所得的差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配;进而,所述控制结果生成单元360响应于所述分类结果为用户按压指纹图像与参考指纹匹配,生成解锁控制指令。

[0063]

具体地,在所述基于物联网的安防设备300的运行过程中,所述指纹采集单元310和所述去雾单元320,用于从数据库获取用户录入的参考指纹图像以及获取由部署于指纹锁内的摄像头采集的用户按压指纹图像,并将所述用户按压指纹图像通过基于对抗生成网络的去雾生成器以得到生成用户按压指纹图像。应可以理解,在用户刷指纹时,如果用户指纹表面存在水渍,可所采集的图像会发生雾化模糊,相应地,在本技术的技术方案中,使用基于对抗生成网络的去雾生成器对所述用户按压指纹图像进行对抗生成以得到所述生成用户按压指纹图像。具体地,所述基于对抗生成网络的去雾生成器包括生成器和鉴别器,其中,所述生成器用于生成去雾图像,所述鉴别器用于计算去雾图像和真实图像之间的鉴别

器损失函数值,并基于所述鉴别器损失函数值作为损失函数值并通过bp算法来更新所述生成器的神经网络参数。

[0064]

具体地,在所述基于物联网的安防设备300的运行过程中,所述指纹特征提取单元330,用于将所述参考指纹图像和所述生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构。在得到所述生成用户按压指纹图像后,将所述参考指纹图像和所述生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构。也就是,将所述参考指纹图像和经去雾处理后的所述生成用户按压指纹图像通过具有对称网络结构的孪生网络模型,其中,所述孪生网络模型的第一卷积神经网络和第二卷积神经网络用于对所述参考指纹图像和所述生成用户按压指纹图像进行显式空间编码提取所述参考指纹图像和所述生成用户按压指纹图像中的高维局部隐含特征以得到所述参考特征图和校验特征图。考虑到在本技术的技术方案中,所述参考指纹图像和所述生成用户按压指纹图像中各个像素对于后续匹配判断的重要性不同,这方面特性可通过空间注意力机制来关注。也就是,优选地,在本技术的技术方案中,将空间注意力机制集成于所述第一卷积神经网络和所述第二卷积神经网络。

[0065]

图5图示了根据本技术实施例的基于物联网的安防设备中指纹特征提取单元的框图。如图5所示,所述指纹特征提取单元330,包括:检测指纹特征提取子单元331,用于使用所述第一卷积神经网络的多层卷积层对所述生成用户按压指纹图像进行深度卷积编码以由所述多层卷积层的最后一层输出深度校验特征图;第一空间注意力子单元332,用于将所述深度校验特征图输入所述第一卷积神经网络的第一空间注意力模块以得到第一空间注意力图;以及,注意力施加子单元333,用于计算所述深度校验特征图和所述第一空间注意力图的按位置点乘以得到所述校验特征图。

[0066]

图6图示了根据本技术实施例的基于物联网的安防设备中指纹特征提取单元的框图。如图6所示,所述指纹特征提取单元330,包括:参考指纹特征提取子单元3311,用于使用所述第二卷积神经网络的多层卷积层对所述参考指纹图像进行深度卷积编码以由所述多层卷积层的最后一层输出深度参考特征图;第二空间注意力子单元3321,用于将所述深度参考特征图输入所述第二卷积神经网络的第二空间注意力模块以得到第二空间注意力图;以及,注意力作用子单元3331,用于计算所述深度参考特征图和所述第二空间注意力图的按位置点乘以得到所述参考特征图。

[0067]

具体地,在所述基于物联网的安防设备300的运行过程中,所述差分单元340,用于计算所述参考特征图和所述校验特征图之间的差分特征图。也就是,计算所述参考指纹图像和所述生成用户按压指纹图像在高维特征空间中的特征分布的差异。在一个具体的示例中,计算所述参考特征图和所述校验特征图之间的按位置差分以得到所述差分特征图。在本技术的一个具体示例中,所述差分单元,进一步用于:以如下公式计算计算所述参考特征图和所述校验特征图之间的差分特征图;

[0068]

其中,所述公式为:

[0069]

[0070]

其中,f1表示所述参考特征图,f2表示所述校验特征图,fc表示所述差分特征图,表示按位置差分。

[0071]

具体地,在所述基于物联网的安防设备300的运行过程中,所述判断单元350和所述控制结果生成单元360,用于将所述差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配,且响应于所述分类结果为用户按压指纹图像与参考指纹匹配,生成解锁控制指令。应可以理解,将所述差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配,进一步地,当所述分类结果为用户按压指纹图像与参考指纹匹配时,生成解锁控制指令来进行指纹解锁门禁,通过这样的方式,可在兼顾安全性的同时,提高匹配的精准度。在本技术的一个具体示例中,所述判断单元,包括:以如下公式对所述差分特征图进行处理以生成分类结果;

[0072]

其中,所述公式为:

[0073]

softmax{(wn,bn):

…

:(w1,b1)|project(f)},其中project(f)表示将所述差分特征图投影为向量,w1至wn为各层全连接层的权重矩阵,b1至bn表示各层全连接层的偏置矩阵。

[0074]

应可以理解,在利用上述神经网络模型进行推断之前,需要对所述基于对抗生成网络的去雾生成器、所述孪生网络模型和所述分类器进行训练。也就是说,在本技术的基于物联网的安防设备中,还包括训练模块,用于对所述基于对抗生成网络的去雾生成器、所述孪生网络模型和所述分类器进行训练。

[0075]

图3图示了根据本技术实施例的基于物联网的安防设备的框图。如图3所示,根据本技术实施例的基于物联网的安防设备300,还包括训练模块400,所述训练模块包括:训练数据采集单元410;训练去雾单元420;训练指纹特征提取单元430;训练差分单元440;训练判断单元450;特征提取模式消解损失单元460;和训练单元470。

[0076]

其中,所述训练数据采集单元410,用于获取训练数据,所述训练数据包括训练参考指纹图像、获取由部署于所述指纹锁内的摄像头采集的训练用户按压指纹图像、以及,所述训练用户按压指纹图像与所述训练参考指纹是否匹配的真实值;所述训练去雾单元420,用于将所述训练用户按压指纹图像通过所述基于对抗生成网络的去雾生成器以得到训练生成用户按压指纹图像;所述训练指纹特征提取单元430,用于将所述训练参考指纹图像和所述训练生成用户按压指纹图像通过所述包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到训练参考特征图和训练校验特征图;所述训练差分单元440,用于计算所述训练参考特征图和所述训练校验特征图之间的训练差分特征图;所述训练判断单元450,用于将所述训练差分特征图通过分类器以得到分类损失函数值;所述特征提取模式消解损失单元460,用于计算所述训练参考特征图和所述训练校验特征图的特征提取模式消解的抑制损失函数值,所述特征提取模式消解的抑制损失函数值与由所述训练参考特征图展开得到的第一特征向量和由所述训练校验特征图展开得到的第二特征向量之间的差分特征向量的二范数的平方有关;以及,所述训练单元470,用于以所述特征提取模式消解的抑制损失函数值和所述分类损失函数值之间的加权和作为分类损失函数值对所述基于对抗生成网络的去雾生成器、所述孪生网络模型和所述分类器进行训练。

[0077]

图7图示了根据本技术实施例的基于物联网的安防设备中训练模块的系统架构图。如图7所示,在所述基于物联网的安防设备300的系统架构中,在训练过程中,首先通过

所述训练数据采集单元410获取训练数据,所述训练数据包括训练参考指纹图像、获取由部署于所述指纹锁内的摄像头采集的训练用户按压指纹图像、以及,所述训练用户按压指纹图像与所述训练参考指纹是否匹配的真实值;所述训练去雾单元420将所述训练数据采集单元410获取的训练用户按压指纹图像通过所述基于对抗生成网络的去雾生成器以得到训练生成用户按压指纹图像;然后,所述训练指纹特征提取单元430将所述训练数据采集单元410获取的训练参考指纹图像和所述去雾单元420得到的训练生成用户按压指纹图像通过所述包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到训练参考特征图和训练校验特征图;所述训练差分单元440计算所述训练参考特征图和所述训练校验特征图之间的训练差分特征图;接着,所述训练判断单元450将所述训练差分单元440计算所得的训练差分特征图通过分类器以得到分类损失函数值;所述特征提取模式消解损失单元460计算所述训练参考特征图和所述训练校验特征图的特征提取模式消解的抑制损失函数值,所述特征提取模式消解的抑制损失函数值与由所述训练参考特征图展开得到的第一特征向量和由所述训练校验特征图展开得到的第二特征向量之间的差分特征向量的二范数的平方有关;进而,所述训练单元470以所述特征提取模式消解的抑制损失函数值和所述分类损失函数值之间的加权和作为分类损失函数值对所述基于对抗生成网络的去雾生成器、所述孪生网络模型和所述分类器进行训练。

[0078]

特别地,在本技术的技术方案中,由于分类特征图是计算所述参考特征图和所述校验特征图之间的差分特征图得到的,因此在训练过程中,分类器的分类损失函数在梯度反向传播时会分别通过所述第一卷积神经网络和所述第二卷积神经网络,从而可能由于异常的梯度发散导致所述第一卷积神经网络和所述第二卷积神经网络的特征提取模式的消解,从而影响所述差分特征图的分类结果的准确性。

[0079]

因此,优选地,引入针对所述参考特征图和所述校验特征图的特征提取模式消解的抑制损失函数,表示为:

[0080][0081][0082]

这里,v1和v2分别是所述参考特征图和所述校验特征图展开后得到的特征向量,m1和m2分别是所述分类器对于所述特征向量v1和v2的权重矩阵,‖

·

‖f表示矩阵的f范数,且表示向量的二范数的平方。

[0083]

具体地,所述特征提取模式消解的抑制损失函数通过以交叉熵形式使得分类器相对于不同特征向量的权重矩阵的差异分布与特征向量的真实的特征差异分布保持一致,来保证梯度反向传播时的定向导数在梯度传播的分支点附近得到正则化,也就是,将梯度针对所述第一卷积神经网络和所述第二卷积神经网络的特征提取模式进行过加权,这样,就对特征提取模式的消解进行了抑制,提升了所述参考特征图和所述校验特征图的特征表达能力,也就相应提升了所述差分特征图的分类结果的准确性。这样,提高指纹匹配判断的精准度,以兼顾安全性和敏感性。

[0084]

综上,根据本技术实施例的基于物联网的安防设备300被阐明,其通过对所采集的指纹图像进行去雾处理,再利用基于深度卷积神经网络的特征提取器来提取所采集的指纹

图像和录入的指纹图像的高维图像特征,并在高维特征空间中来比较两者的相似度,继而提高匹配的精准度,以生成相应的控制指令。

[0085]

如上所述,根据本技术实施例的基于物联网的安防设备可以实现在各种终端设备中。在一个示例中,根据本技术实施例的基于物联网的安防设备300可以作为一个软件模块和/或硬件模块而集成到终端设备中。例如,该基于物联网的安防设备300可以是该终端设备的操作系统中的一个软件模块,或者可以是针对于该终端设备所开发的一个应用程序;当然,该基于物联网的安防设备300同样可以是该终端设备的众多硬件模块之一。

[0086]

替换地,在另一示例中,该基于物联网的安防设备300与该终端设备也可以是分立的设备,并且该基于物联网的安防设备300可以通过有线和/或无线网络连接到该终端设备,并且按照约定的数据格式来传输交互信息。

[0087]

示例性方法

[0088]

图8图示了根据本技术实施例的基于物联网的安防方法的流程图。如图8所示,根据本技术实施例的基于物联网的安防方法,包括步骤:s110,从数据库获取用户录入的参考指纹图像以及获取由部署于指纹锁内的摄像头采集的用户按压指纹图像;s120,将所述用户按压指纹图像通过基于对抗生成网络的去雾生成器以得到生成用户按压指纹图像;s130,将所述参考指纹图像和所述生成用户按压指纹图像通过包含第一卷积神经网络和第二卷积神经网络的孪生网络模型以得到参考特征图和校验特征图,所述第一卷积神经网络和所述第二卷积神经网络具有相同的网络结构;s140,计算所述参考特征图和所述校验特征图之间的差分特征图;s150,将所述差分特征图通过分类器以得到分类结果,所述分类结果用于表示用户按压指纹图像与参考指纹是否匹配;以及,s160,响应于所述分类结果为用户按压指纹图像与参考指纹匹配,生成解锁控制指令。

[0089]

在一个示例中,在上述基于物联网的安防方法中,所述步骤s130,包括:使用所述第一卷积神经网络的多层卷积层对所述生成用户按压指纹图像进行深度卷积编码以由所述多层卷积层的最后一层输出深度校验特征图;将所述深度校验特征图输入所述第一卷积神经网络的第一空间注意力模块以得到第一空间注意力图;以及,计算所述深度校验特征图和所述第一空间注意力图的按位置点乘以得到所述校验特征图。

[0090]

在一个示例中,在上述基于物联网的安防方法中,所述步骤s130,包括:使用所述第二卷积神经网络的多层卷积层对所述参考指纹图像进行深度卷积编码以由所述多层卷积层的最后一层输出深度参考特征图;将所述深度参考特征图输入所述第二卷积神经网络的第二空间注意力模块以得到第二空间注意力图;以及,计算所述深度参考特征图和所述第二空间注意力图的按位置点乘以得到所述参考特征图。

[0091]

在一个示例中,在上述基于物联网的安防方法中,所述步骤s140,包括:以如下公式计算计算所述参考特征图和所述校验特征图之间的差分特征图;

[0092]

其中,所述公式为:

[0093][0094]

其中,f1表示所述参考特征图,f2表示所述校验特征图,fc表示所述差分特征图,表示按位置差分。

[0095]

在一个示例中,在上述基于物联网的安防方法中,所述步骤s150,包括:以如下公

式对所述差分特征图进行处理以生成分类结果;

[0096]

其中,所述公式为:

[0097]

softmax{(wn,bn):

…

:(w1,b1)|project(f)},其中project(f)表示将所述差分特征图投影为向量,w1至wn为各层全连接层的权重矩阵,b1至bn表示各层全连接层的偏置矩阵。

[0098]

综上,根据本技术实施例的基于物联网的安防方法被阐明,其通过对所采集的指纹图像进行去雾处理,再利用基于深度卷积神经网络的特征提取器来提取所采集的指纹图像和录入的指纹图像的高维图像特征,并在高维特征空间中来比较两者的相似度,以提高匹配的精准度并兼顾安全性。

相关技术

网友询问留言

已有0条留言

- 还没有人留言评论。精彩留言会获得点赞!

1